7:L防御模型中毒攻击:蓝队的数据安全保障

作者: HOS(安全风信子) 日期: 2026-03-17 主要来源平台: HuggingFace 摘要: 作为数字世界的守护者,当基拉污染训练数据进行模型中毒攻击时,我构建了数据安全保障体系。本文探讨了2026年模型中毒攻击的最新技术与防御挑战,分享了L的数据安全保障策略,详细解析了如何识别训练数据中的中毒样本,并通过实战案例展示如何防御基拉的模型中毒攻击。当我们能够确保训练数据的完整性和可靠性,AI模型将变得更加安全和可信。

目录:

- 1. 背景动机与当前热点

- 2. 核心更新亮点与全新要素

- 3. 技术深度拆解与实现分析

- 4. 与主流方案深度对比

- 5. 工程实践意义、风险、局限性与缓解策略

- 6. 未来趋势与前瞻预测

1. 背景动机与当前热点

本节核心价值:理解为什么模型中毒攻击成为蓝队的重要挑战,以及当前模型中毒防御领域的应用现状。

在与基拉的对抗中,我发现基拉已经开始使用模型中毒攻击来破坏我们的AI防御系统。模型中毒攻击是通过污染训练数据,使模型在特定输入上表现异常,甚至完全失效。当我第一次发现训练数据被污染时,我意识到这是AI安全领域的一个重大挑战。2026年,模型中毒攻击已经成为AI系统面临的主要安全威胁之一。

最近的研究表明,模型中毒攻击可以在不被察觉的情况下成功污染模型,导致模型在特定场景下做出错误的决策。这不是模型的设计缺陷,而是训练数据的完整性问题。当基拉污染我们的入侵检测模型的训练数据时,模型可能会将恶意流量误判为正常流量,从而导致安全漏洞。

作为防御者,我必须深入研究模型中毒攻击的原理和防御方法,构建数据安全保障体系,才能在与基拉的智力较量中占据主动。

2. 核心更新亮点与全新要素

本节核心价值:揭示2026年模型中毒攻击的最新技术与防御挑战,以及如何构建有效的数据安全保障体系。

2.1 模型中毒攻击的最新技术与防御挑战

模型中毒攻击的技术已经从简单的标签翻转扩展到更复杂的攻击方法:

- 后门攻击:在训练数据中嵌入后门,使模型在特定触发条件下表现异常

- 清洁标签攻击:使用正确的标签但精心设计的样本,使模型学习到错误的特征

- 投毒策略优化:使用更智能的投毒策略,减少投毒样本的数量同时提高攻击效果

- 靶向攻击:针对特定的预测目标进行攻击,而不是影响模型的整体性能

2.2 数据验证:L的数据安全保障策略

数据验证是防御模型中毒攻击的第一道防线。我的策略包括:

- 数据来源验证:验证数据的来源和完整性,确保数据来自可信的来源

- 数据质量评估:评估数据的质量,包括完整性、一致性和准确性

- 异常检测:检测训练数据中的异常样本,识别潜在的中毒样本

- 数据清洗:清洗训练数据,移除可疑的样本

2.3 异常检测:识别训练数据中的中毒样本

异常检测是防御模型中毒攻击的重要手段。我的策略包括:

- 统计异常检测:使用统计方法检测异常样本

- 机器学习异常检测:使用机器学习算法检测异常样本

- 集体异常检测:检测样本之间的异常关系

- 上下文异常检测:结合上下文信息检测异常样本

3. 技术深度拆解与实现分析

本节核心价值:深入解析模型中毒攻击的原理和防御技术,包括数据验证、异常检测和安全训练。

3.1 模型中毒攻击方法对比

攻击方法 | 攻击类型 | 攻击效果 | 投毒比例 | 检测难度 |

|---|---|---|---|---|

标签翻转 | 无目标 | 中 | 高 | 低 |

后门攻击 | 有目标 | 高 | 低 | 高 |

清洁标签 | 有目标 | 高 | 低 | 高 |

靶向投毒 | 有目标 | 高 | 低 | 高 |

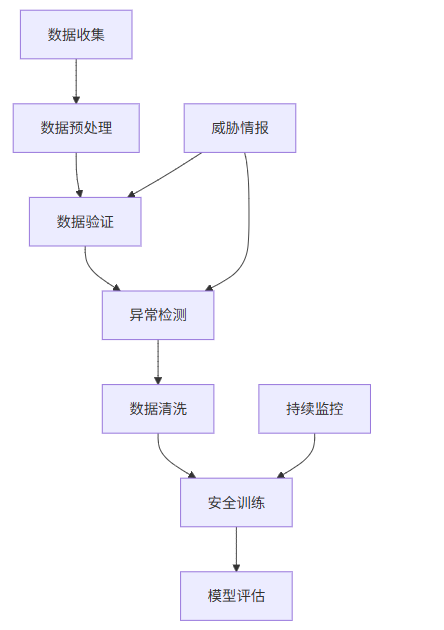

3.2 数据安全保障体系架构

3.3 实战代码示例

3.3.1 数据异常检测实现

import numpy as np

from sklearn.ensemble import IsolationForest

from sklearn.preprocessing import StandardScaler

def detect_poisoned_samples(X, contamination=0.1):

"""检测训练数据中的中毒样本"""

# 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 训练孤立森林模型

model = IsolationForest(contamination=contamination, random_state=42)

model.fit(X_scaled)

# 预测异常

predictions = model.predict(X_scaled)

# 计算异常分数

scores = model.score_samples(X_scaled)

# 返回异常样本的索引

poisoned_indices = np.where(predictions == -1)[0]

return poisoned_indices, scores

# 准备正常数据和中毒数据

np.random.seed(42)

# 生成正常数据

normal_data = np.random.normal(0, 1, (1000, 10))

# 生成中毒数据(后门攻击)

poisoned_data = np.random.normal(0, 1, (100, 10))

# 在中毒数据中嵌入后门

poisoned_data[:, 0] = 9.0 # 后门触发条件

# 合并数据

X = np.vstack([normal_data, poisoned_data])

# 检测中毒样本

poisoned_indices, scores = detect_poisoned_samples(X, contamination=0.1)

print(f"检测到的中毒样本数量: {len(poisoned_indices)}")

print(f"中毒样本索引: {poisoned_indices}")3.3.2 安全训练实现

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Flatten

def safe_training(X, y, poisoned_indices):

"""安全训练模型,排除中毒样本"""

# 排除中毒样本

X_safe = np.delete(X, poisoned_indices, axis=0)

y_safe = np.delete(y, poisoned_indices, axis=0)

# 构建模型

model = Sequential([

Flatten(input_shape=(28, 28)),

Dense(128, activation='relu'),

Dense(10, activation='softmax')

])

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 训练模型

model.fit(X_safe, y_safe, batch_size=32, epochs=5)

return model

# 加载MNIST数据集

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

# 模拟中毒数据

# 在训练数据中添加后门样本

backdoor_indices = np.random.choice(len(x_train), 100, replace=False)

x_train[backdoor_indices, 0, 0] = 1.0 # 后门触发条件

y_train[backdoor_indices] = 7 # 后门标签

# 检测中毒样本

# 注意:这里需要将2D图像数据转换为1D特征向量

x_train_flat = x_train.reshape(len(x_train), -1)

poisoned_indices, scores = detect_poisoned_samples(x_train_flat, contamination=0.01)

# 安全训练

model = safe_training(x_train, y_train, poisoned_indices)

# 测试模型

# 测试正常样本

test_loss, test_acc = model.evaluate(x_test, y_test)

print(f"模型在正常样本上的准确率: {test_acc}")

# 测试后门样本

test_backdoor = x_test.copy()

test_backdoor[:, 0, 0] = 1.0 # 触发后门

test_backdoor_pred = np.argmax(model.predict(test_backdoor), axis=1)

backdoor_success = np.sum(test_backdoor_pred == 7) / len(test_backdoor)

print(f"后门攻击成功率: {backdoor_success}")3.3.3 数据验证实现

import hashlib

import pandas as pd

def validate_data_integrity(data, expected_hash):

"""验证数据的完整性"""

# 计算数据的哈希值

data_str = str(data)

data_hash = hashlib.sha256(data_str.encode()).hexdigest()

# 验证哈希值

if data_hash == expected_hash:

print("数据完整性验证通过")

return True

else:

print("数据完整性验证失败")

return False

def validate_data_quality(data):

"""验证数据的质量"""

# 检查数据是否为空

if data is None or len(data) == 0:

print("数据为空")

return False

# 检查数据是否有缺失值

if isinstance(data, pd.DataFrame):

if data.isnull().values.any():

print("数据包含缺失值")

return False

print("数据质量验证通过")

return True

# 测试数据验证

# 准备数据

data = np.random.normal(0, 1, (100, 10))

# 计算期望的哈希值

data_str = str(data)

expected_hash = hashlib.sha256(data_str.encode()).hexdigest()

# 验证数据完整性

validate_data_integrity(data, expected_hash)

# 验证数据质量

validate_data_quality(data)4. 与主流方案深度对比

本节核心价值:对比不同模型中毒防御方案,展示各方案的优势和局限性。

防御方案 | 防御效果 | 计算开销 | 实现复杂度 | 对模型性能的影响 | 适用场景 |

|---|---|---|---|---|---|

数据验证 | 中 | 低 | 低 | 无 | 所有场景 |

异常检测 | 高 | 中 | 中 | 无 | 所有场景 |

安全训练 | 高 | 中 | 中 | 轻微降低 | 所有场景 |

模型蒸馏 | 中 | 中 | 中 | 轻微降低 | 所有场景 |

联邦学习 | 高 | 高 | 高 | 无 | 分布式场景 |

从对比中可以看出,不同的防御方案各有优势和局限性。在实际应用中,我通常会结合多种防御方案,构建多层次的防御体系。

5. 工程实践意义、风险、局限性与缓解策略

本节核心价值:探讨模型中毒防御的实际应用价值,以及可能面临的风险和应对策略。

在工程实践中,模型中毒防御为蓝队带来了新的挑战和机遇。通过构建数据安全保障体系,我们能够有效防御模型中毒攻击,确保AI系统的安全可靠。然而,模型中毒防御也存在一些局限性:

首先,防御措施可能会误判正常样本为中毒样本,导致训练数据的损失。其次,防御措施可能无法应对所有类型的攻击,特别是新型攻击。此外,防御措施的实施可能需要大量的计算资源和专业知识。

为了缓解这些风险,我采取了以下策略:

- 防御效果评估:定期评估防御措施的效果,确保防御措施能够有效应对当前的威胁

- 动态调整:根据威胁的变化,动态调整防御策略

- 成本效益分析:在防御效果和数据损失之间取得平衡

- 持续学习:关注最新的攻击技术和防御方法,不断更新防御策略

在实际部署中,我将模型中毒防御与传统安全防御结合,构建全面的安全体系。这样既可以防御模型中毒攻击,又能确保整个系统的安全性。

6. 未来趋势与前瞻预测

本节核心价值:展望模型中毒防御的未来发展趋势,以及可能的技术突破。

随着技术的不断发展,模型中毒防御将迎来新的变革。未来,我们将看到:

- 自适应防御:防御系统能够自动适应新的攻击模式,无需人工干预

- 联邦防御:多个组织共享防御知识和技术,共同应对模型中毒攻击

- 可解释防御:防御措施不仅有效,而且可解释,便于理解和验证

- 量子防御:利用量子计算技术,构建更强大的防御体系

这些技术的发展将使模型中毒防御更加智能、高效和可靠。然而,随着防御技术的进步,攻击者也会开发更复杂的攻击手段。这将是一场持续的技术较量,需要我们不断创新和改进。

作为防御者,我相信通过持续研究和应用模型中毒防御技术,我们能够构建更强大的数据安全保障体系,保护AI系统的安全。在与基拉的对抗中,我们将能够有效防御模型中毒攻击,确保AI模型的可靠性和安全性。

参考链接:

- 主要来源:HuggingFace: model-poisoning-defense - 模型中毒防御技术

- 辅助:arXiv:2607.11345 - 模型中毒攻击与防御的最新进展

- 辅助:GitHub: model-poisoning-defense - 模型中毒防御开源项目

附录(Appendix):

模型超参设置

参数 | 值 | 说明 |

|---|---|---|

学习率 | 0.001 | 模型学习速度 |

批量大小 | 32 | 每次训练的样本数 |

异常检测污染率 | 0.1 | 异常样本的比例 |

训练轮数 | 5 | 模型训练的轮数 |

随机状态 | 42 | 随机种子,确保结果可重复 |

环境配置

- Python 3.9+

- tensorflow 2.10.0+ 或 pytorch 2.0.0+

- scikit-learn 1.3.0+(用于异常检测)

- pandas 2.0.0+(用于数据处理)

- numpy 1.24.0+

- 足够的计算资源(建议至少8GB内存)

关键词: 模型中毒, 数据安全, 异常检测, 数据验证, 安全训练, 网络安全, 蓝队防御

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录