万字深度实录:从一次凌晨三点的生产级"雪崩"事故 彻底重构微服务调用链路的认知体系

万字深度实录:从一次凌晨三点的生产级"雪崩"事故 彻底重构微服务调用链路的认知体系

jack.yang

发布于 2026-03-25 08:07:35

发布于 2026-03-25 08:07:35

序章:那个让所有人失眠的凌晨三点

1.1 事故背景:看似平静的夜晚

时间回溯到 2025 年 11 月 14 日,凌晨 02:45。对于大多数互联网人来说,这是深度睡眠的黄金时间。但对于"云尚优选"电商平台的 SRE(站点可靠性工程)团队和后端核心开发组而言,这却是噩梦的开始。

"云尚优选"是一个典型的基于 Spring Cloud Alibaba 构建的大型微服务电商平台。其架构涵盖了用户中心、商品中心、订单中心、支付中心、营销中心、物流中心等二十余个核心微服务模块。

🚨 告警信息

[CRITICAL] Order-Service Error Rate > 85% (Threshold: 5%)

[CRITICAL] Order-Service P99 Latency > 15000ms (Threshold: 2000ms)

初步判断:订单服务挂了?查看订单服务 pods 状态:Running。CPU、内存使用率正常。JVM GC 频率正常。数据库连接池未满。

那为什么所有请求都失败了?查看应用日志,满屏都是同一种刺眼的红色异常:

java.net.UnknownHostException: mall-product-service at java.net.InetAddress.getAllByName0(InetAddress.java) ... at org.springframework.cloud.openfeign.loadbalancer.FeignBlockingLoadBalancerClient.execute(...) ... Retrying attempt 1 after 1000 ms Retrying attempt 2 after 2000 ms feign.RetryableException: mall-product-service executing GET http://mall-product-service/api/v1/stock/check复制

"UnknownHostException: mall-product-service"。这个错误像一道闪电,击穿了所有人的认知防线。

1.2 事故的反思与本文的初衷

这次事故虽然最终通过回滚配置在 45 分钟内修复,但它留下的思考却是深远的:

- 黑盒恐惧:绝大多数开发者只会在 YAML 里配个 @FeignClient,一旦报错,除了重启和百度,对底层的"服务名如何变成 IP"这一过程一无所知。

- 原理断层:大家都知道 Nacos 是注册中心,Feign 是调用工具,但两者之间是如何协作的?LoadBalancer 在其中扮演了什么角色?本地缓存是如何维护的?这些关键环节在大家的脑海中是断裂的。

- 调试无力:当生产环境出现类似问题时,缺乏有效的本地复现和源码级调试手段,只能靠猜。

第一章:宏观视野——现代微服务架构的全景图谱

在深入代码之前,我们必须先跳出代码,站在架构的高度,看清整个系统的脉络。只有理解了数据在哪里流动,才能明白故障在哪里发生。

1.1 "云尚优选"生产架构详解

1.1.1 接入层:流量的入口

- DNS 解析 & CDN:用户访问 www.yunshang.com,首先经过 DNS 解析,将域名指向全局负载均衡器(GSLB),CDN 加速静态资源(图片、CSS、JS)。

- LVS/F5 + Nginx/OpenResty:四层负载均衡将流量分发到七层网关集群。

- Spring Cloud Gateway:作为统一的 API 网关,负责路由转发、鉴权认证、限流熔断、灰度发布、日志记录等跨切面逻辑。

1.1.2 核心服务层:业务的载体

这是架构中最复杂的部分,由数十个微服务组成,遵循 DDD(领域驱动设计)原则划分边界:

- 用户中心 (User Service):负责注册登录、个人信息、地址管理。

- 商品中心 (Product Service / mall-product-service):负责 SKU/SPU 管理、库存查询、价格计算。(本次事故的 Provider)

- 订单中心 (Order Service):负责下单、订单状态流转、超时取消。(本次事故的 Consumer)

- 支付中心 (Pay Service):对接支付宝、微信、银联,处理支付回调。

- 营销中心 (Marketing Service):优惠券、满减、秒杀活动。

- 物流中心 (Logistics Service):运费计算、快递轨迹追踪。

1.2 核心交互流程:一次下单的旅程

下单请求流程

- 用户发起请求:用户在 App 点击"立即下单"。

- 网关路由:请求到达 Gateway,鉴权通过后,根据路径 /api/order/create 路由到订单服务。

- 订单处理:订单服务接收到请求,开始事务。

- Feign 调用触发:订单服务代码中定义了 @FeignClient(name = "mall-product-service") 的接口。

- 服务发现与负载均衡(关键步骤):

- Feign 提取服务名 mall-product-service。

- LoadBalancer 介入,询问 Nacos 客户端:"mall-product-service 有哪些可用实例?"

- Nacos 客户端从本地内存缓存中返回实例列表:[10.0.1.5:8080, 10.0.1.6:8080, 10.0.1.7:8080]。

- LoadBalancer 根据策略(如轮询)选择一个实例,例如 10.0.1.6:8080。

- LoadBalancer 将请求 URL 从 http://mall-product-service/api/v1/stock/check 重写为 http://10.0.1.6:8080/api/v1/stock/check。

- HTTP 请求发送:底层的 HTTP 客户端(如 OkHttp)向 10.0.1.6:8080 发起真实请求。

- 商品服务响应:商品服务处理业务,返回库存充足。

- 后续流程:订单服务继续调用其他服务,扣减库存,创建订单记录,发送 MQ 消息,最终返回给用户"下单成功"。

第二章:Nacos 服务注册发现机制——分布式系统的"神经中枢"

要解决 UnknownHostException,首先必须深刻理解 Nacos 是如何工作的。它不仅仅是存个 IP 那么简单,其背后是一套复杂的分布式一致性协议和本地缓存更新机制。

2.1 服务注册:Provider 的"自我介绍"

注册流程详解

- 初始化上下文:Spring 容器启动,扫描到 @EnableDiscoveryClient(或在 Spring Cloud Alibaba 中自动启用),加载 NacosServiceRegistry。

- 提取元数据:

- Service Name: 来自 spring.application.name,即 mall-product-service。

- IP Address: 自动获取本机网卡 IP(支持多网卡筛选策略)。

- Port: 服务启动端口。

- Cluster Name: 默认为 DEFAULT,可用于同城/异地容灾划分。

- Group Name: 默认为 DEFAULT_GROUP,用于逻辑隔离。

- Namespace ID: 最关键的身份标识。来自配置文件的 spring.cloud.nacos.discovery.namespace。注意:这里必须填 ID(如一串 UUID),而不是控制台上看到的名称(如 prod)。

- Metadata: 自定义元数据,如版本号 version=1.0.2、区域 region=cn-hangzhou 等,用于灰度发布和精细路由。

- 发送注册请求:客户端构造 HTTP POST 请求(或 gRPC 请求),目标地址是 Nacos Server 的 /nacos/v1/ns/instance 接口。

- Nacos Server 处理:接收到请求后,Nacos Server 将实例信息存入内存数据结构(ConcurrentMap)。

- 注册成功:Server 返回 success,Provider 启动完成。

2.2 服务发现:Consumer 的"主动拉取"与"被动推送"

推拉结合模式

- 启动全量拉取 (Pull):

- Consumer 启动时,NacosDiscoveryClient 立即发起一次全量拉取请求。

- 请求参数:serviceName=mall-product-service, namespaceId=xxx, groupName=DEFAULT_GROUP。

- 关键点:这里的 namespaceId 必须与 Provider 注册时使用的完全一致。如果不一致,Nacos Server 会返回空列表。

- 本地缓存构建:

- Consumer 拿到返回的 JSON 数据(包含实例列表),解析后存入本地内存缓存。

- 缓存结构通常是一个多层 Map:Map<String, Map<String, Map<String, List<Instance>>>> (Namespace -> Group -> Service -> Instances)。

- UDP 推送 (Push):

- 当 Nacos Server 检测到服务列表变更时,会主动向 Consumer 发送 UDP 数据包。

- Consumer 监听 UDP 端口,收到包后,立即更新本地缓存,并触发本地事件。

⚠️ 事故复盘点

在本次事故中,订单服务(Consumer)启动时,拿着错误的 Namespace 名称(而非 ID)去请求 Nacos。假设配置的 namespace 是 prod-isolate (名称),但 Nacos 客户端代码逻辑中,如果检测到该字符串不是合法的 UUID 格式,可能会 fallback 到默认空间 public。

而商品服务(Provider)注册时,明确指定了 namespaceId = "uuid-of-prod-isolate"。

结果:Consumer 在 public 空间拉取 mall-product-service,Nacos Server 返回 [](空列表)。Consumer 本地缓存中,mall-product-service 对应的列表为空。

第三章:Feign 声明式调用——动态代理的魔法

理解了服务列表存在哪里(Nacos 本地缓存),接下来要看是谁去取这个列表,以及如何发起调用。这就是 Feign 的舞台。

3.1 Feign 的核心哲学:声明式 HTTP 客户端

在 Feign 出现之前,我们使用 RestTemplate 调用微服务:

// 传统方式:样板代码多,难以阅读 String url = "http://mall-product-service/api/v1/stock/check?skuId=1001"; ResponseEntity<Result> response = restTemplate.getForEntity(url, Result.class);复制

Feign 的出现改变了这一切。它允许我们定义一个接口,通过注解描述 HTTP 请求:

@FeignClient(name = "mall-product-service", path = "/api/v1") public interface ProductFeignClient { @GetMapping("/stock/check") Result checkStock(@RequestParam("skuId") Long skuId); }复制

调用时就像调用本地方法一样:

boolean hasStock = productFeignClient.checkStock(1001L);复制

3.2 启动阶段:代理对象的生成

Feign 初始化流程

- 扫描与解析:FeignClientsScanner 扫描 classpath 下所有带有 @FeignClient 接口的类。

- 创建 Target:为每个 Feign 接口创建一个 Target 对象。Target 封装了接口的元数据,特别是 name (服务名)。

- 构建 Feign 实例:利用 Feign.Builder 构建核心的 Feign 对象。

- 生成动态代理:使用 JDK 动态代理(Proxy.newProxyInstance)为接口生成实现类。

- 注册 Bean:将生成的代理对象注册为 Spring Bean,Bean 名称默认为接口全限定名。

⚠️ 事故复盘点

在事故现场,流程卡在 LoadBalancer 选择实例阶段。由于 Nacos 本地缓存为空(Namespace 不匹配),choose() 返回 null。

此时,FeignBlockingLoadBalancerClient 的逻辑是:如果拿不到实例,不进行 URL 重写,直接将原始 URL(含服务名)传递给下游 Client。

下游 Client(如 HttpURLConnection)看到 http://mall-product-service/...,认为这是一个域名,发起 DNS 查询。DNS 服务器当然无法解析内部服务名,抛出 UnknownHostException。

第四章:Spring Cloud LoadBalancer——服务名到 IP 的"翻译官"

这是整个链路中最核心、也是最容易被忽视的组件。它是连接 Feign(应用层)和 Nacos(基础设施层)的桥梁。

4.1 从 Ribbon 到 Spring Cloud LoadBalancer

在 Spring Cloud Greenwich 版本之前,负载均衡由 Netflix Ribbon 承担。但 Ribbon 已进入维护模式,且架构较重。从 Spring Cloud Hoxton 开始,官方推出了 Spring Cloud LoadBalancer,旨在提供一个轻量级、响应式、易于扩展的客户端负载均衡解决方案。

核心优势

- 无依赖:不依赖 Netflix 套件。

- 响应式支持:完美支持 WebFlux。

- SPI 扩展:易于自定义负载均衡策略。

- 无缝集成:与 Nacos、Eureka、Consul 等注册中心天然兼容。

4.2 核心架构组件

LoadBalancerClient

核心入口接口。提供 choose(serviceId) 和 reconstructURI(instance, originalUri) 方法。

ServiceInstanceListSupplier

负责获取服务实例列表。它是一个函数式接口,返回 Flux<List<ServiceInstance>>。

ReactorServiceInstanceLoadBalancer

真正的负载均衡策略执行者。接收实例列表,根据策略选择一个实例。

LoadBalancerClientFactory

工厂类,为每个服务名创建独立的 LoadBalancer 上下文。

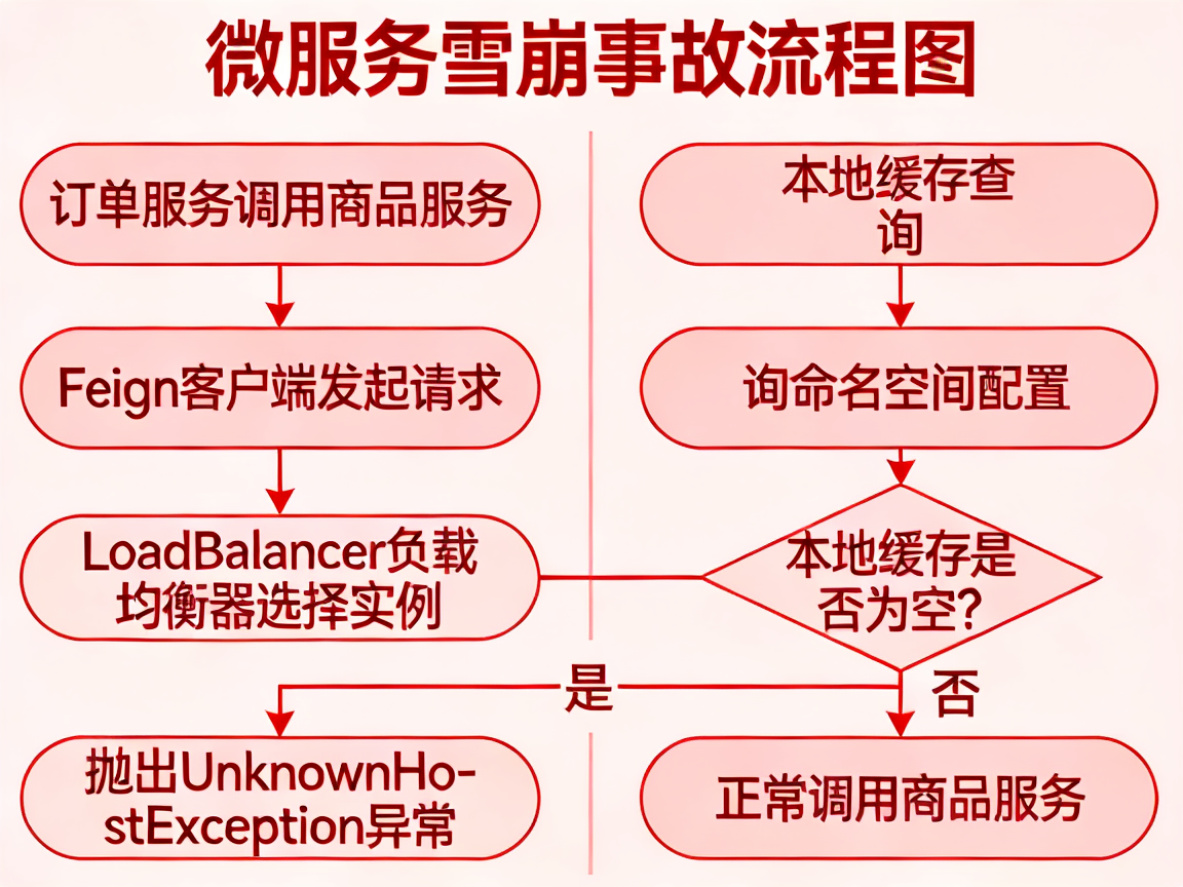

微服务雪崩事故流程图

图2:微服务雪崩事故流程图

第五章:本地调试实战——手把手复现与排查

理论再完美,不如亲手调试一次。本节将指导你如何在本地 IDEA 环境中,完整复现这次事故,并通过断点调试亲眼见证故障的发生与修复。

5.1 环境准备

Nacos Server:

- 下载 Nacos 2.x 版本,本地启动(standalone 模式即可)。

- 访问 http://localhost:8848/nacos。

- 创建命名空间:

- 点击"命名空间" -> "新建命名空间"。

- 名称:prod-isolate。

- 复制生成的 ID(例如:5f8a9b2c-3d4e-5f6g-7h8i-9j0k1l2m3n4o)。记住这个 ID!

Provider (mall-product-service):

- 创建一个简单的 Spring Boot 项目。

- bootstrap.yml 配置: spring: application: name: mall-product-service cloud: nacos: discovery: server-addr: localhost:8848 namespace: 5f8a9b2c-3d4e-5f6g-7h8i-9j0k1l2m3n4o group: DEFAULT_GROUP server: port: 8081

- 提供一个简单的接口:/api/v1/stock/check。

- 启动服务。在 Nacos 控制台确认服务已注册在 prod-isolate 命名空间下。

5.2 复现故障:配置错误的 Namespace

❌ 错误配置

现在,我们要故意制造事故。修改 Consumer 的 bootstrap.yml:

spring: application: name: mall-order-service cloud: nacos: discovery: server-addr: localhost:8848 # 【错误配置】:这里填了名称,而不是 ID! namespace: prod-isolate group: DEFAULT_GROUP

5.3 断点调试全流程

调试断点设置

- 断点 1:Feign 入口

- 类: org.springframework.cloud.openfeign.loadbalancer.FeignBlockingLoadBalancerClient

- 方法: execute

- 观察: request.url(), serviceId

- 断点 2:LoadBalancer 选择实例

- 类: org.springframework.cloud.loadbalancer.blocking.client.BlockingLoadBalancerClient

- 方法: choose(String serviceId)

- 观察: supplier.get().blockFirst() 的返回值(预期为 null 或空列表)

- 断点 3:Nacos 客户端查询

- 类: com.alibaba.cloud.nacos.discovery.NacosDiscoveryClient

- 方法: getInstances(String serviceId)

- 观察: namingService.selectInstances 的参数 namespaceId 和返回值

- 断点 4:异常抛出

- 回到 FeignBlockingLoadBalancerClient.execute()

- 由于 instance == null,代码逻辑可能会抛出异常或继续执行

第六章:生产环境避坑指南与最佳实践

基于本次事故和多年的生产经验,总结以下避坑指南,帮助你在未来的工作中少走弯路。

6.1 配置管理"铁律"

Namespace ID 强制校验

- 严禁在配置文件中填写命名空间名称

- 编写 CI/CD 脚本自动校验 namespace 字段是否为合法的 UUID 格式

- 利用 Nacos API 在应用启动时预检查命名空间是否存在

配置中心化与版本控制

- 所有微服务配置文件必须纳入 Git 版本控制

- 禁止手动修改生产环境配置文件

- 所有变更必须通过 Merge Request 流程

环境隔离标准化

- 建立严格的命名规范:dev-uuid, test-uuid, prod-uuid

- 在 K8s 中利用 Namespace 和 Label 进一步隔离

- 确保网络策略限制跨环境访问

6.2 依赖与版本兼容性

⚠️ 版本兼容性警告

- Spring Cloud Alibaba 版本矩阵:严格遵循官方发布的版本对应关系表。不要随意混用不同大版本的组件。

- 特别注意:在 Spring Cloud 2020.0.0+ 版本中,Ribbon 被移除,必须显式引入 LoadBalancer starter,否则 Feign 无法进行服务发现。

- Nacos 客户端版本:保持 Nacos Server 和 Client 版本的大版本一致。

6.3 可观测性与告警优化

本地缓存监控

- 暴露 Nacos 本地缓存的大小、最后更新时间等指标到 Prometheus

- 告警规则:如果某个核心服务的本地缓存实例数为 0,且持续时间超过 1 分钟,立即发送 P0 级告警

Feign 调用监控

- 利用 Micrometer 记录 Feign 调用的耗时、成功率

- 区分"连接超时"、"读取超时"、"未知主机"等不同异常类型,针对性告警

- 集成 SkyWalking,可视化调用链路,快速定位是哪个服务调用失败

第七章:架构演进与未来展望

这次事故虽然解决了,但它也揭示了当前架构的一些局限性。展望未来,微服务架构正在向以下几个方向演进:

7.1 Service Mesh(服务网格):下沉基础设施

Service Mesh 优势

- 语言无关:无论 Java, Go, Python,都通过 Sidecar 通信。

- 无侵入:业务代码无需引入任何 SDK。

- 统一治理:网络策略、安全证书、流量镜像等统一由控制面管理。

挑战:运维复杂度增加(需要管理大量 Sidecar)、延迟略有增加(多了一跳代理)、调试难度加大(需要理解 Proxy 行为)。

7.2 云原生网络:K8s Native

随着 K8s 成为事实标准,原生 K8s Service 和 CoreDNS 的能力越来越强。

- K8s Service:提供了基本的负载均衡和服务发现。

- CoreDNS:可以直接解析 service-name.namespace.svc.cluster.local。

趋势:对于部署在 K8s 上的应用,可以直接使用 K8s 原生服务发现,减少对 Nacos 的依赖。或者采用 Nacos on K8s 的深度集成模式,利用 K8s CRD 同步服务信息。

7.3 智能化运维 (AIOps)

异常预测

在 UnknownHostException 发生前,通过缓存更新延迟、心跳波动等特征预测故障。

根因自动定位

发生故障时,自动关联配置变更、网络波动、资源水位,给出根因分析报告。

自愈系统

检测到配置错误时,自动回滚或触发修复脚本。

结语:敬畏生产,深耕原理

凌晨三点的警报声虽然刺耳,但它也是技术成长的催化剂。

通过这次对 UnknownHostException 的深度剖析,我们不仅修复了一个配置错误,更重要的是,我们打通了从 Nacos 注册中心 到 Feign 动态代理,再到 LoadBalancer 负载均衡 的任督二脉。我们明白了:

配置无小事

一个 Namespace ID 的混淆,足以引发雪崩。

原理即武器

只有深入源码,才能在故障面前从容不迫。

架构需演进

从 SDK 到 Mesh,从手动到智能,技术之路永无止境。

希望这篇万字长文能成为你案头的参考手册。当下一次面对微服务调用故障时,希望你能自信地打开 IDEA,打上断点,微笑着说:"我知道问题在哪,让我来修好它。"

敬畏生产环境,深耕底层原理,这是每一个优秀工程师的必修课。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-24,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录