刚刚!阿里正式开源下一代基础模型架构 Qwen3-Next,训练成本直降 90%

刚刚!阿里正式开源下一代基础模型架构 Qwen3-Next,训练成本直降 90%

民工哥

发布于 2026-03-24 14:47:49

发布于 2026-03-24 14:47:49

— 特色专栏 —

大家好,我是民工哥!

开源大模型真的是越来越卷了,一波接一波!

图片

2025年9月12日阿里正式开源下一代基础模型架构Qwen3-Next,并发布Qwen3-Next-80B-A3B系列模型,该系列以高稀疏MoE架构、混合注意力机制及多token预测技术为核心,实现了模型性能与计算效率的双重突破。

高稀疏度MoE(混合专家)架构

- 参数激活比达1:50:总参数80B的模型仅激活3B参数(实际激活比例可能因版本略有差异,如部分报道提及30亿激活参数),通过动态路由机制选择最相关的专家子集,显著降低计算开销。

- 专家数量扩展:相比Qwen3的128个总专家,Qwen3-Next扩展至512个总专家,搭配10个路由专家和1个共享专家,提升模型容量与资源利用率。

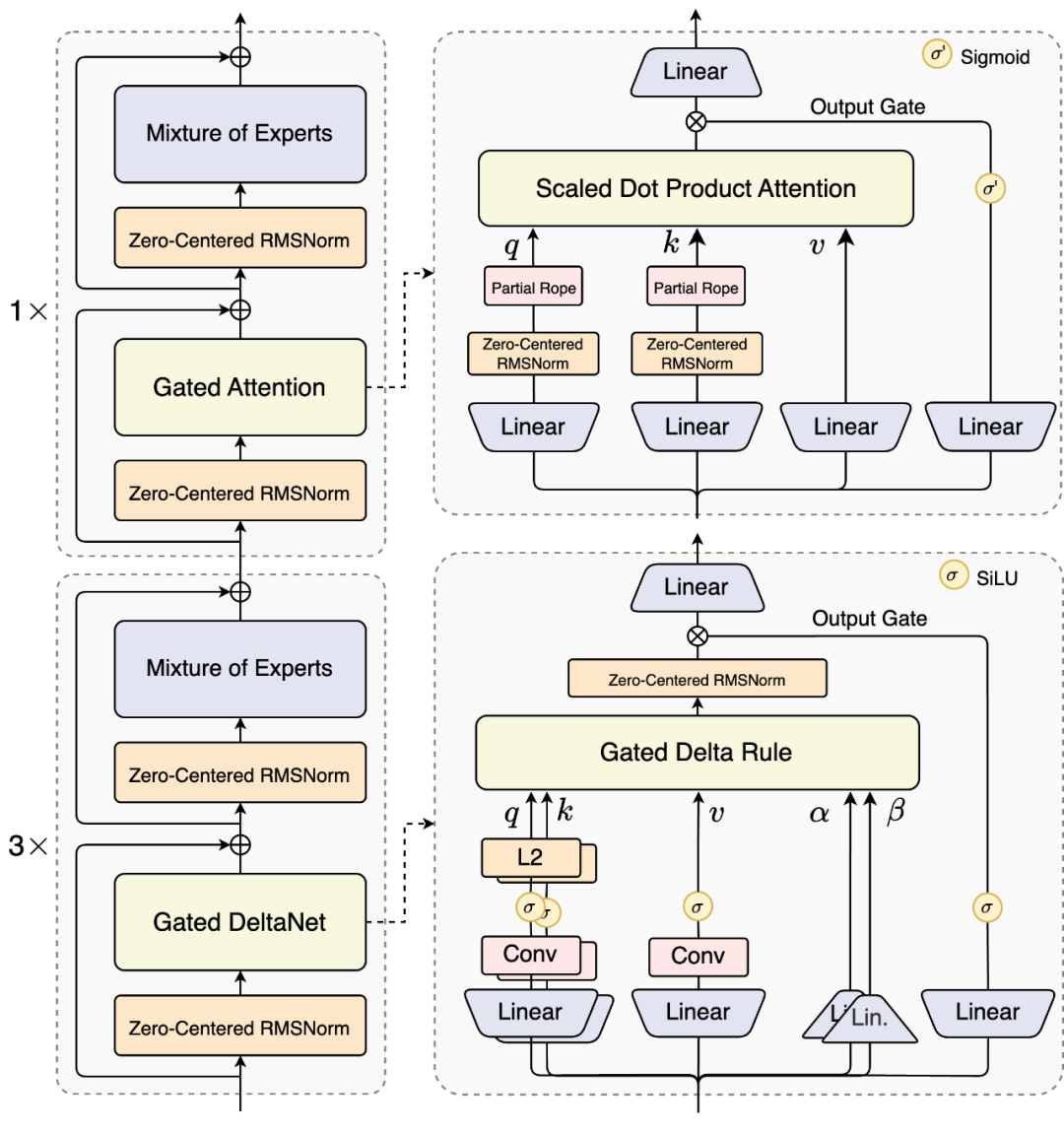

图片

混合注意力机制

- Gated DeltaNet + Gated Attention:结合线性注意力(Gated DeltaNet)与自研门控注意力(Gated Attention),突破传统Transformer的二次复杂度限制。

- 性能优化:在3:1的混合比例下(75%层使用Gated DeltaNet,25%层保留标准注意力),实现上下文学习与计算效率的双重提升,支持百万token超长上下文处理。

多token预测(MTP)技术

- 训练范式革新:模型在预训练阶段同步预测多个token,学会语言规划与长程逻辑,输出更连贯且训练效率更高。

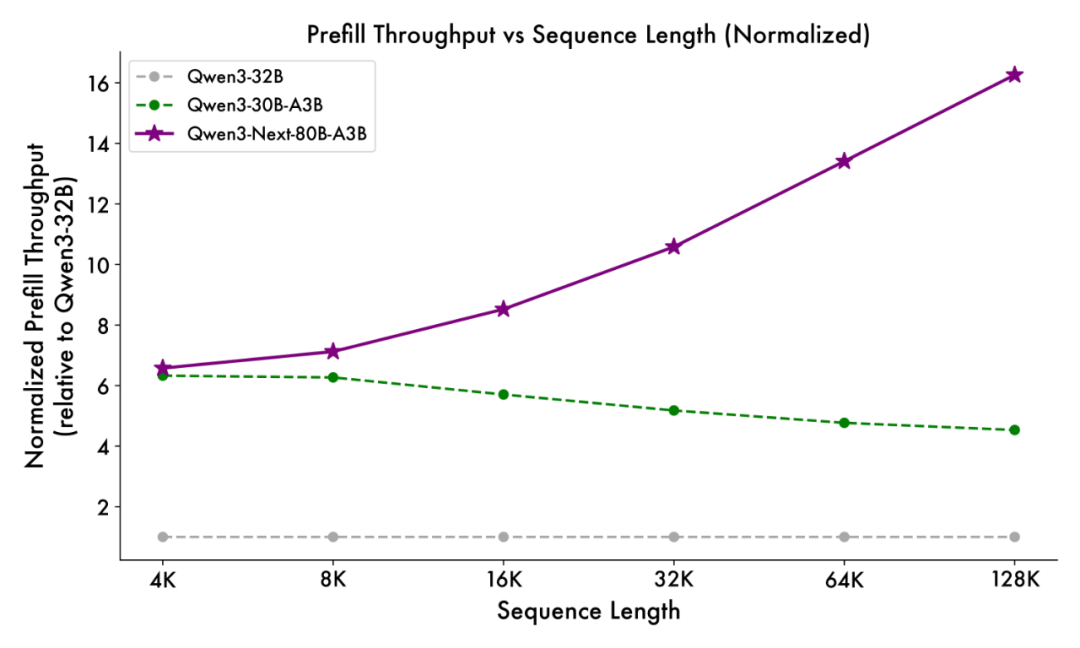

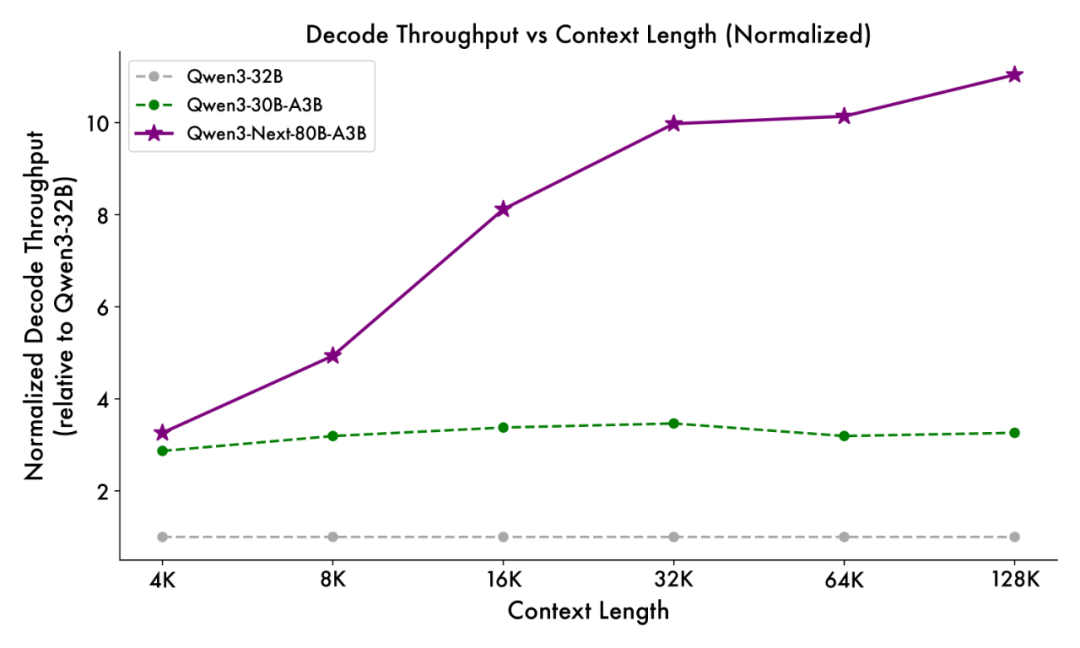

- 推理加速:通过多步推理一致性优化,提升Speculative Decoding接受率,解码阶段吞吐量提升近4倍(4k上下文)至10倍以上(32k+上下文)。

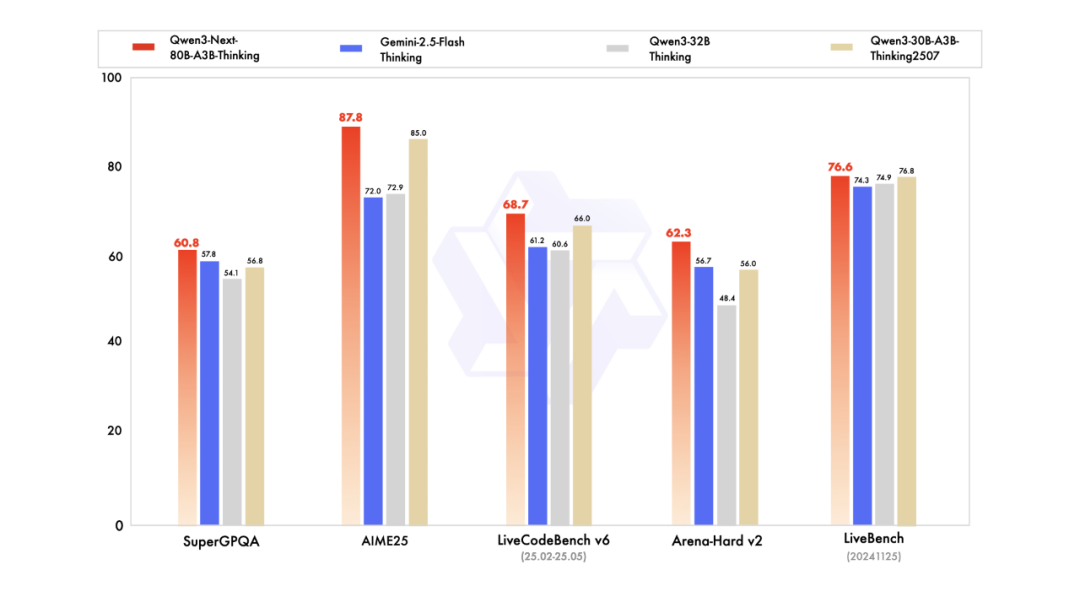

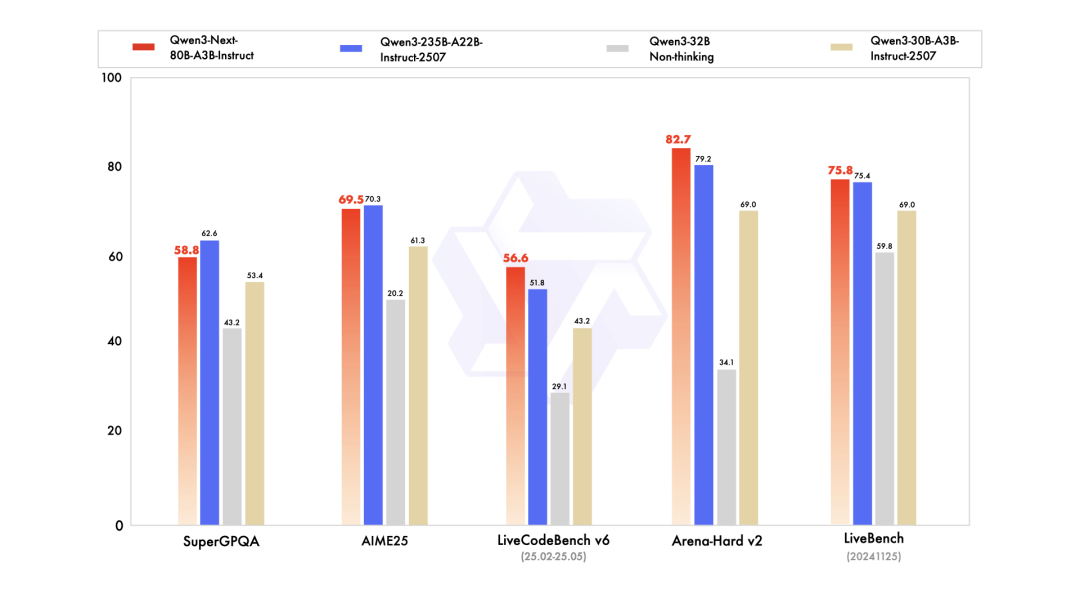

性能媲美千亿级模型

- 基准测试表现:在编程(LiveCodeBench v6)、人类偏好对齐(Arena-Hard v2)等评测中,Qwen3-Next-Instruct超越Qwen3-235B-A22B-Instruct-2507;在数学推理(AIME25)中,Qwen3-Next-Thinking以87.8分全面超越Gemini2.5-Flash-Thinking。

图片

图片

- 长文本处理能力:支持百万token超长上下文,推理吞吐量较Qwen3-32B提升10倍以上(32k+上下文场景)。

图片

图片

训练成本降低超90%

- 资源效率:仅需Qwen3-32B 9.3%的GPU计算资源即可完成预训练,训练成本降至密集模型的1/10以下。

- 稳定性优化:通过Zero-Centered RMSNorm、weight decay及MoE router参数归一化等技术,解决高稀疏MoE架构下的训练稳定性问题。

新模型已在 Qwen.ai 上线,并上传到了 HuggingFace。

- 新模型网页版:https://chat.qwen.ai/

- HuggingFace:https://huggingface.co/collections/Qwen/qwen3-next-68c25fd6838e585db8eeea9d

- Kaggle:https://www.kaggle.com/models/qwen-lm/qwen3-next-80b

并且,Qwen3-Next 模型也已经在很多第三方平台中上线。

通义千问Qwen衍生模型数超17万,稳居全球第一开源模型。

2025年上半年,阿里通义在中国企业级大模型调用市场中占比17.7%,位列第一。

👍 既然都看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-09-12,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读