接入腾讯云AI人脸防护盾Skill,让你的🦞OpenClaw“秒辨”真假美猴王

原创接入腾讯云AI人脸防护盾Skill,让你的🦞OpenClaw“秒辨”真假美猴王

原创腾讯云AI

修改于 2026-03-23 16:14:31

修改于 2026-03-23 16:14:31

《西游记》里,六耳猕猴与孙悟空长得一模一样,最后需要如来亲自出手才能分辨真伪。今天,这个故事有了现实版本——只不过「六耳猕猴」不再是一个,而是一条条黑产流水线。AIGC 换脸、高清屏幕翻拍、3D 建模面具、黑产批量注入,这些攻击手段已经形成完整产业链,专门针对金融开户、社交平台虚假人脸检测、在线远程考试等高频身份核验场景。 随着AIGC技术的爆发式发展,传统的人脸防伪方案已经力不从心。腾讯云AI人脸防护盾基于多模态大模型可以高效应对这些安全威胁;目前,我们已将腾讯云 AI 人脸防护盾的核心能力封装为Skill插件形式,让你只需几步配置,即可在 OpenClaw等Agent工作流中一键调用金融级的人脸防攻击检测能力。

Skill 下载地址: tencentcloud-faceid-detectaifakefaces

1. 什么是 AI 人脸防护盾?

腾讯云 AI 人脸防护盾是腾讯云慧眼人脸核身体系下的一个重要子产品。它基于多模态 AI 大模型算法,结合图片语义理解与模型自学习能力,能够对人脸图片和视频进行深层次的防攻击检测,从而增强业务的整体防伪安全能力。

与传统活体检测不同,AI 人脸防护盾专注于识别那些"看起来像真人但实际上是伪造的"攻击素材,是应对新一代 AI 攻击的利器。

1.1 核心检测能力

检测类型 | 说明 |

|---|---|

AIGC 换脸检测 | 识别由 AI 生成或合成的高仿真换脸攻击,包括 face swap 和 face reenactment 等技术路线 |

高清翻拍检测 | 识别通过屏幕翻拍(如手机拍屏幕、高清显示器回放等)留下的攻击痕迹 |

批量黑产攻击检测 | 识别黑产团伙使用模板批量注入的规模化攻击行为 |

水印痕迹检测 | 识别人脸图片或视频中残留的水印等异常痕迹,辅助判断素材真伪 |

1.2 典型应用场景

AI 人脸防护盾适用于所有需要确认人脸真实性的业务场景,以下是几个典型案例:

场景一:金融开户与远程身份认证。银行、券商等金融机构在远程开户流程中,需要确保用户提交的人脸照片或视频为本人真实拍摄,而非 AI 合成或翻拍素材。AI 人脸防护盾可作为活体检测的增强补充,在后端对提交素材进行二次深度防伪验证。

场景二:社交平台虚假人脸检测。社交媒体平台面临大量 Deepfake 换脸内容的治理压力。通过集成防护盾能力,平台可在内容上传环节自动检测人脸真伪,有效遏制虚假内容传播。

场景三:在线考试与远程面试。教育机构和企业在远程考试、面试场景中,需要确保屏幕前的是考生或候选人本人。防护盾可检测视频流中是否存在换脸或翻拍行为,保障考试公平性。

2. Skill 功能与特性

本 Skill 将腾讯云人脸核身(FaceID)服务中的 DetectAIFakeFaces 接口封装为 OpenClaw 可直接调用的技能,支持图片和视频两种输入模式。

2.1 功能亮点

本 Skill 在封装 API 的基础上做了许多便捷性优化,具体特性如下表所示:

特性 | 说明 |

|---|---|

双模态输入 | 同时支持图片(jpg、png、bmp)和视频(mp4、avi、flv)两种输入格式 |

本地文件自动处理 | 传入本地文件路径后,脚本自动识别文件类型并完成 Base64 编码,无需手动转换 |

Base64 直传 | 也支持直接传入 Base64 编码字符串,适配已有数据流水线 |

结构化风险输出 | 返回清晰的风险等级(Low Mid High)和详细的攻击类型信息 |

轻量级依赖 | 仅依赖 tencentcloud-sdk-python,Python 3.6+ 即可运行 |

2.2 输入规格要求

为了保证检测精度,请确保输入素材满足以下规格要求:

图片输入规格:

参数 | 要求 |

|---|---|

格式 | jpg、png、bmp |

推荐分辨率 | 480×640,人脸区域不小于 100×100 像素 |

文件大小 | Base64 编码后建议不超过 3MB,最大不超过 10MB |

视频输入规格:

参数 | 要求 |

|---|---|

格式 | mp4、avi、flv |

推荐时长 | 2~5 秒,最长不超过 20 秒 |

推荐分辨率 | 480×640(最大支持 720p) |

文件大小 | Base64 编码后建议不超过 8MB,最大不超过 10MB |

2.3 输出结果说明

检测完成后,接口返回 JSON 格式的结构化结果,核心字段包括:

字段 | 说明 |

|---|---|

AttackRiskLevel | 综合风险等级,取值为 Low(低风险)、Mid(中风险)、High(高风险) |

AttackRiskDetailInfos | 详细的攻击信息列表,包含具体的攻击类型和置信度 |

风险等级含义:

等级 | 含义 | 建议处理方式 |

|---|---|---|

Low | 低风险,图片/视频为正常人脸 | 正常放行 |

Mid | 中风险,存在一定攻击嫌疑 | 建议人工复核或增加额外验证 |

High | 高风险,极有可能为攻击行为 | 建议直接拦截并记录 |

3. 安装与配置

3.1 前置条件:安装 ClawHub CLI

如果你尚未安装OpenClaw请参考Coding Plan 接入 AI 工具 进行安装 如果你尚未安装 ClawHub 命令行工具,请先完成以下步骤:

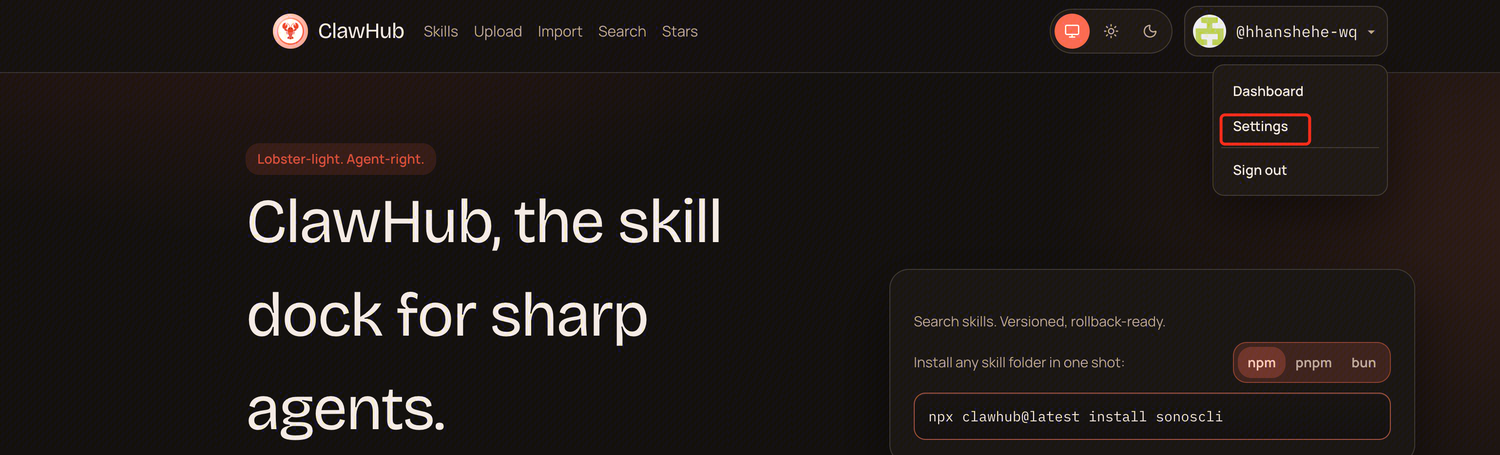

- 打开 ClawHub 官网 并注册登录。

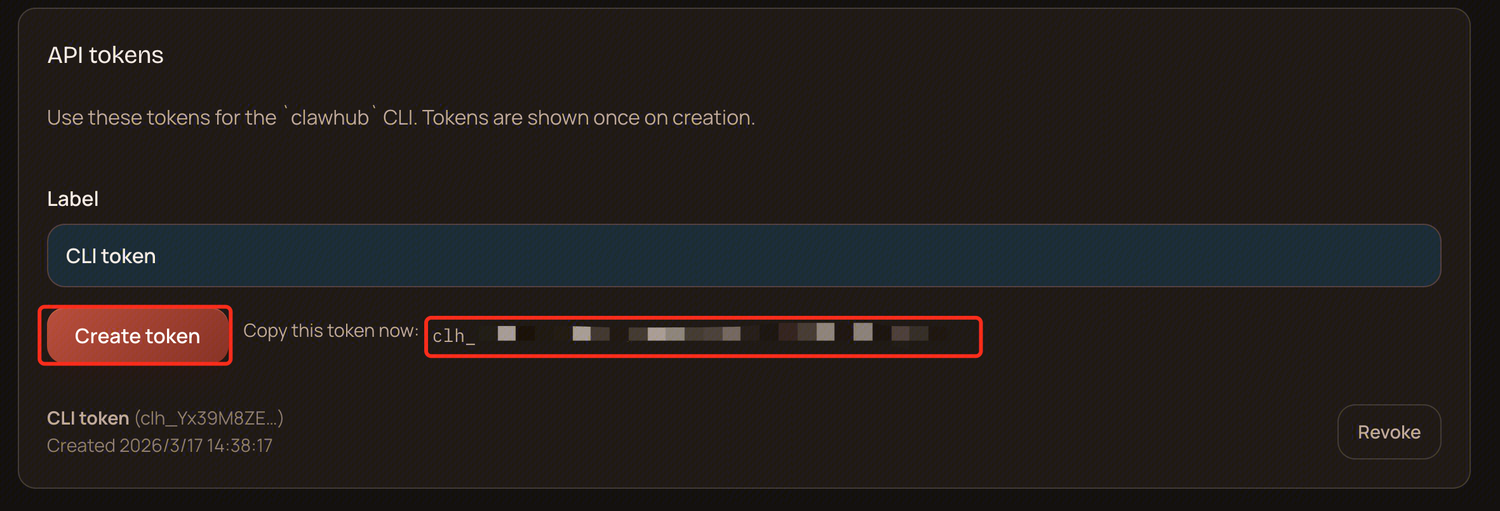

- 点击右上角 Settings → API tokens → Create token,复制生成的 Token。

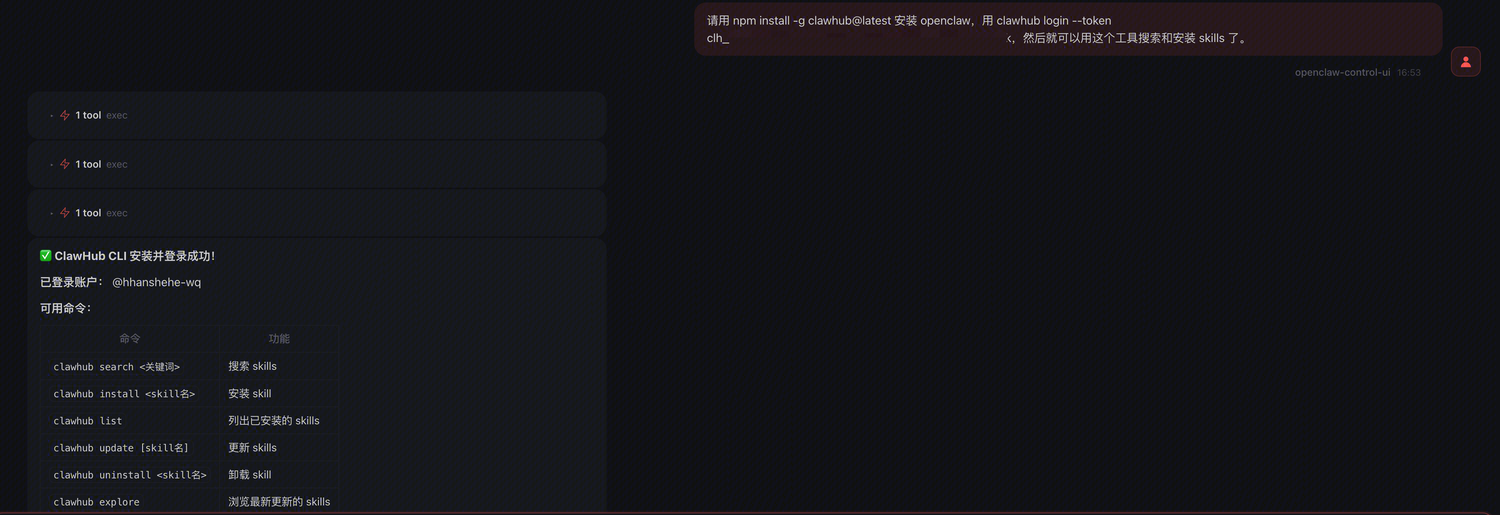

3. 在本地终端执行以下命令完成安装和登录:

# 安装 ClawHub CLI

npm install -g clawhub@latest

# 使用 Token 登录

clawhub login --token 【替换为你的 Token】或者

给 Openclaw 发送指令完成安装和登录:

请用 npm install -g clawhub@latest 安装 openclaw,用 clawhub login --token 【这里换成你的 token】登陆,然后就可以用这个工具搜索和安装 skills 了。

3.2 安装防护盾 Skill

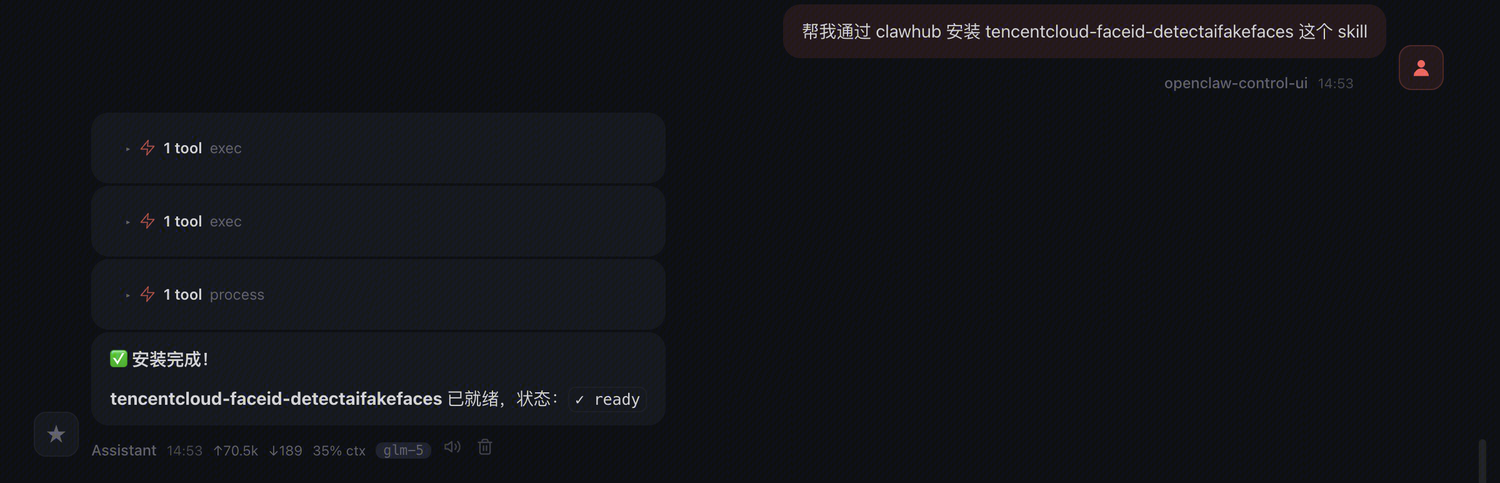

向 OpenClaw 发送以下指令即可完成安装:

"帮我通过 clawhub 安装 tencentcloud-faceid-detectaifakefaces 这个 skill"

OpenClaw 将自动从 ClawHub 拉取并安装该 Skill。

3.3 开通腾讯云人脸核身服务

安装 Skill 后,需要在腾讯云侧完成服务开通并获取 API 密钥。以下是完整的操作流程:

第一步:注册腾讯云账号

如果你已有腾讯云账号,可跳过此步骤。

第二步:完成企业实名认证

注意: 人脸核身服务要求腾讯云账号完成企业实名认证,个人实名认证无法开通该服务。

- 登录腾讯云控制台后,前往 企业实名认证页面。

- 根据页面提示上传营业执照等资质材料,完成企业实名认证。

- 认证审核通过后方可进行下一步操作。

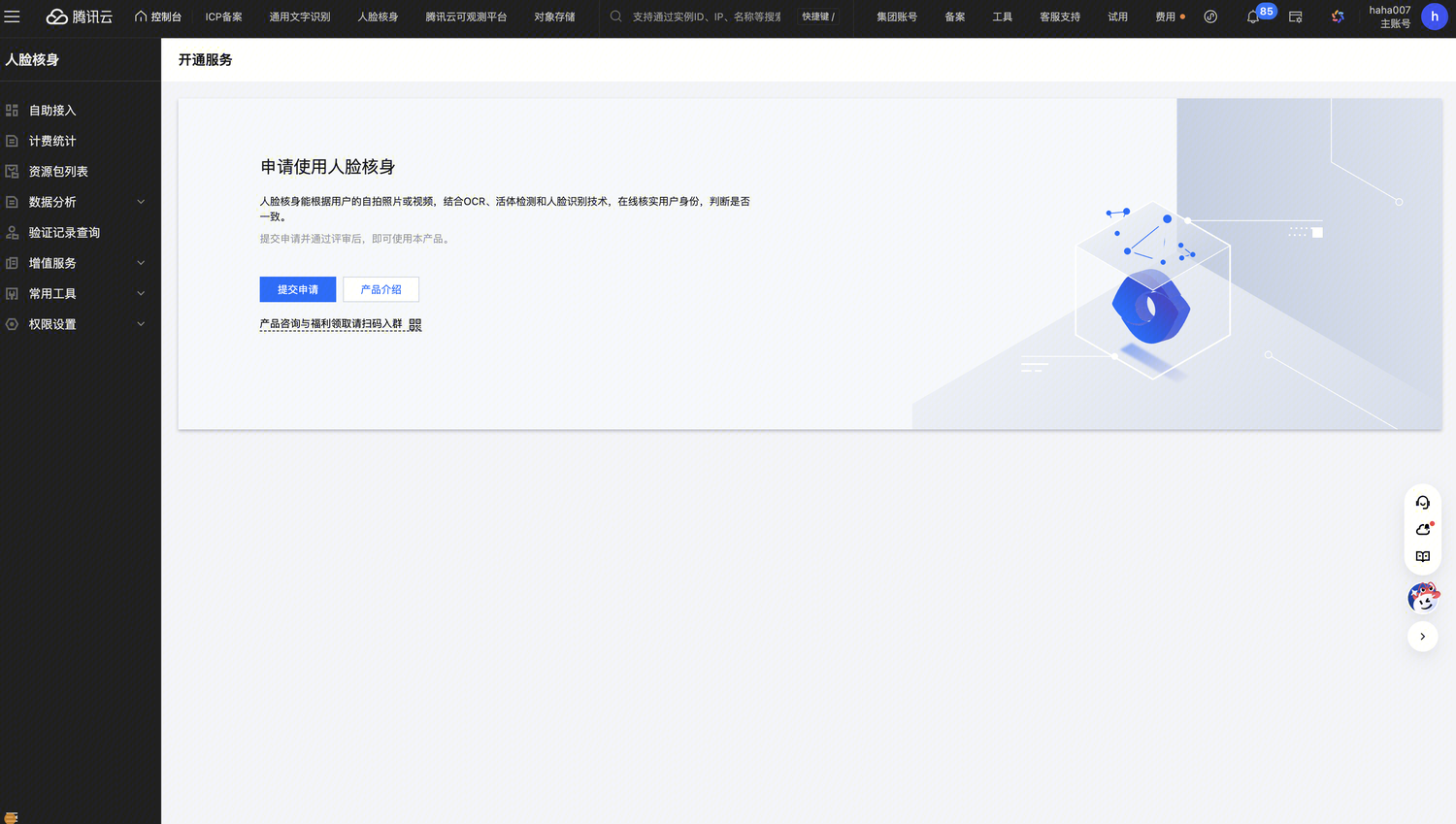

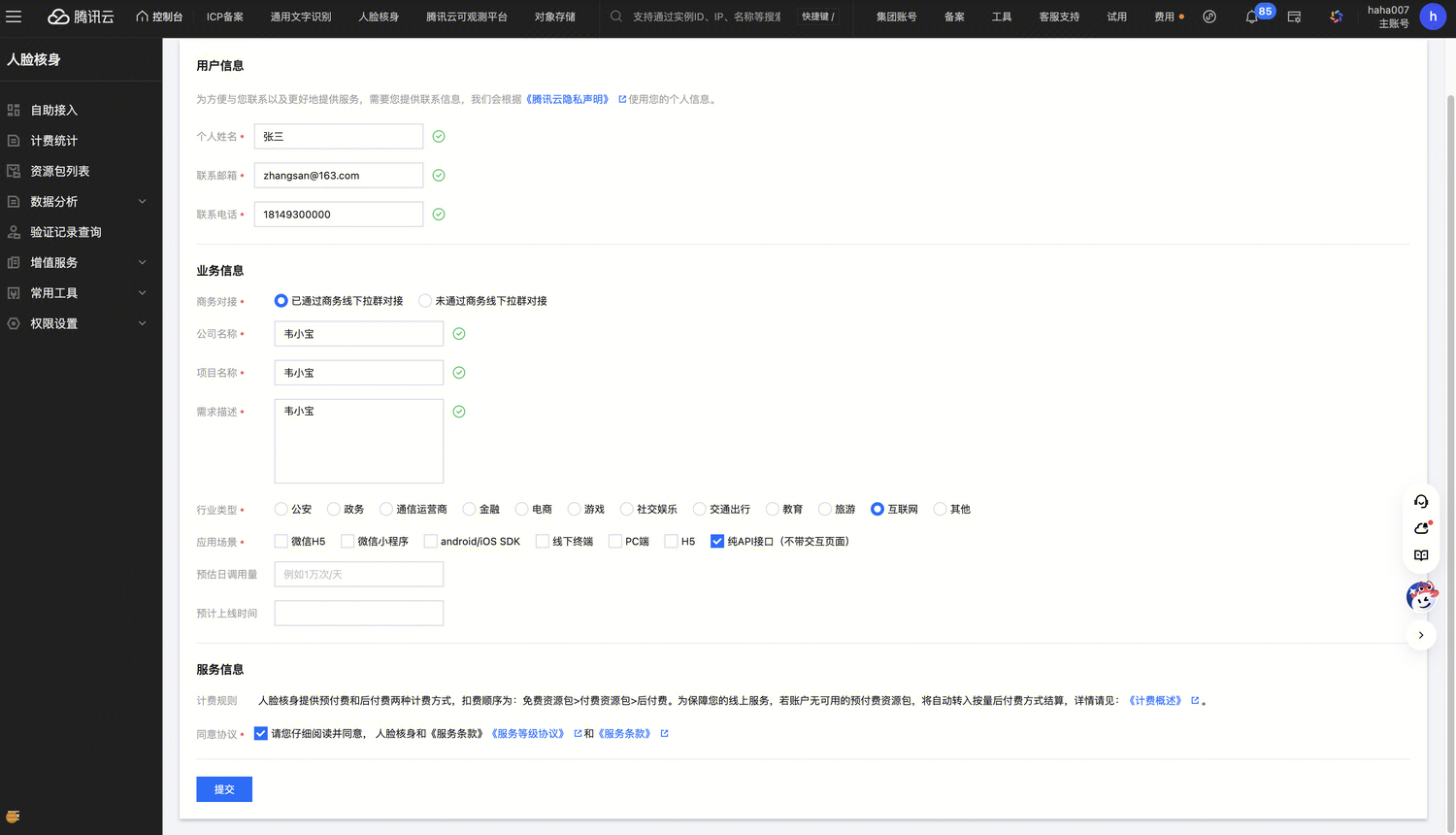

第三步:申请开通人脸核身服务

- 访问 腾讯云人脸核身产品介绍页,点击 "申请免费试用"。

- 在申请页面中,按照实际业务情况填写相关信息并提交申请。

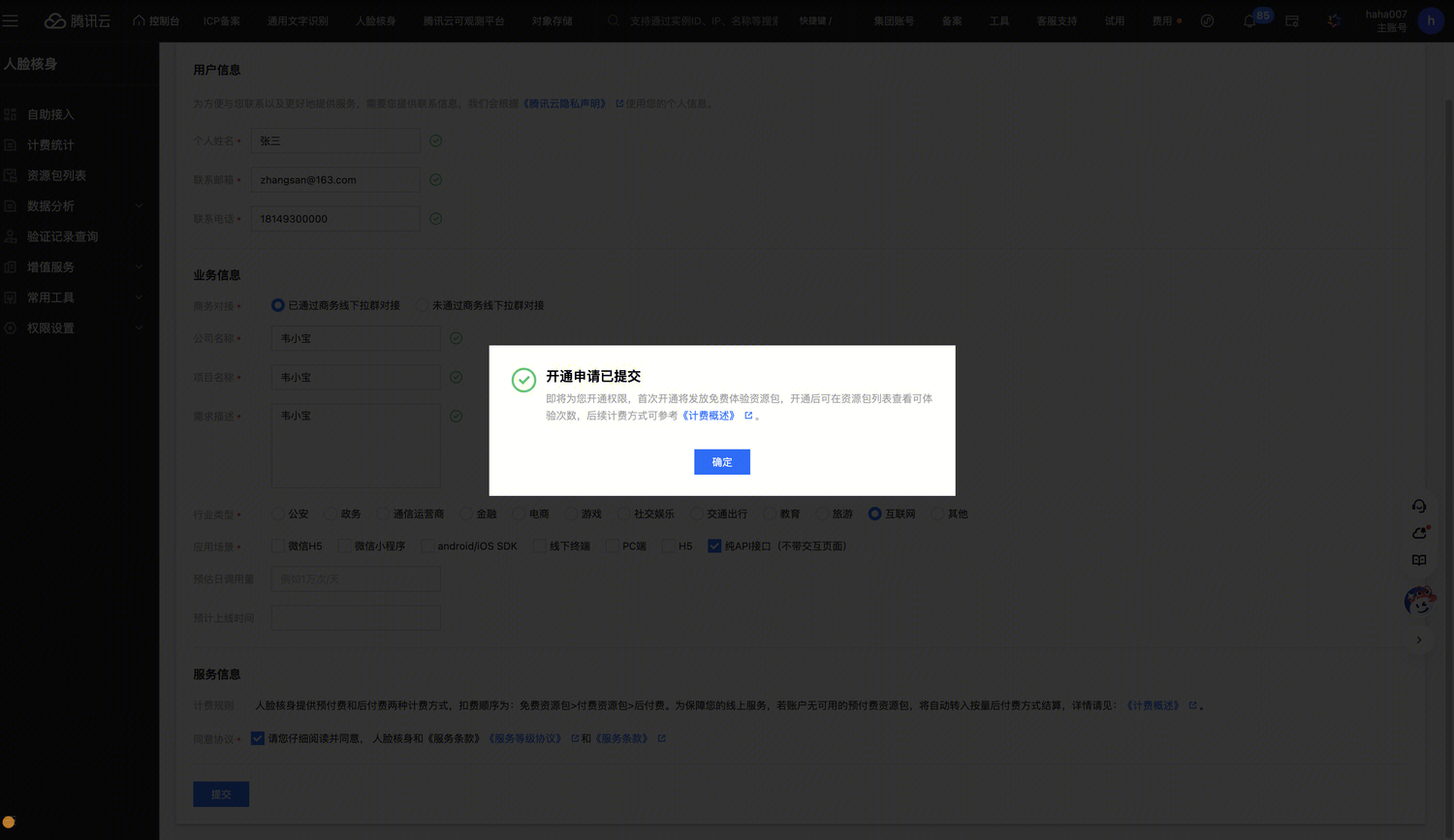

提示: 互联网行业和金融行业在申请时,需要额外上传业务相关的营业资质文件。申请提交后通常即刻通过,无需等待人工审核。

第四步:领取或购买资源包

服务开通后,建议先领取免费资源包用于测试验证:

注意: 成功领取或购买资源包是服务调用的前提。人脸核身支持预付费(资源包)和后付费(按量计费)两种模式,详细定价请参阅 计费概述。

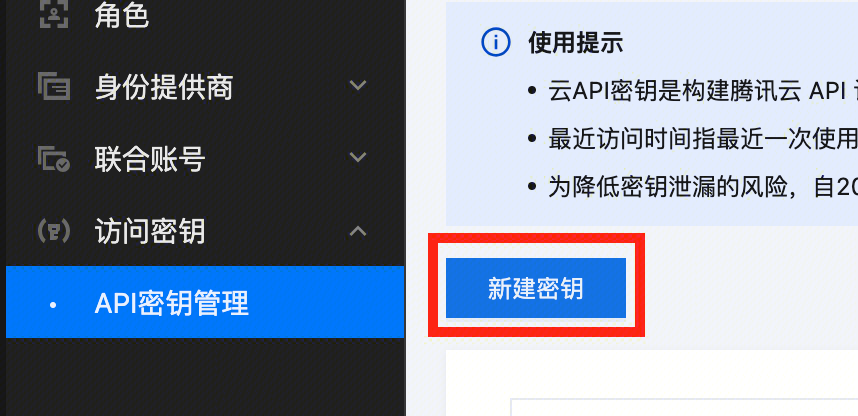

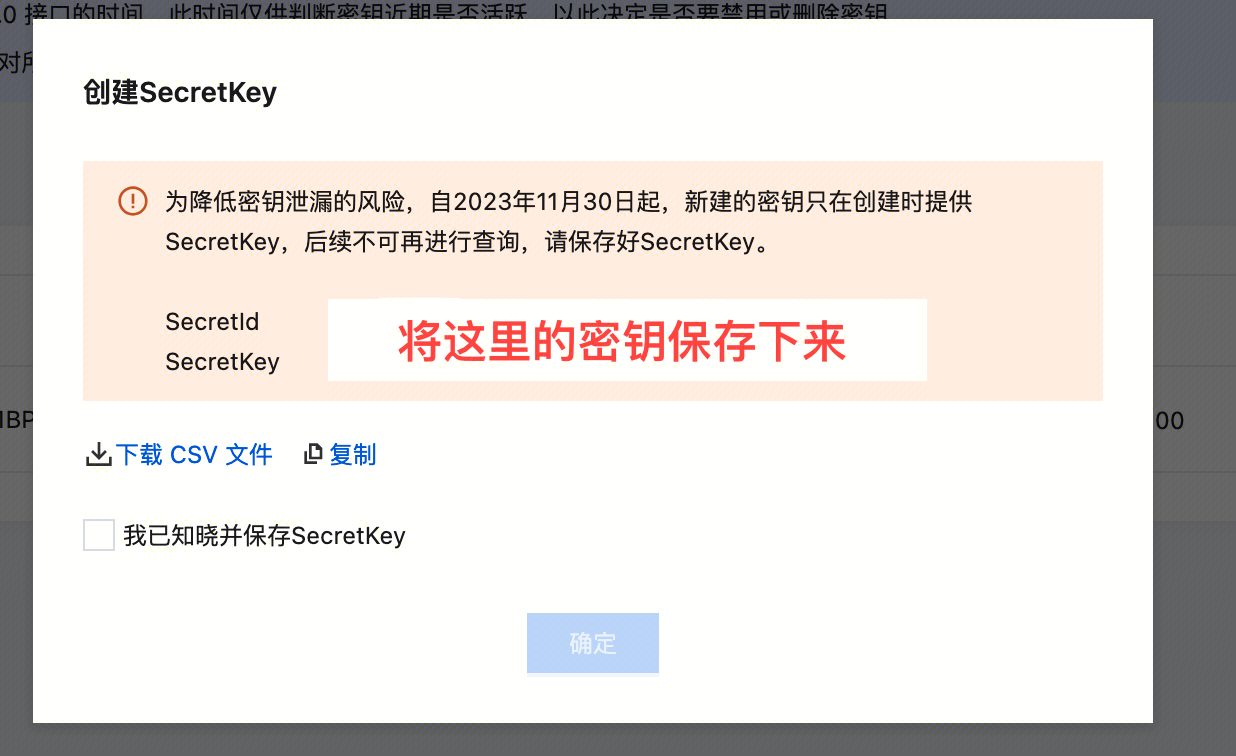

第五步:获取 API 密钥(SecretId 和 SecretKey)

Skill 调用腾讯云接口时需要使用 API 密钥进行身份验证,获取步骤如下:

- 登录 腾讯云访问管理 - API 密钥管理 页面。

- 点击 "新建密钥",系统将自动生成一对 SecretId 和 SecretKey。

3.妥善保存生成的密钥信息,页面关闭后 SecretKey 将不再显示。

安全提示:

- 请勿将密钥发送到任何群聊、公开仓库或不安全的场所。

- 强烈建议创建子账号(而非使用主账号密钥),并仅授予

faceid:DetectAIFakeFaces接口的调用权限,遵循最小权限原则。 - 子账号可在 访问管理控制台 中创建和管理。

以下表格汇总了开通流程中的关键信息,方便你快速查阅:

步骤 | 操作入口 | 备注 |

|---|---|---|

注册账号 | 已有账号可跳过 | |

企业实名认证 | 必须为企业实名,个人实名不可用 | |

申请开通服务 | 点击"申请免费试用",通常即刻通过 | |

领取/购买资源包 | 新用户可领取免费体验包 | |

获取 API 密钥 | 建议使用子账号密钥 |

3.4 配置环境变量

Skill 运行时需要通过环境变量读取 API 密钥,请在你的终端配置文件(如 ~/.zshrc 或 ~/.bashrc)中添加:

export TENCENTCLOUD_SECRET_ID="你的SecretId"

export TENCENTCLOUD_SECRET_KEY="你的SecretKey"配置完成后执行 source ~/.zshrc(或对应的 shell 配置文件)使其生效。

3.5 安装 Python 依赖

Skill 底层依赖腾讯云 Python SDK,请确保已安装:

pip install tencentcloud-sdk-python4. Skill 运行原理

在介绍具体使用方法之前,有必要先了解 OpenClaw Skill 的运行机制——这有助于理解为什么你"说一句话"就能完成一次专业级的人脸防伪检测。

4.1 Skill 的本质:LLM Tool Calling 的封装

OpenClaw 中的 Skill 本质上是对 LLM Function Calling / Tool Calling 能力的一层标准化封装。Skill 并不是由用户在界面上手动点击触发的,而是由 LLM(大语言模型)在理解用户意图后自主决策调用的。

一个完整的 Skill 调用流程如下:

用户发送自然语言请求(如"检测这张图片是否为AI换脸")

↓

OpenClaw 将 Skill 的元数据(名称、描述、参数定义)注入 Agent Prompt

↓

LLM 分析用户意图,判断需要调用哪个 Skill

↓

LLM 输出 tool_call 指令(包含 Skill 名称和参数)

↓

OpenClaw 捕获指令,路由到对应的 Skill

↓

执行 Skill 的 scripts/main.py 脚本

↓

脚本处理输入 → 调用腾讯云 API → 返回检测结果

↓

LLM 根据返回结果,生成自然语言回答呈现给用户简单来说:你对 OpenClaw 说话 → LLM 决定"该用防护盾 Skill" → OpenClaw 自动运行脚本 → 结果返回给你。整个过程对用户完全透明。

4.2 本 Skill 的文件结构

本防护盾 Skill 的项目结构非常精简,仅包含两个核心文件:

tencentcloud-faceid-detectaifakefaces/

├── SKILL.md # 技能说明文件(必需)

└── scripts/

└── main.py # 执行脚本(核心逻辑)文件 | 作用 |

|---|---|

SKILL.md | Skill 的"身份证"。包含 YAML 元数据(名称、描述)和 Markdown 正文(使用说明、触发场景、参数规格等)。OpenClaw 启动时会解析此文件,将其中的 name 和 description 注入到 Agent Prompt,供 LLM 判断何时调用该 Skill |

scripts/main.py | Skill 的"执行引擎"。当 LLM 决定调用该 Skill 时,OpenClaw 会运行此 Python 脚本。脚本负责:接收参数、读取本地文件并转换为 Base64、通过 tencentcloud-sdk-python 调用腾讯云 DetectAIFakeFaces API、将检测结果格式化输出 |

4.3 触发时机:LLM 何时会调用本 Skill

SKILL.md 中定义了明确的触发场景描述。当用户的对话内容涉及以下意图时,LLM 会自动决策调用本 Skill:

- 需要检测人脸图片是否为 AI 合成或换脸

- 需要检测人脸图片是否为翻拍照片

- 需要检测人脸视频是否存在攻击痕迹

- 需要对人脸图片/视频进行防伪安全检测

- 涉及人脸防攻击、防伪检测的任何场景

提示: Skill 的触发是由 LLM 根据语义理解自主决策的,具有一定的非确定性。如果发现 Skill 未被自动调用,可以在对话中更明确地描述意图(例如包含"检测""人脸""AI换脸""翻拍"等关键词),或直接指示 OpenClaw 使用该 Skill。

5. 使用方法

5.1 通过 OpenClaw 对话调用

安装配置完成后,你只需用自然语言描述需求,OpenClaw 就会自动调用防护盾 Skill 完成检测。

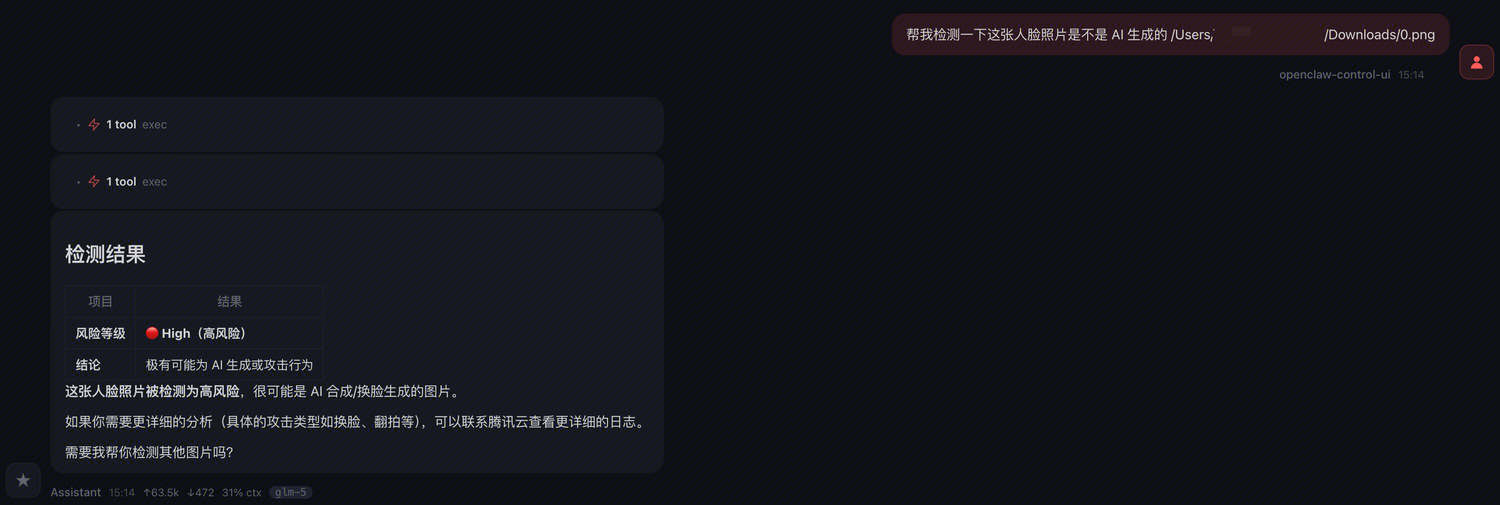

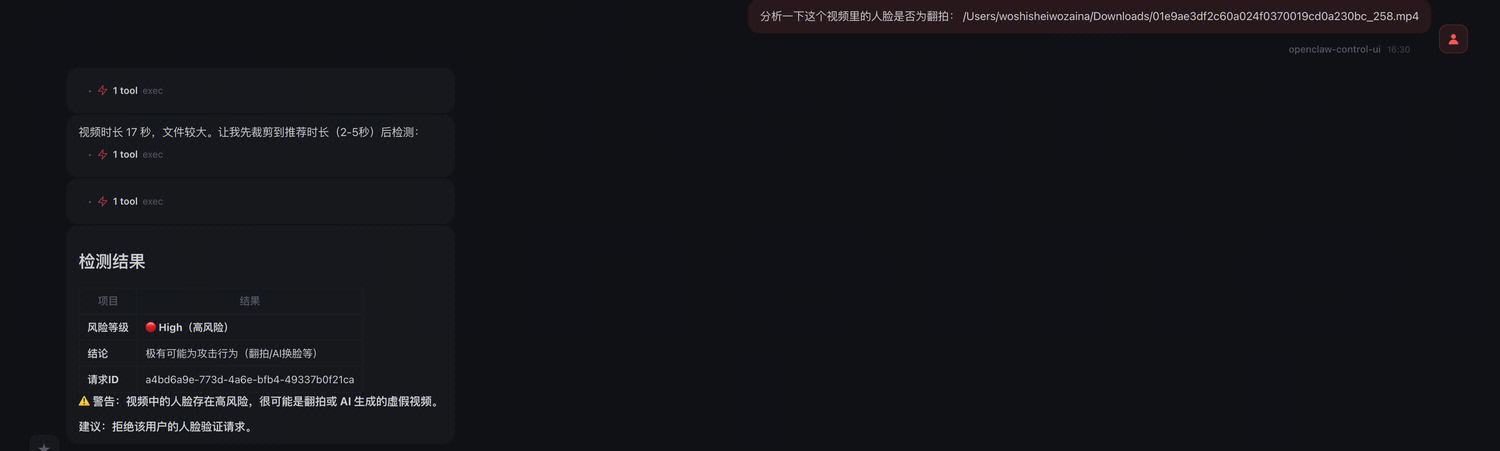

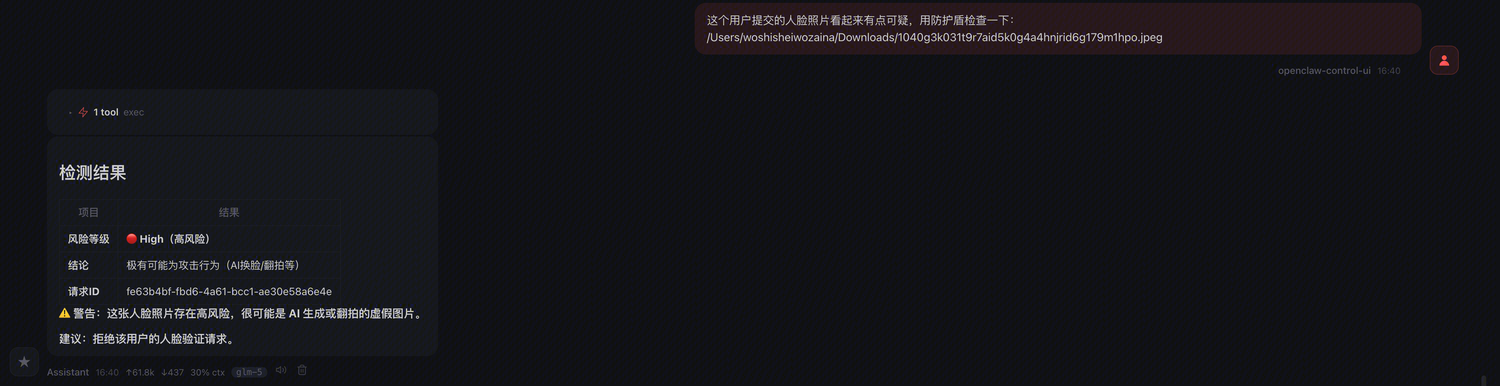

示例对话:

"帮我检测一下这张人脸照片是不是 AI 生成的:./test_face.jpg"

"分析一下这个视频里的人脸是否为翻拍:./interview_clip.mp4"

"这个用户提交的人脸照片看起来有点可疑,用防护盾检查一下:./upload/user_face.png"

背后发生了什么: OpenClaw 接收到你的消息后,LLM 会识别出"人脸检测"意图并发出 tool_call 指令。OpenClaw 随即运行 scripts/main.py,该脚本自动读取你指定的文件、完成 Base64 编码、调用腾讯云 DetectAIFakeFaces API,最后将检测结果返回给 LLM。LLM 再将结构化的 JSON 结果翻译为你能直接理解的自然语言报告。

5.2 实际检测效果示例

以下是一个典型的检测返回结果示例:

{

"Response": {

"AttackRiskDetailList": [

{

"Type": "SuspectedSynthesisVideo" // 疑似合成视频

}

],

"AttackRiskLevel": "High", // 风险等级-高

"ExtraInfo": {},

"RequestId": "13f30d23-9f3e-46f5-a10c-0e448288acfd"

}

}该结果表明送检的人脸素材被判定为 高风险,检测到 AIGC 换脸的攻击痕迹,建议业务侧直接拦截该请求。

如果通过 OpenClaw 对话调用,LLM 会将上述 JSON 翻译为易读的自然语言,例如:"检测完成。该图片被判定为高风险,检测到 AIGC 换脸攻击痕迹,建议直接拦截。"

6. 技术架构

从端到端的视角来看,整个检测流程涉及三个层次——用户交互层(OpenClaw)、脚本执行层(Skill)和云端推理层(腾讯云),它们协同工作的完整时序如下:

┌─────────────────────────────────────────────────────────┐

│ 用户交互层(OpenClaw Agent) │

│ │

│ 用户输入自然语言请求 │

│ ↓ │

│ LLM 解析意图 → 匹配 Skill → 输出 tool_call 指令 │

└──────────────────────┬──────────────────────────────────┘

↓

┌──────────────────────┴──────────────────────────────────┐

│ 脚本执行层(scripts/main.py) │

│ │

│ 接收参数 → 读取本地文件 → Base64 编码 │

│ ↓ │

│ 从环境变量读取 API 密钥 │

│ ↓ │

│ 通过 tencentcloud-sdk-python 发起 API 请求 │

└──────────────────────┬──────────────────────────────────┘

↓

┌──────────────────────┴──────────────────────────────────┐

│ 云端推理层(腾讯云 DetectAIFakeFaces) │

│ │

│ 多模态 AI 大模型分析 │

│ ├── AIGC 换脸检测 │

│ ├── 翻拍痕迹检测 │

│ ├── 黑产攻击识别 │

│ └── 水印痕迹检测 │

│ ↓ │

│ 返回结构化风险评估结果(JSON) │

└──────────────────────┬──────────────────────────────────┘

↓

┌──────────────────────┴──────────────────────────────────┐

│ 用户交互层(OpenClaw Agent) │

│ │

│ LLM 接收检测结果 → 生成自然语言报告 → 呈现给用户 │

└─────────────────────────────────────────────────────────┘Skill 本身是一个轻量级的 Python 脚本封装层,核心检测能力由腾讯云后端的多模态 AI 大模型提供。这种架构设计的优势在于:本地不需要任何 GPU 资源或大模型部署,所有推理计算都在腾讯云端完成,保证了检测的高精度和低延迟。

7. 注意事项与最佳实践

在使用本 Skill 时,建议关注以下几点:

关于 API 密钥安全。 始终通过环境变量传递密钥,切勿在代码中硬编码。建议为防护盾服务创建专用的子账号,仅授予 faceid:DetectAIFakeFaces 接口的调用权限,遵循最小权限原则。

关于输入素材质量。 素材质量直接影响检测精度。建议使用推荐分辨率(480×640)以上的图片,推荐jpg、png格式,确保人脸区域清晰可见且占比合理。视频素材建议控制在 2~5 秒,过长的视频不仅增加传输耗时,也可能超出接口限制。

关于费用控制。 腾讯云人脸核身服务按调用次数计费,新用户通常可获得一定额度的免费资源包。建议在正式接入前,先在控制台领取免费资源包进行测试验证。大规模使用前,请关注 人脸核身计费说明 了解详细定价。

关于结果判读。 风险等级为 "Mid"(中风险)时,建议结合业务场景进行综合判断,而非简单地一刀切拦截。可以设计分级处理策略:低风险直接通过,中风险触发人工复核,高风险直接拦截。

备注:请确保您委托本服务处理人脸等个人信息已获得个人信息主体合法、有效的同意或具备其他的合法性基础,本服务的相关具体事项以本服务官网所载服务协议约定为准。

8. 总结

通过将腾讯云 AI 人脸防护盾封装为 OpenClaw Skill,开发者可以在自然对话中一键调用专业级的人脸防伪检测能力,无需关心底层 API 对接细节。无论是对可疑图片的快速甄别,还是将防护盾集成到业务审核流程中,这个 Skill 都能显著降低接入门槛、提升安全防护水平。

面对日益猖獗的 AI 伪造攻击,现在就为你的 OpenClaw 装上"火眼金睛"吧。

相关链接:

资源 | 地址 |

|---|---|

Skill 下载 | |

ClawHub 官网 | |

腾讯云人脸核身产品文档 | |

腾讯云 API 密钥管理 |

扫码加入OpenClaw × 腾讯云AI产品Skills交流群:

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录