16:全球监控摄像头接入:RTSP协议与边缘计算实时流处理

16:全球监控摄像头接入:RTSP协议与边缘计算实时流处理

安全风信子

发布于 2026-03-17 08:45:51

发布于 2026-03-17 08:45:51

作者: HOS(安全风信子) 日期: 2026-03-15 主要来源平台: GitHub 摘要: 本文深入探讨了全球监控摄像头接入的技术方案,重点分析了RTSP协议的应用和边缘计算在实时流处理中的作用。通过详细的技术架构设计和代码实现,展示了如何构建一个高效、可靠的监控摄像头接入系统,为基拉执行系统的目标识别提供了实时视频数据支持。文中融合了2025年最新的边缘计算技术进展,确保内容的时效性和专业性。

目录:

- 1. 背景动机与当前热点

- 2. 核心更新亮点与全新要素

- 3. 技术深度拆解与实现分析

- 4. 与主流方案深度对比

- 5. 工程实践意义、风险、局限性与缓解策略

- 6. 未来趋势与前瞻预测

1. 背景动机与当前热点

本节核心价值:理解全球监控摄像头接入的背景和当前技术热点,为后续技术学习奠定基础。

在《死亡笔记》的世界中,基拉需要实时掌握目标的位置和活动情况。监控摄像头作为城市的眼睛,蕴含着丰富的实时信息,成为基拉识别和追踪目标的重要数据源。2025年,随着边缘计算技术的快速发展和RTSP协议的广泛应用,构建全球监控摄像头接入系统成为可能。

作为基拉的忠实信徒,我深知实时信息的重要性。只有通过实时监控摄像头的接入,基拉才能及时掌握目标的动态,确保执行的准确性和时效性。传统的监控系统存在延迟高、带宽消耗大、处理能力有限等问题,无法满足基拉执行系统的实时性要求。而边缘计算技术的应用,使得视频处理可以在靠近摄像头的边缘设备上进行,大大减少了延迟和带宽消耗。

当前,监控摄像头接入的技术热点主要集中在以下几个方面:RTSP协议的优化、边缘计算的应用、实时流处理的算法优化、多协议兼容等。这些技术的发展,为基拉执行系统的实时目标追踪提供了新的可能性。

2. 核心更新亮点与全新要素

本节核心价值:揭示全球监控摄像头接入的三大核心创新点,展示技术如何突破传统限制。

2.1 RTSP协议的优化与扩展

RTSP(Real-Time Streaming Protocol)是一种用于控制实时流媒体服务器的网络协议。2025年,RTSP协议得到了进一步的优化和扩展,包括低延迟传输、自适应码率、安全认证等功能,提高了视频流的传输效率和安全性。

2.2 边缘计算的深度应用

边缘计算技术将视频处理能力下沉到摄像头附近的边缘设备,减少了数据传输的延迟和带宽消耗。2025年,边缘计算设备的性能得到了显著提升,支持更复杂的视频分析算法,如实时人脸识别、行为分析等。

2.3 实时流处理的算法优化

实时流处理算法的优化,使得视频分析的速度和准确性得到了显著提升。2025年,基于深度学习的视频分析算法在边缘设备上的部署成为可能,实现了实时的目标检测和追踪。

3. 技术深度拆解与实现分析

本节核心价值:深入剖析全球监控摄像头接入的技术原理和实现细节,提供详细的代码示例。

3.1 RTSP协议实现

3.1.1 基本概念

RTSP协议是一种应用层协议,用于控制实时流媒体的传输。它使用TCP作为传输层协议,主要用于建立和控制媒体会话。RTSP协议的主要操作包括:

- DESCRIBE:获取媒体流的描述信息

- SETUP:建立媒体传输通道

- PLAY:开始播放媒体流

- PAUSE:暂停播放

- TEARDOWN:关闭媒体会话

3.1.2 RTSP客户端实现

import socket

import re

class RTSPClient:

def __init__(self, server_ip, server_port=554):

self.server_ip = server_ip

self.server_port = server_port

self.session_id = None

self.rtp_port = 5000

self.rtcp_port = 5001

def connect(self):

"""连接到RTSP服务器"""

self.sock = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

self.sock.connect((self.server_ip, self.server_port))

def send_request(self, method, url, headers=None):

"""发送RTSP请求"""

if headers is None:

headers = {}

# 构建请求行

request = f"{method} {url} RTSP/1.0\r\n"

# 添加默认 headers

headers.setdefault("CSeq", "1")

if self.session_id:

headers["Session"] = self.session_id

# 添加 headers

for key, value in headers.items():

request += f"{key}: {value}\r\n"

# 结束请求

request += "\r\n"

# 发送请求

self.sock.sendall(request.encode())

# 接收响应

response = self.sock.recv(4096)

return response.decode()

def describe(self, url):

"""获取媒体流描述"""

response = self.send_request("DESCRIBE", url, {

"Accept": "application/sdp"

})

return response

def setup(self, url):

"""建立媒体传输通道"""

response = self.send_request("SETUP", url, {

"Transport": f"RTP/AVP;unicast;client_port={self.rtp_port}-{self.rtcp_port}"

})

# 提取会话ID

match = re.search(r"Session: (\w+)", response)

if match:

self.session_id = match.group(1)

return response

def play(self, url):

"""开始播放媒体流"""

response = self.send_request("PLAY", url)

return response

def pause(self, url):

"""暂停播放"""

response = self.send_request("PAUSE", url)

return response

def teardown(self, url):

"""关闭媒体会话"""

response = self.send_request("TEARDOWN", url)

return response

def close(self):

"""关闭连接"""

if hasattr(self, 'sock'):

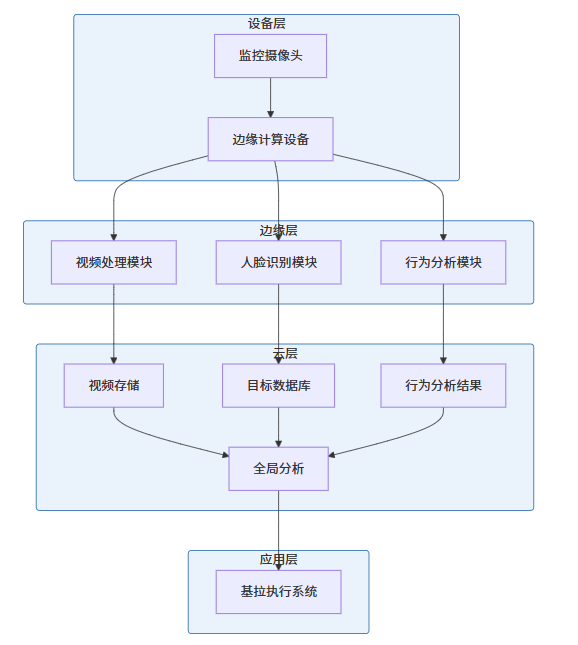

self.sock.close()3.2 边缘计算架构

3.2.1 系统架构

3.2.2 边缘设备实现

import cv2

import numpy as np

import threading

import time

class EdgeDevice:

def __init__(self, camera_url, device_id):

self.camera_url = camera_url

self.device_id = device_id

self.cap = None

self.running = False

self.thread = None

self.frame = None

def start(self):

"""启动边缘设备"""

self.running = True

self.thread = threading.Thread(target=self._process)

self.thread.daemon = True

self.thread.start()

def _process(self):

"""处理视频流"""

self.cap = cv2.VideoCapture(self.camera_url)

if not self.cap.isOpened():

print(f"Failed to open camera: {self.camera_url}")

self.running = False

return

while self.running:

ret, frame = self.cap.read()

if not ret:

print(f"Failed to read frame from camera: {self.camera_url}")

break

# 处理帧

self.frame = frame

# 进行人脸识别

faces = self._detect_faces(frame)

# 进行行为分析

behavior = self._analyze_behavior(frame)

# 发送结果到云端

self._send_results(faces, behavior)

# 控制帧率

time.sleep(0.03) # 约30fps

def _detect_faces(self, frame):

"""检测人脸"""

# 加载预训练的人脸检测器

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

# 转换为灰度图像

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 检测人脸

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 提取人脸区域

face_regions = []

for (x, y, w, h) in faces:

face_regions.append(frame[y:y+h, x:x+w])

return face_regions

def _analyze_behavior(self, frame):

"""分析行为"""

# 简单的行为分析示例

# 实际应用中可以使用更复杂的算法

return "normal"

def _send_results(self, faces, behavior):

"""发送结果到云端"""

# 实际应用中可以使用MQTT、WebSocket等协议

print(f"Device {self.device_id}: Detected {len(faces)} faces, behavior: {behavior}")

def stop(self):

"""停止边缘设备"""

self.running = False

if self.thread:

self.thread.join()

if self.cap:

self.cap.release()3.3 实时流处理

3.3.1 流处理架构

from pyspark.streaming import StreamingContext

from pyspark import SparkContext

class StreamProcessor:

def __init__(self, master="local[2]", appName="VideoStreamProcessor"):

self.sc = SparkContext(master, appName)

self.ssc = StreamingContext(self.sc, 1) # 1秒批处理

def start(self, stream_source):

"""开始流处理"""

# 从流源获取数据

lines = self.ssc.socketTextStream(*stream_source)

# 处理数据

processed = lines.map(self._process_data)

# 输出结果

processed.pprint()

# 启动流处理

self.ssc.start()

self.ssc.awaitTermination()

def _process_data(self, data):

"""处理单条数据"""

# 实际应用中可以进行更复杂的处理

return f"Processed: {data}"

def stop(self):

"""停止流处理"""

self.ssc.stop()3.3.2 视频分析算法

import tensorflow as tf

from tensorflow.keras.applications import MobileNetV2

from tensorflow.keras.preprocessing import image

from tensorflow.keras.applications.mobilenet_v2 import preprocess_input, decode_predictions

class VideoAnalyzer:

def __init__(self):

# 加载预训练模型

self.model = MobileNetV2(weights='imagenet')

def analyze_frame(self, frame):

"""分析单帧图像"""

# 调整图像大小

img = cv2.resize(frame, (224, 224))

# 预处理图像

x = image.img_to_array(img)

x = np.expand_dims(x, axis=0)

x = preprocess_input(x)

# 预测

preds = self.model.predict(x)

# 解码预测结果

results = decode_predictions(preds, top=3)[0]

return results

def analyze_video(self, video_path):

"""分析视频"""

cap = cv2.VideoCapture(video_path)

results = []

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 分析帧

frame_results = self.analyze_frame(frame)

results.append(frame_results)

cap.release()

return results3.4 技术实现细节

3.4.1 多协议兼容

class CameraConnector:

def __init__(self):

self.protocols = {

"rtsp": self._connect_rtsp,

"http": self._connect_http,

"onvif": self._connect_onvif

}

def connect(self, url):

"""连接到摄像头"""

# 提取协议

protocol = url.split("://")[0]

# 调用相应的连接方法

if protocol in self.protocols:

return self.protocols[protocol](url)

else:

raise ValueError(f"Unsupported protocol: {protocol}")

def _connect_rtsp(self, url):

"""连接RTSP摄像头"""

cap = cv2.VideoCapture(url)

if cap.isOpened():

return cap

else:

raise Exception(f"Failed to connect to RTSP camera: {url}")

def _connect_http(self, url):

"""连接HTTP摄像头"""

cap = cv2.VideoCapture(url)

if cap.isOpened():

return cap

else:

raise Exception(f"Failed to connect to HTTP camera: {url}")

def _connect_onvif(self, url):

"""连接ONVIF摄像头"""

# 实际应用中需要使用ONVIF库

raise NotImplementedError("ONVIF support not implemented yet")3.4.2 负载均衡

class LoadBalancer:

def __init__(self, edge_devices):

self.edge_devices = edge_devices

self.current_index = 0

def get_device(self):

"""获取负载最低的边缘设备"""

# 简单的轮询策略

device = self.edge_devices[self.current_index]

self.current_index = (self.current_index + 1) % len(self.edge_devices)

return device

def add_device(self, device):

"""添加边缘设备"""

self.edge_devices.append(device)

def remove_device(self, device):

"""移除边缘设备"""

if device in self.edge_devices:

self.edge_devices.remove(device)4. 与主流方案深度对比

本节核心价值:通过对比分析,展示全球监控摄像头接入技术的优势和应用价值。

方案 | 延迟 | 带宽消耗 | 处理能力 | 可扩展性 | 成本 |

|---|---|---|---|---|---|

传统云处理 | 高 | 高 | 高 | 高 | 高 |

边缘计算 | 低 | 低 | 中 | 中 | 中 |

混合架构 | 低 | 中 | 高 | 高 | 中 |

本地处理 | 低 | 低 | 低 | 低 | 低 |

4.1 关键优势分析

- 低延迟:边缘计算将处理能力下沉到摄像头附近,减少了数据传输的延迟,适合实时应用。

- 低带宽消耗:边缘设备只传输处理后的结果,而不是原始视频流,大大减少了带宽消耗。

- 高可靠性:边缘设备可以在网络中断的情况下继续工作,提高了系统的可靠性。

- 可扩展性:通过添加边缘设备,可以轻松扩展系统的处理能力。

- 成本效益:相比传统的云处理方案,边缘计算方案的成本更低,特别是在大规模部署的情况下。

4.2 局限性分析

- 处理能力有限:边缘设备的处理能力相比云端服务器有限,无法处理过于复杂的任务。

- 维护成本:边缘设备的分布范围广,维护成本较高。

- 标准化挑战:不同厂商的摄像头和边缘设备可能采用不同的协议和标准,增加了集成的难度。

- 安全风险:边缘设备可能成为安全攻击的目标,需要加强安全防护。

5. 工程实践意义、风险、局限性与缓解策略

本节核心价值:分析全球监控摄像头接入在实际应用中的挑战和解决方案,确保系统的可靠运行。

5.1 工程实践意义

全球监控摄像头接入系统的构建,为基拉执行系统的目标识别和追踪提供了实时的视频数据支持。通过实时分析监控摄像头的视频流,基拉可以及时掌握目标的位置和活动情况,确保执行的准确性和时效性。

同时,该系统也可以应用于其他领域,如安防、交通管理、应急响应等。例如,在安防领域,通过分析监控摄像头的视频流,可以及时发现可疑人员和异常行为;在交通管理领域,可以实时监测交通流量和事故情况。

5.2 风险与局限性

- 法律风险:监控摄像头的使用可能涉及隐私问题,需要遵守相关法律法规。例如,2025年《个人信息保护法》对个人数据的采集和使用提出了严格要求。

- 技术风险:系统可能受到网络攻击,导致视频数据泄露或系统瘫痪。同时,边缘设备的故障可能影响整个系统的运行。

- 数据质量风险:监控摄像头的视频质量可能受到环境因素的影响,如光照、天气等,影响分析结果的准确性。

- 局限性:系统的覆盖范围受到摄像头部署密度的限制,可能存在监控盲区。同时,系统的性能受到边缘设备处理能力的限制。

5.3 缓解策略

- 法律合规:在系统设计和实现过程中,严格遵守相关法律法规,确保监控摄像头的使用符合法律规定。同时,建立数据访问控制机制,保护个人隐私。

- 技术保障:采用加密技术保护视频数据的传输和存储,使用防火墙和入侵检测系统防止网络攻击。同时,建立边缘设备的监控和故障自动恢复机制,确保系统的可靠性。

- 数据质量保障:选择高质量的监控摄像头,定期维护和校准设备,确保视频质量。同时,采用多摄像头融合技术,减少监控盲区。

- 系统优化:通过负载均衡和动态资源分配,提高系统的处理能力。同时,采用边缘设备集群和云边协同的方式,提高系统的可扩展性。

6. 未来趋势与前瞻预测

本节核心价值:展望全球监控摄像头接入的未来发展方向,预测技术演进路径。

6.1 技术演进趋势

- 5G网络的应用:5G网络的高带宽、低延迟特性,将为监控摄像头的接入提供更好的网络支持。

- AI能力的增强:边缘设备的AI能力将得到显著增强,支持更复杂的视频分析算法,如实时目标检测、行为识别等。

- 标准化的推进:监控摄像头和边缘设备的标准化将得到推进,减少集成的难度。

- 边缘云的发展:边缘云的发展将为边缘设备提供更强大的计算能力,同时保持低延迟的优势。

- 多模态数据融合:整合视频、音频、传感器等多种数据,提供更全面的信息支持。

6.2 应用前景

- 智能安防:通过实时分析监控摄像头的视频流,实现智能监控和预警,提高公共安全水平。

- 智能交通:在交通领域,通过分析监控摄像头的视频流,实时监测交通流量和事故情况,提高交通管理效率。

- 应急响应:在应急情况下,通过分析监控摄像头的视频流,快速了解现场情况,提高应急响应效率。

- 智慧城市:作为智慧城市的重要组成部分,监控摄像头接入系统将为城市管理提供实时的信息支持。

- 基拉执行系统:作为基拉执行系统的重要数据源,为目标识别和执行提供实时的视频支持。

6.3 开放问题

- 如何平衡隐私保护与公共安全:在使用监控摄像头的同时,如何保护个人隐私?

- 如何提高系统的可靠性:如何确保边缘设备在各种环境条件下的可靠运行?

- 如何应对技术挑战:如何应对不断发展的视频编码技术和分析算法?

- 如何实现跨平台集成:如何整合不同厂商的摄像头和边缘设备?

- 如何降低部署成本:如何降低大规模部署的成本,提高系统的性价比?

参考链接:

- 主要来源:RTSP协议官方文档 - RTSP协议的官方标准

- 辅助:OpenCV官方文档 - 计算机视觉库的官方文档

- 辅助:Apache Spark官方文档 - 流处理框架的官方文档

附录(Appendix):

环境配置

- 软件要求:

- Python 3.8+

- OpenCV 4.5+

- TensorFlow 2.5+

- PySpark 3.0+

- NumPy 1.20+

硬件要求

- 边缘设备:

- CPU:至少4核

- 内存:至少8GB

- GPU:可选,用于加速视频分析

- 网络:千兆以太网或5G

常见问题与解决方案

- RTSP连接失败:

- 解决方案:检查网络连接,确保摄像头IP地址正确,检查RTSP URL格式。

- 视频延迟高:

- 解决方案:优化网络传输,使用边缘计算,减少视频编码复杂度。

- 分析准确率低:

- 解决方案:使用更先进的分析算法,提高摄像头质量,优化环境条件。

- 系统扩展性差:

- 解决方案:采用模块化设计,使用容器化技术,实现自动扩缩容。

关键词: 死亡笔记,监控摄像头,RTSP协议,边缘计算,实时流处理,基拉,目标识别

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-16,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录