深夜告警!Nginx内存诡异暴涨100%,竟因一个“开源替换”功能?

深夜告警!Nginx内存诡异暴涨100%,竟因一个“开源替换”功能?

SRE运维进阶之路

发布于 2026-03-16 16:37:57

发布于 2026-03-16 16:37:57

📢 凌晨三点,刺耳的告警划破宁静! 手机疯狂震动: “Nginx虚拟机已重启!” 睡眼惺忪的我心里一沉——线上服务出事了!

火速登录监控平台,资源画像触目惊心:内存曲线像坐了火箭🚀,一路飙升直至耗尽! 紧接着Swap被榨干,磁盘IO爆表... 服务器在崩溃边缘反复横跳,最终触发了OOM Killer的重启保命机制。

这绝不是一次普通的波动,内存正在被某个“黑洞”疯狂吞噬!必须立刻揪出元凶!

🔍 第一现场:锁定“吃内存怪兽”

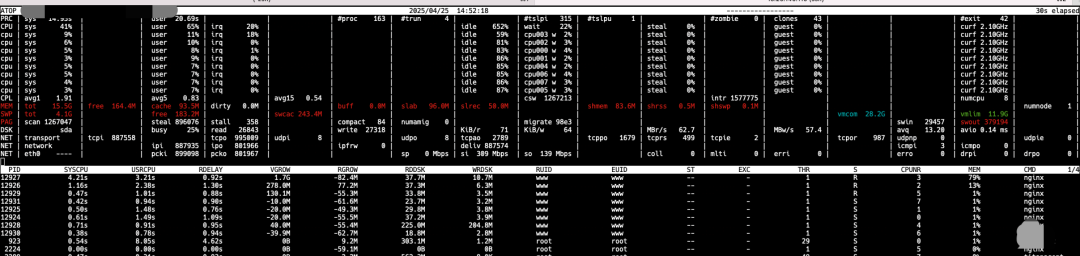

- • 祭出神器

atop,实时捕捉案发瞬间。

- • 关键证据浮现: 几个

Nginx worker进程化身“内存饕餮”,available内存被它们一点点蚕食殆尽,最终被迫动用缓慢的Swap,导致系统卡顿直至崩溃。 - • 初步结论: 问题出在 Nginx 自身,而且很可能在它的处理逻辑里。

📜 日志里的蛛丝马迹:OOM与诡异错误

• journalctl -k | grep -i 'Out of memory':内核日志铁证如山,确认是内存耗尽被OOM Killer干掉的。

• 深入Nginx error.log,发现了决定性线索:

2025/04/24 21:11:41 [emerg] ... malloc(1073741824) failed (12: Cannot allocate memory) ... while reading upstream ...

2025/04/24 21:11:41 [error] ... [subs_filter] ngx_http_subs_body_filter error ...- •

1GB内存申请失败! 这太反常了!什么操作需要瞬间申请这么大块内存? - • 关键模块现身:

ngx_http_subs_body_filter(属于ngx_http_substitutions_filter_module)。这个模块负责把响应内容里的域名替换成CDN域名。

🕵️ 顺藤摸瓜:谁触发了“内存炸弹”?

- • 调取案发时间段的

access.log,化身“数据侦探”:- • 聚焦内存飙升但未崩溃的时间窗口。

- • 筛查: 请求量爆炸的URL?大请求体?慢响应?

- • 特别关注: 最近新上线的域名或功能。

- • 锁定“嫌疑人”: 几个访问量大且响应体较大(尤其是返回大JSON)的URL。

💣 压力测试:重现“案发现场”

- • 对可疑URL发起猛烈的

ab压测 (ab -n 8000 -c 200 -H 'Host: ...' ...)。 - • 内存监控曲线再次陡峭上扬!

mpstat眼睁睁看着可用内存快速消失。 - • 实锤! 访问这些特定URL,必然触发内存暴涨。

🧩 真相大白:开源模块的“内存泄漏陷阱”

- • 排查URL本身和上游服务,均无异常。开源项目社区也没相关Issue。

- • 矛头直指

ngx_http_substitutions_filter_module! 大胆假设:是这个第三方模块在处理特定内容(尤其是大块、无明确边界的JSON)时,发生了内存泄漏! - • 验证: 在配置中注释掉

subs_filter相关指令,再次进行魔鬼压测... - • 🎉 奇迹出现!内存曲线稳如泰山! 泄漏源确认无误!

❓ 为什么泄漏?

我们使用的 ngx_http_substitutions_filter_module 是第三方模块,需要重新编译Nginx集成。它在处理大型响应体(特别是流式或边界不清晰的内容如大JSON)时,存在内存管理缺陷,未能正确释放分配的内存,导致每次处理这类请求就“漏”一点,积少成多最终压垮服务器。

🛠️ 三管齐下,彻底修复

- 1. 精准禁用: 对无需替换功能的内网域名,直接关闭

subs_filter。减少风险面。 - 2. 严格限定范围: 使用

subs_filter_types指令,限制只对明确需要替换的类型(如text/html)生效。排除application/json等高风险类型! (这是关键!) - 3. 源码级修复 (终极方案): 深入分析模块源码,定位泄漏点(通常是某个循环或异常路径未释放内存),打补丁并重新编译Nginx。一劳永逸。

🔧 运维利器:内存分析神器推荐

- • OpenResty XRay (商业): 章亦春大佬出品,功能强大,深度分析Nginx/LuaJIT,诊断内存泄漏、性能瓶颈利器。适合追求效率和深度。

- • OpenResty SystemTap Toolkit (开源): 同样来自章大佬,基于SystemTap的强大工具集,包含内存泄漏检测脚本(

ngx-leak)等。需Nginx编译时支持dtrace。 - • Tengine 用户专属: 如果用的是阿里Tengine,可以利用其内置的

ngx_debug_pool和ngx_slab_stat模块(需编译启用)直接分析内存池和共享内存。

💡 血泪教训总结

- 1. 谨慎对待第三方模块: 即使是开源模块,也可能存在隐藏Bug。引入前充分评估,上线后密切监控。

- 2. 给功能戴上“紧箍咒”: 像

subs_filter_types这样的限制指令非常重要!永远不要假设模块能智能处理所有内容类型。 - 3. 监控告警是生命线: 完善的资源监控和及时告警,是快速响应故障的前提。

- 4. 日志是破案关键:

error.log和内核日志 (journalctl/dmesg) 往往藏着最直接的线索。 - 5. 压测是验证利器: 怀疑某个点?用压测来复现和验证!

这次惊心动魄的“内存蒸发案”终于告破。一个小小的域名替换功能,竟因一个开源模块的内存泄漏,差点引发线上雪崩。运维路上,细节决定成败,对开源组件的“信任”也要保持一份警惕。

你的Nginx配置里,有没有藏着类似的“定时炸弹”呢?🤔 不妨检查一下那些第三方模块的使用姿势吧!

你在排查内存泄漏方面有什么独门秘籍或踩坑经历?欢迎留言分享交流!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-05-28,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录