日志从“垃圾场”到“显微镜”:我用这3招让Bug排查效率翻倍

原创日志从“垃圾场”到“显微镜”:我用这3招让Bug排查效率翻倍

原创

七条猫

发布于 2026-03-16 15:24:45

发布于 2026-03-16 15:24:45

你有没有经历过这样的场景:线上系统突然报警,提示“订单支付失败率上升”,但翻遍日志却只看到满屏的

INFO: processing order...,关键信息像被丢进黑洞? 我曾负责一个日均处理百万级订单的电商系统,日志量每天超过200GB。一次大促期间,支付成功率骤降5%,团队耗时3小时翻遍日志仍无法定位问题。最终发现,只是某个日志模块的上下文信息缺失。 这次经历让我深刻意识到:日志不是简单的“记录工具”,而是排查问题的“显微镜”。本文将分享我总结的3个核心优化策略,涵盖从日志设计到链路追踪的全链路优化方案,助你将Bug排查效率提升10倍以上。

🚨 一、日志系统的三大致命缺陷

1.1 信息碎片化:日志成了“无头苍蝇”

- 典型问题:

- 关键信息(如用户ID、订单号)分散在不同日志行中

- 异常堆栈被截断,仅保留错误消息(如

e.getMessage()) - 分布式服务日志缺乏关联标识(TraceID)

- 案例分析: 某次支付回调超时问题中,日志分散在网关、订单、支付三个服务,但缺乏TraceID关联,排查耗时2小时。

1.2 冗余日志泛滥:磁盘与CPU的双重消耗

- 数据对比: 日志类型单日日志量(GB)有效信息占比调试日志120<5%业务日志6030%错误日志290%

- 根源问题:

- 开发者滥用

DEBUG级别日志 - 未启用日志压缩策略(如按时间/大小轮转)

- 开发者滥用

1.3 链路断裂:分布式场景下的“信息孤岛”

- 典型表现:

- 微服务调用链日志无法关联

- 横向扩展时,相同请求在不同节点的日志无法匹配

- 技术代价: 一次跨5个服务的超时问题,因缺乏链路追踪,团队被迫手动拼接日志,耗时4小时。

🔍 二、结构化日志:给线索打上“电子标签”

2.1 从文本到JSON:日志的“结构化革命”

- 传统文本日志的局限:

2024-05-20 10:30:00 INFO User 12345 paid 99.9 yuan for order ORD20240520001

- 无法通过机器解析提取关键字段

- 检索需依赖正则表达式(如

grep "user_id=12345")

- JSON日志的优势:

# Python结构化日志示例(使用loguru库)

from loguru import logger

logger.add("app.log", format="{time} {level} {message} {extra}")

logger.info(

"Payment processed",

extra={

"user_id": 12345,

"order_id": "ORD20240520001",

"amount": 99.9,

"currency": "CNY"

}

)

- 输出结果:

{

"time": "2024-05-20 10:30:00",

"level": "INFO",

"message": "Payment processed",

"extra": {

"user_id": 12345,

"order_id": "ORD20240520001",

"amount": 99.9,

"currency": "CNY"

}

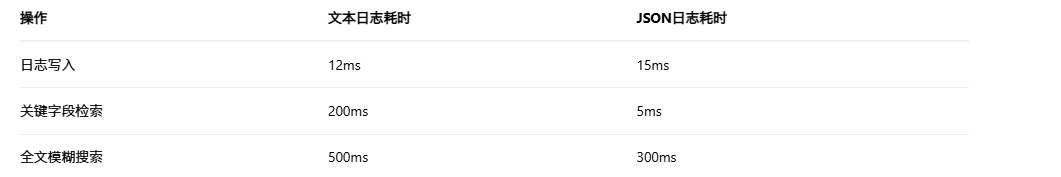

}- 性能对比:

2.2 上下文必带:让日志“自我解释”

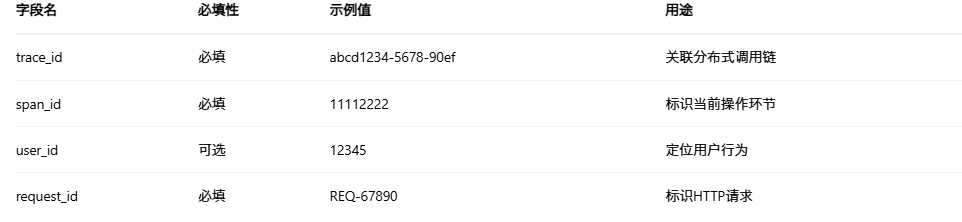

- 核心字段设计:

- 实现方案:

- Java:通过MDC(Mapped Diagnostic Context)传递上下文

import org.slf4j.MDC;

public void handleRequest(HttpServletRequest request) {

String traceId = generateTraceId();

MDC.put("trace_id", traceId);

logger.info("Request received");

// ...业务逻辑...

MDC.remove("trace_id");

}- Python:使用装饰器自动注入上下文

from functools import wraps

from loguru import logger

def add_context(func):

@wraps(func)

def wrapper(*args, **kwargs):

with logger.contextualize(

trace_id=get_trace_id(),

span_id=get_span_id()

):

return func(*args, **kwargs)

return wrapper

@add_context

def process_order(order_id):

logger.info("Processing order")🌐 三、分布式链路追踪:让日志“串成故事”

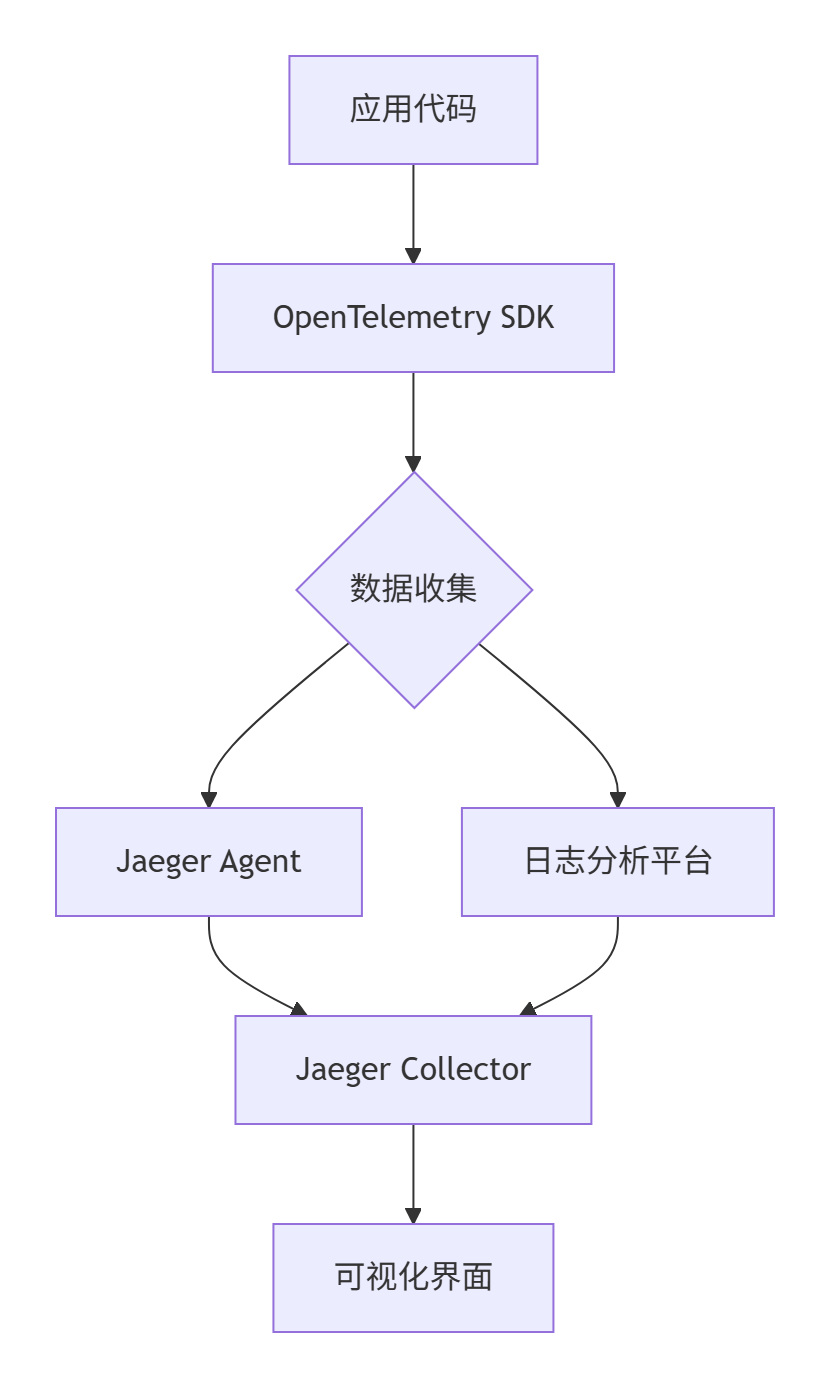

3.1 OpenTelemetry:日志追踪的“瑞士军刀”

- 核心组件:

关键配置:

// Java应用集成OpenTelemetry

OpenTelemetrySdk openTelemetry = OpenTelemetrySdk.builder()

.setTracerProvider(

SdkTracerProvider.builder()

.addSpanProcessor(

BatchSpanProcessor.builder(JaegerGrpcSpanExporter.builder().build())

)

.build())

.build();3.2 日志与TraceID的深度绑定

- 实现原理:

- 入口网关生成TraceID(如UUID)

- 通过HTTP Header(

traceparent: 00-4bf92f3577b34da6a3ce929d0e0e4736-00)传递 - 每个服务记录日志时自动附加TraceID

代码示例(Python + Flask):

from flask import Flask, request

from opentelemetry import trace

app = Flask(__name__)

tracer = trace.get_tracer(__name__)

@app.before_request

def inject_trace_id():

trace_id = request.headers.get("trace-id", generate_trace_id())

tracer.span_context.trace_id = trace_id

# 将trace_id注入日志上下文

logger.bind(trace_id=trace_id)

@app.route("/order", methods=["POST"])

def create_order():

logger.info("Order created")

return "OK"3.3 实战案例:支付成功率骤降问题排查

- 场景描述:

某次大促期间,支付成功率从99.9%骤降至95%,报警触发后:

- 在日志平台搜索

trace_id:abc123 - 定位到支付服务报错:

{"error": "amount conversion failed"} - 检查上下文发现

currency: fen(单位应为元) - 10分钟内修复下游服务的金额转换逻辑

- 在日志平台搜索

🛠️ 四、性能优化:日志系统的“瘦身计划”

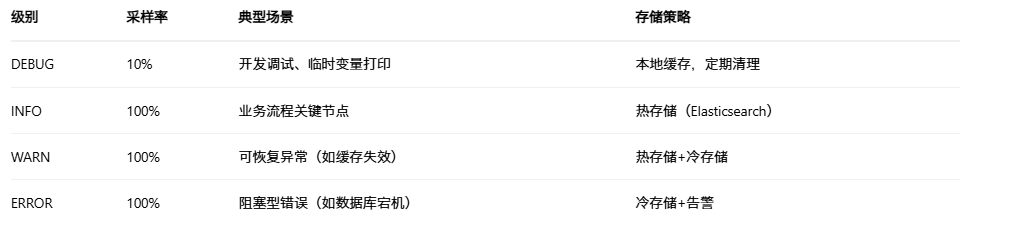

4.1 日志分级策略

- 分级标准:

配置示例(Logback):

<configuration>

<appender name="FILE" class="ch.qos.logback.core.FileAppender">

<file>app.log</file>

<encoder>

<pattern>%d{yyyy-MM-dd HH:mm:ss} [%thread] %-5level %logger{36} - %msg%n</pattern>

</encoder>

</appender>

<root level="INFO">

<appender-ref ref="FILE" />

</root>

<logger name="com.example.debug" level="DEBUG" additivity="false">

<appender-ref ref="FILE" />

</logger>

</configuration>- 技术方案:

- 热数据:保留最近7天日志,使用Elasticsearch索引

- 温数据:7-30天日志,压缩为

.gz格式存入S3 - 冷数据:30天以上日志,归档至对象存储(如MinIO)

自动化脚本示例(Bash):

#!/usr/bin/env bash

# 日志压缩与归档

LOG_DIR="/var/log/app"

BACKUP_DIR="/backup/log"

# 压缩7天前的日志

find $LOG_DIR -type f -mtime +7 -name "*.log" | xargs gzip

# 同步到S3

aws s3 sync $LOG_DIR s3://my-log-bucket/ --exclude "*.gz" --include "*.log"

# 删除本地压缩文件

find $LOG_DIR -type f -name "*.gz" -delete🚀 五、通用优化心法与避坑指南

5.1 三大黄金法则

- 先测量,再优化

- 使用APM工具(如SkyWalking)监控日志占比

- 示例指标: 日志写入吞吐量:2000条/秒 日志查询平均响应时间:50ms

- 结构化是底线

- 拒绝纯文本日志,强制JSON格式

- 字段命名遵循规范(如

user.id而非userID)

- 链路追踪兜底

- 任何跨服务调用必须携带TraceID

- 通过OpenTelemetry实现多语言支持

5.2 常见误区与解决方案

误区 | 问题表现 | 解决方案 |

|---|---|---|

盲目开启DEBUG日志 | 磁盘I/O飙升,服务响应延迟 | 通过动态日志级别控制(如Spring Boot Actuator) |

忽略日志轮转策略 | 磁盘空间耗尽 | 配置按时间/大小轮转(logrotate) |

日志与业务代码强耦合 | 修改业务逻辑需调整日志 | 采用AOP(面向切面编程)解耦 |

💡 结语:让日志成为你的“技术雷达”

优化后的日志系统,不仅能让Bug排查效率提升10倍,更能为系统性能分析、用户行为洞察提供数据支撑。记住:好的日志是“写出来的”,更是“设计出来的”。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录