贝叶斯智能体:通过语言化概率图模型进行不确定性下的贝叶斯智能体推理

贝叶斯智能体:通过语言化概率图模型进行不确定性下的贝叶斯智能体推理

CreateAMind

发布于 2026-03-11 19:17:24

发布于 2026-03-11 19:17:24

贝叶斯智能体:通过语言化概率图模型进行不确定性下的贝叶斯智能体推理

BayesAgent: Bayesian Agentic Reasoning Under Uncertainty via Verbalized Probabilistic Graphical Modeling

https://www.alphaxiv.org/zh/overview/2406.05516v4

摘要

人类认知的卓越之处在于能够超越感官输入,形成构建我们对世界理解结构的潜在表征。虽然大型语言模型(LLM)智能体展现出 emergent 的推理和决策能力,但它们缺乏一个原则性的框架来捕捉潜在结构并对不确定性进行建模。在这项工作中,我们首次探索如何将 LLM 智能体与概率图模型(PGM)相结合,以解决不确定性下的智能体推理问题。为此,我们引入了语言化概率图建模(vPGM),这是一个贝叶斯智能体框架,它能够(i)通过自然语言引导 LLM 智能体遵循 PGM 的关键原则,以及(ii)通过数值贝叶斯推理优化得到的后验分布。与许多需要大量领域专业知识的传统概率方法不同,vPGM 绕过了专家驱动的模型设计,使其特别适用于假设条件有限的场景。我们在几个封闭式和开放式的智能体推理任务上评估了我们的模型。结果表明,该模型有效地增强了置信度校准和文本生成质量。代码与附录 —— https://github.com/xingbpshen/agentic-reasoning-vpgm

引言

在处理复杂的推理问题(例如解决具有挑战性的科学问题)时,人类大脑被认为有能力超越单纯的感官输入,可能形成对世界潜在模式的洞察。这种能力表明,人类可能拥有解释潜在结构和不确定性的复杂技能(Tenenbaum et al. 2011),尽管其确切机制仍是 ongoing 研究和争论的主题。截至目前,人类所展现出的这种理解深度尚未在人工智能系统中完全实现(Lake et al. 2017; Bender and Koller 2020; Zheng et al. 2021; Sumers et al. 2023)。

虽然大型语言模型在处理和生成人类语言方面展现了令人印象深刻的能力(Devlin et al. 2018; Brown et al. 2020; Achiam et al. 2023),但其性能常常受限于其训练数据的范围。这些模型主要基于海量文本语料库构建,擅长生成句法连贯且上下文相关的响应。最近的进展,如思维链(CoT)提示(Wei et al. 2022)和智能体范式的出现(Yao et al. 2023; Schick et al. 2023),已将其能力扩展到交互式和组合式的智能体推理。然而,当在不确定或部分可观测的环境中作为自主智能体运行时,尤其是在那些需要隐性知识以及整合和推理来自多个来源的未公开信息的能力(这些是 humans 在复杂推理中通常运用的技能)的场景下,LLM 智能体常常会遇到困难。这种局限性不仅源于它们对表层语言相关性的依赖,还源于缺乏一个原则性的贝叶斯框架来捕捉潜在结构并对不确定性进行建模。

在这项工作中,我们首次探索如何将 LLM 智能体与概率图模型(PGM)相结合,以解决不确定性下的智能体推理问题。为此,我们引入了语言化概率图建模(vPGM),这是一个贝叶斯智能体框架,它将 LLM 智能体推理的优势与显式的数值贝叶斯推理相结合。与通常需要大量领域专业知识的传统贝叶斯推理框架(Griffiths, Kemp, and Tenenbaum 2008; Bielza and Larrañaga 2014; Wang and Yeung 2020; Abdullah, Hassan, and Mustafa 2022)不同,vPGM 绕过了专家驱动的模型设计,使其特别适用于假设条件有限的场景。具体来说,贝叶斯结构学习方法(Kitson et al. 2023)有助于发现贝叶斯网络,但它们通常需要专家领域知识来手动验证统计依赖性,或者依赖计算成本高昂的评分函数来评估图模型对数据的拟合优度。我们的方法通过引导 LLMs 模拟贝叶斯推理原则,同时通过一个可学习的贝叶斯代理模型增强不确定性量化,从而利用 LLMs 的知识和推理能力,显著减少了对专家输入的依赖。

具体而言,我们的方法包含三个初始阶段:(1)图结构发现,在此阶段,提示 LLM 识别潜在变量及其概率依赖性;(2)基于提示的推理,引导 LLMs 在给定新输入数据的情况下推断每个潜在变量的语言化后验分布;(3)不确定性下的预测,通过计算在推断出的潜在变量上的条件预测分布的期望值,来实现最终预测的置信度。此外,为了充分利用 vPGM 框架内 LLMs 生成的多个响应样本并增强不确定性量化,我们使用数值贝叶斯推理技术扩展了 vPGM,这些技术可以推断预测的后验分布,并通过一个理论上有保证的可微校准损失函数来增强置信度校准。

我们在几个智能体推理任务上评估了我们的方法,这些任务设计为封闭式和开放式回答格式。实验证明,该方法在置信度校准和生成响应的质量方面均有改进,突显了 vPGM 在增强 LLM 智能体概率推理能力方面的有效性。

相关工作

大型语言模型的研究近期已从静态提示转向能够进行智能体推理、工具使用和交互式决策的 LLM 智能体或智能体系统。我们分别讨论这两个方向,强调它们的局限性以及我们提出的 vPGM 如何解决一个关键缺失的组成部分:针对智能体推理任务的概率潜在变量推理和不确定性校准。

LLM 提示 LLM 中的提示方法构成了一个长期的研究方向,其核心是无训练地引导模型响应。早期方法包括上下文学习,即模型根据特定任务的演示进行条件生成;以及指令提示,它将明确的任务指令直接嵌入到自然语言提示中。一个重大的发展是思维链提示,它引出中间推理步骤以增强复杂推理。后续的变体将 CoT 扩展到更灵活或自动化的设置:零样本 CoT、自动 rationale 生成、自洽性解码,以及连续思维链,它将推理轨迹嵌入潜在空间。此外,(Xiong et al. 2023) 在基于一致性的方法基础上进行了扩展,并对 LLM 的置信度 elicitation 进行了实证研究。相比之下,我们提出的 vPGM 从贝叶斯推理的角度解决置信度 elicitation 问题,该方法遵循理论上更扎实的贝叶斯推理框架——概率图模型的原则。

LLM 智能体与智能体系统 在这些提示方法进步的基础上,LLM 提示已演变为 LLM 智能体,它将推理与行动、工具使用以及对外部环境的交互交织在一起。ReAct 结合了自然语言推理与工具调用和环境反馈;Toolformer 使用自监督信号教导 LLM 何时以及如何调用工具;ADAS 则自动化了智能体系统架构的设计。这些系统标志着从被动文本生成向交互式、工具增强行为的转变。然而,现有的智能体方法通常缺乏一个原则性的概率框架:它们不显式地建模潜在变量、量化不确定性或执行贝叶斯信念更新,这限制了它们在需要不确定性下进行校准的智能体推理的场景中的适用性。

同期工作 一些同期的工作探索了使用 LLM 进行概率或因果建模,但它们在很大程度上与我们的贡献是正交的。最近的因果发现研究专注于学习因果关系和反事实,而 vPGM 的目标是针对多源智能体任务的非因果概率潜在变量推理和不确定性校准。BIRD 引入了一个用于 LLM 的贝叶斯推理包装器,但它仅限于二元决策制定,因此不直接适用于我们的多类别和开放式输出。相比之下,vPGM 为 LLM 智能体内的潜在变量推理和校准的不确定性提供了一个统一的贝叶斯框架。

我们的方法:语言化概率图建模(vPGM)

语言化概率图建模(vPGM)是一种贝叶斯智能体推理方法,它利用大型语言模型智能体以自然语言模拟概率图模型的关键原则。与许多需要广泛领域知识和专门训练的现有概率方法不同,vPGM 绕过了基于专家的模型设计需求,使其适用于处理领域假设有限或数据稀缺的复杂推理任务。

vPGM 概述

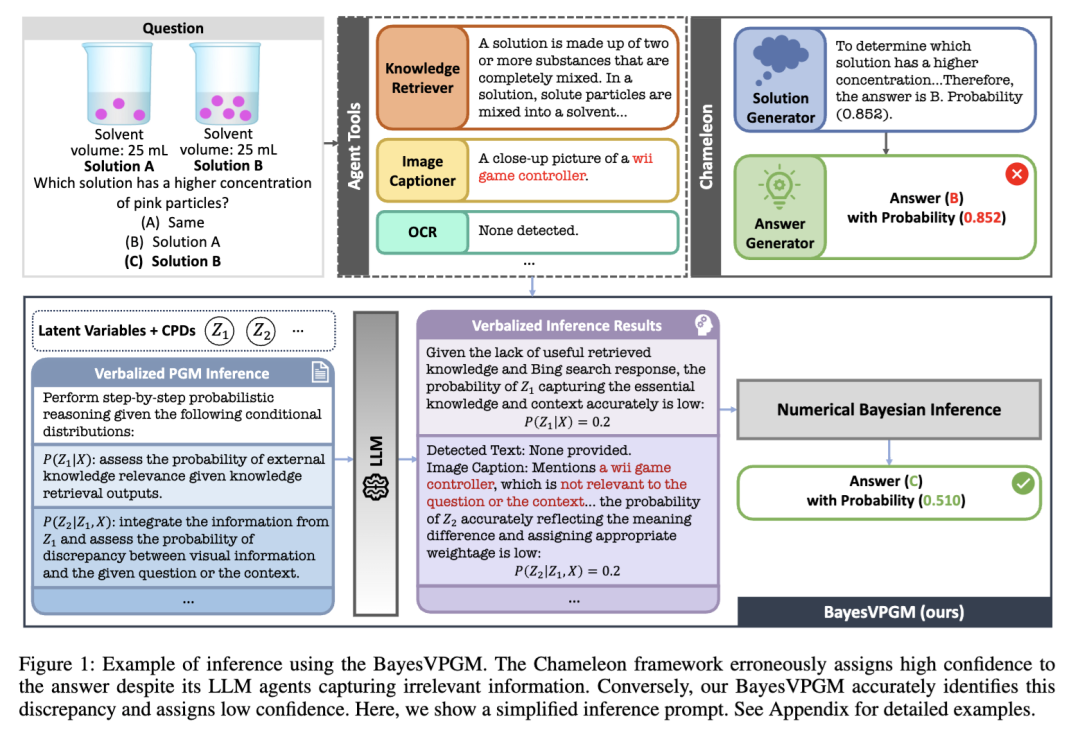

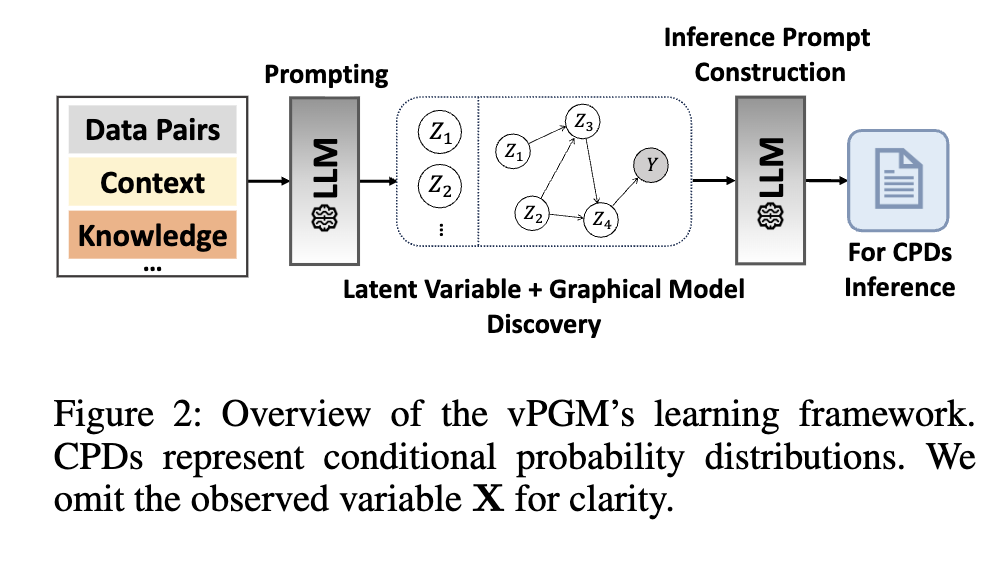

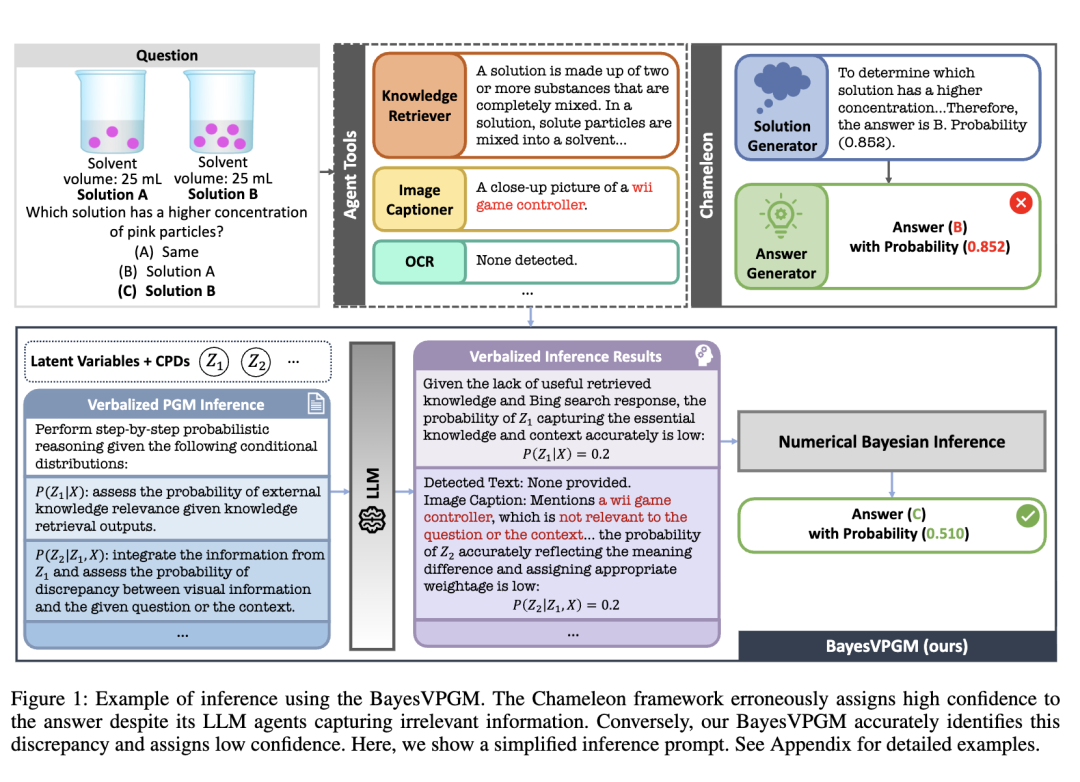

从应用角度来看,vPGM 可以嵌入到一系列复杂的推理系统中,例如智能体推理任务(见图1)。我们的方法将整个推理过程分解为三个核心步骤:(1)图结构发现,在此阶段,通过提示 LLM 来识别潜在变量及其概率依赖关系(见图2);(2)基于提示的推理,引导 LLMs 根据新的输入数据推断每个潜在变量的语言化后验分布;(3)不确定性下的预测,通过计算在推断出的潜在变量上的条件预测分布的期望值,来实现最终预测的置信度。

图结构发现

我们的方法首先通过设计专门的提示(见附录)来揭示组合推理中的潜在变量。该提示包含几个关键要素:(1)通用任务描述,简洁陈述推理目标;(2)输入-输出数据对,展示具有代表性的数据样本;(3)上下文信息,提供必要的背景知识或领域洞见;(4)先验知识与约束,指定约束条件,例如潜在变量的最大数量及其预定义的依赖关系。

在识别出一组潜在变量 Z = {Z₁, Z₂, ..., Zₙ}(潜在变量的示例见附录)之后,我们进一步提示大语言模型(LLMs)来确定每个潜在变量如何依赖于其他变量。从 LLM 获得的一组依赖关系示例如下:{X → Z₁, X → Z₂, X → Z₃, X → Z₄, Z₁ → Z₃, Z₂ → Z₃, Z₂ → Z₄, Z₃ → Z₄, Z₄ → Y},其中每个关系 a → b 表示 b 条件依赖于 a。与传统的概率图模型(PGMs)类似,我们的语言化 PGM(vPGM)将这些依赖关系编码为条件概率分布 P(Zᵢ | Pa(Zᵢ))。然而,vPGM 不依赖于显式的分布形式,而是使用自然语言描述(详细示例见附录)来指定每个条件关系,从而减少了对大量领域专业知识或参数估计的需求。

基于提示的贝叶斯推断

传统上,贝叶斯推断侧重于在给定概率模型和新观测值的情况下推断模型参数的后验分布。然而,在 LLM 的语境下,它被重新表述为生成提示,以在 vPGM 框架下利用其发现的结构和新观测值来模拟后验推断。这种方法利用 LLM 的高级推理能力来生成指令,使其能够模拟贝叶斯推断原理。一个示例提示是:"生成一个提示,引导 LLM 根据提供的任务描述、发现的 PGM 和测试数据,逐步进行概率推理……"

不确定性下的预测

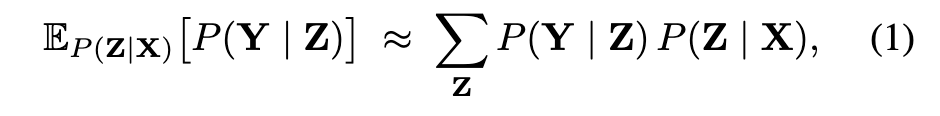

智能体推理任务通常涉及显著的不确定性。例如,LLM 智能体(如图像描述器)可能产生有噪声的输出,引入偶然不确定性。在 vPGM 框架下,这种可变性通过潜在变量的语言化后验分布来捕捉。在通过基于提示的贝叶斯推断构建语言化后验 P(Z | X) 之后,我们通过对 Z 取 P(Y | Z) 的期望值来量化对最终预测的置信度:

其中 X 表示观测输入,Z 是通过使用 vPGM 的贝叶斯推断提示查询 LLM 来采样的。在实践中,P(Z | X) 和 P(Y | Z) 都在单个提示中模拟(详见附录中的示例)。因此,期望后验概率可以通过对 LLM 在这些推断步骤中生成的 P(Y | Z) 的数值取平均来近似。

贝叶斯增强的 vPGM:BayesVPGM

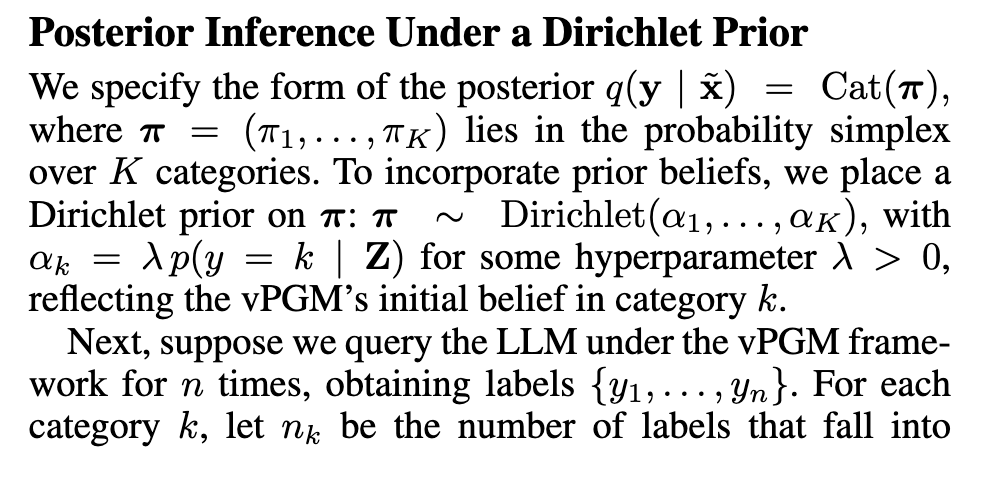

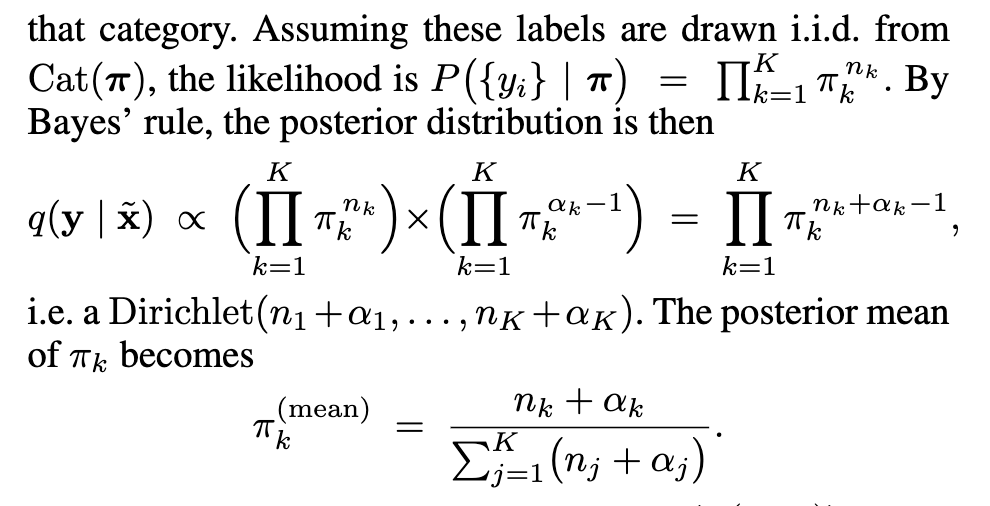

当在 vPGM 框架下反复查询大语言模型(LLM)时,我们会获得多个响应样本,即类别预测及其数值概率。一个自然的问题是:如何利用这些数据来更好地捕捉 LLM 预测中潜在的不确定性。为此,我们提出推断这样一个后验分布,记为 q(y | x̃),其中 x̃ 表示类别预测。

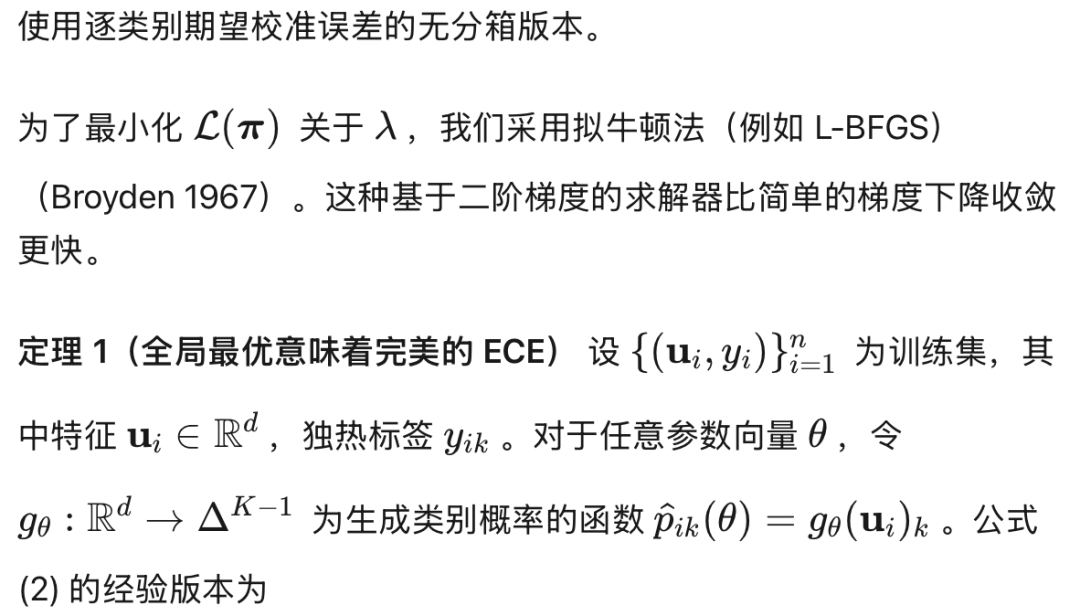

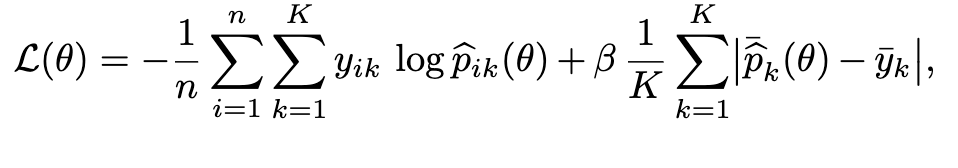

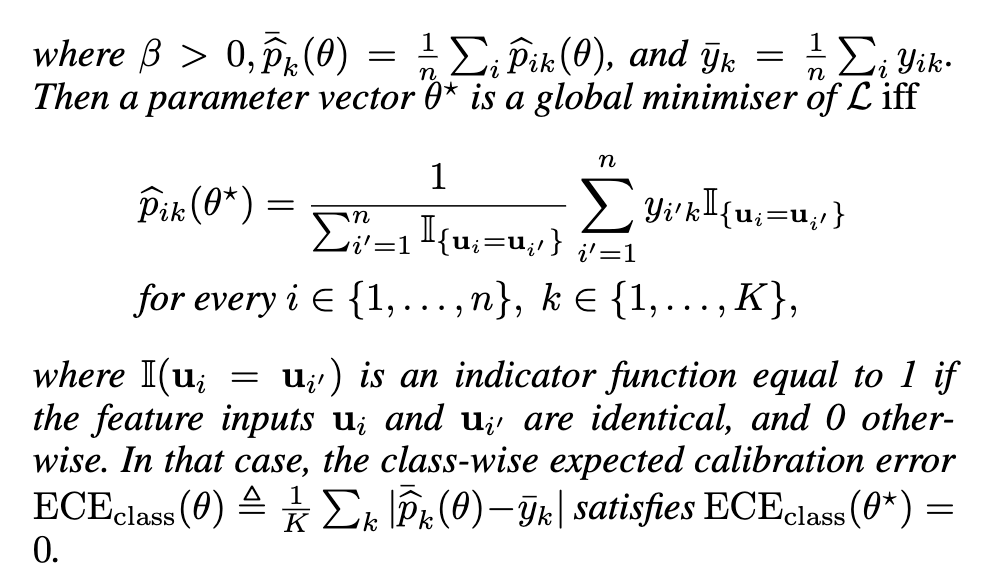

通过可微分校准损失优化 λ

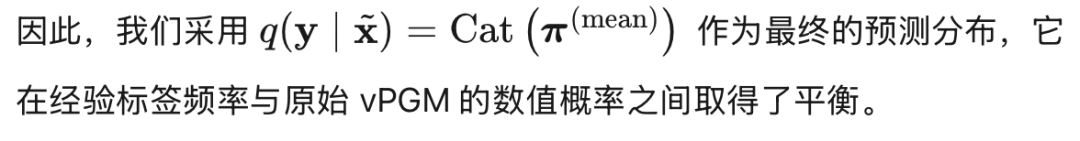

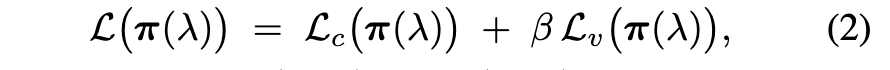

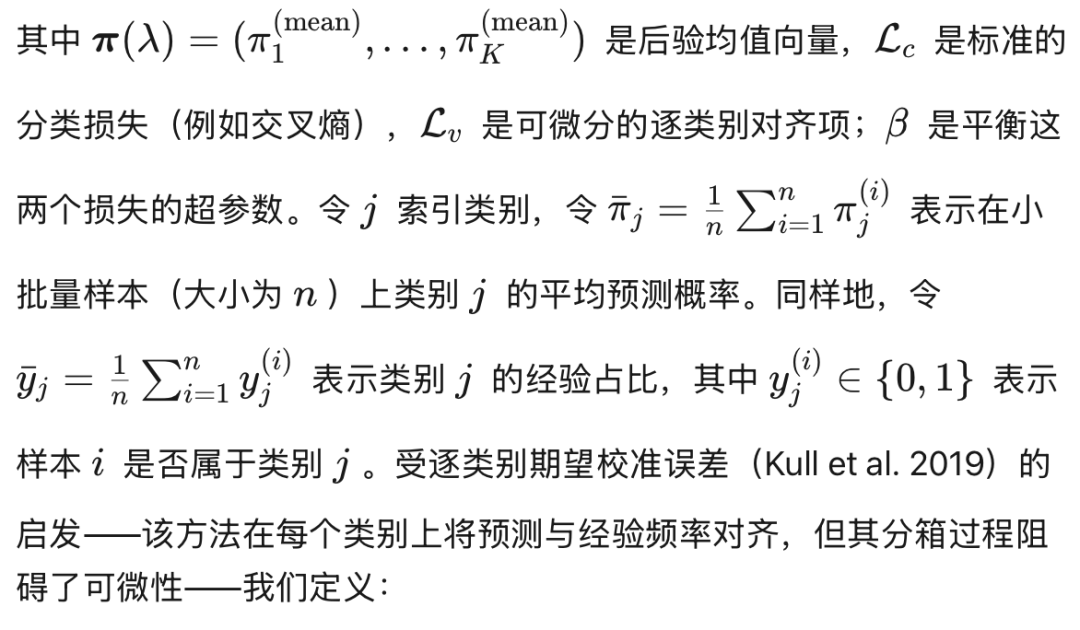

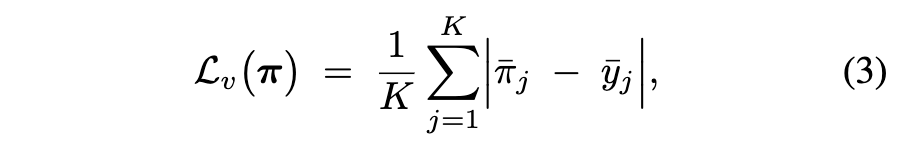

该后验分布的一个关键局限性在于它依赖于手动调优的 λ,该参数控制着 vPGM 的数值概率对最终结果的影响程度。为了实现这一过程的自动化并改善校准效果,我们引入了一种可微分的校准损失,通过基于梯度的优化来学习 λ。

具体而言,我们最小化以下关于 λ 的损失函数:

证明见附录。尽管损失函数公式 (2) 中的交叉熵项将预测拉向独热标签,而校准项强制执行逐类别平均对齐,但定理 1 表明这两个目标可以同时达到最小值。

实验

我们在三个智能体推理任务上评估了所提出的 vPGM 和 BayesVPGM 在建模不确定性方面的有效性。第一个是名为 ScienceQA(Lu et al. 2022)的封闭式任务,第二个是名为 ChatCoach(Huang et al. 2024)的开放式任务,这两个任务都需要结合来自多个来源的未公开信息进行推理。然后,我们引入了一个源自 A-OKVQA(Schwenk et al. 2022)的负对照实验,以研究潜在变量是否可以通过检测错误信息存在时的不匹配来增强置信度校准。详细的实验配置见附录。

科学问答

由(Lu et al. 2022)提出的科学问答(ScienceQA)基准是一个全面的多模态问答基准,涵盖物理学、数学、生物学和人文学科等多种科学学科。它包含 4,241 个问答对,涵盖各种主题和背景。该任务需要整合来自多个来源或 LLM 智能体(例如必应搜索结果、图像描述)的信息,这一过程可能引入错误并增加推理的复杂性。鉴于这些挑战,ScienceQA 成为评估 vPGM 识别潜在结构和模型不确定性效果的理想测试平台。更详细的实验设置见附录。

基线方法 我们将 vPGM/BayesVPGM 与以下基线方法进行比较:

- 思维链(Chain-of-Thought) 这是一种非工具增强的 LLM:配备言语化置信度估计的思维链(CoT)提示(Wei et al. 2022),通过提示其为所选答案提供数值置信度来实现。

- Chameleon 这是一种基于工具增强 LLM 的方法:Chameleon(Lu et al. 2023),我们为其配备了言语化置信度估计。

- Chameleon+ 它通过结合言语化置信度估计和自洽性测量(Wang et al. 2022a)的最先进不确定性量化框架扩展了 Chameleon,如(Xiong et al. 2023)所推荐的。

评估指标 根据(Naeini, Cooper, and Hauskrecht 2015; Guo et al. 2017; Xiong et al. 2023)中先前的置信度校准评估设置,我们采用期望校准误差(ECE)来评估模型置信度,以数值概率预测的形式表示。ECE 量化了预测概率与每个置信度水平(分箱)上观测准确率之间的差异。在整个实验中,我们将置信度分箱数固定为 10,各分箱的置信度贡献均匀分布。此外,我们通过测量准确率(Acc.)来评估给定方法正确解决问题的能力。

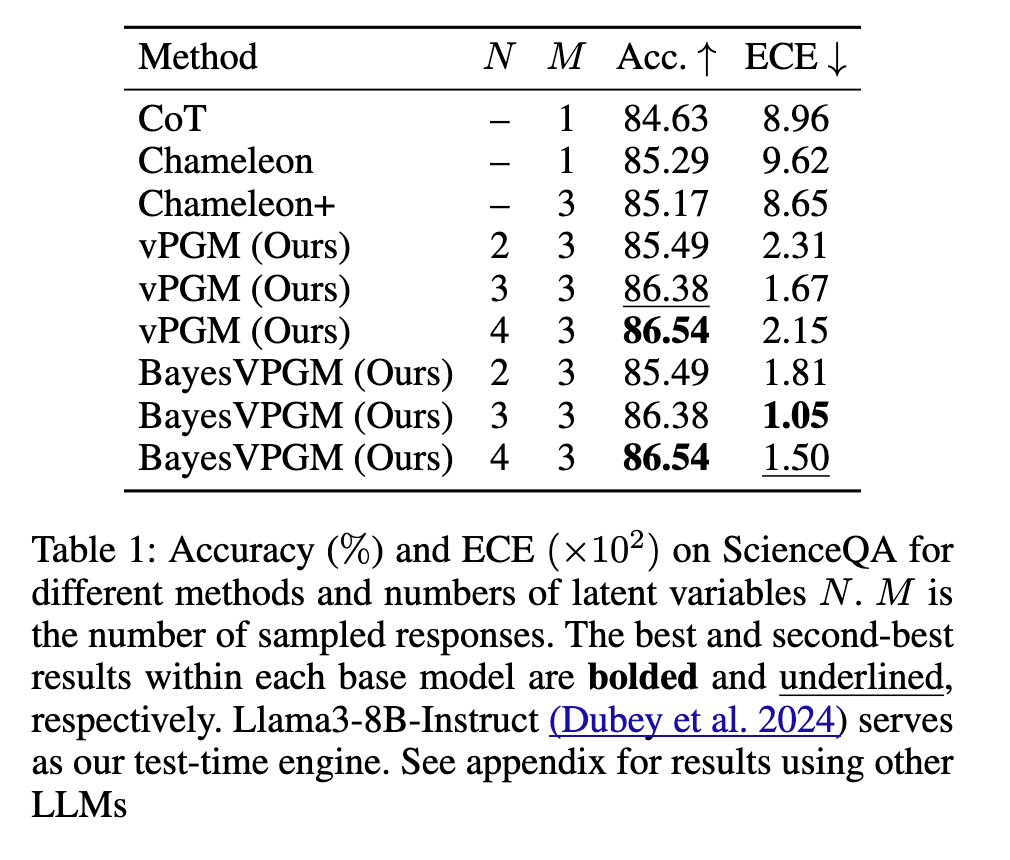

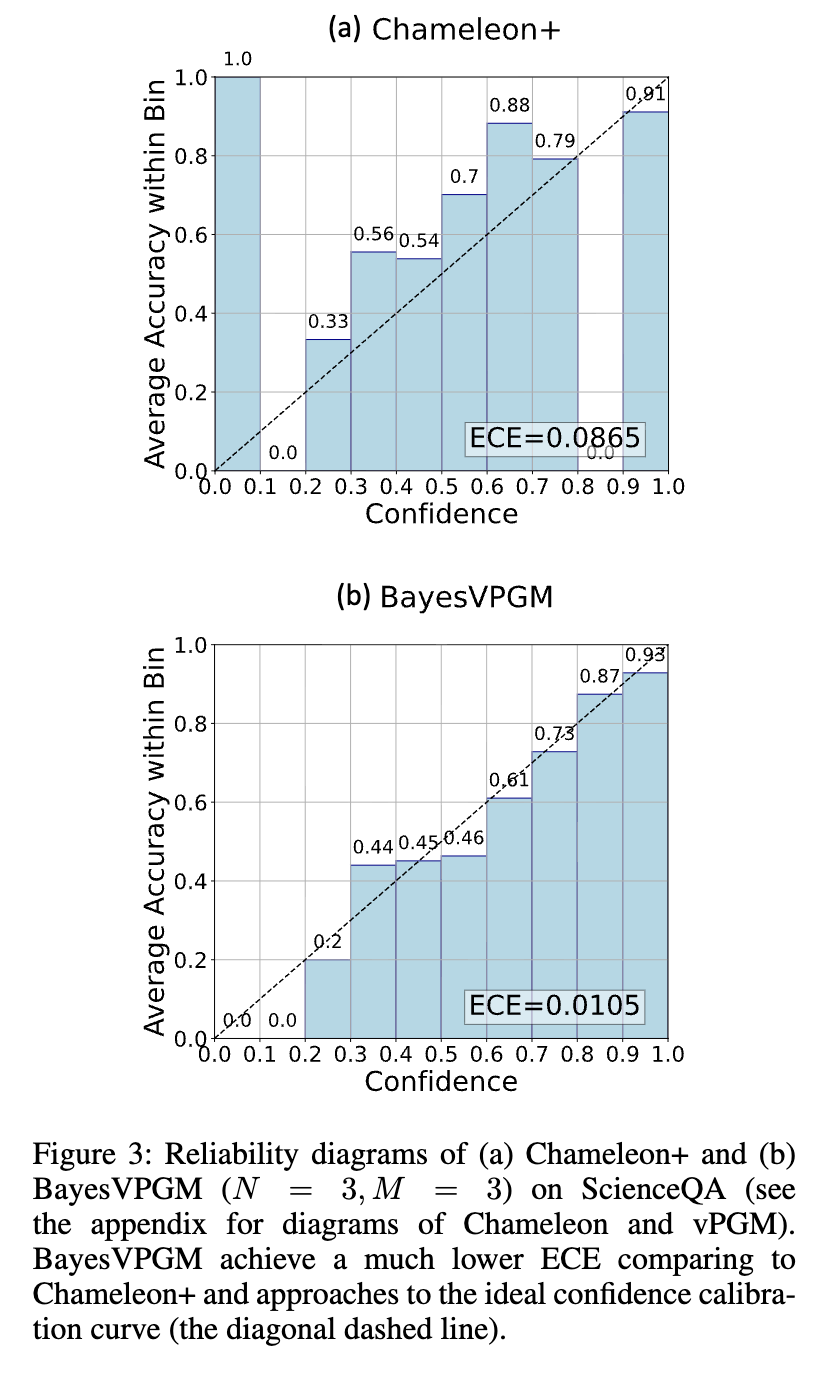

结果 表 1 详细列出了不同方法在 ScienceQA 数据集上的性能。结果显示,Chameleon 的 ECE(×10²)最高(最差),为 9.62,表明即使在借助外部工具的情况下,处理复杂推理任务时仍存在严重的过度自信问题。相比之下,我们的 vPGM 在准确率和 ECE 方面均优于这些方法,这得益于其捕捉其他基线方法所忽略的潜在结构信息的卓越能力。图 3 展示了 vPGM 和 BayesVPGM 的可靠性图,显示其在所有分箱上与理想校准曲线几乎完美对齐,突出了其在置信度校准方面的精确性(消融结果和词元级计算成本见附录)。

推断潜在变量的定性研究 图 1 展示了 BayesVPGM 推理能力的案例研究,以定性评估模型利用潜在结构信息改进置信度估计的能力。在此,vPGM 利用其潜在变量来批判性评估检索信息的相关性。例如,当面对来自必应搜索等外部工具的不相关数据或图像描述器提供的不准确描述时,基线方法 Chameleon 错误地对其预测保持高置信度。相比之下,BayesVPGM 会仔细调整其置信度,在缺少关键上下文知识或知识不正确时分配较低的概率,这一过程通过潜在变量

的推断尤为有效。这些观察结果突显了推断潜在结构对于提高组合推理系统可靠性的重要性。

交际医疗指导

医疗指导基准 ChatCoach 由(Huang et al. 2024)提出,建立了一个复杂的多智能体对话场景,涉及医生、患者和医疗教练,跨越 3,500 轮对话。医疗教练的任务是检测医生使用的医学术语中的不准确之处(检测任务)并提出适当的修正建议(修正任务)。这些任务需要整合外部医学知识,这本质上会给回复生成带来不确定性。选择该基准是为了测试 vPGM 在复杂开放式推理任务上的泛化能力。BayesVPGM 未在此设置中应用,因为该模型假设输出为类别分布。实验和实现的更多细节见附录。

基线方法 为进行比较分析,我们将 vPGM 与以下方法进行基准对比:

- 普通指令提示(Vanilla Instruction Prompting):该方法使用直接指令提示 LLM 生成对话。

- 零样本思维链(Zero-shot Chain of Thought, CoT)(Kojima et al. 2022):一种简单的 CoT 方法,提示 LLM 依次阐述推理链。

- 普通思维链(Vanilla CoT)(Wei et al. 2022):该方法在基础 CoT 之上,为 LLM 提供一组包含详细推理步骤的示例。

- 广义思维链(Generalized CoT, GCoT)(Huang et al. 2024):CoT 的高级版本,旨在有效改进结构化反馈的生成和外部知识的整合。它代表了 ChatCoach 基准中的最先进方法。

评估指标 我们遵循(Huang et al. 2024),采用传统的自动评估指标 BLEU-2、ROUGE-L 和 BERTScore。BLEU-2 用于测量二元语法重叠的精确度,提供生成文本相对于参考答案词汇准确性的洞察。ROUGE-L 用于评估句子级相似性,关注最长公共子序列以评估结构连贯性和顺序 n 元语法的一致性。此外,BERTScore 应用于语义相似性评估,利用 BERT 嵌入在更深层次的语义上比较生成输出和参考文本。如(Huang et al. 2024)所指定,我们使用 GPT-4 从教练智能体的反馈中提取医学术语错误和相应的修正。然后基于这些提取的元素与人类标注进行比较计算自动指标。

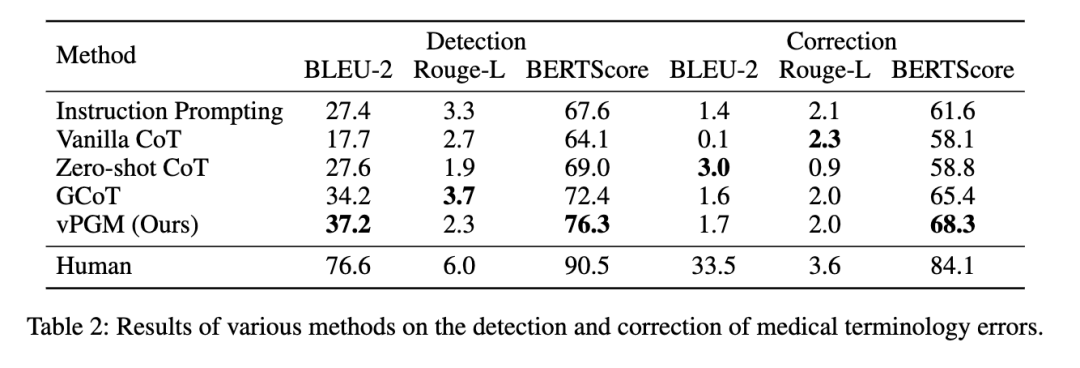

结果 我们在表 2 中展示了各种方法的性能。所有指标上机器生成输出与人类基准之间的显著差异突显了交际医疗指导中固有的挑战。在医学术语错误检测方面,vPGM 以优异的 BLEU-2(37.2)和 BERTScore(76.3)领先,突显其在识别不准确之处方面的熟练程度。在修正任务中,虽然 vPGM 取得了突出的 BERTScore 68.3,超越所有基线,但其在 BLEU-2 和 ROUGE-L 上得分较低。这种变化归因于医生输入中的歧义性,这可能产生多个有效回复,影响依赖精确匹配的指标。

A-OKVQA 负对照:研究错误信息下的潜在变量

数据模拟 A-OKVQA(Schwenk et al. 2022)是一个视觉问答数据集,挑战模型对场景进行常识推理,这通常超出了简单知识库查询的范围。关键的是,它为每个问题提供了真实图像描述和推理依据。我们利用这些标注来构建一个负对照实验:A-OKVQA-clean(603 个数据点)保留正确的图像描述和推理依据(接近单跳推理),而 A-OKVQA-noisy(603 个数据点)随机打乱推理依据,从而引入错误信息并强制进行多跳一致性检查。在此实验中,我们采用具有 2 个潜在变量的 vPGM(推理提示和示例查询见附录)。数据配置的更多细节见附录。

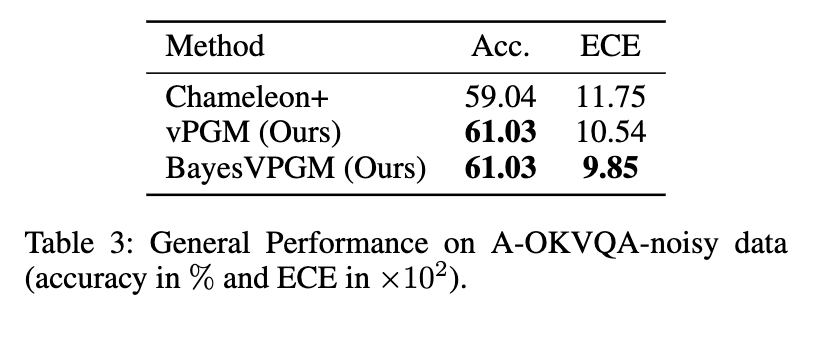

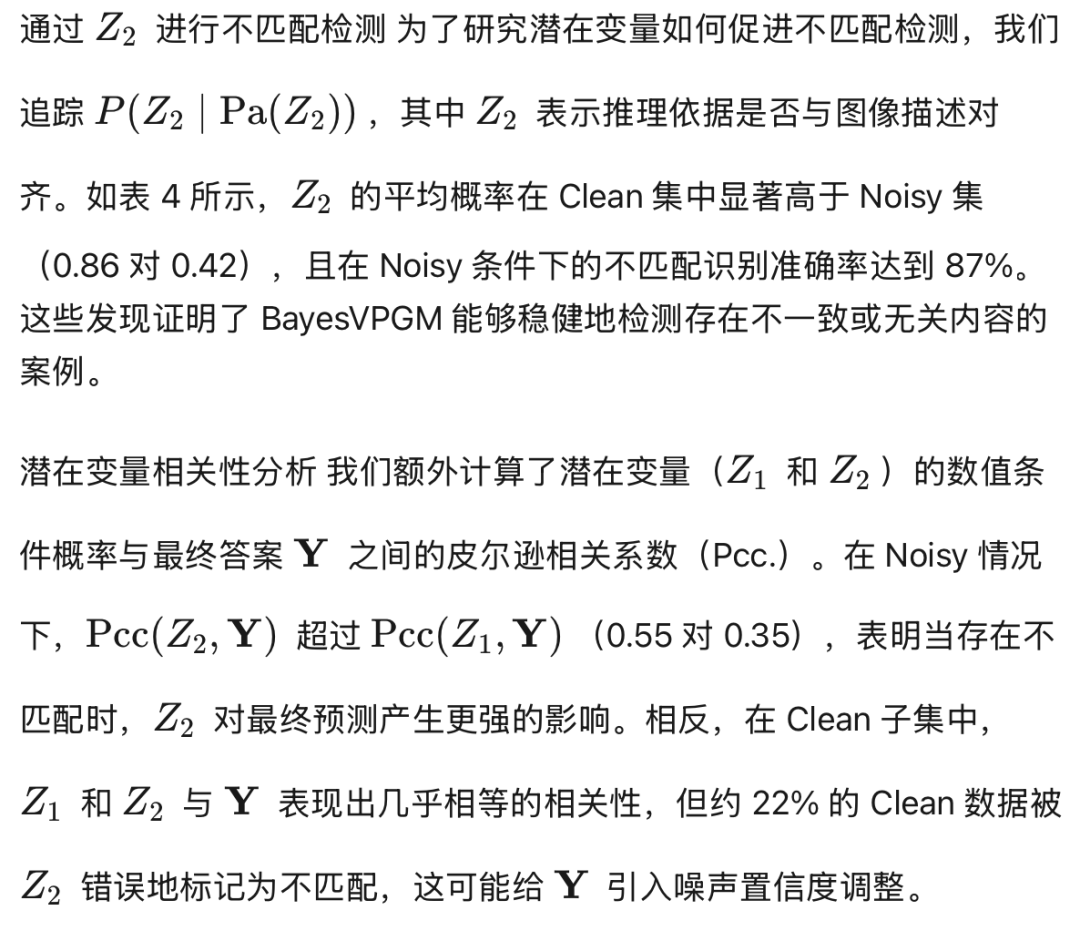

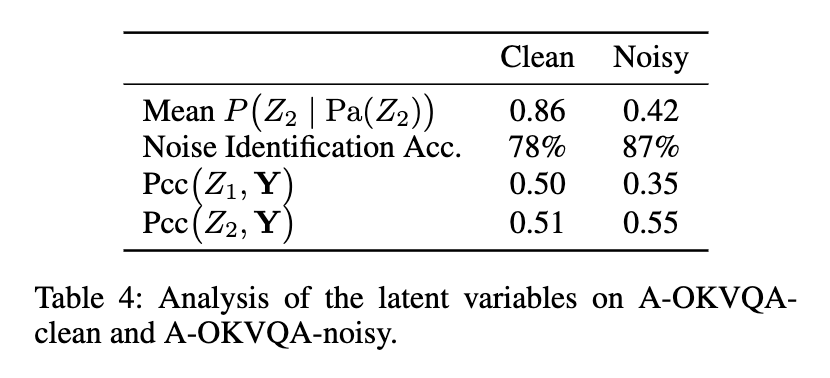

噪声条件下的整体性能 表 3 显示了 A-OKVQA-noisy 数据集上的整体准确率(Acc.)和期望校准误差(ECE)。vPGM 和 BayesVPGM 在准确率上均优于 Chameleon+(61.03% 对 59.04%),并产生更低的 ECE,表明潜在变量能够检测不匹配并改进置信度校准。

这表明了一种权衡:虽然潜在变量在检测错误信息和改进 Noisy 设置中的校准方面表现出色,但在实际不存在不匹配时,它们可能会轻微降低校准效果。

结论

我们提出了言语化概率图模型(vPGM),一种贝叶斯智能体框架,该框架(1)指导 LLM 智能体通过自然语言模拟概率图模型(PGM)的核心原理,以及(2)通过数值贝叶斯推断细化所得的后验分布。应用于智能体工作流中,vPGM 使 LLM 智能体能够执行具有校准不确定性的概率潜在变量推理。该方法无需大量领域专业知识即可发现潜在变量和依赖关系,使其非常适用于假设有限的场景。我们在智能体推理任务上的实证结果显示,在置信度校准和文本生成质量方面均有显著提升。这些结果突显了将贝叶斯原理与 LLM 智能体相结合以增强 AI 系统建模不确定性和不确定性下推理能力的潜力。

原文链接:https://arxiv.org/pdf/2406.05516

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录