大模型边际效应下降,小模型正在悄悄逆袭

大家好,我是刘聪NLP。

前两天刷到一个信息,就是清华和面壁的Densing Law文章,登上Nature子刊的封面,

Densing Law就是大模型的能力密度法则,这个概念并不陌生,其实2024年就挂在了arxiv上了,也听刘知远老师在各大论坛上讲过,

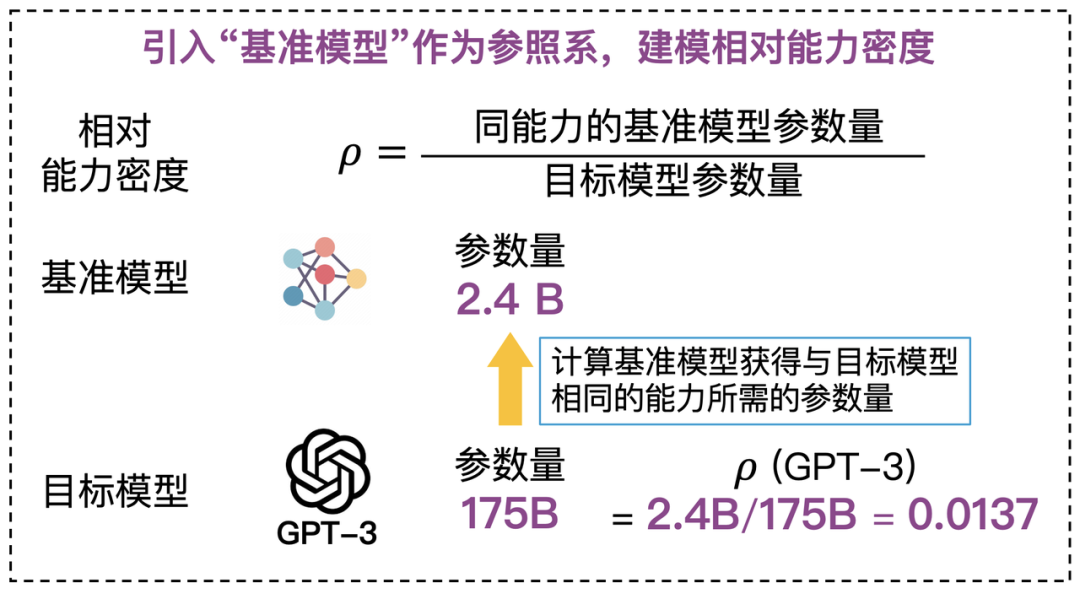

能力密度就是大模型的有效参数大小与实际参数大小的比率,一个0.6B的模型能达到3B参考模型的性能,那么这个0.6B模型的能力密度就是5。

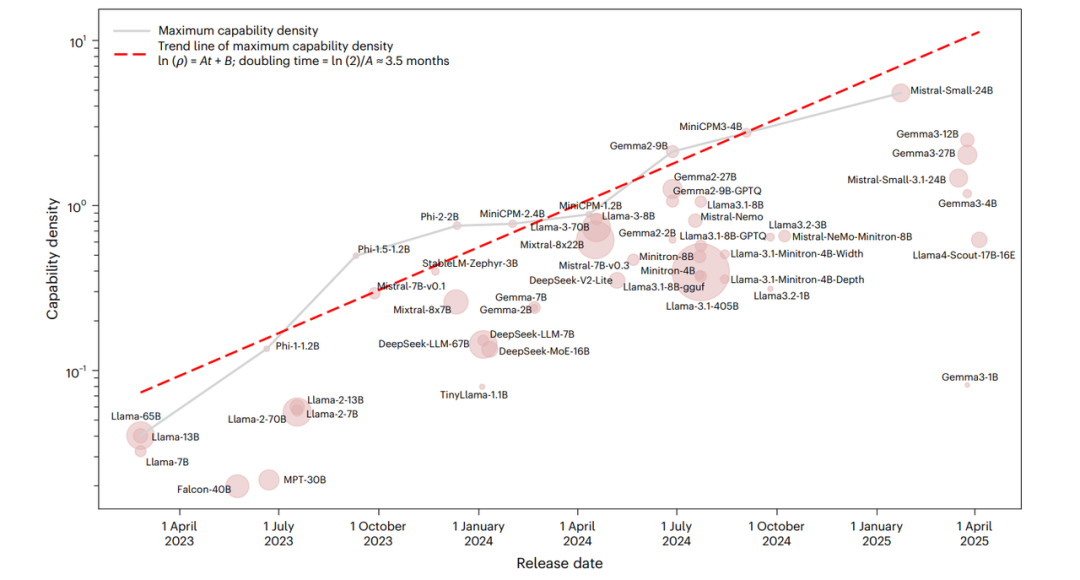

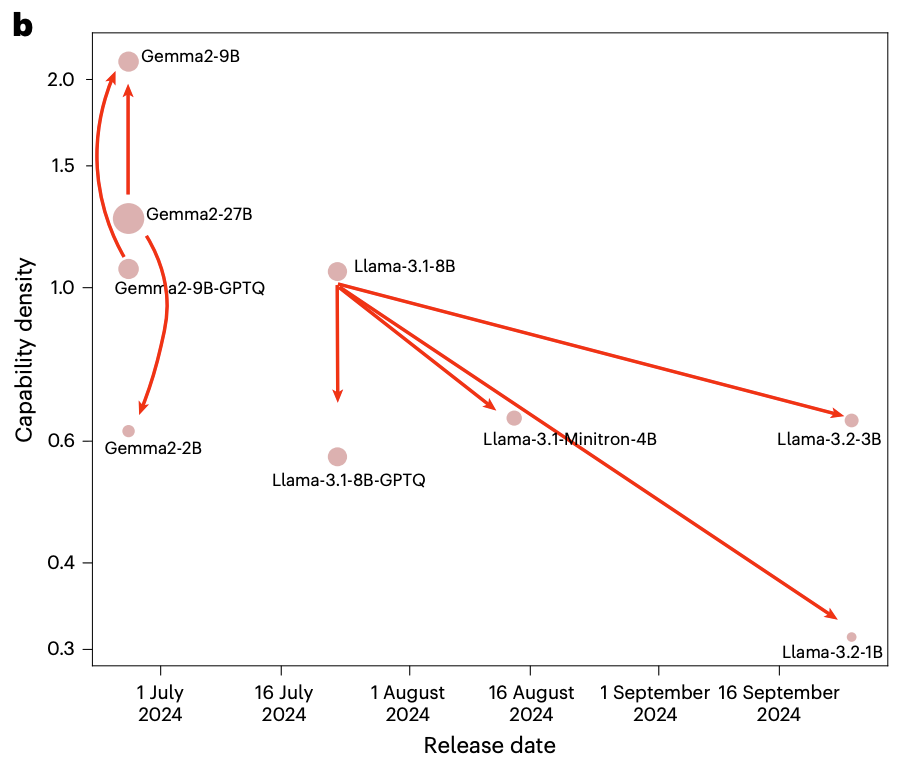

Densing Law发现现在大模型能力密度大概每3.5个月(约100天)就翻一倍,也就是说随着不断地发展,小模型可以干更多的事情。

引用大聪明老师的一句话,就是马上有一天,你可以在小天才手表上,跑 Nano Banana,哈哈哈。

所以今天,借着重读这篇文章,聊一聊端侧模型/小模型的一些想法。

我前面分享过0.6B 这种小模型能干啥?,主要表达了其实现在在很多场景中,小模型还是很有用的。

有些人可能对端侧模型很模糊,其实我也很模糊,因为你会发现,有的0.几B的说自己的端侧模型,7B、8B甚至14B的也说自己的端侧模型。

就像,之前讨论过,多大模型算大模型一样,是LLM、还是SLM,本身就没有明确的定义。

我就以我的想法来定义一波,我觉得分两种端侧,

狭义的端侧,在手机(主要)、眼镜、手表、音箱、甚至汽车座舱上的模型,因为手机内存通常8-16G,留给模型4-6G使用,那么模型规模可以在0.5B-3B之间,或者经过极致量化的7B模型。

广义的端侧,在笔记本电脑、台式机,可以轻松运行7B到14B的模型,所以只要是不上传云端,完全在你的电脑显卡/CPU上跑完推理,都可以算端侧。

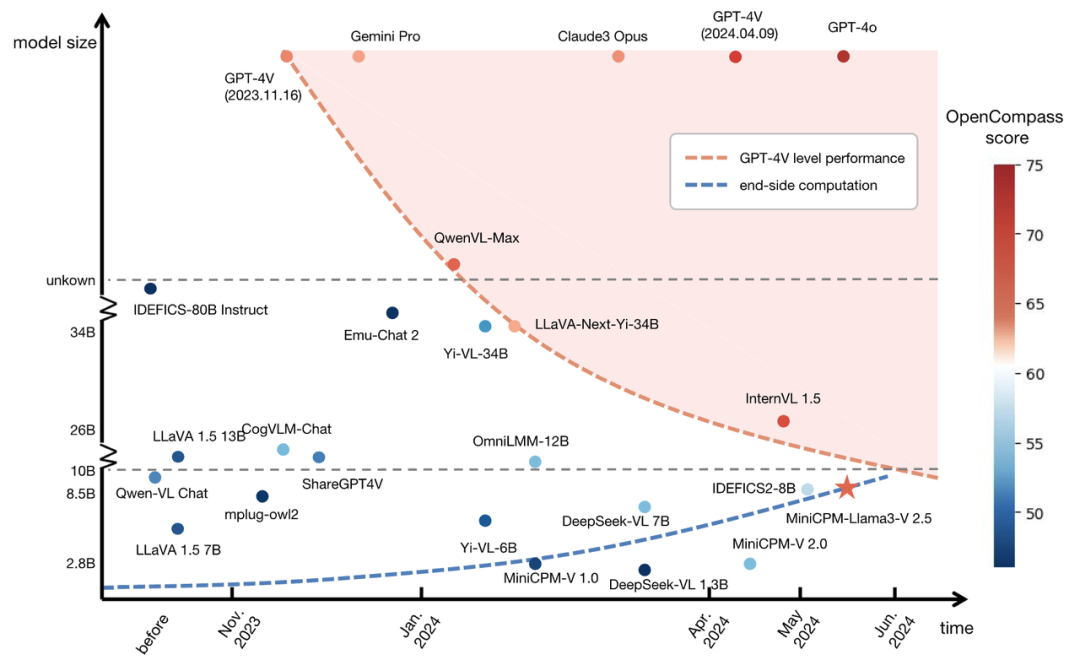

说一个爆论,相较于更大参数的模型,小模型或者端侧模型,在未来两年发展的趋势会更猛,

Scaling Law告诉我们大力出奇迹,堆参数、堆训练数据,模型就会很强,但预训练数据基本上已经用的差不多了,模型一味变大的边际效应明显在变弱。

近期 Ilya 的采访估计大家都看了,Ilya表示2012-2020年是研究时代,2020-2025 年是扩展时代,2025年之后会重回研究时代。

那么,我觉得让小模型拥有大智慧,是一个会大家进行更多研究的方向。

一方面是,LLM落地会考虑成本,使用越小的模型,成本会越低;另一方面,更大模型无法取得很大突破时,以小博大是很多人直观的想法。

英伟达不就发了《Small Language Models are the Future of Agentic AI》了吗?

而且在这两年,小模型的发展其实已经很快了,之前GPT3.5的效果,应该随随便便的7B模型就能达到,甚至还会更好。

然后就是我再思考一个问题,

小参数模型,学习更多的数据,真的能记住吗?

从数据层面上来看,数据的知识密度可能更重要。数据过多可能导致模型出现遗忘,直观层面,就是脑容量的问题。

但我并没有理论依旧,我知道知识密度对模型有作用,但我想说的是,也许小模型对知识密度的要求对大模型更高。(欢迎评论区讨论,我也是瞎想)

所以数据是我觉得是未来持续要卷的方向。

还有就是,模型量化,Densing Law发现模型压缩算法并不总能增强模型能力密度,说白了,就是量化之后,模型本身能力下降了,把这个比率拉的更高,模型能力密度才能更高。

比如现在有很多原生INT4、MXFP4、NVFP4训练,这些主要解决超大模型训练的问题,在小模型上应该也是奏效的,只不过,现在训练资源充足,小模型没必要这么去搞。

长文本在端侧,这其实是个悖论。

好不容易把模型参数压到了极致,塞进手机那可怜的4G/6G内存里。结果一开长文本,KV Cache直接拉满。

但在未来,端侧的长文本也是必须的,端侧需要读取用户大量的私密信息,如聊天记录等等等,才能更了解用户,必会有用户的需求是需要长上下文的。

所以我觉得,端侧长文本,应该是架构层面的创新。

现在模型结构上,大家都在改,Qwen3-Next的SWA+Mamba2,还有现在MoE是标配了, 但目前小模型结构改变,貌似只有面壁的InfLLMv2稀疏注意力架构了,感兴趣的可以去看原文,反正就是快。

Infra还用聊吗?推理框架就是隐形的战场,

llama.cpp、MLC LLM、Qualcomm QNN、SNPE、Apple CoreML、MLX-LLM

哪个更好,适配问题,都值得思考?

这块我也是真不擅长,哈哈哈哈哈

最后想说,

端侧芯片的承载能力越来越强,

端侧模型的知识密度越来越高,

此前只能在云上部署的大模型,最终一定可以用终端芯片就装得下、跑得动,

端侧智能有着巨大潜力。

PS:都看到这里,来个点赞、在看、关注吧。 您的支持是我坚持的最大动力!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-11-29,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读