终身生成建模 Lifelong Generative Modeling

终身生成建模 Lifelong Generative Modeling

CreateAMind

发布于 2026-03-11 17:06:19

发布于 2026-03-11 17:06:19

Lifelong Generative Modeling

终身生成建模

https://arxiv.org/pdf/1705.09847

摘要

终身学习(Lifelong learning)是指按顺序连续学习多个任务的问题,在此过程中,从先前任务中获得的知识会被保留并用于辅助未来的学习。这是构建能够适应其周围环境的智能机器的关键方向之一。在这项工作中,我们专注于无监督生成建模的终身学习方法,其中我们持续将新观察到的数据分布整合进一个已学习的模型中。我们通过一种“学生-教师”变分自编码器(Variational Autoencoder, VAE)架构来实现这一点,这种架构使我们能够在不保留过去数据或旧模型的前提下,学习并保留迄今为止所见过的所有分布。通过引入一种受贝叶斯更新规则启发的新型跨模型正则化器(cross-model regularizer),学生模型可以利用教师模型所学到的信息,而教师模型充当了一个概率知识库。该正则化器减少了在学习一系列分布时出现的灾难性干扰(catastrophic interference)。我们在MNIST、FashionMNIST、PermutedMNIST、SVHN和Celeb-A的序列版本上验证了模型的性能,并展示了我们的模型有效缓解了神经网络在序列学习场景中面临的灾难性遗忘问题。我们的代码可在以下链接获取:https://github.com/jramapuram/LifelongVAE_pytorch 。

1 引言

机器学习的过程是通过对通常带有噪声的数据样本进行观测来逼近未知函数。监督学习通过学习从输入到一组预定义输出(如分类中的类别标签或回归中的连续目标)的映射来逼近这些函数。无监督学习则试图在没有监督信号的情况下从输入数据中发现结构和模式。这类学习范式的例子包括密度估计和聚类方法。

这两种学习范式都做出了一些限制可行解集合的假设。这些假设被称为假设空间、偏置或先验知识,它们帮助模型在多个可能的解之间做出偏好选择 [82, 128]。例如,使用卷积(convolutions)处理图像有利于捕捉局部结构;循环模型(recurrent models)利用序列依赖关系;图神经网络(graph neural networks)假设底层数据可以被准确地建模为图结构。

当前最先进的机器学习模型通常专注于为单一任务训练单一模型,比如图像分类 [72, 121, 43, 118, 66]、图像生成 [100, 13, 63, 39]、自然语言问答 [25, 96] 或单个游戏的玩 [129, 113]。相比之下,人类在其一生中经历一系列学习任务,并能利用以往的学习经验快速掌握新任务。例如,在学会骑自行车之后再学骑摩托车:这一任务由于已有经验的存在而大大简化。心理学研究 [2, 3, 67] 表明,人类可以在仅提供少量样本的情况下迅速泛化到新概念。[67] 展示了人类在只看到一个相关样本的情况下,就能对两轮交通工具的新概念进行分类和生成。这与上述使用数十万个样本但仍无法泛化到原任务微小变化的机器学习模型形成了鲜明对比 [22]。

终身学习 [126, 125] 强调了在任务序列上进行学习的必要性,其中学习到的任务表示和模型会在学习者的整个生命周期中被保存下来,并可用于辅助当前和未来的进一步学习。这种学习形式允许先前学到的模型和表示被迁移使用,从而降低当前学习问题的样本复杂度 [126]。在本工作中,我们将研究范围限定在广泛终身学习范式的一个子集;与大多数最先进的方法专注于监督式的终身学习场景不同,我们的工作是最早尝试解决更具挑战性的深度终身无监督学习问题的研究之一。此外,我们识别并放宽了以往终身学习方法中一些关键的限制条件,这些限制通常要求存储先前的模型和训练数据,而我们的方法使得我们能够在更加现实的学习场景下运行。

2 相关工作

以持续方式进行学习的思想在机器学习领域已经被广泛探索,其起源可以追溯到终身学习(lifelong learning)[126, 125, 117]、在线学习(online learning)[32, 9, 11, 12]以及顺序线性高斯模型(sequential linear Gaussian models)[105, 36](如卡尔曼滤波器 [Kalman Filter] [56] 及其非线性版本粒子滤波器 [Particle Filter] [24])。终身学习与在线学习有一定的相似之处,因为这两种学习范式都是按顺序接收数据。但它们之间也存在差异:典型的在线学习者 [11, 12] 的主要目标是尽可能好地解决当前的学习问题,而不会保留过去学到的知识。相比之下,终身学习的目标是保留和重用以往任务中所学到的行为,并力求在所有任务上实现整体性能的最大化。

举个例子,考虑点击率预测(click through rate forecasting)任务:在线学习者的目标是随着时间演化,使其最好地反映当前用户的偏好;而终身学习者则会在不同任务之间施加一种约束,以确保之前学到的内容不会被遗忘。

终身学习 (Lifelong Learning)[126] 最初是在监督学习框架下提出的,用于概念学习(concept learning),其中每个任务的目标是使用二分类方法来学习特定的概念或类别。原始框架使用了一个针对任务的模型,例如K近邻算法(K Nearest Neighbors, KNN),并结合一个表示学习网络,该网络利用了来自所有过往任务的训练数据(称为支持集 support sets),以学习一个通用的全局表示。这一监督方法后来通过动态学习率 [115]、核心集(core-sets)[114] 和多头分类器(multi-head classifiers)[31] 得到了改进。

与此同时,终身学习也被扩展到独立的多任务学习 [107, 31]、强化学习 [125, 122, 102]、主题建模(topic modeling)[19, 130] 以及半监督语言学习 [83, 81] 等领域。更详细的综述可参见 [20]。

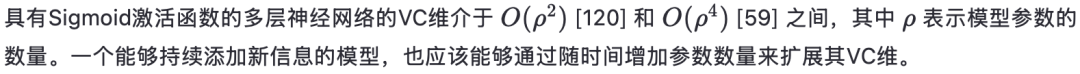

近年来,随着深度学习的发展,终身学习重新受到关注。如前所述,终身学习的核心原则之一是:学习者应在所有观察到的任务上都表现良好。然而,神经网络,更广义地说,使用随机梯度下降(stochastic gradient descent)进行学习的模型 [103],通常无法在不直接保留旧模型或旧数据的情况下保持对先前任务的学习效果。这种被称为“灾难性遗忘”(catastrophic forgetting)[78] 的现象在神经网络研究界广为人知,也是构建有效的神经终身学习系统需要解决的核心障碍。

灾难性遗忘是指神经网络在顺序训练过程中,其参数逐渐偏向最新观测数据的分布,从而遗忘了不再可用的数据上已学到的表示。为了缓解灾难性遗忘问题,当前的终身学习研究主要采用以下四种策略:迁移学习(transfer learning)、回放机制(replay mechanisms)、参数正则化(parameter regularization)和分布正则化(distribution regularization)。

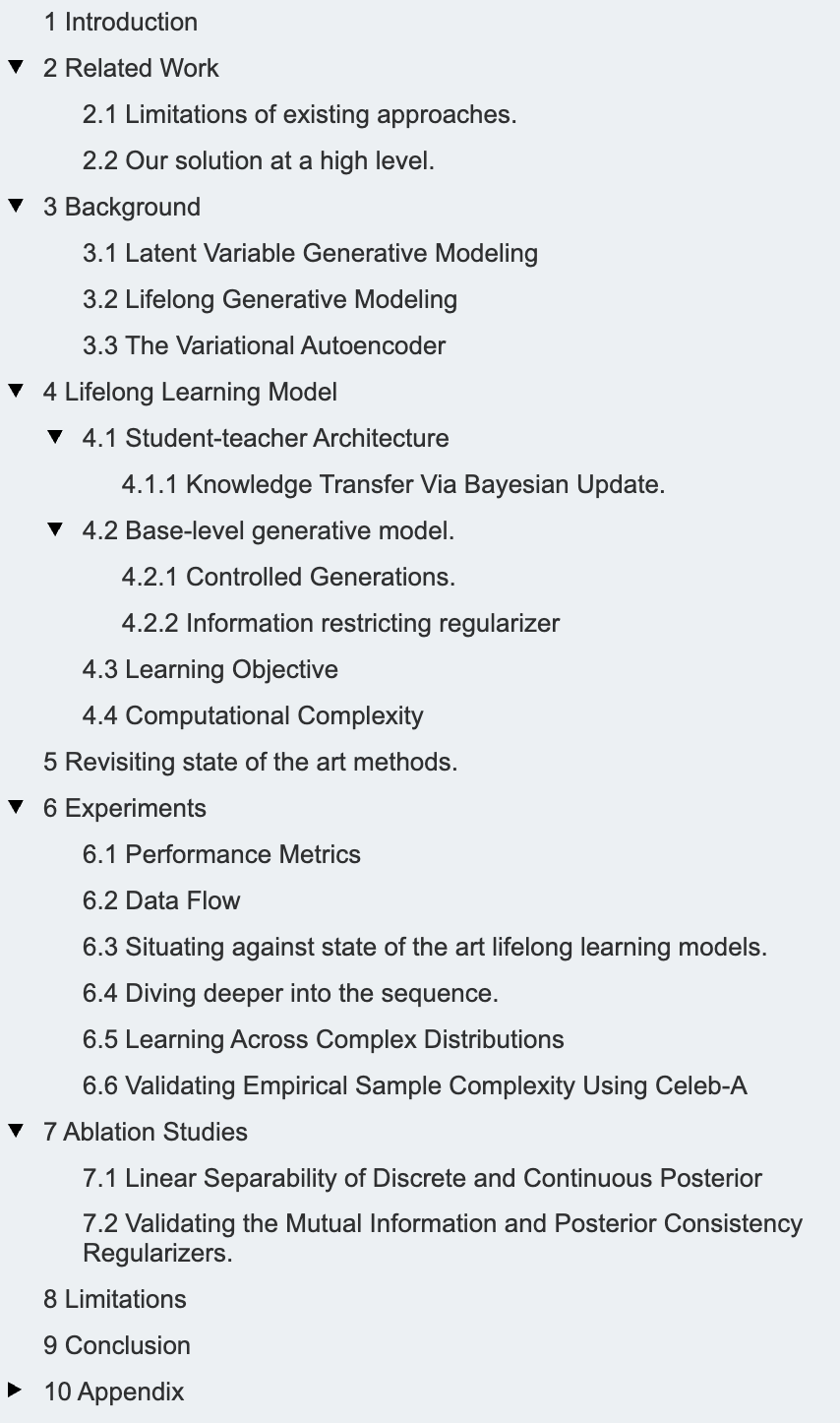

在表1中,我们将接下来段落中将讨论的各种终身学习方法按照这四种策略进行分类。

迁移学习(Transfer learning) :这些方法通过冻结先前任务的模型,并将前一任务的潜在表示传递给当前模型,来缓解灾难性遗忘。用于缓解灾难性遗忘的迁移学习研究包括渐进神经网络 (Progressive Neural Networks, PNN)[94] 和深度块模块化神经网络 (Deep Block-Modular Neural Networks, DBMNN)[123] 等。这些方法允许当前模型以高效的方式适应新的联合表示,并通过直接保留所有以前任务的模型来防止遗忘。

在终身学习设置中采用这种迁移学习机制需要为每个新任务训练一个新模型,这会显著增加终身学习者的内存占用。此外,由于迁移学习方法会冻结之前的模型,因此它否定了利用从新任务中获取的知识来改进之前任务性能的可能性。

回放机制(Replay mechanisms) :终身学习的原始表述 [126] 要求保留所有之前任务的数据。这一要求后来被“核心集”(core-sets)的形式所放宽 [116, 114, 91],核心集是输入数据的一个小加权子集,能够近似完整数据集。最近,在分类任务中出现了一些试图摆脱存储过去训练数据需求的方法,它们依赖于生成建模 [112, 57];我们将这类方法称为深度生成回放 (Deep Generative Replay, DGR)方法。

DGR 方法采用一种学生-教师网络架构,其中教师(生成)模型为学生(分类器)模型提供来自先前任务的合成样本。这些合成的任务样本与当前任务的真实样本一起使用,以学习涵盖所有任务的新联合模型。尽管这些生成回放策略受到生物记忆巩固过程的强烈启发 [119, 53, 58, 110],但它们未能有效利用先前的学习成果,只是从头开始重新学习每一个新的联合任务。

参数正则化(Parameter regularization) :大多数缓解灾难性遗忘的研究都属于参数正则化的范畴。该策略下有两种主要方法:

- 通过预定义度量约束新任务的参数接近旧任务的参数 ;

- 强制任务特定的参数稀疏性 。

这两种方法之间存在一定关联,因为任务特定的参数稀疏性可以看作是对参数约束方法的一种细化。参数约束方法通常共享相同的模型/参数,但鼓励新任务不要改变从前任务中学到的重要参数。而任务特定的参数稀疏性则放松了这一限制,通过注意力机制等方式,强制每个任务使用全局模型中的不同参数子集。

以下是一些属于参数约束策略的模型:

- Laplace Propagation [29]

- 弹性权重巩固 (Elastic Weight Consolidation, EWC)[65]

- 突触智能 (Synaptic Intelligence, SI)[136]

- 变分持续学习 (Variational Continual Learning, VCL)[91]

例如,EWC 使用Fisher信息矩阵 (FIM)来控制两个学习任务之间的模型参数变化。直观上,重要的参数不应被更改,而不重要的参数则保持无约束。在假设参数后验服从高斯分布的前提下,FIM 被用作二次参数差异正则化项的权重。然而,已有研究表明 [86, 10],对于神经网络学到的参数而言,这种高斯后验假设并不理想。

VCL 对 EWC 进行了改进,通过将 FIM 的局部假设推广为(变分)参数后验与先验之间的 KL 散度。这种推广基于这样一个事实:FIM 可以被视为后验与其自身随机变量微小扰动之间的 KL 散度 [51]。VCL 实际上涵盖了多种不同的缓解策略,因为它结合了参数正则化(如前所述)、迁移学习(它为每个任务保留单独的头部网络)以及回放机制(它为每个任务保留一个真实数据的核心集)。

以下是一些属于任务特定参数稀疏性策略的模型:

- 任务硬注意力机制 (Hard Attention to the Task, HAT)[111]

- 共享嵌入变分自编码器 (Variational Autoencoder with Shared Embeddings, VASE)[1]

该缓解策略强制不同任务使用单一模型的不同部分,通常是通过根据监督任务标签学习得到的注意力向量 [6] 来实现的。将注意力向量与模型输出相乘可以阻止梯度下降对模型参数不同子集进行更新,从而使这些参数可用于未来任务的学习。任务特定的参数稀疏性使模型能够在参数中保留一部分用于未来学习,在实践中通常表现良好 [111],其最大的缺点是对监督信息的依赖。

函数正则化(Functional regularization) :参数正则化方法试图通过控制模型参数在不同任务之间的变化来保留模型过去的行为。然而,模型参数只是模型实际行为的一种代理方式。具有非常不同参数的模型可能在输入-输出关系上表现出完全相同的行为(非唯一性 [131])。函数正则化关注的是真正需要保留的对象:输入与输出之间的关系。这种策略允许模型在任务之间灵活地调整其内部参数表示,同时仍然保留之前学到的知识。

诸如知识蒸馏 (distillation)[45]、ALTM [33] 和无遗忘学习 (Learning Without Forgetting, LwF)[71] 等方法,对在不同任务上学到的模型的分类输出施加相似性约束。这可以被理解为一种函数正则化,其通过将约束度量(或半度量)推广为输出条件分布上的散度来实现。与参数正则化不同,函数正则化不对参数后验分布的形式做任何假设。这使得模型可以根据需要灵活地调整其内部表示,从而使函数正则化成为一种理想的缓解策略。

当前函数正则化方法的一个缺陷是:它们需要保留所有先前的数据 。

2.1 现有方法的局限性

解决终身学习问题的一个简单方案是:存储所有数据 ,并在每次遇到新任务时重新学习一个新的联合多任务表示 [17]。或者,也可以选择保留所有之前的模型参数 ,并根据新测试任务数据的表现来选择最佳模型。

现有的大多数方法通常会在这两个要求之间做出权衡:

- [33, 71, 91] 放宽了对模型持久化的需要,但仍然需要保留所有训练数据 [33, 71],或保留一个不断增长的核心数据集(core-set)[116, 114, 91];

- 相反,[94, 123, 91, 136] 放宽了对数据存储的需求,但仍然保留所有以前的模型 [94, 123] 或部分模型参数 [91, 136]。

与这些方法不同的是,我们从人类如何随时间学习的过程中获得启发,去除了存储过去训练数据和模型的要求 。

以人类视觉系统为例,研究表明 [23, 7],人眼每帧图像可以捕捉高达576兆像素的内容。如果在传统计算机上以原始方式存储,这相当于每个样本约6.9千兆字节的信息。考虑到我们在一生中感知到的图像帧数以万亿计,以原始、未压缩的形式存储这些信息是不可行的。

神经科学研究也已证实 [132, 5],人类的大脑通过动态地压缩、融合和重构信息内容来进行关联式记忆处理。受此启发,我们认为一个终身学习者不应存储过去的训练数据或模型。相反,它应该保留一个适用于所有任务的潜在表示,并随着观察到更多任务而不断演化这一表示。

2.2 我们的解决方案概述

虽然目前大多数终身学习的研究集中在监督学习 领域 [94, 33, 71, 123, 136, 65],但我们关注更具挑战性的任务:深度无监督潜变量生成建模 。这类模型在聚类 [77, 52, 85] 和预训练 [68, 95] 等任务中有广泛应用。

我们提出的终身学习方法核心是一对生成模型,分别称为“教师”和“学生”。我们通过利用上述提到的回放机制 和函数正则化策略 来训练这对模型。

在第一个任务上训练完一个生成模型之后,我们将它作为下一个新初始化的学生模型的教师模型。学生模型接收当前任务的数据,以及来自教师模型的回放数据——后者充当了过去任务的概率知识库。为了保留之前的学习成果,我们使用了函数正则化方法,帮助保留过去任务中的输入-输出关系。

不同于 EWC 或 VCL 方法,我们不对参数后验分布的形式做任何假设,而是允许生成模型根据需要灵活使用现有参数,以最好地适应当前和过去的学习需求。

通过结合使用生成回放 和函数正则化 ,我们不再需要保留过去模型和数据。此外,这种方法还显著改善了未来任务学习的样本复杂度,这一点我们在实验中进行了实证验证。

最后值得一提的是,我们的方法也很容易扩展到监督学习场景,正如我们在 [69] 中所做的那样。

3 背景知识

在本节中,我们将介绍贯穿本工作的主要概念。我们首先在 3.1 节 描述基础层次的生成建模方法,接着在 3.2 节 说明其如何扩展到终身学习设置。最后,在 3.3 节 中,我们将描述我们用于构建终身生成模型的变分自编码器 (Variational Autoencoder, VAE)。

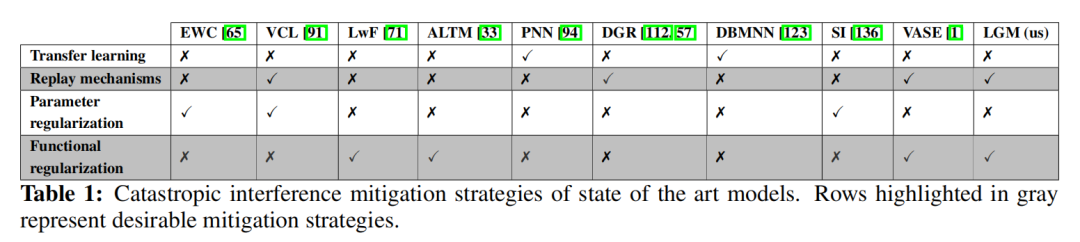

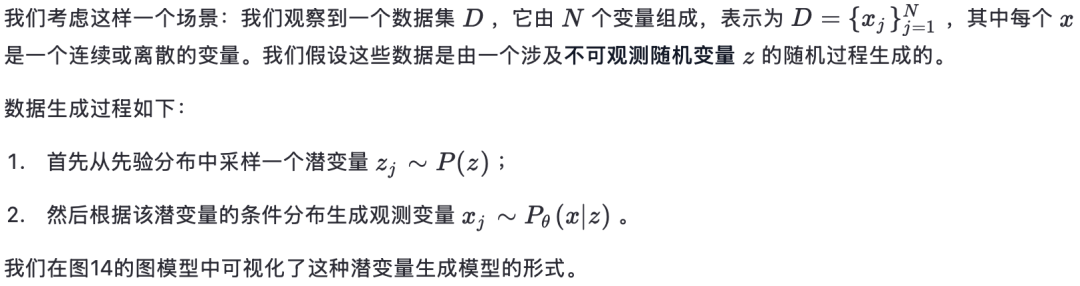

3.1 潜变量生成建模

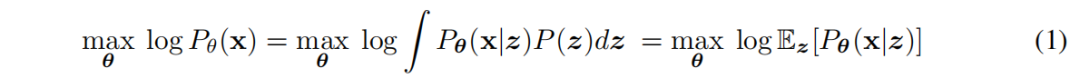

通常,潜变量模型通过最大似然估计 (Maximum Likelihood Estimation, MLE)进行求解,其形式可以表示为:

在许多情况下,公式(1)中的期望没有闭式解(例如:非共轭分布),并且由于空间维度较高(例如:图像),使用数值积分(如求积法)在计算上也难以处理 [63, 101]。为了解决这些难处理性问题,我们采用变分自编码器(Variational Autoencoder, VAE),我们将在第 3.3 节中对其进行简要总结。VAE 使我们能够推断潜变量,并联合估计模型的参数。

然而,在描述 VAE 之前,理解这种生成建模如何在终身学习场景下进行是非常重要的。

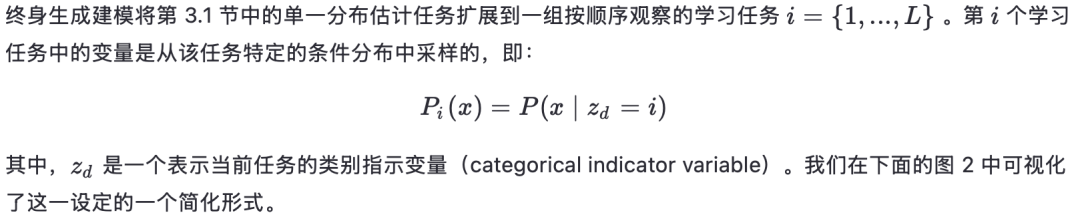

3.2 终身生成建模

3.3 变分自编码器(Variational Autoencoder)

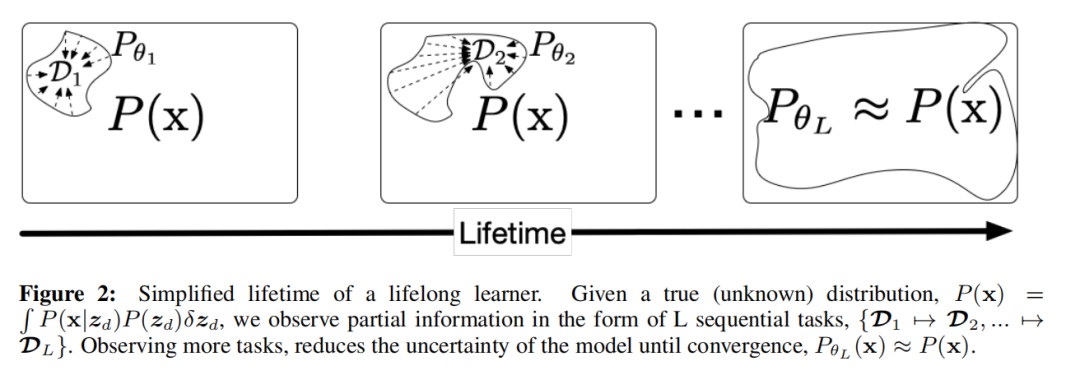

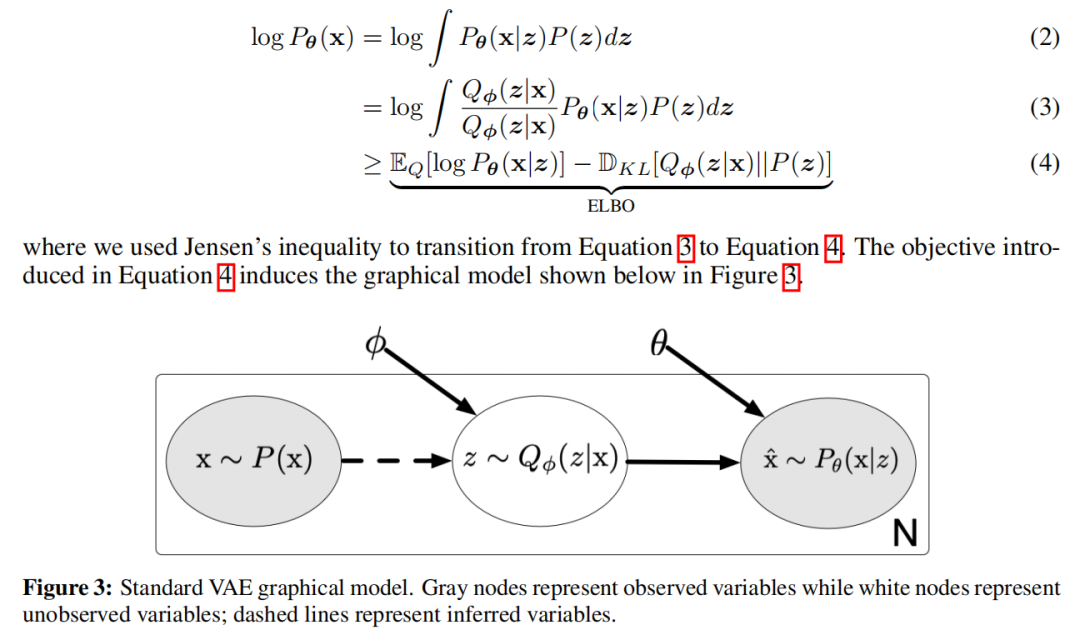

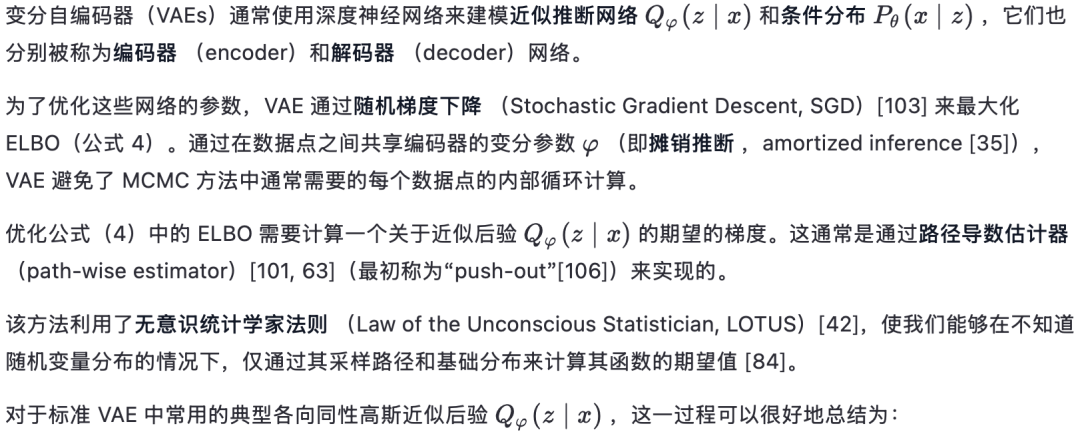

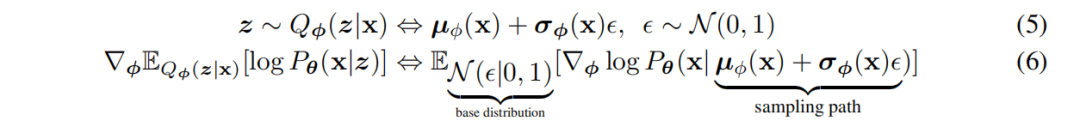

如第 3.1 节所述,我们希望从数据中推断潜变量 。这可以看作是公式(1)的另一种形式,即根据贝叶斯法则表示为:

虽然任何潜变量生成模型都可以扩展到终身学习设置,但我们选择使用变分自编码器 (VAE)[63] 来构建我们的终身生成模型,因为 VAE 提供了稳定的训练机制 ,这与当前其他最先进的无监督模型(如生成对抗网络 GANs)[39, 61] 形成鲜明对比。

此外,在许多学习场景中,潜变量后验近似 是必需的,例如聚类 [93]、压缩 [92] 和无监督表示学习 [30]。最后,GANs 可能存在生成样本多样性低 的问题 [28],这在终身生成建模中可能导致误差累积 。

4 终身学习模型

对啮齿类动物 [119, 53, 58] 和人类 [110] 大脑的 fMRI 研究表明,在休息期间,海马体(hippocampus)会重放先前经历过的事件序列。这些“回放”对于更好的规划 [53] 和记忆巩固 [16] 是必要的。

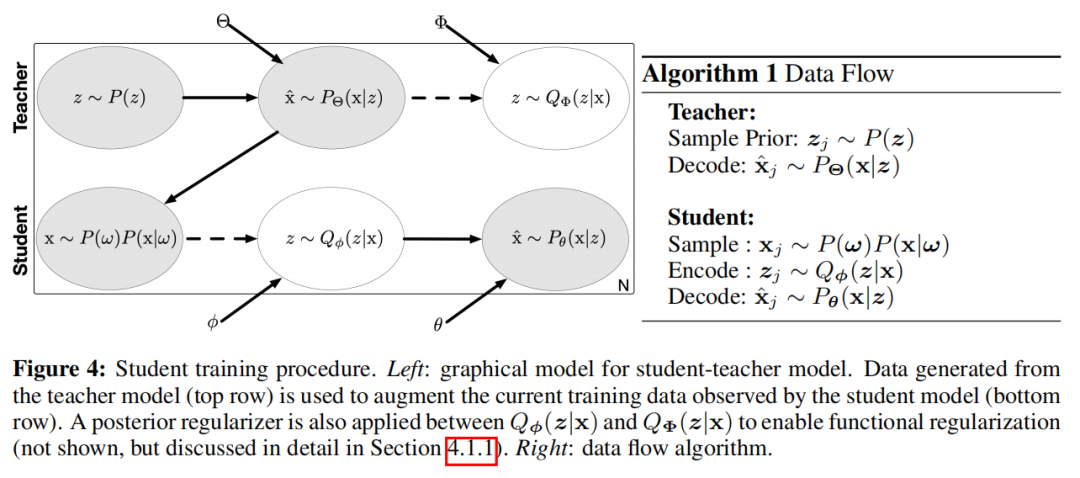

我们从生物学习者的记忆巩固机制中获得启发,提出了我们的终身生成建模 (Lifelong Generative Modeling, LGM)模型。我们在图4中可视化了该模型的学生-教师架构(student-teacher architecture)。

学生模型和教师模型都是同一基础生成模型的具体实现,但在整个学习过程中扮演着不同的角色:

- 教师模型 :作为之前所学部分的概率知识库,他通过生成回放(generative replay)和函数正则化(functional regularization)的方式将知识传递给学生;

- 学生模型 :负责学习新任务的分布,同时兼顾教师模型在旧任务上已学到的表示。

在接下来的小节中,我们将详细描述学生-教师架构,以及它们各自使用的基础生成模型。该基础模型是一种变分自编码器(VAE)的变体,我们针对终身学习任务对其进行了定制,并通过最大化一种标准 VAE ELBO 的变体来训练它;我们将在本节末尾介绍这个目标函数。

4.1 学生-教师架构

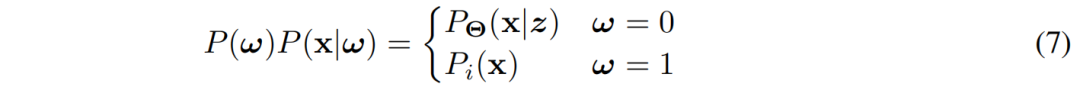

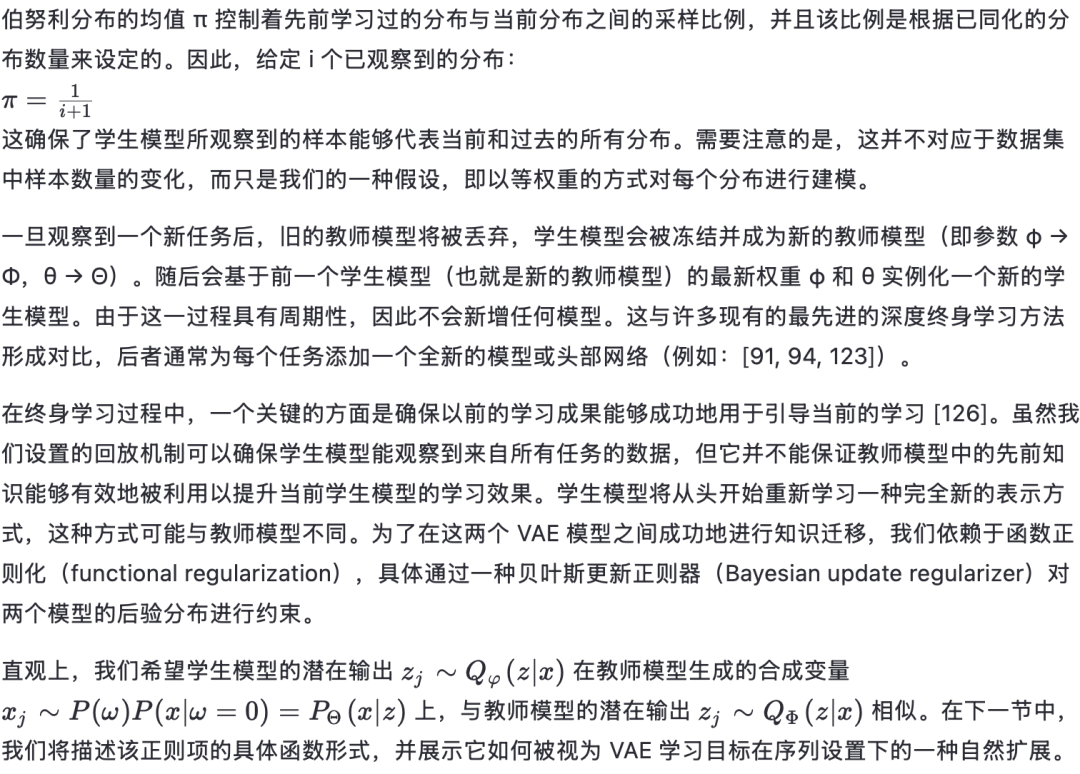

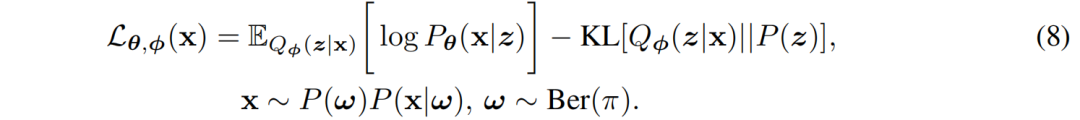

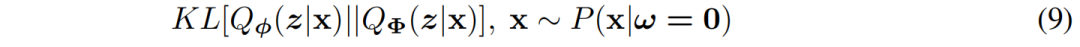

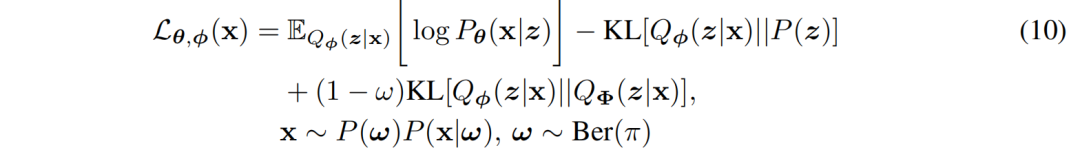

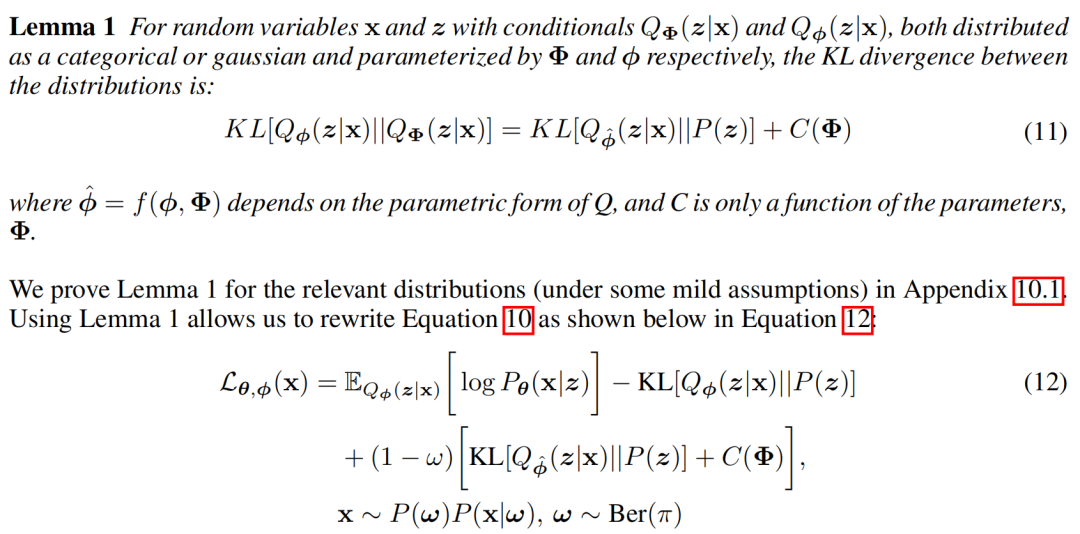

4.1.1 通过贝叶斯更新进行知识迁移 虽然学生模型和教师模型都是为终身学习设置的VAE变体,但在本节的阐述中,我们使用标准的VAE公式。我们的目标是学习学生模型的一组参数 [φ, θ],使其能够从第3.2节中描述的完整分布 P(x) 中生成样本。将增强输入数据 x ∼ P(ω)P(x|ω) 的定义(如公式7所示)纳入考虑,我们可以将学生模型的ELBO定义为:

我们并不像公式8中那样简单地通过KL散度将完整的后验分布收缩到先验分布,而是依赖于贝叶斯范式的一个核心原则:当我们获得新信息时,总可以对我们的后验进行更新(即“昨天的后验是今天的先验”)[79]。基于这一原则,我们引入了我们的后验正则化项²:

该正则化项仅在生成的数据上将教师模型学到的表示提炼(distill)到学生模型中。将公式8和公式9结合,可以得到用于训练学生模型的目标函数,如下面的公式10所示:

需要注意的是,这还不是最终的目标函数,因为我们尚未展示针对终身学习设置特点所设计的VAE变体。接下来,我们将通过学生后验的贝叶斯更新视角,说明后验正则化项如何可以被视为VAE学习目标的一种自然扩展。

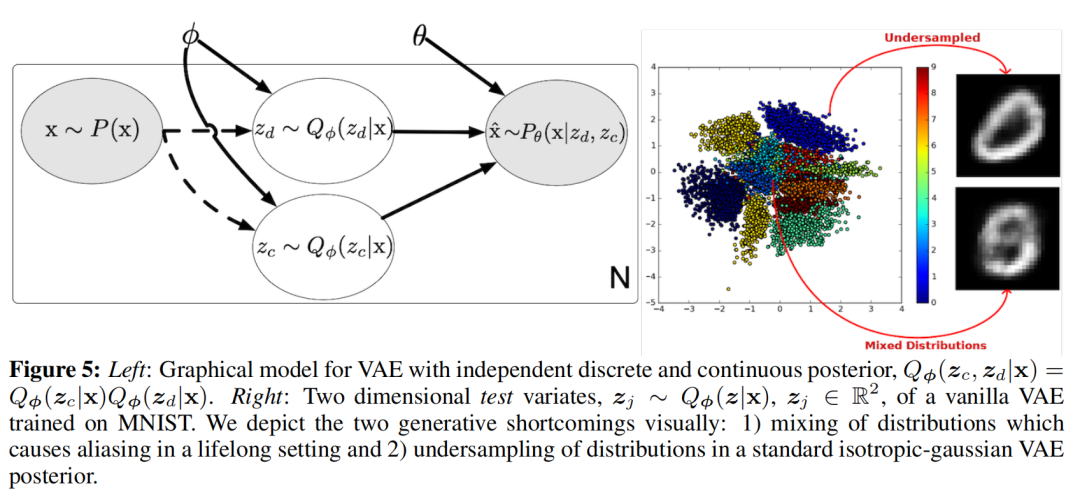

4.2 基础生成模型

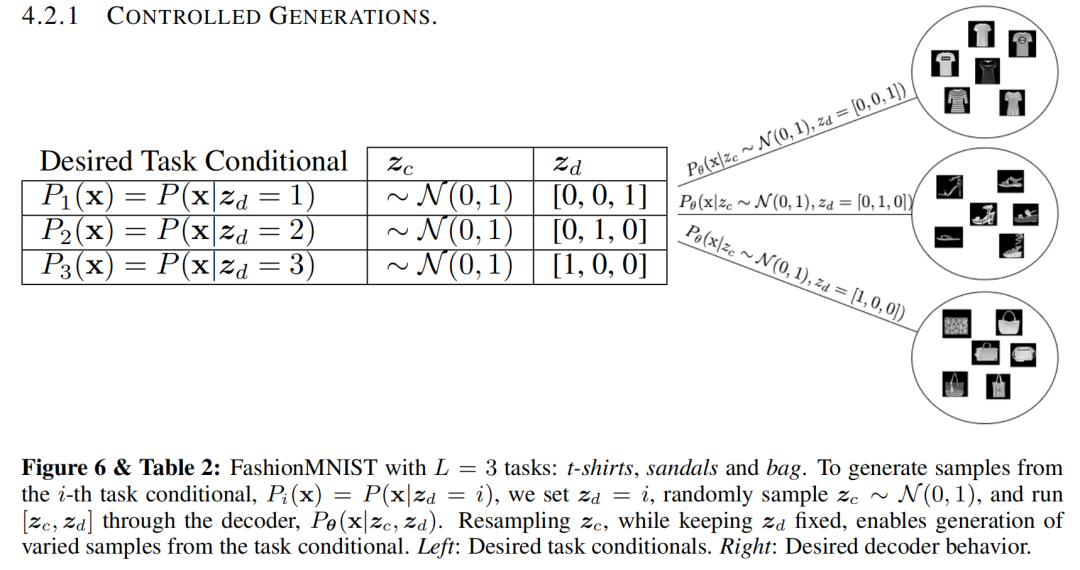

虽然从理论上讲,可以使用第3.3节中介绍的标准VAE作为教师和学生模型,但这样做会暴露出一些局限性,使得其在终身学习背景下的应用变得困难(如图5右侧所示)。具体来说,使用标准VAE的解码器 Pθ(x∣z)来生成用于学生的合成回放数据存在两个问题:

离散部分的目标是概括各个生成分布之间的判别信息。而连续部分则用于建模剩余的样本变异性(即一种干扰变量 [73])。 如果离散部分能够准确地概括这些判别信息,我们就可以显式地从任何一个过去的分布中进行采样,从而使得学生模型的合成输入能够平衡地包含所有先前学到分布的样本。 我们在第4.2.1节中更详细地描述了这种有益的生成采样特性。

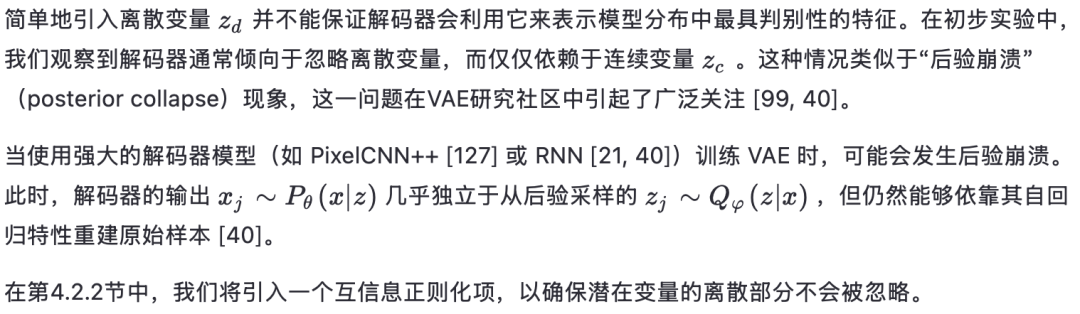

4.2.1 可控生成 (Controlled Generations)

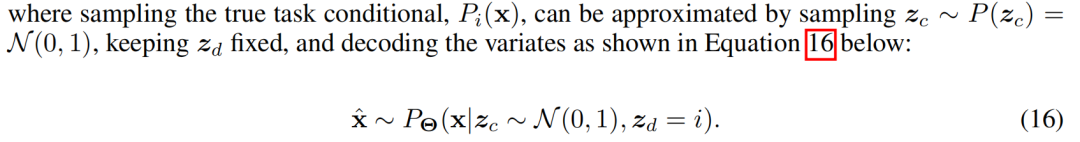

鉴于生成回放在LGM中知识迁移的重要性,教师模型所生成的合成样本需要能够代表所有先前观察到的分布,以防止灾难性遗忘。在假设

能够准确捕捉各个分布的判别特性,并结合LGM生成过程的定义(如公式14所示)下:

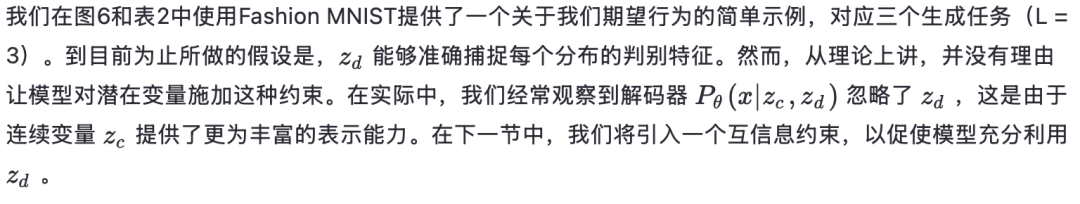

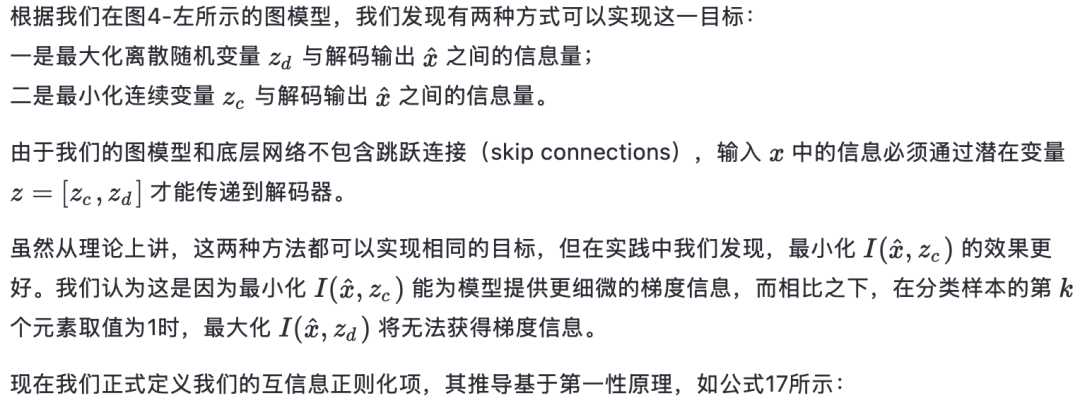

4.2.2 信息限制正则化项

如前一节所述,学生模型所观察到的合成样本需要能够代表所有先前的分布。为了通过第4.2.1节中描述的过程实现可控采样,我们需要确保离散变量

携带有关每个分布的判别信息。

根据我们在图4-左所示的图模型,我们发现有两种方式可以实现这一目标:

其中我们利用了公式13中后验的独立性假设,以及常数的期望等于该常数这一性质。这个正则化项与InfoGAN [18] 中的正则化项有相似之处。

与InfoGAN不同的是,VAE已经估计了后验 Qφ(zc∣x),因此不需要引入额外的参数 φ来进行近似。此外,[47] 指出 InfoGAN 使用了互信息的变分下界(两次),这使得其从理论角度的解释变得模糊不清。

相比之下,我们的正则化项具有清晰的解释:它通过计算图中的某个特定潜在变量来限制信息流。我们观察到,这一约束对于模型的经验性能至关重要,并在第7.2节的消融实验中对其进行了实证验证。

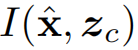

4.3 学习目标

每个学生模型的最终学习目标是最大化序列 VAE 的 ELBO(公式10),同时结合生成回放机制(公式7)以及互信息正则化项

(公式17):

超参数 λ 控制着信息增益正则化项的重要性。若 λ 的值过大,会导致样本多样性下降;而若 λ 过小,则模型将不再使用离散的潜在分布。我们进行了随机超参数搜索,并确定 λ = 0.01 在所有实验中是一个合理的选择。这一取值与 InfoGAN [18] 中用于连续潜在变量的 λ 值一致。

我们在第7.2节的消融实验中对公式18中提出的两个项的必要性进行了实证验证。同时,在第7.1节的实验中也验证了潜在变量分解所带来的好处。

在深入讨论实验之前,我们在下面的第4.4节中对由我们的模型和目标函数(公式18)所引入的计算复杂度进行了理论分析。

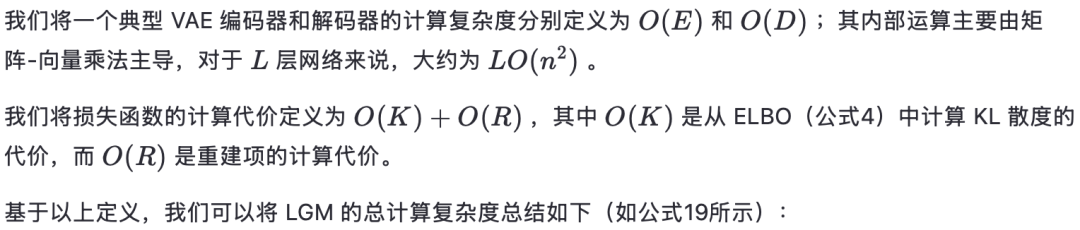

4.4 计算复杂度

其中,由于教师模型生成样本、后验正则化项以及互信息项的引入,计算复杂度有所增加;而后者(互信息项)需要额外的一次编码操作 O(E)。总的来看,计算复杂度仍然主要由神经网络前向传播中的矩阵-向量乘法所主导。

这些运算可以通过现代GPU上的并行计算轻松摊销,因此典型的实验中,实际运行时间并不会严格按照公式19所示的方式增长。在我们最耗时的实验(实验6.6)中,我们观察到每个训练轮次平均增加了13.53秒,每个测试轮次平均增加了6.3秒。

5 重新审视现有最先进方法

在本节中,我们将重新回顾第2节中提到的一些最先进的方法。我们首先从数学角度描述 EWC [65]、VCL [91] 和 LGM 之间的差异,随后讨论 VASE [1] 及其对我们工作的扩展。

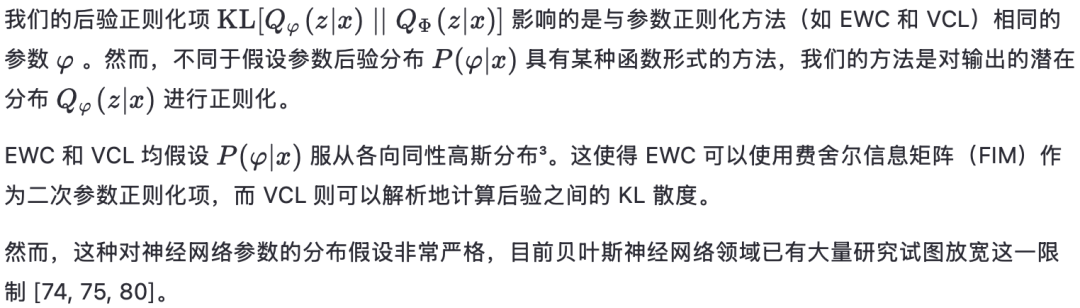

EWC 与 VCL:

在上表中,我们考察了用于最小化灾难性遗忘影响的距离度量 d,在 EWC 和 LGM 中的使用情况。

虽然我们的方法可以应用于任何具有可计算KL散度的分布,但为了便于说明,我们在这里考察了一个简单的各向同性高斯潜在变量后验的情况。

EWC 直接对模型参数 φ施加一个二次约束,而我们的方法则是通过对后验分布 Qφ(z∣x)进行正则化,间接地影响相同的参数。对于任意给定的输入变量 xj,LGM 允许模型自由地改变其内部参数 φ,但这种方式是非线性的⁴ ,使得上述解析形式的 KL 散度达到最小。

VASE: 最近的研究《跨域潜在同源性的终身解耦表示学习》(Life-Long Disentangled Representation Learning with Cross-Domain Latent Homologies),即 VASE [1],在一定程度上扩展了我们的工作 [1, 第7页],但采用了更经验性的路径,通过在其后验分布中引入基于分类的启发式方法。

相比之下,我们在第4.1.1节中展示了:我们的目标函数自然地从VAE在序列学习设置下的框架中推导出来,使我们能够以无监督的方式推断出离散后验 Qφ(zd∣x)。

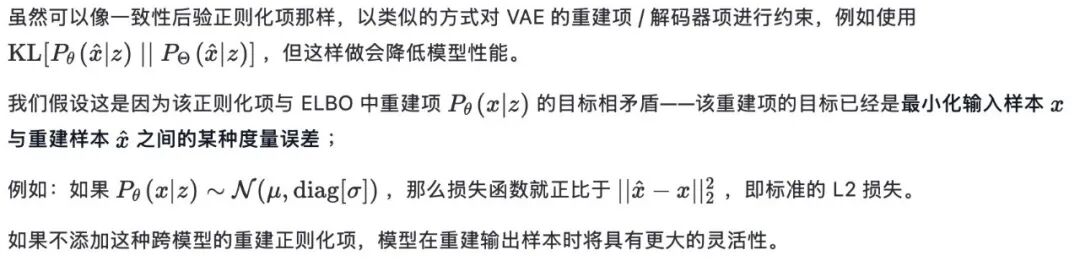

由于 VASE 引入了直接的监督类别信息 [1],他们也观察到对解码分布 Pθ(x∣z)的正则化有助于学习过程;而在我们纯粹的无监督生成设置下,这一做法被发现效果不佳(附录第10.2节)。

最后,与 [1] 不同的是,我们引入了一个信息限制正则化项 (见第4.2.2节),使我们能够直接控制所学潜在变量的信息解释和流动方式。

6 实验

我们在其他最先进的终身学习 / 持续学习文献中常用的标准化数据集上评估我们的模型及基线方法 [91, 136, 112, 57, 65, 94]。虽然这些数据集在传统的分类任务中相对简单,但在转向终身生成设置时,问题的复杂度显著增加。

我们对 LGM 在一系列逐步复杂的任务上进行了评估(第6.2节),并使用一组标准指标与基线方法 [91, 136, 65, 29, 63] 进行比较(第6.1节)。我们模型的所有网络结构和其他优化细节详见附录第10.3节,同时我们也开源了代码仓库 [98]。

6.1 性能指标

为了验证 LGM 在终身学习设置中的优势,我们探讨了三个主要性能维度:

- 模型从所有先前任务中重建和生成样本的能力;

- 随时间推移学习共享表示的能力,从而降低学习所需的样本复杂度。

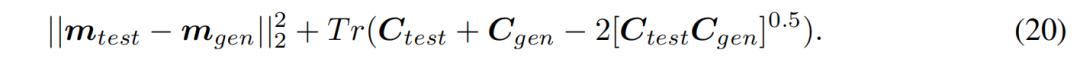

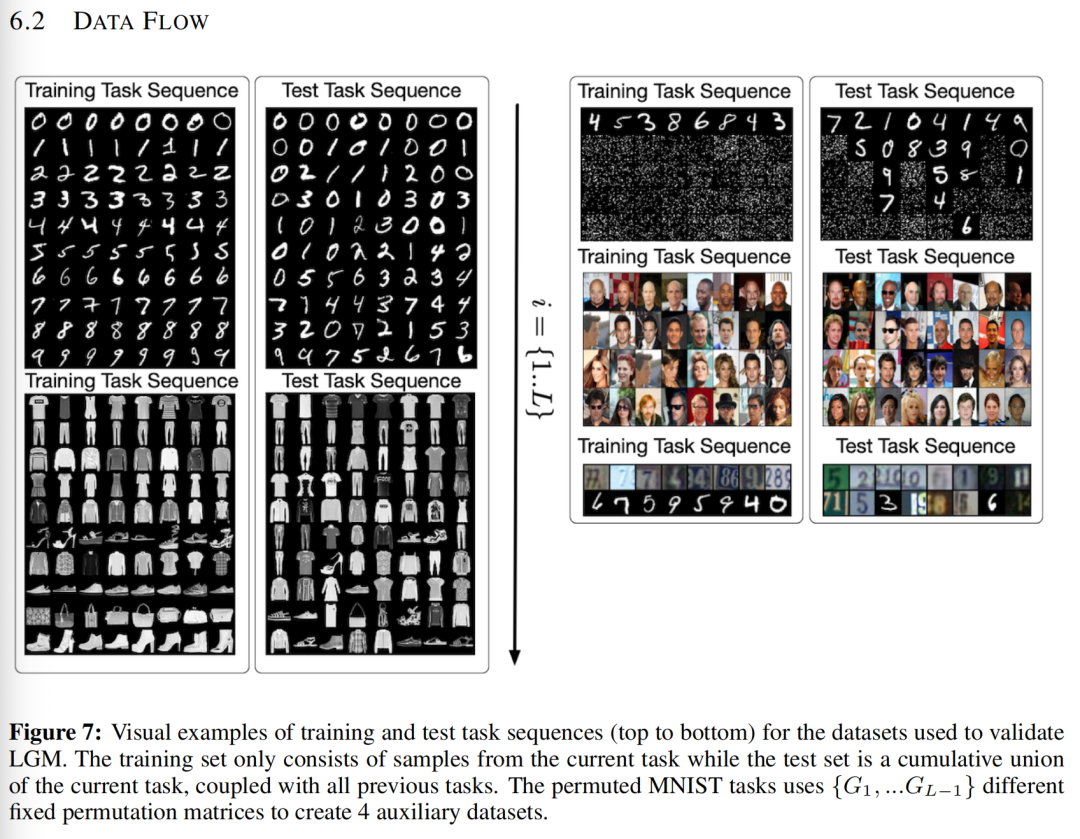

我们实验中使用的三个主要定量性能指标是:

- 对数似然重要性采样估计 [15, 91];

- 测试负ELBO(negative test ELBO);

- 弗雷歇距离(Frechet distance)[44]。

此外,我们还提供了两个辅助指标来进一步验证 LGM 在终身学习中的优势:

- 训练所需的样本复杂度;

- 每个训练/测试轮次的墙钟时间(wall clock time)。

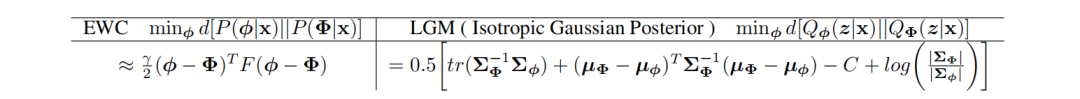

为了公平地比较具有不同潜在变量配置的模型,一种解决方案是在模型评估/测试阶段对潜在变量 z进行边缘化处理:

这在实践中通常通过蒙特卡洛近似实现(通常取 K=5000),也被称为重要性采样 (IS)对数似然估计 [15, 91]。

随着潜在变量和模型复杂度的增加,该估计会变得越来越不稳定且难以计算。因此,在我们的实验中,我们仅在 FashionMNIST 和 MNIST 数据集上使用该指标,因为在一个 K80 GPU 上,为一个复杂模型在 10,000 个测试样本上计算一次估计大约需要 35 小时。

与 IS 对数似然估计相比,测试负ELBO (如公式4所示)仅适用于比较具有相同潜在变量配置的模型;但它的计算速度要快得多。测试负ELBO 提供了在假设潜在变量配置下,真实数据分布对数似然的一个下界。

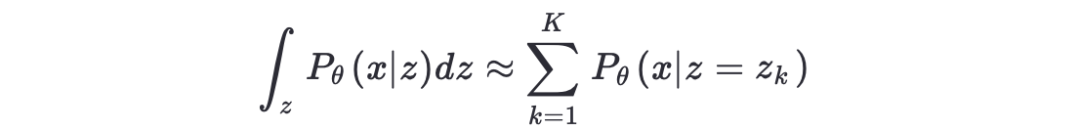

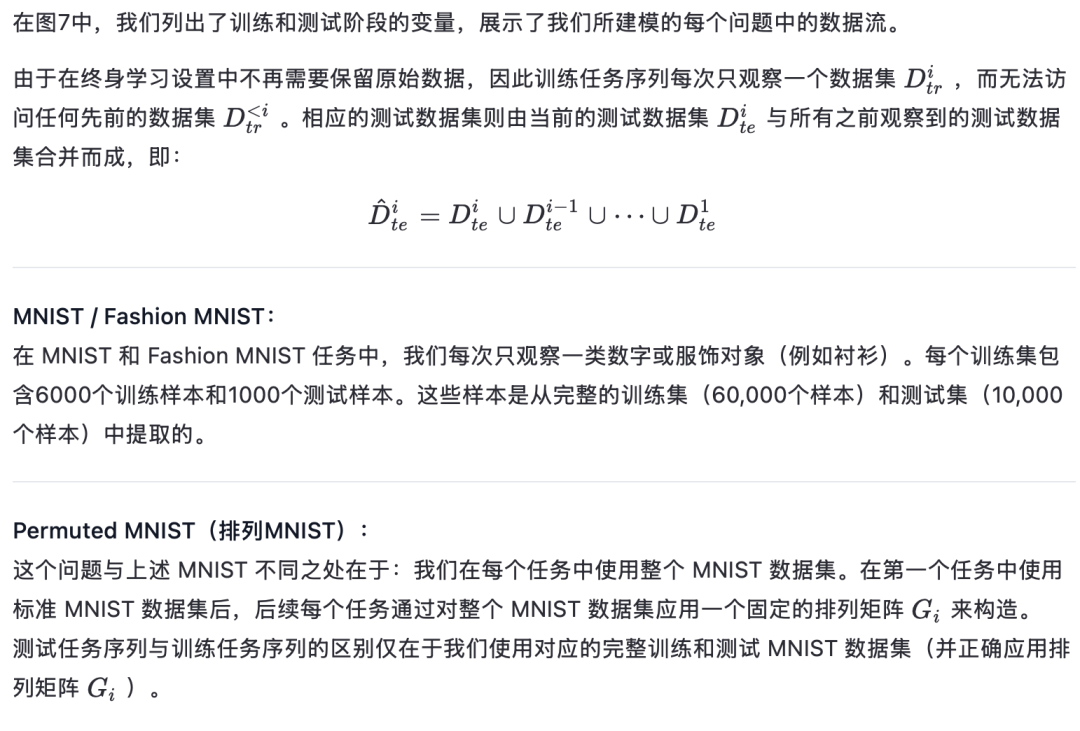

这两个指标都缺少一个关键方面:生成质量的评估 。我们通过使用弗雷歇距离 (Frechet distance)以及定性的图像样本来弥补这一缺陷。

弗雷歇距离 允许我们使用一个预训练的分类器模型,通过比较合成生成样本与测试集中样本之间的特征统计信息(通常假设服从高斯分布),来量化生成样本的质量和多样性。

如果这两组分布之间的弗雷歇距离较小,则说明生成模型能够生成逼真的图像。

尽管弗雷歇距离、负ELBO和IS对数似然估计能够让我们一窥模型性能的表现,但目前尚无一种具有决定性的指标能够全面捕捉无监督生成模型的质量 [124, 108]。当前的研究也表明,在感知质量和模型表示能力之间存在直接的权衡关系 [8]。

因此,除了上述定量指标外,我们还提供了定性评估指标,包括测试图像的重建结果和生成图像的结果。

我们在下表3中总结了所有使用的性能指标:

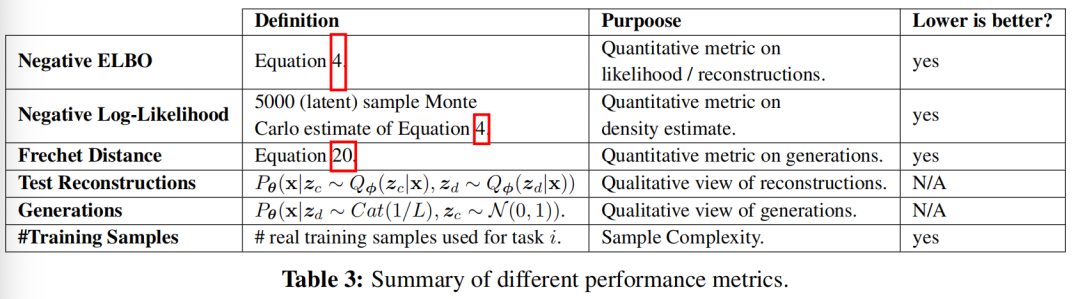

6.3 与最先进的终身学习模型的对比

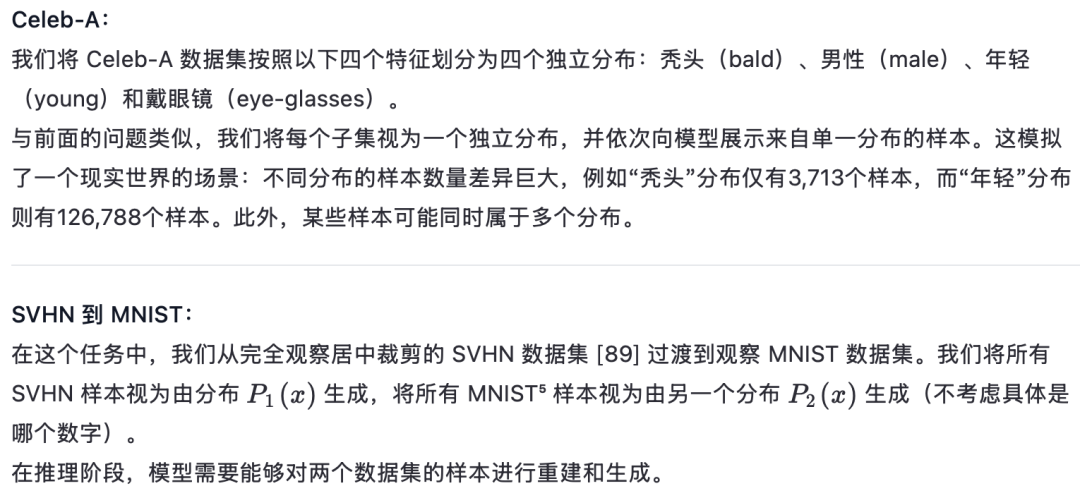

为了将 LGM 与其他最先进的终身学习方法进行对比,我们使用了第6.2节中描述的顺序 FashionMNIST 和 MNIST 数据集,以及图7中的数据流示意图。

我们将提出的 LGM 模型与以下基线模型进行了对比:

- VCL [91]

- 没有任务特定头网络的 VCL

- SI [136]

- EWC [65]

- Laplace propagation [29]

- 在所有数据上联合训练的完整批次VAE (full batch VAE)

- 没有任何灾难性遗忘预防策略的标准朴素序列VAE

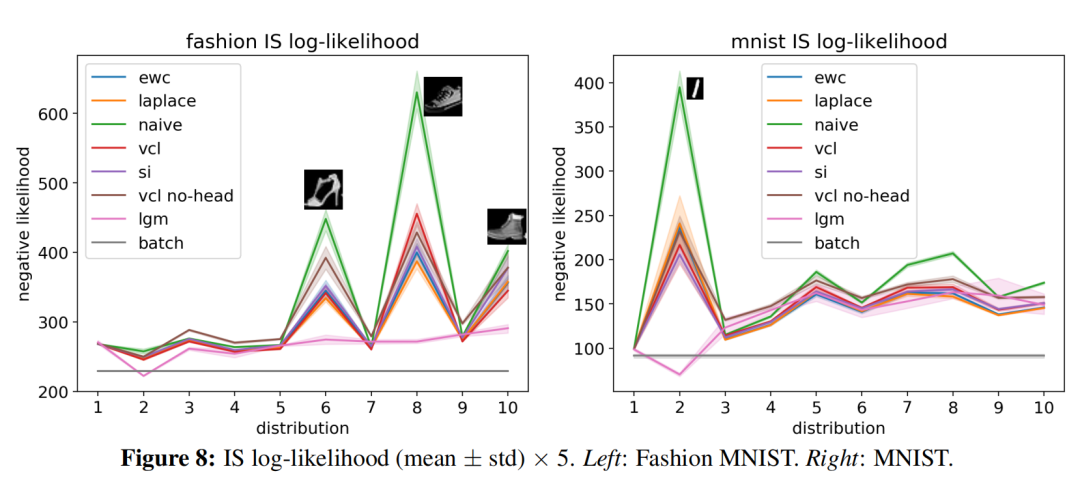

如下面的图8和图9所示,完整批次VAE代表了性能上限,而所有终身学习模型通常在最终学习任务上的表现都会低于该上限。

对于基线模型,我们使用了 VCL 作者慷慨开源的代码 [90],并按照各模型指定的最佳超参数进行训练。

我们首先在下图8中评估了所有对比模型的对数似然的5000样本蒙特卡洛估计:

尽管每次实验重复了五次,我们仍观察到在某些关键时间点上,估计值出现了显著上升。经过进一步检查,我们确定这些大幅增长是由于模型在该时间点上观察到了一个截然不同的分布所致。

我们在图上叠加了一个示例变量,以展示这些峰值的幅度。例如,在 FashionMNIST 数据集中,当任务编号 i=6时,模型首次观察到了鞋类分布;而此前观察到的主要是服装类物品。这一变化导致了性能估计上的突变。

有趣的是,我们观察到 LGM 在各个任务之间的性能变化要平稳得多。我们认为这是因为 LGM 并没有对其参数施加直接限制,而是通过函数正则化来强制保持相同的输入-输出映射。

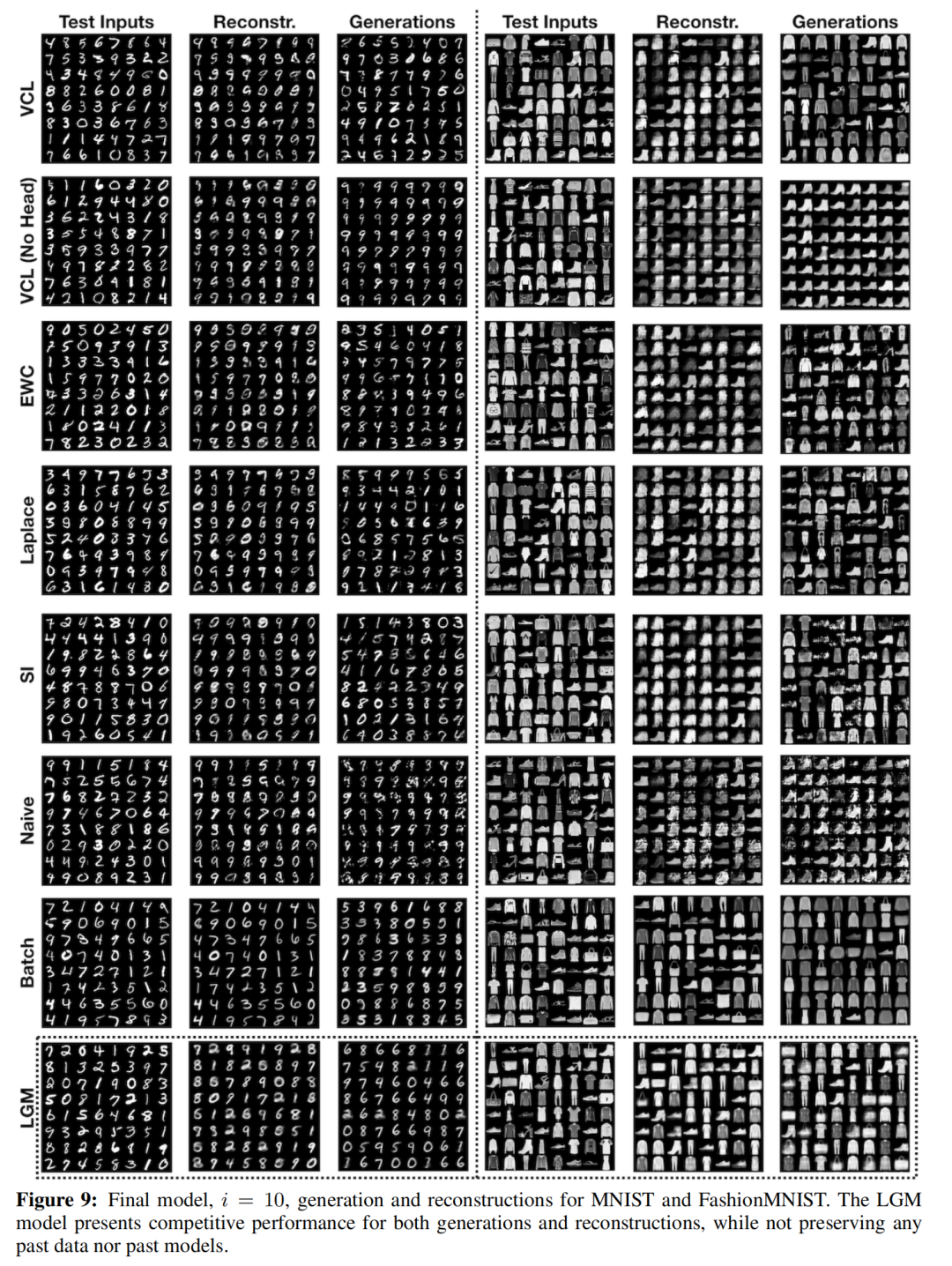

由于终身学习的核心原则之一是随着时间推移降低样本复杂度,我们通过本实验验证 LGM 是否确实实现了这一目标。

由于所有 LGM 模型都是在满足早停(early-stopping)准则的情况下进行训练的,因此我们可以直接根据早停时的训练轮数,以及学生模型中伯努利采样分布的均值 π,来计算每个学习任务所使用的样本数量。

在图10中,我们绘制了模型在满足早停准则之前所使用的真实样本数量 和合成样本数量 。我们观察到,随着时间推移,模型所使用的真实样本数量 稳步减少,这验证了 LGM 在终身学习设置中的优势。

6.4 深入观察序列过程

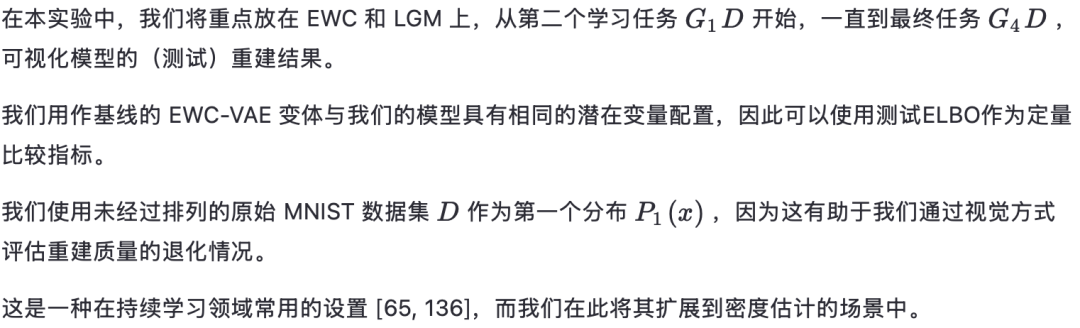

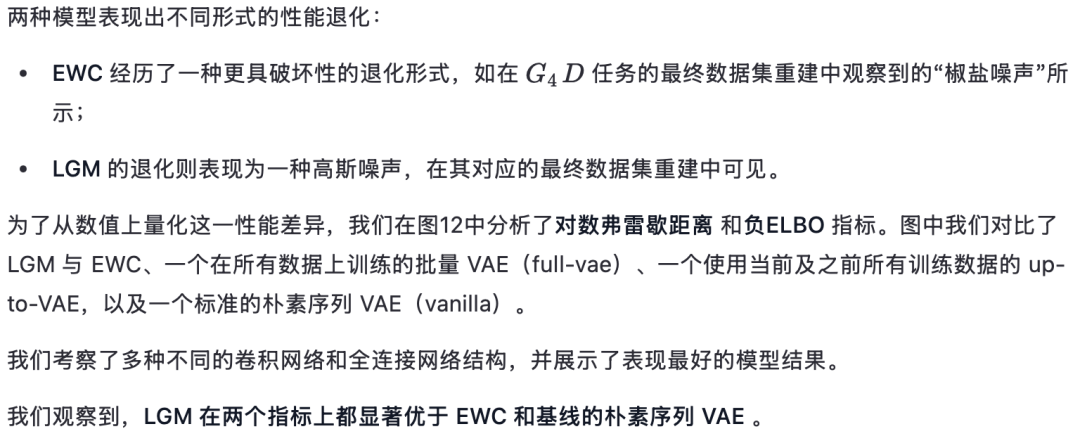

不同于仅在图9中展示最终模型的定性结果,我们在图11中展示了 PermutedMNIST 实验中模型随时间变化的定性表现。这使我们能够直观地观察终身学习模型在多个任务中的性能演变。

6.5 在复杂分布之间学习

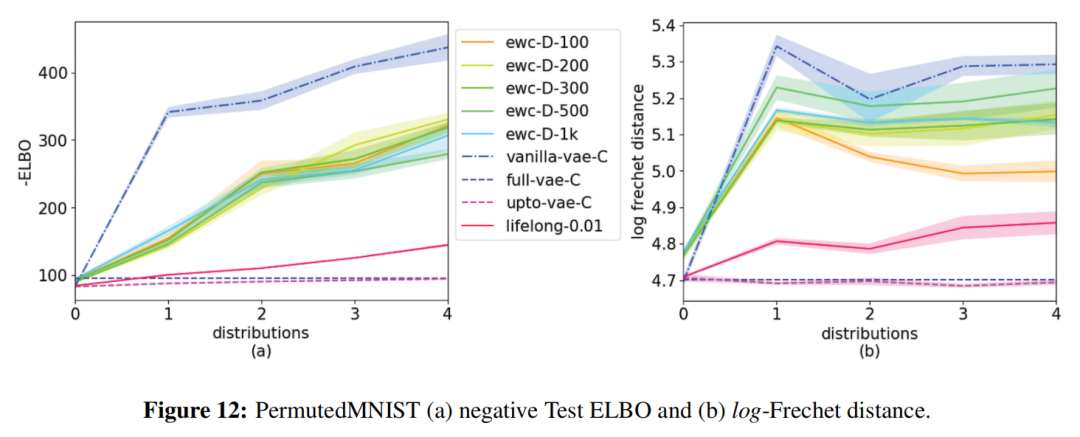

终身学习中的一个常见假设是:观察到的分布序列在某种程度上是相关的 [125]。在本实验中,我们放宽了这一限制,尝试在彩色的 SVHN 数据集 与二值化的 MNIST 数据集 之间学习一个统一的模型。

尽管从人类视角来看这两个数据集语义上相似,但它们在本质上差异巨大:一个是基于真实世界房屋编号的 RGB 图像,另一个则是合成的手写数字图像。

我们在图13(a)中可视化了最终终身模型所使用的真实测试输入 x及其对应的重建结果 x^。即使最终模型在训练过程中只接触过 MNIST 数据集,它仍然能够重建之前观察到的 SVHN 数据。这展示了我们的架构在不同复杂分布之间迁移的能力,同时保留了从先前分布中学到的知识。

该模型为两个分布学习到了一个共享的连续结构,这一点可以通过观察图13(b)和图13(c)中从左上到右下生成样本的变化过程得以验证。

6.6 使用 Celeb-A 验证经验样本复杂度

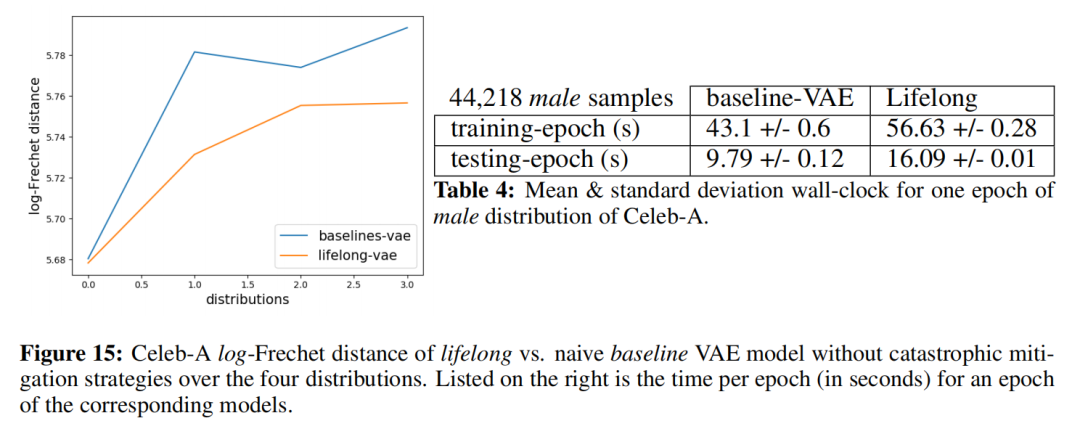

我们按照数据流图(图7)中描述的方式迭代 Celeb-A 数据集,并使用这个学习任务来探索定性和定量的生成能力,以及在现代 GPU 硬件上的经验现实时间复杂度 (如第4.4节所述)。

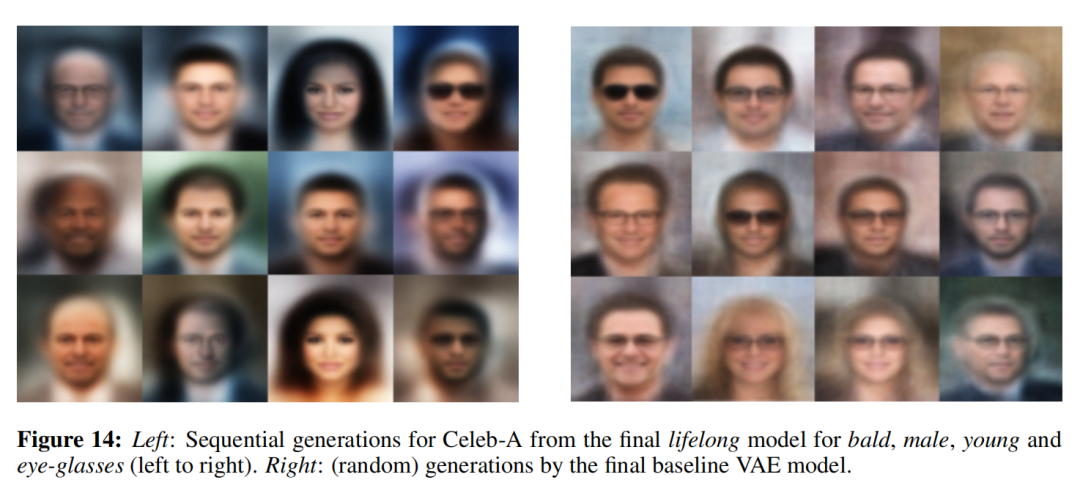

我们训练了一个终身学习模型和一个没有灾难性遗忘缓解策略的标准 VAE 基线模型,并在图14中评估它们的最终生成效果。

正如图14-Left 所示,终身学习模型能够从所有先前的分布中生成样本,而基线模型则出现了灾难性遗忘(见图14-Right),仅能生成来自“戴眼镜”分布的样本。

这一结论也通过图15中展示的对数弗雷歇距离 得到了进一步支持。

我们还评估了终身学习模型和基线 VAE 模型在 男性分布的 44,218 个样本 上的实际运行时间(以秒为单位) ,结果见表4。

我们观察到,终身学习模型并没有带来显著的时间开销。尤其是考虑到基线 VAE 出现了灾难性遗忘(如图14右侧所示),并且完全无法从先前的分布中生成样本的情况下,这种额外的时间开销是可以接受的。

请注意,我们在代码和附录10.3中展示了模型参数数量及其他详细的模型信息。

7 消融实验

在本节中,我们独立验证了第4.3节中提出的学习目标中每个新增组件所带来的益处。

在实验7.1中,我们展示了第4.2.1节中引入的离散-连续后验分解 的优势。

接着在实验7.2中,我们验证了信息限制正则化项 (第4.2.2节)和后验一致性正则化项 (第4.1.1节)的必要性。

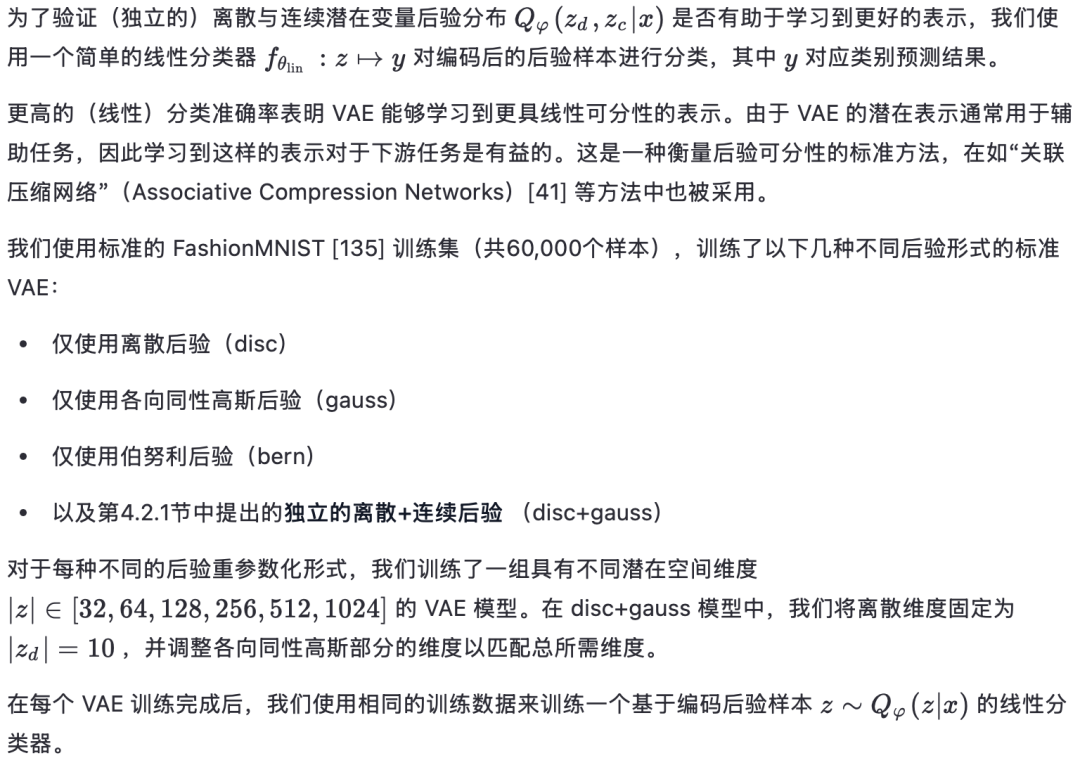

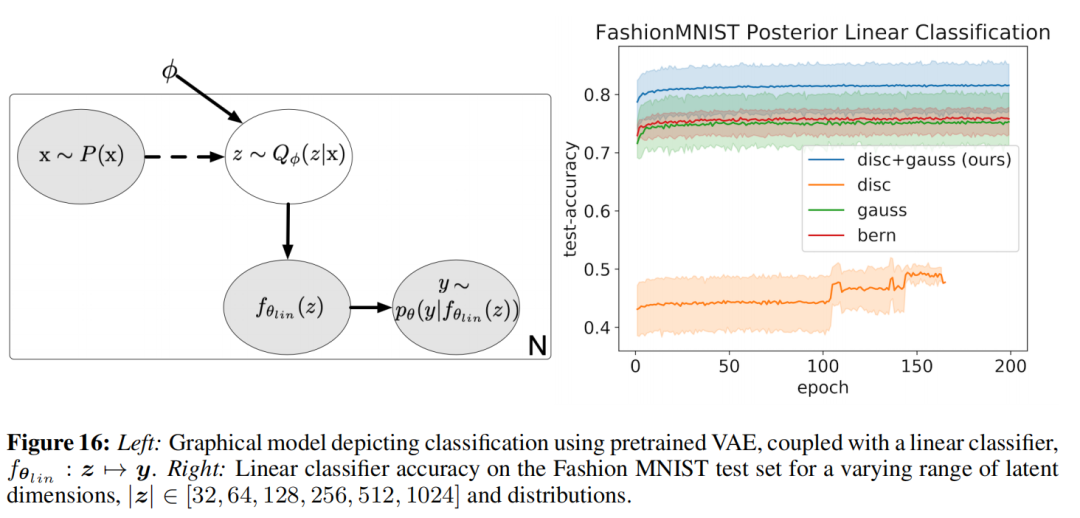

7.1 离散与连续后验的线性可分性

在图16中,我们展示了每组实验的线性测试分类准确率的均值和标准差。正如预期,仅使用离散后验(disc)的表现较差,这是因为将整个输入样本映射为单一 one-hot 向量的限制太强。

仅使用各向同性高斯(gauss)和伯努利(bern)后验的模型提供了较强的基线表现,但将离散与高斯后验结合的模型(disc+gauss)表现更优,达到了 87.1% 的上线性可分测试分类准确率 。

这验证了第4.2.1节中提出的潜在表示解耦方式,有助于学习到更有意义、更具可分性的后验分布。

7.2 验证互信息与后验一致性正则化项

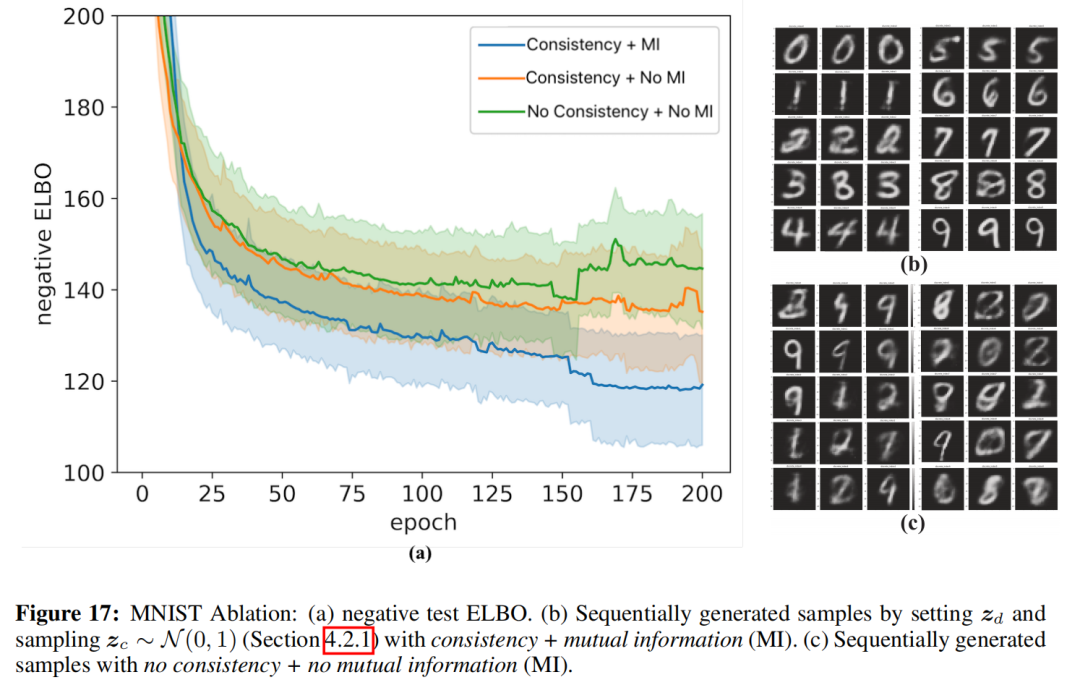

为了独立评估我们提出的贝叶斯更新正则化项 (第4.1.1节)以及互信息正则化项 (第4.2.1节)所带来的优势,我们使用图7中的 MNIST 数据流序列进行了一项消融实验。

我们评估了以下三种情况:

- 同时使用后验一致性正则化项和互信息正则化项

- 仅使用后验一致性正则化项

- 不使用任何正则化项

我们观察到,两个组件都是生成高质量样本所必需的 ,这一点通过图17-(a)中的测试负ELBO结果以及图17-(b-c)中的生成样本可以证明。

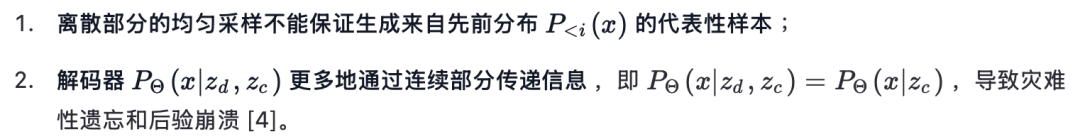

在图17-(c)中,当不使用信息增益正则化项和一致性约束 时,生成的样本变得模糊。我们将这一现象归因于以下两个原因:

8 局限性

尽管 LGM 表现出了较强的性能,但它并未完全解决终身生成建模的问题,并且我们观察到模型性能会随着时间缓慢退化。我们认为这主要是由于 VAE 生成效果不佳的问题在多个任务中累积所致(如下文进一步讨论)。

此外,要实现一个最优的(即弗雷歇距离和 -ELBO 不随时间退化的)无监督生成式终身学习模型,还需要解决以下几个关键问题:

分布边界评估: 当前大多数终身 / 持续学习方法 [91, 136, 112, 57, 65, 94] 的标准假设是使用已知、固定的分布,而不是去学习分布之间的转换边界。

在本研究中,我们关注的是以一种无监督的方式对分布进行积累,而不是通过引入异常检测等方法来识别分布边界,从而避免增加额外的间接层次。

VAE 生成图像模糊: VAE 被广泛认为在图像生成方面会产生模糊的结果,相比之下 GAN 的表现更优。这一问题通常归因于 VAE 并未学习到真实的后验分布,并对重建分布 Pθ(x∣z)做了过于简化的假设 [4, 97]。

虽然存在一些方法如 ALI [27] 和 BiGAN [26] 可以在 GAN 框架内学习后验分布,但近期研究表明,对抗方法在高维空间中难以准确匹配后验与先验的分布比例 [104]。

记忆机制: 为了扩展到真正的终身学习场景,我们认为学习算法需要一个可以与学习过程本身解耦的全局记忆池。这种解耦不仅有助于在连续学习的模型之间进行参数迁移,还能提供一个集中存储和压缩非关键历史数据的位置。

像 Kanerva Machine [133] 及其扩展 [134] 这类近期工作已经在 VAE 框架下提供了有理论依据的方法来实现这一点。

9 结论

在本文中,我们提出了一种在终身学习环境下训练生成模型的新方法。该方法的核心假设是:数据由多个不同的分布生成,并按顺序呈现给学习者。

学习过程的一个关键限制是:学习者无法访问任何旧数据,必须将所有必要信息提炼到一个最终模型中。

所提出的方法基于一种“学生-教师”双模型架构,其中教师模型的作用是保留过去的知识,并辅助学生模型在未来的学习中取得更好效果。

我们论证并扩展了标准 VAE 的 ELBO 目标函数,加入了帮助教师-学生之间知识迁移的正则项。

通过一系列实验,我们展示了这种增强目标函数在终身学习设置中的优势。

结合所提出的正则化项,该架构有效缓解了灾难性干扰的影响,支持了先前知识的保留,从而提升了终身学习场景下的生成模型性能。

10 附录

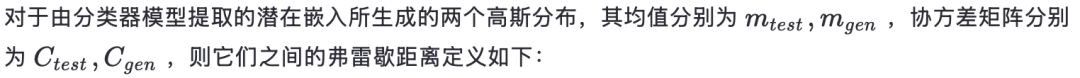

10.1 对一致性正则化项的理解

通过对一致性正则化项的解析推导可以看出,该正则化项可以被解释为对标准 VAE 正则化项的一种变换。

在使用各向同性高斯后验的情况下,所提出的一致性正则化项会通过教师模型后验的方差 1对学生模型后验的均值和方差进行缩放,并额外添加了一个“体积”项。

这种对一致性正则化项的解释表明,所提出的正则化项保留了与标准 VAE 相同的学习目标。

下面我们展示了在使用分类后验和各向同性高斯后验时,一致性正则化项的具体解析形式:

10.2 重建正则化项

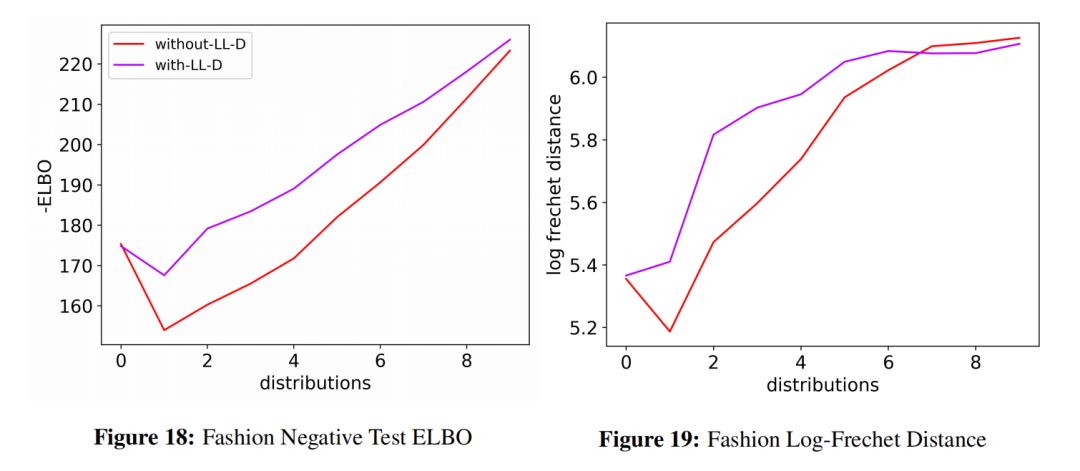

为了量化这一点,我们重复了图7中数据流定义下的 FashionMNIST 实验。为了验证这一假设,我们使用了一个比主实验更简单的模型结构。

我们训练了两个全连接模型(-D):

- 一个仅包含后验一致性正则化项(without-LL-D)

- 另一个同时包含一致性正则化项和似然正则化项(with-LL-D)

如图18和图19所示,我们观察到在引入似然正则化项的情况下(with-LL-D),模型性能出现了下降(无论是在弗雷歇距离还是测试ELBO指标上)。

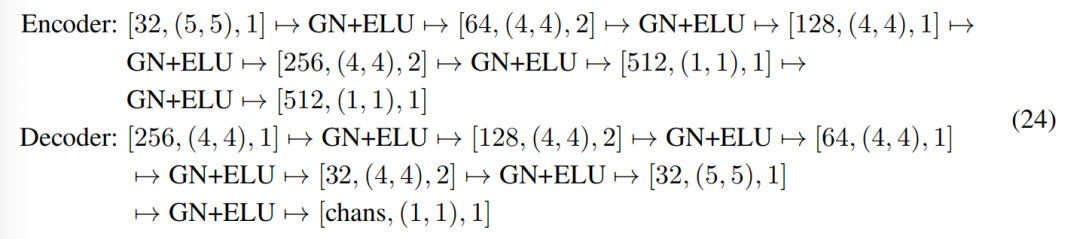

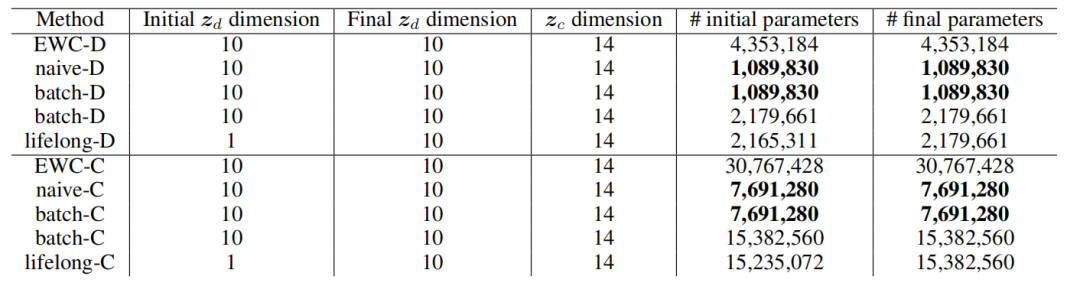

10.3 模型架构

我们在实验中使用了两种不同的网络架构:

当我们使用全连接网络(-D)时,我们采用了两层各512个神经元的隐藏层,用于映射到潜在表示空间;解码器部分也使用两层各512个神经元,用于重建输入。我们对所有层都使用了批归一化 (Batch Norm)[48] 和 ELU 激活函数 ,除了用于映射到潜在空间的那一层和输出层。

需要注意的是,虽然我们在 EWC 实验中也使用了相同的架构,但我们观察到在使用批归一化时会对性能产生显著的负面影响,因此在 EWC 的实验中去掉了批归一化层。

对于卷积网络架构(-C),我们使用了如下所述的编码器和解码器结构(其中解码器使用转置卷积层进行上采样)。卷积层的表示方式为: [输出通道数, (滤波器高度, 滤波器宽度), 步长] :

上表列出了我们实验中所使用每种模型和架构的参数数量。

终身学习模型(lifelong models)最初从一个维度为1的离散潜在变量 zd开始,随后在每个新任务中逐步增加一个维度以适应新的分布(详见第10.7节)。 相比之下,基线模型 EWC 在整个学习过程中始终使用完整的表示空间。

EWC 模型的参数数量是我们的两倍,这是因为 EWC 需要计算对角化的费舍尔信息矩阵(Fisher information matrix),其维度与模型参数数量相同。此外,EWC 还需要保留教师模型的参数 [Φ,Θ]用于其二次正则化项。

而“朴素模型”(naive)和“完整训练模型”(batch)的参数数量最少,因为它们不采用学生-教师框架,仅使用单一模型。但需要注意的是,朴素模型(vanilla)没有防止灾难性干扰的机制,完整模型(full model)则仅作为性能上限存在。

我们使用 Adam 优化器 [62] 来优化所有问题,学习率设置为 1e-4 或 1e-3。当进行权重迁移(weight transfer)时,我们会重新初始化 Adam 的动量累积向量,以及批归一化层中的均值和方差统计量。

完整的模型架构可以在我们的 GitHub 仓库 [98] 中查看,并采用 MIT 许可证开源。

10.4 与流式 / 在线方法的对比

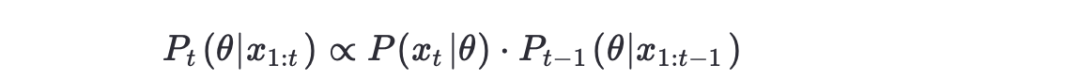

我们的方法与一些流式方法(streaming methods)具有相似之处,例如 Streaming Variational Bayes (SVB) [14] 和增量贝叶斯聚类方法 [60, 38],这些方法都通过时间推移不断估计并精炼后验分布。

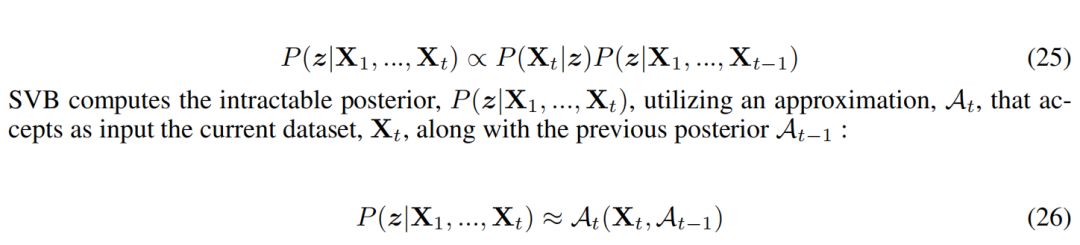

一般来说,这可以通过以下贝叶斯更新规则实现:最新后验正比于当前似然乘以上一次的后验:

这种方法的核心思想是将新数据的信息整合到已有后验中,从而实现持续更新。然而,这类方法通常假设模型结构固定或已知,并且主要关注参数层面的更新。

与之不同的是,我们的方法不仅更新参数,还通过函数正则化的方式保留了模型的输入-输出行为一致性,同时扩展了潜在表示空间以适应新任务。这种机制更适用于深度生成模型的终身学习场景。

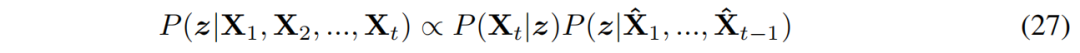

将这种生成回放策略与第4.1.1节中引入的贝叶斯更新正则化项 相结合,我们证明了我们不仅像公式27中那样学习到了一个更新后的后验分布,而且还实现了在顺序学习模型之间的自然知识迁移——这是终身学习的一个基本理念 [126, 125]。

最后,终身学习与在线学习方法之间的另一个关键区别在于:

- 终身学习 旨在从一系列暂时不同(tentatively different)的任务中学习,同时保留并积累知识;

- 而在线学习 通常假设真实的底层分布来自于一个单一分布 [11]。

当然也存在一些例外情况,例如将在线学习应用于领域自适应问题的研究,例如:[49, 60]。

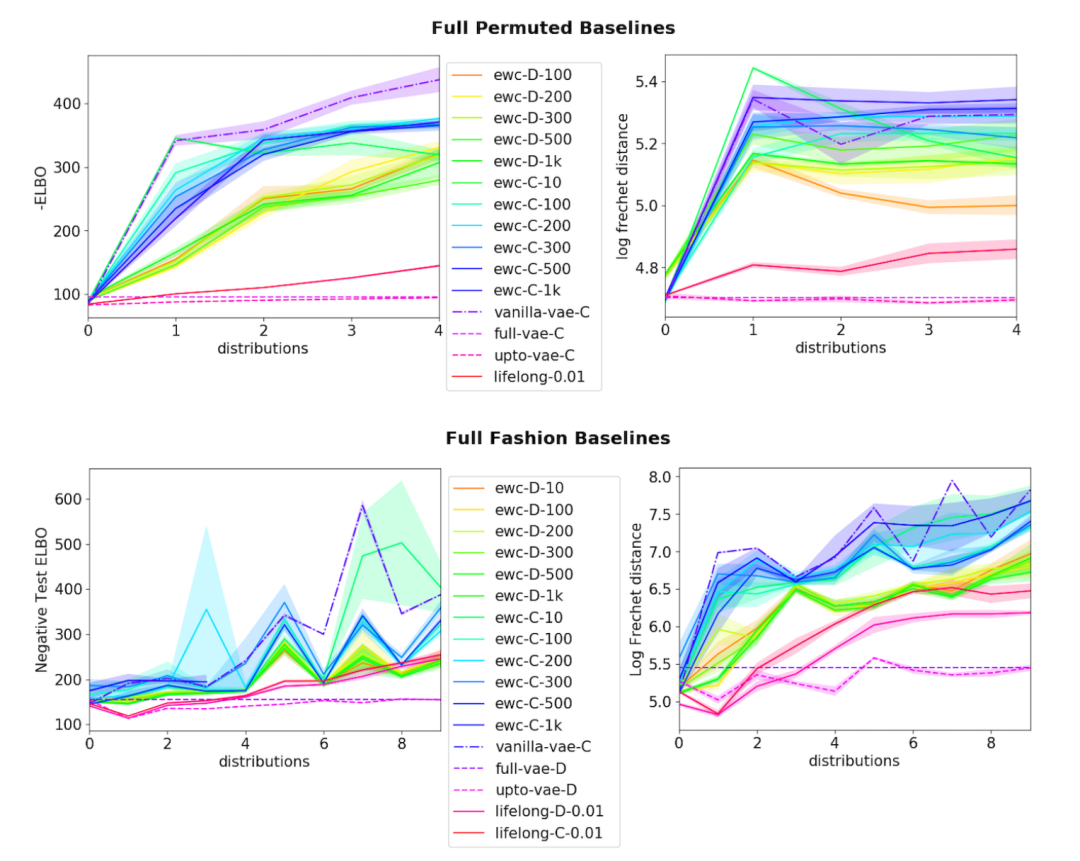

10.5 EWC 基线:卷积网络与全连接网络对比

我们比较了多种 EWC 基线模型,并在实验中仅使用其中表现最好的几个模型。 图10.5中列出了在 PermutedMNIST 和 FashionMNIST 实验中运行的所有 EWC 基线结果。

回顾一下,C / D 表示模型是卷积网络还是全连接网络,后面的数字表示 EWC 或 Lifelong VAE 的超参数。

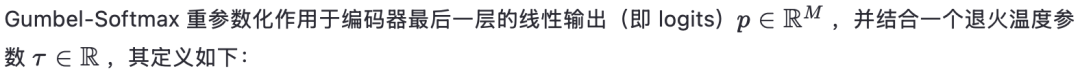

10.6 Gumbel 重参数化

由于我们将潜在变量建模为一个离散分布和连续分布的组合,因此我们也使用了 Gumbel-Softmax 重参数化[76, 50]。

10.7 可扩展的模型容量与表示能力

我们的方法对模型架构没有任何限制:也就是说,可以自由地向新的学生模型中添加新的网络层。

此外,我们也允许离散潜在表示

的维度随着新分布的出现而增长。这是可行的,因为两个不同大小的分类分布之间的KL散度可以通过对教师模型较小的离散分布进行零填充(zero padding)来计算。

由于我们还在教师模型和学生模型之间进行权重迁移,因此也需要妥善处理潜在表示扩展的情况。当新增一个分布时,我们会复制除与潜在分布映射相关之外的所有权重;而这些相关的权重(即进入和离开潜在空间的投影层)则会重新按照标准的 Glorot 初始化方法 [37] 进行初始化。

https://arxiv.org/pdf/1705.09847

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录