VFP AI 插件:超长上下文的识别(一)

VFP AI 插件:超长上下文的识别(一)

firstxinjie

发布于 2026-03-10 16:22:03

发布于 2026-03-10 16:22:03

VFP AI 插件在访问大模型时,有一个上下文长度的问题。

对于 DeepSeek 而言,其大小为 128K(=128000 token)。尽管大多数情况下,对于单轮对话它是足够的,但是对于一些类/类库,甚至对于整个 VFP 项目来说,它太小了。因此,需要将单轮对话在执行时,转换为多轮对话。

在逻辑上,也仅仅是如此处理即可;但是,如果因此觉得这很容易实现,就太天真了。

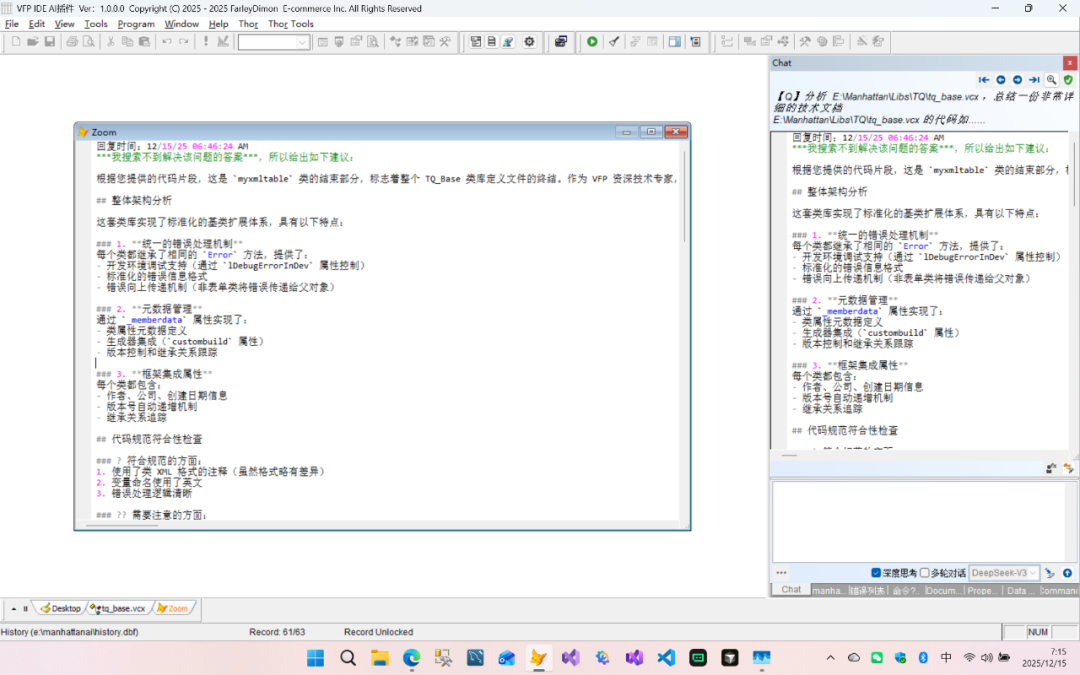

VFP AI 插件 2025.12.15 版,初步实现超长上下文的处理:

所分析 VCX 类库,使用类浏览器转换出的 prg 格式文件,文件体积为 400+KB,共 10329 行,超过模型最大上下文的最大限制。

这是一个良好的开端,尽管它暂时可能仅仅是演示的意义。

未来可期!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读