ollama v0.16.1发布:安装体验优化、模型加载超时可配置、图像生成更智能的全面更新解析

ollama v0.16.1发布:安装体验优化、模型加载超时可配置、图像生成更智能的全面更新解析

福大大架构师每日一题

发布于 2026-03-04 19:04:17

发布于 2026-03-04 19:04:17

在这里插入图片描述

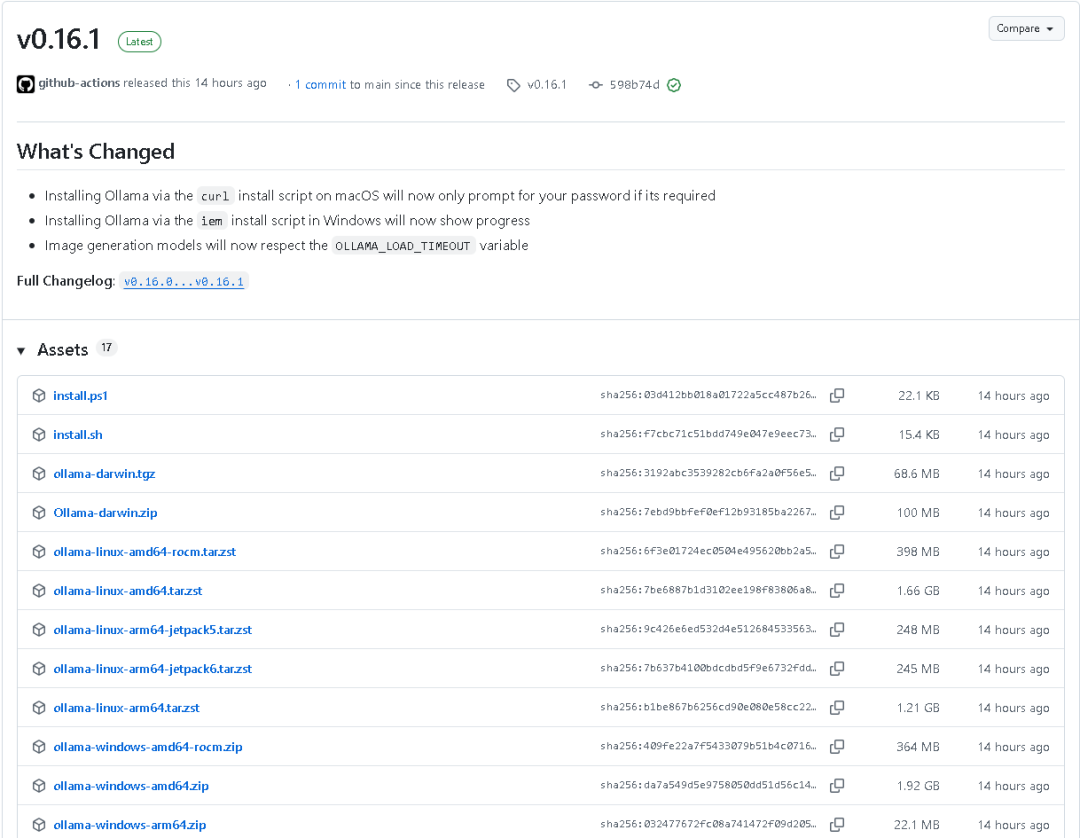

在这里插入图片描述

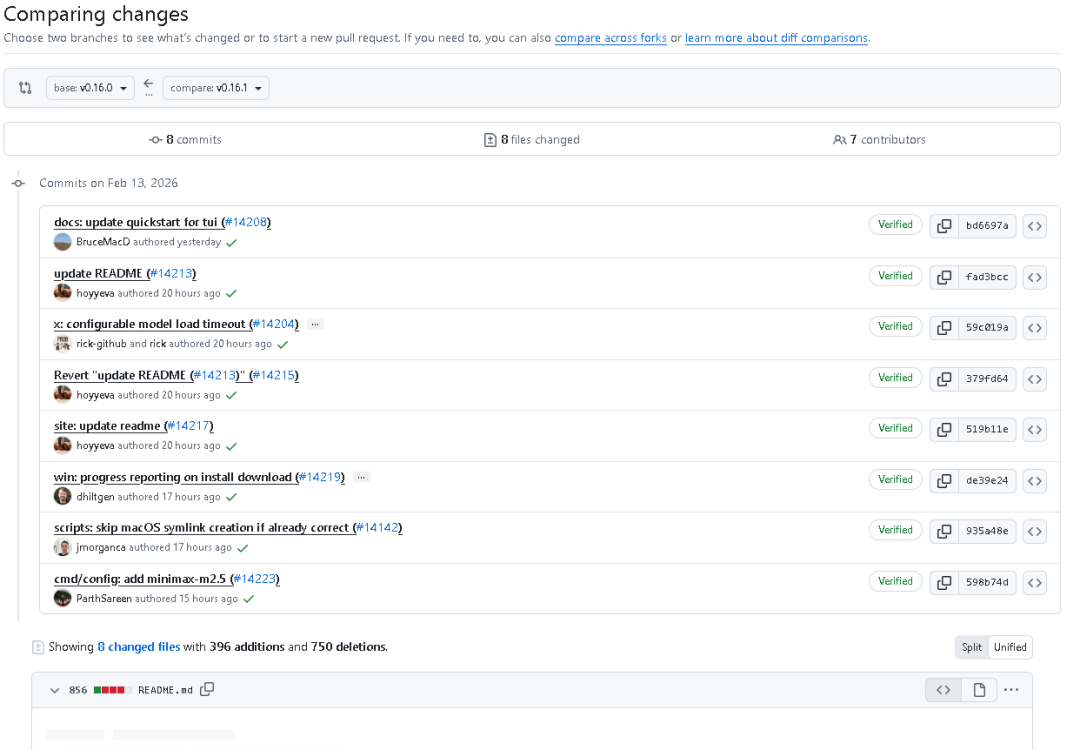

在这里插入图片描述

在2026年2月13日,ollama v0.16.1正式发布。作为一个持续快速发展的AI模型管理与运行平台,这次的更新不仅提升了跨平台安装体验,还新增了对模型加载超时的精细控制,以及图像生成模块的优化。这是一个兼具性能提升与可用性增强的版本,标志着ollama在本地与云端模型无缝使用体验上的又一次重大进步。

本文将全面梳理这一版本的所有改动,带你深入理解每一个技术细节,尤其是在安装脚本、模型配置、云模型限制、开发者文档、图像生成引擎等方面的实质性更新。

一、版本概览

版本:v0.16.1 发布日期:2026年2月13日

核心变化概述:

- 1. macOS安装体验改进:通过curl脚本安装时,仅在确实需要时才会请求系统密码。

- 2. Windows安装反馈增强:安装过程中增加可视化下载进度显示。

- 3. 图像生成模型增强:图像生成模块新增对

OLLAMA_LOAD_TIMEOUT变量的支持,可灵活定义加载超时。

此次版本同步更新了多个代码文件,共包含8个不同的提交和8个文件变更,396行新增、750行删除。这意味着不仅是功能增强,也有大量代码重构与优化。

二、安装体验全面升级

1. macOS安装逻辑更智能

在scripts/install.sh中,这次更新引入了更智能的逻辑判断。当安装过程中检测到系统中已有正确的符号链接时,脚本将跳过重复创建步骤。也就是说,只有当/usr/local/bin/ollama的符号链接与目标路径不匹配时,脚本才会请求管理员密码进行修复。

更新前,安装脚本无论链接是否正确都会尝试创建符号链接,引发系统密码请求。更新后:

if [ ! -L "/usr/local/bin/ollama" ] || [ "$(readlink "/usr/local/bin/ollama")" != "/Applications/Ollama.app/Contents/Resources/ollama" ]; then

status "Adding 'ollama' command to PATH (may require password)..."

mkdir -p "/usr/local/bin" 2>/dev/null || sudo mkdir -p "/usr/local/bin"

ln -sf "/Applications/Ollama.app/Contents/Resources/ollama" "/usr/local/bin/ollama" 2>/dev/null || \

sudo ln -sf "/Applications/Ollama.app/Contents/Resources/ollama" "/usr/local/bin/ollama"

fi此改动显著提升了便利性,让macOS用户在更新或重新安装ollama时无需频繁输入密码。

2. Windows安装进度可视化

在scripts/install.ps1中,引入了一个突破性的安装体验改进:安装过程可视化进度条。

以前的Windows安装脚本在下载过程中只输出简单的“下载中”文字提示,这对于文件较大的安装包显得信息不足。v0.16.1版本新增了基于下载字节总量的动态进度显示。脚本会计算已下载的字节数并实时更新百分比和进度条,用以展示下载过程。

核心改动如下:

while (($read = $stream.Read($buffer, 0, $buffer.Length)) -gt 0) {

$fileStream.Write($buffer, 0, $read)

$totalRead += $read

if ($totalBytes -gt 0) {

$pct = [math]::Min(100.0, ($totalRead / $totalBytes) * 100)

$filled = [math]::Floor($barWidth * $pct / 100)

$empty = $barWidth - $filled

$bar = ('#' * $filled) + (' ' * $empty)

Write-Host -NoNewline "`r$bar ${pctFmt}%"

}

}安装完成时输出更为清晰:

>>> Install complete. Run 'ollama' from the command line.此外,还在卸载过程中新增了更显眼的提示标识:

>>> Ollama has been uninstalled.

>>> Launching uninstaller...这样的细节优化让整个安装与维护周期更加用户友好。

三、模型配置层面深化调整

在cmd/config/integrations.go与cmd/config/integrations_test.go中,这次更新带来了显著的模型推荐机制调整与云模型参数重构。

1. 新增推荐模型:minimax-m2.5

v0.16.1版本引入了一个新的推荐云模型minimax-m2.5:cloud。

配置中明确描述其特性:

{Name: "minimax-m2.5:cloud", Description: "Fast, efficient coding and real-world productivity", Recommended: true},该模型被提升为首位推荐模型,位于模型建议列表最前端。新的推荐模型顺序如下:

minimax-m2.5:cloud

glm-5:cloud

kimi-k2.5:cloud

glm-4.7-flash

qwen3:8b顺序调整让“高效编码与真实生产力”的云模型成为默认首选。

2. 云模型限制重新定义

文件中更新了cloudModelLimits映射,为多个云模型指定上下文与输出的最大token限制值:

"minimax-m2.5": {Context: 204800, Output: 128000},

"glm-4.7": {Context: 202752, Output: 131072},

"kimi-k2.5": {Context: 262144, Output: 262144},

"qwen3-coder-next": {Context: 262144, Output: 32768},此更新让模型的加载与运行更加精确,不再依赖硬编码默认配置。

3. 推荐模型显式标注“未下载”状态

在模型列表生成逻辑中,原描述后缀由install?改为(not downloaded),更符合直觉:

items[i].Description = strings.Join(parts, ", ")替换前是“install?”,替换后则更明确地表示模型未在本地安装。

在测试文件integrations_test.go中,所有相关校验逻辑同步调整。

四、文档重写与开发者体验优化

1. 快速入门文档全面重构

docs/quickstart.mdx做了大量改动,从结构到内容均作了浓缩与升级。

旧版文档以分语言说明命令为主;新版本在简化入口的同时添加了终端操作快捷说明。现在只需一句命令:

ollama即可开启交互菜单。

新内容明确了按键操作提示:

- •

↑/↓导航选项 - •

Enter启动模型 - •

→切换模型 - •

Esc退出菜单

并在下方展示了菜单功能概览:

- Run a model:启动交互对话

- Launch tools:包括 Claude Code、Codex、OpenClaw 等

- Additional integrations:更多功能入口2. 代码工具部分更新

针对编程场景,文档推荐使用glm-4.7-flash作为本地模型,并补充了详细环境要求说明:

需要约23GB显存,支持64,000 tokens上下文长度。在云端使用时,则推荐glm-4.7:cloud以获得完整上下文支持:

ollama pull glm-4.7:cloud

ollama launch codex还新增或更新了ollama launch的应用场景示例,用于快速启动诸如opencode、claude等集成工具。

3. 集成工具列表优化

当前支持的集成包括:

- • OpenCode:开源编程助手

- • Claude Code:智能代码理解与生成工具

- • Codex:代码生成与调试支持

- • Droid:AI代理式编程助手

4. API接口说明更新

在新版文档中,增加了通过API直接启动模型及配置的示例:

ollama launch claude --model glm-4.7-flash

curl http://localhost:11434/api/chat -d '{

"model": "gemma3",

"messages": [{ "role": "user", "content": "Hello!" }]

}'还补充了配置模式启动说明:

ollama launch claude --config这为开发者提供更灵活的启动方式和集成选项。

五、图像生成与加载控制优化

在x/imagegen/server.go中,更新重点落在模型加载等待逻辑上。

旧逻辑固定设定两分钟超时:

timeout := time.After(2 * time.Minute)新版本改为可通过环境变量动态控制:

timeout := time.After(envconfig.LoadTimeout())也就是说,开发者可通过调整环境变量OLLAMA_LOAD_TIMEOUT来自定义加载超时时间,提升灵活性,方便在使用大型模型或复杂图像生成任务时进行性能调优。

六、性能与稳定性提升总结

v0.16.1是一次兼顾用户体验优化与底层性能增强的版本,既保证了开发者更易于操作,也确保用户感知到更顺畅的运行体验。

主要技术亮点回顾:

- 1. 安装体验全面优化

- • macOS安装仅在需要时请求密码。

- • Windows安装新增实时进度条。

- 2. 模型系统更智能

- • 新增minimax-m2.5作为首选推荐云模型。

- • 推荐模型标注“(not downloaded)”状态。

- • 云模型token限制范围更合理。

- 3. 文档体验再升级

- • 快速入门文档更直观。

- • 工具与API示例更全面。

- • 支持更丰富的集成助手。

- 4. 图像生成模块可配置

- • 通过

OLLAMA_LOAD_TIMEOUT灵活控制加载时间。

- • 通过

七、结语:ollama的稳健迭代之道

代码地址:github.com/ollama/ollama

从这一版本可以看出,ollama团队正在持续沿着“本地与云端智能模型统一平台”的方向精进:让安装更无感、模型管理更透明、开发集成更方便、性能参数更可控。

·

我们相信人工智能为普通人提供了一种“增强工具”,并致力于分享全方位的AI知识。在这里,您可以找到最新的AI科普文章、工具评测、提升效率的秘籍以及行业洞察。 欢迎关注“福大大架构师每日一题”,发消息可获得面试资料,让AI助力您的未来发展。

·

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-13,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录