从 TRTC 到 AIGC:探索实时音视频场景下的 AI 纹理重构与修复技术

原创从 TRTC 到 AIGC:探索实时音视频场景下的 AI 纹理重构与修复技术

原创用户10616867

发布于 2026-03-03 17:41:05

发布于 2026-03-03 17:41:05

在 UGC 短视频、直播回放、在线教育等音视频场景中,用户上传内容的质量参差不齐,复杂背景水印、压缩损伤与局部纹理异常成为常见问题。传统基于像素级修补的视频处理方法,在高分辨率与高频纹理区域往往产生明显的平滑痕迹,影响整体观看体验。

随着 AIGC 视频生成能力的提升,视频后处理逐渐成为新的瓶颈。如何在实时或准实时音视频场景中,构建兼顾画质与吞吐能力的生成式修复方案,是本文探讨的核心问题。

一、实时音视频场景的新挑战

在 TRTC 实时互动、短视频 UGC、在线教育、直播回放等场景中,视频质量已经成为核心体验指标。

但在实际业务中,我们常常遇到:

- 用户上传视频带有复杂背景水印

- 多次转码后画质损伤严重

- AIGC 生成视频局部纹理不稳定

- 高频细节区域出现修补痕迹

传统修补方法(模糊填充、邻域插值)在低分辨率时代尚可接受,但在 1080p / 2K 场景下,这类算法往往破坏纹理统计结构,导致:

- 修复区域发虚

- 细节丢失

- 连续播放闪烁

在音视频平台中,这种“修过”的痕迹非常明显。

二、从像素修补到生成式纹理重构

传统 Inpainting 的核心逻辑是:“用邻域像素填补缺失区域”。但扩散模型生成的视频具有丰富的高频纹理特征,例如:

- 衣物褶皱

- 头发边缘

- 木纹细节

- 背景虚化

当使用平滑算法修补这些区域时,本质上是在破坏纹理分布。

生成式重构的核心思想是:

对局部区域进行条件再生成,而非简单填补。

关键技术点包括:

- 引入前后帧特征

- 建立时间一致性约束

- 使用 GPU 推理优化

图 1:高频纹理区域生成效果与传统修补对比示意

高频纹理区域在传统 Inpainting 修补与生成式重构方案下的效果对比。生成式方法在细节保留与纹理连续性方面表现更稳定。

三、生成式重构实践:工程化验证

在实时音视频场景中,我们将扩散式生成模型引入视频去水印与纹理修复流程,并进行了工程化部署验证。

核心优化包括:

- 滑动窗口重叠推理

- 时间一致性损失约束

- GPU 显存调度优化

在实际测试中,我们重点关注:

- 高频纹理是否被真实重建

- 修复区域是否出现时间漂移

- 连续播放是否产生闪烁

针对生成视频与复杂背景水印场景,我们进行了多组实验对比。相关对比结果见 视频去水印实验示例(Sora 场景)

,用于展示扩散模型在视频去水印场景下的纹理重构表现,用于验证生成式修复在真实场景中的可行性。

四、结合腾讯云的音视频解决方案架构

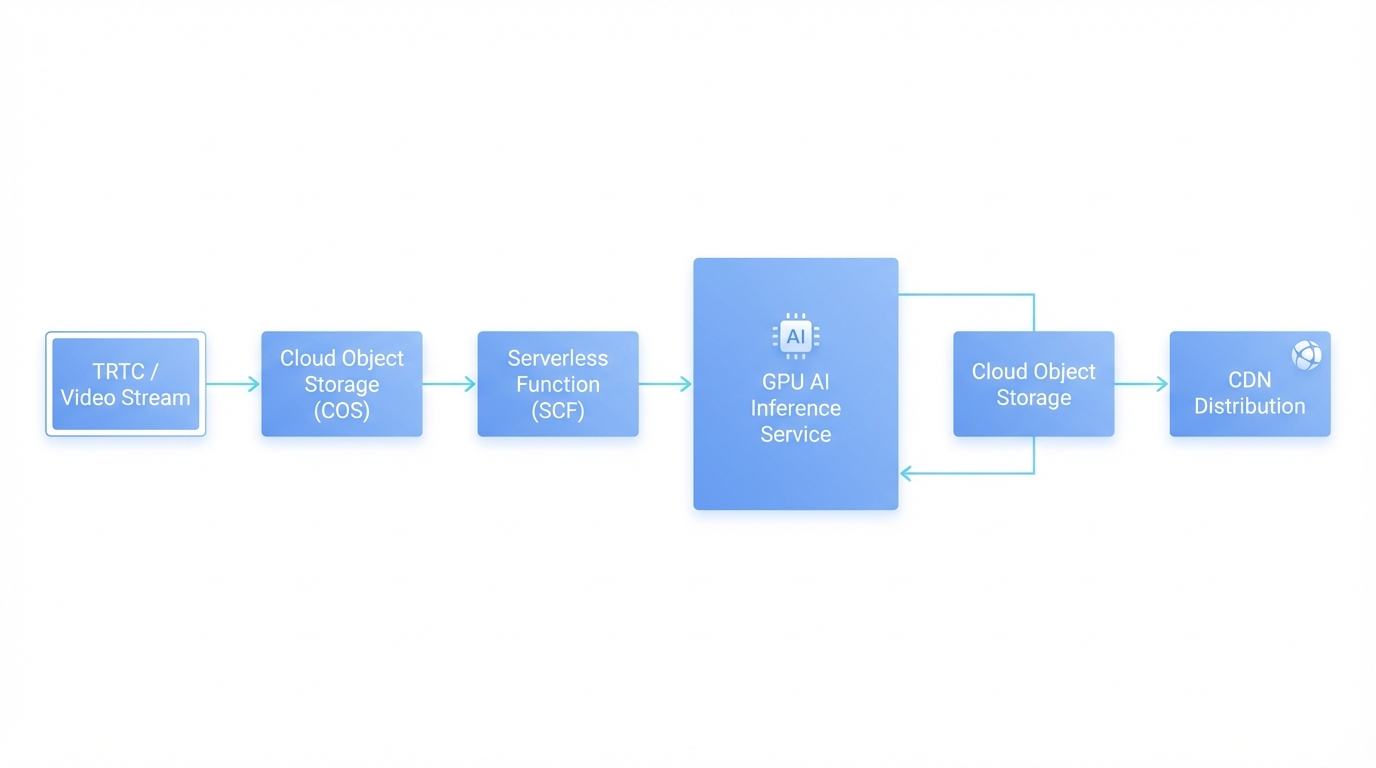

在腾讯云生态下,可以构建如下处理流水线:

TRTC / VOD 视频流

→ COS 对象存储

→ SCF 触发任务

→ GPU 推理服务(生成式修复模型)

→ 结果回写 COS

→ CDN 分发

图 2:基于 TRTC + COS + SCF + GPU 推理的音视频修复架构

基于 TRTC / VOD、COS、SCF 与 GPU 推理服务构建的音视频生成式修复处理架构示意图

架构优势

TRTC / VOD

支持实时与存储视频场景。

COS

统一视频素材管理。

SCF

按需触发,降低资源浪费。

GPU 推理服务

支持高吞吐并发修复任务。

该架构具备:

- 弹性扩展能力

- 按需计费

- 低延迟响应

五、滑动窗口与时间一致性优化

在准实时场景中,完整视频通常采用重叠窗口处理:

- Frame 0–10

- Frame 5–15

- Frame 10–20

通过重叠区域校正时间一致性。

同时结合:

- 光流引导

- 时空注意力机制

- Temporal Loss 优化

可以显著减少闪烁问题。

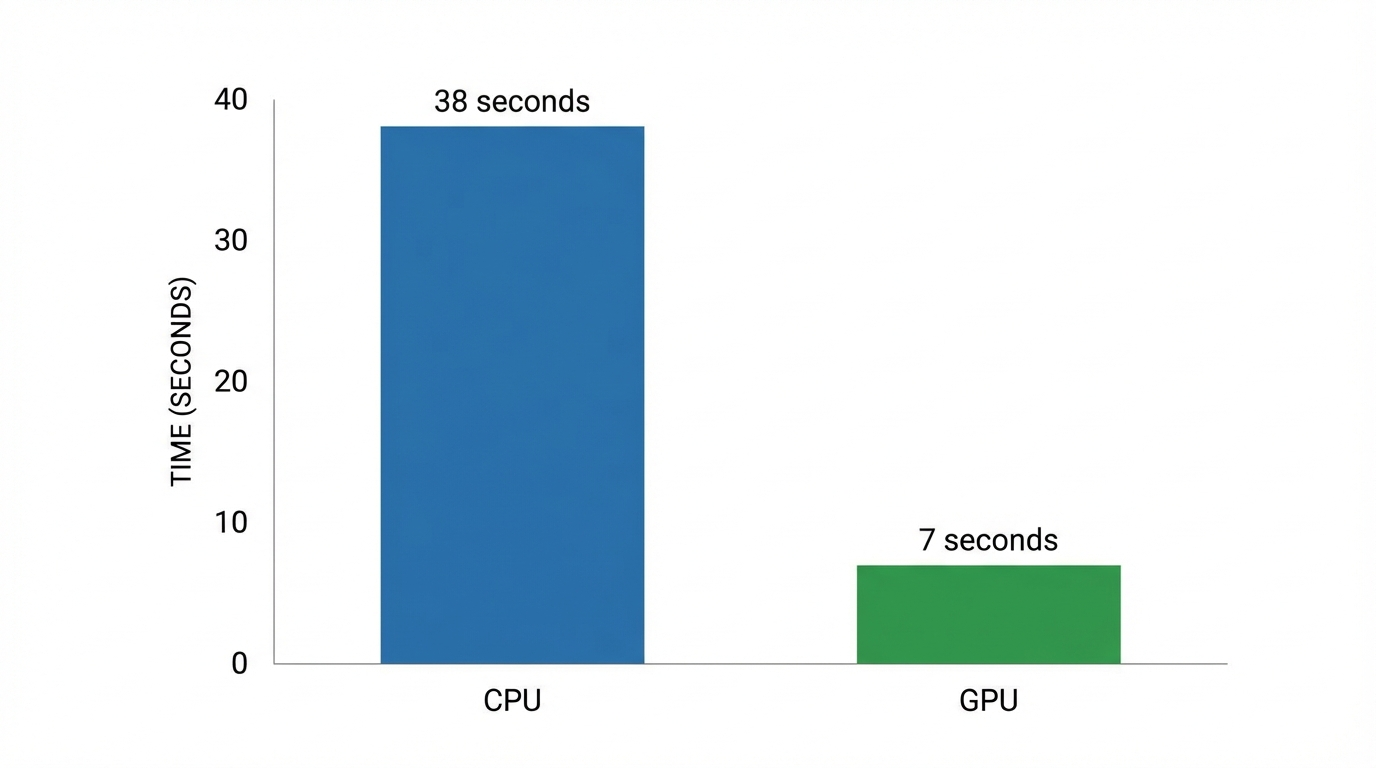

六、性能对比与可行性分析

测试环境:

- GPU 实例(T4)

- 视频规格:1080p / 30fps / 10秒

对比结果如下:

传统 CPU 修补:

- 单视频处理时间:约 35–40 秒

- 高频纹理损失明显

生成式 GPU 修复:

- 单视频处理时间:约 6–8 秒

- 纹理保留度显著提升

- 连续播放更稳定

图 3:CPU 与 GPU 推理时间柱状对比图

CPU 传统修补算法与 GPU 生成式修复在单视频处理时间上的对比。GPU 推理在吞吐能力方面具有明显优势

在准实时批量场景下,GPU 生成式修复可以显著提升整体吞吐能力。

七、业务价值与未来方向

在短视频平台、在线教育、直播回放等场景中,生成式纹理修复可带来:

- 提升 UGC 视频质量

- 减少人工审核成本

- 提高用户停留时长

- 改善分发算法效果

未来趋势包括:

- 轻量模型端侧部署

- 小程序视频增强

- 实时流式修复优化

从 TRTC 到 AIGC,视频处理正在从“流畅优先”迈向“画质优先”。

结语

随着生成式 AI 技术成熟,视频修复能力正在从辅助模块转变为核心生产能力。

通过结合腾讯云音视频能力与生成式纹理重构技术,可以构建高质量、可扩展的音视频修复流水线,为实时互动与 UGC 场景提供更稳定的视觉体验。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录