腾讯混元新研究:瞄准强化学习“工程深水区”

腾讯混元新研究:瞄准强化学习“工程深水区”

小腾资讯君

发布于 2026-03-02 09:00:37

发布于 2026-03-02 09:00:37

本文来自腾讯混元研究博客(HY Research),是继 《从上下文学习远比我们想象的更难》(Learning from context is harder than we thought)之后的第二篇公开研究。在这篇文章里,混元团队将对大模型强化学习中的“工程深水区”展开探索,希望通过一系列提升RLVR(可验证奖励的强化学习)训练细粒度可观测性的基础设施工具,降低RLVR底层物理和统计机理研究的“工程壁垒”。

这篇博客提出了异常梯度定位器GradLoc,可以将全局Gradient Spike定位到具体出现问题的token上,助力系统性解决强化学习中训练不稳定的问题,让开发者不再依赖直觉试错,而是基于确凿的数据证据进行“确定性”的算法迭代。

GradLoc正在让RLVR 的模型调优逐渐告别“玄学”,变得更加科学。

- 英文博客:https://hy.tencent.com/research/100015?langVersion=en

- 中文博客:https://hy.tencent.com/research/100015?langVersion=zh

- Github仓库:https://github.com/Tencent-Hunyuan/GradLoc

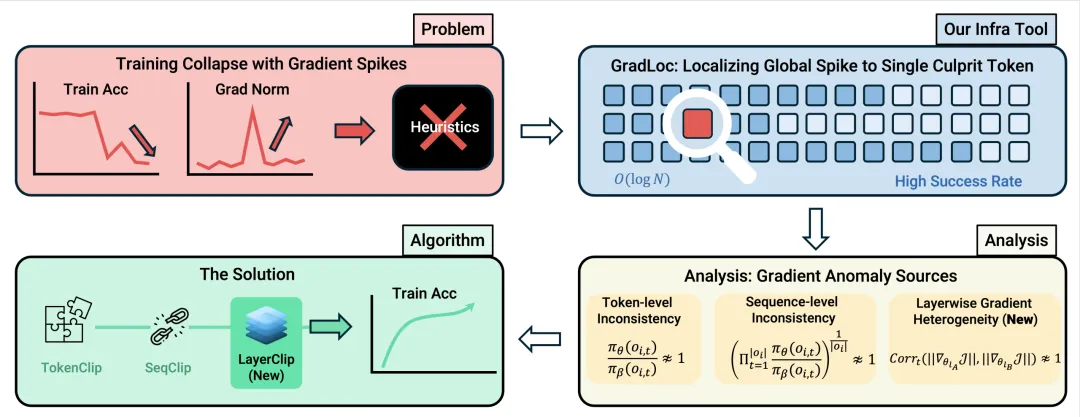

图片

图 : 从黑盒启发式策略到白盒诊断的 RLVR 崩溃分析框架。

大模型强化学习的“工程深水区”

如果说 2024 年前的大模型竞争焦点在预训练(Pre-training),那么 2025 年的主战场已彻底转向后训练阶段。通过利用数学、代码等领域的可验证结果作为反馈信号这一方法,也叫可验证奖励的强化学习(RLVR),大模型正在实现推理能力的显著跃升。然而,尽管算法层面的探索百花齐放,RLVR 的落地却面临着极高的工程门槛。

相比预训练阶段相对成熟的工程链路,大规模 RLVR 训练为了追求极致的效率,引入了大量近似计算。这使得 RLVR 本质上演变成了一个高噪声的复杂动态系统:数据分布与模型参数互为因果,任何微小的近似误差都可能在迭代中被放大,导致对训练动态的分析与理解变得异常困难。

这种系统级的复杂性,构建了一道难以逾越的“分析壁垒”。目前,大量优秀的底层机理研究设想往往因为无法越过工程壁垒、无法有效定位问题根源而被迫搁置。这并非因为这些设想本身有误,而是因为研究者缺乏能够剖析这一复杂系统的观测工具。

因此,腾讯混元这项工作的核心意图并非单纯输出一个算法,而是致力于提供一套可观测的基础设施工具,希望通过大幅降低对 RLVR 训练动态的观测与分析门槛,助力开发者突破工程黑盒,对 RLVR 的训练动态进行更系统的理解与分析。

让RL训练调优从“玄学”回归科学

训练崩溃(Training Collapse)是RLVR训练的重要挑战,在实际训练中,这往往表现为模型准确率的断崖式下跌,同时伴随着监控面板上的“梯度突刺”(Gradient Spikes),对异常梯度的排查往往令研发人员头大。

行业内普遍采用的排查范式具有很强的“黑盒”特征:研究员只能对着grad_norm曲线等全局监控指标进行猜测:是因为学习率设置不当?数据质量低?还是工程上的问题?然后通过实验端到端的验证故障来源;这种排查方式高度依赖专家直觉,不仅验证周期长,时间成本高,而且归因困难,使得算法迭代充满不确定性。

为解决这一痛点,这一研究将问题排查的颗粒度从“全局”推进到了“微观”,推出了异常梯度定位器(Gradient Anomaly Localizer, GradLoc),将全局梯度突刺定位到具体异常token。

GradLoc 的引入,相当于为 RLVR 训练系统配备了一台精密诊断设备。过去,我们在缺乏观测工具时,就像一位没有精密仪器的内科医生,只能面对病人“高烧”(Gradient Spikes)这一表象,凭经验猜测病因是“细菌感染”还是“免疫系统问题”(猜测是脏数据干扰还是训推不一致),并尝试进行宽泛的干预。而 GradLoc 就像是一次“全身核磁共振”,它能够穿透复杂的系统表象,直接定位病灶。

借助 GradLoc,我们不再模棱两可地将失败归因于“训练不稳定”或“运气不好”,而是能给出极具确定性的工程诊断:

“训练崩溃的根源,是 Batch中第2个序列的第 5 个 Token,在经过模型第 32 层梯度反向传播时,产生了数值异常。”

这让开发者不再依赖直觉试错,而是基于确凿的数据证据进行算法迭代。这标志着 RLVR 的模型调优正在告别“玄学”,回归严谨的“科学”范畴。

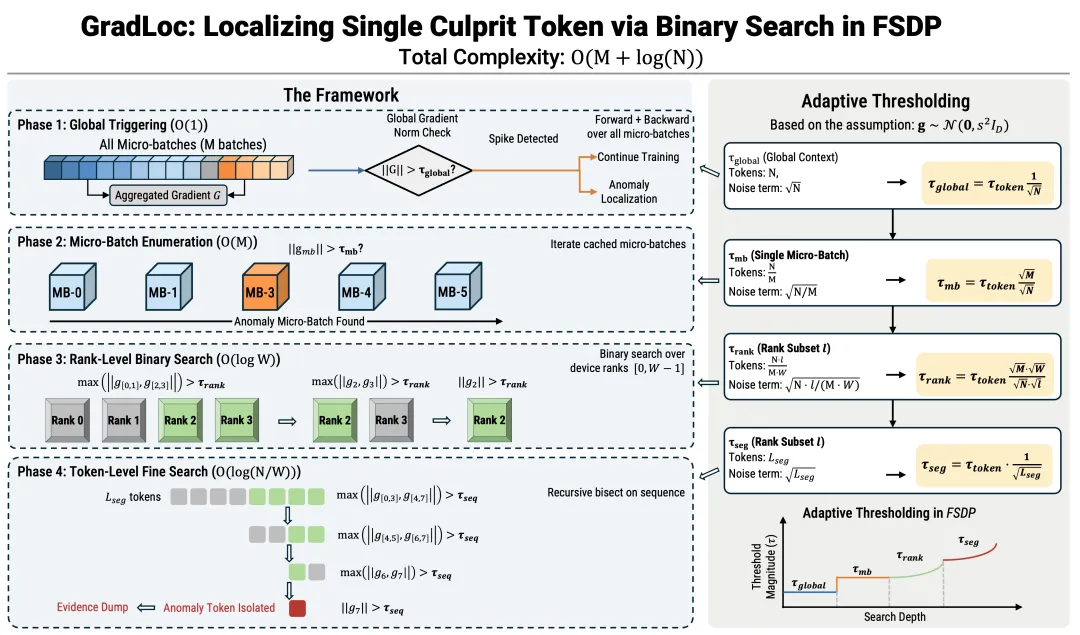

GradLoc:将全局梯度突刺定位到具体异常token

当RLVR训练发生崩溃时,研究者面对的是一系列复杂计算得到的加总结果:数万个 Token 构成的长序列,经过深层神经网络的复杂非线性变换,最终汇聚成一个失控的梯度突刺(Gradient Spike)。

在现有的训练框架中,梯度是通过全局的前向-反向(forward-backward)计算获得的,而框架并未存储单个 Token 的梯度信息。若要追溯异常,全量遍历排查 Batch 中数以千万计的 Token意味着不可接受的算力成本——仅仅排查一个 Step 的异常,就需要消耗相当于数万个 Step 的常规训练时间。

为此,GradLoc 深度适配了分布式计算框架,引入二分搜索(Binary Search)策略。这一策略将排查复杂度从线性降低至对数级,从而实现了从全局 Batch 到具体异常 Token 的高效定位。

图片

(图注:GradLoc 在分布式计算的不同层级(全局 -> Micro-Batch -> Rank -> Token)进行二分定位)

在实际诊断中,我们往往不需要找出所有的异常 token,只要锁定贡献最大/较大的“罪魁祸首”即可归纳出系统性问题。GradLoc 采用了贪心策略:在搜索过程中,优先追踪梯度范数最大的一侧分支。GradLoc将朴素二分改进为深度优先搜索(DFS)机制,能够在几乎不增加额外耗时的前提下,在异常token附近回溯,同时定位出多个其他异常 token,以支持对异常来源的充分归因。

为了适应分布式训练中聚合规模的动态变化(从 Global 到 Micro-Batch 再到 Token),GradLoc 结合梯度向量的统计特性,推导并应用了一套自适应阈值。这一机制能动态调整检测标准,有效避免了“漏检”(无法定位根源)和“误检”(在正常训练步触发检测),从而最大限度地节省算力。

虽然 GradLoc 的介入会使异常 Step 的耗时增加 1-3 倍,但它仅在检测到梯度突刺时触发(Always-on but Dormant)。对于长周期的 RLVR 训练而言,这种“按需启动”的特性使得摊销后的额外开销微乎其微。

具体性能数据如下表所示:

图片

此外,一个常见的理论担忧是:在Token数量极多的Batch中,累积的噪声是否会掩盖单个 Token 的异常信号,导致二分搜索失效?理论分析表明,大语言模型极高的参数维度效保证了 GradLoc在海量数据中定位单个异常的成功率。

关于 GradLoc 的实现细节、理论分析及代码,请参考技术博客和 GitHub 仓库。

借助 GradLoc 系统排查:从“训推不一致”到“层间梯度异质性”

有了 GradLoc,我们不再孤立地依据一两次随机实验来判断算法优劣,而是建立起了“实时定位 -> 异常归因 -> 针对性解决”的系统化迭代闭环。

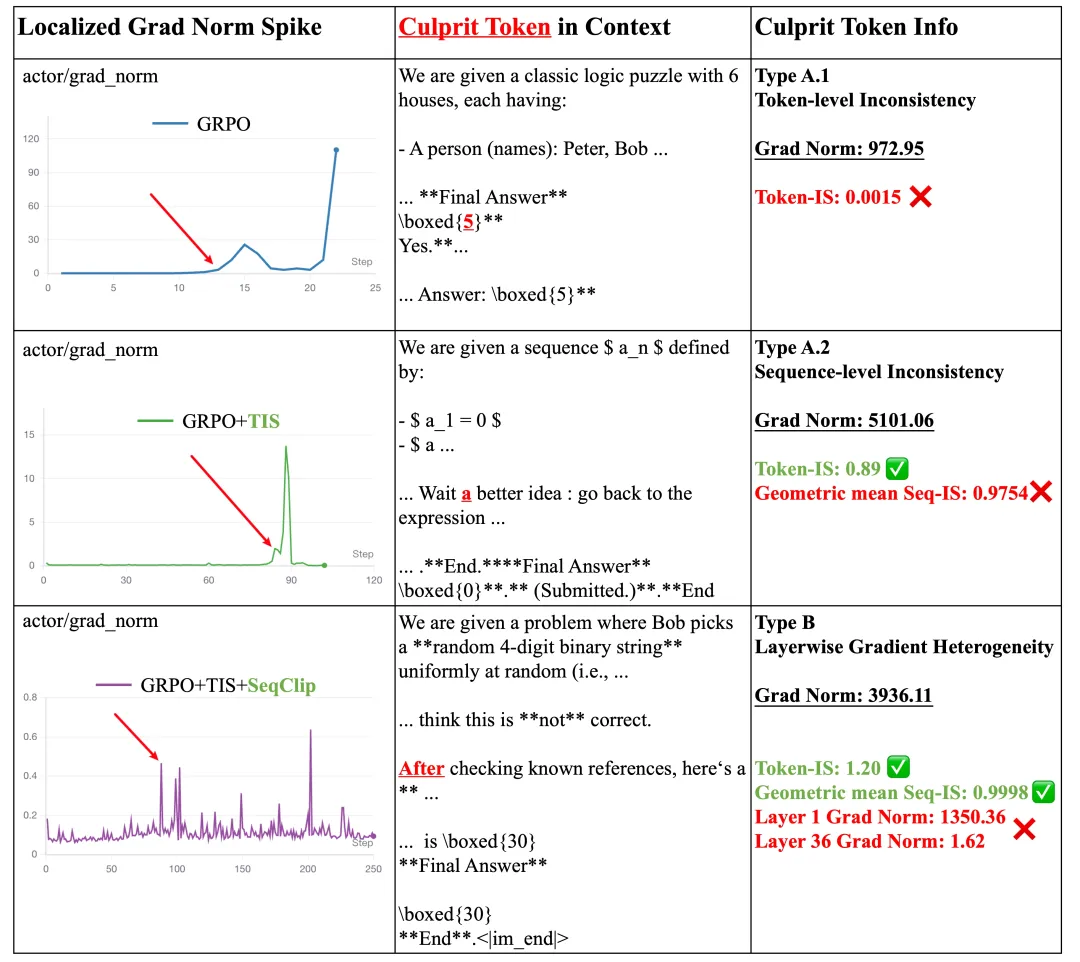

如下图所示,我们基于 Qwen3-4B-Instruct 模型,从标准的 GRPO 算法出发,利用 GradLoc 像剥洋葱一样逐层揭开导致训练崩溃的真相。

图片

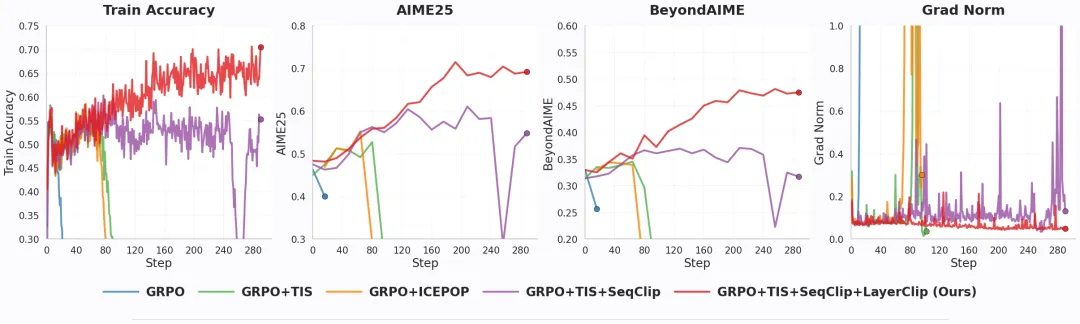

通过GradLoc,我们依次定位到“词元(Token)级训练-推理不一致”、“序列级训练-推理不一致”、“层间梯度异质性”三类异常Token,别分别针对性使用TokenClip、SeqClip、LayerClip针对性处理了这三类异常。实验表明,这些针对性措施的应用,有效逐步提升了训练的稳定性。

图片

总结与展望:构建Infra工具指导算法研发的协同范式

1、坚信确定性带来的效率复利

在工业级的大模型训练中,稳定性即是最大的生产力。

由于模型架构、数据分布、预训练状态以及冷启动策略的巨大差异,RLVR 训练往往呈现出极高的不确定性,导致很多算法改进和认知无法泛化。GradLoc 的价值在于,它作为一个高成功率的基础设施(Infra)工具,以极低的成本实现了对任意 RLVR 训练异常的标准化排查。

通过将模糊的“训练失败”精确定位到具体的“异常 Token”,并据此设计针对性解决方案,腾讯混元这项研究将异常排查的时间成本从“周”降低到了“小时”。这种工程上的确定性,将为算法迭代带来巨大的效率复利。

2、让异常梯度定位像查看 Loss 曲线一样简单

当前,大模型强化学习仍面临着过高的“工程门槛”。由于缺乏有效的微观观测工具,大量具有潜力的理论探索往往受阻于复杂的工程调试,难以落地。

为此,腾讯混元还将持续迭代并开源 GradLoc 这类白盒分析工具,希望让“异常梯度定位”成为像“查看 Loss 曲线”一样触手可及的基础能力。

当底层机制的观测门槛被大幅降低,整个社区将不再被工程黑盒所束缚,从而能够突破现有的经验主义限制,在理论与应用的结合点上进行更深层的探索。

3、展望未来:探索训练动态的底层原理

虽然本次研究提出的 LayerClip 成功将梯度异常限制在了层内,显著提升了训练稳定性,但它本质上仍是一种“缓解手段”,并未从源头消除层间梯度异质性。

然而,GradLoc 揭示的“层间梯度异质性”现象,作为一类有确凿数据支撑的新发现,极可能指向了大模型训练中尚未被充分理解的底层物理与统计机理。

在未来,深入研究这些底层机理将是至关重要的一步。它将指导我们超越单纯的“梯度裁剪”,从数学原理层面设计出更鲁棒、更高效的优化算法。

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录