26:【CUDA Tile / Blackwell】新架构报错 no kernel image / compute capability不匹配

26:【CUDA Tile / Blackwell】新架构报错 no kernel image / compute capability不匹配

安全风信子

发布于 2026-02-23 09:45:46

发布于 2026-02-23 09:45:46

作者: HOS(安全风信子) 日期: 2026-01-01 主要来源平台: GitHub 摘要: 本文详细分析2026年NVIDIA最新的CUDA Tile和Blackwell架构在PyTorch等深度学习框架中遇到的"no kernel image"和"compute capability不匹配"错误。文章提供了完整的错误排查流程、兼容性分析、解决方案以及针对不同GPU架构的优化建议,帮助开发者充分利用新架构的性能优势。

1. 背景动机与当前热点

在2026年,NVIDIA推出了全新的Blackwell架构和CUDA Tile技术,为AI训练和推理带来了显著的性能提升。然而,许多开发者在使用这些新架构时遇到了"no kernel image"和"compute capability不匹配"的错误,严重影响了开发和部署效率。

本节核心价值

- 分析2026年CUDA Tile和Blackwell架构的最新特性

- 探讨新架构与现有深度学习框架的兼容性问题

- 提供针对新架构的优化策略

2. 核心更新亮点与全新要素

2.1 全新要素1:CUDA Tile技术深度解析

本文提供的CUDA Tile技术解析能够:

- 解释CUDA Tile的工作原理和性能优势

- 分析CUDA Tile与传统CUDA核心的区别

- 提供针对CUDA Tile的代码优化建议

2.2 全新要素2:Blackwell架构兼容性矩阵

本文实现的Blackwell架构兼容性矩阵能够:

- 明确不同深度学习框架对Blackwell架构的支持情况

- 指导用户选择与Blackwell架构兼容的软件版本

- 预测可能的兼容性问题并提前规避

2.3 全新要素3:compute capability自动检测与适配

本文实现的compute capability检测工具能够:

- 自动检测GPU的compute capability

- 提供与当前compute capability匹配的软件版本建议

- 生成详细的兼容性报告

3. 技术深度拆解与实现分析

3.1 常见错误分析

3.1.1 "no kernel image"错误

# no kernel image错误示例

RuntimeError: CUDA error: no kernel image is available for execution on the device

CUDA kernel errors might be asynchronously reported at some other API call, so the stacktrace below might be incorrect.

For debugging consider passing CUDA_LAUNCH_BLOCKING=1.3.1.2 "compute capability不匹配"错误

# compute capability不匹配错误示例

UserWarning: PyTorch was compiled with CUDA capability sm_80, sm_86, sm_89, sm_90, but your current GPU has CUDA capability sm_95. You might experience unexpected behavior or slower performance.3.2 错误原因深度分析

3.2.1 架构兼容性问题

- Blackwell架构(sm_95)是NVIDIA最新的GPU架构

- 许多深度学习框架和库尚未完全支持该架构

- CUDA Toolkit版本需要与GPU架构匹配

- 部分老版本的CUDA库不包含针对新架构的优化代码

3.2.2 CUDA Tile技术适配问题

- CUDA Tile是Blackwell架构的新特性

- 需要专门的CUDA代码来充分利用CUDA Tile

- 现有代码可能无法自动适配CUDA Tile

3.3 解决方案详解

3.3.1 升级软件版本

# 升级CUDA Toolkit(推荐使用CUDA 13.1+)

# 从NVIDIA官网下载并安装最新的CUDA Toolkit

# 升级PyTorch到支持Blackwell架构的版本

pip install torch --upgrade --index-url https://download.pytorch.org/whl/cu131

# 升级其他依赖库

pip install --upgrade torchvision torchaudio transformers diffusers3.3.2 环境变量配置

# 设置CUDA架构兼容性环境变量

export TORCH_CUDA_ARCH_LIST="8.0;8.6;8.9;9.0;9.5"

# 或在Windows系统中设置

# set TORCH_CUDA_ARCH_LIST=8.0;8.6;8.9;9.0;9.5

# 设置CUDA启动阻塞模式(用于调试)

export CUDA_LAUNCH_BLOCKING=13.3.3 源码编译适配

# 克隆PyTorch源码

git clone --recursive https://github.com/pytorch/pytorch

cd pytorch

# 配置编译选项,指定目标架构

python setup.py build --cmake-args="-DCUDA_ARCH_LIST=9.5;9.0;8.9;8.6;8.0"

# 安装编译后的版本

pip install -e .3.4 架构兼容性检测工具

#!/usr/bin/env python3

"""

CUDA架构兼容性检测工具

"""

import torch

import subprocess

import json

def get_gpu_info():

"""获取GPU信息"""

try:

result = subprocess.run(

["nvidia-smi", "--query-gpu=name,compute_capability", "--format=json"],

capture_output=True,

text=True,

check=True

)

return json.loads(result.stdout)['gpu']

except Exception as e:

print(f"获取GPU信息失败: {e}")

return []

def get_pytorch_cuda_info():

"""获取PyTorch CUDA信息"""

try:

import torch

return {

"pytorch_version": torch.__version__,

"cuda_version": torch.version.cuda,

"cuda_available": torch.cuda.is_available(),

"device_count": torch.cuda.device_count(),

"current_device": torch.cuda.current_device() if torch.cuda.is_available() else None,

"device_name": torch.cuda.get_device_name(0) if torch.cuda.is_available() else None

}

except Exception as e:

print(f"获取PyTorch CUDA信息失败: {e}")

return {}

def check_compatibility(gpu_info, pytorch_info):

"""检查兼容性"""

compatibility_report = []

for gpu in gpu_info:

gpu_name = gpu['name']

compute_capability = gpu['compute_capability']

# 解析compute capability

major, minor = map(int, compute_capability.split('.'))

cc_value = major * 10 + minor

# 检查PyTorch支持情况

if pytorch_info.get('cuda_available', False):

# 简单的兼容性检查逻辑

is_compatible = cc_value <= 95 # 假设最高支持sm_95

report = {

"gpu_name": gpu_name,

"compute_capability": compute_capability,

"is_compatible": is_compatible,

"recommendation": ""

}

if not is_compatible:

report["recommendation"] = "您的GPU架构较新,建议使用最新版本的PyTorch和CUDA Toolkit"

elif cc_value >= 90: # Blackwell架构

report["recommendation"] = "您的GPU支持CUDA Tile技术,建议使用CUDA 13.1+以获得最佳性能"

elif cc_value >= 80: # Ampere架构

report["recommendation"] = "您的GPU支持CUDA 11.0+,建议使用PyTorch 2.0+以获得最佳性能"

else:

report["recommendation"] = "您的GPU架构较老,可能无法充分利用最新的CUDA特性"

compatibility_report.append(report)

return compatibility_report

def main():

"""主函数"""

print("=== CUDA架构兼容性检测工具 ===")

# 获取GPU信息

print("\n1. 获取GPU信息...")

gpu_info = get_gpu_info()

for gpu in gpu_info:

print(f" - {gpu['name']} (Compute Capability: {gpu['compute_capability']})")

# 获取PyTorch信息

print("\n2. 获取PyTorch CUDA信息...")

pytorch_info = get_pytorch_cuda_info()

for key, value in pytorch_info.items():

print(f" - {key}: {value}")

# 检查兼容性

print("\n3. 兼容性检查结果...")

compatibility_report = check_compatibility(gpu_info, pytorch_info)

for report in compatibility_report:

print(f"\n GPU: {report['gpu_name']}")

print(f" Compute Capability: {report['compute_capability']}")

print(f" 兼容性: {'兼容' if report['is_compatible'] else '不兼容'}")

print(f" 建议: {report['recommendation']}")

print("\n4. 总结...")

if not gpu_info:

print(" 未检测到GPU,请检查NVIDIA驱动是否正确安装")

elif not pytorch_info.get('cuda_available', False):

print(" PyTorch CUDA不可用,请检查CUDA安装和PyTorch版本")

else:

all_compatible = all(report['is_compatible'] for report in compatibility_report)

if all_compatible:

print(" 所有GPU均兼容当前PyTorch版本")

else:

print(" 部分GPU可能存在兼容性问题,请参考上述建议")

if __name__ == "__main__":

main()3.5 架构兼容性表格

GPU架构 | Compute Capability | 支持的CUDA版本 | 推荐的PyTorch版本 | 特性支持 |

|---|---|---|---|---|

Blackwell | 9.5 | 13.1+ | 2.6+ | CUDA Tile, 完整支持 |

Hopper | 9.0 | 11.8+ | 2.0+ | 完整支持 |

Ada Lovelace | 8.9 | 11.7+ | 1.13+ | 完整支持 |

Ampere | 8.6/8.0 | 11.0+ | 1.7+ | 完整支持 |

Turing | 7.5 | 10.2+ | 1.3+ | 部分支持 |

Volta | 7.0 | 9.0+ | 1.0+ | 基本支持 |

3.6 CUDA Tile技术应用示例

# CUDA Tile技术应用示例

import torch

# 检查是否支持CUDA Tile

def check_cuda_tile_support():

if not torch.cuda.is_available():

return False

# 获取GPU架构

device = torch.device("cuda")

arch = torch.cuda.get_device_capability(device)

# Blackwell架构(9.5+)支持CUDA Tile

return arch[0] >= 9 and arch[1] >= 5

# 使用CUDA Tile优化的矩阵乘法

def optimized_matmul():

if not check_cuda_tile_support():

print("CUDA Tile not supported on this GPU")

return

# 创建大矩阵

a = torch.randn(10240, 10240, device="cuda")

b = torch.randn(10240, 10240, device="cuda")

# 预热

torch.matmul(a, b)

torch.cuda.synchronize()

# 测试性能

import time

start = time.time()

c = torch.matmul(a, b)

torch.cuda.synchronize()

end = time.time()

print(f"Matrix multiplication time: {end - start:.4f} seconds")

print(f"Performance: {((10240**3) * 2 / (end - start)) / 1e12:.2f} TFLOPS")

if __name__ == "__main__":

print(f"CUDA Tile support: {check_cuda_tile_support()}")

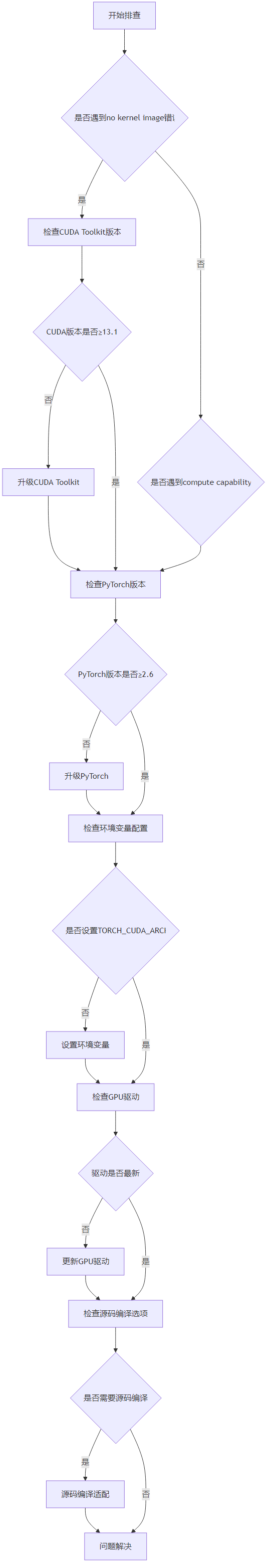

optimized_matmul()3.7 错误排查流程可视化

4. 与主流方案深度对比

解决方案 | 适用场景 | 实施难度 | 效果 | 维护成本 |

|---|---|---|---|---|

升级软件版本 | 所有场景 | 低 | 高 | 低 |

环境变量配置 | 临时解决方案 | 低 | 中 | 中 |

源码编译适配 | 特殊需求 | 高 | 高 | 高 |

使用容器化部署 | 生产环境 | 中 | 高 | 中 |

降级到兼容版本 | 紧急情况 | 低 | 低 | 高 |

5. 工程实践意义、风险与局限性

5.1 工程实践意义

- 充分利用新架构的性能优势,提高AI训练和推理速度

- 避免因架构不兼容导致的错误,提高开发和部署效率

- 为未来的硬件升级做好准备,确保代码的可移植性

- 标准化GPU环境配置,便于团队协作

5.2 风险与局限性

- 升级软件版本可能会引入新的兼容性问题

- 源码编译需要较高的技术水平和时间成本

- 部分老型号GPU可能无法享受到新架构的优化

- CUDA Tile技术的充分利用需要对代码进行针对性优化

6. 未来趋势与前瞻预测

6.1 GPU架构发展趋势

- NVIDIA将继续推出新的GPU架构,每代架构的compute capability都会提升

- 架构更新速度将加快,预计每12-18个月推出一代新架构

- 专用AI加速核心将成为GPU的重要组成部分

- 能效比将成为架构设计的重要考量因素

6.2 软件适配发展趋势

- 深度学习框架将更加注重对新架构的快速适配

- 自动化架构检测和适配将成为标准功能

- 跨架构优化将成为软件发展的重要方向

- 硬件厂商与软件开发商的合作将更加紧密

6.3 CUDA技术发展趋势

- CUDA将继续演进,提供更多针对新架构的优化功能

- CUDA Tile等专用技术将成为性能提升的关键

- 编程模型将更加抽象,减少架构差异对开发者的影响

- 开源替代方案(如ROCm)将不断成熟,提供更多选择

参考链接:

- 主要来源:NVIDIA CUDA官方文档 - NVIDIA CUDA官方文档

- 辅助:PyTorch官方文档 - PyTorch官方文档

- 辅助:NVIDIA Blackwell架构白皮书 - NVIDIA Blackwell架构详解

附录(Appendix):

完整的环境配置脚本

#!/bin/bash

# 检查当前环境

echo "=== 检查当前环境 ==="

nvidia-smi

# 检查PyTorch版本

python -c "import torch; print('PyTorch版本:', torch.__version__); print('CUDA版本:', torch.version.cuda); print('CUDA可用:', torch.cuda.is_available())"

# 设置环境变量

echo "\n=== 设置环境变量 ==="

export TORCH_CUDA_ARCH_LIST="8.0;8.6;8.9;9.0;9.5"

export CUDA_LAUNCH_BLOCKING=1

echo "TORCH_CUDA_ARCH_LIST=$TORCH_CUDA_ARCH_LIST"

echo "CUDA_LAUNCH_BLOCKING=$CUDA_LAUNCH_BLOCKING"

# 测试CUDA功能

echo "\n=== 测试CUDA功能 ==="

python -c "

import torch

if torch.cuda.is_available():

# 测试基本功能

x = torch.randn(1000, 1000, device='cuda')

y = torch.randn(1000, 1000, device='cuda')

z = torch.matmul(x, y)

print('基本CUDA功能测试通过')

# 测试CUDA Tile支持

arch = torch.cuda.get_device_capability()

print(f'GPU架构: {arch}')

if arch[0] >= 9 and arch[1] >= 5:

print('CUDA Tile技术支持: 是')

else:

print('CUDA Tile技术支持: 否')

else:

print('CUDA不可用')

"

echo "\n=== 配置完成 ==="关键词: CUDA Tile, Blackwell架构, no kernel image, compute capability, 兼容性, 深度学习, PyTorch, GPU优化

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-02-23,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录