从0开始全面认识高质量数据集建设(5)

原创从0开始全面认识高质量数据集建设(5)

原创

zhouzhou的奇妙编程

发布于 2026-02-19 14:37:20

发布于 2026-02-19 14:37:20

引言

上一篇中,我们了解了数据工程实施环节的核心全流程,深入掌握了如何通过多样化的采集手段打破数据孤岛,利用智能化的预处理插件清洗多源异构数据,以及通过端到端的标注体系将原始样本转化为高质量的监督学习数据。 然而,经过加工处理的数据资产若要真正服务于业务和模型训练,还必须经过严格的登记与质量检查。只有确保上架数据的规范性与合规性,才能避免“垃圾进,垃圾出”的风险。这一篇,我们将重点了解数据集编目上架、数据集符合性检测这两个关键环节,探讨如何建立最后一道质量闸门,确保交付的数据集真正可信、可用、可管。

数据集编目上架

数据集编目上架是将经过采集、预处理、标注等环节产出的高质量数据资产,进行标准化 “身份登记” 并纳入统一管理的关键环节。它通过多维度信息挂载与结构化分类,让数据从 “零散加工成果” 转变为 “可检索、可理解、可复用” 的标准化资产,为后续的合规检测、开放共享和业务赋能奠定基础。

编目上架的第一步,是建立一套可灵活检索的分类体系,让使用者能够快速定位目标数据集。这套体系支持从多个维度进行筛选与导航:

- 按数据集知识类别:将数据集划分为行业专识数据集和行业通识数据集,明确其知识深度与应用范围,例如公路交通、道路运输、水路交通、城市交通等行业专识类数据,以及支撑行业共性需求的行业通识类数据。

- 按数据模态:根据数据的形态进行划分,如文本、图像、视频等,适配不同类型的 AI 模型与业务场景,例如 “公路病害数据集” 可明确其模态为图像 / 视频,便于视觉类模型快速匹配。

- 按来源单位:关联数据的生产与管理主体,明确数据归属,便于溯源与责任追溯,例如公路交通领域的数据集可关联至对应的业务管理单位。

通过这套多维度分类体系,数据资产不再是杂乱的文件集合,而是形成了层次清晰、逻辑严谨的目录树,使用者可像在图书馆检索书籍一样,快速定位到所需数据。

在完成分类后,需要为每个数据集挂载一套完整的元数据信息,形成其 “数字档案”,确保数据的可理解、可追溯、可管理。这套信息主要分为五大模块:

- 基本信息:作为数据集的 “身份名片”,包含数据集名称、内容介绍、分类分级标签、适用场景、版本历史等核心信息,让使用者快速了解数据的核心价值与应用范围。

- 管理信息:明确数据的 “来处与去处”,包括来源系统、管理单位、业务管理标签、质量检测符合情况等,建立清晰的责任链路与合规依据。

- 生产加工信息:记录数据的 “诞生过程”,涵盖数据构成、加工方式、标注规范等,确保数据生产过程可复现、可审计,为质量追溯提供依据。

- 数据集内容描述:刻画数据的 “内在结构”,包括数据集格式、结构描述、样例数据等,让使用者在未接触原始数据前,就能精准判断其适配性。

- 其他附加信息:补充数据的特殊属性,如敏感等级、共享范围、更新频率等,满足精细化管理与合规管控的需求。

通过这五大模块的信息挂载,每个数据集都拥有了一份完整、透明的数字档案,彻底解决了 “数据是什么、从哪来、怎么用” 的核心问题。

我们再举一个例子,方便大家理解,还是以城市指挥中心大脑为例,我们可以列出数字档案如下:

模块 | 字段 | 示例内容 |

|---|---|---|

基本信息 | 数据集名称 | 城市应急事件融合数据集(V2.0) |

内容介绍 | 整合公安、消防、卫健委、应急管理局等多部门应急相关数据,用于支撑城市应急事件实时融合指挥视图、智能研判预警、多部门协同调度等核心场景。 | |

分类分级 | 行业专识类 / 核心级(敏感) | |

适用场景 | 城市应急事件实时融合指挥视图、应急事件智能研判预警、多部门协同调度 | |

版本历史 | V1.0(2025-12):初始版本,覆盖公安、消防数据; V2.0(2026-02):新增卫健委、应急管理局数据,优化字段结构。 | |

管理信息(来处与去处) | 来源系统 | 公安警情系统、消防接处警系统、120急救调度系统、应急管理局综合平台 |

管理单位 | 城市指挥中心数据管理科 | |

业务管理标签 | 应急指挥、多部门融合、核心业务 | |

质量检测符合情况 | 符合《城市指挥中心高质量数据集目录建设标准》V1.0,关键字段完整率100%,错误率≤0.1%。 | |

生产加工信息(诞生过程) | 数据构成 | 结构化数据(事件ID、事件类型、发生时间、地点、等级、处置状态等)+ 关联多媒体(现场图片、视频片段) |

加工方式 | 实时API采集 → 数据清洗(去重、补全) → 多源关联融合 → 质量校验 | |

标注规范 | 事件类型标签:火灾、交通事故、医疗急救、自然灾害等; 处置状态标签:待处置、处置中、已完成、已复核。 | |

数据集内容描述(内在结构) | 数据集格式 | 结构化:JSON / CSV;多媒体:JPG、MP4 |

结构描述 | 核心字段:事件ID(唯一标识)、事件类型、发生时间、经纬度、事件等级、处置状态、责任单位、关联资源(警车/消防车/救护车)等。 | |

样例数据 | 事件ID:CZ-YJ-20260216001 事件类型:火灾 发生时间:2026-02-16 14:30:00 地点:XX市XX区XX路XX号(北纬30.XX,东经120.XX) 事件等级:2级(重大) | |

其他附加信息(特殊属性) | 敏感等级 | 秘密级(仅对指挥中心核心运维人员、应急处置人员开放) |

共享范围 | 内部共享(指挥中心及协同部门:公安、消防、卫健委、应急管理局) | |

更新频率 | 实时(事件发生即更新)+ 每日全量校验 | |

备注 | 数据包含敏感信息,严禁对外泄露;使用前需通过数据申请审批流程。 |

数据集符合性检测环节

数据集编目上架后,并非直接进入可用状态,还需经过严格的符合性检测,这是保障数据质量、避免 “垃圾进、垃圾出” 的最后一道质量闸门。本环节以《高质量数据集 质量评测规范(征求意见稿)》为指导,从说明文档维度、数据质量维度、模型应用维度三大核心维度,对数据集进行全面体检,确保其满足 AI 模型开发、训练及业务场景的核心要求。

在《高质量数据集 质量评测规范( 征求意见稿) 》中,规范了以下三大检测维度:

- 说明文档维度:要求数据集的说明文档完整,需包含基本信息、内容特征、建设过程及应用说明 等内容。

- 数据质量维度:聚焦数据本身的内在质量,确保数据满足 AI 模型开发和训练的基本要求,是检测的核心环节。

- 模型应用维度:数据集应能有效支撑目标场景人工智能模型的开发和训练。

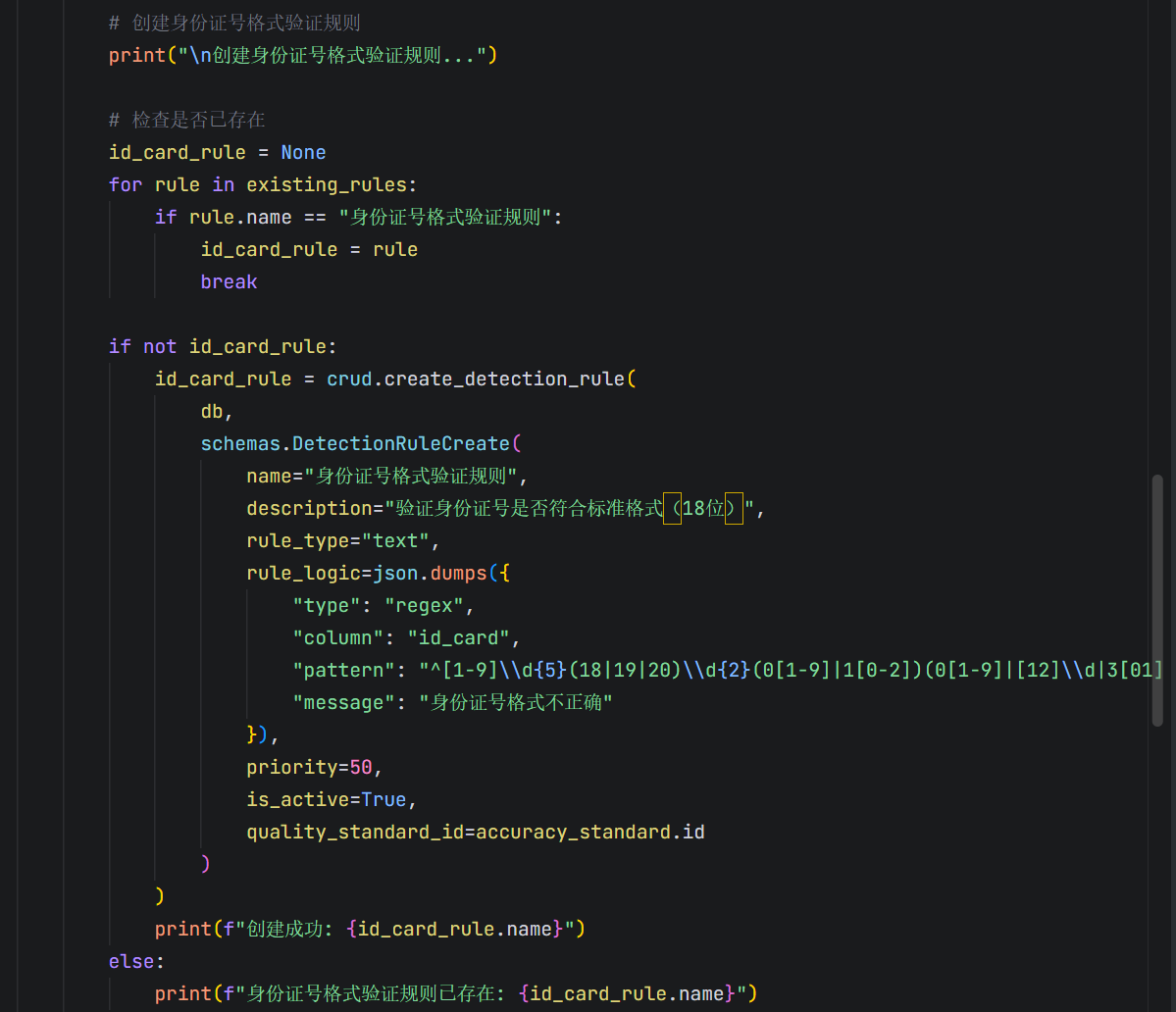

相信大家看到这个表,人都直接麻了,这么多条,人工一条条核对非常的麻烦。为了解决这一痛点,其实是可以引入了智能贯标检查智能体的,将原本繁琐、易出错的人工检测,升级为自动化、智能化的质量管控流程,大幅提升检测效率与准确性。

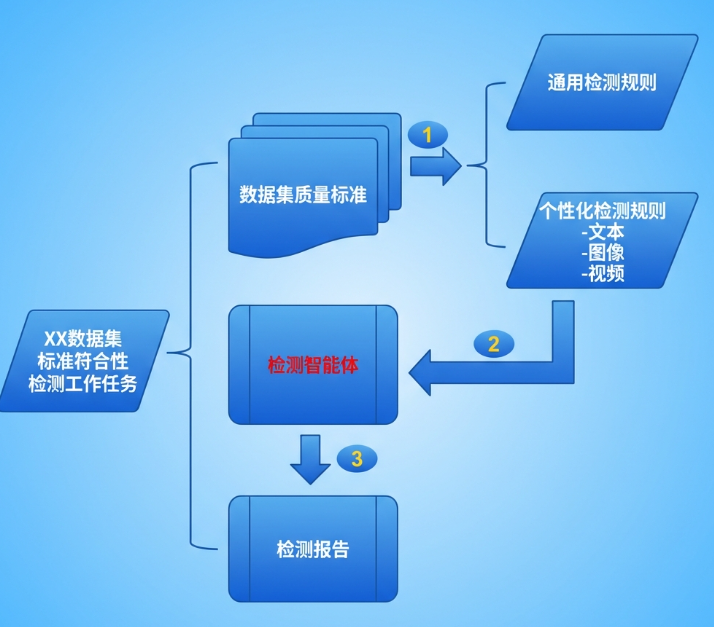

整个框架架构图如下:

智能贯标检查智能体基于清晰的上中下三层架构设计,实现了从数据接入到质量检测、异常识别、智能修复的全流程自动化管理。上层的前端应用层提供直观的可视化界面,用户可通过仪表盘实时监控数据质量状况,快速创建检测任务,配置检测规则,并查看详细的检测报告;中层的后端服务层作为系统核心,集成了强大的规则引擎和AI功能模块,能够自动适配不同类型的数据,执行多维度的质量检测,同时结合异常检测算法识别数据中的异常值、缺失值和无效格式,生成智能修复建议;下层的数据层确保所有检测数据和结果的安全存储与高效检索。

整个智能体的工作流程遵循"数据接入→规则匹配→质量检测→AI异常识别→智能修复建议→结果分析→报告生成"的完整路径,通过API网关实现前后端的高效通信,利用CRUD操作实现与数据库的交互。与传统人工检测相比,智能贯标检查智能体不仅将检测效率提升了数十倍,还大幅降低了人为错误率,能够24小时不间断运行,及时发现和处理数据质量问题。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录