大模型应用:基于 SpeechT5 的自媒体多角色剧情配音系统:架构、细节与实践.20

原创大模型应用:基于 SpeechT5 的自媒体多角色剧情配音系统:架构、细节与实践.20

原创

未闻花名

发布于 2026-02-17 14:48:40

发布于 2026-02-17 14:48:40

一、前言

在现在很多自媒体平台的剧情类短视频创作中,多角色配音是核心环节但痛点显著:真人配音成本高、周期长,通用 TTS 工具缺乏角色区分度,多语言 /多情绪适配性差,且难以批量处理剧本、生成标准化字幕。

今天我们基于SpeechT5 模型构建一套自媒体多角色剧情配音系统,正是针对上述痛点的可落地解决方案。该系统以 SpeechT5 为核心引擎,支持中英文多角色配音,覆盖 “剧本解析→语音合成→音频拼接→字幕生成→项目报告” 全流程,还提供 Web 可视化界面与批量处理能力,完全适配自媒体小团队的配音需求。

系统的核心示例围绕 “校园魔法冒险” 剧情展开:以小明、小红、老师、魔法书等角色构建短剧情,通过不同音色(青年男 / 女、中年女)、语速、音调的定制化合成,搭配音效 / 停顿指令,生成完整的剧情音频,并自动输出 SRT/ASS 字幕与项目报告,直接适配短视频制作流程。

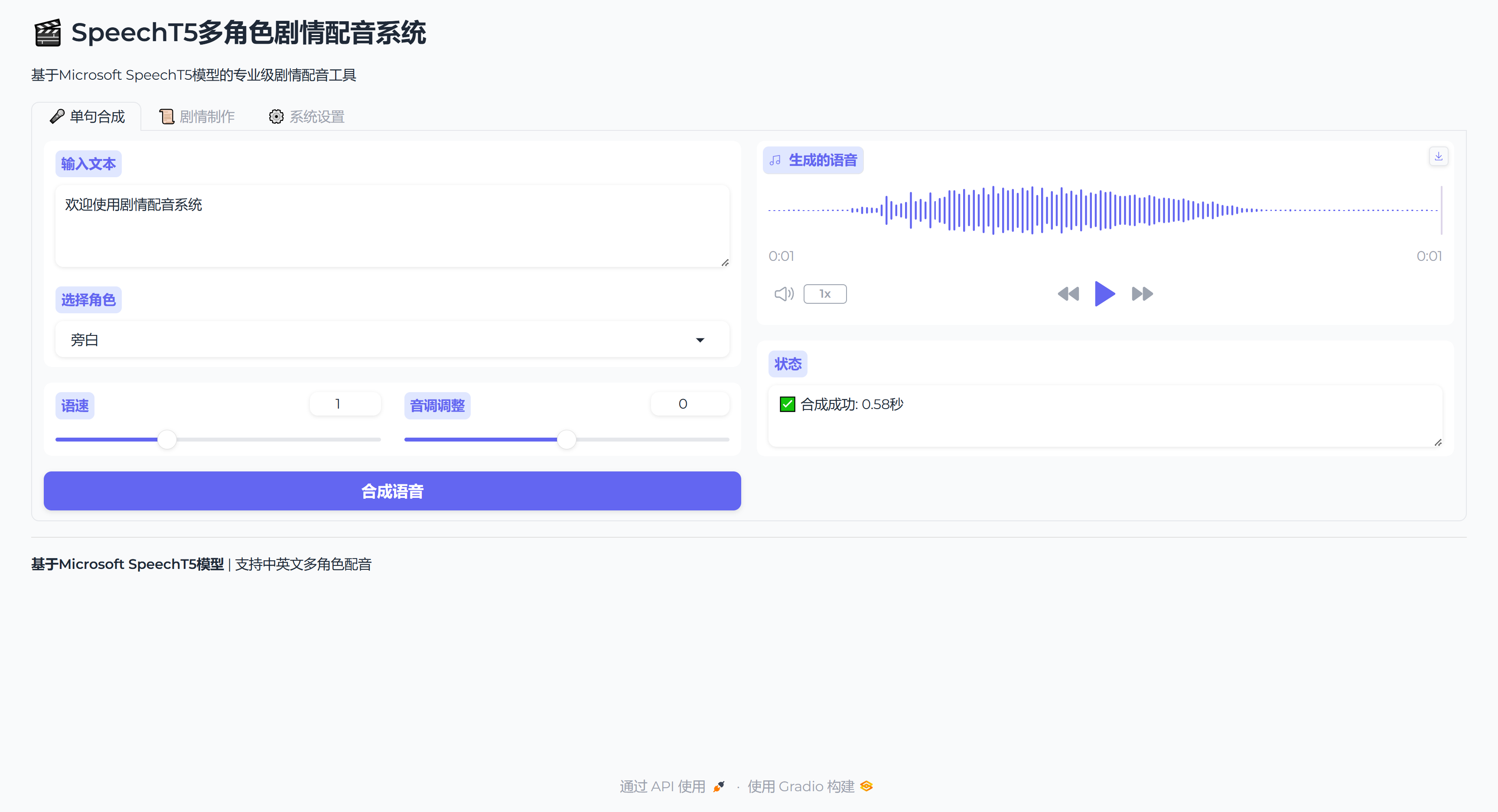

二、运行界面

1. 单句语音生成界面

2. 剧情制作合成

3. 系统角色配置

三、系统架构

Microsoft SpeechT5(轻量、开源、支持多说话人嵌入)+ FFmpeg(音频处理)+ Gradio(可视化交互)。

1. 说话人嵌入管理

SpeechT5 实现多角色配音的关键是说话人嵌入向量(512 维) —— 不同向量对应不同音色,该类解决了 “本地嵌入加载与角色映射” 的核心问题,细节如下:

1.1 核心逻辑

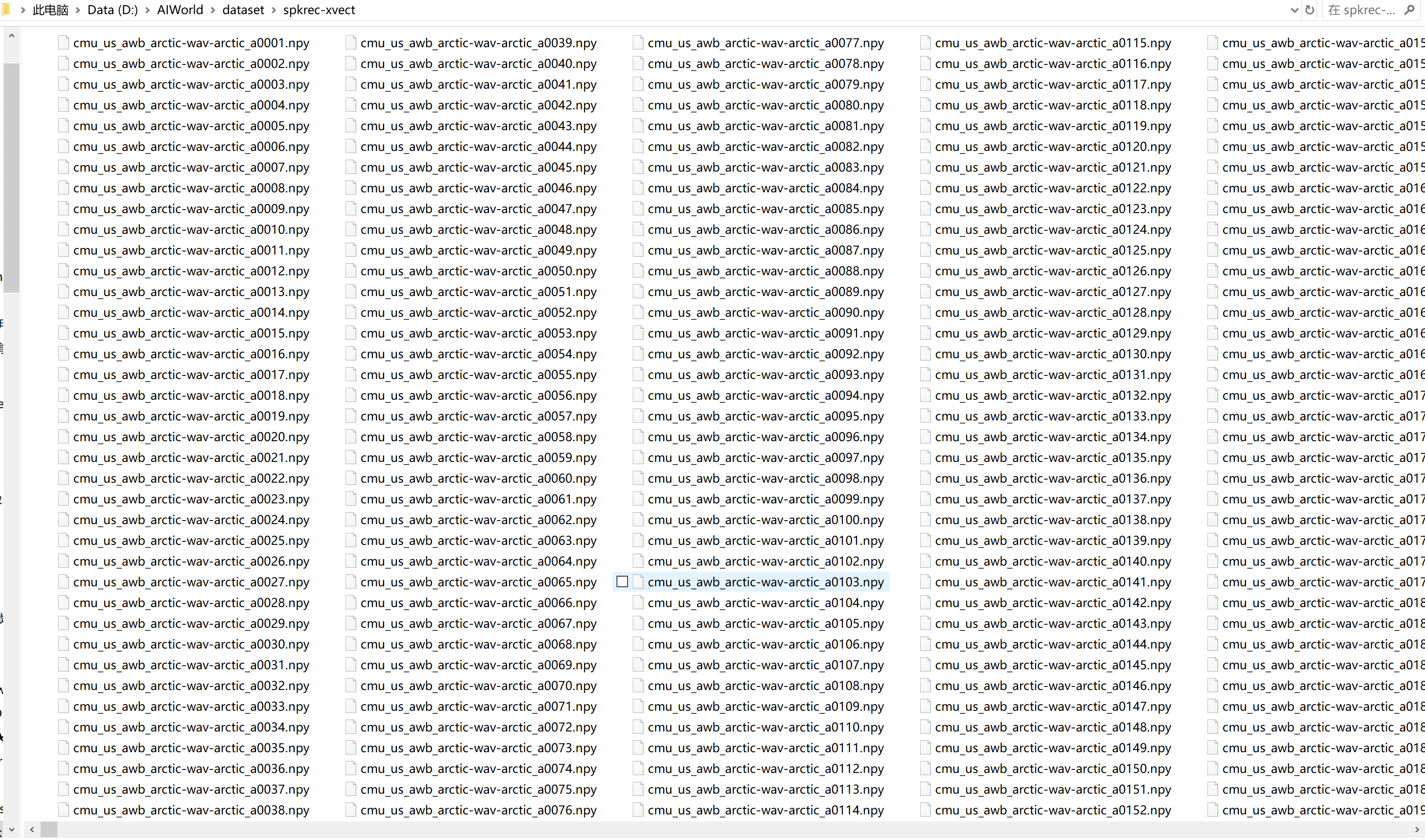

- 初始化:指定本地嵌入文件目录(D:/AIWorld/dataset/spkrec-xvect),加载所有.npy 格式的嵌入文件;

- 文件名解析:通过正则匹配(cmu_us_{speaker}_arctic)提取说话人标识,并映射为易理解的角色标签:

- awb → male_young(青年男性)、slt → female_young(青年女性);

- bdl → male_middle(中年男性)、clb → female_middle(中年女性);

- rms/jmk → male_old(老年男性);

- 平均嵌入计算:对同一角色的多个嵌入文件取均值,保证音色稳定性;

- 容错机制:若未找到.npy 文件,给出明确提示,不中断系统运行。

1.2 关键作用

将技术化的说话人标识(如 awb)转化为创作者易理解的角色标签(如青年男性),降低使用门槛;通过平均嵌入提升音色一致性,避免单文件嵌入的随机性。

1.3 加载方式

今天我们采用本地数据集的加载方式,将spkrec-xvect.zip的集合加载到项目中,优化了模拟数据的使用过程。

数据集文件预览:

本地加载示例:

import numpy as np

import os

from pathlib import Path

import torch

import re

class LocalSpeakerEmbeddings:

"""

从本地目录加载说话人嵌入

支持 .npy 格式的文件

"""

def __init__(self, embeddings_dir="D:/AIWorld/dataset/spkrec-xvect"):

"""

初始化本地说话人嵌入加载器

Args:

embeddings_dir: 嵌入文件目录

"""

self.embeddings_dir = Path(embeddings_dir)

self.embeddings = {}

self.speaker_mapping = {}

# 加载所有嵌入文件

self.load_all_embeddings()

def load_all_embeddings(self):

"""加载所有嵌入文件"""

print(f"正在从 {self.embeddings_dir} 加载说话人嵌入...")

# 获取所有.npy文件

npy_files = list(self.embeddings_dir.glob("*.npy"))

if not npy_files:

print("❌ 未找到 .npy 文件")

return

print(f"找到 {len(npy_files)} 个嵌入文件")

# 按说话人分组

speaker_embeddings = {}

for file_path in npy_files:

try:

# 从文件名提取说话人信息

speaker_id = self.extract_speaker_from_filename(file_path.name)

if speaker_id not in speaker_embeddings:

speaker_embeddings[speaker_id] = []

# 加载嵌入向量

embedding = np.load(file_path)

# 确保形状正确 (512维)

if embedding.shape == (512,):

speaker_embeddings[speaker_id].append(embedding)

else:

print(f"⚠️ 文件 {file_path.name} 形状异常: {embedding.shape}")

except Exception as e:

print(f"❌ 加载文件失败 {file_path.name}: {str(e)}")

# 计算每个说话人的平均嵌入

self._compute_average_embeddings(speaker_embeddings)

def extract_speaker_from_filename(self, filename):

"""

从文件名提取说话人标识

文件名示例: cmu_us_awb_arctic-wav-arctic_a0324.npy

提取规则: cmu_us_{speaker}_arctic...

"""

try:

# 模式匹配: cmu_us_{speaker}_arctic

pattern = r'cmu_us_([a-z]+)_arctic'

match = re.search(pattern, filename)

if match:

return match.group(1)

else:

# 如果正则匹配失败,使用文件名的前部分

parts = filename.split('_')

if len(parts) >= 3:

return parts[2] # 通常是第三个部分

else:

return filename.split('.')[0]

except Exception:

return "unknown_speaker"

def _compute_average_embeddings(self, speaker_embeddings):

"""计算每个说话人的平均嵌入"""

print("\n计算说话人平均嵌入...")

for speaker_id, embeddings_list in speaker_embeddings.items():

if embeddings_list:

# 计算平均嵌入

avg_embedding = np.mean(embeddings_list, axis=0)

# 存储为torch tensor

self.embeddings[speaker_id] = torch.tensor(avg_embedding).unsqueeze(0)

print(f" {speaker_id}: {len(embeddings_list)} 个样本")

print(f"✅ 加载了 {len(self.embeddings)} 个说话人嵌入")

# 显示加载的说话人

self.list_speakers()

def list_speakers(self):

"""列出所有可用的说话人"""

print("\n📋 可用的说话人:")

for i, (speaker_id, embedding) in enumerate(self.embeddings.items(), 1):

print(f" {i:2d}. {speaker_id} - 维度: {embedding.shape[1]}")

def get_embedding(self, speaker_id, default_speaker="awb"):

"""

获取说话人嵌入

Args:

speaker_id: 说话人标识

default_speaker: 如果找不到时的默认说话人

Returns:

嵌入向量 (torch.Tensor)

"""

if speaker_id in self.embeddings:

return self.embeddings[speaker_id]

elif default_speaker in self.embeddings:

print(f"⚠️ 说话人 '{speaker_id}' 不存在,使用默认 '{default_speaker}'")

return self.embeddings[default_speaker]

else:

# 如果都没有,返回第一个可用的

if self.embeddings:

first_key = list(self.embeddings.keys())[0]

print(f"⚠️ 使用可用的第一个说话人 '{first_key}'")

return self.embeddings[first_key]

else:

# 如果没有嵌入,创建一个随机嵌入

print("⚠️ 没有可用的嵌入,创建随机嵌入")

return torch.randn(1, 512) * 0.1

def get_available_speakers(self):

"""获取所有可用说话人列表"""

return list(self.embeddings.keys())

if __name__ == "__main__":

# 实例化类并加载嵌入

embeddings_loader = LocalSpeakerEmbeddings()

# 列出所有可用的说话人

speakers = embeddings_loader.get_available_speakers()

print("可用的说话人:", speakers)示例运行输出:

正在从 D:\AIWorld\dataset\spkrec-xvect 加载说话人嵌入... 找到 7931 个嵌入文件 计算说话人平均嵌入... awb: 1138 个样本 bdl: 1133 个样本 clb: 1132 个样本 jmk: 1132 个样本 ksp: 1132 个样本 rms: 1132 个样本 slt: 1132 个样本 ✅ 加载了 7 个说话人嵌入 📋 可用的说话人: 1. awb - 维度: 512 2. bdl - 维度: 512 3. clb - 维度: 512 4. jmk - 维度: 512 5. ksp - 维度: 512 6. rms - 维度: 512 7. slt - 维度: 512 可用的说话人: ['awb', 'bdl', 'clb', 'jmk', 'ksp', 'rms', 'slt']

2. FFmpeg配置

FFmpeg是一个开源的跨平台多媒体处理框架,可以处理音频、视频等多种媒体格式。在本项目中,FFmpeg主要用于音频文件的合并与处理,其核心优势在于无损合并能力,在示例可以看到以下一些参数配置。

参数解析:

- -f concat:指定使用concat协议

- -safe 0:禁用安全检查,允许相对路径

- -i concat_list.txt:输入连接列表文件

- -c copy:流复制模式,不重新编码,保证音频质量

- -y:自动覆盖输出文件

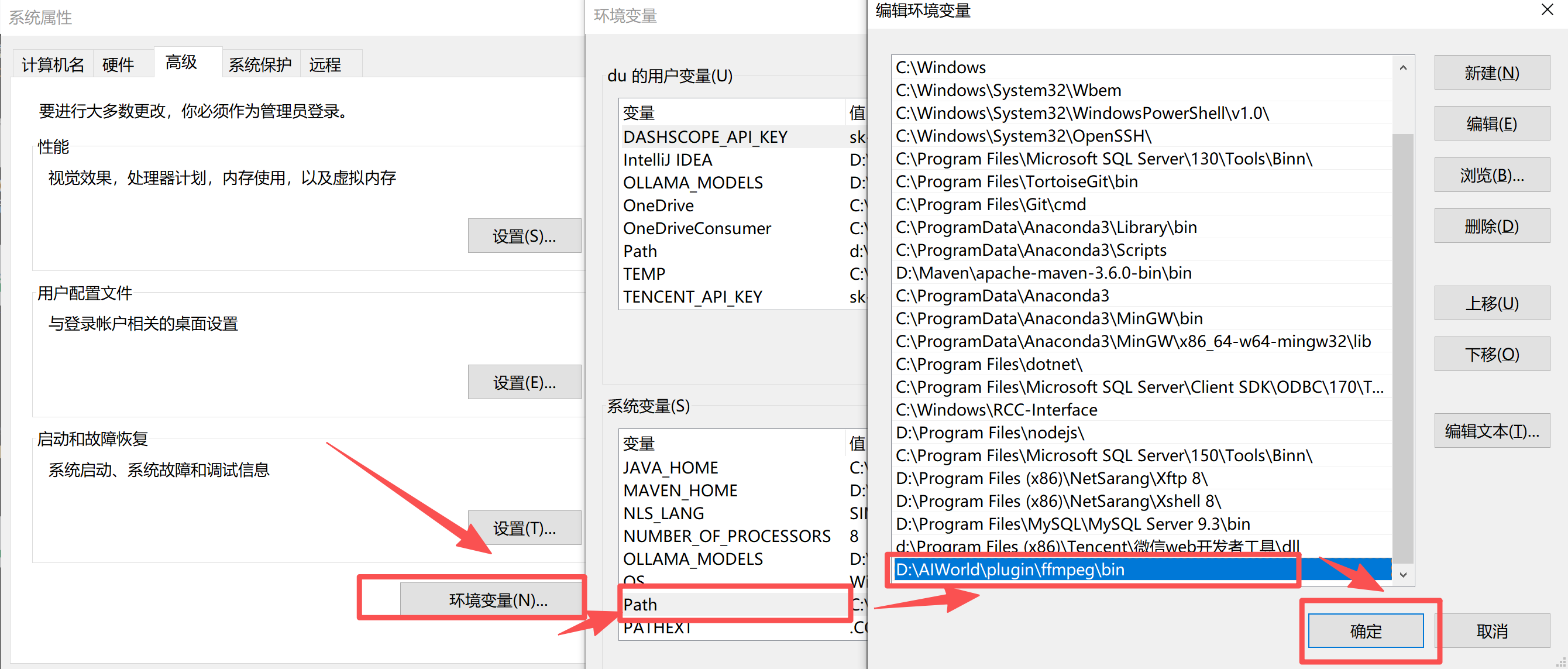

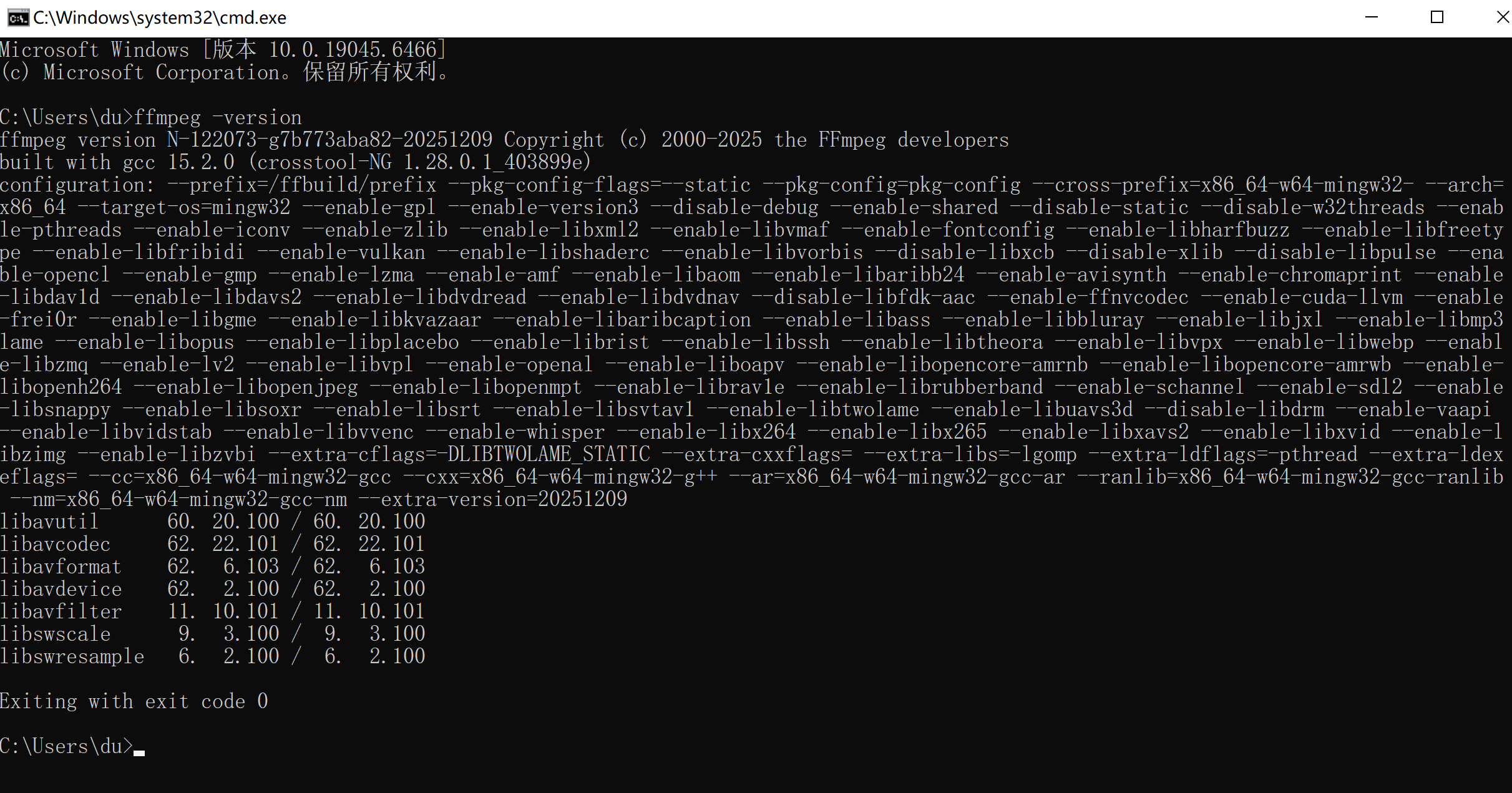

FFmpeg的安装配置步骤:

- 1. 下载ffmpeg:https://www.ffmpeg.org/download.html#build-windows

- 2. 解压到目录(如D:\AIWorld\plugin\ffmpeg)

- 3. 将D:\AIWorld\plugin\ffmpeg\bin添加到系统环境变量PATH

- 4. 验证:终端输入 ffmpeg -version

3. 核心组件

3.1 LocalSpeakerEmbeddings类

作用:说话人嵌入管理,从本地文件系统加载和管理说话人嵌入向量,支持说话人识别和声音控制。

# 嵌入向量标准化处理

def _compute_average_embeddings(self, speaker_embeddings):

"""计算每个说话人的平均嵌入,确保声音一致性"""

for speaker_id, embeddings_list in speaker_embeddings.items():

if embeddings_list:

# 计算平均嵌入,减少单个样本的噪声影响

avg_embedding = np.mean(embeddings_list, axis=0)

# 转换为PyTorch张量并添加批次维度

self.embeddings[speaker_id] = torch.tensor(avg_embedding).unsqueeze(0)- 智能文件命名解析:支持cmu_us_awb_arctic-wav-arctic_a0324.npy格式自动识别

- 容错机制:当指定说话人不存在时自动回退到默认说话人

- 内存优化:使用平均嵌入减少内存占用,同时保持声音特征

角色音色的差异化控制:

通过 “说话人嵌入 + 语速 + 音调” 三维参数定制角色音色:

- 小明(male_young):语速 1.1 倍、音调 + 0.5 半音,体现活泼;

- 老师(female_middle):语速 0.9 倍、音调 - 0.2 半音,体现稳重;

- 反派(male_middle):语速 0.8 倍、音调 - 0.5 半音,体现阴沉。

3.2 SpeechT5VoiceSystem类

作用:语音合成引擎,封装SpeechT5模型,提供完整的TTS功能,包括多说话人、多语言支持。

def synthesize(self, text: str, speaker_type: str = "female_young",

speed: float = 1.0, pitch_shift: float = 0.0,

output_file: Optional[str] = None) -> np.ndarray:

"""核心合成函数,包含完整的处理流水线"""

# 1. 缓存检查(提高性能)

cache_key = f"{text}_{speaker_type}_{speed}_{pitch_shift}"

if cache_key in self.audio_cache:

return self.audio_cache[cache_key]

# 2. 说话人嵌入获取(支持回退机制)

if speaker_type not in self.speaker_embeddings:

speaker_type = "female_young"

speaker_embedding = self.speaker_embeddings[speaker_type].to(self.device)

# 3. 文本预处理和模型推理

inputs = self.processor(text=text, return_tensors="pt")

with torch.no_grad():

speech = self.model.generate_speech(

inputs["input_ids"].to(self.device),

speaker_embedding,

vocoder=self.vocoder

)

# 4. 音频后处理(语速、音调调整)

audio = speech.cpu().numpy().squeeze()

audio = self._postprocess_audio(audio, speed, pitch_shift)

# 5. 缓存管理

self._add_to_cache(cache_key, audio)语音合成与后处理:

- 核心方法:synthesize(文本、角色类型、语速、音调、输出路径);

- 缓存机制:以 “文本 + 角色 + 语速 + 音调” 为缓存键,缓存上限 50 条,避免重复合成,提升批量处理效率;

- 后处理细节:

- 语速调整:通过 librosa.effects.time_stretch 实现(0.5-2.0 倍速);

- 音调调整:通过 librosa.effects.pitch_shift 实现(-5~+5 半音);

- 音量归一化:将音频振幅压缩到 0.9 倍,避免失真。

3.3 DramaVoiceSystem类

作用:剧情编排系统,管理完整的剧情制作流程,包括角色配置、剧本解析、音频合成和后期处理。

def parse_script(self, script_text: str):

"""智能剧本解析器,支持多种格式"""

# 支持格式:

# 1. 角色对话: "小明: 你好啊!"

# 2. 音效: "[音效] door_open"

# 3. 停顿: "[停顿] 2.5"

# 4. 旁白: 直接文本视为旁白

# 时长估算算法:基于字符数和内容复杂度

duration = len(text) * 0.12 # 每个字符约0.12秒

if any(char in text for char in "。!?"): # 标点增加停顿

duration *= 1.2

def combine_audio(self, output_filename: str = "final_drama.wav") -> str:

"""使用FFmpeg进行专业级音频合并"""

# 1. 创建音频连接列表

# 2. 生成静音片段用于停顿

# 3. 使用FFmpeg的concat协议无损合并

# 4. 添加专业音频效果(淡入淡出、动态压缩)

# FFmpeg命令构建:

cmd = [

'ffmpeg',

'-f', 'concat', # 使用连接协议

'-safe', '0', # 允许非常规路径

'-i', concat_file, # 输入连接列表

'-c', 'copy', # 流复制(无损)

output_path,

'-y' # 覆盖输出

]该类是衔接 “TTS 引擎” 与 “自媒体需求” 的核心,覆盖剧本处理到音频输出的全业务流程,细节如下:

3.3.1 数据结构定义

- CharacterConfig:角色配置数据类,包含名称、说话人类型、语速、音调、音量、描述,支持字典转实例(from_dict);

- ScriptLine:剧本行数据类,包含角色、台词、时长、音频文件路径,清晰封装剧本元素。

3.3.2 剧本解析规则

- 支持 3 类剧本指令,完全贴合短视频剧本的写作逻辑:

- 角色台词:角色名: 台词(如 “小明:这本书真有意思!”);

- 音效指令:[音效] 音效名称(如 “[音效] magic_sparkle”);

- 停顿指令:[停顿] 时间(秒)(如 “[停顿] 1.0”);

- 容错处理:未知角色默认映射为 “旁白”,未指定时长的停顿默认 1 秒,台词时长按 “字符数 ×0.12 秒” 估算(最短 2 秒)。

3.3.3 音频合并与后处理

- FFmpeg 批量拼接:生成 concat_list.txt 文件,按剧本顺序拼接语音、静音(音效 / 停顿)文件;

- 音频效果优化:

- 淡入淡出:默认淡入 0.5 秒、淡出 1 秒,避免音频开头 / 结尾突兀;

- 动态范围压缩:使不同角色的音量更均匀;

- 音量归一化:统一整体音量,适配短视频平台播放标准。

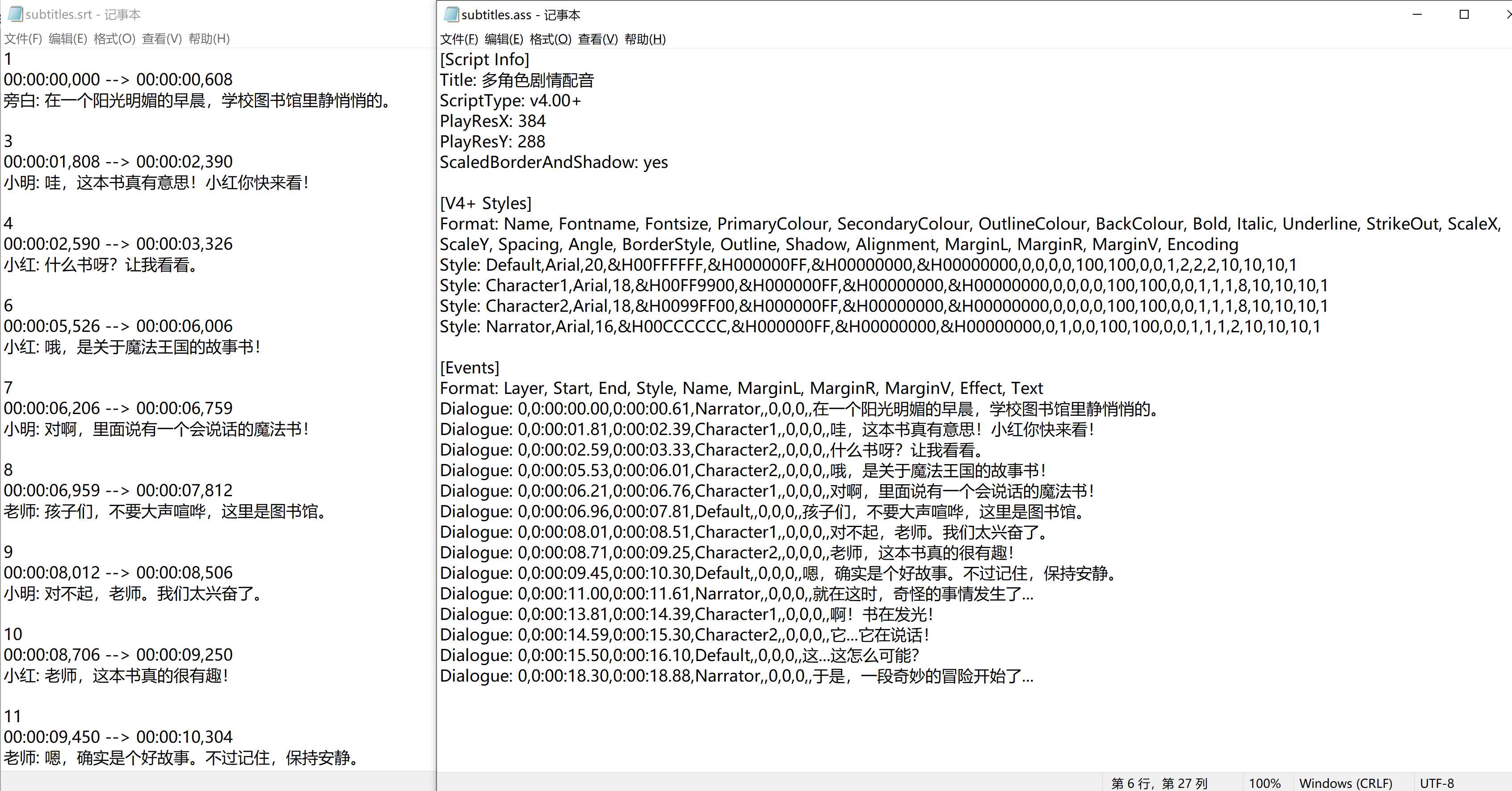

3.3.4 多格式字幕生成

- SRT 字幕:基础格式,兼容所有剪辑软件(剪映、PR、AE);

- ASS 字幕:富格式,支持角色样式区分(如小明用橙色、小红用绿色),提升字幕美观度;

- 时间轴计算:按音频实际时长生成,角色台词间添加 0.2 秒间隔,避免字幕重叠。

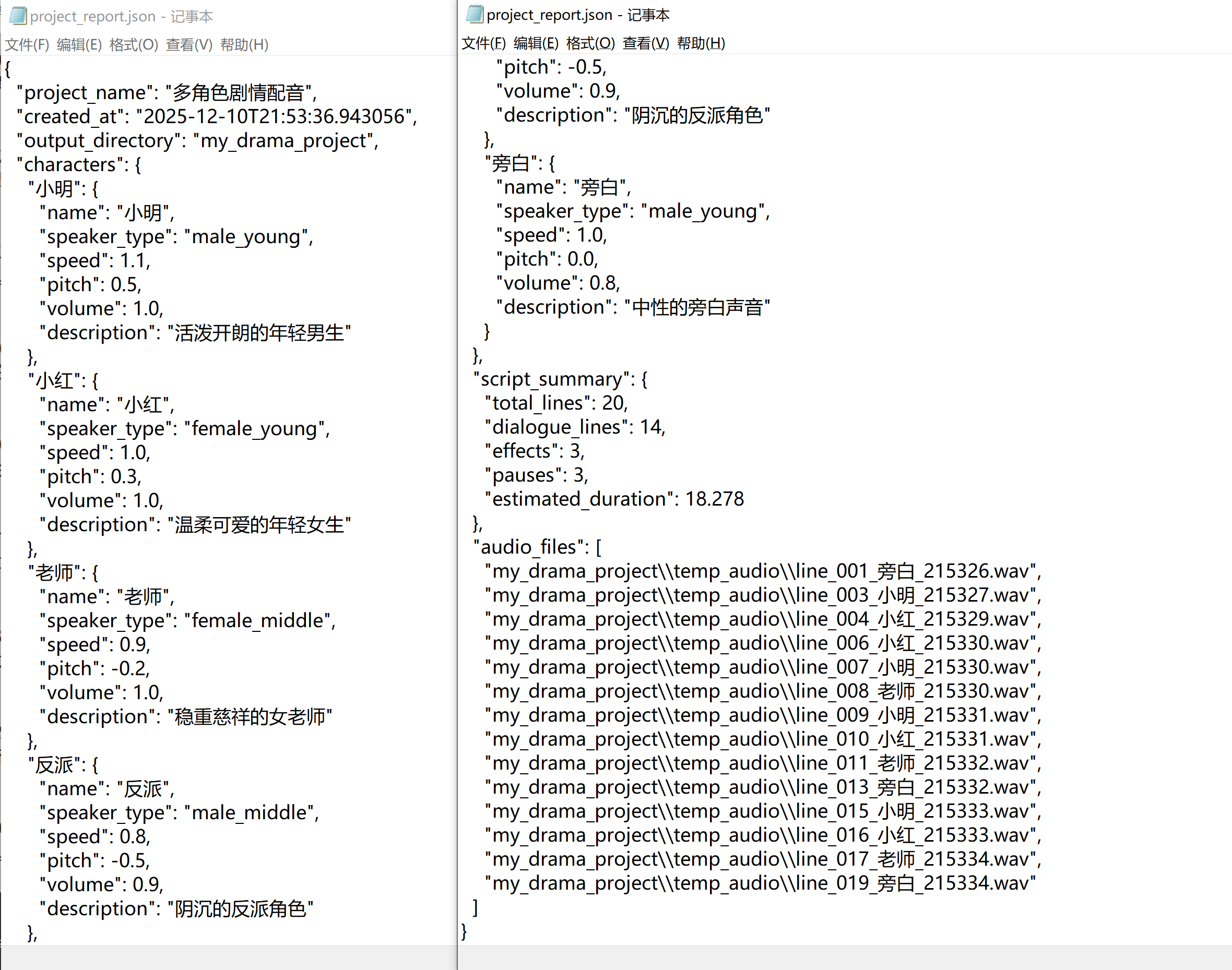

3.3.5 项目报告与临时文件清理

- 报告生成:输出 JSON(结构化数据)+ Markdown(可视化报告),包含角色配置、剧本摘要、音频文件列表,方便团队协作;

- 临时文件清理:自动删除 temp_audio、temp_combine 目录,避免冗余文件占用存储空间。

4. 交互与示例模块

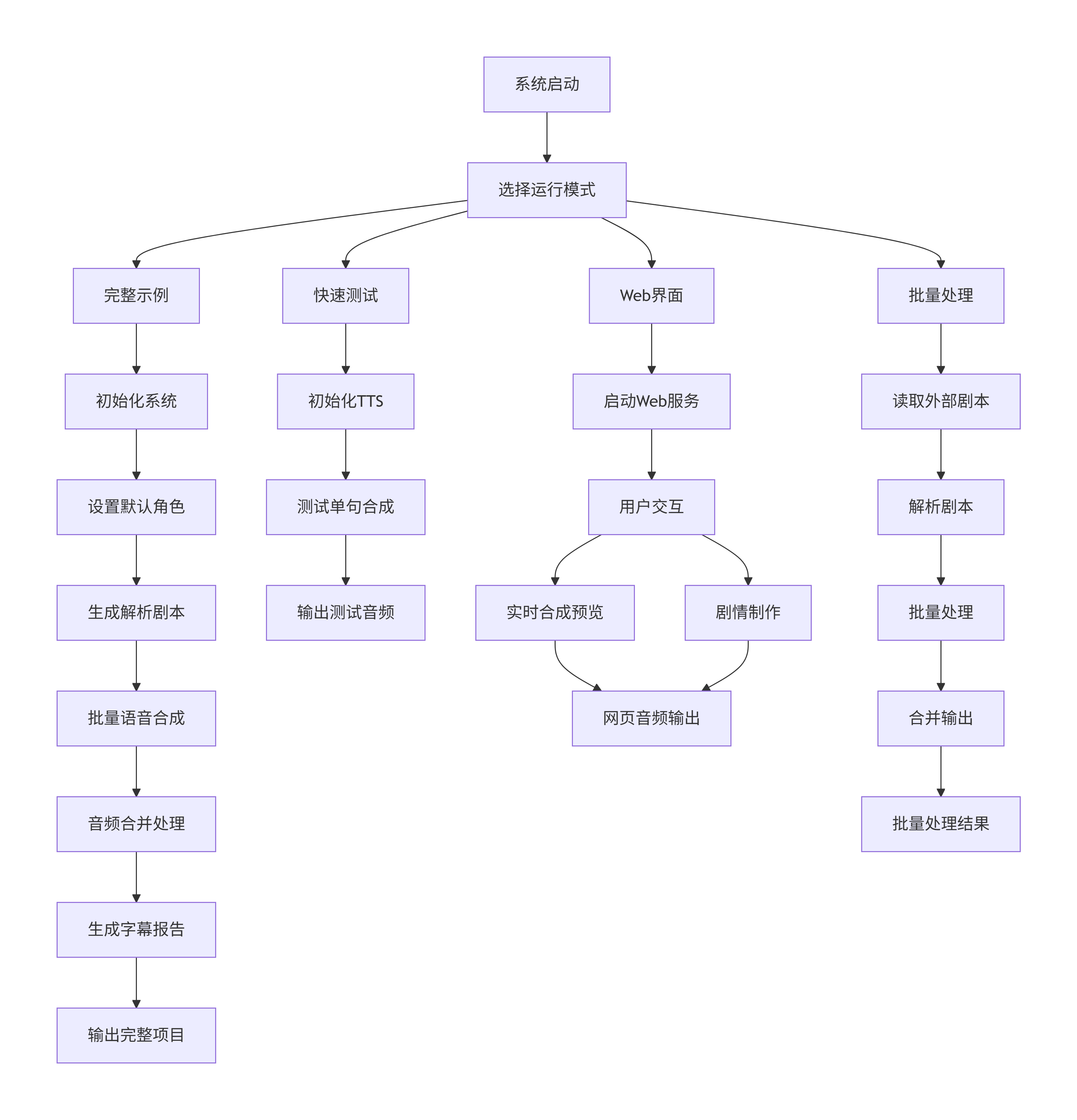

主程序提供 4 种运行模式,适配不同使用场景:

- 完整示例:生成 “校园魔法冒险” 完整剧情音频 + 字幕 + 报告;

- 快速测试:测试单句语音合成,验证系统是否正常;

- Web 界面:Gradio 可视化操作,支持单句合成、剧情制作,无需编写代码;

- 批量处理:加载外部剧本文件,批量生成配音,适配多剧本创作需求。

示例剧本设计

- 示例剧本围绕 “校园魔法冒险” 展开,包含旁白、角色对话、音效、停顿,总时长约 30 秒(适配短视频时长),覆盖自媒体剧情类视频的典型元素。

5. 主要执行流程

完整实例流程主要步骤:

- 系统初始化:创建配音系统实例,设置输出目录

- 角色配置:加载默认角色(小明、小红、老师、旁白等)

- 剧本处理:解析示例剧本,识别角色对话和音效标记

- 语音生成:为每个角色台词生成语音文件

- 音频拼接:使用FFmpeg将所有音频按顺序合并

- 后处理:添加淡入淡出效果,音量标准化

- 字幕生成:创建SRT和ASS格式字幕文件

- 项目报告:生成JSON和Markdown格式的项目文档

- 清理输出:删除临时文件,保留最终成果

四、运行过程

1. 选择运行模式

选择运行模式: 1. 完整示例(生成完整剧情) 2. 快速测试(测试语音合成) 3. Web界面(交互式操作) 4. 批量处理(处理剧本文件) 请输入选择 (1-4): 1

2. 系统初始化

⚙️ 初始化SpeechT5系统... 设备: cpu 模型: microsoft/speecht5_tts ✅ SpeechT5系统初始化完成 🎭 剧情配音系统初始化完成 输出目录: my_drama_project ✅ 设置了 5 个默认角色 📢 测试SpeechT5系统... 📥 正在加载SpeechT5模型... 正在从 D:\AIWorld\dataset\spkrec-xvect 加载说话人嵌入... 找到 7931 个嵌入文件 计算说话人平均嵌入... male_young: 2270 个样本 male_middle: 1133 个样本 female_middle: 1132 个样本 male_old: 2264 个样本 female_young: 1132 个样本 ✅ 加载了 5 个说话人嵌入 📋 可用的说话人: 1. male_young - 维度: 512 2. male_middle - 维度: 512 3. female_middle - 维度: 512 4. male_old - 维度: 512 5. female_young - 维度: 512 ✅ 从本地目录加载了 5 个说话人嵌入 ✅ 模型加载成功!

3. 创建示例脚本

📜 创建示例剧本... 旁白: 在一个阳光明媚的早晨,学校图书馆里静悄悄的。 [停顿] 1.0 小明: 哇,这本书真有意思!小红你快来看! 小红: 什么书呀?让我看看。 [音效] page_turn 小红: 哦,是关于魔法王国的故事书! 小明: 对啊,里面说有一个会说话的魔法书! 老师: 孩子们,不要大声喧哗,这里是图书馆。 小明: 对不起,老师。我们太兴奋了。 小红: 老师,这本书真的很有趣! 老师: 嗯,确实是个好故事。不过记住,保持安静。 [停顿] 0.5 旁白: 就在这时,奇怪的事情发生了... [音效] magic_sparkle 小明: 啊!书在发光! 小红: 它...它在说话! 魔法书: 你们好,孩子们。我是魔法王国的向导。 老师: 这...这怎么可能? 魔法书: 跟我来吧,带你们去一个神奇的世界! [音效] portal_open 旁白: 于是,一段奇妙的冒险开始了... [停顿] 2.0 ⚠️ 第17行: 未知角色 '魔法书' ⚠️ 第19行: 未知角色 '魔法书' 📜 解析了 20 行剧本

4. 按角色生成语音

🎤 开始生成语音... [1/20] 旁白: 在一个阳光明媚的早晨,学校图书馆里静悄悄的。... 🔊 合成语音: 在一个阳光明媚的早晨,学校图书馆里静悄悄的。... 说话人: male_young, 语速: 1.0x, 音调: +0.0 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_001_旁白_215326.wav [3/20] 小明: 哇,这本书真有意思!小红你快来看!... 🔊 合成语音: 哇,这本书真有意思!小红你快来看!... 说话人: male_young, 语速: 1.1x, 音调: +0.5 半音 语音已保存: my_drama_project\temp_audio\line_003_小明_215327.wav [4/20] 小红: 什么书呀?让我看看。... 🔊 合成语音: 什么书呀?让我看看。... 说话人: female_young, 语速: 1.0x, 音调: +0.3 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_004_小红_215329.wav [6/20] 小红: 哦,是关于魔法王国的故事书!... 🔊 合成语音: 哦,是关于魔法王国的故事书!... 说话人: female_young, 语速: 1.0x, 音调: +0.3 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_006_小红_215330.wav [7/20] 小明: 对啊,里面说有一个会说话的魔法书!... 🔊 合成语音: 对啊,里面说有一个会说话的魔法书!... 说话人: male_young, 语速: 1.1x, 音调: +0.5 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_007_小明_215330.wav [8/20] 老师: 孩子们,不要大声喧哗,这里是图书馆。... 🔊 合成语音: 孩子们,不要大声喧哗,这里是图书馆。... 说话人: female_middle, 语速: 0.9x, 音调: -0.2 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_008_老师_215330.wav [9/20] 小明: 对不起,老师。我们太兴奋了。... 🔊 合成语音: 对不起,老师。我们太兴奋了。... 说话人: male_young, 语速: 1.1x, 音调: +0.5 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_009_小明_215331.wav [10/20] 小红: 老师,这本书真的很有趣!... 🔊 合成语音: 老师,这本书真的很有趣!... 说话人: female_young, 语速: 1.0x, 音调: +0.3 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_010_小红_215331.wav [11/20] 老师: 嗯,确实是个好故事。不过记住,保持安静。... 🔊 合成语音: 嗯,确实是个好故事。不过记住,保持安静。... 说话人: female_middle, 语速: 0.9x, 音调: -0.2 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_011_老师_215332.wav [13/20] 旁白: 就在这时,奇怪的事情发生了...... 🔊 合成语音: 就在这时,奇怪的事情发生了...... 说话人: male_young, 语速: 1.0x, 音调: +0.0 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_013_旁白_215332.wav [15/20] 小明: 啊!书在发光!... 🔊 合成语音: 啊!书在发光!... 说话人: male_young, 语速: 1.1x, 音调: +0.5 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_015_小明_215333.wav [16/20] 小红: 它...它在说话!... 🔊 合成语音: 它...它在说话!... 说话人: female_young, 语速: 1.0x, 音调: +0.3 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_016_小红_215333.wav [17/20] 老师: 这...这怎么可能?... 🔊 合成语音: 这...这怎么可能?... 说话人: female_middle, 语速: 0.9x, 音调: -0.2 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_017_老师_215334.wav [19/20] 旁白: 于是,一段奇妙的冒险开始了...... 🔊 合成语音: 于是,一段奇妙的冒险开始了...... 说话人: male_young, 语速: 1.0x, 音调: +0.0 半音 ✅ 语音已保存: my_drama_project\temp_audio\line_019_旁白_215334.wav ✅ 所有语音生成完成 🔗 合并音频... 执行命令: ffmpeg -f concat -safe 0 -i my_drama_project\temp_combine\concat_list.txt -c copy my_drama_project\my_drama_final.wav -y ✅ 音频合并完成: my_drama_project\my_drama_final.wav 🎵 添加了音频效果: 淡入0.5秒, 淡出1.0秒

5. 生成字幕

📝 生成字幕... ✅ SRT字幕已生成: my_drama_project\subtitles.srt 📝 生成字幕... ✅ ASS字幕已生成: my_drama_project\subtitles.ass 📊 生成项目报告... ✅ 项目报告已生成: - my_drama_project\project_report.json - my_drama_project\README.md 🧹 已清理临时音频文件 🧹 已清理临时合并文件 ================================================================== 🎉 剧情配音制作完成! ================================================================== 🎵 最终音频: my_drama_project\my_drama_final.wav 📝 字幕文件: - SRT格式: my_drama_project\subtitles.srt - ASS格式: my_drama_project\subtitles.ass 📄 项目报告: my_drama_project/README.md 📊 详细数据: my_drama_project/project_report.json 🚀 下一步: 1. 使用视频编辑软件导入音频和字幕 2. 添加背景图片或视频 3. 导出为完整的视频作品

字幕文件内容参考:

项目数据报告文档:

五、总结

这套基于 SpeechT5 的多角色剧情配音系统,是针对自媒体创作者的 “轻量化、全流程、可落地” 解决方案。其核心价值在于:以开源技术为底座,将专业级的 TTS 能力转化为创作者易使用的工具,解决了真人配音成本高、效率低的痛点。

系统的设计细节(如容错机制、缓存策略、多格式输出)充分考虑了自媒体创作的实际需求,从 “技术实现” 到 “业务落地” 形成了完整闭环。即使是无编程基础的创作者,也能通过 Web 界面快速生成多角色剧情配音;可通过代码定制角色、优化参数,适配更复杂的创作场景。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录