腾讯混元新评测:CL-bench揭示大模型上下文学习能力真实上限

原创腾讯混元新评测:CL-bench揭示大模型上下文学习能力真实上限

原创

霍格沃兹-测试开发学社

发布于 2026-02-11 15:08:48

发布于 2026-02-11 15:08:48

腾讯混元官网正式上线姚顺雨团队最新成果,发布了专门评测大语言模型能否从上下文(Context)中学习新知识并正确应用的基准CL-bench。

这是姚顺雨加入腾讯混元担任首席AI科学家后,其团队首次发布研究成果,也是腾讯混元技术博客首次公开。

图片

在评估大模型能力时,一个常见假设是:只要给够上下文,模型就能正确完成任务。

但在真实系统中,这个假设经常失效。 模型“看过说明”“读过规则”,却依然输出错误结果。

腾讯混元最新公开的 CL-bench,并没有继续堆叠更难的推理题,而是直接针对这一问题做了一次系统性评测:模型是否真的具备从上下文中学习新知识并正确应用的能力。

一、真实系统里,大模型失败往往不是“不会推理”

大模型的失败模式并不陌生:

- 文档给了,但模型没用

- 规则写清楚了,但模型仍按旧知识执行

- 流程说明完整,但模型跳步、漏步

这些问题很难用“模型不够聪明”来解释。 更接近事实的说法是:模型并没有真正把上下文当成“可学习的信息源”。

CL-bench 正是围绕这个问题设计的。

二、CL-bench 想评测的,不是知识量而是学习能力

CL-bench 的核心前提非常明确:

任务所需的全部信息,都在上下文中,且这些信息不在模型的预训练记忆里。

评测并不考察模型“知道多少”,而是考察它是否能够:

- 识别上下文中的新规则

- 构建临时知识结构

- 在后续任务中正确使用这些新知识

从目标上看,这是一种更接近真实工作场景的能力测试。

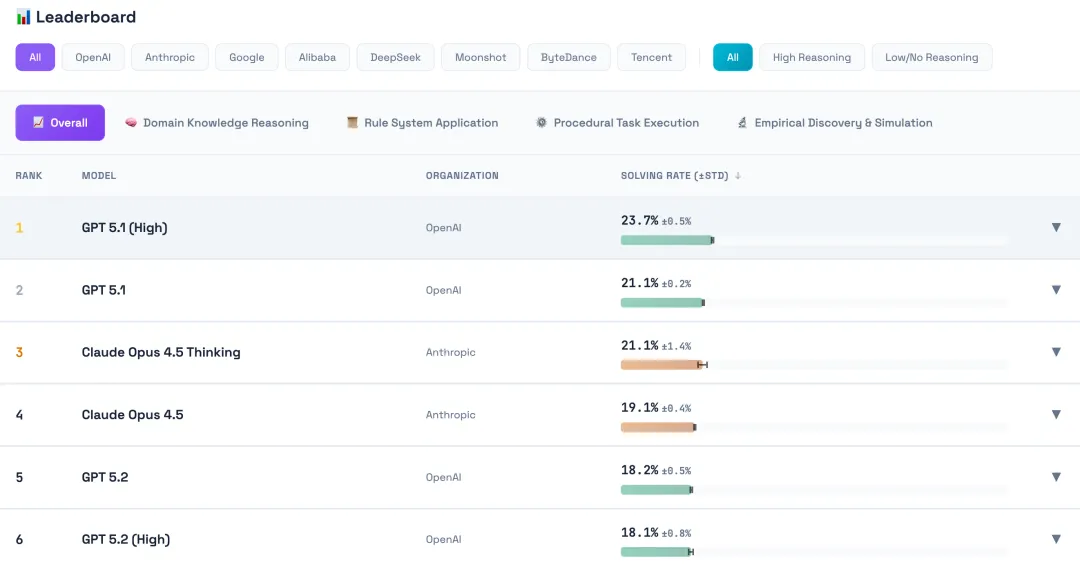

三、评测结果:主流模型在上下文学习任务上的真实表现

在 CL-bench 上,腾讯混元团队评测了 10 个主流大语言模型。

- 平均任务成功率:17.2%

- 表现最好的 GPT-5.1(高推理强度)成功率也仅为 23.7%

图片

这意味着: 即使上下文中明确给出了完成任务所需的全部信息,模型在大多数情况下仍然失败。

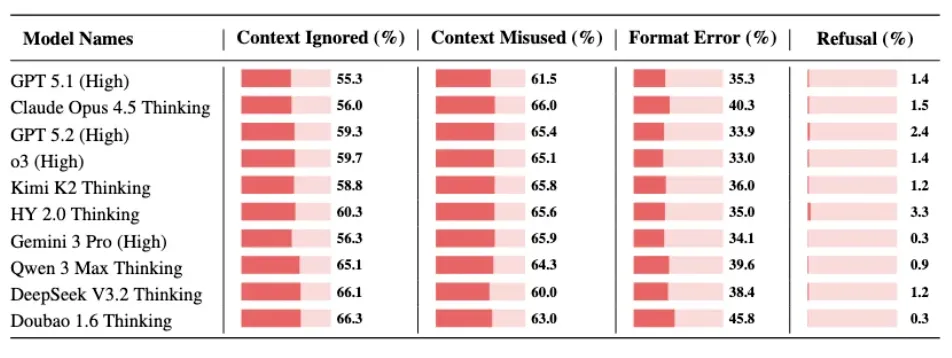

四、错误分析:模型更倾向于调用静态记忆,而不是学习上下文

从错误分布来看,失败的主要原因并不是信息缺失,而是:

- 忽略上下文中的关键定义

- 错误套用预训练阶段学到的通用知识

- 未能根据新规则调整推理路径

这说明一个重要事实:模型默认更信任“参数化记忆”,而不是输入中的新信息。

图片

五、长上下文与高推理强度,并不能解决根本问题

评测结果显示:

- 无法处理长上下文的模型,表现确实更差

- 但即便能处理长输入、严格遵循指令,仍会在大量任务中失败

提高推理强度对部分任务有帮助,但提升幅度有限,且不稳定。

这表明:上下文学习并不是“读得更久、想得更久”就能解决的问题。

六、归纳能力缺失,是当前模型最明显的短板

在 CL-bench 的几类任务中,模型在“演绎型任务”(按明确规则执行)上的表现明显好于:

- 从实验数据中发现规律

- 从环境反馈中总结结论

后者往往需要归纳能力,而这一能力在当前模型中表现最弱,部分任务成功率低于 10%。

七、无污染设计,暴露了上下文学习的真实下限

CL-bench 采用了严格的无污染设计:

- 大量虚构体系

- 对现实规则的系统性改写

- 小众或新兴内容

在不提供任何上下文的情况下,模型的成功率几乎为零。 这说明模型无法通过“记忆猜测”完成任务,必须依赖上下文学习。

同时,超过一半任务存在强序列依赖,进一步放大了学习失败的后果。

八、对工程实践的启示:Context 并不是“给了就能用”

对做系统的人来说,CL-bench 的结论非常直接:

- 上下文不是外挂知识库

- Prompt 不是学习机制

- Agent 并不会自动“看文档做事”

如果模型不能稳定地从上下文中学习,新一代智能系统在复杂场景下仍然会频繁失效。

九、大模型“如何记忆”,正在成为系统级问题

腾讯混元团队在结语中提出一个判断:

大模型如何从上下文中保留、组织和巩固知识,可能会成为下一阶段的核心研究方向。

当模型的上下文学习能力变得可靠之后,人类在系统中的角色也会发生变化—— 从训练数据提供者,转变为上下文构建者与任务设计者。

在那之前,CL-bench 提供了一个非常清晰的现实提醒:

Context 并不等于知识, 给了上下文,也不代表模型学会了。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录