为什么没有「智能体领航员」,执行型 AI 注定会被误用?

原创为什么没有「智能体领航员」,执行型 AI 注定会被误用?

原创

Agent_阿杨

发布于 2026-01-23 09:35:33

发布于 2026-01-23 09:35:33

一、一个正在反复发生的现象:AI 越强,人反而越累

在很多真实使用场景中,AI 并没有带来预期中的“解放”。

相反,一种更隐蔽的负担正在出现:

- 你要不断判断 这一步该不该做

- 你要频繁修正 已经开始执行的方向

- 你要为 AI 的“照做”承担最终责任

于是形成一个看似荒谬、但极其常见的局面:

AI 负责执行,人类负责所有判断。

这并不是使用方式的问题,而是系统结构的问题。

二、执行型 AI 被误用,并不是因为它“不够聪明”

很多人会下意识地把问题归结为:

- 模型还不够强

- 推理还不够好

- 多模态还不够成熟

但如果你把视角从“能力”切换到“结构”,会发现一个更残酷的事实:

执行型 AI 的误用,是一种结构必然,而不是阶段性缺陷。

原因很简单—— 执行系统天生不具备判断合法性的能力。

它只回答一个问题:

“如果要做这件事,我该怎么做?”

而它永远不会回答的问题是:

- 这件事现在该不该做?

- 是否应该先做另一件?

- 如果做错了,该不该立刻停?

当系统里没有一个角色专门负责这些问题时, 判断就会自动回流到人类身上。

三、没有领航层,系统一定会把“判断问题”伪装成“执行问题”

这是母题一的核心机制。

当系统缺失领航结构时,会发生三件几乎不可避免的事。

1️⃣ 不确定性被强行压扁为流程

原本需要动态判断的事情,被包装成:

- checklist

- workflow

- prompt 模板

看起来“可以执行”,但实际上只是暂时冻结了问题。

2️⃣ 错误被延迟,而不是被避免

执行系统的典型特征是:

一旦启动,就倾向于把路径走完。

于是错误不是在“判断阶段”被发现, 而是在结果阶段才被暴露。

3️⃣ 人类成为隐形的“兜底模块”

系统越自动化,人类越退到最后一环:

- 最终拍板

- 最终负责

- 最终解释失败

这就是为什么很多人会产生一种错觉:

“我好像什么都没做,但所有责任都在我身上。”

四、问题不在于“AI 替不替代人”,而在于“谁在负责判断”

在没有智能体领航员的系统中,判断呈现出一种非常危险的状态:

- 没有明确归属

- 没有系统约束

- 没有持续校正

它既不完全属于 AI, 也不完全属于人类。

于是判断变成了:

一种无名的、不可追责的、被默认存在的负担。

这正是执行型 AI 被误用的根本原因:

它被要求解决本不属于它的问题空间。

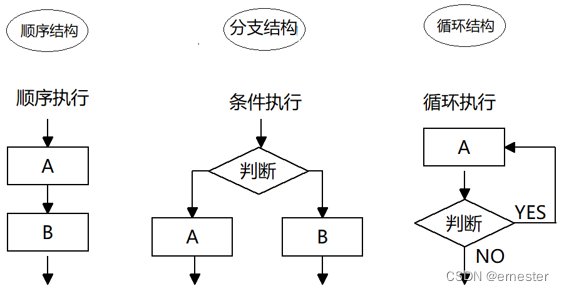

五、智能体领航员的真正作用:把“是否该做”从人脑中解放出来

现在我们终于可以引入那个关键角色。

智能体领航员并不是来“做更多事”的, 而是来接管一种长期被忽视的系统职责:

持续判断:下一步是否成立。

它的价值不体现在:

- 写得多快

- 干得多好

而体现在三个非常具体的能力上:

- 在执行之前,判断是否应该启动

- 在执行过程中,判断是否需要改向

- 在结果出现后,判断是否继续投入

一旦这个角色被系统化, 一个关键变化就会发生:

判断不再默认由人类兜底。

Image

六、为什么“没有智能体领航员”,执行型 AI 一定会被滥用?

现在我们可以给出一个结构性结论:

只要系统中不存在显性的领航层, 执行型 AI 就一定会被推到它不该承担的位置上。

因为系统无法容忍“判断真空”。

当判断没有被明确承接时,它只会:

- 被压进 prompt

- 被塞进流程

- 被丢给人类

这不是使用者的问题, 而是系统设计必然导致的错配。

七、一个行业级判断:AI 的真正瓶颈,已经从“执行”转移到“判断”

如果你站在行业尺度回看,会发现一个清晰的迁移趋势:

- 执行能力:快速商品化

- 判断能力:高度稀缺

而智能体领航员,正是这一稀缺能力的系统化尝试。

它并不承诺:

- 更高的成功率

- 更少的失败

它只承诺一件事:

让错误尽可能发生在“判断阶段”, 而不是“结果阶段”。

这本身,就是高级系统与低级系统的分水岭。

结语(定性收束)

执行型 AI 并没有错。 被放错位置的,才是问题。

当系统缺失领航层, 人类就会被迫为所有错误路径兜底。

而智能体领航员存在的意义,不是替代人, 而是把判断这件事,从默认、隐形、不可控, 变成显性、可协作、可修正的系统能力。

这,才是它真正的行业价值。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录