“LSTM”让机器拥有记忆力的“时间魔法师”——深度解析循环神经网络的核心突破

“LSTM”让机器拥有记忆力的“时间魔法师”——深度解析循环神经网络的核心突破

一只大侠

发布于 2025-12-31 11:34:01

发布于 2025-12-31 11:34:01

引言:“LSTM”让机器拥有记忆力的“时间魔法师”——深度解析循环神经网络的核心突破

当AI需要理解一句话、预测一段趋势、或生成一段音乐时,它面临着一个根本挑战:如何记住过去的信息以理解现在?2017年Transformer横空出世前,有一种神经网络结构统治序列建模长达20年——它就是长短期记忆网络(LSTM)。今天,我们来重新认识这位“时间序列大师”的智慧与局限。

在这里插入图片描述

在这里插入图片描述

- 引言:“LSTM”让机器拥有记忆力的“时间魔法师”——深度解析循环神经网络的核心突破

- 一、从“健忘症”到“好记性”:LSTM的诞生初心

- 二、解剖LSTM:三个门控+一个细胞状态的“智能记忆系统”

- 三、梯度消失的终结者:LSTM的技术突破

- 四、LSTM的变体家族:谁更适合你的任务?

- 五、LSTM vs Transformer:不是替代,而是互补

- 六、LSTM的实战挑战与解决方案

- 七、未来展望:LSTM的“第二春”

一、从“健忘症”到“好记性”:LSTM的诞生初心

在LSTM出现之前,朴素循环神经网络(RNN)是处理序列数据的主力军。理论上,RNN能够通过隐藏层状态传递历史信息,但在实际应用中,它却饱受梯度消失/爆炸问题的困扰。当序列长度超过一定阈值,模型就会“忘记”早期的关键信息——比如处理长文本时,RNN可能记不住开头的主语,更无法完成长句子的翻译任务。

1997年,学者Hochreiter & Schmidhuber从“人脑记忆机制”中获得灵感,提出了LSTM的核心架构。它通过设计精巧的门控机制,让模型学会自主“记住有用信息、遗忘无用信息”,彻底解决了RNN的“健忘症”难题,成为此后20年序列建模领域的标杆。

二、解剖LSTM:三个门控+一个细胞状态的“智能记忆系统”

如果把LSTM比作一个智能笔记系统,那么它的核心组件就是三个“门”和一条贯穿始终的“记忆传送带”,各司其职又协同工作:

在这里插入图片描述

- 遗忘门:信息的“垃圾过滤器” 遗忘门的作用是决定哪些历史记忆需要被丢弃。它会读取当前时刻的输入和上一时刻的隐藏状态,通过sigmoid函数输出0~1之间的数值——0代表完全遗忘,1代表完全保留。比如在文本处理中,当模型读到“他”这个代词时,遗忘门会选择保留前文提到的“小明”这个主语,同时遗忘无关的修饰词。

- 输入门:新信息的“安检通道” 输入门负责筛选值得存入长期记忆的新信息。它分为两步:先用sigmoid函数判断“哪些信息需要更新”,再用tanh函数生成新的候选记忆内容,最后将两者相乘,得到需要添加到记忆中的部分。就像做笔记时,我们会先标记重点,再把核心内容写进笔记本。

- 输出门:记忆的“发言人” 输出门决定当前时刻应该输出什么信息。它先根据当前输入和历史状态,用sigmoid函数确定输出的权重,再将细胞状态经过tanh函数处理,最后两者相乘得到当前的隐藏状态——也就是模型对外输出的“记忆快照”。

- 细胞状态:贯穿时间的“记忆传送带” 细胞状态是LSTM的核心,它像一条稳定的传送带,贯穿整个序列的时间步。遗忘门和输入门的操作直接作用于细胞状态,让有用的信息在传送带上持续传递,无用的信息被及时清理。这正是LSTM能够保留长序列早期信息的关键。

三、梯度消失的终结者:LSTM的技术突破

LSTM之所以能解决RNN的梯度消失问题,核心在于细胞状态的线性传递特性。

在朴素RNN中,隐藏状态的更新是一个非线性变换的过程,梯度在反向传播时会被多次乘以权重矩阵,导致梯度指数级衰减(梯度消失)或膨胀(梯度爆炸)。而LSTM的细胞状态更新是近似线性的:

其中

表示元素相乘。反向传播时,梯度可以沿着细胞状态直接传递,避免了多次非线性变换带来的梯度衰减。这就像在一条畅通的高速公路上开车,梯度可以“一路直达”长序列的早期时刻。

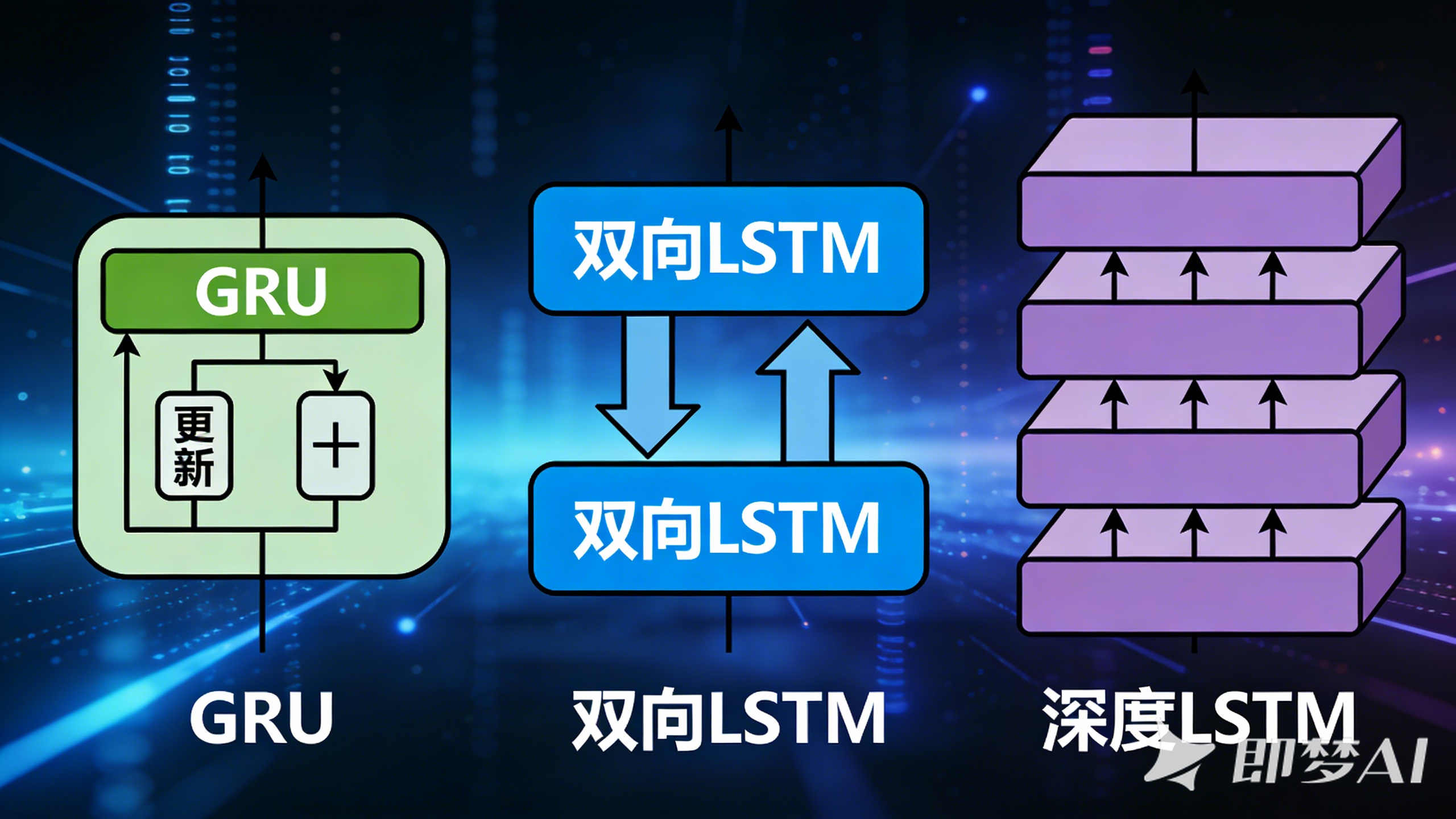

四、LSTM的变体家族:谁更适合你的任务?

为了适配不同的应用场景,LSTM衍生出了多个经典变体,各自有着独特的优势:

在这里插入图片描述

- GRU(门控循环单元):更简洁的“轻量版LSTM” GRU将遗忘门和输入门合并为“更新门”,同时把细胞状态和隐藏状态合并,结构比LSTM更简单,计算效率更高。在数据量较小、计算资源有限的场景下,GRU的性能往往和LSTM不相上下,是性价比极高的选择。

- 双向LSTM:同时“看过去”和“看未来” 单向LSTM只能利用过去的信息,而双向LSTM通过正向和反向两个LSTM的组合,同时捕捉序列的上下文信息。在自然语言处理任务中,比如情感分析、命名实体识别,双向LSTM能够显著提升模型的理解能力——毕竟理解一句话,既需要知道前文,也需要知道后文。

- 深度LSTM:堆叠出来的“记忆深度” 将多层LSTM堆叠起来,就得到了深度LSTM。底层LSTM负责捕捉基础的序列特征,上层LSTM则学习更抽象的高级特征。比如在语音识别中,深度LSTM可以逐层提取语音的声学特征、音节特征和语义特征,大幅提升识别准确率。

五、LSTM vs Transformer:不是替代,而是互补

2017年,Transformer架构凭借自注意力机制横空出世,在自然语言处理领域掀起革命。很多人认为LSTM已经被时代淘汰,但事实并非如此——两者各有所长,是互补而非替代的关系。

对比维度 | LSTM | Transformer |

|---|---|---|

时间复杂度 | 线性复杂度 O ( n ) O(n) O(n),n为序列长度 | 平方复杂度 O ( n 2 ) O(n^2) O(n2),长序列计算成本高 |

数据需求 | 小数据集下泛化能力强 | 依赖大规模数据和预训练,才能发挥优势 |

长序列处理 | 擅长捕捉长序列的局部依赖 | 擅长捕捉长序列的全局依赖 |

计算资源 | 对硬件要求低,适合边缘部署 | 依赖GPU集群,计算成本高 |

,n为序列长度平方复杂度

,长序列计算成本高数据需求小数据集下泛化能力强依赖大规模数据和预训练,才能发挥优势长序列处理擅长捕捉长序列的局部依赖擅长捕捉长序列的全局依赖计算资源对硬件要求低,适合边缘部署依赖GPU集群,计算成本高

实战建议:如果你的任务是小数据集的时序预测(如电力负荷预测、销量预测)、边缘设备上的实时语音识别,LSTM是更优选择;如果你的任务是大规模文本生成、机器翻译,且拥有充足的计算资源,Transformer会带来更好的效果。此外,LSTM-Transformer混合架构(如Longformer)也成为研究热点,它结合了LSTM的线性复杂度和Transformer的全局注意力优势,在长序列建模任务中表现亮眼。

六、LSTM的实战挑战与解决方案

在实际应用中,想要用好LSTM,还需要攻克几个核心难题:

- 超参数调优:隐藏层维度不宜过大(否则容易过拟合),序列长度需要根据任务调整(比如股价预测一般选择3060天的序列长度),学习率建议选择1e-31e-4的范围。

- 过拟合应对:时序数据中,早停法(Early Stopping)和变分Dropout是最有效的正则化手段。变分Dropout在训练过程中保持Dropout掩码不变,更适合序列数据的特性。

- 部署优化:在边缘设备上部署时,可以通过模型量化(将32位浮点数转为16位或8位整数)和剪枝(移除冗余的神经元),大幅降低模型的计算量和内存占用。

七、未来展望:LSTM的“第二春”

随着Mamba(选择性状态空间模型)等新架构的出现,序列建模领域迎来了新的变革。但这并不意味着LSTM会退出历史舞台。在边缘AI和物联网时代,LSTM的低计算需求、高泛化能力的优势愈发凸显——比如在智能手表的语音助手、工业传感器的故障预警等场景中,LSTM依然是不可替代的选择。

从1997年诞生至今,LSTM已经走过了26年的历程。它不是最先进的架构,但却是最经典的序列建模方案之一。理解LSTM的门控机制和记忆原理,不仅能帮助我们更好地解决实际问题,更能让我们窥见深度学习“从模仿人脑到超越人脑”的发展脉络。

附录:学习资源推荐

- 经典论文:《Long Short-Term Memory》(Hochreiter & Schmidhuber, 1997)

- 开源项目:PyTorch官方LSTM教程、Keras时序预测案例

- 公开数据集:股票数据集Yahoo Finance、电力负荷数据集UCI Energy

#深度学习 #LSTM #时间序列分析 #循环神经网络 #AI算法 #序列建模 #PyTorch实战

✨ 坚持用 清晰的图解 +易懂的硬件架构 + 硬件解析, 让每个知识点都 简单明了 ! 🚀 个人主页 :一只大侠的侠 · CSDN 💬 座右铭 : “所谓成功就是以自己的方式度过一生。”

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-12-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录