ransformer一统江湖:视觉、语言与多模态的融合革命

ransformer一统江湖:视觉、语言与多模态的融合革命

一只大侠

发布于 2025-12-31 11:27:54

发布于 2025-12-31 11:27:54

引言:Transformer一统江湖:视觉、语言与多模态的融合革命

五年前,机器学习领域还是“群雄割据”的局面:NLP领域被BERT系列模型统治,计算机视觉(CV)则是CNN的天下,跨模态任务更是需要专门设计的融合模块“牵线搭桥”。而如今,Transformer架构凭借其强大的注意力机制,正逐步打破模态壁垒,实现了视觉、语言乃至多模态领域的统一。从能读懂图文的Qwen2.5-VL,到能生成同步动作与视频的EgoTwin,再到解析生物分子交互的ProDMM,Transformer正在重塑整个机器学习的技术版图。本文将深度解析这一统一进程的核心逻辑,提供可落地的多模态交互实战流程,并附上关键程序代码,帮你快速跟上这波技术浪潮。

在这里插入图片描述

在这里插入图片描述

- 引言:Transformer一统江湖:视觉、语言与多模态的融合革命

- 一、从“分头作战”到“协同统一”:Transformer的进化之路

- 二、核心原理:Transformer统一多模态的三大关键技术

- 三、实战流程:基于ColQwen2的图文检索实现(附完整代码)

- 安装依赖

- 导入所需库

一、从“分头作战”到“协同统一”:Transformer的进化之路

在Transformer一统江湖之前,不同模态的模型就像两条平行线,难以真正交融。NLP领域的BERT通过双向注意力理解文本语义,CV领域的CNN依靠卷积核提取图像特征,而跨模态任务(如图文检索)则需要通过“图像编码器+文本编码器+相似度计算”的三段式结构实现,这种模式存在明显的“模态鸿沟”——模型只能机械匹配特征,无法真正理解图文间的语义关联。

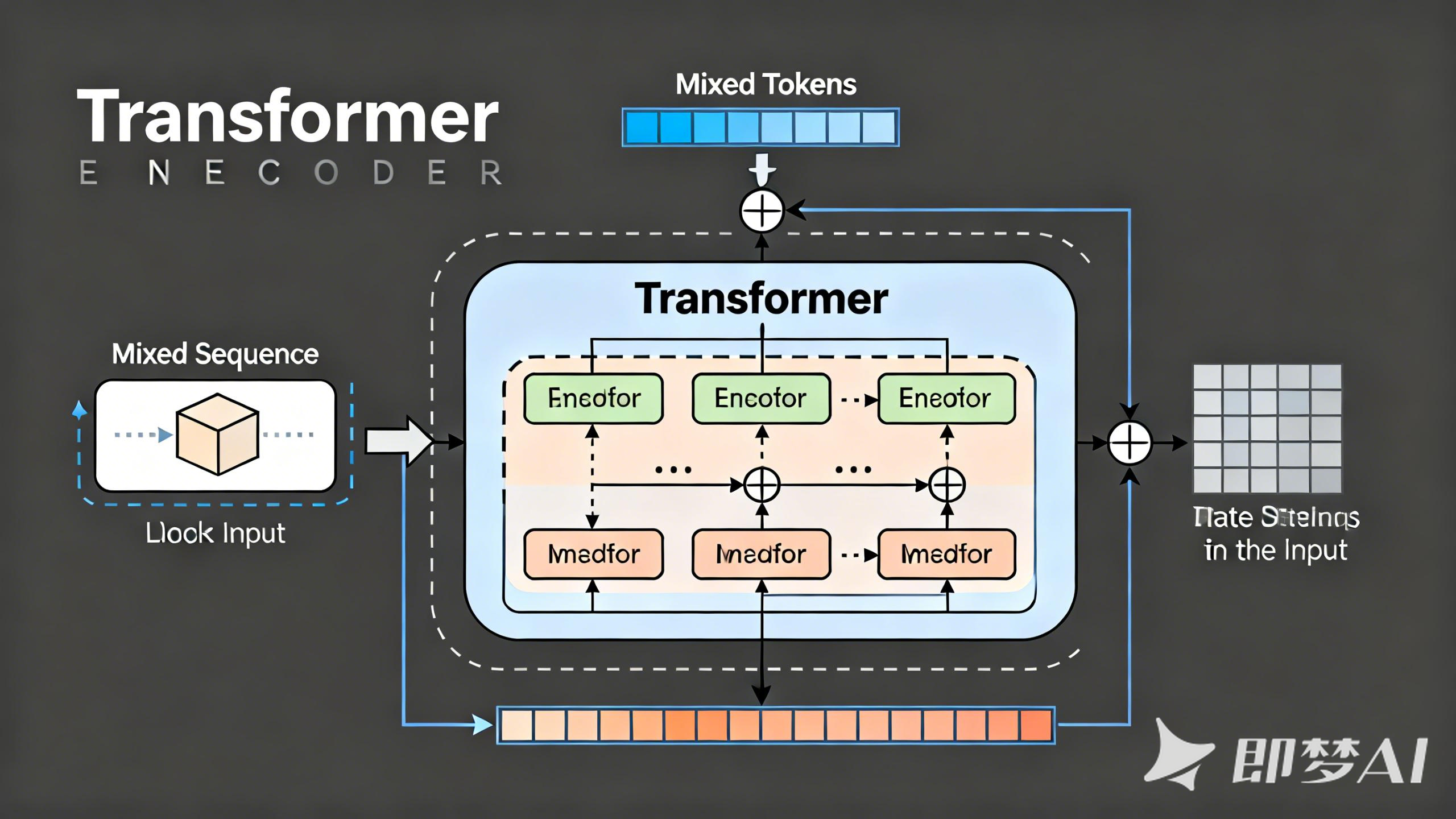

Transformer的出现改变了这一格局,其核心优势在于统一的Token化表征和灵活的自注意力机制。所谓Token化,就是将任意模态的原始数据转换为统一格式的序列单元:文本可以直接拆分为单词Token,图像可以切割为图块(Patch)转换为视觉Token,音频可以分割为帧转换为音频Token。而自注意力机制则能捕捉这些Token间的全局依赖,让模型在统一的框架内学习不同模态的语义关联。这种“万物皆可Token化,万物皆可注意力”的特性,成为Transformer统一多领域的关键钥匙。

从技术演进来看,Transformer的统一之路分为三个阶段:第一阶段是单模态突破,BERT(NLP)、ViT(CV)分别验证了Transformer在单一领域的可行性;第二阶段是跨模态融合,CLIP通过对比学习实现图文特征对齐,开启了多模态研究的热潮;第三阶段是端到端统一,以Qwen2.5-VL、Janus-Pro为代表的模型,将视觉、语言Token直接输入同一Transformer,实现了理解与生成的一体化,彻底打破了模态壁垒。

二、核心原理:Transformer统一多模态的三大关键技术

Transformer之所以能实现多模态统一,并非简单的架构复用,而是在Token编码、交互机制和训练策略上的三大革新。这些技术共同解决了传统模型的模态鸿沟、信息丢失和训练效率问题。

- 统一Token编码:打破模态壁垒的基础

不同模态的数据格式差异巨大,比如文本是一维序列,图像是二维矩阵,视频是三维张量。Transformer统一的第一步,就是将这些异构数据转换为同源的Token序列。以图文统一为例,具体流程为:

- 文本Token化:使用BPE分词器将文本拆分为子词Token,生成文本Token序列(如“猫在沙发上”→ [猫, 在, 沙发, 上]);

- 图像Token化:将图像按固定尺寸切割为N×N的图块(如224×224图像切割为16×16图块,得到196个图块),通过线性层将每个图块转换为视觉Token,生成视觉Token序列;

- 格式对齐:为文本Token和视觉Token添加区分标识(如[TEXT]、[IMAGE]),避免模态混淆,然后拼接为统一的混合Token序列,输入Transformer编码器。

在这里插入图片描述

2025年的最新技术如SigLIP 2的NaFlex机制,还支持原生宽高比输入,无需强制缩放图像,进一步保留了视觉细节,提升了统一表征的质量。

- 视觉迟交互:解决信息丢失的核心方案

传统多模态模型(如CLIP)会将图像压缩为单一向量,导致大量细节丢失,无法处理复杂图文关联(如图表解读、表格分析)。2025年主流的视觉迟交互(Visual Late Interaction)机制彻底解决了这一问题,其核心逻辑是保留多向量表征,延迟相似度计算。

以ColQwen2模型为例,迟交互机制的流程为:① 图像编码时不压缩为单一向量,而是保留128~768个视觉Token向量(每个对应一个图块);② 文本编码生成多个文本Token向量;③ 计算相似度时,让每个文本Token与所有视觉Token逐一匹配,取最大相似度求和(MaxSim操作)。这种方式能精准捕捉局部细节关联,比如查询“表格第三行第二列数据”时,能直接定位对应的图像图块,无需依赖易出错的OCR转换,准确率比传统方案提升20%~30%。

- 统一训练策略:提升跨模态对齐效率

多模态模型的训练难点在于如何让不同模态的Token在语义空间中精准对齐。传统CLIP使用InfoNCE损失函数,存在批量限制(通常32k),导致模型难以学习细粒度差异。2025年的主流方案是采用Sigmoid交叉熵损失函数,实现两大突破:一是解耦计算,支持跨设备并行训练,无需全局同步;二是批量可无限扩展(轻松达到1M+),让模型接触海量负例,能精准区分“阿拉斯加犬”与“哈士奇”这类相似样本。

三、实战流程:基于ColQwen2的图文检索实现(附完整代码)

下面我们以实际场景中的图文检索任务为例,展示基于Transformer的多模态模型实战流程。本次使用开源的ColQwen2模型,该模型支持视觉迟交互,无需OCR即可处理含表格、公式的图像,实用性极强。

- 环境准备与依赖安装

首先安装必要的依赖包,包括模型库、图像处理工具和向量检索库:

安装依赖

!pip install torch transformers pillow qwen-vl colqwen2 sentence-transformers导入所需库

import torch

from PIL import Image

from transformers import AutoProcessor, AutoModel

import numpy as np- 模型加载与初始化

加载预训练的ColQwen2模型和处理器,处理器负责完成图像和文本的Token化:

# 模型和处理器路径(Hugging Face开源地址)

model_name = "Qwen/ColQwen2-VL-2B"

# 加载处理器(处理图文输入的Token化)

processor = AutoProcessor.from_pretrained(model_name, trust_remote_code=True)

# 加载模型(开启推理模式,使用GPU加速)

model = AutoModel.from_pretrained(

model_name,

torch_dtype=torch.float16,

device_map="auto",

trust_remote_code=True

).eval()- 图文编码与特征提取

分别对图像和文本进行编码,生成多向量表征(而非单一向量),保留细节信息:

def extract_image_features(image_path):

"""提取图像的多向量特征"""

# 读取图像

image = Image.open(image_path).convert("RGB")

# 图像编码(返回视觉Token的多向量表征)

with torch.no_grad():

inputs = processor(images=image, return_tensors="pt").to(model.device)

image_features = model.get_image_features(**inputs) # shape: [1, num_patches, hidden_dim]

return image_features.squeeze(0).cpu().numpy()

def extract_text_features(text):

"""提取文本的多向量特征"""

# 文本编码

with torch.no_grad():

inputs = processor(text=text, return_tensors="pt").to(model.device)

text_features = model.get_text_features(**inputs) # shape: [1, num_tokens, hidden_dim]

return text_features.squeeze(0).cpu().numpy()

# 示例:提取单张图像和文本的特征

image_features = extract_image_features("table_image.pdf") # 支持直接输入PDF图像

text_features = extract_text_features("查找续航超过10小时的笔记本电脑参数")- 迟交互相似度计算与检索

采用MaxSim操作计算文本与图像的相似度,实现精准匹配:

def calculate_maxsim_similarity(text_features, image_features):

"""计算迟交互相似度:文本Token与图像Patch逐一匹配取最大值求和"""

# 计算文本Token与图像Patch的点积相似度

similarity_matrix = np.dot(text_features, image_features.T) # shape: [num_text_tokens, num_image_patches]

# 每个文本Token取最大相似度

max_sim_per_text = np.max(similarity_matrix, axis=1) # shape: [num_text_tokens]

# 求和得到总相似度

total_similarity = np.sum(max_sim_per_text)

return total_similarity

# 计算示例图文的相似度

similarity = calculate_maxsim_similarity(text_features, image_features)

print(f"图文相似度:{similarity:.4f}")

# 批量检索:遍历图像库,返回相似度最高的Top-K图像

def retrieve_top_k(text, image_paths, k=3):

text_feat = extract_text_features(text)

similarities = []

for img_path in image_paths:

img_feat = extract_image_features(img_path)

sim = calculate_maxsim_similarity(text_feat, img_feat)

similarities.append((img_path, sim))

# 按相似度降序排序,返回Top-K

similarities.sort(key=lambda x: x[1], reverse=True)

return similarities[:k]

# 检索示例

image_library = ["table1.pdf", "table2.pdf", "product_img1.jpg", "product_img2.jpg"]

top_k_results = retrieve_top_k("查找续航超过10小时的笔记本电脑参数", image_library, k=3)

print("Top-3检索结果:")

for img_path, sim in top_k_results:

print(f"图像:{img_path},相似度:{sim:.4f}")- 结果解读与优化方向

通过上述流程,我们实现了无需OCR的图文检索,即使图像中包含复杂表格或公式,也能精准匹配文本查询。实际应用中,可通过以下方式优化性能:① 增加批量训练数据,微调模型适配特定领域(如电商、医疗);② 使用向量数据库(如FAISS)加速批量检索;③ 结合原生宽高比输入,避免图像缩放导致的细节丢失。

四、前沿应用:Transformer统一多模态的落地场景

Transformer的多模态统一能力已在多个领域落地,从消费级应用到前沿科研,展现出巨大的产业价值。

- 视觉文档理解:重构办公自动化流程

传统办公场景中,PDF文档的表格、公式提取依赖OCR,准确率受排版和字体影响较大。基于ColQwen2等模型的多模态方案,可直接将PDF视为图像,通过视觉迟交互精准提取表格数据、匹配公式含义,将文档处理效率提升50%以上,广泛应用于金融报表分析、学术论文解读等场景。

- 生物医学:解析分子间的跨模态交互

上海交大团队提出的ProDMM模型,将Transformer用于蛋白质与DNA的多模态建模,通过统一序列建模实现了基因表达预测、突变适应性分析等任务。该模型能自动学习氨基酸与密码子的对应关系,为蛋白质工程、代谢通路优化提供了全新工具,将生物实验的试错成本降低30%~40%。

- 具身智能:实现第一视角的动作与视频同步生成

新加坡国立大学团队提出的EgoTwin框架,基于扩散Transformer实现了第一视角视频与人体动作的联合生成。该模型通过三模态注意力机制捕捉“文本-视频-动作”的因果关联,解决了视角对齐难题,为AR交互、可穿戴设备仿真等场景提供了核心技术支撑。

五、总结与未来趋势

Transformer的出现,彻底改变了机器学习领域“模态分割”的格局,通过统一的Token化表征和灵活的注意力机制,实现了视觉、语言乃至更多模态的深度融合。从技术层面看,视觉迟交互、原生宽高比编码、大规模批量训练等技术的演进,持续提升着统一模型的性能;从应用层面看,文档理解、生物医学、具身智能等场景的落地,正在重构各个行业的自动化流程。

未来,Transformer的统一之路将朝着三个方向发展:一是更高效的架构设计,通过MoE(混合专家系统)等技术提升模型效率;二是更泛化的模态支持,实现文本、图像、音频、视频、3D点云的全模态统一;三是更深度的语义理解,结合因果推理解决“相关性≠因果性”的核心问题。对于开发者而言,紧跟Transformer的统一趋势,掌握多模态建模能力,将成为未来十年的核心竞争力。

在这里插入图片描述

✨ 坚持用 清晰的图解 +易懂的硬件架构 + 硬件解析, 让每个知识点都 简单明了 ! 🚀 个人主页 :一只大侠的侠 · CSDN 💬 座右铭 : “所谓成功就是以自己的方式度过一生。”

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-12-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录