Meta AI网络架构融合篇:基于10X Backbone与ZR/ZR+ 相干光模块的吉瓦级AI骨干网大动脉

Meta AI网络架构融合篇:基于10X Backbone与ZR/ZR+ 相干光模块的吉瓦级AI骨干网大动脉

AGI小咖

发布于 2025-12-22 11:44:21

发布于 2025-12-22 11:44:21

AGI小咖

"作为Meta AI 网络架构系列融合篇,本文深度拆解 Meta 面向吉瓦级算力互联重构的 10x Backbone 架构——基于IP over DWDM(IPoDWDM)与光传输解耦理念,利用 ZR/ZR+ 相干光模块与 DC Metro 环网深度融合的去 DCI-BOX 光电底座;并依托 Open/R 路由系统与 SBT (Scheduled Bulk Transfers) 全局流量编排机制,重塑连接吉瓦级算力孤岛的 AI 骨干网大动脉。"

PART 01

MetaAI网络架构前瞻回顾

在《Meta AI网络架构前传:RoCEv2在Llama3万卡集群中的失效与救赎》中,我们分享了Meta在部署24K H100GPU集群的工程实践中发现传统RoCEv2在AI“低熵、突发、大象流”下的失效难题,尝试了从星型到三层Clos的拓扑变革,从E-ECMP到集中式TE流量工程的路由迭代,以及从DCQCN失效到接收端驱动流控的突破等一系列“填坑”工程实践经验,这些宝贵的“填坑”经验成为下一代网络架构的“原型”和“试验场”,加速定制化DSF与开放式NSF的诞生。

紧接着在《Meta AI网络架构续集:DSF,一台“榨干”以太网物理极限的“F1赛车”,却难做“保时捷911”》中,我们继续分享了Meta工程师基于前人“填坑”经验设计了全新的DSF无损确定性网络,DSF采用前后端物理隔离与双平面冗余设计,创新性地引入以太网域与交换网域的双域解构架构,利用信元喷射技术打破大象流瓶颈;深度联动自研FBOSS控制平面和VOQ+Credit硬件流控结合输入均衡模式,实现了微秒级精度的无阻塞调度与链路故障的分布式自愈,将确定性调度和链路效率推向了物理极限。

尽管DSF性能极致,但对深缓存、高吞吐、低延迟专用交换芯片的强依赖制约了“吉瓦级”超大规模AI数据中心集群扩展,为下一代拥抱通用以太网的NSF(非调度网络)埋下伏笔。

接下来在《Meta AI网络架构再探:NSF如何驾驭双柜NVL72超节点,重构吉瓦级AI底座?》中,我们分享了Meta面向吉瓦级集群(如Prometheus)重构的非调度架构(NSF)——基于浅缓存商用以太网(如搭载NVIDIA Spectrum-4 ASIC的Minipack 3N)和基于ORv3标准定制的高功率双机柜NVL72超节点(Catalina Pod)深度融合的高性能底座,依托原生支持自适应路由与Spectrum-X端网协同机制重构吉瓦级AI基础设施,完成了从专用定制向开放解耦的范式转移。

当NSF架构成功将单体集群扩展至数万张GPU时,新的物理矛盾出现了——能源。

一个包含8000个机柜的GB200 NVL 72集群(Catalina Pod)可能消耗超过1吉瓦(GW)的电力。在全球范围内,极少有单一园区能提供如此巨大的瞬时功率和相应的散热能力。因此,Meta必须将物理上分散在不同地理位置(如俄亥俄州、弗吉尼亚州、俄勒冈州)的数据中心,在逻辑上整合成一台“超级计算机”。这就要求连接这些数据中心的骨干网必须具备极高的带宽密度、确定性的延迟以及极高的能效比,以化解这一“能源-距离悖论”。

PART 02

架构分野:双骨干网策略

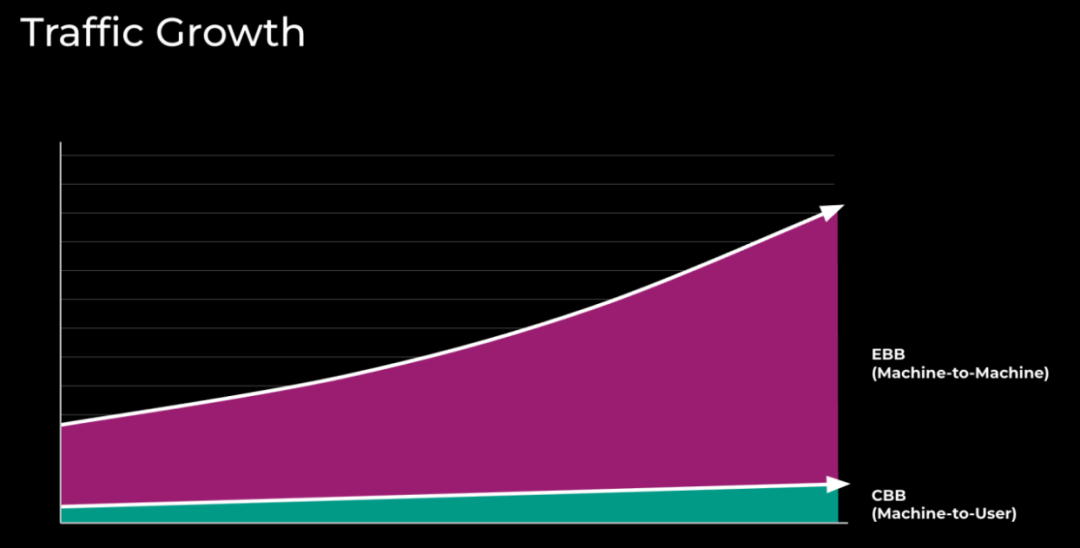

为了隔离不同SLA和流量特征的业务,Meta运营着两张物理上截然不同的骨干网:

- 经典骨干网(CBB):服务于全球用户的“公网大动脉”,类似于电信ChinaNet(163骨干网),CBB用于实现从数据中心(DC)到我们接入点(POP)的全球覆盖,采用传统的IP/MPLS-TE(互联网协议/多协议标签交换/流量工程)技术,负责将Meta的服务推送至全球边缘,承载数十亿用户的HTTP/Video请求。

- 极速骨干网(EBB):服务于AI集群的“广域DCI专网”类似于阿里/腾讯/字节的长途DCI骨干专网,区别于Llama4集群内部的“园区级短距互联”,EBB专注于在跨州、跨洋的广域尺度上,运行自研的Open/R路由协议与集中式TE控制器等高度定制的软件栈,解决数据中心孤岛之间海量训练数据与模型参数的异步搬运问题。

图1:Meta骨干网流量增长趋势(EBBvsCBB)

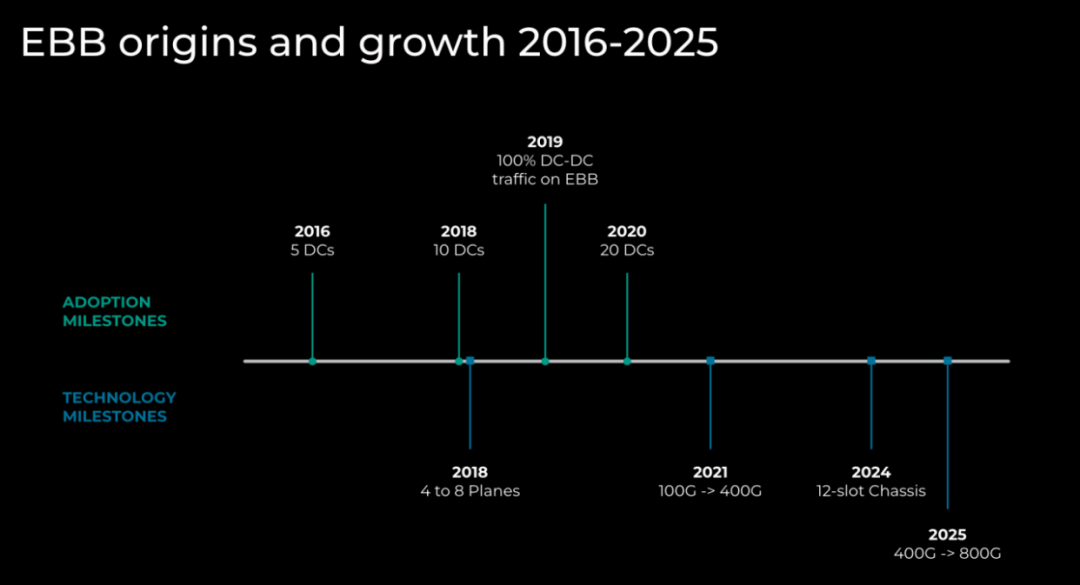

图2:EBB技术演进里程碑(2016-2025)

如图所示,EBB网络自2015年正式投产以来,完成了从2016年仅连接5个数据中心的实验性网络,到2025年凭借前沿“C+L波段800G ZR+技术”全面支撑吉瓦级集群的跨越。EBB网络流量增长轨迹呈现出与AI模型参数量高度耦合的指数级爆发,深刻演绎了骨干网带宽与算力摩尔定律的齐头并进。

PART 03

10X Backbone全栈技术解构

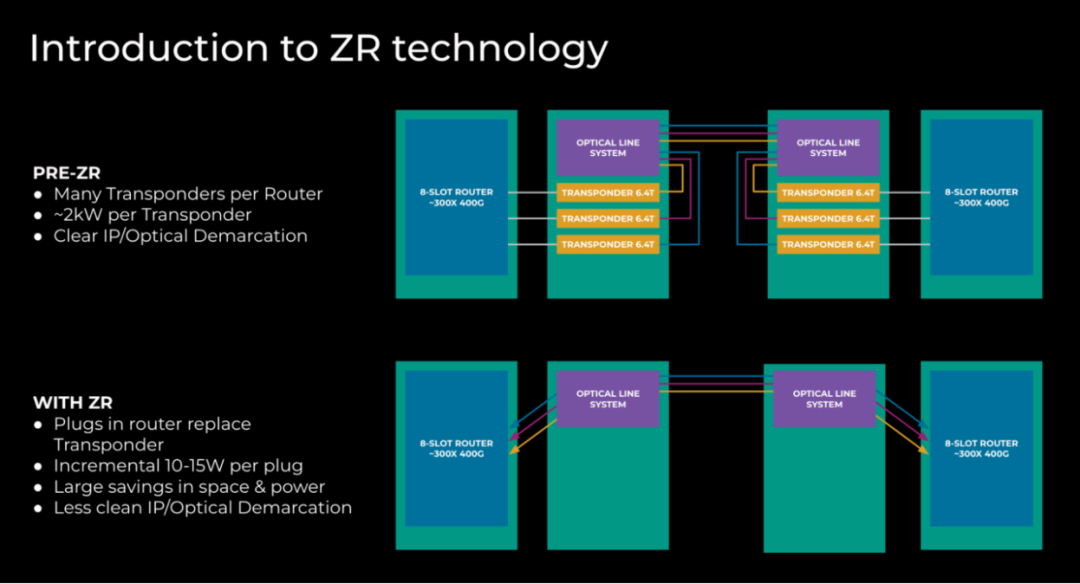

4.1 传输设备重构:IPoDWDM与光传输解耦

不同于传统电信级架构采用“路由器+独立传输设备(DCI-BOX)”的级联模式,Meta激进地推动了IP over DWDM(IPoDWDM)技术的全面落地:通过在路由器端口直接集成400G ZR和800G ZR+ 相干光模块,彻底消除了中间的传输设备层级,实现了物理架构的极简与扁平化。

图3:引入ZR前后的网络拓扑结构

在此基础上,Meta的技术演进重点从仅适用于短距数据中心互联(<120km)的400G ZR模块,转向支持长距骨干网的新一代C+L波段800G ZR+ 相干光模块。后者通过引入更高阶的oFEC纠错算法与多速率自适应能力,原生支持1000—2000km的长距传输,具备了替代传统长途转发器、承载跨洲骨干网流量的特性。

根据Meta在ODNM 2025峰会上披露的数据,在1300公里以内的传输距离上,800G ZR+ 相干光模块(运行于600G或800G模式)的能效显著优于传统高性能转发器。凭借这一优势,800G ZR+已在Meta骨干网中实现89%的覆盖率,成为新一代骨干网的主流物理层介质。

为了适配ZR+ 相干光模块的物理特性,Meta彻底重构了光网络拓扑即抛弃了复杂的Mesh(网状网)拓扑转向极简的P2P架构,同时为了最大化发挥ZR+ 相干光模块在1000km内的传输效能,Meta移除了中间站点的ROADM设备改用Glass-Through(光直通)技术,配合集中式TE的光层跳数惩罚策略——即大幅增加经过中间光节点链路的路由开销(Metric),Meta在逻辑上强制流量优先选择低损耗的物理直连链路,不仅彻底消除了传统波长竞争,更实现了光层控制平面的极致简化。

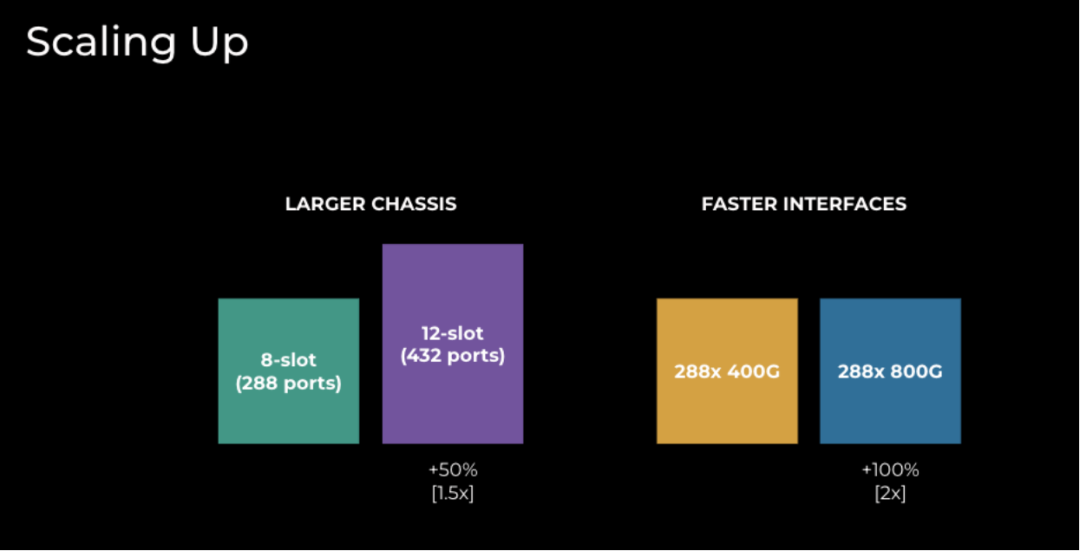

4.2 IP平台演进:Scale-Up与Scale-Out演进

为了支撑物理层ZR+ 相干光模块所带来的海量带宽需求,Meta在10X Backbone的演进中采取了Scale-Up与Scale-Out双轨并行的策略。

- 在Scale-Up方面Meta聚焦于追求单机设备的极致高密度重构:通过将传统8槽位机箱升级为12槽位高密度机箱,单设备物理容量提升50%;依托新一代高性能ASIC(如51.2T级别芯片)将端口速率从400G全面升级至800G,在保持布线密度不变的前提下实现了单链路容量的翻倍,但也带来了严峻的供电与散热密度挑战。另外,随着单机ASIC数量显著增加,网络操作系统(NOS)的编程复杂度与接口管理难度呈指数级上升,激增的光纤布线密度更对机房物理基础设施的设计与运维提出了极限考验。

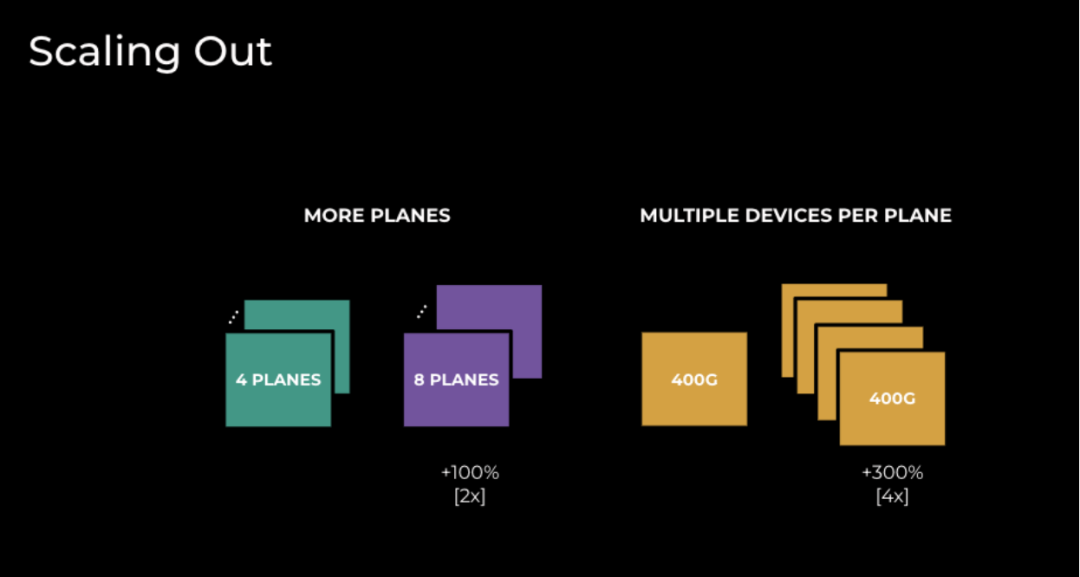

图4:EBBScale-Up纵向扩展技术

- 面对单机扩展的物理瓶颈,Meta同步推进Scale-Out层面的演进,其核心演进方向是将数据中心内部成熟的Clos架构引入10X Backbone。具体而言物理网络被划分为多个相互独立的平行平面(例如从4平面扩展至8平面)。当骨干网容量达到上限时,无需更换现有设备,只需新增一个平面即可实现容量的线性扩容,这种按需横向扩展的模式显著提升了网络弹性以及有效缩小了故障影响范围,标志着广域网正式迈入“数据中心化”时代。但这一架构也带来复杂的工程挑战:增加平面意味着需要在全球多个站点同步进行复杂的“光纤重排(Fiber Restriping)”、复杂的全互联拓扑管理、对自动化运维提出了极高要求。

图5:EBB Scale-Out横向扩展技术

4.3 控制平面:Open/R与全局流量编排

EBB的控制平面基于Meta自研的Open/R构建,作为一个基于KvStore的分布式消息总线,Open/R具备秒级收敛能力,支持承载TE控制器下发的非路由元数据,完美适配多平面的复杂拓扑。

另外,不同于传统SR-TE仅基于空间维度的CSPF算法,全局流量编排引入了SBT(Scheduled Bulk Transfers)机制——在SR-TE技术栈的基础上创新性地引入了“带宽日历(Bandwidth Calendar)”,让TE控制器能够为Llama4 Checkpoint等关键任务提前锁定未来的光传输路径与带宽资源,确保任务在预定周期内不受其他流量干扰,实现了从“尽力而为”到“确定性预约”的范式跨越。

4.4 拓扑演进:AI Backbone与城域环网

随着单体数据中心园区的电力容量逼近物理极限,Meta将骨干网架构正式升级为“AI Backbone”——在同城地理范围内通过将多栋物理隔离的数据中心进行超大带宽互联,构建出一个逻辑统一的吉瓦级超级集群。

图6:AI Backbone拓扑全景

4.4.1 DC Metro Architecture:城域环网的预构建

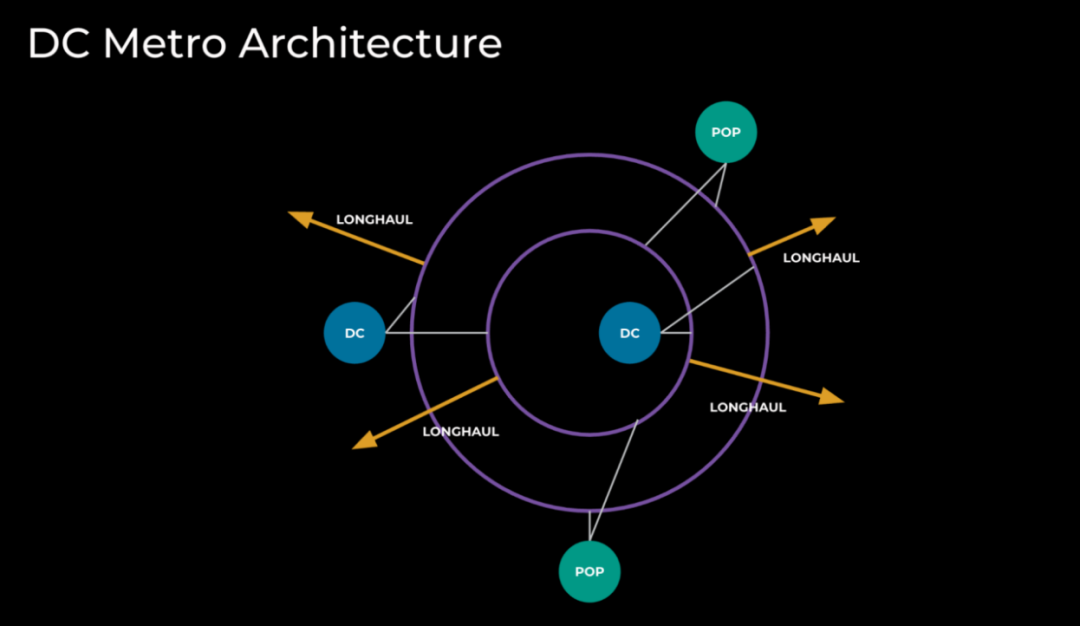

为了打破AI算力选址的物理约束,Meta摒弃了传统的长途直连模式,创新性地在核心区域预先铺设高密度的双光纤环网(Dual FiberRings)与预置POP点的组合架构——长途光缆不再直接进入数据中心,而是汇聚至环网上的POP点,这一组合架构设计与天翼云资源池就近接入云网POP异曲同工之妙:通过将数据中心与骨干网物理路径彻底解耦,新建AI集群无需等待漫长的长途光缆铺设,只需就近“热插拔”接入POP点即可快速复用骨干网的全球连接资源,极大缩短了服务等待时间。

图7:DCMetro环网架构

4.4.2 物理连接的三级阶梯

在AI Backbone的构建中,Meta根据物理距离制定了精细化的三级光互联标准,以在成本、延迟与光纤资源之间取得极致平衡:

- <3km(园区级):采用最廉价、最低延迟的点对点(P2P)直连方案和FR(FiberReach)光模块,Meta通过链路预算优化技术实现传输距离由原来的2km延伸至3km。

- 3km—10km(城域级):点对点(P2P)直连架构升级为LR(LongReach)光模块,利用暗光纤资源换取极简运维,避免引入复杂的有源传输设备。

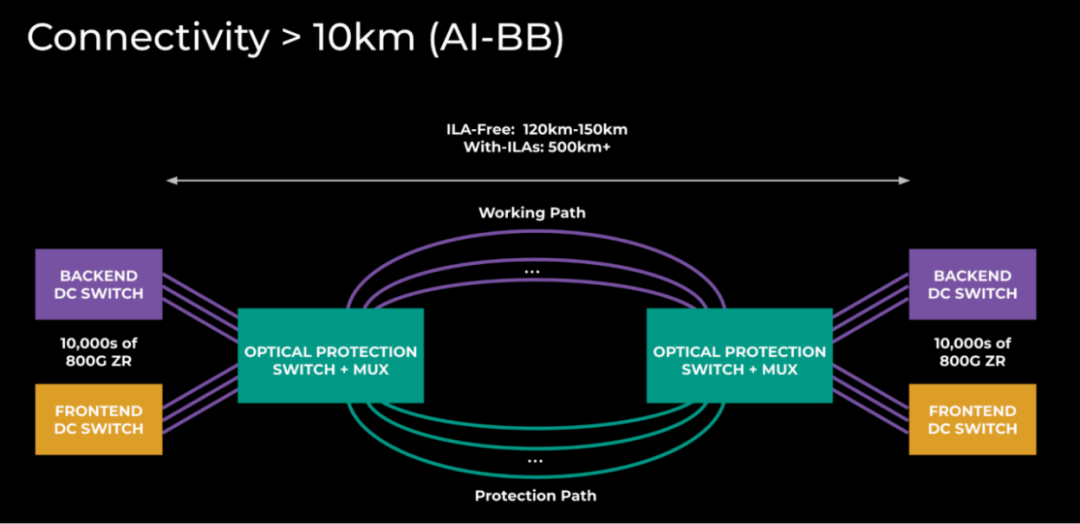

- >10km(区域级):采用ZR/ZR+ 相干光模块与IP over DWDM(IPoDWDM)的组合方案,在单对光纤上借助波分复用技术实现高达51.2T的传输容量,以极简的物理链路支撑长距离、高通量的数据输送。

PART 04

结语

面对从“计算墙”到“能源墙”的挑战,Meta利用ZR+相干光模块与DC Metro环网构建了极简的点对点 (P2P) 去 DCI-BOX光电底座,依托Open/R 路由系统与以SBT (Scheduled Bulk Transfers) 为核心约束的集中式流量工程 (TE) 深度协同,成功重塑了连接吉瓦级算力孤岛的 AI 骨干网大动脉。

Meta在10X Backbone上实现800G ZR+相干光模块规模化商用的基础上,积极推动下一代1.6T ZR+ 相干光模块的标准化与规模化落地,旨在进一步逼近光纤传输的频谱效率与香农极限。

展望未来,AI 骨干网有望迈入基于光电路交换(OCS)的全光网络时代,在中间节点实现无需光电转换的全光交换(All-Optical Switching),为未来构建一张高吞吐、低延迟、跨地域的吉瓦级AI骨干专网奠定坚实的物理基础。

往期推荐

三大超节点:昇腾384 VS 阿里磐久AL128 VS NVIDIA GB200 NVL72,网工视角,谁主沉浮?

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-12-02,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读