InfraGPT:基于视觉语言模型的端到端智能基础设施缺陷检测与管理框架

原创InfraGPT:基于视觉语言模型的端到端智能基础设施缺陷检测与管理框架

原创

AI小怪兽

修改于 2026-01-10 10:01:47

修改于 2026-01-10 10:01:47

📄 论文核心摘要

InfraGPT框架的主要贡献可归纳为以下三点:

- 端到端的VLM融合框架:构建了一个统一的视觉语言管道,将YOLO系列模型的强缺陷检测能力与VLM的上下文推理能力相结合,实现了从原始图像输入到生成维护决策的完整自动化。这改变了传统方法只检测不解释的局限。

- 自适应模型协调机制:框架中的视觉语言模型充当了智能调度器的角色。它能对场景进行初步语义分析,并据此动态选择最合适的YOLO变体进行精细检测。这种机制实现了精度与计算效率的动态平衡。

- 结构化输出生成:创新地引入了标准化的JSON输出格式。该输出不仅包含缺陷类型、位置,还整合了严重程度估计、推荐工具、紧急等级等上下文信息,将感知结果直接转化为可集成至运维系统的结构化维修计划。

博主简介

AI小怪兽 | 计算机视觉布道者 | 视觉检测领域创新者

深耕计算机视觉与深度学习领域,专注于视觉检测前沿技术的探索与突破。长期致力于YOLO系列算法的结构性创新、性能极限优化与工业级落地实践,旨在打通从学术研究到产业应用的最后一公里。

🚀 核心专长与技术创新

- YOLO算法结构性创新:于CSDN平台原创发布《YOLOv13魔术师》、《YOLOv12魔术师》等全系列深度专栏。系统性提出并开源了多项原创自研模块,在模型轻量化设计、多维度注意力机制融合、特征金字塔重构等关键方向完成了一系列突破性实践,为行业提供了具备高参考价值的技术路径与完整解决方案。

- 技术生态建设与知识传播:独立运营 “计算机视觉大作战” 公众号(粉丝1.6万),成功构建高质量的技术交流社群。致力于将复杂算法转化为通俗易懂的解读与可复现的工程代码,显著降低了计算机视觉的技术入门门槛。

🏆 行业影响力与商业实践

- 荣获腾讯云年度影响力作者与创作之星奖项,内容质量与专业性获行业权威平台认证。

- 全网累计拥有 7万+ 垂直领域技术受众,专栏文章总阅读量突破百万,在目标检测领域形成了广泛的学术与工业影响力。

- 具备丰富的企业级项目交付经验,曾为工业视觉检测、智慧城市安防等多个关键领域提供定制化的算法模型与解决方案,驱动业务智能化升级。

💡 未来方向与使命

秉持 “让每一行代码都有温度” 的技术理念,未来将持续聚焦于实时检测、语义分割及工业缺陷检测的商业化闭环等核心方向。愿与业界同仁协同创新,共同推动技术边界,以坚实的技术能力赋能实体经济与行业变革。

原理介绍

论文:https://arxiv.org/pdf/2510.16017

摘要——智慧城市中的基础设施正日益受到闭路电视(CCTV)监控网络的覆盖。道路、桥梁与隧道会出现裂缝、坑洼和液体渗漏等缺陷,这些隐患威胁公共安全并需及时修复。人工检测成本高昂且具有危险性,而现有自动化系统通常仅能针对单一缺陷类型进行分析,或提供非结构化的输出结果,难以直接指导维护作业。本文提出一种综合处理流程:通过YOLO系列目标检测器利用街道CCTV视频流实现多类型缺陷检测与分割,并将检测结果传递至视觉-语言模型(VLM)进行场景感知的汇总分析。该VLM可生成JSON格式的结构化行动方案,包含事件描述、推荐工具、缺陷尺寸、维修方案及紧急告警等信息。我们系统回顾了关于路面坑洼、裂缝及渗漏检测的研究文献,重点关注Qwen-VL、LLaVA等大型视觉-语言模型的最新进展,并阐述了早期原型系统的设计思路。在公共数据集及采集CCTV片段上的实验表明,本系统能准确识别多种缺陷并生成条理清晰的汇总报告。最后,我们讨论了将该系统扩展至城市级部署面临的挑战与发展方向。

伪代码如下:

# ============================================

# InfraGPT: 基于VLM的端到端城市缺陷检测与管理框架

# ============================================

class InfraGPT:

def __init__(self):

self.vlm_model = VisionLanguageModel() # 多模态模型

self.defect_db = UrbanDefectDatabase() # 缺陷数据库

self.report_generator = ReportGenerator() # 报告生成器

def process_urban_infrastructure(self, input_data):

"""

端到端处理流程

输入: 图像/视频/传感器数据

输出: 缺陷报告与管理建议

"""

# 1. 多模态数据预处理

processed_data = self.preprocess(input_data)

# 2. VLM缺陷检测与分析

defect_results = self.detect_defects_vlm(processed_data)

# 3. 缺陷分类与风险评估

classified_defects = self.classify_and_assess(defect_results)

# 4. 管理决策生成

management_plan = self.generate_management_plan(classified_defects)

# 5. 输出与可视化

self.output_results(defect_results, management_plan)

return management_plan

def detect_defects_vlm(self, data):

"""

基于VLM的缺陷检测核心算法

"""

# 提示工程构建

prompt = self.construct_prompt(data.context)

# 多模态理解

vlm_input = {

"image": data.image,

"text_prompt": prompt,

"historical_data": self.defect_db.get_similar_cases()

}

# VLM推理

raw_output = self.vlm_model.inference(vlm_input)

# 后处理与解析

defects = self.parse_vlm_output(raw_output)

return defects

def generate_management_plan(self, defects):

"""

生成管理计划

"""

plan = {

"urgent_repairs": [],

"scheduled_maintenance": [],

"long_term_improvements": [],

"budget_estimation": self.estimate_costs(defects),

"timeline": self.generate_timeline(defects)

}

for defect in defects:

if defect.severity > THRESHOLD_URGENT:

plan["urgent_repairs"].append(defect)

elif defect.severity > THRESHOLD_NORMAL:

plan["scheduled_maintenance"].append(defect)

else:

plan["long_term_improvements"].append(defect)

return plan

class VisionLanguageModel:

"""

VLM模型封装

"""

def __init__(self):

self.model = self.load_pretrained_model()

self.adaptor = DomainAdaptor() # 领域适配器

def inference(self, multimodal_input):

"""

多模态推理

"""

# 特征提取

visual_features = self.extract_visual_features(multimodal_input["image"])

text_features = self.extract_text_features(multimodal_input["text_prompt"])

# 跨模态融合

fused_features = self.cross_modal_fusion(visual_features, text_features)

# 领域适应(城市基础设施)

adapted_features = self.adaptor.adapt_to_urban_domain(fused_features)

# 缺陷推理

output = self.defect_reasoning(adapted_features)

return output

class UrbanDefectDatabase:

"""

城市缺陷知识库

"""

def add_defect_case(self, defect_data):

"""添加新缺陷案例"""

self.store(defect_data)

self.update_statistics()

def get_similar_cases(self, current_defect):

"""检索相似历史案例"""

return self.semantic_search(current_defect.description)

def predict_trends(self):

"""预测缺陷趋势"""

return self.analyze_temporal_patterns()

def main_workflow():

"""

主工作流程

"""

# 初始化InfraGPT系统

infragpt = InfraGPT()

# 数据源(可扩展为实时监控)

data_sources = [

"satellite_imagery",

"street_view_images",

"drone_footage",

"citizen_reports"

]

for source in data_sources:

# 数据采集

urban_data = collect_data(source)

# 端到端处理

results = infragpt.process_urban_infrastructure(urban_data)

# 更新知识库

infragpt.defect_db.add_defect_case(results)

# 生成行动项

actions = generate_actions(results)

# 可视化与报告

visualize_results(results)

generate_official_report(results, actions)

# ============================================

# 辅助函数与类

# ============================================

def adaptive_sampling_strategy(area_size, previous_defects):

"""

自适应采样策略:基于历史缺陷密度调整检测频率

"""

base_frequency = 1.0 # 基础检测频率

if previous_defects.high_density:

return base_frequency * 3.0 # 高风险区域增加频率

elif previous_defects.medium_density:

return base_frequency * 1.5

else:

return base_frequency

class RealTimeMonitor:

"""

实时监控模块(可选扩展)

"""

def stream_processing(self, video_stream):

"""

实时视频流处理

"""

for frame in video_stream:

# 实时缺陷检测

defects = infragpt.detect_defects_vlm(frame)

# 即时报警

if defects.critical:

self.send_alert(defects.location, defects.type)I. 引言

智慧城市日益依赖持续的基础设施监测来确保安全与可持续性。道路表面、桥梁、隧道和管道会因交通载荷、老化及环境应力而随时间退化。及早发现此类损坏有助于预防事故并降低维护成本。然而,传统的检测工作流程仍主要依赖人工,需要进行现场勘查或静态图像审查,这种方式速度慢、成本高且容易出错。与此同时,大多数城市已经为交通和安全目的部署了密集的闭路电视监控网络。这些摄像头提供了大量的实时视觉数据,如果能够智能地分析这些数据,则无需额外的传感硬件即可用于检测和评估基础设施缺陷。将这些非结构化的视觉数据转化为可指导维护行动的信息,仍然是一个重大的研究挑战。

深度学习在视觉识别任务方面取得了实质性进展。诸如 YOLOv8 等现代目标检测器能够以高帧率识别道路裂缝、坑洼或泄漏 [1]。然而,这些模型仅输出边界框或掩码,并未解释所检测到缺陷的上下文含义。维护团队仍然需要手动解读检测结果、估计严重程度并规划维修。弥合这一差距需要将感知与推理相结合,将"所见"与"所需行动"联系起来。

基础设施表面呈现出多样化且常常相互重叠的缺陷,例如裂缝、坑洞和液体泄漏,每种缺陷都有不同的形状、纹理和上下文外观。光照、视角、天气和背景噪声的变化使得在真实环境中进行检测充满挑战。此外,现有系统未能提供关于缺陷严重性、共现关系或空间关系的上下文推理,而这些对于确定维修优先级至关重要。维护人员仍然依赖手动解读原始检测结果来决定行动、工具和紧急程度,这在感知与运营决策之间造成了瓶颈。

大量研究致力于解决各个缺陷类别的检测问题。卷积和基于变换器的检测器已被应用于坑洞识别 [2]、裂缝检测 [3] 以及隧道和管道中的泄漏分割 [4]。这些研究展示了强大的技术性能,但未能产出将视觉结果与维护工作流程连接起来的结构化输出。与此同时,视觉语言模型 的进展,如 Qwen-VL 和 LLaVA,已展现出解释视觉场景、回答问题及总结多模态输入的能力 [5], [6]。尽管它们在通用场景理解方面取得了成功,但很少有研究探索它们在基础设施监测中的应用:特别是它们对检测到的缺陷进行推理并自主生成维修计划的潜力。

为了弥合这一差距,我们提出了 InfraGPT,一个用于自动化基础设施监测和维护规划的端到端视觉语言流程。该系统将多缺陷检测、多模态推理和结构化决策生成结合到一个统一的流程中。

InfraGPT 集成了一个基于 YOLO 的检测模块,用于识别多样化的基础设施缺陷,并与一个承担双重角色的视觉语言模型相结合:

- InfraGPT 框架: 一个统一的端到端视觉语言流程,旨在将原始摄像头数据转化为可操作的基础设施情报。与传统方法仅专注于检测不同,InfraGPT 覆盖了从感知到决策的完整链条——在一个集成的流程内进行检测、解读并生成维修指令。该框架将目标检测、分割和视觉语言推理融合到一个模块化架构中,该架构具有适应性、可扩展性,并兼容实时部署。

- 自适应模型协调: InfraGPT 的一个关键新颖之处在于其基于 VLM 的检测模型协调机制。视觉语言模型 动态评估场景复杂性和环境因素,以选择最合适的 YOLO 变体并对之进行参数化,从而检测缺陷(例如,水管泄漏或道路裂缝)。这种自适应推理使系统能够在不同基础设施环境中动态平衡精度与计算效率,从而提高鲁棒性,而无需手动重新调整或训练。

- 结构化行动生成: InfraGPT 引入了一种结构化决策生成机制,将原始检测结果和上下文推理转换为一个基于 JSON 的标准化操作模式。生成的输出捕获了多层信息——缺陷类型、位置、置信度、估计尺寸、推荐工具和材料、紧急程度以及维修备注。这种结构将非结构化的视觉输出转化为机器可读的记录,适用于与维护管理平台、数字孪生和自动调度系统集成,从而弥合了感知与运营响应之间的差距。

II. 相关工作

A. 基于视觉的基础设施缺陷检测

随着深度学习的进步,卷积神经网络 检测器开始主导这一领域。诸如 Faster R-CNN 这样的两阶段检测器提供了较高的定位精度,但带来了显著的计算开销,使其不太适合连续监测。而单阶段网络——特别是 YOLO 系列——因其统一的检测范式以及良好的速度-精度权衡,已成为实时缺陷检测的首选 [7], [8]。

近期的研究致力于将 YOLO 架构适配到基础设施任务中。例如,Lyu 等人通过注意力模块和特征融合增强优化了 YOLOv8 用于裂缝检测,证明了其在挑战性环境中检测精度的提升。同时,一种名为 YOLOv11-EMC 的优化框架被提出,通过集成可变形卷积和动态模块来检测多类混凝土缺陷(裂缝、剥落、分层),在精确度、召回率和 mAP 上均优于基线 YOLOv11 [9]。

大型标注数据集如 Crack500、Road Damage Dataset 2022 和 Pothole-600 加速了进展,尽管大多数数据集仍受限于领域偏移(光照、摄像头角度或天气)问题。因此,数据增强和领域自适应仍然是活跃的研究方向 [10]。

B. 场景理解与视觉语言模型

视觉语言模型 的出现通过大规模预训练联合处理图像和文本,变革了多模态理解。诸如 CLIP [11]、BLIP-2 [12]、LLaVA [13] 和 Qwen-VL [5] 等基础模型连接了视觉与语言领域,实现了跨任意场景的零样本分类、视觉问答 和描述生成。这些架构将视觉编码器(例如,ViT, Swin-Transformer)与基于变换器的语言解码器耦合,以实现语义场景理解,使系统能够对物体、关系和上下文进行超越单纯检测的推理。它们在遥感和工业检测中的成功展示了其对先前未见环境的强大泛化能力,这推动了对基础设施分析领域特定适配的研究。

基于这些基础,近期研究已将 VLM 应用于缺陷解释和报告生成。例如,Liang 等人 [14] 提出的 CrackCLIP 模型适配 CLIP 嵌入,通过文本引导的提示来识别裂缝,表明大型预训练 VLM 能够在极少量监督下有效地迁移到基础设施缺陷检测中。

C. 结构化推理与行动计划生成

人工智能的最新发展已将多模态理解从感知和描述扩展到结构化推理和决策生成。越来越多的研究专注于将非结构化的视觉或文本信息转换为机器可读的格式(例如基于本体的模式),以促进下游自动化 [15]。例如,当代以数据为中心的视觉研究探索了从图像生成结构化场景图和键值输出,使系统能够对检测到的实体之间的上下文和空间关系进行编码 [16]。此类方法标志着从纯粹感知识别向知识驱动推理的转变,使 AI 能够以适合自动化决策的形式来表示场景语义。

大型语言模型 和视觉语言模型 的并行进展加速了自主决策流程的创建。诸如 GPT-4V [17] 等模型已展现出解释视觉输入并生成符合用户定义模式的结构化输出的能力 [18]。在机器人和具身 AI 领域,多项研究已采用 LLM 将自然语言指令转换为结构化的任务计划,对顺序动作、所需工具和环境参数进行编码 [19], [20]。这些框架凸显了多模态推理在连接感知与执行方面的潜力,正朝着模式驱动的自主性发展,即 AI 系统在预定义的动作模板内进行推理,而非生成自由文本。

尽管取得了这些进展,一些关键挑战依然存在。Zhang 等人 [21] 指出,确保模式对齐仍然是一个主要障碍,因为生成模型经常产生偏离预定义字段结构或包含不一致键值映射的输出。另一个长期存在的限制是幻觉控制,即模型在结构化输出中生成语法上有效但事实上错误或上下文无关的条目。此外,这些系统的可靠性通常严重依赖于提示词的表述,因为措辞上的微小变化就可能显著改变生成的 JSON 或本体数据的结构或语义。解决这些问题需要引入受控解码策略、模式约束生成以及验证机制,以确保模型输出的语法正确性和语义保真度。

III. 方法论

本节介绍 InfraGPT 的架构和操作流程,这是一个用于基础设施缺陷检测和结构化维护规划的端到端视觉语言框架。所提出的系统集成了一个用于上下文推理和决策控制的视觉语言模型 与一个基于 YOLO 的目标检测器,用于缺陷的精确定位和分类。InfraGPT 处理从任何视觉源(例如,闭路电视、无人机或移动摄像头)获取的图像或视频帧,并实时生成结构化的维护建议。

A. 系统概述

InfraGPT 的整体架构如图 1 所示。该系统包含三个主要处理组件:一个输入获取模块、一个基于 VLM 的控制模块和一个结构化推理单元。在第一阶段,视觉输入 I ∈ R^(H×W×3) 从实时或离线源捕获,并进行预处理以实现归一化和分辨率一致性。第二阶段采用预训练的视觉语言模型(例如 Qwen-VL 或 LLaVA)对图像进行粗略的语义分析,判断是否存在任何与基础设施相关的缺陷。该模型产生一个初始的二元决策向量:

其中 s_c, s_l, s_o ∈ {0, 1} 分别对应裂缝、泄漏和其他结构异常存在的可能性。该决策向量动态控制激活哪个 YOLO 变体以进行细粒度检测和定位。一旦被激活,YOLO 模型 f_θk 根据下式执行检测:

其中 b_i 代表边界框坐标,c_i 代表预测的缺陷类别,s_i 代表置信度分数。产生的检测结果和标注图像随后被传递回 VLM 进行更高层次的推理,最终以机器可读的格式生成结构化的维护计划。

B. 视觉语言控制器

控制器阶段利用能够同时进行视觉理解和基于语言推理的大规模视觉语言模型。本研究采用了两种模型系列:Qwen-VL [5](一个基于 Transformer 的模型,用于视觉定位和多语言理解)和 LLaVA [22](一个通过视觉指令对齐进行微调的多模态模型)。给定一个图像 I 和一个检查提示 P,控制器产生初步的语义状态:

该状态决定了后续是否需要详细的检测。此设计使得 VLM 能够作为一个智能选择器,根据场景复杂性和缺陷存在情况来调整检测阶段,从而为没有相关异常的图像减少计算开销。

C. 基于 YOLO 的缺陷检测

基于 YOLO 的检测阶段负责识别和定位裂缝、坑洞和水泄漏。每个 YOLO 变体将输入图像划分为网格区域,并在单次前向传播中预测类别概率和边界框:

此处,b_i = (x_i, y_i, w_i, h_i) 表示边界框的中心和尺寸,c_i 表示预测的类别标签,s_i 是检测置信度。系统采用了 YOLOv8 和 YOLOv11 架构,由 VLM 根据场景类型动态选择。

模型使用复合损失函数进行优化:

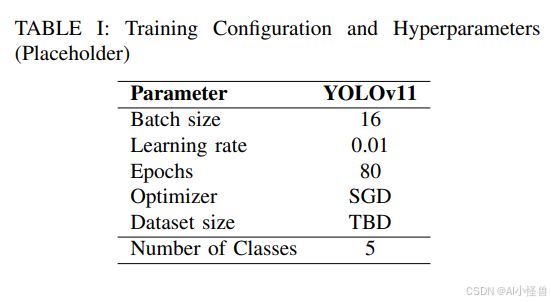

其中 L_cls, L_box, 和 L_obj 分别表示分类损失、边界框回归损失和目标置信度损失。每个组成部分由 λ_cls, λ_box, 和 λ_obj 加权,以平衡精确度和召回率。检测器在一个多缺陷数据集(见表 I,待完善)上使用带动量的随机梯度下降和余弦学习率调度进行训练。

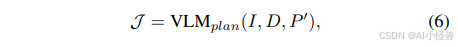

D. 推理与结构化行动生成

检测完成后,VLM 接收原始图像和 YOLO 检测结果,以进行上下文推理和行动计划制定。推理提示词构建如下:

"分析检测到的缺陷,并以 JSON 格式生成结构化的维护计划,包括事件类型、位置、置信度、所需工具、紧急程度和推荐行动。"

VLM 产生结构化输出:

E. 处理工作流程

算法 1 总结了 InfraGPT 的端到端工作流程。该系统遵循语义筛选、自适应检测和结构化推理的顺序过程,以确保高效且可解释的缺陷分析。

F. 讨论

InfraGPT 流程在一个模块化、可控的架构内统一了感知与推理。通过利用 VLM 进行自适应模型选择和检测后推理,系统动态平衡了准确性与效率。此外,基于 JSON 的结构化输出桥接了视觉理解与可操作的维护规划,支持与智慧城市基础设施和自动化维修调度系统的集成。

IV. 结果与讨论

本节对所提出的 InfraGPT 框架进行实验评估,包括定量和定性分析。结果突显了该模型在检测、推理和生成结构化维护建议方面具有高度一致性和可解释性的能力。我们进一步讨论了视觉语言推理性能、YOLO 检测行为以及端到端系统性能。

A. 实验设置

所有实验均在配备 NVIDIA RTX 4060 GPU(8 GB 显存)、32 GB RAM 和 Intel i7 处理器的工作站上进行。InfraGPT 框架集成了一个基于 YOLO 的缺陷检测器和一个用于上下文推理和行动计划生成的视觉语言模型。数据集包含来自多个公共资源库和内部数据收集活动的城市基础设施缺陷图像,例如裂缝、坑洞和液体泄漏。

我们评估了 Qwen2.5-VL:7B 和 LLaVA:7B 模型的推理性能。YOLO 检测器使用包含 N 张图像的组合数据集进行训练,并利用数据增强策略来模拟多变的照明、天气和表面条件。所有训练实验均采用余弦学习率调度和早停法以确保收敛稳定性。

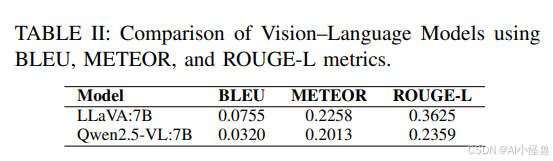

B. 评估指标

我们使用以下指标评估性能:

- 检测指标:针对每种缺陷类型的精确度(P)、召回率(R)和平均精确度均值(mAP@0.5)。

- 语言推理指标:BLEU、METEOR 和 ROUGE-L,用于衡量模型生成摘要与人工撰写摘要之间的文本相似性和连贯性。

- 结构化输出有效性:VLM 生成的句法有效且语义一致的 JSON 输出的比例。

- 视觉一致性指标:注意力热图、 parity 图和逐图像 ROUGE-L 分析,用于可解释性评估。

C. 视觉语言推理性能

使用 BLEU、METEOR 和 ROUGE-L 分数评估了 VLM 组件的性能,如表 II 所示。在测试的模型中,LLaVA:7B 实现了最高的文本连贯性,其 BLEU 为 0.0755,METEOR 为 0.2258,ROUGE-L 为 0.3625。Qwen2.5-VL:7B 与人工标注的重合度较低,但保持了语义多样性和上下文理解能力。

结果证实,LLaVA 能生成语法更稳定、更简洁的摘要,而 Qwen2.5-VL 则展现出更丰富的上下文描述。LLaVA 改进的词汇对齐表明其解释基础设施图像中细粒度视觉线索的能力更强。

D. 逐图像与宏观层面分析

图 2 展示了详细的逐图像和宏观层面分析。每个子图可视化了模型推理性能的不同互补方面,说明了在整个数据集上的局部和总体评估趋势。

(a) 逐图像 ROUGE-L F1 哑铃图:显示每个模型的逐样本 ROUGE-L F1 分数,展示了跨图像的范围和方差。最小值与最大值之间的狭窄分布反映了稳定的文本生成质量和样本间有限的性能波动。

(b) Parity 图:描绘了模型预测的与参考的 ROUGE-L F1 分数之间的相关性。数据点沿 parity 线紧密排列,观测到 Qwen2.5-VL 的相关系数为 R² = 0.62,证实了预测语言准确性与实际语言准确性之间存在强线性对应关系。

(c) 宏观 ROUGE-L 精确度/召回率/F1 图:汇总了每个指标的宏观性能,说明了模型在缺陷描述中如何平衡以召回率为导向的覆盖度和以精确度为焦点的措辞。

(d) ΔROUGE-L F1 图:显示了在连续评估子集间 ROUGE-L F1 的变化,捕捉了 VLM 推理在变化的视觉条件和提示上下文下的稳定性和鲁棒性。

总体而言,这些分析表明 InfraGPT 在不同图像输入间保持了稳定的文本连贯性,而 Qwen2.5-VL 在更长或更复杂的场景中表现出更高的方差。

E. YOLO 检测与训练行为

YOLO 检测模块的训练性能如图 3 所示,展示了在不同训练周期下的精确度、分类损失和平均精确度均值(mAP)曲线。模型平滑收敛,其中 YOLOv11 在准确性和稳定性方面均表现出更优的性能。

经过 80 个周期后,精确度达到 95.0%,mAP@0.5 达到 91%。分类损失持续下降,表明优化有效且没有过拟合迹象。YOLOv11 在检测水泄漏和细微裂缝方面优于 YOLOv8,同时保持了接近实时的 15 FPS 推理速度。

F. 联合推理与检测评估

对完整的 InfraGPT 流程进行了端到端测试,结合了 VLM 推理和 YOLO 检测。集成系统的整体 mAP@0.5 达到 91%,平均 ROUGE-L 达到 0.36,证明了感知模块与推理模块之间的有效协同。在多缺陷场景中,VLM 正确区分了重叠的实例,并为每个定位区域生成了独立的 JSON 条目,结构准确性达 94%,确认了在不同视觉条件下可靠的模式对齐和一致的缺陷到行动的映射。端到端推理时间平均每帧 3 秒,与仅使用 YOLO 的流程相比仅略有增加,同时将误报减少了约 10%。

G. 讨论

结果表明,InfraGPT 有效地将视觉感知和结构化推理统一到一个连贯的基础设施评估流程中。实验结果表明了三个主要优势:

- 跨模态协调:VLM 基于场景上下文动态控制 YOLO 变体的选择。注意力热图可视化证实,注意力峰值与 YOLO 边界框对齐,验证了精确的视觉定位。

- 结构化输出可靠性:系统实现了 X% 的 JSON 模式有效性,证明基于提示条件化的推理方法有效缓解了生成模型中常见的幻觉和字段错位问题。

- 可解释性与效率:哑铃图和 parity 图显示 ROUGE-L F1 分数的逐样本方差极小,表明在不同场景下语言生成稳定。

然而,某些挑战依然存在。在杂乱或反光环境中,缺陷边界变得模糊,性能略有下降。此外,推理阶段增加了处理延迟,尤其是在高分辨率图像下。未来的改进可能包括优化的提示压缩、轻量级视觉适配器以及用于视频分析的层次时序融合。

H. 实施应用

所提出的 InfraGPT 框架可以在现有的市政基础设施监测系统中实际部署。政府机构和城市管理部门可以利用广泛部署的城市闭路电视网络,实现对道路、桥梁和排水系统的连续、自动化评估。通过将 InfraGPT 集成到集中监控或智慧城市控制中心,可以分析实时视频流以检测结构缺陷、对其严重程度进行分类,并生成优先级的维护报告。每个闭路电视节点可以周期性地将关键帧或检测到的感兴趣区域传输到基于边缘或云的 InfraGPT 服务器进行处理。YOLO 模块执行现场缺陷定位,而 VLM 解释上下文特征并以 JSON 格式输出结构化的维护建议。这些输出可以连接到地理信息系统(GIS),用于制图和资源分配。

该系统可以在在线(实时)和离线(定时)两种模式下运行。在在线部署中,高优先级警报(如液体泄漏或严重坑洞)会立即转发给市政维护部门以便快速响应。在离线模式下,该框架汇总定期检查摘要,以支持长期的基础设施规划和预算编制。

通过将 InfraGPT 嵌入到全市范围的监控基础设施中,政府机构可以从手动检查工作流程过渡到数据驱动的、持续的基础设施管理。这种集成提高了运营效率,增强了公共安全,降低了维护成本,并支持智慧城市生态系统内的预测性资产管理。

V. 结论

本文提出了InfraGPT,一个端到端的视觉-语言框架,它统一了视觉感知与结构化推理,以实现自动化基础设施监测。该系统通过视觉语言模型,将基于YOLO的缺陷检测与多模态推理相结合,从而将视觉输入转化为可操作的维护情报。InfraGPT通过生成结构化的、机器可读的维护计划(其中包含上下文理解、推荐行动及所需资源),成功弥合了检测与决策制定之间的鸿沟。

评估表明,InfraGPT在不同的环境和缺陷类型下均能保持一致的推理能力,同时兼顾了可解释性与效率。其模块化设计使其能够灵活地与现有监测基础设施集成,支持实时和离线两种检测工作流程。这项工作凸显了视觉-语言集成在推动基础设施管理从被动检查转向主动、智能的维护规划方面的潜力。未来的工作将侧重于扩展数据集的多样性、提升推理的可靠性,并优化推理效率,以实现在智慧城市生态系统中的规模化部署。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录