Flink CDC深度解析:MySQL Binlog实时同步与关联实战指南

Flink CDC深度解析:MySQL Binlog实时同步与关联实战指南

用户6320865

发布于 2025-11-28 18:03:23

发布于 2025-11-28 18:03:23

引言:实时数据处理的变革与Flink CDC的崛起

在大数据技术飞速发展的今天,企业对数据处理的需求已经从传统的批处理模式逐渐转向实时化、流式化。根据2025年最新行业报告,全球实时数据处理市场规模预计突破千亿美元,年复合增长率超过25%。随着业务场景的复杂化和数据量的爆炸式增长,仅仅依靠T+1的数据处理方式已经无法满足诸如实时风控、实时推荐、业务监控和数据仓库实时同步等关键应用的需求。数据的价值往往具有很强的时间敏感性,延迟的数据可能导致企业错失商机甚至造成直接的经济损失。因此,实时数据处理已成为现代数据架构中不可或缺的一环。

作为实时计算领域的佼佼者,Apache Flink凭借其高吞吐、低延迟、精确一次(exactly-once)语义和强大的状态管理能力,已经成为流处理的事实标准。然而,在构建实时数据管道时,一个常见且关键的挑战是如何高效、无侵入地捕获数据库中的变更数据,并将其集成到流处理任务中。传统的解决方案如基于查询的轮询、使用触发器或日志解析工具,往往存在性能瓶颈、数据一致性难以保证或架构复杂等问题。

正是在这样的背景下,Flink CDC(Change Data Capture)技术应运而生,并迅速崛起为解决数据库实时变更捕获与流处理集成问题的关键技术。2025年发布的Flink CDC 3.0版本进一步增强了对多源异构数据库的支持,并优化了分布式快照机制。CDC的核心思想是捕获数据库的事务日志(如MySQL的Binlog、PostgreSQL的WAL),并将其转化为数据流,从而实现对数据库插入、更新、删除等操作的实时响应。与其它方案相比,CDC具有低延迟、减少数据库压力、保证数据一致性以及支持全量和增量同步等显著优势。

Flink CDC通过其开源组件flink-cdc-connectors,将CDC能力与Flink流处理引擎深度集成,为用户提供了一种无缝接入多种数据库变更日志的方式。它支持MySQL、PostgreSQL、MongoDB等常见数据源,能够自动解析二进制日志,并将变更事件作为数据流发射到Flink作业中。这一机制不仅简化了实时数据管道的搭建流程,还充分发挥了Flink在状态管理和容错方面的优势,确保了整个处理过程的高可靠性和一致性。

随着企业数字化进程的加速,Flink CDC的应用场景也日益广泛。从电商行业的实时库存同步和订单处理,到金融领域的交易监控和风险预警,再到物联网设备的实时状态采集与分析,Flink CDC正在成为许多数据驱动型业务的核心支撑技术。其能够实现跨数据源的实时关联和复杂事件处理,进一步拓展了流处理的应用边界。

总的来说,Flink CDC的出现标志着实时数据处理领域的一次重要进化。它不仅填补了数据库与流处理系统之间的鸿沟,还通过标准化的连接器和简化的API,大幅降低了实时数据集成技术的使用门槛。随着技术的不断成熟和社区支持的加强(Flink CDC在GitHub上的Star数已突破5k),Flink CDC正在助力更多企业构建高效、弹性且易于维护的实时数据架构。

Flink CDC基础:理解Change Data Capture的核心机制

在深入了解Flink CDC之前,我们首先需要理解Change Data Capture(CDC)这一核心概念。CDC,即变更数据捕获,是一种用于识别和捕获数据库中数据变更的技术。简单来说,它就像数据库的“监控摄像头”,能够实时记录数据的每一次插入、更新或删除操作,并将这些变更以事件流的形式提供出来。这种机制使得下游系统能够及时响应数据变化,而无需频繁地轮询或全量扫描数据库,从而大大提升了数据处理的效率和实时性。

CDC的工作原理主要依赖于数据库的事务日志。以MySQL为例,其Binlog(二进制日志)记录了所有对数据库的更改操作。CDC工具通过读取这些日志,可以精确捕获到每一行数据的变更历史。这种方式不仅高效,而且对源数据库的性能影响极小,因为它不需要额外的查询或锁表操作。类似地,PostgreSQL的WAL(Write-Ahead Logging)或Oracle的Redo Log也扮演着相同的角色。CDC技术本质上是一种“拉”模式,但它基于日志的机制使其更像一种被动的、事件驱动的数据捕获方式。

Flink CDC在这一生态中扮演了关键角色。作为Apache Flink的一个扩展组件,Flink CDC Connectors将CDC能力无缝集成到流处理框架中。它不仅仅是一个数据捕获工具,更是一个将数据库变更实时转换为数据流的桥梁。通过Flink CDC,用户可以轻松地将MySQL、PostgreSQL、MongoDB等常见数据库的变更日志接入到Flink作业中,并利用Flink强大的状态管理和容错机制进行处理。这与传统的CDC工具(如Debezium)相比,优势在于原生支持流处理,无需额外的中间件或复杂的ETL管道。

Flink CDC的核心优势体现在多个方面。首先,它提供了低延迟的数据捕获能力。由于直接读取数据库日志,变更事件几乎可以实时传递到Flink作业中,延迟通常在毫秒级别。其次,它具有exactly-once的语义保证,确保数据在传输和处理过程中不丢失、不重复。这对于金融或电商等对数据一致性要求极高的场景至关重要。此外,Flink CDC支持多种数据源,包括关系型数据库和NoSQL数据库,提供了统一的接口,减少了技术栈的复杂性。

为了更直观地理解,我们可以用一个类比:假设数据库是一家银行的账本,每一次交易(数据变更)都会被记录在案。CDC就像一位高效的审计员,实时监控账本的变化,并将每一笔交易通知给下游系统(如风险控制系统或报表生成器)。而Flink CDC则是这位审计员的“智能助手”,不仅负责监控,还能即时处理这些交易信息,进行实时分析或转发到其他系统。这种无缝集成使得整个数据处理流程更加流畅和高效。

在实际应用中,CDC捕获的变更数据通常以事件形式表示,包括操作类型(insert、update、delete)、变更前和变更后的数据快照,以及时间戳等元数据。例如,当用户在电商平台下单时,MySQL中的orders表会插入一条新记录。Flink CDC会捕获这一事件,并将其转换为一个数据流事件,下游的Flink作业可以立即处理这个事件,如更新实时库存或触发用户通知。这种机制确保了业务的实时响应能力。

支持的数据源类型是CDC技术的一个重要方面。Flink CDC Connectors目前覆盖了主流数据库,包括MySQL、PostgreSQL、Oracle、MongoDB和SQL Server等。每种连接器都针对特定数据库的日志机制进行了优化,例如MySQL Connector基于Binlog,而PostgreSQL Connector则利用其逻辑解码功能。这种多样性使得用户可以在混合数据库环境中实现统一的变更数据捕获,无需为不同数据库定制不同的解决方案。

Flink CDC在架构中的角色不仅仅是数据捕获,它还充当了流处理的入口点。通过将CDC数据作为Flink的Source,用户可以构建复杂的流处理管道,例如实时数据仓库、数据同步或事件驱动型应用。这与传统批处理方式相比,显著降低了数据延迟,并支持更动态的业务逻辑。例如,在实时推荐系统中,Flink CDC可以捕获用户行为变更,并立即触发模型更新,提升推荐准确性。

总的来说,理解CDC的核心机制是掌握Flink CDC的基础。它通过数据库日志实现高效、低侵入的变更捕获,而Flink CDC则将这些能力提升到流处理层面,提供了无缝集成和强大的一致性保证。在下一章节中,我们将深入探讨Flink CDC的技术架构,看看它是如何实现这些功能的,以及在实际部署中需要注意哪些细节。

无缝接入数据库:Flink CDC的技术架构与实现原理

架构概览:Flink CDC 的核心组件

Flink CDC 的整体架构围绕 Connector、Source 和 Sink 三个核心组件构建,这些组件协同工作,实现了对数据库变更日志的无缝接入与处理。Connector 作为桥梁,负责与外部数据源(如 MySQL、PostgreSQL)建立连接并捕获变更事件;Source 组件则将这些事件转换为 Flink 可处理的流数据;Sink 组件则将处理后的数据输出到目标系统(如 Kafka、HDFS 或另一个数据库)。这种模块化设计不仅提高了系统的灵活性,还支持对不同类型数据库的统一接入,而无需修改核心处理逻辑。

在 Flink CDC 中,Connector 的实现依赖于数据库本身的变更日志机制。例如,对于 MySQL,Connector 通过读取 Binlog 来捕获数据变更(插入、更新、删除),并将其封装为事件流。Source 组件则基于 Flink 的 DataStream API,将这些事件流转换为可操作的流数据,供后续处理。Sink 组件则负责将处理结果写入外部存储,确保数据最终一致性。整个架构的设计目标是在低延迟的前提下,保证高吞吐量和数据准确性。

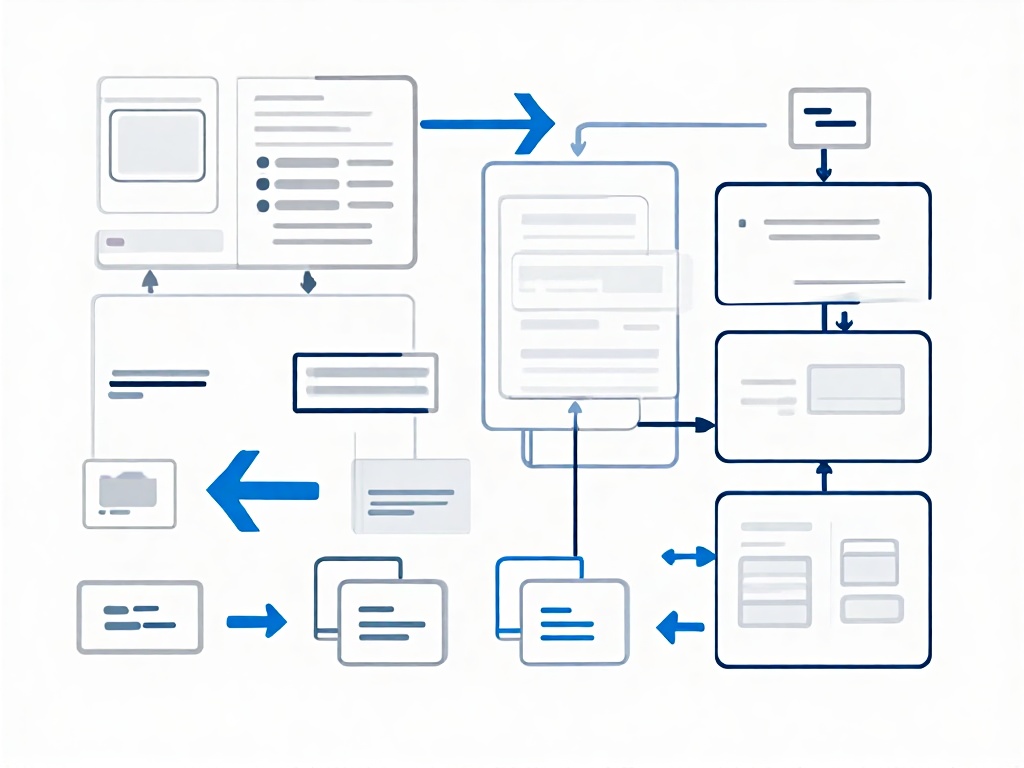

Flink CDC架构组件交互示意图

无缝集成机制:以 MySQL 为例

Flink CDC 的无缝集成能力主要体现在其对多种数据库的兼容性和易用性上。以 MySQL 为例,Flink CDC Connector 通过 JDBC 或原生协议直接连接到 MySQL 数据库,并利用 Binlog 机制实时捕获数据变更。Binlog 是 MySQL 的二进制日志,记录了所有对数据库的修改操作,Flink CDC Connector 通过解析 Binlog 事件(如 Write Rows、Update Rows、Delete Rows),将其转换为结构化的数据变更流。

这一过程无需在数据库中安装额外插件或代理,减少了部署复杂性。Connector 会自动处理 Binlog 的定位和增量读取,支持从指定位置(如时间戳或 GTID)开始捕获,确保数据同步的灵活性和精确性。同时,Flink CDC 还提供了自动 schema 演化支持,当源表结构发生变化(如添加列)时,Connector 能够动态适应并反映到流数据中,避免了手动调整的需求。

对于其他数据库(如 PostgreSQL 的 WAL 日志或 Oracle 的 Redo Log),Flink CDC 采用了类似的集成模式,通过统一的 API 和配置接口,使开发者能够以一致的方式处理不同数据源的变更捕获。这种设计大大降低了多源数据同步的复杂度,适用于混合数据库环境。

数据一致性保障机制

在分布式流处理中,数据一致性是核心挑战之一。Flink CDC 通过多种机制确保端到端的数据一致性,包括精确一次(Exactly-Once)语义和故障恢复能力。Source 组件利用 Flink 的检查点(Checkpoint)机制,定期保存读取位置(如 Binlog 的偏移量),当任务失败时,可以从最近的一致状态恢复,避免数据重复或丢失。

对于 MySQL Binlog 的读取,Flink CDC Connector 支持 GTID(Global Transaction Identifier)模式,确保即使在主从切换或网络分区的情况下,也能正确追踪事务边界和顺序。此外,Connector 还提供了事务性输出支持,Sink 组件可以通过两阶段提交(2PC)协议,将数据原子性地写入目标系统,进一步强化一致性保障。

在容错方面,Flink CDC 继承了 Flink 本身的弹性扩缩容和状态管理能力。例如,当需要增加并行度以处理更高吞吐量时,Flink 可以动态调整 Source 的分片策略,均匀分配读取负载,而不会破坏数据一致性。同时,通过状态后端(如 RocksDB)的持久化存储,系统能够在节点故障后快速恢复,最小化业务中断时间。

性能优化与扩展性

Flink CDC 在设计上注重高性能和可扩展性。Connector 支持并行读取,例如对 MySQL 的分库分表场景,可以配置多个 Source 任务同时捕获不同表或分片的变更,显著提升吞吐量。此外,通过增量快照(Incremental Snapshot)机制,Flink CDC 能够在全量同步阶段避免锁表,减少对源数据库的影响,并加快初始数据同步速度。

对于大规模数据流处理,Flink CDC 还提供了参数调优选项,如批量读取大小、心跳间隔和缓冲区配置,用户可以根据网络环境和业务需求调整这些参数,以优化资源利用率和延迟表现。结合 Flink 的窗口操作和状态管理,CDC 数据流可以进一步用于复杂事件处理(CEP)或实时聚合,满足多样化业务场景。

未来,随着更多数据库的支持和云原生部署的普及,Flink CDC 可能会进一步优化其资源调度和自动化运维能力。例如,2025年Flink CDC已深度集成Kubernetes生态,支持通过Operator实现动态扩缩容,并引入智能资源感知调度,根据数据流量自动调整Connector实例数量。同时,新增了对云原生数据库(如AWS Aurora、Azure SQL Database)的原生协议支持,减少了JDBC连接的开销,提升了同步效率。此外,新一代Connector还集成了数据压缩和加密传输功能,进一步优化了跨云和混合云环境下的性能与安全性。

实战准备:环境搭建与MySQL Binlog配置指南

环境准备清单

在开始实战之前,我们需要准备以下组件:

- Apache Flink 1.14 或更高版本(推荐使用最新稳定版)

- MySQL 5.7 或 8.0 版本(需启用Binlog)

- flink-cdc-connectors 库(与Flink版本对应)

- Java 8 或 11 开发环境

- 简易测试用数据库表(建议准备包含增删改操作的示例表)

建议读者通过官方渠道下载组件,避免使用非稳定版本导致兼容性问题。以下是具体操作步骤。

Flink 本地环境搭建

首先从Apache Flink官网下载二进制包,解压后进入目录。通过以下命令启动本地集群:

./bin/start-cluster.sh访问 http://localhost:8081 确认集群状态正常。建议同时下载并配置Flink Web UI依赖,便于监控任务运行状态。

对于IDE环境,推荐使用IntelliJ IDEA创建Maven项目,在pom.xml中添加Flink相关依赖:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>1.14.4</version>

</dependency>

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java_2.12</artifactId>

<version>1.14.4</version>

</dependency>MySQL Binlog 配置详解

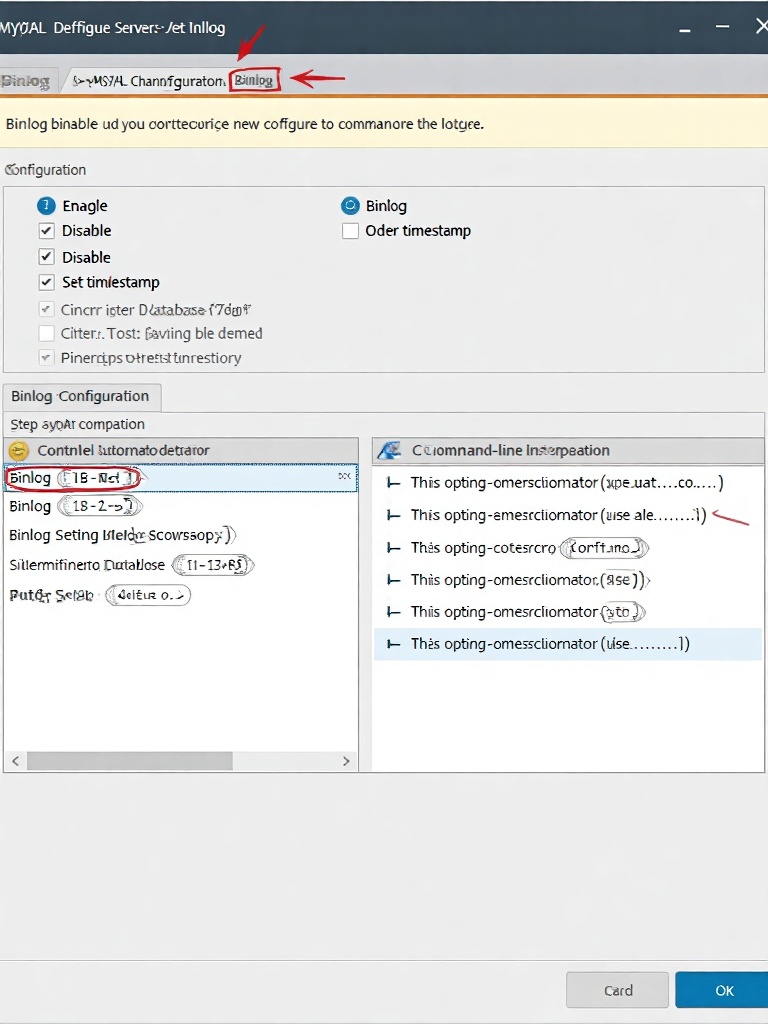

MySQL的Binlog是CDC捕获数据变更的关键。请按以下步骤配置:

- 修改MySQL配置文件my.cnf(Linux)或my.ini(Windows),添加以下参数:

[mysqld]

server-id = 1

log_bin = /var/log/mysql/mysql-bin.log

binlog_format = ROW

binlog_row_image = FULL

expire_logs_days = 10

max_binlog_size = 100M

MySQL配置文件修改示例

- 重启MySQL服务使配置生效:

sudo systemctl restart mysql- 创建专门用于CDC连接的数据库用户并授权:

CREATE USER 'flink_cdc'@'%' IDENTIFIED BY 'SecurePassword123!';

GRANT SELECT, RELOAD, SHOW DATABASES, REPLICATION SLAVE, REPLICATION CLIENT ON *.* TO 'flink_cdc'@'%';

FLUSH PRIVILEGES;关键配置说明:

- binlog_format必须设置为ROW:确保记录行级别的变更

- binlog_row_image建议为FULL:保证获取变更前后的完整数据

- 创建专用账户时需授予REPLICATION相关权限:这是CDC连接器读取Binlog的基础

常见环境问题解决方案

Q1: Binlog未正确启用怎么办?

通过执行SHOW VARIABLES LIKE 'log_bin';验证Binlog状态。若返回OFF,请检查:

- 配置文件路径是否正确

- MySQL用户是否有写入日志文件的权限

- 配置文件修改后是否重启服务

Q2: Flink连接MySQL时报权限错误?

确认用户权限包含REPLICATION SLAVE和REPLICATION CLIENT。建议使用SHOW GRANTS FOR 'flink_cdc'@'%';核查权限列表。

Q3: 如何验证Binlog是否正常记录数据变更? 使用mysqlbinlog工具实时查看日志内容:

mysqlbinlog --base64-output=DECODE-ROWS -v mysql-bin.000001观察到ROW格式的日志输出即表示配置成功。

连接器依赖配置

在Maven项目中添加flink-cdc-connectors依赖(以MySQL连接器为例):

<dependency>

<groupId>com.ververica</groupId>

<artifactId>flink-connector-mysql-cdc</artifactId>

<version>2.3.0</version>

</dependency>注意版本兼容性:Flink 1.14.x建议使用connector 2.3.x版本。若遇到依赖冲突,可使用mvn dependency:tree命令排查冲突包,通过exclusion排除重复依赖。

完成以上准备后,建议创建测试表并执行若干DML操作,验证Binlog记录是否完整。接下来我们将进入核心实战环节,演示如何编写完整的Flink CDC同步程序。

核心实战:使用flink-cdc-connectors实现实时同步

环境准备与依赖配置

在开始编写Flink CDC作业之前,需要确保开发环境已正确配置。首先,通过Maven或Gradle引入flink-cdc-connectors依赖。以下是2025年推荐的Maven配置示例:

<dependency>

<groupId>com.ververica</groupId>

<artifactId>flink-connector-mysql-cdc</artifactId>

<version>3.2.0</version>

</dependency>同时,确保Flink版本与Connector兼容,推荐使用Flink 1.18及以上版本以获得最佳性能。若目标输出为Kafka,还需添加Flink Kafka Connector依赖:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka</artifactId>

<version>2.1.0</version>

</dependency>编写Flink CDC作业代码

以下是一个完整的Flink作业示例,实现从MySQL Binlog捕获数据变更并实时同步到Kafka。代码基于Flink DataStream API编写,包含Source连接、数据转换和Sink输出。

Flink CDC实时数据同步流程

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import com.ververica.cdc.debezium.JsonDebeziumDeserializationSchema;

import com.ververica.cdc.connectors.mysql.source.MySqlSource;

import org.apache.flink.api.common.serialization.SimpleStringSchema;

import org.apache.flink.streaming.connectors.kafka.FlinkKafkaProducer;

public class MySQLCDCToKafka {

public static void main(String[] args) throws Exception {

// 创建流执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 配置MySQL CDC Source

MySqlSource<String> mySqlSource = MySqlSource.<String>builder()

.hostname("localhost")

.port(3306)

.databaseList("test_db") // 监控的数据库

.tableList("test_db.user_table") // 监控的数据表

.username("flink_user")

.password("flink_pwd")

.deserializer(new JsonDebeziumDeserializationSchema()) // 使用JSON格式解析变更数据

.serverId("5401-5404") // 2025年推荐配置唯一服务器ID范围

.build();

// 定义Kafka Sink配置

FlinkKafkaProducer<String> kafkaSink = new FlinkKafkaProducer<>(

"kafka_topic_name",

new SimpleStringSchema(),

KafkaProperties.getProducerProperties() // 自定义Kafka连接属性

);

// 构建数据处理流水线

env.fromSource(mySqlSource, WatermarkStrategy.noWatermarks(), "MySQL CDC Source")

.addSink(kafkaSink)

.name("Kafka Sink");

// 执行作业

env.execute("MySQL CDC to Kafka Sync Job");

}

}关键参数解析与性能调优

在CDC Connector配置中,以下几个参数对性能和稳定性至关重要:

server-id:MySQL复制标识,需确保每个Flink作业唯一,避免冲突。2025年推荐使用范围配置如.serverId("5401-5404")。snapshot.mode:初始快照模式,支持initial(全量+增量)或schema_only(仅增量)。对于历史数据量大的场景,建议使用initial并调整并行度。heartbeat.interval:心跳间隔,默认30秒,用于维持Binlog连接。若网络不稳定,可缩短至10-15秒。chunk.key-column:全量同步时按列分片,提升读取效率。例如对自增ID字段分片:.chunkKeyColumn("id")。

针对高吞吐场景,可通过以下方式优化作业性能:

并行度调整:设置Source并行度为MySQL表的分片数(如按主键范围划分),Sink并行度与Kafka分区数一致。

检查点配置:启用检查点并设置间隔(如30秒),确保Exactly-Once语义:

env.enableCheckpointing(30000);

env.getCheckpointConfig().setCheckpointingMode(CheckpointingMode.EXACTLY_ONCE);缓冲区控制:通过env.setBufferTimeout(100)减少延迟,或调整Flink网络缓冲区大小。

异常处理与监控

CDC作业运行时可能因Binlog清除、网络抖动等问题中断。建议添加以下容错机制:

重启策略:配置指数退避重启,避免频繁失败:

env.setRestartStrategy(RestartStrategies.exponentialDelayRestart(

Time.seconds(10), Time.seconds(30), 1.5, Time.seconds(60), 0.1

));监控指标:通过Flink Metrics集成Prometheus或Grafana,重点关注:

numRecordsIn:输入记录数currentFetchEventTimeLag:数据延迟numberOfCommittedCheckpoints:检查点完成数

同步到HDFS的扩展实现

若需同步至HDFS,可使用StreamingFileSink替代Kafka Sink。以下为示例片段:

import org.apache.flink.streaming.api.functions.sink.filesystem.StreamingFileSink;

import org.apache.flink.core.fs.Path;

StreamingFileSink<String> hdfsSink = StreamingFileSink

.forRowFormat(new Path("hdfs://namenode:8020/cdc_data"), new SimpleStringEncoder<>())

.withRollingPolicy(DefaultRollingPolicy.builder().build())

.build();

env.fromSource(mySqlSource, ...).addSink(hdfsSink);需注意设置合理的文件滚动策略(如按时间间隔1小时或大小128MB),避免小文件过多。

高级应用:数据关联与流处理优化技巧

流式关联查询:JOIN操作的核心机制

在实时数据处理场景中,数据关联是最常见的需求之一。Flink CDC通过捕获数据库变更日志,为流式JOIN操作提供了原生支持。与批处理不同,流式JOIN需要持续处理无限的数据流,并维护状态以匹配不同流中的记录。例如,在电商场景中,用户行为日志流需要与订单信息流进行关联,以实时分析用户购买偏好。

Flink支持多种JOIN类型,包括常规JOIN、间隔JOIN和时态表JOIN。其中,常规JOIN适用于双流完全匹配的场景,但需要注意状态可能无限增长的问题。间隔JOIN通过时间窗口限制关联范围,适合事件时间序列的数据。时态表JOIN则基于版本化表的概念,能够处理维度表变更的历史关联,这在CDC场景中尤为实用——比如当商品价格表发生变更时,仍能正确关联历史订单数据。

通过Flink SQL可以简洁地实现这些操作。例如,以下代码实现了订单流与商品维表的时间关联:

SELECT

o.order_id,

o.product_id,

p.product_name,

o.amount

FROM orders o

JOIN product FOR SYSTEM_TIME AS OF o.proc_time AS p

ON o.product_id = p.product_id其中FOR SYSTEM_TIME AS OF语法确保了关联时使用订单事件时间对应的商品维表版本。

状态管理:保障关联查询的稳定性

流式关联的核心挑战在于状态管理。Flink CDC作业需要维护大量的中间状态,包括流数据的缓存、维表的历史版本等。状态过大不仅影响性能,还可能导致作业失败。Flink提供了多种状态后端选择(如RocksDB、HashMap),并支持状态过期(TTL)配置。

最佳实践包括:根据业务需求合理设置状态存活时间,避免无限状态累积;使用增量检查点机制减少状态持久化的开销;通过状态分区和键控流设计优化状态访问性能。例如,在对用户会话数据进行关联时,可以按用户ID进行键控分区,确保相同用户的数据始终由同一个任务处理,减少网络传输开销。

监控方面,Flink Web UI提供了状态大小的实时监控,结合Metrics API可以定制状态使用告警。2024年发布的Flink 1.18版本进一步优化了状态后端的内存管理,特别是在RocksDB状态后端中引入了压缩策略动态调整功能,显著降低了大规模状态场景下的磁盘I/O压力。

窗口函数:时间维度关联的利器

对于时间敏感的关联场景,窗口函数提供了强大的处理能力。滚动窗口、滑动窗口和会话窗口可以灵活划分数据时间段,结合聚合函数实现复杂计算。在CDC数据同步中,窗口函数常用于解决乱序事件问题——通过设置允许延迟和水位线机制,确保数据处理的正确性。

例如,在计算每分钟订单金额总和时,可以使用滚动窗口:

dataStream

.keyBy(order -> order.getProductId())

.window(TumblingEventTimeWindows.of(Time.minutes(1)))

.aggregate(new OrderAmountAggregator());窗口优化策略包括:根据事件时间特征调整水位线延迟参数,平衡延迟和准确性;使用增量聚合函数(如ReduceFunction、AggregateFunction)减少状态存储;对于超大窗口,考虑使用分层聚合或采样近似计算。

性能调优:从并行度到资源分配

流处理作业的性能优化需要多维度考量。首先,合理设置并行度是关键——过低的并行度会导致处理瓶颈,而过高的并行度可能增加协调开销。建议通过反压监控和CPU使用率动态调整并行度。其次,网络缓冲区和堆内存配置直接影响吞吐量,特别是在多流关联场景中需要增加网络缓冲区数量。

资源分配方面,建议将状态后端存储在SSD磁盘上以提高I/O性能,同时为JVM分配足够的堆外内存以缓解垃圾回收压力。2024年多家企业在生产环境中实践表明,针对CDC数据同步作业,采用异步检查点并调整最小暂停时间,能够将故障恢复时间缩短60%以上。

代码优化与执行计划分析

Flink SQL在编译阶段会生成执行计划,通过EXPLAIN语句可以分析优化器是否选择了最佳方案。常见的优化手段包括:谓词下推提前过滤无效数据;投影剪裁减少不必要的字段传输;避免交叉连接等代价高昂的操作。

对于复杂关联逻辑,建议将大表拆分为多个子查询分段处理,或者将频繁访问的维表数据缓存到本地。Flink 1.17版本引入的自适应批处理模式(Adaptive Batch Execution)在2024年得到进一步强化,能够根据数据量动态调整执行策略,显著提升大数据量关联查询的效率。

通过以上技巧的综合运用,开发者能够构建出高效稳定的CDC数据关联管道,满足实时数仓、实时风控等业务场景的需求。

常见挑战与解决方案:避坑指南

在使用 Flink CDC 进行 MySQL Binlog 实时同步的过程中,尽管其强大的功能为数据工程带来了便利,但在实际部署和运维中仍可能遇到一些典型挑战。这些问题若不及时识别并解决,可能导致数据延迟、一致性错误甚至作业失败。以下是一些常见问题及其解决方案,帮助您有效避坑。

数据延迟问题

数据延迟是实时同步中最常见的问题之一,表现为目标系统接收到的数据明显晚于源数据库的变更时间。造成延迟的原因多样,可能来自网络、资源分配或配置不当。

可能原因及解决方案:

- 网络带宽或延迟:如果源数据库与 Flink 集群之间的网络存在瓶颈,Binlog 数据的传输速度会受限。建议通过监控工具(如 Prometheus)实时跟踪网络吞吐量,必要时升级带宽或优化网络路由。

- Flink 任务资源不足:TaskManager 的内存或 CPU 资源分配不足,会导致数据处理速度跟不上 Binlog 的产生速度。可以通过调整 Flink 的并行度参数(如

parallelism.default)或增加 TaskManager 的数量来提升处理能力。例如,在flink-conf.yaml中适当增加taskmanager.memory.process.size。 - Binlog 读取频率设置不当:Flink CDC Connector 默认以低延迟方式读取 Binlog,但在高并发场景下,可能需要调整参数如

server-id和scan.incremental.snapshot.chunk.size来平衡资源使用和读取效率。建议根据实际数据量进行性能测试并优化这些配置。

数据一致性错误

在分布式环境中,确保数据一致性是核心挑战。常见问题包括重复数据处理、数据丢失或中间状态不一致。

可能原因及解决方案:

- Exactly-Once 语义配置缺失:Flink CDC 默认提供 At-Least-Once 保证,但在要求严格一致性的场景中,需启用 Checkpoint 机制来实现 Exactly-Once。确保在 Flink 作业中配置定期 Checkpoint,并设置合理的间隔(如每分钟一次)以及状态后端(如 RocksDB)。

- 源数据库事务隔离级别不匹配:MySQL 的 Binlog 格式(如 Row 格式)必须与 Flink CDC 的解析方式兼容。如果出现数据不一致,检查 MySQL 的

binlog_format设置为ROW,并确认binlog_row_image为FULL以捕获完整行变更。 - Connector 版本兼容性问题:不同版本的

flink-cdc-connectors可能与 Flink 或 MySQL 驱动存在兼容性差异。始终使用官方推荐版本组合,例如 Flink 1.14+ 配合 Connector 2.4+,并在升级前进行充分测试。

作业失败与容错处理

Flink CDC 作业可能因异常(如数据库连接中断或 schema 变更)而失败,如何快速恢复是关键。

可能原因及解决方案:

- 数据库连接超时或中断:网络波动或数据库重启可能导致连接失败。通过在 Connector 配置中设置合理的连接超时参数(如

connect.timeout和connection.max-retries),并结合 Flink 的重启策略(如fixed-delay重启尝试)来增强鲁棒性。 - Binlog 位置丢失或重置:如果 Flink 作业失败后无法从正确的 Binlog 位置恢复,可能导致数据重复或遗漏。确保使用 Flink 的 Checkpoint 机制持久化偏移量,并在作业配置中指定

scan.startup.mode为latest-offset以避免历史数据重放。 - Schema 变更处理不当:源表结构变更(如添加列)可能使 Flink 反序列化失败。建议在 MySQL 端使用在线 DDL 工具(如 pt-online-schema-change)以减少影响,并在 Flink 作业中启用自适应 schema 演化支持(如使用

debezium.schema.history.internal配置)。

性能调优与监控

缺乏有效的监控和调优可能导致作业运行效率低下,甚至隐藏潜在问题。

优化建议:

- 监控关键指标:利用 Flink Web UI 或集成监控系统(如 Grafana)跟踪吞吐量、延迟和资源使用率。重点关注

numRecordsInPerSecond和currentFetchEventTimeLag等指标,及时发现瓶颈。 - 调整并行度和缓冲区:根据数据流量调整 Source 和 Operator 的并行度。对于高吞吐场景,可以增加

taskmanager.numberOfTaskSlots,并优化网络缓冲区大小(如taskmanager.memory.network.fraction)。 - 避免频繁 Checkpoint:虽然 Checkpoint 对一致性很重要,但过于频繁可能影响性能。通过平衡 Checkpoint 间隔(如 1-5 分钟)和最小化状态大小来减少开销。

预防措施与最佳实践

除了 reactive 的 troubleshooting,采取 proactive 措施能显著降低问题发生概率。

- 定期进行负载测试:在生产部署前,模拟高负载场景测试作业稳定性和资源需求。

- 文档化配置与版本管理:维护详细的配置变更记录,确保环境一致性。

- 启用日志与告警:配置 Flink 和数据库的详细日志级别(如 DEBUG 用于 Connector),并设置告警规则(如延迟阈值告警)。

通过上述方法,您可以有效应对常见挑战,确保 Flink CDC 同步作业的稳定高效运行。

未来展望:Flink CDC在数据工程中的演进

技术架构演进:从单数据源到统一数据平台

随着企业数据架构的复杂化,Flink CDC正在从单一数据库变更捕获工具向统一数据集成平台演进。2025年,Flink CDC预计将全面支持多源异构数据的统一接入,不仅覆盖传统关系型数据库(MySQL/PostgreSQL/Oracle),还将深度整合NoSQL数据库、云原生数据服务以及物联网设备数据流。通过标准化Connector接口和动态Schema管理,实现近乎零代码的配置接入,大幅降低多系统协同的技术门槛。

值得注意的是,架构层面正加速向“CDC as a Service”的云原生模式演进。通过将变更捕获逻辑抽象为独立服务,实现与Flink计算引擎的解耦,使资源调度更加灵活高效。这种架构支持根据实时数据流量动态扩缩容Connector实例,同时保持Exactly-Once语义的强一致性保障。例如,某大型电商平台在2024年已试点此类架构,成功将数据处理延迟降低40%,资源成本节约25%。

智能数据管道:AI驱动的自动化优化

机器学习技术的深度融入正使CDC管道具备前所未有的自优化能力。2025年的Flink CDC预计将集成智能预测模块,通过分析历史数据变更模式,自动调整数据采集频率和批处理大小。例如,在业务低峰期自动切换至批量拉取模式,高峰时段则无缝过渡到流式处理,在保障实时性的同时优化资源利用率。

异常检测能力也将显著增强。通过持续监控数据变更的速率、格式一致性及业务规则符合度,系统可自动识别潜在数据质量问题,如主键冲突、字段异常或逻辑违规,并触发实时告警甚至自动修复流程。这种智能化的数据治理能力,将帮助数据工程师从繁琐的监控工作中彻底解放出来,更专注于业务价值创造。

多云与混合云部署的标准化支持

随着多云战略成为企业新常态,Flink CDC正加强对跨云环境的原生支持。2025年版本将提供统一的云中立配置管理界面,支持在AWS、Azure、GCP及阿里云等主流云平台间无缝迁移CDC管道。通过抽象底层基础设施差异,真正实现“一次编写,随处运行”的部署体验。

跨云数据同步场景将得到特别优化。例如,通过智能路由选择算法和数据压缩技术,有效降低区域间数据传输延迟和成本。安全方面将增强跨云身份认证集成,支持云厂商原生的IAM服务,并确保变更数据在传输过程中的端到端加密,满足企业级安全合规要求。

实时数据生态的深度融合

Flink CDC正与现代数据栈的其他组件实现深度集成。2025年将进一步增强与流式数据湖(Delta Lake/Iceberg/Hudi)的原生对接能力,支持直接将从数据库捕获的变更写入数据湖格式,彻底避免额外的ETL步骤。这种深度集成使得数据湖能够实时反映业务系统状态,为实时分析提供统一的高质量数据基础。

与MLOps平台的结合尤为值得关注。通过将实时数据流直接对接特征存储(Feature Store),可以持续更新机器学习特征,支持在线模型的实时推理和快速迭代优化。这种能力对需要实时个性化推荐的电商平台或实时风险控制的金融场景具有重要价值,预计将在2025年成为行业标准实践。

开发者体验的持续优化

工具链的完善将是2025年的重要发展方向。可视化CDC管道设计器将逐渐成熟,允许通过直观的拖拽方式配置数据源和目标,自动生成对应的Flink作业代码。调试工具也将大幅增强,提供变更数据流的实时可视化追踪,帮助开发者快速定位数据一致性问题。

学习资源的丰富化同样不可或缺。随着功能复杂度的增加,官方将提供更完善的示例库和最佳实践指南,涵盖数据迁移、双活架构、容灾备份等企业级场景。社区建设方面将加强与企业用户的合作,形成更多行业解决方案参考,助力开发者快速掌握最新技术。

应对新兴数据挑战

随着全球数据隐私法规的加强,Flink CDC将内置更强大的数据脱敏和隐私保护功能。2025年版本预计支持在数据捕获阶段对敏感字段进行加密或掩码处理,同时保持数据关联性不受影响。审计功能也将全面强化,满足GDPR、CCPA以及中国数据安全法等法规对数据变更追踪的合规要求。

将在2025年成为行业标准实践。

开发者体验的持续优化

工具链的完善将是2025年的重要发展方向。可视化CDC管道设计器将逐渐成熟,允许通过直观的拖拽方式配置数据源和目标,自动生成对应的Flink作业代码。调试工具也将大幅增强,提供变更数据流的实时可视化追踪,帮助开发者快速定位数据一致性问题。

学习资源的丰富化同样不可或缺。随着功能复杂度的增加,官方将提供更完善的示例库和最佳实践指南,涵盖数据迁移、双活架构、容灾备份等企业级场景。社区建设方面将加强与企业用户的合作,形成更多行业解决方案参考,助力开发者快速掌握最新技术。

应对新兴数据挑战

随着全球数据隐私法规的加强,Flink CDC将内置更强大的数据脱敏和隐私保护功能。2025年版本预计支持在数据捕获阶段对敏感字段进行加密或掩码处理,同时保持数据关联性不受影响。审计功能也将全面强化,满足GDPR、CCPA以及中国数据安全法等法规对数据变更追踪的合规要求。

边缘计算场景的支持是另一个重点演进方向。通过优化资源消耗和网络传输协议,使CDC能力可以部署在资源受限的边缘环境中,实现边缘设备与云端数据的实时同步。这对物联网、智能制造等场景具有重要价值,预计将在2025年看到大规模商业化应用。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-11-27,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录