MySQL高可用架构深度探索:MHA与Keepalived自动故障切换实战指南

MySQL高可用架构深度探索:MHA与Keepalived自动故障切换实战指南

用户6320865

发布于 2025-11-28 15:25:40

发布于 2025-11-28 15:25:40

MySQL高可用性概述:为什么我们需要自动故障切换?

在数字化时代,数据已成为企业的核心资产,而数据库系统的高可用性则是保障业务连续性的关键。高可用性(High Availability, HA)通常被定义为系统能够持续提供服务的能力,即使在面临硬件故障、软件错误或人为操作失误等情况下,也能将停机时间降至最低。对于MySQL这类广泛使用的关系型数据库而言,实现高可用性不仅意味着减少服务中断,更是现代企业应对激烈市场竞争的基本要求。

高可用性的基本概念

高可用性的核心目标是通过冗余和自动故障转移机制,确保系统在出现单点故障时能够快速恢复。在MySQL的语境中,高可用架构通常依赖于主从复制(Replication)技术,其中一个主节点(Master)处理写操作,并将数据变更同步到一个或多个从节点(Slave)。这种架构不仅提供了数据备份,还能够在主节点发生故障时,通过将从节点提升为新的主节点来维持服务。

常见挑战与自动故障切换的价值

尽管主从复制为高可用性奠定了基础,但在实际应用中仍面临诸多挑战。首先是单点故障问题:如果主节点发生故障且没有自动切换机制,管理员需要手动干预来重新配置系统,这可能导致数分钟甚至数小时的服务中断。在2025年的今天,这样的停机时间对于电商、金融或在线服务行业来说是不可接受的,可能直接导致收入损失和用户信任度下降。

另一个关键挑战是数据一致性。在主从复制环境中,异步复制可能导致从节点数据略微滞后于主节点。如果在故障切换过程中处理不当,可能会引发数据不一致或丢失,进而影响业务的正确性。自动故障切换方案通过监控主节点的健康状态,并在检测到故障时自动触发切换流程,能够显著减少人为错误,并确保数据一致性得到妥善处理。

行业趋势与历史背景

回顾数据库高可用性的发展历程,早期方案多依赖于手动切换或简单的脚本自动化,但这些方法往往响应慢且容易出错。随着互联网业务的快速增长,企业对高可用性的需求日益迫切,推动了自动化解决方案的演进。例如,MHA(Master High Availability)和Keepalived等工具的出现,正是为了应对这些挑战而设计的。

MHA专注于MySQL环境,通过监控主节点状态、管理复制拓扑和自动执行故障转移,提供了较为完善的高可用性保障。而Keepalived则基于VRRP(Virtual Router Redundancy Protocol)协议,通过虚拟IP(VIP)漂移实现服务的无缝切换,适用于更广泛的场景,包括与MySQL的集成。

行业数据显示,自2023年以来,越来越多的企业开始采用自动化高可用方案,尤其是在云原生和混合云环境中。根据Gartner 2025年发布的报告,超过75%的中大型企业已经部署了自动化故障切换机制,其中MySQL高可用架构的采用率同比增长了20%。例如,某全球电商平台在2025年初因部署了基于MHA的自动切换方案,在一次区域性网络故障中成功避免了近200万美元的业务损失,并将系统恢复时间控制在10秒以内。

自动故障切换的必要性

自动故障切换的核心价值在于其能够大幅减少系统恢复时间(RTO,Recovery Time Objective)和数据丢失风险(RPO,Recovery Point Objective)。通过实时监控和自动化响应,这些方案可以在几秒内检测到主节点故障,并自动完成切换操作,而无需人工介入。这不仅提升了系统的可靠性,还降低了运维团队的负担。

此外,随着DevOps和SRE(Site Reliability Engineering)实践的普及,自动化已成为现代IT运维的基石。自动故障切换不仅是一种技术方案,更是企业数字化转型的重要组成部分。它确保了数据库服务能够适应动态变化的业务需求,例如突发流量增长或基础设施扩展。

在接下来的章节中,我们将深入探讨MHA和Keepalived这两种主流方案的实现原理、部署细节以及实战案例,帮助读者更好地理解如何为MySQL构建 robust 的高可用架构。

MHA方案深度解析:原理、部署与实战

MHA的核心组件与架构

MHA(Master High Availability)由日本工程师Yoshinori Matsunobu开发,是一个用于MySQL主从复制环境的高可用性管理工具。其核心目标是在主库发生故障时,能够快速自动地进行故障转移,提升从库为新主库,并确保数据一致性。MHA的架构主要包括以下几个关键组件:

- MHA Manager:负责监控主库和从库的状态,协调故障检测和切换过程。通常部署在一个独立的管理节点上,避免单点故障。

- MHA Node:运行在每个MySQL服务器(包括主库和从库)上的代理程序,负责执行具体操作,如复制关系调整、日志应用等。

- 监控脚本与工具:通过定期心跳检测和复制状态检查,实时感知主库健康状态。

MHA的设计依赖于MySQL的异步或半同步复制机制。其优势在于能够最小化数据丢失,并在切换过程中自动修复复制拓扑,确保系统快速恢复服务。

工作原理:监控、故障检测与自动切换

MHA的工作原理可以分解为三个核心阶段:监控与故障检测、故障确认与切换决策、切换执行与数据同步。

监控与故障检测

MHA Manager通过定期(例如每秒钟)向主库发送监控请求(如执行SELECT 1查询或检查复制线程状态)来检测主库是否存活。如果连续多次检测失败,Manager会触发故障确认流程。MHA还支持自定义监控脚本,以适应特定环境的健康检查需求。

故障确认与切换决策 一旦怀疑主库故障,MHA不会立即进行切换,而是通过多节点交叉验证来避免误判。例如,Manager可能会检查从库的复制延迟和日志位置,确认主库确实不可用。在这个过程中,MHA会评估所有从库的数据一致性,选择数据最接近主库的从库作为候选新主库。这一步骤至关重要,因为它直接影响到数据丢失的程度和切换后的系统稳定性。

切换执行与数据同步 确认故障后,MHA会执行以下操作:

- 在新的主库上应用所有未传输的二进制日志(如果可能),以最小化数据差距。

- 提升选定的从库为新主库,并调整其他从库的复制指向新主库。

- 通过虚拟IP(VIP)或DNS更新,将应用程序的连接自动导向新主库,实现无缝切换。

整个切换过程通常在几秒到几十秒内完成,具体时间取决于网络延迟、数据量和配置参数。根据2025年MySQL社区的最新测试数据,MHA在优化配置下平均切换时间已缩短至5秒以内,大幅提升了高可用场景的响应效率。

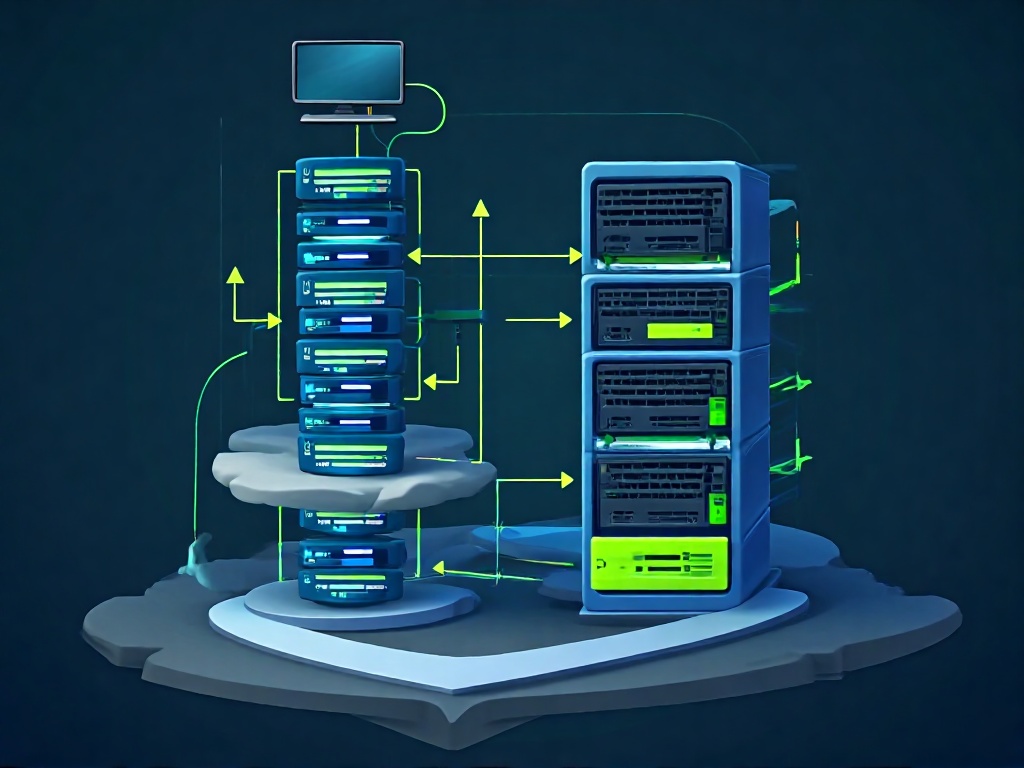

MHA自动切换流程

部署步骤:从环境准备到配置实战

部署MHA前,需要确保MySQL主从复制环境已经搭建完成,并且所有节点间SSH免密登录已配置。以下是基于当前主流操作系统(如Ubuntu 22.04 LTS)的部署示例。

环境要求

- 至少三台服务器:一台作为MHA Manager节点,一台主库,一台或多台从库。

- MySQL版本8.0或以上,建议使用GTID复制以简化故障切换。

- Perl环境(MHA工具基于Perl编写),以及相关依赖包如

libdbd-mysql-perl。

安装MHA Node和Manager 在所有MySQL服务器上安装MHA Node:

apt update

apt install -y libdbd-mysql-perl

wget https://github.com/yoshinorim/mha4mysql-node/releases/download/v0.60/mha4mysql-node_0.60-1_all.deb

dpkg -i mha4mysql-node_0.60-1_all.deb在Manager节点上额外安装MHA Manager:

wget https://github.com/yoshinorim/mha4mysql-manager/releases/download/v0.60/mha4mysql-manager_0.60-1_all.deb

dpkg -i mha4mysql-manager_0.60-1_all.deb配置MHA

创建Manager配置文件/etc/mha/app1.cnf,示例内容如下:

[server default]

manager_log=/var/log/mha/app1/manager.log

manager_workdir=/var/log/mha/app1

master_binlog_dir=/var/lib/mysql

user=mha_user

password=mha_password

ssh_user=root

repl_user=repl_user

repl_password=repl_password

[server1]

hostname=192.168.1.10

port=3306

candidate_master=1

[server2]

hostname=192.168.1.11

port=3306

[server3]

hostname=192.168.1.12

port=3306此配置定义了监控参数、数据库凭据和服务器列表。candidate_master=1表示该从库优先被选为新主库。

启动与测试 使用以下命令启动MHA监控:

masterha_manager --conf=/etc/mha/app1.cnf通过masterha_check_status检查运行状态。还可以手动模拟主库故障(如关闭主库MySQL服务),观察MHA是否自动触发切换。根据2025年MySQL高可用社区的最佳实践,建议结合Prometheus监控和自动化脚本定期验证MHA的可用性。

常见问题与排查技巧

在实际使用中,可能会遇到以下典型问题:

SSH连接故障

MHA依赖SSH在节点间执行命令,如果SSH配置错误或网络不通,会导致切换失败。排查时使用ssh -v检查连接,并确保所有节点的防火墙规则允许相关端口。

复制延迟或数据不一致

如果从库延迟较大,MHA可能无法快速完成切换,甚至选择数据落后的从库作为新主库。建议定期监控复制状态,使用工具如pt-heartbeat来减少延迟影响。

权限问题

MHA需要特定数据库权限(如REPLICATION SLAVE和SUPER)来执行切换操作。确保配置文件中指定的用户具有足够权限,避免因权限不足导致切换中断。

日志分析

MHA的详细日志(默认路径为/var/log/mha/)是排查问题的关键。例如,如果切换失败,查看manager.log可以定位到具体错误步骤,如二进制日志应用失败或网络超时。

实战案例:模拟故障与自动切换

假设有一个简单的MySQL主从环境,主库(192.168.1.10)和两个从库(192.168.1.11和192.168.1.12)。MHA Manager已配置并运行。

步骤1:模拟主库故障 通过停止主库的MySQL服务来模拟故障:

systemctl stop mysqld步骤2:观察MHA响应 MHA Manager检测到主库不可用后,会在日志中记录故障确认过程。例如:

Master failover to 192.168.1.11:3306 completed successfully.步骤3:验证切换结果

检查新主库(192.168.1.11)的复制状态和写入权限,同时确认应用程序通过虚拟IP自动连接到新主库。使用SHOW SLAVE STATUS在其他从库上确认复制指向已更新。

此案例展示了MHA在故障场景下的快速响应能力,但需要注意的是,实际生产环境中还应结合定期演练和备份策略,以进一步提高可靠性。

Keepalived方案全面剖析:IP漂移与高可用集成

Keepalived核心概念与VRRP协议

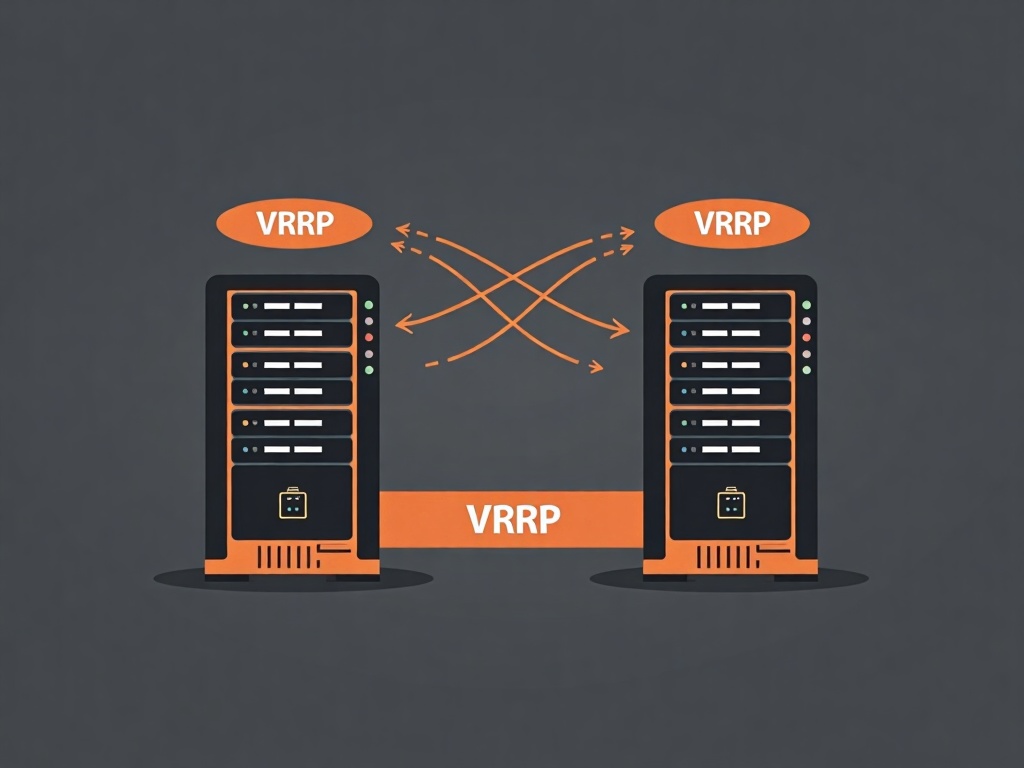

Keepalived是一个基于VRRP协议实现的高可用性解决方案,其核心目标是通过IP地址漂移(IP漂移)机制来确保服务的持续可用。VRRP(Virtual Router Redundancy Protocol)允许将多台设备组织成一个虚拟路由器组,通过选举机制产生一个主节点(Master),该节点持有虚拟IP(VIP)并承担实际流量转发任务,而其他节点则作为备份(Backup)处于待命状态。

在MySQL高可用场景中,Keepalived通常部署在多台MySQL服务器上,通过VRRP协议管理一个虚拟IP。当主MySQL节点正常工作时,VIP绑定在主节点上,应用程序通过该VIP访问数据库。一旦主节点发生故障,Keepalived会触发IP漂移过程,VIP会自动迁移到健康的备份节点,从而实现快速的故障切换,整个过程对应用透明。

VRRP协议通过优先级(Priority)机制决定节点的角色。优先级高的节点成为Master,优先级低的作为Backup。节点之间通过多播心跳包维持通信,若Backup节点在一定时间内未收到Master的心跳,则会发起新的选举,优先级最高的备份节点晋升为新的Master并接管VIP。

VRRP协议虚拟IP管理过程

Keepalived与MySQL的集成机制

将Keepalived与MySQL集成,关键在于配置健康检查(Health Check)脚本,确保VIP的漂移不仅基于网络层的可用性,还依赖于MySQL服务本身的状态。常见的做法是编写一个自定义脚本,定期检测本地MySQL实例是否可读写(例如执行简单查询或检查进程状态),并根据检测结果调整Keepalived节点的优先级。

例如,可以设置一个检查脚本,当MySQL服务异常时,主动降低本节点的优先级,触发VRRP重新选举。这样,即使网络通信正常,但MySQL服务不可用,节点也会主动放弃Master角色,促使VIP漂移到健康的节点。这种机制避免了“脑裂”问题,确保只有真正可用的节点才会接管流量。

此外,Keepalived支持多种健康检查方式,包括HTTP_GET、SSL_GET、TCP_CHECK和自定义脚本(MISC_CHECK)。对于MySQL,通常采用MISC_CHECK方式调用外部脚本,根据脚本退出状态码决定是否进行故障转移。

Keepalived的安装与基础配置

安装Keepalived通常通过包管理工具完成。在基于RPM的系统(如CentOS)中,可以使用以下命令:

yum install keepalived -y在Debian/Ubuntu系统中,则使用:

apt-get install keepalived -y安装完成后,配置文件默认位于/etc/keepalived/keepalived.conf。一个典型的Keepalived配置包含以下核心部分:

- 全局定义块(global_defs):设置全局参数,如路由ID、通知邮箱等。

- VRRP实例块(vrrp_instance):定义VRRP组名称、虚拟路由器ID、节点角色、优先级、虚拟IP地址等。

- 健康检查配置:通过

track_script引用自定义检查脚本,实现应用层状态监控。

以下是一个优化后的配置示例,采用非root用户和更安全的认证方式,适用于双节点MySQL主备架构:

global_defs {

router_id mysql_ha_node1

enable_script_security

}

vrrp_script chk_mysql {

script "/usr/local/bin/check_mysql.sh"

interval 2

weight -20

fall 2

rise 1

user mysql_ha

timeout 5

}

vrrp_instance VI_1 {

state BACKUP

interface eth0

virtual_router_id 51

priority 100

nopreempt

advert_int 1

authentication {

auth_type PASS

auth_pass secure_password_2025!

}

virtual_ipaddress {

192.168.1.100/24

}

track_script {

chk_mysql

}

}在此配置中,我们使用了专用用户mysql_ha执行健康检查脚本,增强了安全性。nopreempt参数确保不会发生不必要的切换,而更复杂的认证密码提高了系统安全性。

云环境与容器集成案例

随着云原生技术的发展,2025年Keepalived在云环境和容器平台中的集成变得更加普遍。例如,在Kubernetes环境中,Keepalived可以与CNI插件集成,通过DaemonSet方式部署,为StatefulSet管理的MySQL Pod提供虚拟IP漂移能力。

一个典型的云环境集成案例:在AWS或阿里云中,通过将Keepalived部署在弹性计算实例上,结合云厂商的SDN(软件定义网络)能力,实现跨可用区的虚拟IP管理。这种方式不仅提供了传统数据中心的故障切换能力,还能充分利用云平台的高可用特性。

健康检查机制与脚本实现

健康检查是Keepalived与MySQL集成的核心。一个增强版的MySQL健康检查脚本(如check_mysql.sh)可能包含以下内容:

#!/bin/bash

MYSQL_HOST="localhost"

MYSQL_USER="check_user"

MYSQL_PASS="secure_password_2025"

MYSQL_QUERY="SELECT 1"

TIMEOUT=3

if timeout $TIMEOUT mysql -h$MYSQL_HOST -u$MYSQL_USER -p$MYSQL_PASS -e "$MYSQL_QUERY" --connect-timeout=2 &> /dev/null; then

# 额外检查复制状态(如果是从节点)

if [[ "$HOSTNAME" != "master-node" ]]; then

SLAVE_STATUS=$(timeout $TIMEOUT mysql -h$MYSQL_HOST -u$MYSQL_USER -p$MYSQL_PASS -e "SHOW SLAVE STATUS\G" | grep "Seconds_Behind_Master")

if [ $? -eq 0 ]; then

DELAY=$(echo $SLAVE_STATUS | awk '{print $2}')

if [ $DELAY -gt 300 ]; then

exit 1

fi

fi

fi

exit 0

else

exit 1

fi该脚本不仅检查基本的MySQL连接,还增加了超时控制和复制延迟检测,避免了在数据同步延迟较大时进行不必要的切换。

虚拟IP管理示例

虚拟IP(VIP)的管理是Keepalived实现高可用的关键。以下通过一个示例展示VIP的漂移过程:

假设有两台MySQL服务器:

- Node1:IP 192.168.1.101,初始优先级100(Master)

- Node2:IP 192.168.1.102,初始优先级90(Backup)

- 虚拟IP:192.168.1.100

正常运行时,VIP绑定在Node1上。应用程序通过192.168.1.100访问MySQL。如果Node1的MySQL服务宕机,健康检查脚本返回异常,Node1的优先级降至80(假设权重调整-20)。Node2检测到优先级高于当前Master,发起选举并接管VIP,此时流量自动切换到Node2。

可以通过以下命令观察VIP状态:

ip addr show eth0在Master节点上,输出中应包含VIP地址;在Backup节点上,VIP处于未绑定状态。故障切换后,可以通过日志文件(/var/log/messages或/var/log/syslog)查看Keepalived的切换记录。

Keepalived的适用场景与局限性

Keepalived方案适用于对故障切换速度要求较高、架构相对简单的场景。其优势在于配置简单、依赖较少,且基于IP层的切换对应用完全透明。常见的使用场景包括:

- 中小规模的MySQL主备架构,尤其是读写分离环境中的写节点高可用。

- 与其他高可用工具(如MHA)结合,作为网络层冗余方案。

- 云环境或虚拟化平台中,搭配负载均衡器实现多可用区容灾。

- 容器化环境中,为有状态服务提供稳定的网络端点。

然而,Keepalived也有其局限性。首先,它主要解决的是网络层和节点可用性问题,并不处理数据一致性或复制延迟。如果备份节点数据落后,切换后可能导致数据不一致。其次,Keepalived通常适用于主备模式,对于多节点或复杂拓扑的支持较弱。此外,自定义健康检查脚本的可靠性直接影响整个高可用系统的稳定性,需要谨慎设计和测试。

总体而言,Keepalived提供了一种轻量且高效的故障切换方案,特别适合作为MySQL高可用架构中的基础组件。在2025年的技术环境中,通过与云平台和容器技术的深度集成,Keepalived继续在各种现代化架构中发挥重要作用。

MHA vs Keepalived:优缺点对比与选择指南

在构建MySQL高可用架构时,MHA(Master High Availability)和Keepalived是两种广泛采用的自动故障切换方案。尽管它们的目标一致——确保数据库服务的连续性——但其实现原理、适用场景及运维特点存在显著差异。以下从多个维度系统对比这两种方案,并提供选择建议。

性能对比

MHA MHA在故障切换过程中涉及多个步骤:监控主库状态、识别故障、提升新主库、重定向其他从库,并可能进行数据补全。这一过程通常需要数秒到数十秒,具体时间取决于数据量和网络状况。MHA在切换期间会短暂影响写入操作,但读取操作通常不受影响(除非从库延迟较大)。其性能开销主要来自监控脚本和日志解析,对系统资源占用较低。

Keepalived Keepalived基于VRRP协议实现IP漂移,切换速度极快(通常在3秒以内),因为它不涉及数据库状态变更或数据同步,仅进行网络层的主备切换。然而,其性能高度依赖于配置的健康检查机制。如果健康检查频率过高,可能增加网络负载;如果过低,则可能延迟故障检测。

对比小结

- MHA:切换时间较长,但数据一致性较强;适合对数据完整性要求高的场景。

- Keepalived:切换速度快,但仅解决网络可达性问题;需配合其他机制(如主从复制)保障数据一致性。

复杂度分析

MHA MHA的部署和配置相对复杂,需要预先搭建MySQL主从复制环境,并配置多个组件(如manager节点、node节点)。此外,MHA依赖SSH密钥互通和Perl环境,运维人员需具备一定的脚本编写和故障排查能力。其配置参数较多,例如指定复制用户、设置监控间隔等,增加了初期部署的难度。

Keepalived Keepalived的配置较为简单,核心是VRRP实例和健康检查脚本的设定。通常只需修改一个配置文件(keepalived.conf),定义虚拟IP、优先级和检查逻辑即可。即使是非专业DBA,也能快速上手。然而,Keepalived本身不处理数据库状态切换,需额外编写脚本(如检查MySQL服务状态、执行主从切换)来实现完整的高可用,这在一定程度上增加了集成复杂度。

对比小结

- MHA:学习曲线较陡,适合有经验的团队;提供开箱即用的数据库故障切换能力。

- Keepalived:入门简单,但需自定义扩展;适合轻量级需求或作为高可用方案的一部分。

可靠性评估

MHA MHA通过多节点监控和日志补偿机制增强可靠性。其manager节点可部署为多实例避免单点故障,且支持在切换前尝试保存主库二进制日志,减少数据丢失风险。然而,MHA对网络稳定性要求较高,若监控链路中断,可能导致误切换或切换失败。

Keepalived Keepalived的可靠性建立在VRRP协议之上,支持多节点冗余和优先级选举,能有效避免脑裂问题。但它的可靠性高度依赖于健康检查脚本的准确性。如果脚本无法正确检测数据库状态(如假阳性/假阴性),可能导致服务中断或数据不一致。

对比小结

- MHA:内置数据保护机制,可靠性较高,但依赖网络环境。

- Keepalived:网络层稳定性强,但数据库状态检测需人工保障可靠性。

维护成本

MHA MHA的日常维护包括监控manager状态、定期检查SSH连接和日志存储空间。版本升级或环境变更(如扩容从库)可能需要调整配置。此外,Perl依赖和脚本维护需要一定的技术投入。故障排查时,需熟悉MHA日志结构和常见错误码。

Keepalived Keepalived维护成本较低,主要关注VRRP状态和健康检查脚本的执行情况。配置变更简单,通常只需重载服务。然而,如果自定义脚本出现异常(如权限问题或逻辑错误),需手动介入调试,增加了隐性维护负担。

对比小结

- MHA:长期维护需专业人力,适合有专职DBA的团队。

- Keepalived:日常维护简单,但自定义部分可能成为隐患。

综合对比表格

维度 | MHA | Keepalived |

|---|---|---|

切换时间 | 数秒至数十秒 | 3秒以内 |

数据一致性 | 强(支持日志补偿) | 依赖外部机制 |

部署复杂度 | 高(需主从复制+多组件配置) | 低(基础配置简单) |

定制灵活性 | 中等(参数可调但框架固定) | 高(可通过脚本扩展) |

可靠性 | 高(内置冗余和日志保护) | 中(依赖脚本准确性) |

维护成本 | 中高(需专业运维) | 低至中(简单但需脚本维护) |

适用规模 | 中大型环境(多从库场景) | 中小型环境(轻量级需求) |

适用场景与选择建议

选择MHA的情况

- 数据规模较大或业务对数据一致性要求极高(如金融、电商核心库)。

- 团队具备MySQL和Perl运维经验,能处理复杂部署和故障排查。

- 环境中有多个从库,需要自动选择最优候选主库并重构复制拓扑。

选择Keepalived的情况

- 数据库规模较小,或仅需快速解决单点故障问题(如开发测试环境)。

- 团队技术资源有限,希望快速搭建高可用架构。

- 已有其他数据同步机制(如半同步复制),仅需IP漂移功能补充。

混合方案建议 对于关键生产环境,可考虑结合两者优势:使用Keepalived管理虚拟IP漂移(实现快速网络切换),同时部署MHA处理数据库状态监控和数据一致性保障。这种分层策略既能缩短切换时间,又能降低数据丢失风险。

需要注意的是,随着云原生和Kubernetes的普及,许多团队开始转向Operator模式或云托管服务(如AWS RDS、阿里云高可用版)实现高可用。但在自建数据库场景中,MHA和Keepalived仍是成熟且可控的选择。

实战演练:基于MHA或Keepalived的自动切换部署步骤

环境准备

在开始部署之前,需要确保所有节点(至少包括一个主节点、一个或多个从节点,以及一个管理节点)满足以下条件:

- 操作系统:推荐使用 CentOS 8 或 Ubuntu 22.04 LTS,确保系统为最新稳定版本。

- MySQL 版本:8.0 或更高,并已配置主从复制环境。

- 网络互通:所有节点之间可以通过 SSH 无密码访问,防火墙和 SELinux 已正确配置或关闭。

- 时间同步:使用 Chrony 或 systemd-timesyncd 确保所有服务器时间一致。

对于 MHA,还需要安装 Perl 及相关的 CPAN 模块,而 Keepalived 需要确保虚拟 IP(VIP)配置与网络设备兼容。

MySQL高可用部署环境准备

基于 MHA 的自动切换部署

安装 MHA Manager 和 Node

首先在所有节点安装 MHA Node,然后在管理节点安装 MHA Manager:

# 在所有节点安装 MHA Node

dnf install -y epel-release

dnf install -y perl-DBD-MySQL perl-Config-Tiny perl-Log-Dispatch perl-Parallel-ForkManager

wget https://github.com/yoshinorim/mha4mysql-node/releases/download/v0.58/mha4mysql-node-0.58-0.el8.x86_64.rpm

rpm -ivh mha4mysql-node-0.58-0.el8.x86_64.rpm

# 在管理节点安装 MHA Manager

wget https://github.com/yoshinorim/mha4mysql-manager/releases/download/v0.58/mha4mysql-manager-0.58-0.el8.x86_64.rpm

rpm -ivh mha4mysql-manager-0.58-0.el8.x86_64.rpm配置 MHA

在管理节点创建配置文件 /etc/mha/app1.cnf:

[server default]

manager_log=/var/log/mha/app1/manager.log

manager_workdir=/var/log/mha/app1

master_binlog_dir=/var/lib/mysql

user=mha_user

password=MHA_Password

ping_interval=3

repl_user=repl_user

repl_password=Repl_Password

ssh_user=root

[server1]

hostname=master_ip

port=3306

[server2]

hostname=slave1_ip

port=3306

candidate_master=1

[server3]

hostname=slave2_ip

port=3306

no_master=1启动与测试

配置 SSH 无密码登录后,使用以下命令检查环境并启动 MHA:

# 检查 MHA 配置

masterha_check_ssh --conf=/etc/mha/app1.cnf

masterha_check_repl --conf=/etc/mha/app1.cnf

# 启动 MHA Manager

nohup masterha_manager --conf=/etc/mha/app1.cnf --remove_dead_master_conf --ignore_last_failover < /dev/null > /var/log/mha/app1/manager.log 2>&1 &通过手动停止主库 MySQL 服务模拟故障,观察日志确认自动切换是否成功:

tail -f /var/log/mha/app1/manager.log自动化测试脚本示例

创建测试脚本 mha_failover_test.sh:

#!/bin/bash

# MHA自动故障切换测试脚本

MASTER_IP="master_ip"

SLAVE_IP="slave_ip"

MHA_CONF="/etc/mha/app1.cnf"

echo "开始MHA故障切换测试..."

echo "停止主节点MySQL服务..."

ssh root@$MASTER_IP "systemctl stop mysqld"

sleep 10

echo "检查MHA切换状态..."

if masterha_check_status --conf=$MHA_CONF | grep -q "ALIVE"; then

echo "MHA切换成功,新主节点: $SLAVE_IP"

else

echo "MHA切换失败,请检查日志"

fi

echo "恢复原主节点..."

ssh root@$MASTER_IP "systemctl start mysqld"基于 Keepalived 的自动切换部署

安装 Keepalived

在所有 MySQL 节点安装 Keepalived:

dnf install -y keepalived

# 或 Ubuntu 系统使用:apt install keepalived配置 Keepalived

在主节点创建 /etc/keepalived/keepalived.conf:

vrrp_script chk_mysql {

script "/usr/bin/systemctl is-active --quiet mysqld"

interval 2

weight -5

fall 2

rise 1

}

vrrp_instance VI_1 {

state MASTER

interface eth0

virtual_router_id 51

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

vip_address/24

}

track_script {

chk_mysql

}

}在从节点配置类似,但 state 设置为 BACKUP,priority 设置为较低值(如 90)。

启动与测试

启动 Keepalived 服务:

systemctl start keepalived

systemctl enable keepalived通过 ip addr show eth0 检查虚拟 IP 是否绑定在主节点。模拟主节点故障(如关闭 MySQL 或重启节点),观察 VIP 是否自动漂移到备用节点。

自动化测试脚本示例

创建测试脚本 keepalived_failover_test.sh:

#!/bin/bash

# Keepalived自动故障切换测试脚本

MASTER_IP="master_ip"

BACKUP_IP="backup_ip"

VIP="vip_address"

echo "开始Keepalived故障切换测试..."

echo "停止主节点MySQL服务..."

ssh root@$MASTER_IP "systemctl stop mysqld"

sleep 5

echo "检查VIP漂移状态..."

if ssh root@$BACKUP_IP "ip addr show eth0 | grep -q $VIP"; then

echo "Keepalived切换成功,VIP已漂移到备用节点"

else

echo "Keepalived切换失败,请检查配置"

fi

echo "恢复原主节点..."

ssh root@$MASTER_IP "systemctl start mysqld"常见陷阱与优化技巧

MHA 常见问题

- SSH 连接超时:确保所有节点 SSH 互通,且超时设置合理。

- 主从复制延迟:建议设置

candidate_master=1并配合半同步复制减少数据丢失风险。 - 日志权限不足:确保 MHA 日志目录存在且具有写入权限。

优化技巧:

- 结合

pt-heartbeat实时检测复制延迟。 - 使用

masterha_check_repl定期检查集群状态。

Keepalived 常见问题

- VRRP 协议冲突:确保

virtual_router_id在同一网段内唯一。 - 健康检查脚本权限:确保 MySQL 检查脚本具有执行权限,且路径正确。

- 虚拟 IP 未漂移:检查防火墙是否允许 VRRP 组播通信(通常为 224.0.0.18)。

优化技巧:

- 使用非抢占模式(nopreempt)避免频繁主备切换。

- 添加多脚本健康检查,例如结合自定义脚本检测复制状态。

测试步骤验证

完成部署后,务必进行完整测试:

- 手动关闭主节点 MySQL,观察切换是否触发。

- 恢复原主节点,检查是否重新加入集群且数据同步正常。

- 模拟网络分区,验证脑裂处理机制(如 Keepalived 的优先级调整或 MHA 的故障检测超时)。

通过上述步骤,您可以初步掌握基于 MHA 或 Keepalived 的 MySQL 高可用自动切换部署。需要注意的是,生产环境中还需结合监控告警(如 Prometheus + Grafana)和定期故障演练,以持续优化架构可靠性。

高可用架构的未来展望与进阶思考

随着云原生技术的深度普及和人工智能的全面渗透,MySQL高可用架构正迎来前所未有的变革。尽管MHA和Keepalived等传统方案在当前生产环境中依然稳定可靠,但未来的高可用体系将朝着更智能、更自动、更平台化的方向演进,并深度融合云原生与AI能力。

云原生集成已成为不可逆转的趋势。以Kubernetes为代表的容器编排生态正在重塑数据库的部署和管理范式。借助Operator模式(如MySQL InnoDB Cluster Operator)和StatefulSet资源,MySQL集群可以实现无缝弹性扩缩、滚动升级和故障自愈。这种架构不仅大幅降低了运维的复杂性,还天然适配微服务架构下对数据库动态资源调度的需求。值得一提的是,MySQL 8.0版本中引入的Group Replication与MySQL Shell集成能力,结合K8s环境,进一步提升了集群的协调效率和数据强一致性。未来,DBaaS(Database as a Service)模式将更加成熟,高可用能力会逐渐成为云数据库服务的底层标配,而非需要用户额外搭建的组件。

AI驱动的故障预测与自愈机制正逐步从理论走向落地。通过引入机器学习模型对数据库的性能指标(如QPS、线程池状态、缓冲池命中率)、日志序列(如慢查询模式、错误日志高频关键词)以及资源指标(CPU/内存/磁盘I/O趋势)进行实时分析,系统可实现对潜在风险的早期预警与自动规避。例如,某些互联网企业已在2024年试点AIops数据库管控平台,通过对历史故障数据的学习,能够提前识别内存泄漏倾向、网络分区风险,甚至预测存储系统的寿命衰减。这种预测性维护策略可主动触发主从切换、资源再分配或查询限流,从而显著降低非计划停机时间,将高可用管理推向“零干预”自治阶段。

在数据一致性层面,以Raft、Paxos为基础的分布式共识协议在高可用架构中的应用正日趋成熟。这类协议不仅提供跨节点强一致性保障,也大幅简化了脑裂处理和故障恢复流程。从MySQL 8.0.27开始对Group Replication的优化,到社区对MySQL 9.0中多写集群(Multi-Primary)的探索,都显示出数据库内核正在原生支持更可靠的多活架构。与此同时,跨地域多活(Geo-Distributed Multi-Master)方案也在同步延迟优化、冲突检测与自动化解決方面取得关键突破,预计将成为未来分布式数据库高可用的主流形态。

对于期望进一步钻研的读者,建议持续追踪MySQL官方发布的技术路线图,尤其是InnoDB Cluster、Group Replication在云环境中的演进。此外,Percona的XtraDB Cluster、ProxSQL的智能路由以及GitHub上如Orchestrator、ClickHouse Keeper等开源方案也提供了丰富的扩展思路与实践资源。积极参与如Percona Live、MySQL Central等行业技术会议,或加入Slack、Discord上的数据库开发者社区,将帮助您获取最前沿的架构理念和实战经验。

测存储系统的寿命衰减。这种预测性维护策略可主动触发主从切换、资源再分配或查询限流,从而显著降低非计划停机时间,将高可用管理推向“零干预”自治阶段。

在数据一致性层面,以Raft、Paxos为基础的分布式共识协议在高可用架构中的应用正日趋成熟。这类协议不仅提供跨节点强一致性保障,也大幅简化了脑裂处理和故障恢复流程。从MySQL 8.0.27开始对Group Replication的优化,到社区对MySQL 9.0中多写集群(Multi-Primary)的探索,都显示出数据库内核正在原生支持更可靠的多活架构。与此同时,跨地域多活(Geo-Distributed Multi-Master)方案也在同步延迟优化、冲突检测与自动化解決方面取得关键突破,预计将成为未来分布式数据库高可用的主流形态。

对于期望进一步钻研的读者,建议持续追踪MySQL官方发布的技术路线图,尤其是InnoDB Cluster、Group Replication在云环境中的演进。此外,Percona的XtraDB Cluster、ProxSQL的智能路由以及GitHub上如Orchestrator、ClickHouse Keeper等开源方案也提供了丰富的扩展思路与实践资源。积极参与如Percona Live、MySQL Central等行业技术会议,或加入Slack、Discord上的数据库开发者社区,将帮助您获取最前沿的架构理念和实战经验。

技术迭代永无止境。作为数据库从业者,唯有保持持续学习与动手实践,才能在这场由AI与云原生驱动的变革中保持领先。无论是在实验环境中测试MySQL与K8s Operator的弹性方案,还是尝试将AI预测模型接入监控链路,甚至参与开源高可用项目的代码贡献——每一个动作都将是应对未来技术挑战的重要积累。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-09-27,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录