Spark与Iceberg/Hudi/Delta Lake:构建湖仓一体的深度集成原理

Spark与Iceberg/Hudi/Delta Lake:构建湖仓一体的深度集成原理

用户6320865

发布于 2025-11-28 13:58:26

发布于 2025-11-28 13:58:26

引言:湖仓一体架构的兴起与Spark的核心角色

随着企业数据规模呈指数级增长,传统的数据仓库与数据湖架构各自面临瓶颈。数据仓库虽然提供强一致性和高性能查询,但扩展性有限且成本高昂;数据湖虽能存储海量原始数据,却缺乏事务支持和数据治理能力。这种割裂状态催生了湖仓一体(Lakehouse)架构的兴起,它旨在融合两者的优势:在数据湖的低成本存储基础上,实现数据仓库的ACID事务、数据版本管理和高效分析能力。

在这一演进过程中,Apache Spark作为分布式计算框架的核心作用不可替代。自2014年发布以来,Spark凭借其内存计算、统一批流处理API(如DataFrame和SQL)以及丰富的生态系统,已成为大数据处理的事实标准。然而,原生Spark在数据管理层面存在局限——它缺乏内置的事务机制,无法直接保证数据的原子性和一致性,也难以支持时间旅行等高级功能。这正是表格式(Table Format)技术登场的背景。

Iceberg、Hudi和Delta Lake作为新一代表格式,通过元数据层抽象解决了上述痛点。它们与Spark深度集成,将底层数据文件(如Parquet、ORC)封装为具有事务语义的表,使Spark能够像操作传统数据库一样管理数据湖中的数据集。例如,通过Spark SQL或DataFrame API,用户可以直接对这些表执行ACID事务操作(如INSERT、UPDATE、MERGE),并利用时间旅行功能查询历史数据快照。这种集成不仅提升了数据可靠性,还简化了架构复杂度,避免了传统ETL管道中多套系统带来的运维负担。

本文将从原理层面深入解析Spark与这三种表格式的协同机制。首先回顾Spark的核心特性及其与表格式集成的必要性,随后分章节详细探讨Iceberg、Hudi和Delta Lake如何实现ACID事务、时间旅行和增量处理等功能,并通过对比分析与实践案例帮助读者构建高效的湖仓一体架构。目标读者包括数据工程师、架构师以及任何希望深入了解现代数据管理技术的爱好者。通过阅读本文,您将掌握如何利用Spark与表格式技术应对真实场景中的数据一致性、性能优化和治理挑战。

Apache Spark基础:数据处理与表格式集成概述

Apache Spark作为大数据处理领域的核心引擎,自诞生以来就以其高性能的内存计算能力和灵活的编程模型赢得了广泛认可。其核心数据结构DataFrame和Dataset提供了强大的结构化数据处理能力,而Spark SQL则让用户能够通过标准SQL语句直接操作数据,大大降低了使用门槛。结构化流处理(Structured Streaming)进一步扩展了Spark的边界,使得实时数据管道与批处理作业能够在同一套API下无缝集成。

然而,随着数据湖和湖仓一体架构的兴起,Spark在处理大规模数据时面临新的挑战。传统的数据湖存储格式(如Parquet、ORC)虽然提供了高效的列式存储,但缺乏事务支持、数据版本管理和元数据一致性保障。这导致数据工程师在实现ACID事务、数据回滚和时间旅行等功能时不得不依赖外部工具或自定义解决方案,增加了系统的复杂性和维护成本。

正是在这样的背景下,表格式(Table Format)技术应运而生。Iceberg、Hudi和Delta Lake作为三种主流的表格式,通过为数据湖添加表级抽象层,弥补了Spark在数据管理方面的不足。它们与Spark的深度集成使得用户能够在保持Spark高性能计算的同时,获得企业级数据管理能力。

Iceberg由Netflix开发并捐赠给Apache基金会,它通过隐藏分区、元数据层优化和快照隔离机制,为Spark提供了完善的ACID事务支持和时间旅行功能。Hudi(Hadoop Upserts Deletes and Incrementals)由Uber推出,专注于增量数据处理和高效的upsert操作,特别适合需要近实时数据更新的场景。Delta Lake则由Databricks主导开发,完全兼容Spark API,提供了事务日志、模式演进和数据版本管理等核心功能。

这三种表格式虽然设计理念和实现细节有所不同,但都与Spark形成了紧密的集成关系。通过Spark DataSource V2 API,它们能够以插件化的方式与Spark引擎交互,使得用户可以通过熟悉的DataFrame API或Spark SQL直接操作这些表格式的数据。例如,在Spark中读取Iceberg表只需要简单的格式指定:

val df = spark.read.format("iceberg").load("path/to/table")这种集成不仅简化了数据操作流程,还保持了Spark计算引擎的高性能特性。同时,表格式的元数据管理能力使得Spark能够更高效地执行谓词下推、分区裁剪等优化操作,进一步提升查询性能。

值得注意的是,表格式的引入并没有改变Spark的核心计算模型,而是通过扩展其存储层的 capabilities,使得Spark在湖仓一体架构中能够同时承担数据计算和数据管理的双重角色。这种设计哲学符合大数据领域“计算与存储分离”的趋势,同时通过智能的元数据管理和优化,减少了因数据移动带来的性能开销。

随着数据规模的不断增长和业务需求的日益复杂,Spark与表格式的深度集成正在成为构建现代数据架构的标准实践。这种结合不仅解决了数据湖场景下的数据一致性和可靠性问题,还为机器学习、实时分析等高级应用场景提供了更加稳固的数据基础。

Iceberg与Spark集成:ACID事务与时间旅行原理

元数据管理机制

Iceberg通过多层级元数据架构实现与Spark的深度集成,其核心在于将元数据分为三层:元数据文件(Metadata File)、清单列表(Manifest List)和清单文件(Manifest File)。这种设计使得Spark能够高效地处理大规模数据集的元数据操作。

在Spark中集成Iceberg时,首先需要通过配置SparkSession来指定Iceberg作为数据源:

import org.apache.spark.sql.SparkSession

val spark = SparkSession.builder()

.appName("IcebergIntegration")

.config("spark.sql.catalog.spark_catalog", "org.apache.iceberg.spark.SparkSessionCatalog")

.config("spark.sql.catalog.spark_catalog.type", "hive")

.config("spark.sql.extensions", "org.apache.iceberg.spark.extensions.IcebergSparkSessionExtensions")

.getOrCreate()

Iceberg元数据层级架构

元数据文件记录了表的最新状态,包括schema、分区信息和当前清单列表的引用。清单列表则包含指向多个清单文件的指针,而每个清单文件又记录了数据文件的具体信息(如路径、统计信息等)。这种分层结构使得Spark在查询时只需读取必要的元数据,显著减少了元数据操作的开销。

ACID事务实现原理

Iceberg通过原子性的提交机制实现ACID事务。每个数据修改操作(如INSERT、UPDATE、DELETE)都会生成新的元数据文件,并通过原子交换操作更新表的元数据指针。这种机制确保了事务的原子性和一致性。

在Spark中执行事务性写入操作时,Iceberg会创建新的数据文件和对应的元数据版本。例如,执行数据插入操作:

// 创建Iceberg表

spark.sql("""

CREATE TABLE local.db.sample (

id bigint,

data string)

USING iceberg

PARTITIONED BY (days(data))

""")

// 事务性写入数据

val data = Seq((1L, "A"), (2L, "B")).toDF("id", "data")

data.writeTo("local.db.sample").append()提交过程中,Iceberg会先写入新的数据文件,然后生成新的元数据版本,最后通过原子操作将元数据指针更新到新版本。如果提交过程中发生故障,原有的元数据版本保持不变,确保了事务的原子性。同时,通过快照隔离机制,Iceberg保证并发读写操作不会相互干扰,读取操作始终看到一致的快照视图。

时间旅行功能实现

时间旅行功能基于Iceberg的快照机制实现。每次提交都会生成一个新的快照,记录了该时间点表的完整状态。每个快照都包含时间戳信息和唯一的快照ID,使得用户可以查询特定时间点或快照版本的数据。

在Spark中执行时间旅行查询:

// 根据时间戳查询历史数据

spark.read

.option("as-of-timestamp", "2025-07-25 09:30:00")

.table("local.db.sample")

.show()

// 根据快照ID查询历史数据

spark.read

.option("snapshot-id", 1234567890L)

.table("local.db.sample")

.show()Iceberg通过在元数据中维护快照的时间线来实现时间旅行。每个快照都指向其父快照,形成版本链。当执行时间旅行查询时,Spark会根据指定的时间戳或快照ID定位到对应的快照,然后使用该快照的元数据信息来读取数据文件。这种机制不仅支持数据版本回溯,还支持版本比较和回滚操作。

文件组织与查询优化

Iceberg采用隐藏分区和元数据过滤技术来优化Spark查询性能。通过将分区信息存储在元数据中,而不是依赖目录结构,Iceberg允许更灵活的分区策略。Spark在执行查询时,可以首先读取元数据中的统计信息(如最小值、最大值、空值计数等),快速跳过不满足条件的数据文件。

例如,在查询包含时间范围过滤的条件时:

spark.sql("""

SELECT * FROM local.db.sample

WHERE timestamp > '2025-07-25 09:00:00'

AND timestamp < '2025-07-25 10:00:00'

""")Iceberg的元数据会帮助Spark识别哪些数据文件可能包含符合条件的数据,从而显著减少实际需要扫描的数据量。这种优化对于大规模数据湖查询特别重要,可以降低I/O开销并提高查询性能。

并发控制机制

Iceberg使用乐观并发控制(Optimistic Concurrency Control)来处理并发写入冲突。当多个Spark作业同时尝试修改同一张表时,Iceberg会通过快照隔离确保读写操作互不干扰。写入操作在提交时会检查当前快照是否与开始写入时的快照一致,如果发现冲突,则会抛出异常并要求重试。

这种机制通过以下代码示例展示:

try {

// 尝试并发写入

data.writeTo("local.db.sample").append()

} catch {

case e: org.apache.iceberg.exceptions.CommitFailedException =>

// 处理写入冲突,通常需要重试逻辑

println("Write conflict detected, retrying...")

}通过这种设计,Iceberg在保持高性能的同时,确保了数据的一致性和完整性。

Hudi与Spark集成:增量处理与数据湖优化

Hudi的核心架构与设计理念

Apache Hudi(Hadoop Upserts Deletes and Incrementals)作为一个开源数据湖表格式,其核心设计目标是解决大数据场景下的增量数据处理挑战。Hudi通过将存储层优化与计算引擎深度集成,为Spark用户提供了高效的upsert(更新/插入)、delete(删除)和incremental query(增量查询)能力。其架构基于两个关键概念:Copy on Write(写时复制)和Merge on Read(读时合并),这两种模式分别针对不同的性能与延迟需求进行优化。

在Copy on Write模式下,Hudi在数据写入时直接生成新的数据文件,并更新元数据索引,适合读多写少的场景,能够保证查询性能的一致性。而Merge on Read模式则允许实时写入增量日志文件,在查询时动态合并基础文件和日志,适合需要低写入延迟的场景。这两种模式的灵活性使得Hudi能够适应多样化的业务需求,从实时数据分析到批处理任务均可覆盖。

Hudi的元数据管理采用时间轴(Timeline)机制,所有对表的操作(如commit、compact)均被记录为时间轴事件,支持ACID事务和时间旅行功能。每个commit对应一个事务版本,用户可以通过指定时间戳或版本号查询历史数据状态,这为数据审计、回滚和增量管道提供了坚实基础。

Spark与Hudi的集成机制

Hudi与Spark的集成主要体现在Spark DataFrame API和Spark SQL的扩展支持上。用户可以通过Hudi的Spark数据源(org.apache.hudi)直接读写Hudi表,无需额外配置复杂的底层存储逻辑。例如,使用spark.read.format("hudi")加载数据,或通过df.write.format("hudi")写入数据,并指定操作类型(如upsert、insert、bulk_insert)。

在写入过程中,Hudi利用Spark的分布式计算能力处理数据分区、索引构建和文件合并。例如,执行upsert操作时,Hudi会首先查询现有数据的索引(支持布隆索引、HBase索引等多种类型),快速定位需要更新的记录,然后生成新的文件版本或增量日志。这一过程通过Spark的并行任务执行,显著提升了大规模数据集的更新效率。

对于增量处理,Hudi提供了HoodieIncrementalReader类,允许Spark作业仅读取自上次处理以来变更的数据,而非全表扫描。这在ETL管道中极为有用,例如仅处理新增的订单记录或用户活动日志,减少计算资源和时间的消耗。用户可以通过指定beginInstantTime和endInstantTime来定义增量查询的范围,结合Spark Structured Streaming还可以实现近实时的数据摄取与处理。

增量处理与Upsert操作的实现

Hudi的增量处理能力是其与Spark集成的核心优势之一。通过时间轴元数据,Hudi能够跟踪所有数据变更,并提供增量拉取(Incremental Pull)功能。用户可以使用Spark作业定期查询自上次提交后的变更数据,用于下游数据同步、聚合或机器学习特征更新。

Upsert操作是Hudi的另一大亮点,它解决了传统大数据存储(如HDFS)难以高效更新记录的痛点。在Spark中执行upsert时,用户只需将DataFrame写入Hudi表并指定operation为upsert,Hudi会自动处理新旧记录的合并。例如,在用户画像场景中,可以持续更新用户的属性字段(如最后登录时间),而无需重写整个分区。

以下是一个简单的代码示例,演示如何使用Spark进行Hudi upsert操作:

val hudiOptions = Map[String,String](

"hoodie.table.name" -> "user_profiles",

"hoodie.datasource.write.operation" -> "upsert",

"hoodie.datasource.write.recordkey.field" -> "user_id",

"hoodie.datasource.write.precombine.field" -> "timestamp"

)

val updatesDF = spark.read.json("/path/to/incremental/data")

updatesDF.write.format("hudi")

.options(hudiOptions)

.mode("append")

.save("/hudi/user_profiles")此代码中,recordkey.field指定了主键字段,precombine.field定义了冲突解决策略(选择时间最新的记录),确保了数据一致性。

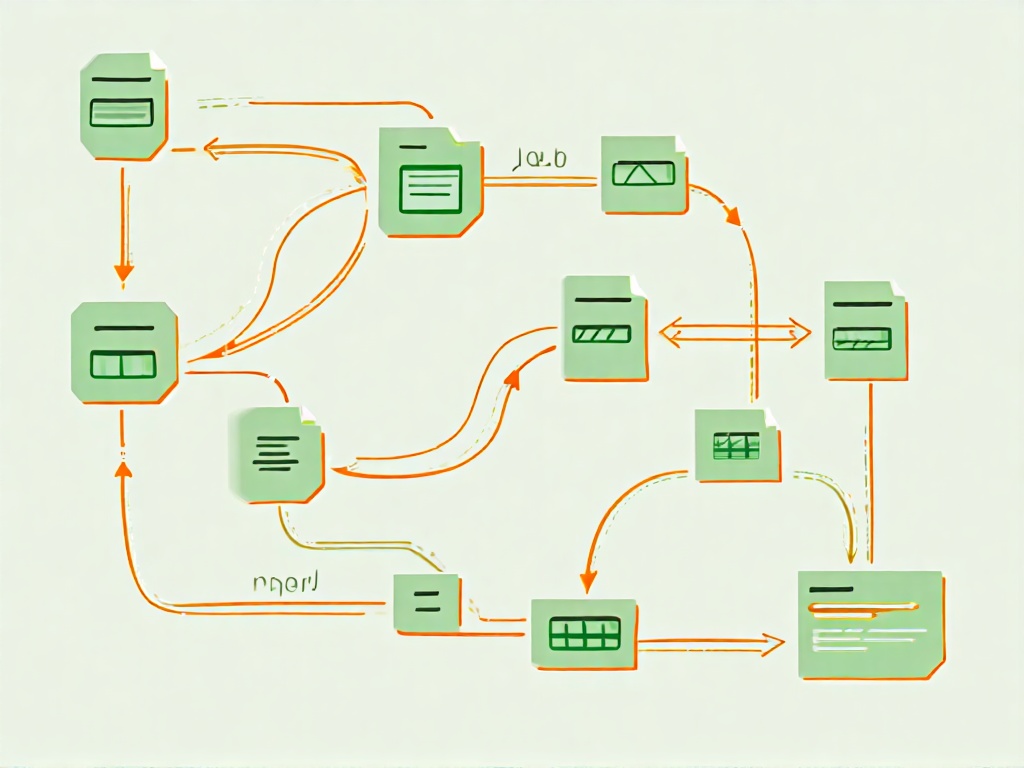

Hudi增量处理与Upsert数据流

数据湖性能优化策略

Hudi通过多种机制优化数据湖的读写性能。首先,其索引机制(如布隆索引)大幅减少了upsert和delete操作时需要扫描的数据量,避免了全表搜索的开销。其次,Hudi支持自动压缩(Compaction)和清理(Cleanup)功能,通过后台任务合并小文件并删除旧版本数据,维持存储效率。

在Spark集成中,用户可以通过调整Hudi配置参数来优化性能。例如,设置hoodie.parquet.max.file.size控制输出文件大小,避免小文件问题;或调整hoodie.copyonwrite.record.size.estimate优化内存使用。此外,Hudi支持分区剪枝(Partition Pruning)和谓词下推(Predicate Pushdown),利用Spark的查询优化器减少I/O操作。

对于大规模数据湖,Hudi还提供了集群模式(Clustering)功能,允许用户重新组织数据布局(如按时间排序),提升查询性能。这一功能可以通过Spark作业触发,与现有数据处理管道无缝集成。

实际应用场景与最佳实践

Hudi与Spark的集成在多个行业场景中得到广泛应用。在电商领域,用户行为日志的实时更新和查询常采用Hudi的Merge on Read模式,平衡写入延迟和查询性能。在金融行业,合规审计需要时间旅行功能,Hudi的时间轴机制能够快速回溯历史数据状态。

最佳实践包括:根据读写比例选择Copy on Write或Merge on Read模式;定期执行压缩作业以优化存储;利用Hudi的元数据表(Metadata Table)加速文件列表操作(避免Listing开销)。此外,建议在Spark作业中监控Hudi的提交时间与文件大小,动态调整参数以适应数据增长。

尽管Hudi提供了强大的功能,但在实际部署时仍需注意与现有数据生态的兼容性,例如与Hive Metastore的集成或与对象存储(如S3、OSS)的协同工作。

Delta Lake与Spark集成:统一数据管理平台

Delta Lake作为Databricks推出的开源表格式,专为Apache Spark生态系统设计,旨在解决数据湖中的可靠性、一致性和性能问题。它通过深度集成Spark,提供了ACID事务支持、模式演进、时间旅行等关键功能,助力企业构建统一的湖仓一体架构。这种集成不仅仅是简单的兼容,而是从底层元数据管理到事务处理的全面融合,使Spark能够像操作传统数据库一样高效管理数据湖。

Delta Lake统一数据管理平台

核心集成机制:事务与元数据层

Delta Lake与Spark的集成核心在于其事务日志(Transaction Log)和元数据管理。Delta Lake使用Apache Parquet作为底层存储格式,并通过事务日志记录所有数据变更操作,确保ACID事务的原子性、一致性、隔离性和持久性。当Spark执行数据写入、更新或删除操作时,Delta Lake的事务管理器会协调这些操作,避免数据冲突和部分写入问题。例如,在Spark作业中执行df.write.format("delta").mode("overwrite").save(path)时,Delta Lake会自动处理事务提交,确保即使在作业失败时也能保持数据一致性。

这种机制使得Spark用户无需额外配置复杂的外部工具,即可在数据湖中实现多版本并发控制(MVCC)。事务日志以JSON文件形式存储,记录了每个操作的版本信息,Spark可以直接读取这些日志来协调并发读写,从而支持高吞吐量的数据处理场景。

时间旅行与数据版本管理

时间旅行(Time Travel)是Delta Lake与Spark集成的一大亮点,它允许用户查询历史数据版本,支持数据审计、回滚和重复实验。Delta Lake通过事务日志中的版本号和时间戳记录所有数据变更,Spark SQL可以直接使用VERSION AS OF或TIMESTAMP AS OF语法访问特定时间点的数据。例如,执行SELECT * FROM delta_table VERSION AS OF 123可以检索版本123的数据快照。

这一功能在数据 pipeline 调试和合规性场景中极为实用。Spark用户无需备份整个数据集,即可通过Delta Lake的内置版本管理快速恢复错误操作或分析数据演变历史。结合Spark的批处理和流处理能力,时间旅行使得数据湖能够同时满足实时分析和历史追溯的需求。

模式演进与Schema enforcement

Delta Lake提供了灵活的模式处理能力,与Spark的结构化数据管理无缝结合。它支持模式演进(Schema Evolution),允许用户在写入数据时自动添加新列或调整数据类型,而无需重写现有数据。例如,在Spark中使用.option("mergeSchema", "true")选项,可以动态合并新旧模式,避免ETL流程中的 schema 冲突。

同时,Delta Lake通过Schema enforcement确保数据质量,在写入时验证数据格式是否符合预期。如果Spark作业尝试写入与目标表模式不匹配的数据,Delta Lake会抛出错误,防止脏数据污染湖仓。这种机制减少了数据工程师的手动校验工作,提升了数据管道的可靠性。

对比其他表格式:集成优势与差异

与Iceberg和Hudi相比,Delta Lake在Spark生态中的集成更为原生和紧密。由于由Databricks(Spark的创始团队)推动,Delta Lake直接优化了Spark的DataFrame API和SQL接口,提供开箱即用的体验。例如,Delta Lake的OPTIMIZE和ZORDER命令可以直接通过Spark调用,自动压缩数据文件并优化查询性能,而Iceberg和Hudi可能需要额外的配置或外部工具。

在事务处理方面,Delta Lake强调简化的流批一体能力。它与Spark Structured Streaming深度集成,支持增量处理和高频upsert操作,适用于实时数据入库场景。而Hudi虽然也支持增量处理,但在Spark中的配置复杂度稍高;Iceberg则更专注于通用性,与多种计算引擎兼容,但在Spark专属优化上相对较少。

此外,Delta Lake的生态系统集成较为成熟,例如与Databricks平台的Delta Sharing功能结合,支持安全的数据共享,而Iceberg和Hudi在多云环境下的灵活性更强。选择时需权衡项目需求:如果团队深度依赖Spark且追求快速部署,Delta Lake是理想选择;若需要跨引擎兼容或特定云服务集成,可评估Iceberg或Hudi。

性能优化与实践建议

为了最大化Delta Lake与Spark集成的效益,建议采用以下实践:首先,定期运行VACUUM命令清理旧数据文件,避免存储膨胀,但需注意保留足够版本以支持时间旅行。其次,利用Z-Order索引优化频繁查询的列,提升Spark SQL的扫描效率。例如,执行OPTIMIZE delta_table ZORDER BY (date_column)可以加速基于时间范围的查询。

在流处理场景中,结合Spark Structured Streaming使用Delta Lake可实现低延迟的CDC(变更数据捕获)管道。通过设置.trigger(once=True)和检查点机制,确保流作业的 exactly-once 语义。同时,监控事务日志的大小和版本数量,避免元数据层成为性能瓶颈。

总体而言,Delta Lake通过深度集成Spark,降低了构建湖仓一体架构的复杂度,使数据团队能够专注于业务逻辑而非底层维护。随着2025年数据平台技术的演进,Delta Lake持续优化与云原生服务的集成,例如支持更细粒度的权限管理和自动化治理功能,进一步强化其在统一数据管理平台中的竞争力。

对比分析:Iceberg、Hudi、Delta Lake的异同与选型指南

在构建湖仓一体架构时,选择合适的表格式对数据管理和处理效率至关重要。Iceberg、Hudi和Delta Lake作为当前主流的三种表格式,均与Spark深度集成,但在设计理念、功能侧重和生态系统支持上存在显著差异。以下从多个维度进行系统对比,并提供基于实际场景的选型指南。

ACID事务支持对比

三种格式均提供ACID事务保障,但实现机制和适用场景有所不同。

- Iceberg:通过原子性提交和快照隔离实现多版本并发控制(MVCC),支持跨多个操作的事务一致性。其元数据层采用分层结构(元数据文件、清单列表、清单文件),确保读写操作的高效隔离。适用于高并发读写场景,如数据湖中的实时分析。

- Hudi:专注于增量数据处理,通过时间轴(Timeline)管理事务,支持基于日志的并发控制。提供两种表类型:Copy-on-Write(COW)和Merge-on-Read(MOR),前者优化写入,后者优化查询。适合需要频繁upsert和增量ETL的场景,如流式数据摄入。

- Delta Lake:基于事务日志(Transaction Log)实现ACID,所有操作均记录为有序的JSON文件,支持序列化隔离级别。与Spark集成最紧密,提供原生API(如

deltaTable)简化事务管理。适合需要强一致性和简化运维的企业级数据平台。

性能特性分析

性能差异主要体现在数据写入、查询效率和存储优化方面。

- 写入性能:Hudi在upsert场景下表现优异,尤其是MOR表可减少写放大;Delta Lake通过小文件合并和Z-Order聚类优化写入效率;Iceberg的元数据剪枝能力可加速分区过滤,但写入开销相对较高。

- 查询性能:Iceberg凭借元数据索引和谓词下推支持高效扫描;Delta Lake借助数据跳过(Data Skipping)和统计信息加速查询;Hudi的MOR表需额外处理日志文件,可能增加查询延迟。

- 存储优化:三者均支持压缩(Compaction)和清理(Vacuum)功能,但Hudi和Delta Lake更注重自动优化(如自动压缩),而Iceberg依赖手动或外部调度。

生态系统与集成支持

生态系统兼容性直接影响部署和扩展成本。

- 云原生支持:Iceberg设计为云中立,与AWS Glue、Apache Flink等集成广泛;Delta Lake深度绑定Databricks平台,但在开源版本中也可独立使用;Hudi支持多种执行引擎(如Spark、Flink),但云服务集成较弱。

- 社区与商业化:Delta Lake由Databricks主导,企业级支持完善;Iceberg作为Apache项目,社区活跃且厂商中立;Hudi同样为Apache项目,但在流处理生态中更受青睐。

- Spark集成度:Delta Lake与Spark原生兼容(如

spark.sql.format=delta),操作最简化;Iceberg和Hudi需通过外部jar包或配置集成,但均提供完整API支持。

选型指南:基于场景的决策

选择需结合业务需求、技术栈和团队能力。以下为常见场景建议:

- 实时数据湖与流处理:若需高频upsert(如CDC数据同步),优先选择Hudi(MOR表);若强调查询性能与事务一致性,Delta Lake更合适。

- 跨平台与云中立架构:若需避免厂商锁定或兼容多引擎(如Flink、Presto),Iceberg是理想选择。

- 企业级数据平台:若已采用Databricks生态,Delta Lake可降低运维复杂度;若追求社区驱动和灵活性,Iceberg或Hudi均可适配。

- 成本敏感型场景:Iceberg和Hudi的开源方案更经济,但需自主优化;Delta Lake在Databricks环境中可能产生额外成本。

综合对比表格

特性维度 | Iceberg | Hudi | Delta Lake |

|---|---|---|---|

ACID事务 | 快照隔离,MVCC | 时间轴日志,COW/MOR | 事务日志,序列化隔离 |

写入优化 | 元数据分层 | Upsert优先 | 小文件合并 |

查询性能 | 谓词下推,索引剪枝 | MOR需日志合并 | 数据跳过 |

流处理支持 | 中等(依赖外部引擎) | 优秀(原生增量处理) | 优秀(Structured Streaming) |

云原生兼容性 | 高(AWS、Azure等) | 中等 | 高(Databricks集成) |

社区生态 | Apache项目,活跃 | Apache项目,流处理强 | Databricks主导 |

实际选型中,建议通过PoC测试验证特定工作负载下的性能表现,并结合团队技术积累做出决策。例如,金融行业可能更倾向Delta Lake的事务强一致性,而互联网高并发场景可能选择Hudi的增量处理能力。

实践案例:构建湖仓一体架构的实战示例

假设我们有一个电商平台的数据湖,存储着海量的用户行为日志和交易数据,原始数据以Parquet格式存放在Amazon S3中。由于业务需要实时分析用户购买趋势并支持数据回滚,我们决定采用Apache Spark与Iceberg表格式构建湖仓一体架构。以下是一个完整的实战示例,涵盖环境配置、数据导入、ACID事务操作、时间旅行查询以及性能优化。

环境准备与部署

首先,确保Spark集群(如使用AWS EMR或自建集群)已集成Iceberg。可以通过在spark-defaults.conf中配置相关参数来启用Iceberg支持:

spark.sql.catalog.spark_catalog = org.apache.iceberg.spark.SparkSessionCatalog

spark.sql.catalog.spark_catalog.type = hive

spark.sql.extensions = org.apache.iceberg.spark.extensions.IcebergSparkSessionExtensions对于云存储集成,设置S3路径和凭证:

spark.hadoop.fs.s3a.access.key = YOUR_ACCESS_KEY

spark.hadoop.fs.s3a.secret.key = YOUR_SECRET_KEY部署时,建议使用Spark 3.x版本,并确保Iceberg JAR包(如iceberg-spark3-runtime-0.14.0.jar)已添加到集群的classpath中。

数据导入与表创建

假设原始用户行为数据存储在S3路径s3://my-bucket/raw/user_events/中,格式为Parquet。我们首先使用Spark SQL创建一个Iceberg表来管理这些数据:

CREATE TABLE spark_catalog.default.user_events (

user_id BIGINT,

event_time TIMESTAMP,

action STRING,

product_id BIGINT

) USING iceberg

PARTITIONED BY (days(event_time))

LOCATION 's3://my-bucket/iceberg/user_events'

TBLPROPERTIES ('format-version'='2');接下来,将现有Parquet数据导入Iceberg表:

INSERT INTO spark_catalog.default.user_events

SELECT * FROM parquet.`s3://my-bucket/raw/user_events/`;这一步骤利用了Spark的分布式处理能力,高效地将数据转换为Iceberg格式,同时自动维护元数据层。

ACID事务与增量处理

Iceberg通过快照机制支持ACID事务。例如,业务中可能需要批量更新用户行为记录(如修正错误数据)。以下是一个事务性更新示例,使用MERGE INTO语句实现upsert操作:

MERGE INTO spark_catalog.default.user_events target

USING (

SELECT user_id, event_time, 'click' as action, product_id

FROM parquet.`s3://my-bucket/updates/`

) source

ON target.user_id = source.user_id AND target.event_time = source.event_time

WHEN MATCHED THEN UPDATE SET target.action = source.action

WHEN NOT MATCHED THEN INSERT *;此操作确保在并发环境下保持原子性,避免数据不一致。Iceberg的元数据管理会自动创建新快照,并记录事务日志。

时间旅行查询

利用Iceberg的时间旅行功能,可以查询历史数据状态。例如,检索2025年7月20日特定时间点的用户行为:

SELECT * FROM spark_catalog.default.user_events

FOR TIMESTAMP AS OF '2025-07-20 12:00:00'

WHERE user_id = 1001;或者基于快照ID查询:

SELECT * FROM spark_catalog.default.user_events

FOR VERSION AS OF 123456789

WHERE action = 'purchase';这在审计和故障恢复场景中极为有用,无需额外备份即可访问历史版本。

性能优化技巧

为了提升查询效率,可以结合Iceberg的元数据优化和Spark的配置调整:

元数据管理: 定期执行元数据清理,避免快照积累过多。使用CALL语句删除旧快照:

CALL spark_catalog.system.expire_snapshots('spark_catalog.default.user_events', TIMESTAMP '2025-06-01 00:00:00');数据组织: 利用Iceberg的隐藏分区(如days(event_time))和Z-order排序优化查询性能。在写入时添加排序配置:

df.writeTo("spark_catalog.default.user_events")

.partitionedBy(expr("days(event_time)"))

.sortBy(expr("ZORDER(user_id, product_id)"))

.append()缓存与统计: 启用Spark的缓存机制和Iceberg的统计信息收集,加速聚合查询。在Spark中配置spark.sql.statistics.histogram.enabled=true以生成列统计。

监控与维护

在生产环境中,通过Spark UI和Iceberg的元数据表(如snapshots)监控作业性能和数据变化。例如,查询当前表的快照历史:

SELECT * FROM spark_catalog.default.user_events.snapshots;此外,设置定期压缩小文件的任务,以优化存储效率:

CALL spark_catalog.system.rewrite_data_files('spark_catalog.default.user_events');此实战案例展示了如何从原始数据湖过渡到基于Spark和Iceberg的湖仓一体架构,实现了事务保障、历史查询和高效分析。实际部署中,需根据数据规模和业务需求调整分区策略和资源分配。

常见问题与解决方案

在使用Spark与Iceberg、Hudi或Delta Lake构建湖仓一体架构的过程中,开发者和数据工程师常会遇到一些典型问题。这些问题主要集中在集成配置、性能优化以及错误排查等方面。以下基于社区实践和常见场景,整理了一些高频问题及其解决方案。

集成配置问题

问题1:Spark无法识别或加载表格式依赖库 许多用户在初次集成时遇到ClassNotFound或NoSuchMethodError等异常,这通常是由于依赖版本不匹配或未正确引入JAR包所致。例如,Spark 3.x与Iceberg 1.0+的兼容性较好,但如果使用较旧的Spark版本(如2.4),可能需要调整Iceberg版本或手动添加shaded包。

解决方案:

- 确认版本兼容矩阵,例如Iceberg官方文档提供了与Spark版本的对应关系。

- 使用Maven或SBT统一管理依赖,避免混用多个来源的JAR。对于生产环境,建议通过–jars参数或集群lib目录统一分发依赖。

- 对于Delta Lake,如果使用Databricks Runtime,无需额外配置;但在开源Spark中需显式添加delta-core依赖。

问题2:表格式元数据与Spark Catalog集成失败 例如,配置Iceberg时需指定catalog类型(如hive、hadoop或自定义),若未正确设置warehouse路径或catalog名称,会导致表创建或查询失败。

解决方案:

在Spark配置中明确指定catalog参数,例如:

spark.sql.catalog.my_catalog = org.apache.iceberg.spark.SparkCatalog

spark.sql.catalog.my_catalog.type = hive

spark.sql.catalog.my_catalog.warehouse = /path/to/warehouse对于Hudi,需确保Hive Metastore或AWS Glue等元存储服务可用,并正确配置hoodie.metadata.enable=true以启用元数据同步。

性能调优问题

问题3:大规模数据写入时性能下降 尤其是在upsert或merge操作中,Iceberg和Hudi可能需要处理大量小文件,导致元数据膨胀和查询延迟增高。

解决方案:

- 启用自动压缩功能:Iceberg可通过rewrite_data_files动作合并小文件,Hudi提供clustering优化,Delta Lake则有OPTIMIZE命令。

- 调整写入并行度:根据数据量动态调整spark.sql.shuffle.partitions或格式特定参数(如hoodie.parquet.max.file.size用于Hudi)。

- 利用Z-Order或Bloom Filter加速查询:Delta Lake和Iceberg支持通过Z-Order优化数据布局,减少扫描范围。

问题4:时间旅行查询响应慢 当需要回溯历史版本时,如果元数据层级过深或快照未优化,可能导致查询性能不佳。

解决方案:

- 定期清理过期快照:Iceberg提供expire_snapshots过程,Delta Lake有VACUUM命令,可控制历史版本保留时长。

- 为频繁查询的时间旅行字段(如timestamp)建立索引或分区,减少全表扫描。

错误处理与排查

问题5:事务冲突或并发写入异常 在多用户场景中,同时写入同一表可能引发ACID事务冲突,例如Iceberg的OCC(乐观并发控制)报错。

解决方案:

- 优化写入策略:采用队列或分布式锁机制协调写入任务,避免高频并发提交。

- 调整重试机制:对于 transient 错误(如网络超时),可在客户端实现自动重试逻辑,并设置指数退避策略。

- 使用Delta Lake的transaction日志调试工具(如DESCRIBE HISTORY)定位冲突操作。

问题6:模式演进(Schema Evolution)导致兼容性问题 例如,新增字段后旧查询失败,或数据类型变更引发读写异常。

解决方案:

- 遵循向后兼容规则:Delta Lake和Iceberg均支持ADD COLUMN、RENAME等DDL,但删除或修改字段需谨慎。建议使用nullable字段或默认值避免断裂。

- 测试环境中预先验证模式变更:通过spark.sql.adaptive.schemaEvolution.enabled等配置控制行为,并利用单元测试覆盖演进场景。

问题7:资源消耗过高(内存/OOM) 特别是在处理海量历史数据或复杂时间旅行查询时,Spark Driver或Executor可能因元数据加载过多而溢出。

解决方案:

- 增加堆外内存配置:调整spark.executor.memoryOverhead或spark.driver.memoryOverhead。

- 限制元数据扫描范围:例如在Iceberg中设置snapshot-id区间查询,避免全量快照加载。

- 使用增量查询优化:Hudi的增量拉取(incremental pull)或Delta Lake的CDF(Change Data Feed)可减少数据处理量。

环境与部署问题

问题8:云存储(如S3、ADLS)一致性行为差异 例如,S3的最终一致性可能导致列表操作延迟,影响Iceberg或Hudi的元数据更新。

解决方案:

- 启用一致性保证机制:Iceberg推荐使用S3Guard或利用Amazon DynamoDB跟踪文件状态。

- 对于Hudi,配置hoodie.consistency.check.enabled=true并调整重试策略。

- 避免直接文件系统操作,优先通过格式内置API(如Iceberg的Table API)管理数据。

问题9:认证与权限错误 在Kerberos或云厂商IAM场景下,访问存储系统或元存储时可能因权限不足失败。

解决方案:

- 统一凭证管理:利用Hadoop core-site.xml或Spark的hadoopConfiguration注入认证信息。

- 对于Delta Lake on Databricks,集成Unity Catalog实现集中权限控制。

- 调试时启用详细日志:通过spark.hadoop.fs.s3a.log.level=DEBUG等配置输出访问细节。

这些问题大多源于配置疏忽、版本 mismatch 或规模扩展时的资源瓶颈。通过结合社区最佳实践(如定期查阅Apache项目邮件列表或GitHub Issues)和系统性测试,可以显著降低运维风险。此外,建议在开发环境中模拟生产数据量和并发模式,提前验证集成方案的稳定性。

未来展望:湖仓一体技术的演进方向

随着数据技术的快速发展,湖仓一体架构正逐步成为企业数据平台的核心。Spark与Iceberg、Hudi、Delta Lake等表格式的深度集成,不仅解决了传统数据湖的ACID事务和时间旅行等关键问题,还为未来的技术演进奠定了基础。展望未来,这一领域将朝着更智能化、云原生化和功能多样化的方向演进。

AI与机器学习的深度集成 AI和机器学习正在重塑数据处理的方式。未来,Spark与表格式技术的结合将更紧密地支持ML工作流。例如,通过内置的ML框架和自动化特征工程,表格式可以直接优化训练数据的版本管理和回溯能力。时间旅行功能使得模型训练可重现,而ACID事务则能确保数据在特征提取和模型迭代过程中的一致性。预计未来会有更多原生支持ML的元数据扩展和优化器,实现数据与AI流水线的无缝衔接。

云原生与多模态架构的演进 云原生技术已是大势所趋,Spark和表格式将进一步拥抱云环境。未来,Iceberg、Hudi和Delta Lake可能会增强与对象存储(如AWS S3、Azure Blob Storage)的兼容性,减少数据迁移开销。同时,多云和混合云支持将成为重点,表格式通过标准化接口实现跨云数据管理和查询。此外,随着无服务器(Serverless)计算的普及,Spark on Kubernetes等部署模式将更高效,结合表格式的元数据抽象,实现弹性扩缩容和成本优化。

实时性与流批一体的深化 流批一体架构已在当前实践中显现价值,但未来将更加成熟。Spark Structured Streaming与表格式的集成会进一步提升实时数据处理能力,例如支持更低延迟的增量计算和事件时间处理。Hudi的增量查询、Iceberg的流式摄取优化以及Delta Lake的Change Data Feed等功能将持续增强,使得实时分析和大规模批处理在同一数据湖上无缝协作。

数据治理与自动化运维 随着数据规模扩大,治理和运维挑战日益突出。未来,表格式技术将内置更强大的数据治理功能,如自动化数据质量检查、血缘追踪和策略执行。Spark可能会集成更多元数据管理工具,实现动态合规性检查和隐私保护。此外,AI驱动的自动化优化(如自动分区、压缩和索引维护)将减少人工干预,提升系统可靠性。

生态系统融合与标准化 开源社区的协作将推动表格式向标准化方向发展。目前,Iceberg、Hudi和Delta Lake已在不同场景占据优势,但未来可能会出现更统一的接口或互操作协议,减少厂商锁定风险。Spark作为通用引擎,将继续扮演核心角色,通过API扩展支持多种表格式,方便用户根据需求灵活选型。

性能与可扩展性突破 硬件技术进步(如NVMe存储和RDMA网络)将催化性能提升。表格式可能会引入新的存储布局和索引机制,结合Spark的查询优化器,实现更快的数据扫描和聚合。另一方面,分布式元数据管理和缓存策略的改进,将支持更大规模的数据湖部署,突破PB级数据的管理瓶颈。

总体来看,湖仓一体技术的未来充满潜力,Spark与表格式的协同创新将持续推动数据架构的演进。随着AI集成、云原生支持和实时性深化,这一领域将为数据驱动型组织带来更高效、灵活的解决方案。

结语:拥抱数据驱动的智能时代

随着大数据技术的飞速演进,我们正站在一个数据驱动决策的新纪元门口。Apache Spark与Iceberg、Hudi、Delta Lake等表格式的深度集成,不仅重新定义了数据湖与数据仓库的边界,更在实际应用中显著提升了数据处理的可靠性、灵活性与效率。ACID事务的保障、时间旅行能力的实现,以及增量处理的优化,共同构建起支撑智能业务场景的坚实底座。

在实际项目中,选择适合的表格式并充分发挥其与Spark的协同效应至关重要。无论是追求开放生态的Iceberg、注重实时处理的Hudi,还是与Databricks深度绑定的Delta Lake,每一种技术都有其独特的优势与应用场景。通过本文的探讨,希望您能更清晰地理解这些工具的核心原理与差异,从而在构建湖仓一体架构时做出更明智的技术选型。

技术的价值最终体现在落地实践中。建议读者结合自身业务需求,从小规模试点开始,逐步探索Spark与表格式集成的实际效果。例如,可以尝试在数据管道中引入时间旅行功能进行历史数据回溯,或利用ACID事务确保关键业务数据的一致性。只有通过实践,才能更深刻地体会这些技术如何为数据驱动的智能时代赋能。

个数据驱动决策的新纪元门口。Apache Spark与Iceberg、Hudi、Delta Lake等表格式的深度集成,不仅重新定义了数据湖与数据仓库的边界,更在实际应用中显著提升了数据处理的可靠性、灵活性与效率。ACID事务的保障、时间旅行能力的实现,以及增量处理的优化,共同构建起支撑智能业务场景的坚实底座。

在实际项目中,选择适合的表格式并充分发挥其与Spark的协同效应至关重要。无论是追求开放生态的Iceberg、注重实时处理的Hudi,还是与Databricks深度绑定的Delta Lake,每一种技术都有其独特的优势与应用场景。通过本文的探讨,希望您能更清晰地理解这些工具的核心原理与差异,从而在构建湖仓一体架构时做出更明智的技术选型。

技术的价值最终体现在落地实践中。建议读者结合自身业务需求,从小规模试点开始,逐步探索Spark与表格式集成的实际效果。例如,可以尝试在数据管道中引入时间旅行功能进行历史数据回溯,或利用ACID事务确保关键业务数据的一致性。只有通过实践,才能更深刻地体会这些技术如何为数据驱动的智能时代赋能。

若希望进一步深入学习,可以参考Apache Spark、Iceberg、Hudi及Delta Lake的官方文档与社区资源。此外,GitHub上的开源项目、技术论坛的讨论以及行业会议中的案例分享,均为持续探索提供了丰富素材。未来,随着云原生与AI技术的深度融合,湖仓一体架构必将迎来更多创新与突破。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-09-14,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录