开源技术驱动与架构创新:AI领域的破局之道

原创开源技术驱动与架构创新:AI领域的破局之道

原创

澜舟科技

发布于 2025-11-25 11:41:35

发布于 2025-11-25 11:41:35

在人工智能飞速发展的当下,AI架构师在推动技术落地、满足企业与市场需求方面发挥着关键作用。本文将从开源模型进展、AI架构师职责、大模型交付实例以及丰富的开源技术等四个维度展开深入探讨,为AI领域从业者带来诸多启发。

开源模型:性能突破与产业赋能

从最初的自然语言处理,到视觉多模态的兴起,再到联合多模态的突破,AI的发展呈现出多元化和融合化的趋势。多模态模型的发展能让模型处理的任务类型越来越多,越来越接近于人类的交互形式,进而处理更多人类才能去解决的问题。

最近火出圈的DeepSeek R1具备强大的推理能力,其通过底层强化学习与工具使用能力的深度融合,在复杂逻辑判断、知识推理等领域取得重大突破。未来,基于DeepSeek Zero技术训练的模型,将实现API工具链的无缝调用,进一步降低开发成本、提升开发效率,推动模型在专业领域的深度应用。

除了模型本身横向能力和纵向能力的发展,模型的开源也占据非常重要的地位。

模型的开源堪称一部技术进化史。从LLama系列、Qwen系列到DeepSeek,开源模型的性能不断突破,逐步达到甚至超越闭源模型SOTA(State-of-the-Art)的水平。

这一突破不仅增强了本土模型的市场信心,更通过降低技术使用门槛,激发了AI应用生态的创新能力。以DeepSeek为代表的开源模型,凭借在数学与编程竞赛中的优异表现,为企业提供了低成本、高质量的AI技术解决方案,加速了AI技术的普惠应用。

AI架构师:驱动软件生产变革的关键角色

传统AI应用开发经历了三个阶段的演进:

- 在大模型出现前,因模型通用性不足,不能快速验证效果如何,且无法做复杂、有逻辑的任务;

- 闭源大模型时代,虽然可以快速做POC的验证,但私有化交付面临重重困难,每次都必须做针对能力的额外模型调优和蒸馏;

- 随着开源大模型能力追平闭源模型,AI应用开发进入了高效验证与私有化交付并重的新阶段。

AI架构师在软件生产过程中承担着核心职责,其开发范式可以总结为三大关键步骤:

- 需求深度挖掘:通过与用户的深度沟通,精准提炼业务流程、使用场景中的AI诉求,明确应用开发方向。

- 方案闭环验证:构建workflow、选择适配工具、调用优质Modelapi,通过持续测试与优化,实现技术效果与商业模式的双重验证。

- 成本效益优化:运用模型压缩与加速技术,在保障应用效果的前提下,降低计算成本,提升运行效率,实现商业价值的持续增长。此外,还需要关注市场动态和用户反馈,及时进行产品的更新和改进,以适应不断变化的需求。

为提升AI软件交付效率,可通过workflow平台化、模型训练/压缩技术平台化以及开源工具调用三大策略,实现流程标准化、资源高效利用与功能快速集成,以更低成本覆盖更广泛的交付需求。

交付流程从明确客户需求开始,依次进行任务分配、需求拆解、AI能力搭建和模型能力优化。不同层级的工程师在交付体系中各司其职:

大模型交付项目为例:投研领域的应用探索

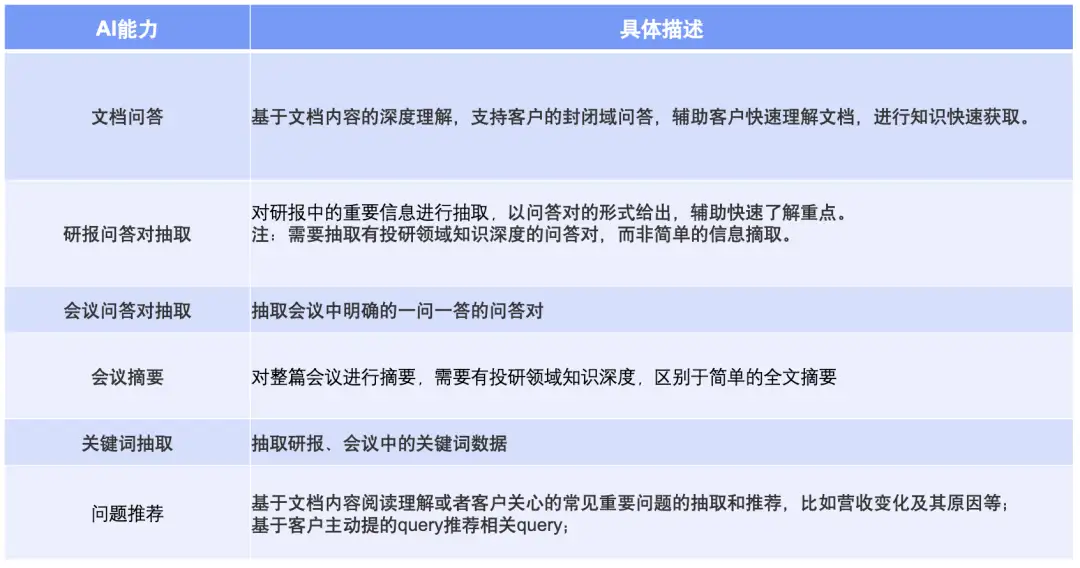

以澜舟科技在投研领域的大模型交付项目为例,来看具体的交付步骤。该项目旨在实现封闭域文档问答和问题推荐,并以插件形式嵌入页面,支持多种研报和会议文档类型。项目需求涵盖封闭域文档问答、文档理解与问答对抽取、问题推荐、关键词抽取及定位等多个方面。

为满足这些需求,项目首先对涉及到AI算法的部分拆分为6个能力:文档问答、研报问答对抽取、会议问答对抽取、会议摘要、关键词抽取、问题推荐。

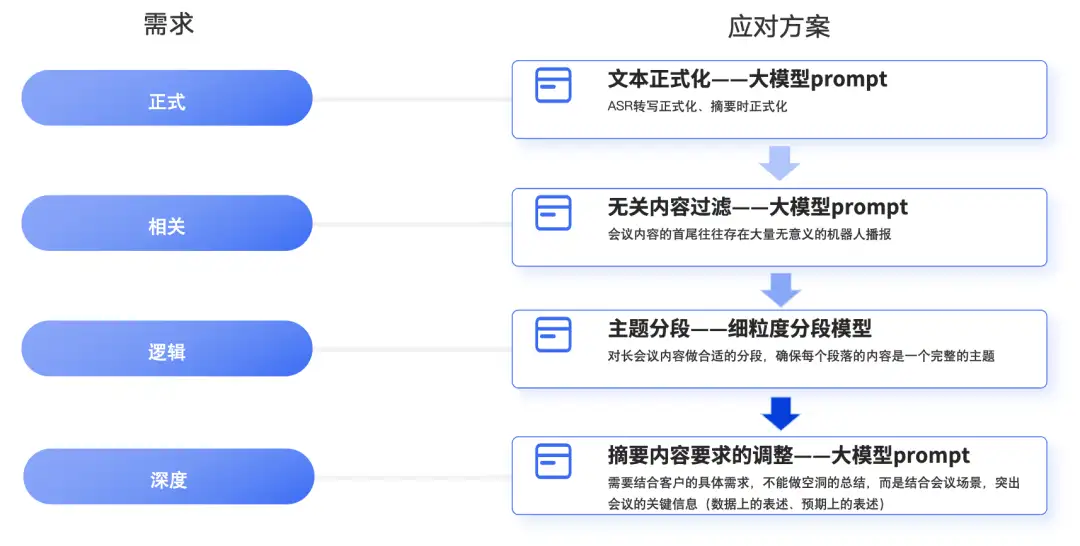

明确用户需求的各个要点,给出算法应对方案。具体以摘要任务为例,能力标准化过程包括大模型prompt实现文本正式化、过滤无关内容、利用细粒度分段模型进行主题分段以及调整摘要内容要求等。

以上我们以摘要作为具体实例,给出了一个需求->算法方案->算法流程路径,现在,我们要确定这个工作由谁来做。参考前文提到的工程师分级,对应拆分出好的能力:

- 如果有现成的workflow及可用的组件,需要做的只是连接各组件,即对应一级workflow工程师

- 如果没有现成的workflow,且大模型无法一步到位完成这项工作,需要我们自己去编排,并实现编排后的每个组件,即对应二级workflow工程师

- 如果客户有降本的需求,例如大模型成本高,想换成小一点的大模型,且需要有一定的效果,即对应模型压缩/微调工程师(这块目前还没有从data->model效果迭代标准化比较好的工具)

从时效性预估来看,标准化流程后各项能力的交付时间显著缩短,效率大幅提升,如研报问答对抽取时间从5天缩短到3天,效率提升40%。

开源技术:丰富“弹药库”助力高效交付

通用Agent框架

什么是通用型的Agent?通用Agent框架,具备独立解决复杂任务的能力,通过自主思考和规划,在虚拟环境中调用各类工具来完成用户的需求。

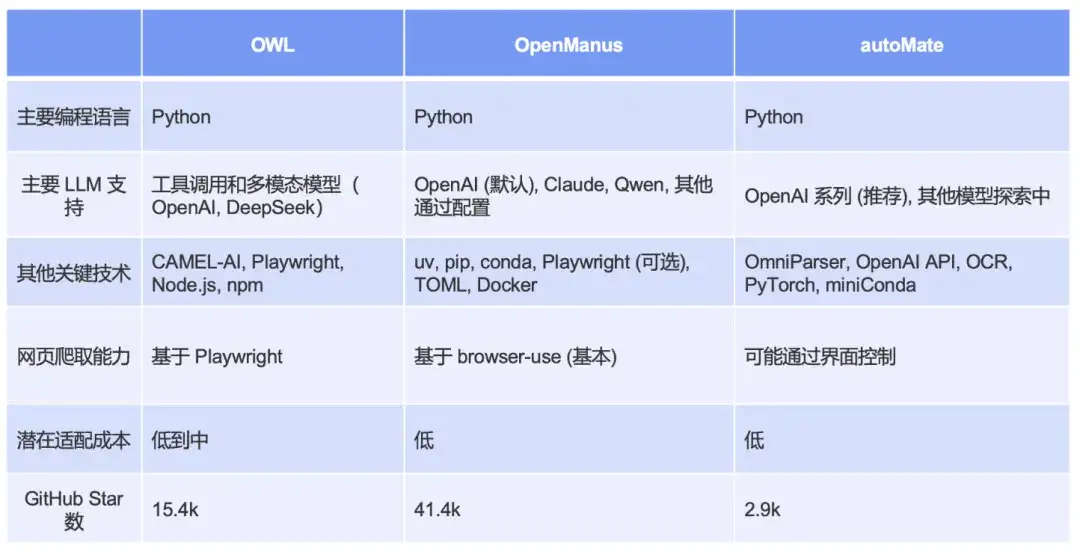

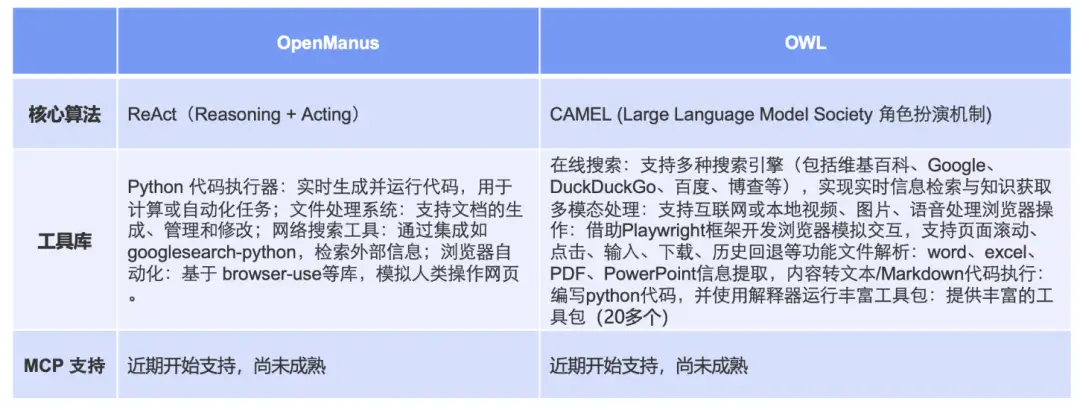

在评估Agent项目时,效果表现与适配成本是两大核心考量因素。在众多通用型Agent框架中,经考察发现,OWL、OpenManus和autoMate相对比较优秀。

从上表可以看出,OWL、OpenManus和autoMate均以Python为主要开发语言,与我们的技术栈高度兼容,显著降低了技术适配难度。同时,基于落地适配成本考虑,可优先考虑OWL、OpenManus和autoMate。

- 快速部署首选:OWL综合效果(GAIAbenchmark排名第一)排名第一,有丰富的工具库,涵盖了在线搜索、多模态处理、浏览器操作、文件解析、代码执行等多种能力,成为快速上手的理想选择;

- 强化学习定制:OpenManus依托OpenManusRL,可将智能体流程融入强化学习训练,优化智能体能力。

随着对mcp协议的支持逐步完善,这些框架未来将集成更多功能,值得持续关注。

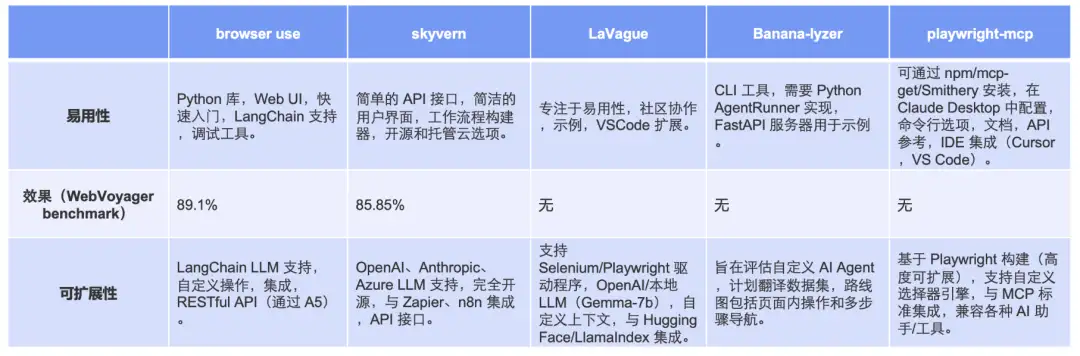

Agent框架的强大离不开丰富的工具。这里就重点介绍一类关键工具——浏览器智能体工具。这种工具让AI能够像人一样浏览和操作网页,获取信息或完成任务。只要你输入一句话,就可以让它帮你上传网盘、发个邮件。

以上浏览器智能体工具技术门槛低,基本上都是基于playwright技术的二次开发。

如果是快速上手,browseruse是一个相对成熟且经过验证的工具,功能丰富,支持视觉与HTML结合提取、多标签页管理等。WebVoyager基准测试得分也相当高。

Playwright-mcp是微软Playwright团队近期推出的项目。虽然相对较新,但它背靠Playwright底层技术,潜力更大,可以跟踪后续该项目后续发展。

特定场景AI项目-RAG项目

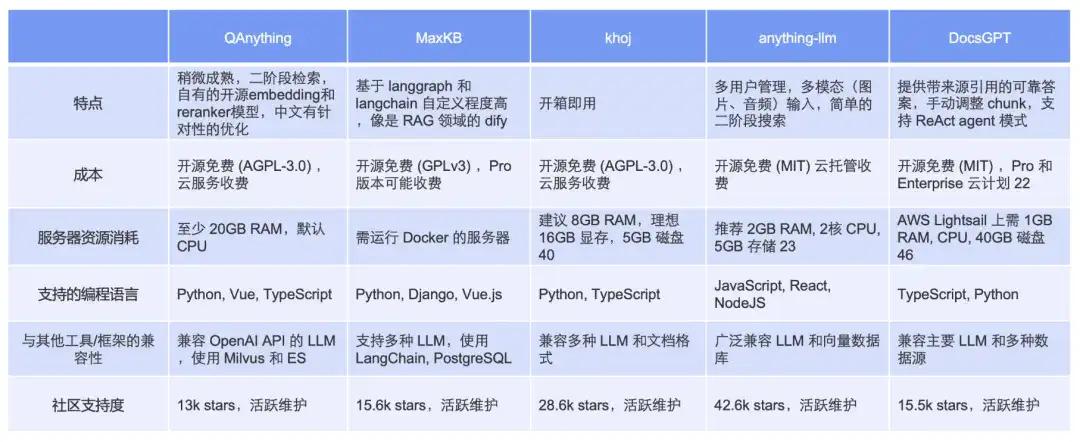

市面上有很多RAG开源项目,如QAnything、MaxKB、khoj、anything-llm、DocsGPT等。很多项目核心是基于LangChain框架开发的,更像是一个基础的RAG实现,缺乏针对RAG场景的深度优化。但这些优化往往是商业版的核心竞争力。

QAnything是网易有道出的文档问答产品,但只有他的企业版才有更好的语义切分模型、文档解析和图索引能力。QAnything的技术路径相对更为成熟,它采用了二阶段检索,并且拥有自研的开源embedding和reranker模型,对中文场景做了特别优化。

anything-llm在多用户管理和多模态输入方面有特色。DocsGPT强调来源引用和手动调整chunk。MaxKB基于langgraph,自定义程度高。

AI架构师在选择时,除了基础功能,应关注其检索策略、重排(rerank)能力。

模型本地化工具-微调工具

满足客户私有化部署需求,以及通过模型微调、模型压缩、加速来降本增效,是AI架构师需要考虑的重要环节。

微调可以让通用模型更好地适应特定任务,所以我们需要模型微调工具:

- LLaMAFactory是一个集大成者,支持预训练、SFT和强化学习训练,集成了LoRA、Adam-mini等多种流行技术,新出现的算法也能快速支持,支持模型广泛。

- Unsloth专注于单GPU的高效微调,通过定制CUDA内核和量化技术加速训练,特别适合显存受限的环境,比如我们如果想用家用显卡训练,就可以考虑这个。

- 对于超大规模模型的训练,需要模型并行的场景,Megatron-DeepSpeed是首选,但配置和使用也更复杂。

模型本地化工具-部署加速工具

模型训练好后,高效部署是关键。目标是低延迟、高吞吐。所以我们需要模型部署加速工具。从速度上来看:TensorRT-LLM>=SGLang>vLLM>Ollama。

TensorRT-LLM是NVIDIA官方推出的工具,通过深度优化和编译,追求极致的推理性能,尤其是在NVIDIAGPU上。但它需要额外的模型转换和编译步骤,对专业知识要求更高。性能要求极高情况下,我们选TensorRT-LLM。

如果是用自己的主机或者笔记本想快速测试模型,Ollama非常合适。

SGLang针对复杂的LLM程序执行(结构化输出)做了优化,在复杂的Agent调用场景下比较合适。

在需要快速部署的聊天服务情况下,vLLM部署相对简单,比较合适。

AI架构师的技术选型需综合项目需求(性能、成本、隐私)、硬件资源(GPU型号与数量)、团队技术能力及模型特性,通过权衡与决策,实现AI应用的高效、低成本交付。

开源技术为AI架构师提供了丰富资源,熟练运用这些开源工具,能助力架构师高效理解、拆解和满足客户需求。在未来,随着开源技术的不断发展,AI架构师将在更广阔的空间中推动AI技术的创新与应用。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读