还在用SQL写ETL?这6款数据抽取工具让你效率提升10倍!

原创还在用SQL写ETL?这6款数据抽取工具让你效率提升10倍!

原创

IT-王大拿

发布于 2025-11-03 17:43:09

发布于 2025-11-03 17:43:09

作为一名数据工程师,你是否曾深陷于数百行复杂的SQL脚本、存储过程以及难以维护的调度任务中?在数据源日益多样化、实时性要求越来越高的今天,传统基于SQL的ETL开发模式已经变得力不从心。数据抽取作为数据流水线的源头,其效率与稳定性直接决定了整个数据项目的成败。

本文将深入剖析传统方法的瓶颈,盘点6款能够显著提升数据抽取效率的现代化工具,帮助大家从容应对数据集成挑战。

一、为什么传统SQL ETL在现代化数据栈中逐渐失灵?

传统SQL脚本编写ETL任务,在处理单一数据源、逻辑简单的场景下确实有效,但当数据环境变得复杂,其固有的局限性便会暴露无遗。

实时性差:大多数基于SQL的批处理任务难以胜任秒级甚至分钟级的实时数据同步需求。

维护成本高:业务逻辑的变更意味着需要重写并测试大量SQL脚本,牵一发而动全身。

处理异构数据源乏力:从API接口、日志文件、NoSQL数据库到云存储,仅靠SQL难以统一、高效地接入这些非关系型数据。

缺乏可视化运维:任务依赖、执行状态、错误日志排查等,在纯脚本模式下往往缺乏直观的可视化界面,增加了运维难度。

二、选择现代数据抽取工具必须关注的6大核心能力

面对市场上琳琅满目的工具,如何做出明智的选择?我认为,一款优秀的现代化数据抽取工具应至少具备以下6项核心能力:

1.多源异构支持能力:能否轻松连接各类数据库、API、文件、消息队列等。

2.实时与批量处理能力:是否同时支持批量同步和实时流式数据捕获。

3.低代码/可视化配置:是否提供图形化界面,通过拖拽和配置替代编码,降低技术门槛。

4.强大的数据转换与清洗功能:内嵌丰富的数据处理组件,如字段映射、数据脱敏、格式转换等。

5.可观测性与运维监控:提供完整的任务监控、告警、日志和性能分析面板。

6.弹性扩展与高可用性:能否随数据量增长线性扩展,并保障生产环境的高可用。

三、6款高效数据抽取工具横评

1.Apache NiFi

一个开源的数据集成工具,专注于数据的自动化流转。

核心优势:其基于流(Flow-Based)的编程模型和直观的数据流UI界面非常强大,内置了数百个处理器,支持从多种数据系统动态拉取和分发数据。

适用场景:适用于构建高可靠、高可扩展的数据流水线,尤其在物联网数据采集、日志收集等场景表现优异。

2.ETLCloud(国产代表)

ETLCloud是RestCloud旗下的一款零代码数据集成平台,专注于提供轻量、高效的数据同步和ETL处理能力。

核心优势:采用全可视化流程设计,用户通过拖拽组件即可完成复杂的数据抽取、转换和加载逻辑,几乎无需编写代码。对国内常见的数据库和云服务有良好的适配性。

适用场景:非常适合需要进行频繁、复杂的异构数据源同步,且希望降低对开发人员编码依赖的团队。

3.Talend Open Studio

一款开源的、功能全面的数据集成工具。

核心优势:提供了强大的数据映射和转换功能,并生成本地代码执行,性能出色。社区活跃,组件丰富。

适用场景:适合有一定技术背景,希望利用开源方案构建企业级数据集成解决方案的团队。

4.StreamSets

一个智能数据集成平台,强调数据流的持续采集和实时监控。

核心优势:在设计时即考虑了“设计一次,持续运行”的理念,能自动处理源端数据结构的变化,大大减少了因表结构变更导致的数据管道故障。

适用场景:非常适合需要处理频繁变化的数据源,并追求高稳定性和自动化运维的实时数据管道。

5.Fivetran

一个完全托管的SaaS数据连接器服务。

核心优势:开箱即用,用户只需配置源和目标,它即可自动完成全量和增量数据的同步,几乎无需运维。

适用场景:适合追求快速上手、零运维,并且预算充足的团队,尤其受数据分析师欢迎。

6.Airbyte

一个快速发展的开源数据集成平台,旨在解决Fivetran等方案的封闭性和高成本问题。

核心优势:开源且社区驱动,拥有数量极其丰富的连接器,并且允许用户自定义开发连接器。

适用场景:适合需要大量非标准数据源连接,且拥有运维能力的技术团队。

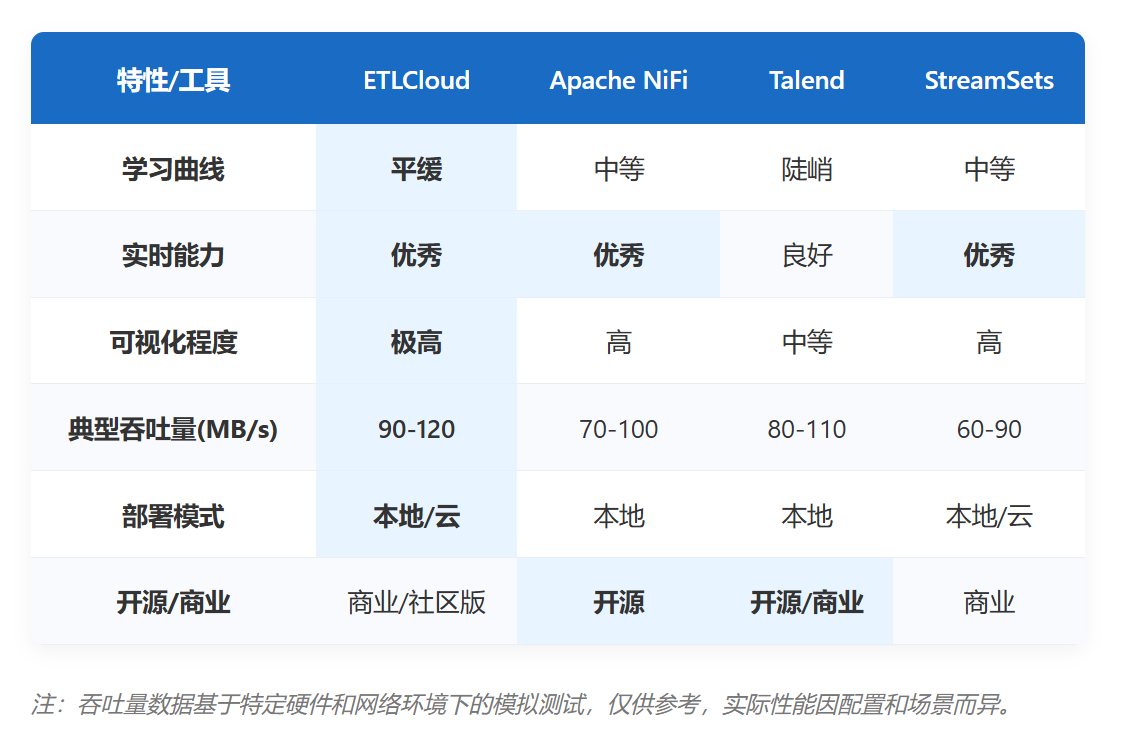

工具性能关键指标对比(模拟测试环境)

四、实战FAQ:数据抽取工具选型与落地指南

Q1:中小型企业预算有限,如何选择第一款数据抽取工具?

A1:建议从两个方向考虑:一是选择像ETLCloud或Airbyte这样提供免费社区版或开源版本的工具,它们功能完备,足以支撑中小型场景;二是评估团队技术栈,若团队Java背景强,NiFi是不错选择;若追求极致易用性和快速交付,ETLCloud的零代码特性优势明显。

Q2:从SQL脚本迁移到可视化工具,具体有哪些步骤?

A2:这是一个系统化工程,建议分四步走:

步骤1:资产盘点与梳理。整理现有所有的SQLETL脚本、调度任务、数据库连接信息。

步骤2:工具选型与POC验证。选择1-2款候选工具,抽取几个最具代表性的复杂任务进行迁移验证,评估开发效率和运行性能。

步骤3:分阶段迁移与并行运行。优先迁移非核心、逻辑清晰的任务,新老系统并行运行一个周期,确保数据一致性。

步骤4:全面切换与技能培训。在全团队推广新工具,并组织针对性培训,让团队成员从“写代码”思维转向“画流程”思维。

Q3:如何确保数据抽取过程中的数据质量?

A3:现代工具通常内置了数据质量保障机制,可以在数据流转的各个环节设置质量校验规则,比如:

在数据入口处,设置“非空检查”、“枚举值检查”。

在转换过程中,执行“数据脱敏”、“格式标准化”。

在出口前,进行“记录数对比”、“数据抽样核对”。这些检查都可以通过配置实现,无需编写冗长的校验SQL。

————

拥抱现代化数据抽取工具是数据团队提升交付效率、保障数据链路稳定性的必然选择,通过采用低代码甚至零代码的平台,工程师可以从重复的编码劳动中解脱出来,更专注于核心的数据建模与业务分析工作。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录