人工智能大语言模型注意力机制开发学习日志

原创人工智能大语言模型注意力机制开发学习日志

原创

鼓掌MVP

发布于 2025-09-27 22:32:34

发布于 2025-09-27 22:32:34

引言

随着自然语言处理(NLP)从统计机器学习向深度学习的演进,文本表示方法也经历了从传统统计模型到神经网络模型的重大转变。从最初的向量空间模型、语言模型,到Word2Vec等单层神经网络,再到如今基于注意力机制的复杂神经网络架构,文本表示的质量和效果不断提升。

在计算机视觉(CV)领域发展起来的神经网络架构,其核心主要包括三种类型:卷积神经网络(CNN)、循环神经网络(RNN)和注意力机制(Attention)。这些架构不仅在CV领域取得了巨大成功,也在NLP领域得到了广泛应用和进一步发展。

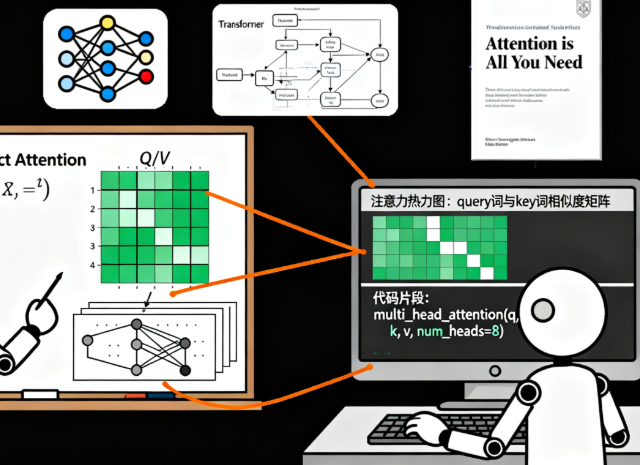

本文将详细介绍注意力机制的原理、发展历程、在NLP中的应用,以及如何实现一个简单的注意力机制模型。

1. 神经网络核心架构概述

1.1 卷积神经网络(CNN)

卷积神经网络最初在计算机视觉领域取得了突破性进展,其核心思想是通过卷积操作提取局部特征,并通过池化操作降低特征维度。在NLP中,CNN可以用于提取文本的局部特征,如n-gram特征。

CNN的主要优势:

- 局部特征提取能力强

- 参数共享,减少参数量

- 平移不变性

1.2 循环神经网络(RNN)

循环神经网络专门用于处理序列数据,其核心特点是具有记忆能力,能够捕捉序列中的时序信息。在NLP中,RNN及其变体(如LSTM、GRU)被广泛用于文本建模。

RNN的主要优势:

- 处理变长序列

- 具有记忆能力

- 能够捕捉长距离依赖

1.3 注意力机制(Attention)

注意力机制最初受到人类视觉注意力的启发,其核心思想是让模型在处理信息时能够关注到最重要的部分。在NLP中,注意力机制能够让模型在处理文本时关注到最重要的词汇或短语。

注意力机制的主要优势:

- 能够处理长距离依赖

- 提供可解释性

- 并行化处理能力强

2. 注意力机制原理详解

2.1 注意力机制的基本概念

注意力机制的核心思想是模拟人类的注意力机制,在处理信息时能够有选择性地关注重要部分,而忽略不重要的信息。在NLP中,这意味着模型在处理一个词时,能够关注到句子中与该词相关的其他词。

注意力机制的基本流程:

- 计算查询(Query)与键(Key)的相似度

- 通过softmax函数将相似度转换为注意力权重

- 使用注意力权重对值(Value)进行加权求和

2.2 注意力机制的数学表达

注意力机制可以形式化为以下函数:

$$\text{Attention}(Q, K, V) = \text{softmax}(\frac{QK^T}{\sqrt{d_k}})V$$

其中:

- Q(Query):查询矩阵

- K(Key):键矩阵

- V(Value):值矩阵

- $d_k$:键向量的维度

2.3 注意力机制的类型

- 自注意力(Self-Attention):Query、Key、Value都来自同一序列

- 交叉注意力(Cross-Attention):Query来自一个序列,Key和Value来自另一个序列

- 多头注意力(Multi-Head Attention):并行计算多个注意力头,然后将结果拼接

3. 注意力机制在NLP中的应用

3.1 机器翻译

在机器翻译任务中,注意力机制能够让解码器在生成目标语言词汇时,关注到源语言句子中相关的重要部分。这大大提高了翻译质量,特别是对于长句子的翻译。

3.2 文本摘要

在文本摘要任务中,注意力机制能够让模型在生成摘要时,关注到原文中最重要的句子或短语,从而生成更准确的摘要。

3.3 问答系统

在问答系统中,注意力机制能够让模型在寻找答案时,关注到问题和文档中最相关的内容,提高答案的准确性。

3.4 情感分析

在情感分析任务中,注意力机制能够帮助模型关注到文本中表达情感的关键词汇,提高情感分类的准确性。

4. 注意力机制实现

4.1 简单注意力机制实现

下面是一个简单的注意力机制实现:

import numpy as np

import torch

import torch.nn as nn

import torch.nn.functional as F

class SimpleAttention(nn.Module):

def __init__(self, hidden_size):

super(SimpleAttention, self).__init__()

self.hidden_size = hidden_size

# 定义注意力权重矩阵

self.attention_weights = nn.Linear(hidden_size, 1, bias=False)

def forward(self, encoder_outputs):

# encoder_outputs: (batch_size, seq_len, hidden_size)

# 计算注意力分数

scores = self.attention_weights(encoder_outputs) # (batch_size, seq_len, 1)

scores = scores.squeeze(2) # (batch_size, seq_len)

# 应用softmax函数得到注意力权重

attention_weights = F.softmax(scores, dim=1) # (batch_size, seq_len)

# 使用注意力权重对encoder输出进行加权求和

context_vector = torch.bmm(

attention_weights.unsqueeze(1), # (batch_size, 1, seq_len)

encoder_outputs # (batch_size, seq_len, hidden_size)

) # (batch_size, 1, hidden_size)

context_vector = context_vector.squeeze(1) # (batch_size, hidden_size)

return context_vector, attention_weights

# 使用示例

batch_size = 2

seq_len = 5

hidden_size = 128

# 模拟encoder输出

encoder_outputs = torch.randn(batch_size, seq_len, hidden_size)

# 创建注意力机制实例

attention = SimpleAttention(hidden_size)

# 计算注意力

context_vector, attention_weights = attention(encoder_outputs)

print(f"Context vector shape: {context_vector.shape}")

print(f"Attention weights shape: {attention_weights.shape}")4.2 多头注意力机制实现

class MultiHeadAttention(nn.Module):

def __init__(self, d_model, num_heads):

super(MultiHeadAttention, self).__init__()

self.d_model = d_model

self.num_heads = num_heads

self.d_k = d_model // num_heads

# 定义线性变换矩阵

self.W_q = nn.Linear(d_model, d_model)

self.W_k = nn.Linear(d_model, d_model)

self.W_v = nn.Linear(d_model, d_model)

self.W_o = nn.Linear(d_model, d_model)

def forward(self, query, key, value, mask=None):

batch_size = query.size(0)

# 线性变换

Q = self.W_q(query) # (batch_size, seq_len, d_model)

K = self.W_k(key) # (batch_size, seq_len, d_model)

V = self.W_v(value) # (batch_size, seq_len, d_model)

# 分割成多个头

Q = Q.view(batch_size, -1, self.num_heads, self.d_k).transpose(1, 2) # (batch_size, num_heads, seq_len, d_k)

K = K.view(batch_size, -1, self.num_heads, self.d_k).transpose(1, 2) # (batch_size, num_heads, seq_len, d_k)

V = V.view(batch_size, -1, self.num_heads, self.d_k).transpose(1, 2) # (batch_size, num_heads, seq_len, d_k)

# 计算注意力分数

scores = torch.matmul(Q, K.transpose(-2, -1)) / np.sqrt(self.d_k) # (batch_size, num_heads, seq_len, seq_len)

# 应用mask(如果有的话)

if mask is not None:

scores = scores.masked_fill(mask == 0, -1e9)

# 应用softmax函数

attention_weights = F.softmax(scores, dim=-1) # (batch_size, num_heads, seq_len, seq_len)

# 加权求和

attention_output = torch.matmul(attention_weights, V) # (batch_size, num_heads, seq_len, d_k)

# 合并多个头

attention_output = attention_output.transpose(1, 2).contiguous().view(

batch_size, -1, self.d_model) # (batch_size, seq_len, d_model)

# 最后的线性变换

output = self.W_o(attention_output) # (batch_size, seq_len, d_model)

return output, attention_weights

# 使用示例

batch_size = 2

seq_len = 5

d_model = 128

num_heads = 8

# 模拟输入

query = torch.randn(batch_size, seq_len, d_model)

key = torch.randn(batch_size, seq_len, d_model)

value = torch.randn(batch_size, seq_len, d_model)

# 创建多头注意力机制实例

multi_head_attention = MultiHeadAttention(d_model, num_heads)

# 计算多头注意力

output, attention_weights = multi_head_attention(query, key, value)

print(f"Output shape: {output.shape}")

print(f"Attention weights shape: {attention_weights.shape}")5. 注意力机制的优势与挑战

5.1 优势

- 长距离依赖建模:注意力机制能够有效地建模长距离依赖关系,解决了RNN在处理长序列时的梯度消失问题。

- 并行化处理:与RNN不同,注意力机制可以并行处理序列中的所有位置,大大提高了计算效率。

- 可解释性:注意力权重提供了模型决策过程的可视化,增强了模型的可解释性。

- 灵活性:注意力机制可以灵活地应用于各种NLP任务,如机器翻译、文本摘要、问答系统等。

5.2 挑战

- 计算复杂度:标准注意力机制的计算复杂度为O(n²),对于长序列来说计算开销较大。

- 内存消耗:注意力机制需要存储注意力权重矩阵,对于长序列来说内存消耗较大。

- 过拟合风险:在数据量较小的情况下,复杂的注意力机制可能会出现过拟合现象。

6. 注意力机制的发展趋势

6.1 稀疏注意力

为了解决标准注意力机制计算复杂度高的问题,研究者提出了稀疏注意力机制,如Sparse Transformer、Longformer等,通过限制注意力计算的范围来降低计算复杂度。

6.2 线性注意力

线性注意力机制通过近似计算来降低注意力机制的计算复杂度,如Linear Transformer、Performer等。

6.3 层次化注意力

层次化注意力机制在不同粒度上应用注意力机制,如在词级别和句子级别分别应用注意力机制。

7. 实践案例分析

7.1 Transformer模型

Transformer模型完全基于注意力机制,摒弃了RNN和CNN结构,成为NLP领域的重要里程碑。其核心组件包括:

- 多头自注意力机制

- 位置编码

- 前馈神经网络

- 残差连接和层归一化

7.2 BERT模型

BERT(Bidirectional Encoder Representations from Transformers)基于Transformer的编码器部分,通过双向注意力机制预训练语言模型,在多项NLP任务上取得了显著效果。

7.3 GPT模型

GPT(Generative Pre-trained Transformer)基于Transformer的解码器部分,通过单向注意力机制进行语言建模,在文本生成任务上表现出色。

8. 开发实践建议

8.1 选择合适的注意力机制

根据具体任务需求选择合适的注意力机制:

- 对于需要建模长距离依赖的任务,使用标准注意力机制

- 对于计算资源受限的场景,考虑使用稀疏注意力或线性注意力

- 对于需要多粒度建模的任务,考虑使用层次化注意力

8.2 注意力机制的优化

- 正则化:使用Dropout等正则化技术防止过拟合

- 初始化:合理初始化注意力权重矩阵

- 学习率调整:为注意力机制组件设置合适的学习率

8.3 注意力可视化

通过可视化注意力权重,可以更好地理解模型的决策过程,有助于模型调试和优化。

9. 总结

注意力机制作为深度学习时代NLP领域的重要技术,极大地推动了自然语言处理技术的发展。从最初的简单注意力机制到现在的复杂变体,注意力机制在各种NLP任务中都展现出了强大的能力。

通过本文的学习,我们了解了注意力机制的基本原理、数学表达、实现方法以及在NLP中的应用。同时,我们也认识到注意力机制的优势和挑战,以及未来的发展趋势。

在实际开发中,我们应该根据具体任务需求选择合适的注意力机制,并注意优化和调试,以充分发挥注意力机制的优势。

随着技术的不断发展,注意力机制必将在NLP领域发挥更加重要的作用,为构建更智能的语言处理系统提供强大支持。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录