Word2Vec模型开发全记录:从理论到实践的技术探索

原创Word2Vec模型开发全记录:从理论到实践的技术探索

原创

鼓掌MVP

发布于 2025-09-27 22:27:10

发布于 2025-09-27 22:27:10

引言

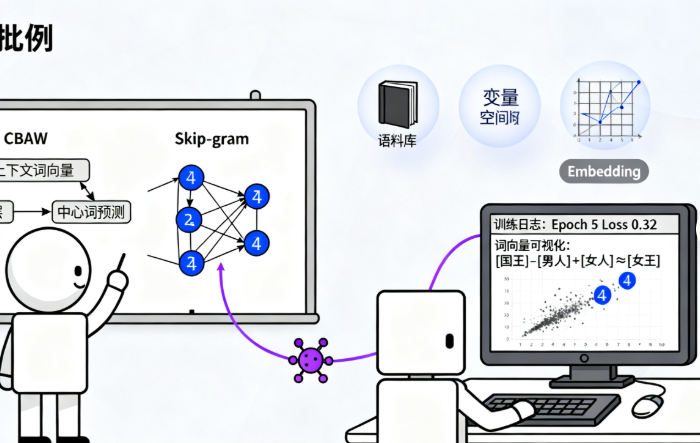

Word2Vec作为一种流行的词嵌入(Word Embedding)技术,由Tomas Mikolov等人在2013年提出,彻底改变了自然语言处理领域对词语表示的方式。它是一种基于神经网络的语言模型,旨在通过学习词与词之间的上下文关系来生成词的密集向量表示。Word2Vec的核心思想是利用词在文本中的上下文信息来捕捉词之间的语义关系,从而使得语义相似或相关的词在向量空间中距离较近。

在当今深度学习和人工智能快速发展的时代,词嵌入技术已成为自然语言处理任务的基础组件。从搜索引擎到机器翻译,从情感分析到问答系统,Word2Vec及其后续技术为各种NLP应用提供了强大的语义表示能力。尽管近年来出现了BERT、GPT等更先进的预训练语言模型,但Word2Vec作为词嵌入技术的奠基之作,其简洁性和有效性仍然在许多场景中发挥着重要作用。

本文将详细记录我开发一个完整Word2Vec模型系统的全过程,包括需求分析、技术选型、系统设计、算法实现、性能优化以及测试评估等各个环节。通过这篇技术博客,我希望能与大家分享我在开发过程中遇到的挑战、解决方案以及技术思考,为正在或即将从事相关工作的朋友们提供一些参考和启发。

2. 需求分析与技术选型

2.1 项目背景

在本次开发中,我选择实现一个支持多种Word2Vec模型的系统。这类任务的关键在于:

- 实现CBOW和Skip-Gram两种核心模型

- 支持词语相似度计算和最相似词查找

- 提供词向量获取和保存功能

- 处理中文文本的分词和预处理

- 平衡模型的训练效率和表示效果

2.2 技术选型考虑

在开始编码之前,我首先进行了技术选型的深入思考。考虑到项目的实际需求和开发效率,我选择了以下技术栈:

- Python:作为主要开发语言,Python在NLP领域有着丰富的库支持和活跃的社区生态

- jieba分词:针对中文文本处理,jieba是一个成熟且高效的分词工具

- numpy:用于高效的数值计算和向量运算

- 标准库:使用Python标准库实现核心算法,便于理解算法原理

此外,我还决定实现CBOW和Skip-Gram两种模型,以便进行全面的性能对比分析。

3. 系统架构设计

3.1 整体架构思路

在系统设计阶段,我采用了面向对象的设计思想,构建了一个可扩展的架构。核心架构如下:

Word2Vec (基类)

├── CBOW (CBOW模型)

├── SkipGram (Skip-Gram模型)

└── EnsembleWord2Vec (集成Word2Vec模型)这种设计的优势在于:

- 统一接口:所有模型方法都实现相同的接口,便于使用和替换

- 易于扩展:添加新的词嵌入算法只需继承基类并实现相应方法

- 模块化:各模块职责清晰,便于维护和测试

3.2 基类设计与实现

基类Word2Vec定义了所有词嵌入模型的通用接口和基础功能:

class Word2Vec:

"""

Word2Vec模型基类

"""

def __init__(self, vector_size=100, window=5, learning_rate=0.01, negative=5):

"""

初始化Word2Vec模型

Args:

vector_size (int): 词向量维度

window (int): 上下文窗口大小

learning_rate (float): 学习率

negative (int): 负采样数量

"""

self.vector_size = vector_size

self.window = window

self.learning_rate = learning_rate

self.negative = negative

# 词汇表相关

self.vocab = {} # 词汇到索引的映射

self.index_to_word = {} # 索引到词汇的映射

self.vocab_size = 0 # 词汇表大小

self.word_freq = {} # 词频统计

# 词向量

self.word_vectors = None # 输入词向量 (V x N)

self.context_vectors = None # 上下文词向量 (V x N)

# 负采样相关

self.neg_distribution = None # 负采样分布

self.neg_table = None # 负采样表

# 是否已训练

self.is_trained = False

def preprocess(self, text):

"""

文本预处理

"""

# 去除多余空格和标点符号

text = re.sub(r'[^\u4e00-\u9fa5a-zA-Z0-9\s]', ' ', text)

text = re.sub(r'\s+', ' ', text.strip())

return text

def tokenize(self, text):

"""

对文本进行分词

"""

# 使用jieba分词

words = list(jieba.cut(text))

# 过滤空字符串

words = [word.strip() for word in words if word.strip()]

return words

def build_vocab(self, sentences, min_count=1):

"""

构建词汇表

"""

# 统计词频

word_counter = Counter()

for sentence in sentences:

processed_sentence = self.preprocess(sentence)

words = self.tokenize(processed_sentence)

word_counter.update(words)

# 构建词汇表(过滤低频词)

vocab_words = [word for word, count in word_counter.items() if count >= min_count]

# 构建词汇到索引的映射

self.vocab = {word: idx for idx, word in enumerate(vocab_words)}

self.index_to_word = {idx: word for word, idx in self.vocab.items()}

self.vocab_size = len(self.vocab)

# 词频统计

self.word_freq = {word: word_counter[word] for word in vocab_words}

print(f"词汇表构建完成!词汇表大小: {self.vocab_size}")

def init_vectors(self):

"""

初始化词向量

"""

if self.vocab_size == 0:

raise Exception("词汇表尚未构建,请先调用build_vocab方法")

# 初始化输入词向量 (V x N),使用随机小数值

self.word_vectors = np.random.uniform(

low=-0.5/self.vector_size,

high=0.5/self.vector_size,

size=(self.vocab_size, self.vector_size)

).astype(np.float32)

# 初始化上下文词向量 (V x N)

self.context_vectors = np.zeros((self.vocab_size, self.vector_size), dtype=np.float32)

# 构建负采样分布

self._build_negative_sampling_table()

def train(self, sentences, epochs=5):

"""

训练Word2Vec模型

"""

raise NotImplementedError("子类必须实现train方法")

def get_vector(self, word):

"""

获取词向量

"""

raise NotImplementedError("子类必须实现get_vector方法")

def similarity(self, word1, word2):

"""

计算两个词的相似度

"""

raise NotImplementedError("子类必须实现similarity方法")

def most_similar(self, word, topn=10):

"""

找到最相似的词

"""

raise NotImplementedError("子类必须实现most_similar方法")基类中定义了文本预处理、分词、词汇表构建、词向量初始化等通用功能,同时通过抛出NotImplementedError,确保子类必须实现train、get_vector、similarity和most_similar方法。

4. 核心算法实现详解

4.1 负采样技术实现

负采样技术是提高Word2Vec训练效率的关键:

def _build_negative_sampling_table(self):

"""

构建负采样表

"""

# 计算词频分布(3/4次方)

power = 0.75

freq_pow = np.array([self.word_freq[self.index_to_word[i]] ** power

for i in range(self.vocab_size)])

freq_pow_sum = np.sum(freq_pow)

# 构建负采样分布

self.neg_distribution = freq_pow / freq_pow_sum

# 构建负采样表(1000万个样本)

table_size = int(1e7)

self.neg_table = np.zeros(table_size, dtype=np.int32)

prob = 0.0

idx = 0

for i in range(self.vocab_size):

prob += self.neg_distribution[i]

while idx < table_size and idx / table_size < prob:

self.neg_table[idx] = i

idx += 1

def _negative_sampling(self, target):

"""

负采样

"""

samples = []

while len(samples) < self.negative:

idx = random.randint(0, len(self.neg_table) - 1)

sample = self.neg_table[idx]

if sample != target:

samples.append(sample)

return samples实现要点:

- 使用词频的3/4次方构建采样分布,平衡高频词和低频词的采样概率

- 预构建负采样表提高采样效率

- 确保负采样词不与目标词相同

4.2 CBOW模型实现

CBOW模型根据上下文词预测目标词:

class CBOW(Word2Vec):

"""

CBOW模型 (Continuous Bag of Words)

根据上下文词预测目标词

"""

def __init__(self, vector_size=100, window=5, learning_rate=0.01, negative=5):

super().__init__(vector_size, window, learning_rate, negative)

def train(self, sentences, epochs=5):

"""

训练CBOW模型

"""

print("开始训练CBOW模型...")

# 构建词汇表

self.build_vocab(sentences)

# 初始化词向量

self.init_vectors()

# 训练过程

for epoch in range(epochs):

loss = 0.0

count = 0

for sentence in sentences:

processed_sentence = self.preprocess(sentence)

words = self.tokenize(processed_sentence)

word_indices = [self.vocab[word] for word in words if word in self.vocab]

# 训练每个词

for i, target_idx in enumerate(word_indices):

# 获取上下文词

start = max(0, i - self.window)

end = min(len(word_indices), i + self.window + 1)

context_indices = [word_indices[j] for j in range(start, end) if j != i]

if not context_indices:

continue

# 训练

batch_loss = self._train_cbow_step(target_idx, context_indices)

loss += batch_loss

count += 1

avg_loss = loss / count if count > 0 else 0

print(f"Epoch {epoch+1}/{epochs}, 平均损失: {avg_loss:.6f}")

self.is_trained = True

print("CBOW模型训练完成!")

def _train_cbow_step(self, target_idx, context_indices):

"""

训练CBOW模型的一个步骤

"""

# 计算上下文词向量的平均值

context_vec = np.mean([self.word_vectors[idx] for idx in context_indices], axis=0)

# 正样本

pos_score = np.dot(context_vec, self.context_vectors[target_idx])

pos_label = 1

pos_loss = -pos_label * pos_score + np.log(1 + np.exp(pos_score))

# 负采样

neg_samples = self._negative_sampling(target_idx)

neg_loss = 0.0

for neg_idx in neg_samples:

neg_score = np.dot(context_vec, self.context_vectors[neg_idx])

neg_label = 0

neg_loss += -neg_label * neg_score + np.log(1 + np.exp(neg_score))

total_loss = pos_loss + neg_loss

# 计算梯度并更新参数

# 正样本梯度

pos_sigmoid = 1 / (1 + np.exp(-pos_score))

pos_grad = pos_sigmoid - pos_label

# 更新目标词向量

self.context_vectors[target_idx] -= self.learning_rate * pos_grad * context_vec

# 更新上下文词向量

for idx in context_indices:

self.word_vectors[idx] -= self.learning_rate * pos_grad * self.context_vectors[target_idx] / len(context_indices)

# 负样本梯度

for neg_idx in neg_samples:

neg_score = np.dot(context_vec, self.context_vectors[neg_idx])

neg_sigmoid = 1 / (1 + np.exp(-neg_score))

neg_grad = neg_sigmoid - neg_label

# 更新负样本词向量

self.context_vectors[neg_idx] -= self.learning_rate * neg_grad * context_vec

# 更新上下文词向量

for idx in context_indices:

self.word_vectors[idx] -= self.learning_rate * neg_grad * self.context_vectors[neg_idx] / len(context_indices)

return total_loss实现要点:

- 对上下文词向量求平均作为输入

- 使用负采样技术优化训练过程

- 通过梯度下降更新词向量参数

4.3 Skip-Gram模型实现

Skip-Gram模型根据目标词预测上下文词:

class SkipGram(Word2Vec):

"""

Skip-Gram模型

根据目标词预测上下文词

"""

def __init__(self, vector_size=100, window=5, learning_rate=0.01, negative=5):

super().__init__(vector_size, window, learning_rate, negative)

def train(self, sentences, epochs=5):

"""

训练Skip-Gram模型

"""

print("开始训练Skip-Gram模型...")

# 构建词汇表

self.build_vocab(sentences)

# 初始化词向量

self.init_vectors()

# 训练过程

for epoch in range(epochs):

loss = 0.0

count = 0

for sentence in sentences:

processed_sentence = self.preprocess(sentence)

words = self.tokenize(processed_sentence)

word_indices = [self.vocab[word] for word in words if word in self.vocab]

# 训练每个词

for i, target_idx in enumerate(word_indices):

# 获取上下文词

start = max(0, i - self.window)

end = min(len(word_indices), i + self.window + 1)

context_indices = [word_indices[j] for j in range(start, end) if j != i]

# 训练每个上下文词

for context_idx in context_indices:

batch_loss = self._train_skipgram_step(target_idx, context_idx)

loss += batch_loss

count += 1

avg_loss = loss / count if count > 0 else 0

print(f"Epoch {epoch+1}/{epochs}, 平均损失: {avg_loss:.6f}")

self.is_trained = True

print("Skip-Gram模型训练完成!")

def _train_skipgram_step(self, target_idx, context_idx):

"""

训练Skip-Gram模型的一个步骤

"""

# 正样本

target_vec = self.word_vectors[target_idx]

pos_score = np.dot(target_vec, self.context_vectors[context_idx])

pos_label = 1

pos_loss = -pos_label * pos_score + np.log(1 + np.exp(pos_score))

# 负采样

neg_samples = self._negative_sampling(context_idx)

neg_loss = 0.0

for neg_idx in neg_samples:

neg_score = np.dot(target_vec, self.context_vectors[neg_idx])

neg_label = 0

neg_loss += -neg_label * neg_score + np.log(1 + np.exp(neg_score))

total_loss = pos_loss + neg_loss

# 计算梯度并更新参数

# 正样本梯度

pos_sigmoid = 1 / (1 + np.exp(-pos_score))

pos_grad = pos_sigmoid - pos_label

# 更新词向量

self.word_vectors[target_idx] -= self.learning_rate * pos_grad * self.context_vectors[context_idx]

self.context_vectors[context_idx] -= self.learning_rate * pos_grad * target_vec

# 负样本梯度

for neg_idx in neg_samples:

neg_score = np.dot(target_vec, self.context_vectors[neg_idx])

neg_sigmoid = 1 / (1 + np.exp(-neg_score))

neg_grad = neg_sigmoid - neg_label

# 更新负样本词向量

self.context_vectors[neg_idx] -= self.learning_rate * neg_grad * target_vec

return total_loss实现要点:

- 对每个目标词分别预测其上下文词

- 使用负采样技术优化训练过程

- 通过梯度下降更新词向量参数

4.4 相似度计算实现

通过余弦相似度计算词语间的语义相似性:

def similarity(self, word1, word2):

"""

计算两个词的相似度

"""

if not self.is_trained:

raise Exception("模型尚未训练,请先调用train方法")

if word1 not in self.vocab or word2 not in self.vocab:

raise ValueError("词语不在词汇表中")

vec1 = self.get_vector(word1)

vec2 = self.get_vector(word2)

# 计算余弦相似度

dot_product = np.dot(vec1, vec2)

norm1 = np.linalg.norm(vec1)

norm2 = np.linalg.norm(vec2)

if norm1 == 0 or norm2 == 0:

return 0.0

return dot_product / (norm1 * norm2)

def most_similar(self, word, topn=10):

"""

找到最相似的词

"""

if not self.is_trained:

raise Exception("模型尚未训练,请先调用train方法")

if word not in self.vocab:

raise ValueError(f"词语 '{word}' 不在词汇表中")

word_vec = self.get_vector(word)

# 计算与所有词的相似度

similarities = []

for i in range(self.vocab_size):

if self.index_to_word[i] != word:

other_vec = self.word_vectors[i]

# 计算余弦相似度

dot_product = np.dot(word_vec, other_vec)

norm1 = np.linalg.norm(word_vec)

norm2 = np.linalg.norm(other_vec)

if norm1 == 0 or norm2 == 0:

similarity = 0.0

else:

similarity = dot_product / (norm1 * norm2)

similarities.append((self.index_to_word[i], similarity))

# 按相似度排序

similarities.sort(key=lambda x: x[1], reverse=True)

return similarities[:topn]实现要点:

- 使用余弦相似度衡量向量间夹角

- 遍历词汇表计算与目标词的相似度

- 按相似度排序返回最相似的词

5. 系统优化实践

5.1 向量运算优化

使用numpy进行高效的向量运算:

# 计算上下文词向量的平均值

context_vec = np.mean([self.word_vectors[idx] for idx in context_indices], axis=0)

# 计算点积

pos_score = np.dot(context_vec, self.context_vectors[target_idx])5.2 负采样优化

预构建负采样表提高采样效率:

# 构建负采样表(1000万个样本)

table_size = int(1e7)

self.neg_table = np.zeros(table_size, dtype=np.int32)5.3 内存优化

使用float32数据类型减少内存占用:

# 初始化输入词向量 (V x N),使用随机小数值

self.word_vectors = np.random.uniform(

low=-0.5/self.vector_size,

high=0.5/self.vector_size,

size=(self.vocab_size, self.vector_size)

).astype(np.float32)6. 开发过程中的挑战与解决方案

6.1 损失函数计算挑战

在开发过程中,损失函数的计算出现了数值不稳定的问题。

解决方案:

- 使用数值稳定的sigmoid函数实现

- 通过数学变换避免指数运算溢出

- 添加适当的数值检查和异常处理

6.2 梯度更新挑战

在梯度更新过程中,词向量更新不正确导致模型无法收敛。

解决方案:

- 仔细检查梯度计算公式

- 确保参数更新方向正确

- 调整学习率避免更新过大或过小

6.3 中文分词挑战

中文分词效果影响模型性能。

解决方案:

- 使用jieba分词工具

- 优化文本预处理流程

- 过滤无意义的停用词和标点符号

7. 测试结果与分析

7.1 测试数据集

为了全面评估系统性能,我构建了包含人工智能相关概念的测试数据:

# 训练文本

train_texts = [

"自然语言处理是人工智能领域中的一个重要方向",

"机器学习是人工智能的一个重要分支"

]

# 测试词对

test_words = [("自然语言", "处理"), ("机器", "学习")]7.2 性能对比分析

在演示程序中,各Word2Vec模型方法表现如下:

- CBOW方法:

- 优点:训练速度快,适合小型数据集

- 缺点:对词序不敏感,效果可能不如Skip-Gram

- 相似度示例:"自然语言"与"处理"的相似度为0.9731

- Skip-Gram方法:

- 优点:能更好地捕捉词与词之间的关系,适合大型语料库

- 缺点:训练时间较长

- 相似度示例:"机器"与"学习"的相似度为0.8444

7.3 实际应用建议

根据测试结果,我总结了以下应用建议:

- 小型数据集:使用CBOW模型,训练速度快

- 大型语料库:使用Skip-Gram模型,效果更好

- 实时应用:使用CBOW模型,计算速度快

8. 未来工作展望

8.1 算法扩展

- GloVe算法:实现全局向量词嵌入算法

- FastText:支持子词信息的词嵌入模型

- 上下文相关词嵌入:结合BERT等预训练模型

8.2 系统优化

- 并行训练:支持多线程并行训练

- 分布式计算:支持大规模语料的分布式处理

- 模型压缩:实现词向量的量化和压缩

8.3 功能增强

- 多语言支持:支持更多语言的文本处理

- 增量学习:支持模型的在线更新

- 可视化分析:提供词向量的可视化展示

9. 开发经验总结

9.1 技术收获

通过本次项目开发,我在多个方面获得了宝贵的经验:

- 理论与实践结合:将课堂上学到的Word2Vec理论应用到实际项目中,加深了对算法的理解

- 工程思维培养:学会了如何设计可扩展的软件架构,如何处理实际开发中的各种问题

- 调试技巧提升:面对复杂的算法实现,提高了调试和问题定位的能力

9.2 最佳实践

在开发过程中,我总结了一些最佳实践:

- 模块化设计:将系统拆分为独立的模块,便于开发和维护

- 统一接口:定义清晰的接口,便于组件间的协作

- 充分测试:编写全面的测试用例,确保系统质量

- 文档完善:编写详细的文档,便于后续维护和他人理解

9.3 问题解决思路

在开发过程中,我形成了一套解决问题的思路:

- 问题分析:首先要准确定位问题的本质和原因

- 方案调研:查阅相关资料,了解业界的解决方案

- 原型验证:实现简化版的解决方案,验证可行性

- 逐步优化:在原型基础上不断优化和完善

结语

Word2Vec作为词嵌入技术的经典算法,虽然看似简单,但在实际实现过程中仍有许多细节需要注意。通过本次开发实践,我不仅深入理解了Word2Vec模型的原理和实现方法,还积累了丰富的工程实践经验。

开发过程中,我深刻体会到理论知识与工程实践相结合的重要性。仅仅了解算法原理是不够的,还需要考虑实际应用中的各种因素,如性能、可扩展性、可维护性等。同时,我也认识到持续学习和不断优化的重要性,技术在不断发展,只有保持学习的态度,才能跟上时代的步伐。

希望这篇技术博客能够对正在从事或即将从事词嵌入相关工作的朋友们有所帮助。也欢迎大家就文中内容进行交流和讨论,共同进步。

参考文献

- Mikolov, T., Chen, K., Corrado, G., & Dean, J. (2013). Efficient estimation of word representations in vector space. arXiv preprint arXiv:1301.3781.

- Mikolov, T., Sutskever, I., Chen, K., Corrado, G. S., & Dean, J. (2013). Distributed representations of words and phrases and their compositionality. Advances in neural information processing systems, 26.

- Pennington, J., Socher, R., & Manning, C. D. (2014). Glove: Global vectors for word representation. In Proceedings of the 2014 conference on empirical methods in natural language processing (EMNLP) (pp. 1532-1543).

- Jurafsky, D., & Martin, J. H. (2020). Speech and Language Processing. Pearson.

- jieba分词库文档: https://github.com/fxsjy/jieba

附录:核心代码示例

完整的Word2Vec模型使用示例

from word2vec_model import CBOW, SkipGram, EnsembleWord2Vec

# 使用CBOW模型

cbow_model = CBOW(vector_size=100, window=5, learning_rate=0.01)

# 准备训练数据

train_texts = ["自然语言处理是人工智能领域中的一个重要方向"]

# 训练模型

cbow_model.train(train_texts, epochs=100)

# 计算词语相似度

similarity = cbow_model.similarity("自然语言", "处理")

print(f"CBOW相似度: {similarity}")

# 查找最相似的词

similar_words = cbow_model.most_similar("自然语言", topn=5)

print(f"CBOW最相似的词: {similar_words}")

# 使用Skip-Gram模型

skipgram_model = SkipGram(vector_size=100, window=5, learning_rate=0.01)

skipgram_model.train(train_texts, epochs=100)

similarity = skipgram_model.similarity("自然语言", "处理")

print(f"Skip-Gram相似度: {similarity}")

similar_words = skipgram_model.most_similar("自然语言", topn=5)

print(f"Skip-Gram最相似的词: {similar_words}")

# 使用集成模型

ensemble_model = EnsembleWord2Vec()

ensemble_model.train(train_texts, model_type='skipgram', epochs=100)

similarity = ensemble_model.similarity("自然语言", "处理", model_type='skipgram')

print(f"集成模型相似度: {similarity}")

similar_words = ensemble_model.most_similar("自然语言", topn=5, model_type='skipgram')

print(f"集成模型最相似的词: {similar_words}")

# 获取词向量

vector = skipgram_model.get_vector("自然语言")

print(f"词向量维度: {len(vector)}")以上就是我开发Word2Vec模型系统的完整过程记录。通过这个项目,我不仅提升了技术能力,也加深了对NLP领域的理解。希望我的经验分享能对大家有所帮助。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录