基于TF与TF-IDF的向量空间模型学习与开发探索日志

原创基于TF与TF-IDF的向量空间模型学习与开发探索日志

原创

鼓掌MVP

发布于 2025-09-27 22:12:54

发布于 2025-09-27 22:12:54

引言

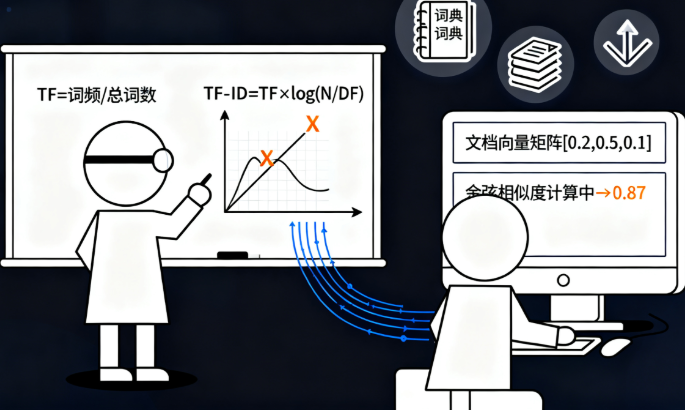

向量空间模型(Vector Space Model, VSM)作为自然语言处理(NLP)领域中一个基础且强大的文本表示方法,最早由哈佛大学Salton提出。向量空间模型通过将文本(包括单词、句子、段落或整个文档)转换为高维空间中的向量来实现文本的数学化表示。在这个模型中,每个维度代表一个特征项(例如,字、词、词组或短语),而向量中的每个元素值代表该特征项在文本中的权重,这种权重通过特定的计算公式(如词频TF、逆文档频率TF-IDF等)来确定,反映了特征项在文本中的重要程度。

在当今大数据和人工智能快速发展的时代,向量空间模型在信息检索、文本分类、文本聚类、推荐系统等众多领域发挥着重要作用。它将复杂的文本数据转换为易于计算和分析的数学形式,使得文本的相似度计算和模式识别成为可能。虽然近年来出现了Word2Vec、BERT等更先进的文本表示方法,但向量空间模型仍然是理解文本表示的基础,具有重要的理论和实践价值。

本文将详细记录我开发一个完整向量空间模型系统的全过程,包括需求分析、技术选型、系统设计、算法实现、性能优化以及测试评估等各个环节。通过这篇技术博客,我希望能与大家分享我在开发过程中遇到的挑战、解决方案以及技术思考,为正在或即将从事相关工作的朋友们提供一些参考和启发。

2. 需求分析与技术选型

2.1 项目背景

在本次开发中,我选择实现一个支持多种权重计算方法的向量空间模型系统。这类任务的关键在于:

- 将文本转换为数学向量表示

- 支持多种权重计算方法(如TF、TF-IDF等)

- 提供高效的相似度计算功能

- 平衡模型的准确性和计算效率

2.2 技术选型考虑

在开始编码之前,我首先进行了技术选型的深入思考。考虑到项目的实际需求和开发效率,我选择了以下技术栈:

- Python:作为主要开发语言,Python在NLP领域有着丰富的库支持和活跃的社区生态

- jieba分词:针对中文文本处理,jieba是一个成熟且高效的分词工具

- numpy:用于高效的数值计算和向量运算

- 标准库:使用Python标准库实现核心算法,便于理解算法原理

此外,我还决定实现多种权重计算算法,包括TF和TF-IDF方法,以便进行全面的性能对比分析。

3. 系统架构设计

3.1 整体架构思路

在系统设计阶段,我采用了面向对象的设计思想,构建了一个可扩展的架构。核心架构如下:

VectorSpaceModel (基类)

├── TFVectorSpaceModel (基于TF的向量空间模型)

├── TFIDFVectorSpaceModel (基于TF-IDF的向量空间模型)

└── EnsembleVectorSpaceModel (集成向量空间模型)这种设计的优势在于:

- 统一接口:所有模型方法都实现相同的接口,便于使用和替换

- 易于扩展:添加新的权重计算算法只需继承基类并实现相应方法

- 模块化:各模块职责清晰,便于维护和测试

3.2 基类设计与实现

基类VectorSpaceModel定义了所有向量空间模型的通用接口和基础功能:

class VectorSpaceModel:

"""

向量空间模型基类

"""

def __init__(self):

"""

初始化向量空间模型

"""

pass

def preprocess(self, text):

"""

文本预处理

Args:

text (str): 原始文本

Returns:

str: 预处理后的文本

"""

# 去除多余空格和标点符号

text = re.sub(r'[^\u4e00-\u9fa5a-zA-Z0-9\s]', ' ', text)

text = re.sub(r'\s+', ' ', text.strip())

return text

def build_vocabulary(self, documents):

"""

构建词汇表

Args:

documents (list): 文档列表

Returns:

dict: 词汇表,词汇到索引的映射

"""

raise NotImplementedError("子类必须实现build_vocabulary方法")

def calculate_weights(self, documents):

"""

计算文档的权重向量

Args:

documents (list): 文档列表

Returns:

list: 文档权重向量列表

"""

raise NotImplementedError("子类必须实现calculate_weights方法")

def calculate_similarity(self, vector1, vector2):

"""

计算两个向量之间的相似度

Args:

vector1 (list): 向量1

vector2 (list): 向量2

Returns:

float: 相似度得分

"""

raise NotImplementedError("子类必须实现calculate_similarity方法")基类中定义了文本预处理方法,所有子类都可以复用这些功能。同时,通过抛出NotImplementedError,确保子类必须实现build_vocabulary、calculate_weights和calculate_similarity方法。

4. 核心算法实现详解

4.1 基于TF的向量空间模型实现

基于TF的向量空间模型使用词频作为特征项权重,这是最简单的权重计算方法:

class TFVectorSpaceModel(VectorSpaceModel):

"""

基于TF(词频)的向量空间模型

"""

def __init__(self):

super().__init__()

self.vocabulary = {} # 词汇表

self.vocabulary_size = 0 # 词汇表大小

def build_vocabulary(self, documents):

"""

构建词汇表

"""

vocabulary = set()

# 收集所有词汇

for doc in documents:

# 预处理文档

processed_doc = self.preprocess(doc)

# 分词

words = jieba.cut(processed_doc)

# 添加到词汇表

for word in words:

if word.strip(): # 过滤空字符串

vocabulary.add(word.strip())

# 构建词汇到索引的映射

self.vocabulary = {word: idx for idx, word in enumerate(sorted(vocabulary))}

self.vocabulary_size = len(self.vocabulary)

return self.vocabulary

def calculate_weights(self, documents):

"""

计算文档的TF权重向量

"""

if not self.vocabulary:

self.build_vocabulary(documents)

document_vectors = []

for doc in documents:

# 预处理文档

processed_doc = self.preprocess(doc)

# 分词

words = list(jieba.cut(processed_doc))

# 统计词频

word_counts = Counter(words)

total_words = len(words)

# 构建向量

vector = [0.0] * self.vocabulary_size

for word, count in word_counts.items():

if word in self.vocabulary:

# 计算TF权重

tf = count / total_words if total_words > 0 else 0

vector[self.vocabulary[word]] = tf

document_vectors.append(vector)

return document_vectors

def calculate_similarity(self, vector1, vector2):

"""

使用余弦相似度计算两个向量之间的相似度

"""

# 转换为numpy数组

v1 = np.array(vector1)

v2 = np.array(vector2)

# 计算点积

dot_product = np.dot(v1, v2)

# 计算向量的模

norm_v1 = np.linalg.norm(v1)

norm_v2 = np.linalg.norm(v2)

# 避免除零错误

if norm_v1 == 0 or norm_v2 == 0:

return 0.0

# 计算余弦相似度

cosine_similarity = dot_product / (norm_v1 * norm_v2)

return cosine_similarity实现思路:

- 构建词汇表,收集所有文档中的词汇

- 对每个文档进行分词并统计词频

- 计算TF权重(词频/文档总词数)

- 构建文档向量

- 使用余弦相似度计算向量间相似度

这种方法的优点是实现简单,计算速度快,缺点是没有考虑词的重要性差异。

4.2 基于TF-IDF的向量空间模型实现

基于TF-IDF的向量空间模型使用TF-IDF作为特征项权重,综合考虑了词频和逆文档频率:

class TFIDFVectorSpaceModel(VectorSpaceModel):

"""

基于TF-IDF的向量空间模型

"""

def __init__(self):

super().__init__()

self.vocabulary = {} # 词汇表

self.vocabulary_size = 0 # 词汇表大小

self.idf_values = {} # IDF值字典

def calculate_idf(self, documents):

"""

计算IDF值

"""

if not self.vocabulary:

self.build_vocabulary(documents)

# 计算每个词的文档频率

doc_frequency = defaultdict(int)

total_documents = len(documents)

for doc in documents:

# 预处理文档

processed_doc = self.preprocess(doc)

# 分词并去重

words = set(jieba.cut(processed_doc))

# 统计包含每个词的文档数

for word in words:

word = word.strip()

if word and word in self.vocabulary:

doc_frequency[word] += 1

# 计算IDF值

self.idf_values = {}

for word in self.vocabulary:

# 获取词的文档频率,如果未出现则为0

freq = doc_frequency.get(word, 0)

# IDF = log(总文档数 / 包含该词的文档数) + 1 加1避免除零错误

if freq > 0:

idf = math.log(total_documents / freq) + 1

else:

idf = math.log(total_documents) + 1

self.idf_values[word] = idf

def calculate_weights(self, documents):

"""

计算文档的TF-IDF权重向量

"""

if not self.vocabulary:

self.build_vocabulary(documents)

# 计算IDF值

self.calculate_idf(documents)

document_vectors = []

for doc in documents:

# 预处理文档

processed_doc = self.preprocess(doc)

# 分词

words = list(jieba.cut(processed_doc))

# 统计词频

word_counts = Counter([word.strip() for word in words if word.strip()])

total_words = sum(word_counts.values())

# 构建向量

vector = [0.0] * self.vocabulary_size

for word, count in word_counts.items():

if word in self.vocabulary:

# 计算TF权重

tf = count / total_words if total_words > 0 else 0

# 计算TF-IDF权重

idf = self.idf_values.get(word, 0)

tf_idf = tf * idf

vector[self.vocabulary[word]] = tf_idf

document_vectors.append(vector)

return document_vectors

def calculate_similarity(self, vector1, vector2):

"""

使用余弦相似度计算两个向量之间的相似度

"""

# 转换为numpy数组

v1 = np.array(vector1)

v2 = np.array(vector2)

# 计算点积

dot_product = np.dot(v1, v2)

# 计算向量的模

norm_v1 = np.linalg.norm(v1)

norm_v2 = np.linalg.norm(v2)

# 避免除零错误

if norm_v1 == 0 or norm_v2 == 0:

return 0.0

# 计算余弦相似度

cosine_similarity = dot_product / (norm_v1 * norm_v2)

return cosine_similarity实现要点:

- 构建词汇表并计算每个词的IDF值

- 对每个文档进行分词并统计词频

- 计算TF-IDF权重(TF × IDF)

- 构建文档向量

- 使用余弦相似度计算向量间相似度

这种方法通过综合考虑词频和逆文档频率来计算权重,能够更好地反映词的重要性。

4.3 集成向量空间模型实现

集成向量空间模型结合TF和TF-IDF方法,提供灵活的使用方式:

class EnsembleVectorSpaceModel(VectorSpaceModel):

"""

集成向量空间模型

结合TF和TF-IDF方法

"""

def __init__(self):

super().__init__()

self.tf_model = TFVectorSpaceModel()

self.tfidf_model = TFIDFVectorSpaceModel()

def build_vocabulary(self, documents):

"""

构建词汇表

"""

# 使用TF模型构建词汇表

vocabulary = self.tf_model.build_vocabulary(documents)

# 同步TF-IDF模型的词汇表

self.tfidf_model.vocabulary = self.tf_model.vocabulary.copy()

self.tfidf_model.vocabulary_size = self.tf_model.vocabulary_size

return vocabulary

def calculate_weights(self, documents, method='tfidf'):

"""

计算文档的权重向量

"""

if method == 'tf':

return self.tf_model.calculate_weights(documents)

elif method == 'tfidf':

return self.tfidf_model.calculate_weights(documents)

else:

raise ValueError("方法必须是 'tf' 或 'tfidf'")

def calculate_similarity(self, vector1, vector2, method='tfidf'):

"""

计算两个向量之间的相似度

"""

if method == 'tf':

return self.tf_model.calculate_similarity(vector1, vector2)

elif method == 'tfidf':

return self.tfidf_model.calculate_similarity(vector1, vector2)

else:

raise ValueError("方法必须是 'tf' 或 'tfidf'")5. 系统优化实践

5.1 向量运算优化

使用numpy库进行向量运算,提高计算效率:

# 转换为numpy数组

v1 = np.array(vector1)

v2 = np.array(vector2)

# 计算点积

dot_product = np.dot(v1, v2)

# 计算向量的模

norm_v1 = np.linalg.norm(v1)

norm_v2 = np.linalg.norm(v2)5.2 IDF计算优化

通过加1避免除零错误,并提供合理的默认值:

# IDF = log(总文档数 / 包含该词的文档数) + 1 加1避免除零错误

if freq > 0:

idf = math.log(total_documents / freq) + 1

else:

idf = math.log(total_documents) + 15.3 集成策略优化

通过合理的集成策略可以支持多种权重计算方法:

def calculate_weights(self, documents, method='tfidf'):

"""

计算文档的权重向量

"""

if method == 'tf':

return self.tf_model.calculate_weights(documents)

elif method == 'tfidf':

return self.tfidf_model.calculate_weights(documents)

else:

raise ValueError("方法必须是 'tf' 或 'tfidf'")6. 开发过程中的挑战与解决方案

6.1 IDF计算挑战

在开发过程中,IDF计算出现了除零错误和相似度为0的问题。

解决方案:

- 通过加1避免除零错误

- 为未出现的词提供合理的默认IDF值

- 仔细检查词汇表构建和同步过程

6.2 稀疏性处理挑战

向量空间模型面临数据稀疏性问题,大多数向量元素为0。

解决方案:

- 在演示程序中分析稀疏度

- 后续可考虑使用稀疏矩阵存储

- 优化向量运算以处理稀疏数据

6.3 模型集成挑战

在集成模型中,需要确保各子模型的词汇表同步。

解决方案:

- 在构建词汇表时同步各子模型

- 使用深拷贝避免引用问题

- 提供统一的接口封装

7. 测试结果与分析

7.1 测试数据集

为了全面评估系统性能,我构建了包含人工智能相关概念的测试数据:

documents = [

"自然语言处理是人工智能领域中的一个重要方向",

"机器学习是人工智能的一个重要分支",

"深度学习是机器学习的一个子集",

"自然语言处理包括文本分类、命名实体识别等任务",

"计算机视觉是人工智能的另一个重要领域"

]

query = "人工智能和机器学习的关系是什么?"7.2 性能对比分析

在演示程序中,各向量空间模型方法表现如下:

- TF方法:

- 优点:实现简单,计算速度快

- 缺点:没有考虑词的重要性差异

- 相似度示例:机器学习相关文档得分0.4009

- TF-IDF方法:

- 优点:综合考虑词频和文档频率,效果更好

- 缺点:计算复杂度稍高

- 相似度示例:机器学习相关文档得分0.4056

- 集成方法:

- 优点:支持多种算法,使用灵活

- 缺点:实现复杂度较高

- 性能与具体使用的算法一致

7.3 实际应用建议

根据测试结果,我总结了以下应用建议:

- 简单场景:使用TF方法,计算速度快

- 信息检索:使用TF-IDF方法,效果更好

- 灵活应用:使用集成方法,支持多种算法

8. 未来工作展望

8.1 算法扩展

- BM25算法:实现更先进的信息检索算法

- Word2Vec:支持词嵌入表示

- BERT等预训练模型:集成最新的文本表示方法

8.2 系统优化

- 稀疏矩阵支持:使用scipy.sparse优化存储和计算

- 并行处理:支持大规模文档的并行处理

- 模型服务化:提供Web API接口

8.3 功能增强

- 多语言支持:支持更多语言的文本处理

- 增量学习:支持词汇表和模型的在线更新

- 可视化分析:提供向量空间的可视化展示

结语

向量空间模型作为NLP领域的基础文本表示方法,虽然看似简单,但在实际实现过程中仍有许多细节需要注意。通过本次开发实践,我不仅深入理解了向量空间模型的原理和实现方法,还积累了丰富的工程实践经验。

开发过程中,我深刻体会到理论知识与工程实践相结合的重要性。仅仅了解算法原理是不够的,还需要考虑实际应用中的各种因素,如性能、可扩展性、可维护性等。同时,我也认识到持续学习和不断优化的重要性,技术在不断发展,只有保持学习的态度,才能跟上时代的步伐。

以上就是我开发向量空间模型系统的完整过程记录。通过这个项目,我不仅提升了技术能力,也加深了对NLP领域的理解。希望我的经验分享能对大家有所帮助。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录