AI 又一次颠覆游戏世界——揭秘腾讯开源的 Hunyuan-GameCraft

原创AI 又一次颠覆游戏世界——揭秘腾讯开源的 Hunyuan-GameCraft

原创

算法一只狗

发布于 2025-09-26 17:42:58

发布于 2025-09-26 17:42:58

最近腾讯混元团队又开源了一款模型,被称为Hunyuan‑GameCraft,而且能够在消费级显卡上进行运行,让普通人能够简单基于一个场景生成动态视频。

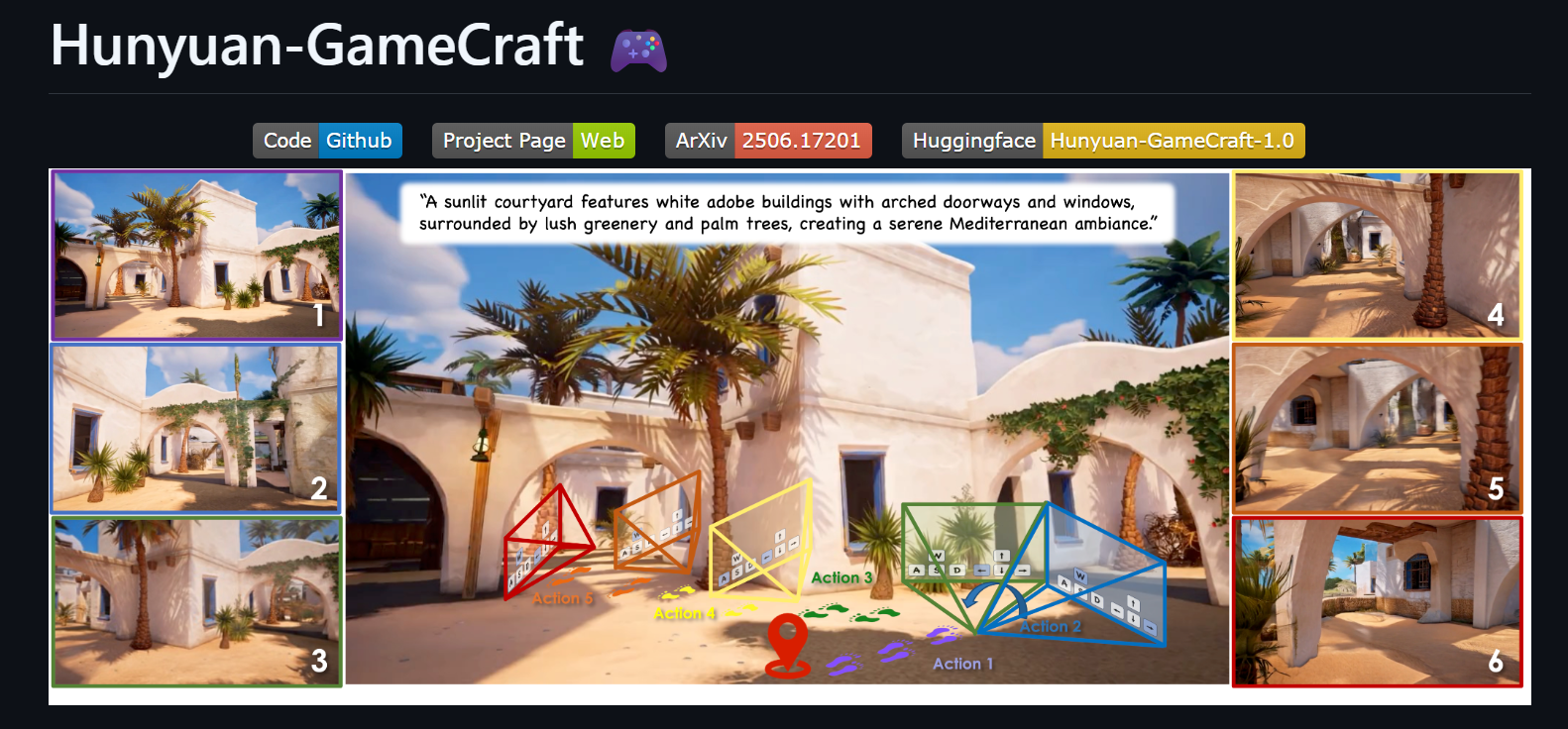

也就是只需一张静态图、一段文字描述和简单的动作输入,就能生成拥有高度动态性、超强交互体验的“游戏视频”,而生成的视频同时也拥有电影级的视觉效果。

我们看看官方的介绍:它通过输入一个场景图,然后加入具体的action操作,用来控制玩家的具体视角。那么模型就会根据输入图片、文件和action动作来生成类似的视角视频场景。

再来看看和其他模型的对比,混元这个模型生成的视频非常丝滑,会遵循用户输入的指令进行场景视角的切换。

在以前的方法中,其动态、物理真实感、长期一致性和效率方面都存在局限性,这限制了创建各种游戏视频的能力。而混元团队基本克服了这些缺点,精心挑选的游戏场景数据显著提升了视觉保真度、真实感和动作可控性。

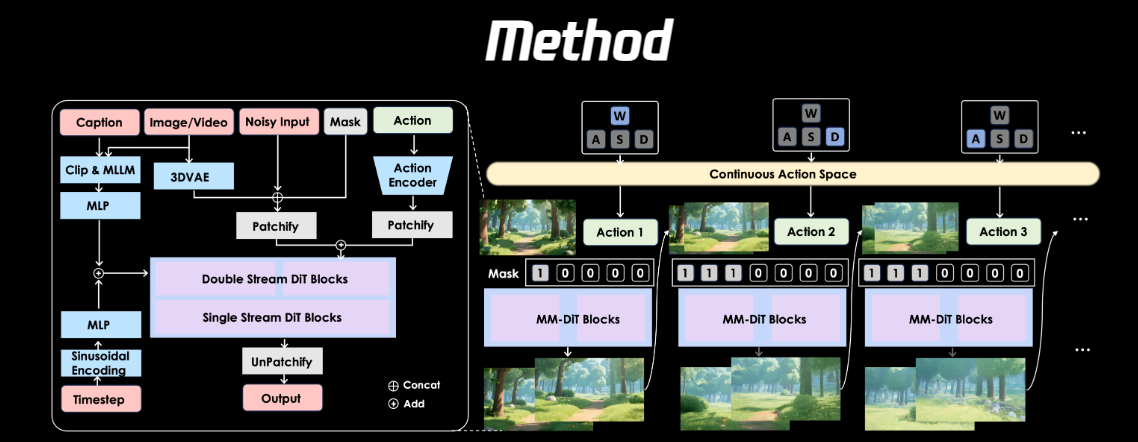

在动态控制这块儿,Hunyuan-GameCraft 把普通的键盘输入都整合进了一个统一的连续动作空间里,那么模型就可以根据不同的action动作加上输入的图像数据进行统一生成,解决了以前action和图像数据两种模态隔离的模式。

这种方法让它有效控制场景的运动轨迹,然后根据输入指令进行有效生成。

同时对于多种action的输入,它也能够进行有效控制。

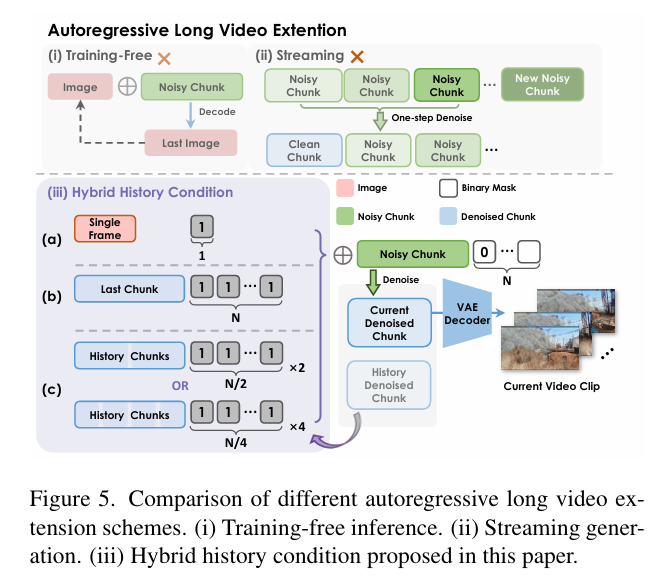

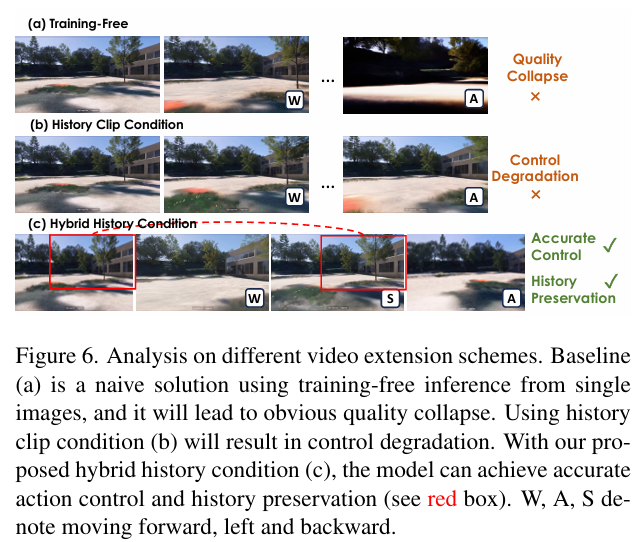

接下来说说长期一致性。它在模型中提出了一种混合历史条件训练策略,该策略可以自回归地扩展视频序列,同时保留游戏场景信息。

最后,在模型成本上给降下来不少,

以前如果要进行游戏场景的生成,费用不低。但是这个模型经过PCM蒸馏技术把推理步骤都给压缩了,速度一下子就提上去了,成本也跟着降下来了。这么一来呢,使用量化的13B模型,能在RTX 4090这种咱们普通消费者能买得起的GPU上运行。

目前整体模型已经开源在github上,感兴趣的可以去看看:

https://github.com/Tencent-Hunyuan/Hunyuan-GameCraft-1.0

模型三大技术亮点:智能、真实、流畅

腾讯开源的这个模型,对比同行业来看,分别有三个不同的优势:

首先是把动作进行统一输入,然后结合连续相机控制进行生成

它通过将键盘与鼠标等离散操作映射进统一的“相机表示空间”,实现细腻的速度与角度控制,让用户能够顺滑地控制场景移动和视角变化

利用了混合历史条件训练策略

通过自回归方式,在每一步生成过程中融合历史帧与当前动作输入,确保生成的视频在长期连续性与场景一致性方面都表现出色。相比仅依赖单帧作为条件的方法,该机制更能保持场景连贯性又不牺牲交互灵活性

为了进行高效推理速率,对模型进行了蒸馏

为了满足实时交互的需求,Hunyuan‑GameCraft 使用了模型蒸馏技术进行加速。例如通过将扩散模型转化为阶段一致性模型(Phased Consistency Model)配合无分类器引导蒸馏,推理速度提升 10~20 倍,响应时延控制在 5 秒以内,达到每秒 ~6.6 帧的实时生成能力

技术细节

整体模型架构如下所示,给定参考图像和相应的提示,即键盘或鼠标信号(比方说是w、a、s、d这些),将这些选项转换为连续的相机空间。

然后设计一个轻量级的动作编码器来编码输入的相机轨迹。 对于长视频扩展,同时设计了一个可变掩码指标,其中 1 和 0 分别表示历史帧和预测帧。

在 交互式游戏视频生成 中,视频不仅仅是单帧的生成,还要满足:

- 长时序一致性:动作与场景要连续,不出现突兀跳变;

- 动作-场景耦合:角色动作必须和键盘/鼠标输入相符;

- 上下文依赖:比如角色刚刚转身,那么下一帧的视角必须延续前一帧的旋转趋势。

如果只用当前输入(例如一帧图像 + 动作指令),模型容易出现:

- 动作失真(输入要求前进,但角色却突然转向);

- 场景漂移(背景物体随机变化,丢失一致性);

- 长视频生成时,累积错误导致失真。

因此,作者提出了 混合历史条件,让模型在训练和推理时既能利用历史,又不过度依赖单一模式。

如下图所示,training-free方法做外推时,历史背景信息不够,结果生成出来的效果时好时坏,而且越往后生成越容易画面崩坏。

混合历史条件训练的目标是,在生成第t帧视频时,模型的条件输入既包括:历史帧信息(History Frames)例如上一时刻的场景画面、特征向量等 → 保证视觉与场景的连续性。动作输入(Action Input)来自键盘/鼠标(已被映射到相机空间) → 保证动作的准确可控性。场景上下文(Scene Context)长时间的全局信息(如地图、环境纹理、任务目标) → 避免短期记忆遗忘。

另外,为了加速模型推理,在技术上也使用了蒸馏技术。通过模型蒸馏,推理速度提高了 10 到 20 倍,并将延迟降低到每个动作 5 秒以内。

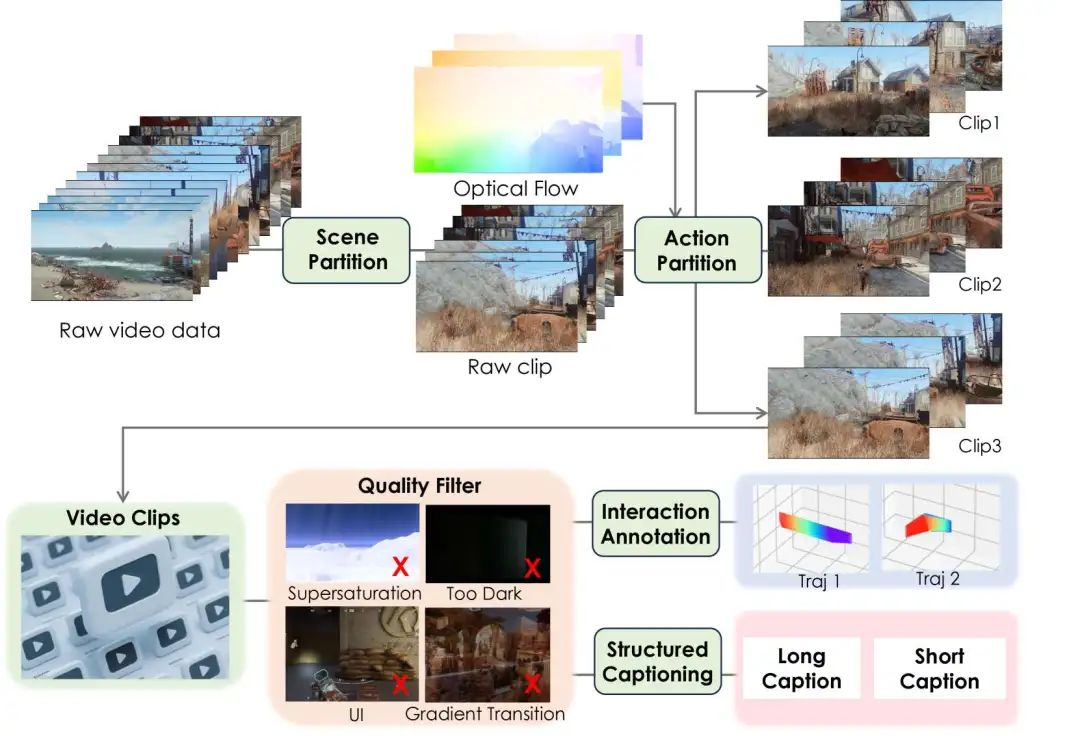

数据集构建上,收集了大量的游戏数据。来自 100+ 款 AAA 游戏 的 100 万+ 段游戏录屏(1080p),并在一个精标的合成数据上做微调以增强精细可控性与视觉真实度。

实验效果

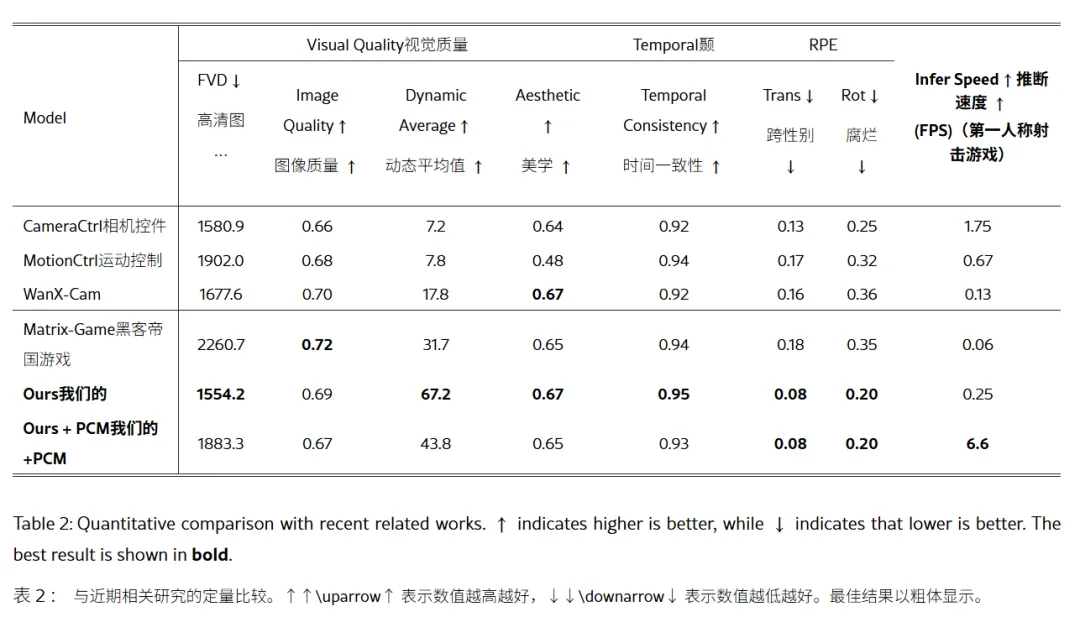

大量实验表明,Hunyuan‑GameCraft 在以下方面全面优于当前多种主流模型(如 Matrix‑Game、CameraCtrl 等):

- 视觉质量更真实

- 动态表现更丰富

- 控制精度更高

- 时间一致性更强

- 推理效率更优

从结果能看出来:Hunyuan-GameCraft 效果更真实、更生动,控制也更精准,在视频质量、时间连贯性、动作准确性还有动态效果这些方面,它的平均排名分都是最高的。

说真的,Hunyuan-GameCraft 绝对算得上是 AI 游戏发展路上的一个重要里程碑了。

快速上手部署

首先需要支持 CUDA 的 NVIDIA GPU。

- 最低要求:所需的最低 GPU 内存为 24GB,但速度非常慢。

- 建议:建议使用具有 80GB 内存的 GPU 以获得更好的生成质量。

首先下载代码库:

git clone https://github.com/Tencent-Hunyuan/Hunyuan-GameCraft-1.0.git

cd Hunyuan-GameCraft-1.0Linux 安装

我们建议使用 CUDA 12.4 版本进行手动安装。

# 1. Create conda environment

conda create -n HYGameCraft python==3.10

# 2. Activate the environment

conda activate HYGameCraft

# 3. Install PyTorch and other dependencies using conda

conda install pytorch==2.5.1 torchvision==0.20.0 torchaudio==2.5.1 pytorch-cuda=12.4 -c pytorch -c nvidia

# 4. Install pip dependencies

python -m pip install -r requirements.txt

# 5. Install flash attention v2 for acceleration (requires CUDA 11.8 or above)

python -m pip install ninja

python -m pip install git+https://github.com/Dao-AILab/flash-attention.git@v2.6.3另外,也可以使用HunyuanVideo的Docker镜像。使用以下命令拉取并运行该Docker镜像。

# For CUDA 12.4 (updated to avoid float point exception)

docker pull hunyuanvideo/hunyuanvideo:cuda_12

docker run -itd --gpus all --init --net=host --uts=host --ipc=host --name hunyuanvideo --security-opt=seccomp=unconfined --ulimit=stack=67108864 --ulimit=memlock=-1 --privileged hunyuanvideo/hunyuanvideo:cuda_12

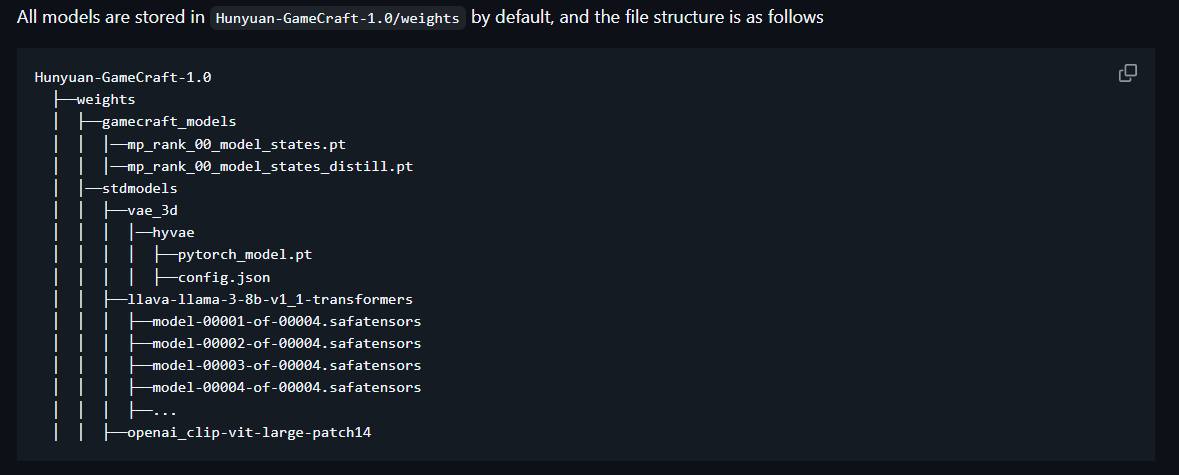

pip install diffusers==0.34.0 transformers==4.54.1下载预训练模型

下载预训练模型的详细信息:

https://github.com/Tencent-Hunyuan/Hunyuan-GameCraft-1.0/blob/main/weights/README.md

在多个 GPU 上进行并行推理

例如,要使用8块GPU生成视频,可以使用以下命令,其中--action-list w s d a模拟键盘操作信号,帮助你生成相应内容的视频。--action-speed-list 0.2 0.2 0.2 0.2表示位移距离,可以替换为0到3之间的任意值。

你可以尝试任意组合和任意长度的动作列表(每 33 帧一个动作,25FPS)来生成长视频,并确保 的长度--action-speed-list必须与 相同--action-list。需要注意的是,推理时间与动作长度呈线性关系:

#!/bin/bash

JOBS_DIR=$(dirname $(dirname "$0"))

export PYTHONPATH=${JOBS_DIR}:$PYTHONPATH

export MODEL_BASE="weights/stdmodels"

checkpoint_path="weights/gamecraft_models/mp_rank_00_model_states.pt"

current_time=$(date "+%Y.%m.%d-%H.%M.%S")

modelname='Tencent_hunyuanGameCraft_720P'

torchrun --nnodes=1 --nproc_per_node=8 --master_port 29605 hymm_sp/sample_batch.py \

--image-path "asset/village.png" \

--prompt "A charming medieval village with cobblestone streets, thatched-roof houses, and vibrant flower gardens under a bright blue sky." \

--add-pos-prompt "Realistic, High-quality." \

--add-neg-prompt "overexposed, low quality, deformation, a poor composition, bad hands, bad teeth, bad eyes, bad limbs, distortion, blurring, text, subtitles, static, picture, black border." \

--ckpt ${checkpoint_path} \

--video-size 704 1216 \

--cfg-scale 2.0 \

--image-start \

--action-list w s d a \

--action-speed-list 0.2 0.2 0.2 0.2 \

--seed 250160 \

--infer-steps 50 \

--flow-shift-eval-video 5.0 \

--save-path './results/'此外,还支持 FP8 优化和SageAttn。要启用 FP8,只需将 添加--use-fp8到您的命令中即可。然后使用以下命令安装 SageAttention:

git clone https://github.com/thu-ml/SageAttention.git

cd SageAttention

python setup.py install # or pip install -e .还提供了加速模型,您可以使用以下命令:

#!/bin/bash

JOBS_DIR=$(dirname $(dirname "$0"))

export PYTHONPATH=${JOBS_DIR}:$PYTHONPATH

export MODEL_BASE="weights/stdmodels"

checkpoint_path="weights/gamecraft_models/mp_rank_00_model_states_distill.pt"

current_time=$(date "+%Y.%m.%d-%H.%M.%S")

modelname='Tencent_hunyuanGameCraft_720P'

torchrun --nnodes=1 --nproc_per_node=8 --master_port 29605 hymm_sp/sample_batch.py \

--image-path "asset/village.png" \

--prompt "A charming medieval village with cobblestone streets, thatched-roof houses, and vibrant flower gardens under a bright blue sky." \

--add-neg-prompt "overexposed, low quality, deformation, a poor composition, bad hands, bad teeth, bad eyes, bad limbs, distortion, blurring, text, subtitles, static, picture, black border." \

--ckpt ${checkpoint_path} \

--video-size 704 1216 \

--cfg-scale 1.0 \

--image-start \

--action-list w s d a \

--action-speed-list 0.2 0.2 0.2 0.2 \

--seed 250160 \

--infer-steps 8 \

--use-fp8 \

--flow-shift-eval-video 5.0 \

--save-path './results_distill/'写在最后

目前 Hunyuan‑GameCraft 聚焦于相机轨迹控制、不含复杂游戏操作,如射击、爆炸等未来可能加入这些动作类型。但其出色的高动态交互能力、模型效率和生成质量已为实时游戏视频生成奠定了坚实基础 。当然未来,这样的游戏视频生成模型,使得它可以应用于多种场景,比如:

- 游戏开发实时预览

- 内容创作者视频制作工具

- 自动剧情生成与虚拟人机交互场景构建

从整体来看,Hunyuan-GameCraft 是跨界 AI 与游戏互动内容创作的一座里程碑。它以统一动作表示、混合历史训练机制与模型蒸馏优化,实现了高互动性、长时一致性与实时生成的“电影级”游戏视频合成效果。伴随开源发布,它已经准备好被用于更广泛的创作与开发场景。喜欢创作、热爱游戏的你,或许该动动手,试试从一张图片开始“玩”你的专属游戏世界。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录