AI学术助手为何总在“翻车”?评测基准ScholarSearch为你揭秘 | AGI-Eval 独家托管

原创AI学术助手为何总在“翻车”?评测基准ScholarSearch为你揭秘 | AGI-Eval 独家托管

原创

AGI-Eval评测社区

发布于 2025-09-03 10:37:19

发布于 2025-09-03 10:37:19

我们总觉得 AI 神通广大:GPT-4 能解高数题,Gemini 能写代码,甚至有些Agent号称能够帮助人类熬夜查文献、写专业的学术研究报告。然而当大语言模型遇上艰深的学术研究时,它们的真实搜索能力究竟如何?最近,来自北京大学的研究团队带来了全新的评测基准——ScholarSearch,它是首个专门用于评估大语言模型在学术研究中复杂信息检索能力的数据集,它像一把精密的游标卡尺,首次量出了 AI 在学术深水区的“真实水位”。

ScholarSearch 包含 223 道高难度的学术检索题目及其答案,对具备联网搜索能力的代表性模型及纯推理模型进行了评估。该基准发现了一个残酷真相:在真正的学术研究里,AI 可能连“入门级”任务都搞不定。

Image

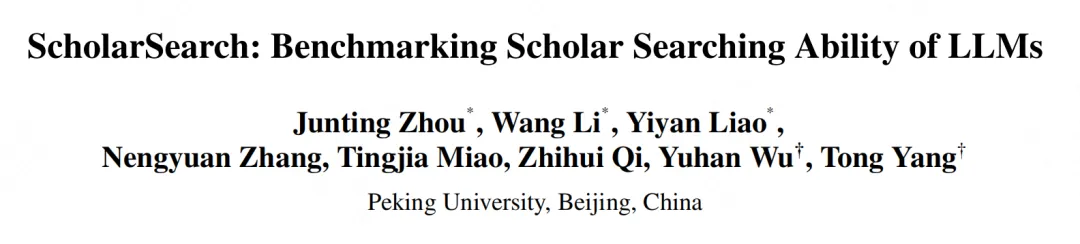

在 ScholarSearch 对模型评测的结果中,纯推理模型的准确率极低,GPT-4.1 正确率 7.17%,GPT-4o-mini 仅 2.24%;具备搜索功能的模型表现较好,gemini-2.5-pro-deep-research 的搜索版准确率为 39.46%,GPT-4o-search-preview 搜索版准确率 18.83%,gpt-4o-mini-search-preview 的准确性为 10.31%;社科人文(Social Sciences & Humanities)题目的正确率普遍高于理工科(Science & Engineering),但也有例外情况,grok3-deep-search 社科人文的正确率(0.95%)不及理工科(11.02%),gemini-2.5-flash 也是如此。

Image

△模型准确率

该榜单已同步至 AGI-Eval 评测社区,进入小程序即可查看完整内容。

- 微信小程序:AGI-Eval模型评测

- huggingface: https://huggingface.co/datasets/PKU-DS-LAB/ScholarSearch

- 论文链接: https://arxiv.org/abs/2506.13784

接下来,我们将详细介绍 ScholarSearch 是如何构建的、这份“学术专用考卷”的硬核设计以及该“考卷”对 AI 模型的评测结果。

01.为什么需要“学术专用考卷”?

在科学研究的动态环境中,大语言模型从海量在线数据源中准确提取关键、最新信息的能力至关重要。这种实时信息检索对于跟上新发现的步伐、验证假设以及拓展知识边界而言必不可少。

尽管先进的推理模型拥有相当丰富的累积知识储备,但一个关键的局限性仍然存在:它们无法实时获取和整合最新信息,没有多步溯源、跨库验证、实时更新的学术研究能力。在 ScholarSearch 基准出现前,AI 的“考试”其实有点“放水”:

- 传统学术基准考察记忆:GPQA、 MMLU 这类学术基准测试,主要评估大语言模型对既有知识或精选学术内容的理解和推理能力。虽然这些基准测试对于评估事实回忆和逻辑推理很有价值,但它们通常不需要主动、实时的信息搜索,考察的是模型对课本内容的记忆。就像让学生背题应付考试,根本不涉及“查新文献”的能力,与真实研究中“从 0 到 1 找答案”的场景相去甚远。

- 浏览基准太“生活化”:OpenAI 的 BrowseComp 这类浏览基准测试,侧重于通用网页浏览和从公共互联网来源提取信息,可以让 AI 订机票、查天气,这些工作和 “追 Nature 最新论文” 比起来,难度差了不止一个量级。

复杂的、多步骤信息检索能力对真正的学术研究至关重要。学术研究的核心痛点,恰恰藏在这些基准的盲区里。现有的学术基准测试和当前的浏览基准测试都无法充分衡量大语言模型真正的 “深度研究” 能力。

学术研究的本质是“动态侦探工作”:你需要从 10 篇相关论文里揪出关键数据,对比 3 个数据库的矛盾结论,还要验证 5 年前的理论在新实验中的适用性。这要求 AI 不仅会“搜”,更要会“追”—— 像侦探查线索一样,一步接一步深挖。而 ScholarSearch,就是第一份专门针对这种 “学术侦探能力” 的考卷。

02.研究团队如何打造评测考卷

ScholarSearch 的每一个问题,都要经过“九九八十一难”才能最终入选。这个由北京大学多学科团队打造的 “筛选流水线”,是对学术严谨性的致敬。

2.1 学生出题,专家把关

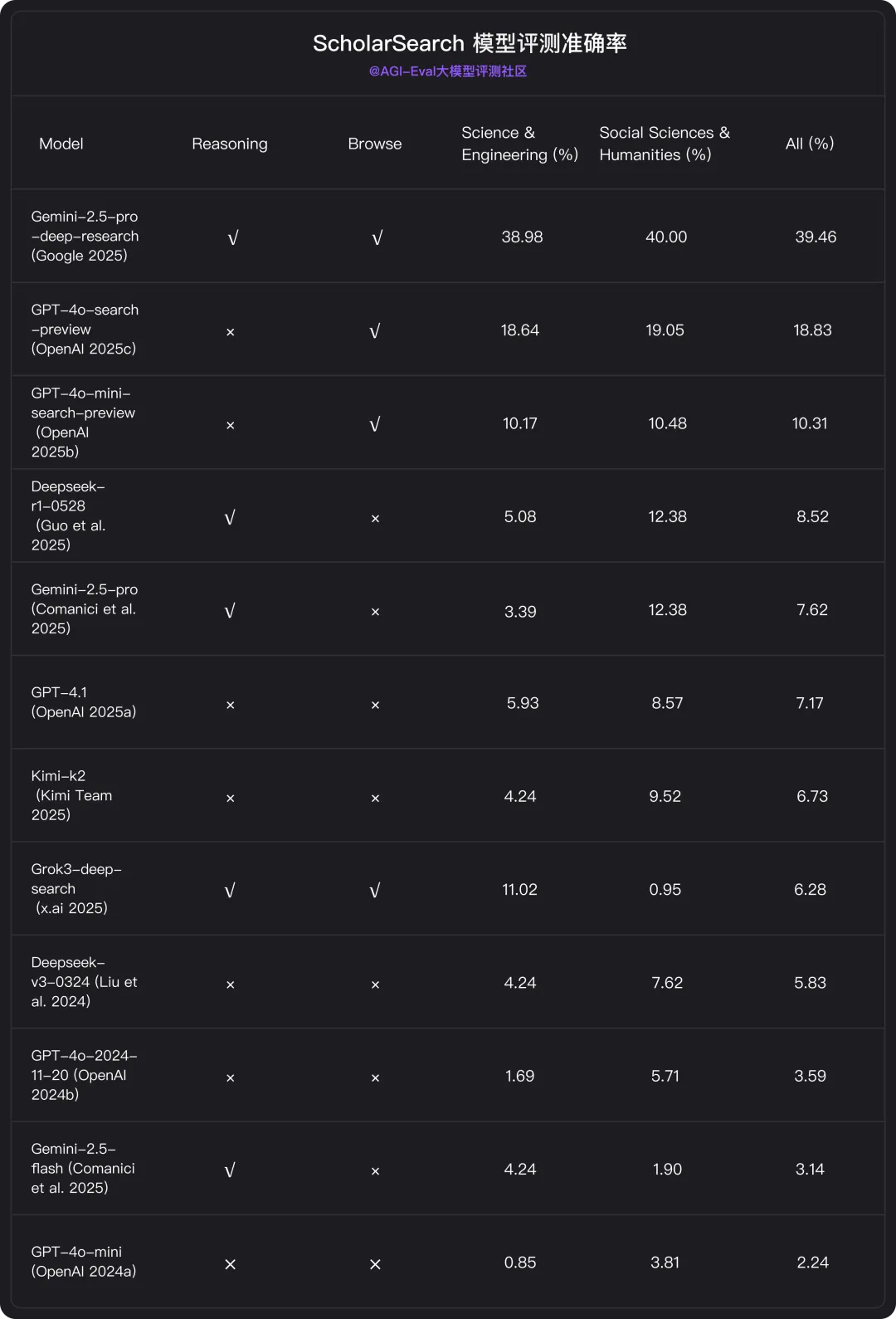

ScholarSearch 的问题全部源自真实研究场景,北大 15 个学科的本硕博学生化身 “出题人”,将自己科研中遇到的真实困惑转化为测试题,确保每个问题都像你写论文时遇到的“拦路虎”。

Image

△ScholarSearch 的数据收集流程。学生从可公开访问的学术出版物或网站获取数据,首先会通过多个大语言模型(LLMs)进行筛选,以挑选出难度较高的问题。随后,一个专业团队会对筛选后的这些数据进行审核,审核内容包括答案的唯一性、来源的可获取性以及学术正确性。

2.2 AI 先做,不及格才算数

问题初稿会先交给两位 “AI 考官”:Grok 3 的 DeepSearch 模式和 Gemini 2.5 Pro 的 Deep Research 功能。只有同时满足两个条件的问题才能过关:

- Grok 3 纯靠自身知识(不搜索)答不出;

- 至少一款深度检索模型答错或答不全。

2.3 专家审核

最后一关由跨学科专家团队把守,他们手持“三把尺子”:

- 唯一性标尺:检查答案是否有歧义。比如“某事件发生年份”,必须精确到具体数字,不能是“19 世纪末”这种模糊表述、

- 来源标尺:验证参考资料是否真实可访问。如果某篇关键论文仅存于某大学内部数据库,问题就会被打回。

- 学术标尺:评估问题是否有研究价值。淘汰那些“为了难而难”的无意义问题(比如“某论文作者的名字拼写”)。

从最初的 1000 多个问题,到最终入选的 223 个,ScholarSearch 所筛选题目的“幸存率”不到 25%。这种近乎苛刻的筛选,确保了它能真实反映学术研究的能力需求。

03.ScholarSearch 的硬核设计

ScholarSearch 的 223 道题,精心设计用于严格评估大语言模型在学术环境中的复杂信息检索技能,每道都经过 “魔鬼筛选”:

3.1 学术实用性

与那些刻意设计的 “刁钻陷阱题” 不同,ScholarSearch 的问题全部源自真实研究场景。北京大学的本科生和研究生们化身 “出题人”,将自己科研中遇到的真实困惑转化为测试题。

如计算机系学生问:“如何用算法处理多属性数据流的聚合查询?”,是源自分布式系统研究中的实际瓶颈;

历史系学生问:“王阳明‘读考亭《上光宗疏》’的戊午年,对应公历哪一年?”是来自古籍整理时的真实考证需求。

3.2 问题高难度

出题时,团队会先用 Grok DeepSearch 或 Gemini Deep Research 这类“学霸级 AI”测试,若模型能直接答出来,这题就会被淘汰。最终入选的题,答案无法由单一模型直接提供,至少需要 3 次深度搜索才能解决。设计的问题使其答案无法从单一搜索查询或现有大语言模型知识中直接得出,需要通过迭代的、多次的搜索来解决。

用一道物理题来举例:中科院物理所研究的 LaNiO3/LaFeO3 3:1 超晶格,居里温度是多少开尔文?

答案:589K,需搜索“中科院物理所发表研究成果,状 La2NiFeO6 双钙钛矿薄膜中诱导出了远高于室温的铁磁性”,阅读多个相关网页才可确定实验结果,少一步搜索都不行。

3.3 广度覆盖

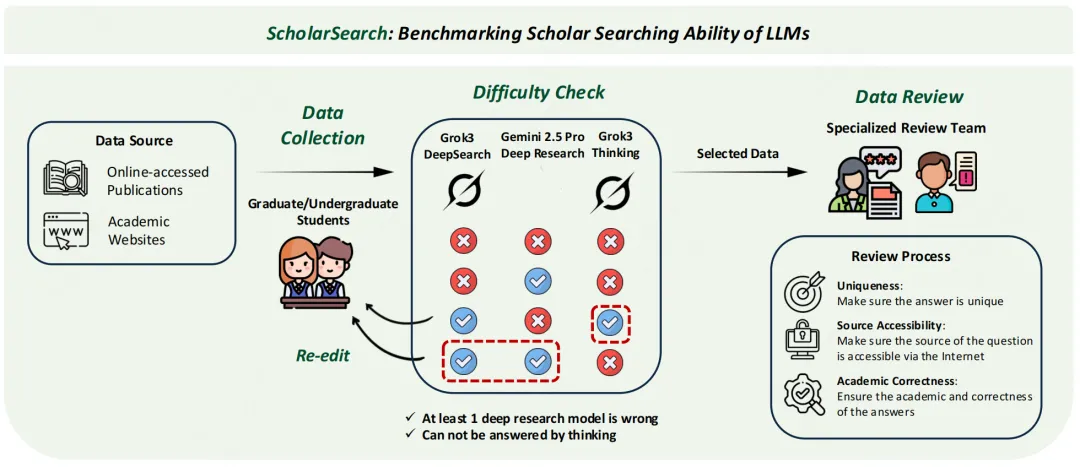

计算机科学(57 题,占比25.56%)、文学(45 题,占比20.18%)、生物学(35 题,15.70%)、政治学(21 题,9.42%)、经济学(17 题,占比 7.62%)... 连人口学、科学技术史都有涉及,跨越 15 个学科,文理通杀。

Image

△图 2:ScholarSearch 中的学科分布。每个问题所属的学科均由问题创建者手动标注。

这种分布不是随机的,团队刻意选择了“知识更新速度差异大”的学科组合:既有计算机科学这种时常有新突破的领域,也有文学这种“注重经典”的领域,目的就是测试 AI 在不同“知识时间尺度”下的检索能力。

04.评测结果

研究团队拿这份考卷测试了多款 AI,结果堪称 “大型翻车现场”:

Image

△模型准确率

4.1 纯推理模型表现惨淡

依赖预训练知识和推理的模型,其准确性异常低。GPT-4.1 正确率 7.17%,GPT-4o-mini 仅 2.24%。作为最佳推理模型之一的 deepseek-r1-0528 也表现不佳,仅达到 8.52% 的准确性,相当于闭卷考直接摆烂。学术研究查询通常需要动态的、交叉引用的,有时甚至是实时的数据,而纯推理模型无法有效地提供这些数据。

比如经济学题目:中国的会计准则每年都会修订。相比于 2023 年的会计准则,2024 年的会计准则在《企业会计准则第 22 号——金融工具确认和计量》中, 对于以摊余成本计量的金融资产后续计量部分进行修订时,对计提利息的会计准则进行了怎样的直接变更?

答案:“应收利息和应付利息”科目改为“债权投资 - 应计利息”。考的是最新修订内容,2023 年训练的 AI 注定一脸懵。这类信息既不在模型的训练数据里,也无法通过推理“猜”出来 —— 必须去查 2024 年发布的修订文件。

4.2 搜索功能对学术检索至关重要

各模型综合准确率差异显著,具备搜索功能的模型综合准确略远高于其他模型。GPT-4o-search-preview 搜索版准确率 18.83%,远高于无搜索能力的 gpt-4.1(准确率7.17%),比闭卷时翻了近 3 倍。gpt-4o-mini-search-preview 的准确性为 10.31%,其没有浏览功能的变体 gpt-4o-mini (准确率为2.24%)的四倍多。

具备搜索能力的模型 gemini-2.5-pro-deep-research 的正确率达到了39.46%,在众多模型中表现最佳,但即使最好的支持搜索的模型也仍然没有完全具备有效处理学术研究查询复杂性的能力,离“合格研究员”还差得远。

4.3 文理偏科明显

没搜索功能的模型中,社科人文题正确率比理工科高不少 —— 这可能表明人文社科文本在大语言模型的训练语料中占比较高,也可能与其中一些领域知识的更新速度较慢有关,AI “老黄历”还能应付。

但在具有搜索能力的模型中,理工科问题的准确率与社科人文问题的准确率相对接近,文理正确率差距缩小,说明实时搜索能帮 AI 补充一定的“新知识点”。

4.4 能力支持与性能的关联

- 同时支持推理 + 浏览的模型:gemini-2.5-pro-deep-research、grok3-deep-search。其中gemini-2.5-pro-deep-research综合性能远超grok3-deep-search(39.46% vs 6.28%)。

- 仅支持浏览的模型:gpt-4o-search-preview、gpt-4o-mini-search-preview,这类模型综合准确率 10%~19%,处于中上游水平。

- 仅支持推理的模型:deepseek-r1-0528、gemini-2.5-pro、gemini-2.5-flash,综合准确率在 3%~9% 区间。

- 均不支持推理 + 浏览的模型:gpt-4.1、kimi-k2、deepseek-v3-0324 等,这类模型综合准确率位于 2%~8%,普遍较低。

05.总结

看到 AI 在 ScholarSearch 里表现拉胯,你可能会觉得 “AI 也不过如此”。但换个角度想:正因为有了这样严苛的基准,AI 的进步才有了明确方向。或许 AI 考得差,反而是好事。

ScholarSearch 的意义,远不止于“难住 AI”。它更像一个路标,告诉我们 AI 要成为真正的“学术助手”,下一步该往哪走:一个真正的研究模型必须超越简单的信息检索,还需要整合复杂的综合技术、上下文理解以及确保答案准确性的机制。

ScholarSearch 给 AI 的“学术能力”立了一把尺子。也许再过 3 年,当我们再用这份考卷测试 AI 时,它能像优秀研究员一样,从容地追文献、理逻辑、辨来源 —— 到那时,你熬夜查资料的日子,可能真的会少很多。

最后,如果你也喜欢这篇文章,那就点赞转发收藏吧~下一期继续为你带来实用干货,别忘了关注我们!

— 完 —

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录