命令行中与大模型对话

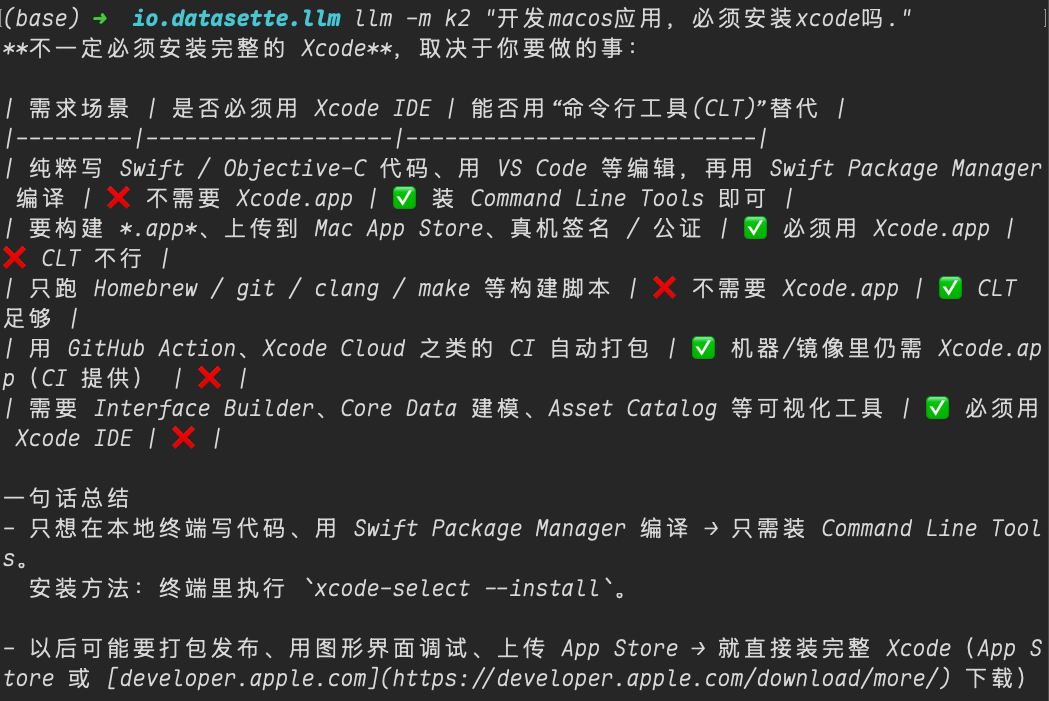

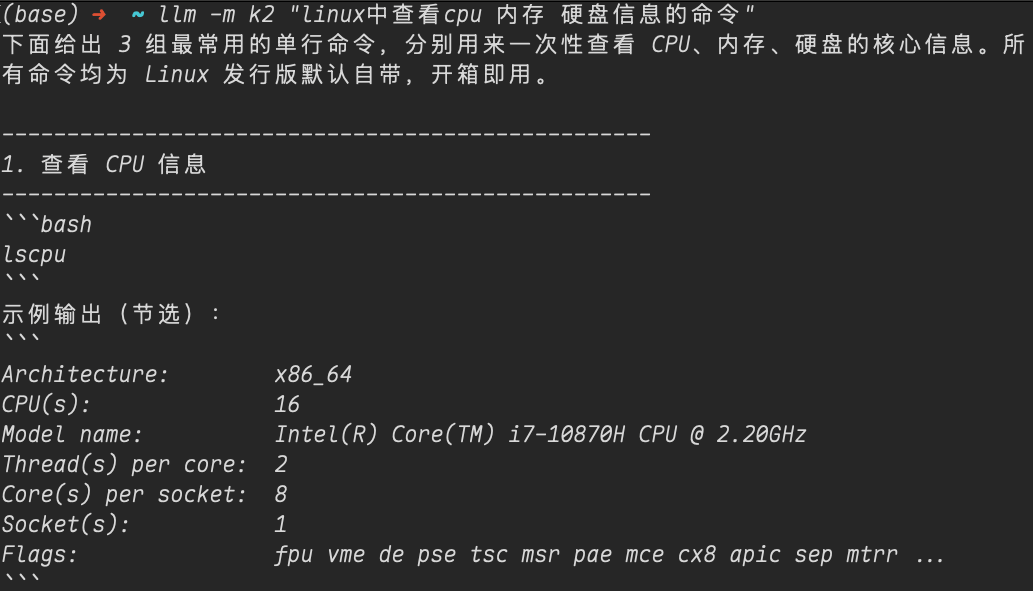

大家好,我是老章推荐一个有意思的可以在命令行与大模型对话的Python库 虽然各种code CLI工具很多,但是也不是什么问题都要去找Claude Code、Gemini CLI、Qwen Code这些烧钱的大家伙,有时候跑去网页端再粘回来也很麻烦,这个llm工具还是很有应用场景的。

LLM

LLM 是一款功能强大的命令行工具和 Python 库,可与 OpenAI、Anthropic 的 Claude、Google 的 Gemini、Meta 的 Llama 等众多大语言模型进行交互,支持通过远程 API 及在本地安装运行模型。

其功能丰富,如命令行运行提示、在 SQLite 中存储提示与响应、生成和存储嵌入、从文本和图像中提取结构化内容等。

安装 llm

安装最简单的方式:pip install llm

查看 llm 的用法:llm --help

prompt* 执行一个提示命令

aliases 管理模型别名

chat 与模型进行持续对话

collections 查看和管理嵌入集合

embed 对文本进行嵌入并存储或返回结果

embed-models 管理可用的嵌入模型

embed-multi 一次性为多个字符串存储嵌入...

fragments 管理数据库中存储的片段

install 从PyPI安装包到LLM所在环境

keys 管理不同模型的存储API密钥

logs 探索记录的提示和响应工具

models 管理可用模型

openai 直接与OpenAI API交互的命令

openrouter 与llm-openrouter插件相关的命令

plugins 列出已安装插件

schemas 管理存储的模式

similar 使用余弦相似度返回集合中前N个相似ID...

templates 管理存储的提示模板

tools 管理可供LLM使用的工具

uninstall 从LLM环境卸载Python包

配置 API

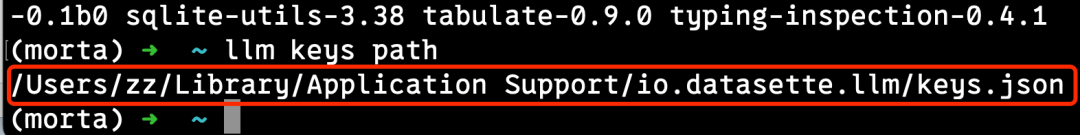

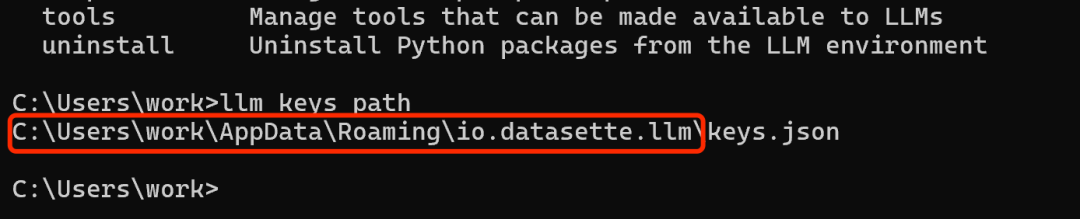

执行命令,查看配置文件及路径

llm keys path

macos中是

Windows 中是

在该目录中创建一个名为 extra-openai-models.yaml 的文件。

比如 Kimi

- model_id: kimi-k2-0711-preview

model_name: kimi-k2-0711-preview

aliases: ["k2"]

api_base: "https://api.moonshot.cn/v1"

api_key_name: moonshot

比如 DeepSeek

- model_id: deepseek-reasoner

model_name: deepseek-reasoner

aliases: ["r1"]

api_base: "https://api.deepseek.com/v1"

api_key_name: moonshot

大家举一反三吧,事实上所有 OpenAI API 格式的 API 都是兼容的

比如我常用的 Siliconflow

- model_id: moonshotai/Kimi-K2-Instruct

model_name: moonshotai/Kimi-K2-Instruct

aliases: ["k2"]

api_base: "https://api.siliconflow.cn/v1"

api_key_name: siliconflow

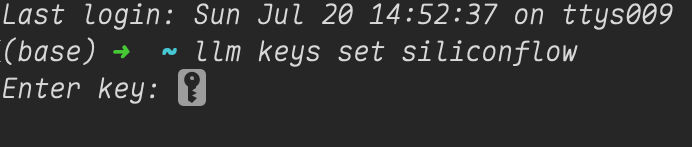

设置 API Key

上一步只是设置模型和 API 地址

这里还需要设置 Key

llm keys set [api_key_name]

把【api_key_name】替换成上一步中的名称即可

比如 llm keys set siliconflow

粘贴后 enter 即可

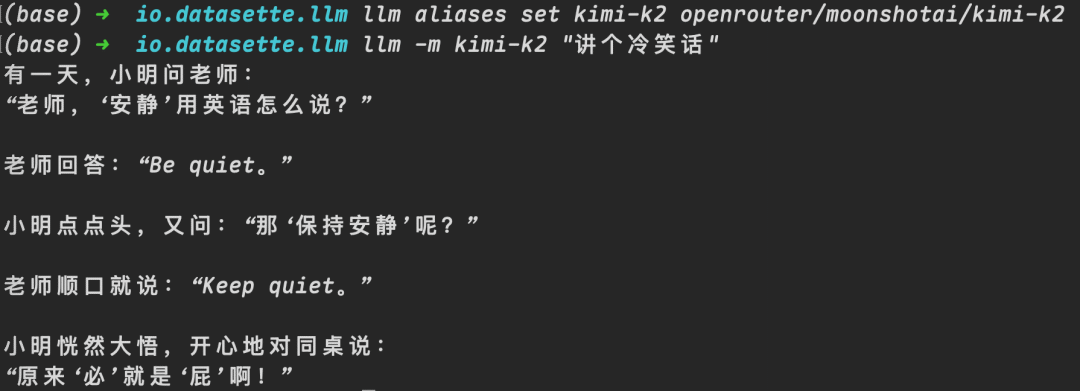

设置别名

配置 API 那一步,我们其实已经设置过别名了,就是 alias 那里

如果没有设置,事后也可以补

llm aliases set kimi-k2 openrouter/moonshotai/kimi-k2

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-24,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录