ollama安装初体验

ollama安装初体验

git clone firc-dataset

发布于 2025-07-16 17:49:02

发布于 2025-07-16 17:49:02

部署环境描述

硬件要求

- CPU:建议使用多核心处理器,特别是对于需要处理大量文本生成任务的情况。

- 内存:至少16GB RAM;根据模型大小和预期负载,可能需要更多内存(如32GB或更高)。

- GPU(可选但推荐):NVIDIA GPU 配备至少8GB显存,用于加速模型推理过程。推荐使用具有16GB或以上显存的专业级GPU。

- 存储:SSD硬盘以加快数据读取速度;考虑到模型文件较大,建议准备充足的存储空间,要求C盘空间可用>=10GB。

软件环境

- 操作系统:Linux 发行版(如Ubuntu 20.04 LTS 或更高版本),Windows 和 macOS 用户可以通过 WSL2 或虚拟机来运行 Linux 环境。

- Python:建议 Python 3.8 或更高版本,确保兼容最新的库和工具包

Ollama官网:https://ollama.com/,官方网站的介绍就一句话:Get up and running with large language models. (开始使用大语言模型。)下载直接双击安装即可,由于网络原因可能下载不了,这里也可以去国内aistudio.baidu.com/datasetdetail/314989下载。 Ollama是一个开源的 LLM(大型语言模型)服务工具,用于简化在本地运行大语言模型、降低使用大语言模型的门槛,使得大模型的开发者、研究人员和爱好者能够在本地环境快速实验、管理和部署最新大语言模型,包括如Qwen2、Llama3、Phi3、Gemma2等开源的大型语言模型。

安装后是默认路径:C:\Users\Administrator\AppData\Local\Programs\OllamaOllama大模型仓库

https://ollama.org.cn/library安装注意:

安装路径不可选只能被强制安装在 C:\Users\Administrator\AppData\Local\Programs\Ollama文件夹下面,占用空间5GB,需要您的C盘足够大。

Ollama配置服务端口 编辑环境变量

配置端口

变量名称:OLLAMA_HOST 值: 0.0.0.0:8080 配置大模型本地存储路径

变量名称:OLLAMA_MODELS 值:D:\ollama\models 访问端口允许跨域

变量名称:OLLAMA_ORIGINS 值:* 配置环境变量后重启Ollama

常见ollama 属性设置

我们在平时使用ollama过程中会遇到不少问题,比如模型镜像加载在C 盘有没有办法切换到其他盘符、启动ollama 只能127.0.0.1 不能使用IP 访问等问题。这些问题都是可以借助ollama 属性设置来解决。

1 OLLAMA_HOST=0.0.0.0 解决外网访问问题

2 OLLAMA_MODELS=E:\ollamaimagers 解决模型默认下载C 盘的问题

3 OLLAMA_KEEP_ALIVE=24h 设置模型加载到内存中保持24个小时(默认情况下,模型在卸载之前会在内存中保留 5 分钟)

4.OLLAMA_HOST=0.0.0.0:8080 解决修改默认端口11434端口

5.OLLAMA_NUM_PARALLEL=2 设置2个用户并发请求

6.OLLAMA_MAX_LOADED_MODELS=2 设置同时加载多个模型

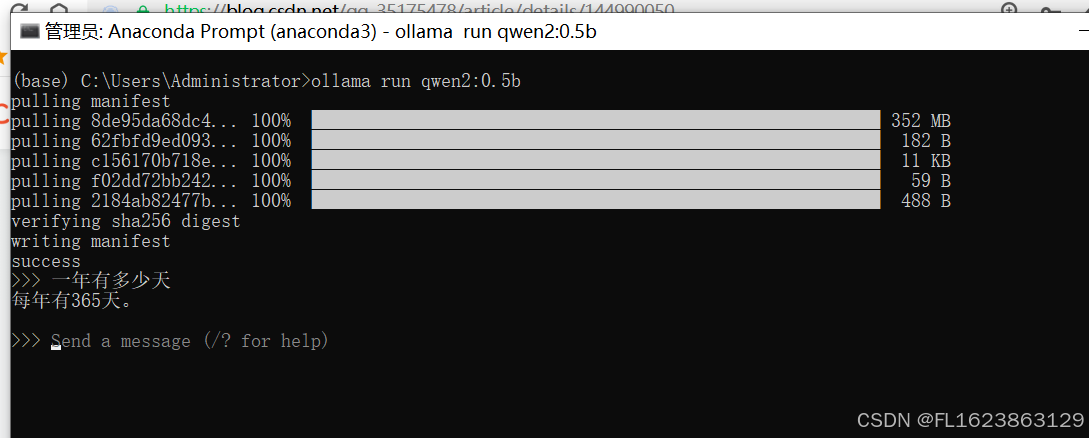

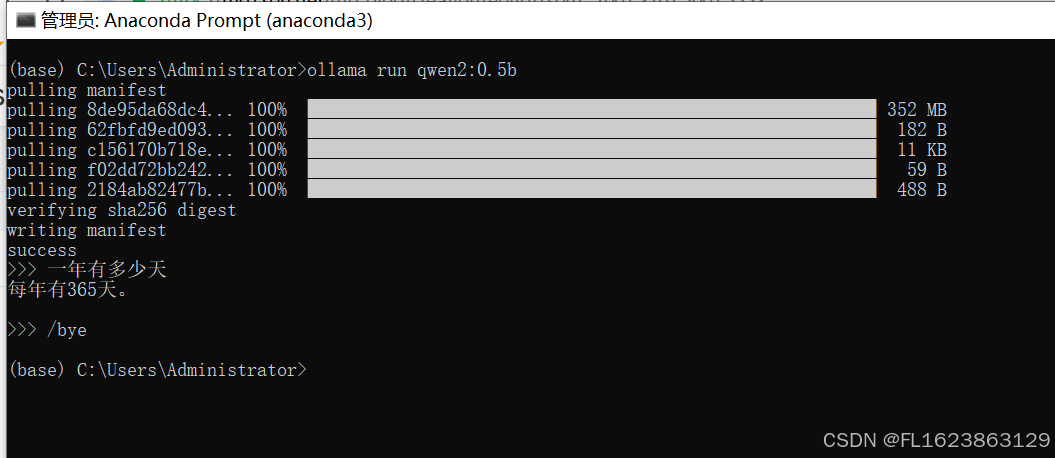

启动Ollama后安装启动本地大模型

ollama run qwen2:0.5b

退出 /bye

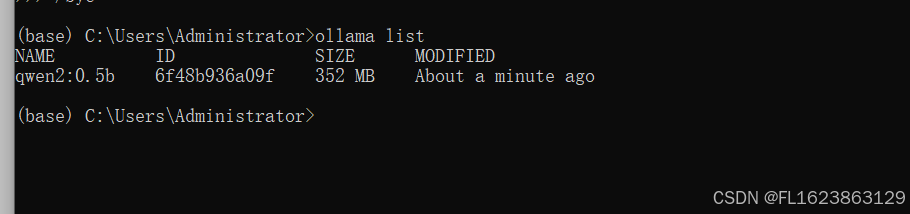

查看本地大模型

ollama list

查看帮助:

(base) C:\Users\Administrator>ollama --help

Large language model runner

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

stop Stop a running model

pull Pull a model from a registry

push Push a model to a registry

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

Use "ollama [command] --help" for more information about a command.模型操作命令

ollama serve:启动 Ollama 服务,是后续操作的基础。ollama create:从模型文件创建模型,适用于自定义模型或本地已有模型文件的情况。ollama show:显示模型信息,可查看模型架构、参数等详细信息,辅助模型分析。ollama run:运行模型,如ollama run qwen2,若本地无该模型会自动下载并运行,可用于快速测试模型。ollama pull:从注册表中拉取模型,如ollama pull llama3,方便获取官方或其他来源的模型。ollama push:将模型推送到注册表,便于共享模型。ollama list:列出本地已有的模型,方便管理和选择。ollama cp:复制模型,可用于备份或创建模型副本。ollama rm:删除模型,释放存储空间。ollama help:获取任何命令的帮助信息,方便用户快速查询命令用法。

Ollama 提供了用于运行和管理模型的 REST API。

(1). 生成响应

curl http://localhost:11434/api/generate -d '{

"model": "llama2",

"prompt":"Why is the sky blue?"

}'(2). 与模型交流

curl http://localhost:11434/api/chat -d '{

"model": "mistral",

"messages": [

{ "role": "user", "content": "why is the sky blue?" }

]

}'二、OpenAI 兼容性

注意: OpenAI 兼容性是实验性的,可能会有重大调整,包括破坏性更改。要完全访问 Ollama API,请查看 Ollama Python库、JavaScript库 和 REST API。

Ollama 提供了与 OpenAI API 部分功能的实验性兼容性,以帮助将现有应用程序连接到 Ollama。

1. 使用方法

(1). OpenAI Python库

from openai import OpenAI

client = OpenAI(

base_url='http://localhost:11434/v1/',

# 必需但被忽略

api_key='ollama',

)

chat_completion = client.chat.completions.create(

messages=[

{

'role': 'user',

'content': 'Say this is a test',

}

],

model='llama2',

)(2). curl

curl http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "llama2",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "Hello!"

}

]

}'本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2025-01-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录