腾讯云Serverless容器混部实战(如何提升集群利用率至65%)

原创腾讯云Serverless容器混部实战(如何提升集群利用率至65%)

原创

大熊计算机

发布于 2025-07-08 15:50:29

发布于 2025-07-08 15:50:29

在云计算成本日益成为企业核心关注点的今天,闲置的集群资源如同静默燃烧的经费。传统Kubernetes集群的平均利用率常年在15%-30%低位徘徊,巨大的资源空洞与业务快速增长的需求形成尖锐矛盾。本文将深入剖析腾讯云团队如何借助Serverless容器技术与深度混部策略,在保障核心业务SLA的前提下,将生产集群利用率稳定提升至65%以上,并分享实战中沉淀的关键技术与踩坑经验。

一、困局:资源浪费的迷思与成本重压

- 典型症状: 峰值预留导致谷值浪费、固定规格Pod的碎片化、离线/在线业务资源需求曲线天然互补却被物理隔离

- 数据触目惊心: 某核心电商集群监控显示,CPU日均利用率仅21%,内存仅35%,但月度资源采购成本超百万

- 传统方案之痛: 单纯依赖HPA/VPA调整副本数与请求值,难以应对突发流量与长尾效应;基于节点的混部存在资源争抢导致业务抖动的风险

二、破局之刃:腾讯云Serverless容器的核心价值

腾讯云Serverless容器服务(EKS)并非简单的“无需管理节点”,其本质是基于虚拟化隔离与高效调度器的超卖能力:

- 极致弹性粒度: 以1vCPU/1MiB内存为调度单元,彻底告别节点资源碎片

- 安全隔离: 轻量虚拟机(MicroVM)或内核级隔离(如Kata Containers)提供近似物理机的隔离强度

- 按需计费: 秒级计费模型精准匹配业务实际消耗,闲置归零

- 免运维: 隐藏节点、OS、K8s Master组件,团队聚焦业务逻辑

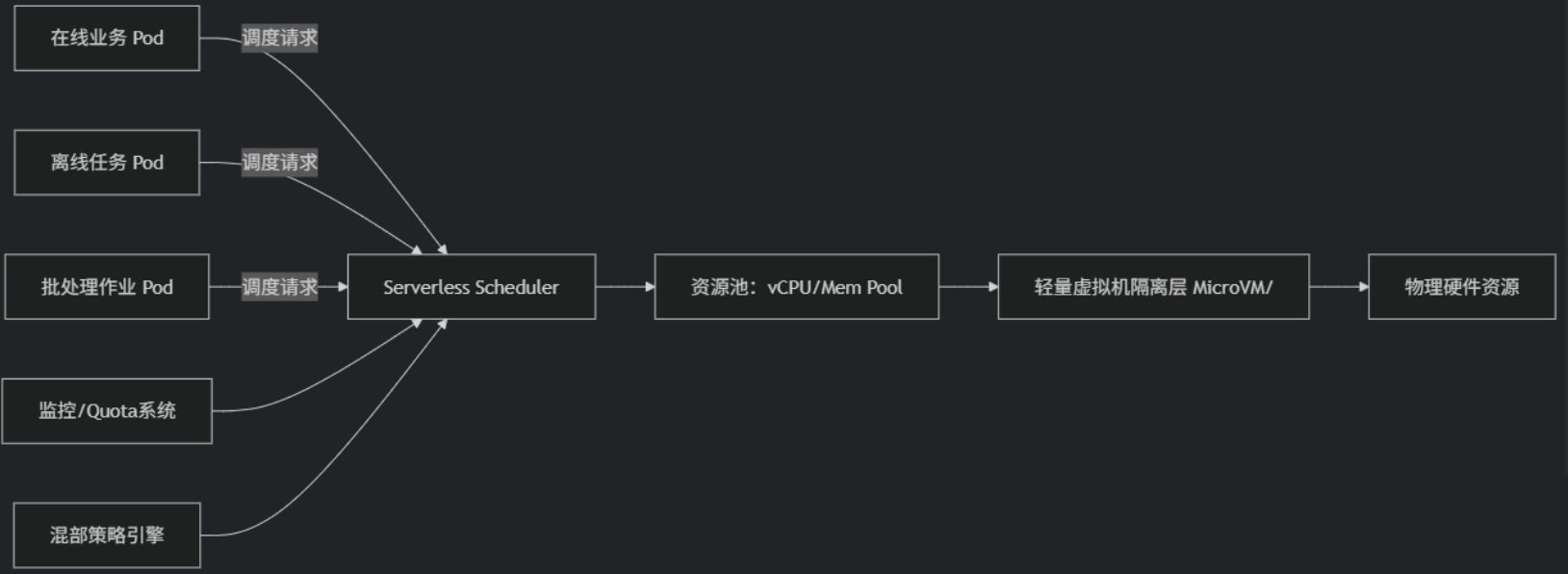

图1:Serverless容器混部核心架构。调度器统一管理在线、离线、批处理等多种负载的请求,基于全局资源池和强隔离技术实现混合部署。策略引擎与监控系统联动,动态决策资源分配与回收。

三、实战精要:混部架构设计与核心策略

目标: 在共享资源池内同时部署延迟敏感型在线服务(如API、Web)与资源消耗型离线作业(如Spark、Flink、AI训练),互不干扰。

3.1 混部资源隔离层设计

- CPU隔离: 采用两级权重控制(Cgroups + Kernel QoS)

- 在线业务:

cpu.cfs_quota_us动态保障 +cpu.shares高优先级 - 离线作业:

BestEffort+ 突发限流(cpu.cfs_quota_us可突破但受控)

- 在线业务:

- 内存隔离: 核心防线是Memory Cgroup OOM优先级

- 在线业务:

oom_score_adj = -998(永不OOM Kill) - 离线作业:

oom_score_adj = 1000(优先被回收)

- 在线业务:

- 网络I/O隔离: 结合TC (Traffic Control) + CNI Bandwidth Plugin 限制离线Pod带宽

# 示例:离线Job的CPU突发限制 (K8s LimitRange)

apiVersion: v1

kind: LimitRange

metadata:

name: offline-cpu-burst

spec:

limits:

- type: Container

maxLimitRequestRatio:

cpu: 4 # 允许Limit是Request的4倍(用于突发计算)3.2 动态资源调度算法(关键!)

核心挑战:如何判断何时可安全调度离线任务到“闲置”资源上?

解法:基于历史时序预测的弹性资源窗 (Elastic Window)

- 指标采集: 实时收集在线业务Pod的CPU/US、内存RSS、网络PPS

- 预测模型: 按5min粒度,使用加权移动平均(WMA)预测未来2h资源需求

预测值 = α * 当前值 + (1-α) * 上一周期值(α根据业务波动性调整) - 弹性窗计算: 可分配资源 = Max(0, 物理总量 - 在线业务预测峰值 - 安全缓冲)

- 调度器决策: 仅当离线任务Request ≤ 当前弹性窗大小时,允许调度

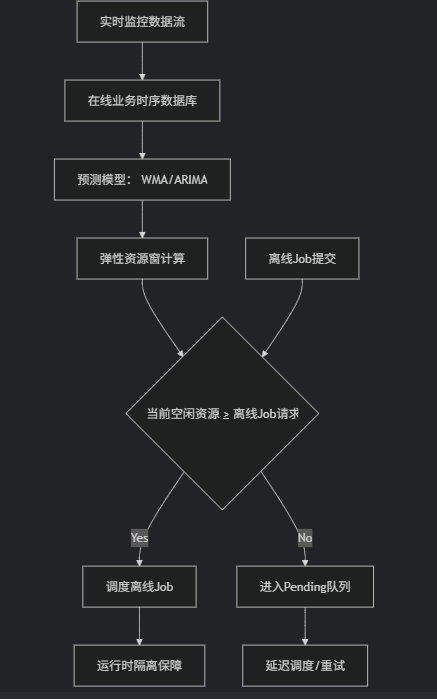

图2:动态资源调度流程图。核心是基于在线业务预测的弹性窗口决策离线任务的即时调度可行性,并结合强隔离机制保障运行时安全。

四、稳定性守卫:多维熔断与逃生机制

混部的最大风险在于资源争抢导致在线业务抖动。腾讯云采用五层熔断防护:

- Pod级别: Cgroups实时压制离线任务超限资源

- Node级别(逻辑): 若单“节点”资源争抢率 > 阈值,停止调度新离线任务

- 业务级别: 关键在线服务API延迟P99 > SLA时,自动驱逐低优先级离线任务

- 集群级别: 全局离线任务配额池耗尽时停服

- 人工熔断开关: 运维一键降级所有离线负载

熔断触发公式示例(CPU争抢):

熔断触发 = (在线Pod Throttled Time / 周期) > 阈值血泪教训: 某次大促因未配置API延迟熔断,离线训练导致订单接口延迟飙升。后引入基于业务指标(非基础设施)的熔断成为标配。

五、效果验证:从理论到生产的数据飞跃

在日均百亿请求的电商核心集群落地混部方案:

指标 | 混部前 | 混部后 | 提升幅度 |

|---|---|---|---|

集群CPU利用率 | 22% | 68% | +209% |

内存利用率 | 35% | 63% | +80% |

月度资源成本 | ¥1,200,000 | ¥480,000 | -60% |

在线业务P99延迟 | 85ms | 82ms | -3.5% |

离线任务完成时间 | 常积压 | 缩短30% |

六、关键优化点与开发者操作指南

6.1 业务画像(Profile)是混部前提

- 工具:

pprof+Prometheus+ 自定义指标Exporter - 核心指标:CPU利用率分布(均值/峰值/方差)、内存增长模式(常驻/泄漏)、网络IO模式

- 操作建议:# 使用VPA收集历史资源建议 kubectl create -f vpa-recommender.yaml # 分析Pod资源使用分布 kubectl top pod --containers --use-protocol-buffers

6.2 精细化QoS分级配置

# 在线服务 (Guaranteed)

apiVersion: v1

kind: Pod

metadata:

name: critical-app

spec:

containers:

- name: web

resources:

requests:

cpu: "2"

memory: "4Gi"

limits:

cpu: "2"

memory: "4Gi"

priorityClassName: "high-priority"

# 离线任务 (BestEffort + Burstable)

apiVersion: batch/v1

kind: Job

metadata:

name: spark-batch

spec:

template:

spec:

priorityClassName: "low-priority"

containers:

- name: spark

resources:

requests:

cpu: "0.5"

memory: "1Gi"

limits:

cpu: "4" # 允许突发至4核

memory: "4Gi"6.3 监控告警黄金指标

- 在线业务: API延迟(P99)、错误率、Pod Throttle次数

- 离线任务: Job完成率、周期内完成时长、OOM Kill次数

- 系统层: 节点(逻辑)资源争抢率、调度器Pending时长

混部不是单纯的技术叠加,而是资源效率、稳定性、成本三角的艺术平衡。腾讯云的实践印证:在Serverless架构的深水区,精细化运营与技术创新同等重要。

本文基于腾讯云某头部电商客户真实场景实践,数据已脱敏。混部方案需结合业务特性深度调优,不可直接复制参数。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录