DeepSeek-V3 新论文来了!通过硬件感知协同设计揭开低成本大型模型训练的秘密

DeepSeek-V3 新论文来了!通过硬件感知协同设计揭开低成本大型模型训练的秘密

AI在线工具

发布于 2025-06-20 11:36:42

发布于 2025-06-20 11:36:42

DeepSeek-V3 背后的团队最近发布了一篇 14 页的技术论文,DeepSeek 首席执行官梁文峰是合著者,阐明了“AI 架构硬件的扩展挑战和反思”。他们最初技术报告的后续行动深入探讨了大型语言模型 (LLM) 开发、训练和底层硬件基础设施之间的复杂关系。本文超越了 DeepSeek-V3 的架构细节,探讨了硬件感知模型协同设计如何有效解决当前硬件的局限性,最终实现经济高效的大规模训练和推理。

LLM 的快速扩展暴露了当前硬件架构中的关键瓶颈,尤其是在内存容量、计算效率和互连带宽方面。DeepSeek-V3 在 2048 个 NVIDIA H800 GPU 集群上进行了训练,是一个引人注目的案例研究,展示了模型设计和硬件考虑之间的协同方法如何克服这些限制。本研究的重点是硬件架构和模型设计在实现经济的大规模训练和推理方面的相互作用,旨在为在不影响性能或可访问性的情况下有效扩展 LLM 提供可作的见解。

本文的主要关注领域包括:

- 硬件驱动的模型设计:分析硬件特性(例如 FP8 低精度计算和纵向扩展/横向扩展网络属性)如何影响 DeepSeek-V3 中的架构选择。

- 硬件-模型相互依赖性:研究硬件功能如何塑造模型创新,以及 LLM 不断变化的需求如何推动对下一代硬件的要求。

- 硬件发展的未来方向:从 DeepSeek-V3 中汲取实用见解,指导未来硬件和模型架构的协同设计,以实现可扩展且经济高效的 AI 系统。

DeepSeek-V3 的设计原则:解决核心扩展挑战

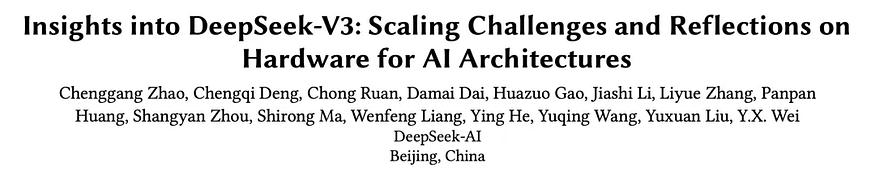

DeepSeek-V3 融合了几项关键的架构创新,如本文的图 1 所示,包括 DeepSeekMoE 架构和多头潜在注意力 (MLA)。这些设计直接解决了扩展 LLM 的核心挑战:内存效率、成本效益和推理速度。

内存效率:MLA 和 KV 高速缓存优化

LLM 的内存需求呈指数级增长,超过了 HBM 等高速内存的缓慢增长速度。虽然多节点并行提供了一种解决方案,但从源头优化内存使用仍然至关重要。DeepSeek 通过多头潜在注意力 (MLA) 解决了这一瓶颈,它采用投影矩阵将所有注意力头的键值 (KV) 表示压缩成一个更小的潜在向量,并与模型联合训练。在推理过程中,只需要缓存这个压缩的潜在向量,与为每个头存储完整的 KV 缓存相比,这大大减少了内存消耗。

除了 MLA 之外,DeepSeek 还强调了其他有价值的减少 KV 缓存大小的技术,为内存高效注意力机制的未来发展提供了灵感:

- 共享 KV (GQA;MQA):多个注意力头共享一组键值对,从而大大压缩了存储空间。

- 窗口 KV:限制 KV 缓存的上下文窗口。

- 量化压缩:降低存储的 KV 值的精度。

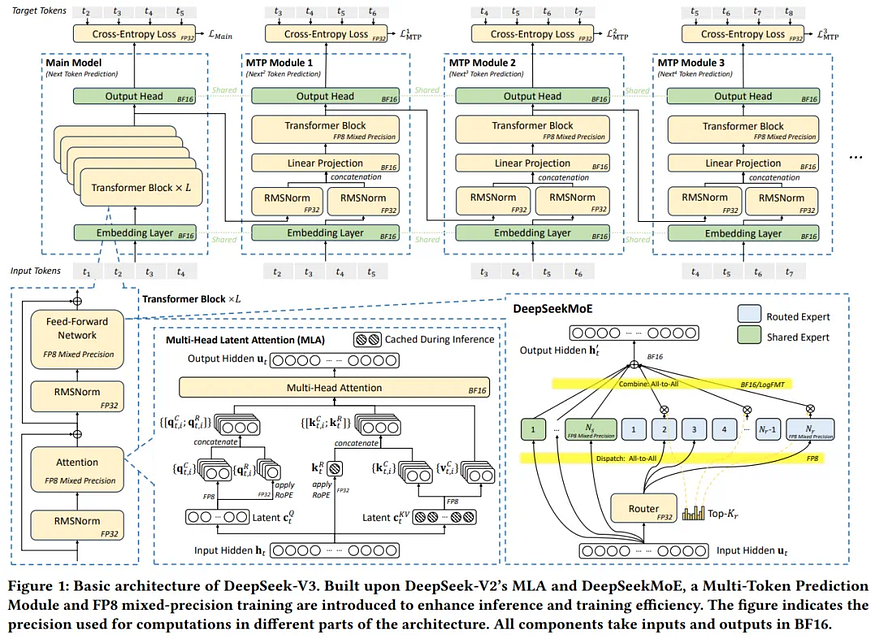

本文中的表 1 比较了 DeepSeek-V3 、 Qwen-2.5 72B 和 LLaMA-3.1 405B 的每令牌 KV 缓存内存占用。DeepSeek-V3 实现了显著的缩减,每个令牌只需要 70 KB,明显低于 LLaMA-3.1 405B 的 516 KB 和 Qwen-2.5 72B 的 327 KB。

成本效益:用于稀疏计算的 DeepSeekMoE

对于稀疏计算,DeepSeek 开发了 DeepSeekMoE,这是一种先进的专家混合 (MoE) 架构(图 1,右下角)。MoE 模型在成本效益方面具有两个关键优势:

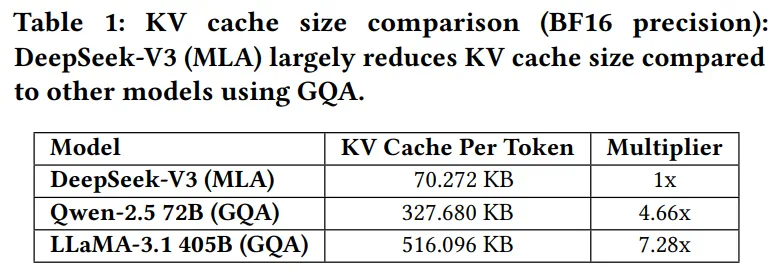

- 减少训练计算:通过选择性地激活每个令牌的专家参数子集,MoE 架构允许大幅增加参数总数,同时保持可管理的计算需求。例如,DeepSeek-V3 拥有 671B 参数,几乎是其前身 V2 (236B) 的三倍,但每个 Token 仅激活 37B 参数。相比之下,Qwen2.5-72B 和 LLaMa3.1-405B 等密集模型要求所有参数在训练期间都处于活动状态。表 2 表明,DeepSeekV3 实现了与这些密集模型相当或更好的性能,而计算成本降低了一个数量级(每个令牌约 250 GFLOPS,而 72B 密集模型为 394 GFLOPS,405B 密集模型为 2448 GFLOPS)。

- 个人使用和本地部署的优势:在 MoE 模型中选择性激活参数可显著降低单请求推理期间的内存和计算要求。例如,DeepSeek-V2(236B 参数)在推理过程中仅激活 21B 参数,在配备 AI SoC 的个人计算机上实现接近或高于每秒 20 个令牌 (TPS),这一能力远远超过同类硬件上类似大小的密集模型。这为在本地运行的个性化 LLM 代理提供了可能性。

增强的推理速度:重叠计算和通信

DeepSeek 优先考虑系统级最大吞吐量和单次请求延迟,以提高推理速度。为了最大限度地提高吞吐量,该模型从一开始就采用了双微批处理重叠架构,有意将通信延迟与计算重叠。

此外,DeepSeek 将 MLA 和 MoE 的计算解耦为不同的阶段。当一个微批处理执行 MLA 或 MoE 计算的一部分时,另一个微批处理同时执行相应的调度通信。相反,在第二个微批处理的计算阶段,第一个微批处理执行 combine 通信步骤。这种流水线方法实现了全对全通信与连续计算的无缝重叠,从而确保 GPU 的充分利用。在生产环境中,DeepSeek 采用预填充和解码分离架构,将大批量预填充和延迟敏感的解码请求分配给不同规模的专家并行组,从而在实际服务条件下最大限度地提高系统吞吐量。

本文还谈到了测试时间缩放对推理模型的重要性,并强调了高令牌输出速度在强化学习工作流程中的关键作用,以及对于减少长推理序列中用户感知的延迟的关键作用。因此,通过软硬件协同创新优化推理速度对于推理模型的效率至关重要。

低精度驱动设计:FP8 训练和 LogFMT

FP8 混合精度训练

虽然 GPTQ 和 AWQ 等量化技术显著降低了主要用于推理的内存需求,但 DeepSeek 率先将 FP8 混合精度训练用于大规模 MoE 模型。尽管 NVIDIA 的 Transformer 引擎支持 FP8,但 DeepSeek-V3 作为第一个利用 FP8 进行训练的公开大型模型,标志着重要的一步。这一成就是基础设施和算法团队密切合作以及广泛实验的结果,在保持模型质量的同时显著降低了计算成本,使大规模训练更加可行。图 1 说明了训练期间用于向前和向后传递的 FP8 精度。

用于高效通信的 LogFMT

DeepSeek 还对 DeepSeek-V3 架构中的网络通信采用低精度压缩。在 EP 并行期间,使用细粒度的 FP8 量化对 Token 进行调度,与 BF16 相比,通信量减少了 50%,从而显著缩短了通信时间。

除了传统的浮点格式之外,DeepSeek 还试验了一种称为 LogFMT-nBit (对数浮点格式) 的新型数据类型。

互连驱动设计:解决硬件限制

当前硬件架构及其约束

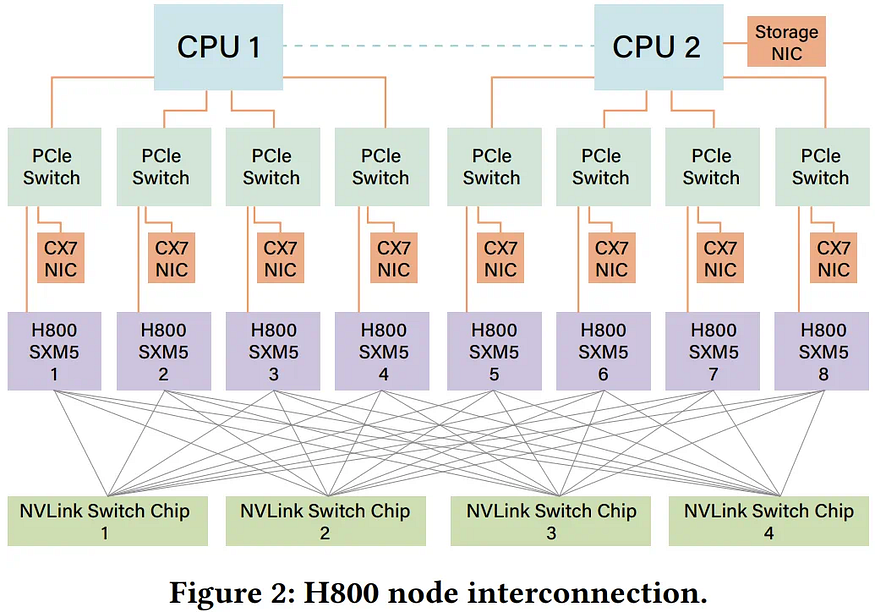

DeepSeek 目前使用 NVIDIA H800 GPU SXM 架构(图 2),虽然该架构基于类似于 H100 的 Hopper 架构,但由于监管要求,FP64 计算性能和 NVLink 带宽(从 H100 的 900 GB/s 降低 400 GB / s )降低。节点内扩展带宽的显著减少给高性能工作负载带来了挑战。作为补偿,每个节点都配备了 8 个 400G Infiniband (IB) CX7 网络接口卡 (NIC),以增强节点间扩展能力。

硬件感知并行化和模型协同设计

为了克服 H800 架构的局限性,DeepSeek-V3 模型整合了并行化的硬件感知设计注意事项,包括:避免张量并行 (TP)、增强管道并行 (PP) 和加速专家并行 (EP)。这些策略的具体细节可以在原始论文中找到。

模型协同设计的一个关键方面是 MoE 架构中 TopK 专家选择策略的 “节点感知路由” 。鉴于节点内(NVLink,~160 GB/s 有效速率)和节点间(IB,每个 NIC ~40 GB/s)通信之间的带宽差异约为 4:1,DeepSeek 设计了路由以利用更高的节点内带宽。通过将 256 名路由专家(在 8 节点、64 个 GPU 设置中每个 GPU 4 名)分为 8 组,每组 32 名专家,每组驻留在单个节点上,并在算法上确保每个令牌最多路由到 4 个节点,DeepSeek 缓解了 IB 通信瓶颈,提高了训练期间的有效通信带宽。发往同一节点上的专家的代币可以通过 IB 发送一次,然后通过 NVLink 转发,从而减少冗余的 IB 流量。

纵向扩展和横向扩展融合:未来的硬件方向

虽然节点感知路由减少了带宽需求,但 NVLink 和 IB 之间的带宽差异使通信密集型内核的实现变得复杂。目前,GPU 流式多处理器 (SM) 通过 NVLink 处理网络消息处理和数据转发,消耗大量计算资源。DeepSeek 主张将节点内(纵向扩展)和节点间(横向扩展)通信集成到一个统一的框架中。

集成专用协处理器以进行网络流量管理以及 NVLink 和 IB 域之间的无缝转发,可以降低软件复杂性并最大限度地提高带宽利用率。对动态流量重复数据删除的硬件支持可以进一步优化 DeepSeek-V3 的节点感知路由等策略。DeepSeek 还探索了新兴的互连协议,如超级以太网联盟 (UEC) 和超级加速器链路 (UALink),并指出统一总线 (UB) 是融合纵向扩展和横向扩展的最新方法。本文详细介绍了在编程框架级别实现这种融合的方法,包括统一网络适配器、专用通信协处理器、灵活的转发和广播/归约机制以及硬件同步原语。

带宽争用和延迟

当前硬件的另一个限制是在 NVLink 和 PCIe 上的不同流量类型之间动态分配带宽时缺乏灵活性。例如,在推理过程中将 KV 缓存数据从 CPU 内存传输到 GPU 可能会使 PCIe 带宽饱和,从而导致通过 IB 与 GPU 间 EP 通信争用,从而可能降低整体性能并导致延迟峰值。DeepSeek 建议的解决方案包括动态 NVLink/PCIe 流量优先级、I/O 小芯片集成以及纵向扩展域内的 CPU-GPU 互连。

大规模网络驱动设计:多平面 Fat-Tree

网络协同设计:多平面 Fat-Tree

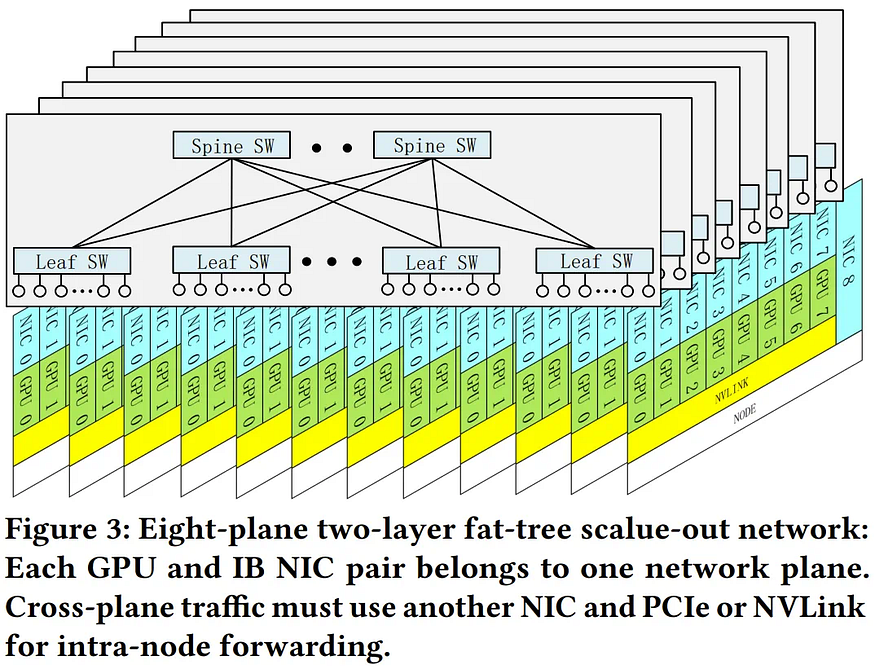

对于 DeepSeek-V3 训练,部署了多平面脂肪树 (MPFT) 横向扩展网络(图 3 )。每个节点配备 8 个 GPU 和 8 个 IB NIC,将每个 GPU-NIC 对分配给不同的网络平面。此外,每个节点都有一个 400 Gbps 以太网 RoCE NIC,该 NIC 连接到单独的存储网络平面,用于访问 3FS 分布式文件系统。横向扩展网络采用 64 端口 400G IB 交换机,理论上支持多达 16384 个 GPU,同时保留了两层网络的成本和延迟优势。但是,由于政策和法规的限制,实际部署涉及 2000 多个 GPU。

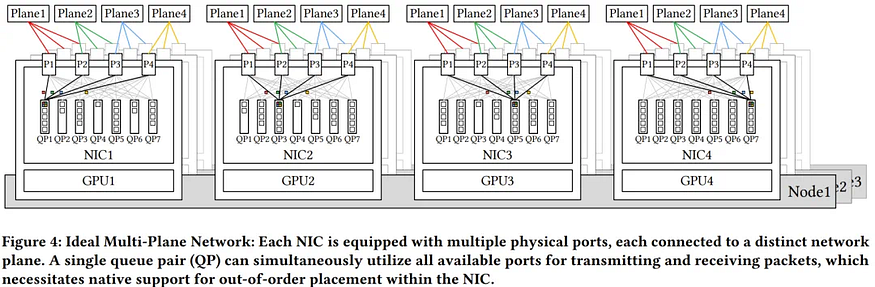

由于 IB ConnectX-7 的当前限制,部署的 MPFT 网络并未完全实现其预期的架构。理想情况下(图 4),每个 NIC 都有多个物理端口,每个端口都连接到一个单独的网络平面,但通过端口绑定作为单个逻辑接口呈现给用户。这将允许单个队列对 (QP) 在所有可用端口上无缝发送和接收消息,类似于数据包喷洒。NIC 中的本机无序布局支持对于确保消息一致性和正确的排序语义是必要的,因为来自同一 QP 的数据包可能会遍历不同的网络路径并无序到达。InfiniBand ConnectX-8 原生支持四个平面,未来完全支持高级多平面功能的 NIC 将显著有利于大型 AI 集群的两层胖树网络的可扩展性。总体而言,多平面架构在大型系统的故障隔离、稳健性、负载平衡和可扩展性方面具有显著优势。

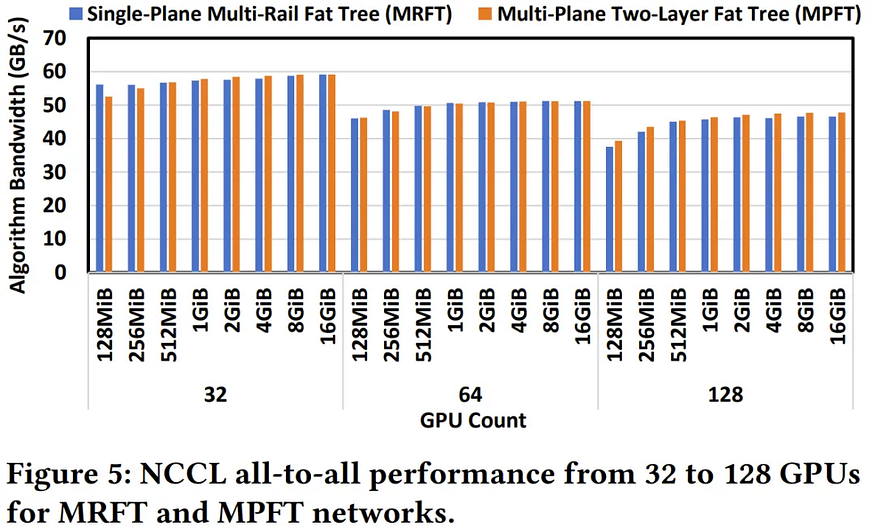

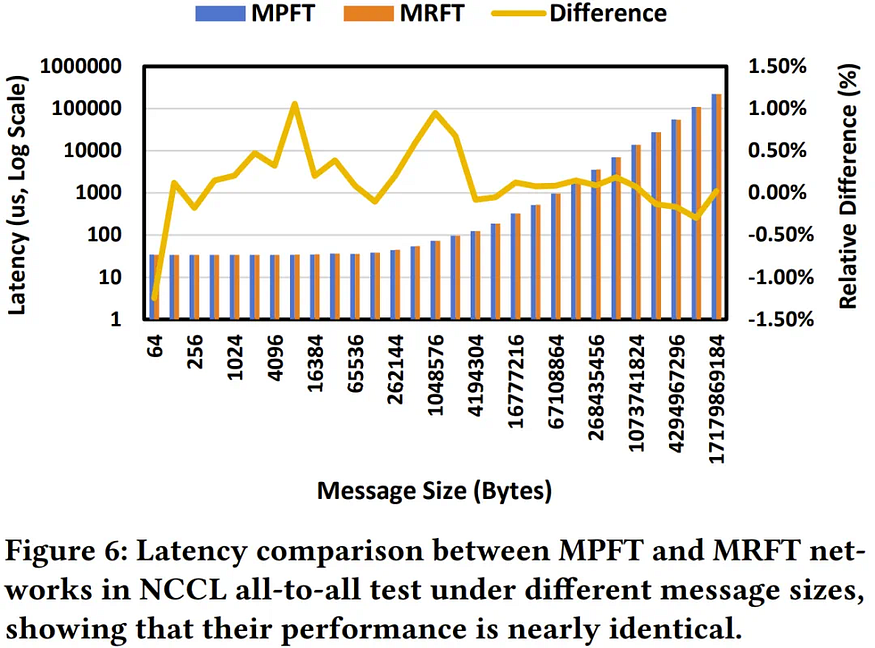

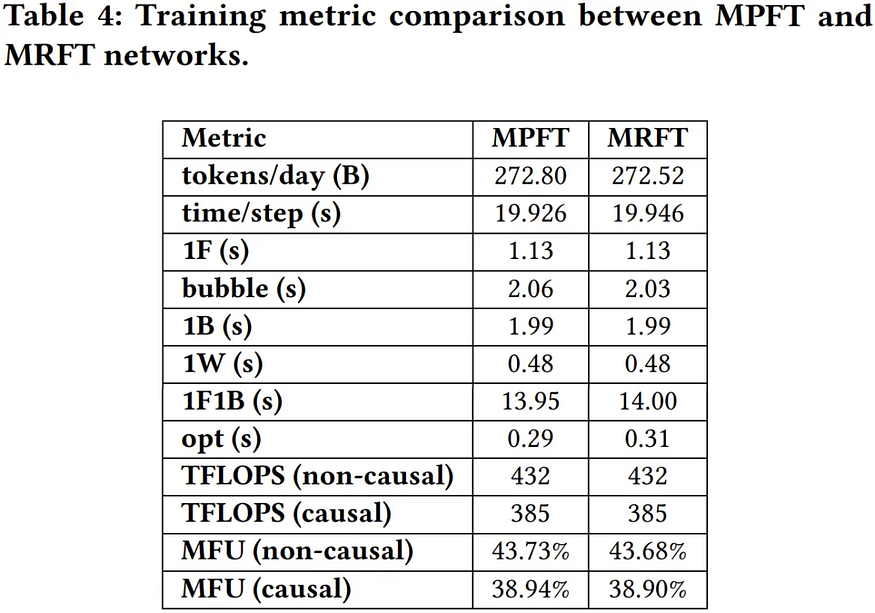

DeepSeek 强调了 MPFT 的几个优势,包括它作为多轨脂肪树 (MRFT) 的子集,允许无缝集成现有的 NVIDIA 和 NCCL 优化,以实现 MRFT 网络、成本效益、流量隔离、减少延迟和稳健性。比较 MPFT 和 MRFT 的性能分析(图 5 和 6,表 4)表明,多平面网络的多对多性能与单平面多轨网络非常相似,并且在 2048 个 GPU 上训练 V3 模型时,MPFT 和 MRFT 的性能几乎相同。

低延迟网络

在 DeepSeek 的模型推理中,大规模 EP 严重依赖 all-to-all 通信,这对带宽和延迟都很敏感。即使是微秒级的固有网络延迟也会显著影响系统性能。

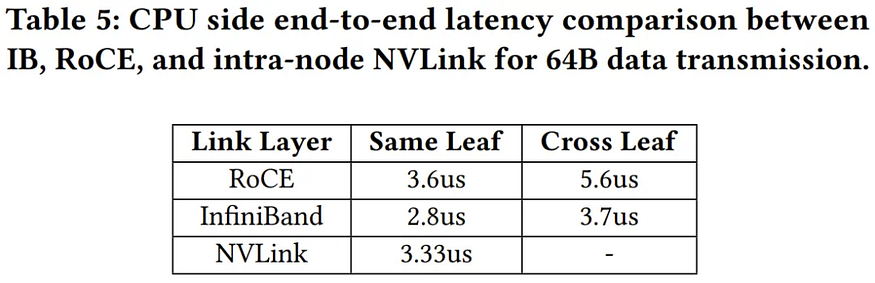

DeepSeek 分析了 IB 和 RoCE 的延迟特征(表 5),指出 IB 的延迟始终较低,因此更适合分布式训练和推理等延迟敏感型工作负载。虽然 RoCE 提供了一种可能具有成本效益的替代方案,但其当前的延迟和可扩展性限制使其无法完全满足大规模 AI 系统的需求。DeepSeek 为 RoCE 提出了具体的改进,包括专用的低延迟 RoCE 交换机、优化的路由策略以及增强的流量隔离或拥塞控制机制。

为了进一步降低网络通信延迟,DeepSeek 利用了 InfiniBand GPUDirect Async (IBGDA)。传统上,网络通信涉及 CPU 代理线程,这会带来额外的开销。IBGDA 允许 GPU 直接填充工作请求 (WR) 内容并写入 RDMA 门铃 MMIO 地址,从而消除与 GPU-CPU 通信相关的显著延迟。通过在 GPU 内管理整个控制平面, IBGDA 避免了 CPU 瓶颈,尤其是在发送大量小数据包时,因为 GPU 的并行线程可以分配工作负载。DeepSeek 的 DeepEP 和其他工作已经证明,使用 IBGDA 可以显著提高性能,这使得 DeepSeek 倡导在各种加速器设备上广泛支持此类功能。

对未来硬件架构设计的讨论和见解

基于已确定的硬件限制和特定应用环境中提出的解决方案,本文扩大了讨论范围,为未来的硬件架构设计提供了前瞻性的方向:

- 稳健性挑战:通过高级错误检测和纠正机制解决硬件故障和静默数据损坏问题,以构建不间断的 AI 基础设施。

- CPU 瓶颈和互连限制:优化 CPU 加速器协作,特别是打破 PCIe 等传统接口的限制,实现高速、无瓶颈的节点内通信。

- AI 智能网络:使用共同封装的光学器件、无损机制和自适应路由等技术创建低延迟和智能网络,以处理复杂的通信需求。

- 内存语义通信和排序:解决当前内存语义通信中的数据一致性和排序挑战,探索硬件级内置保障,提高通信效率。

- 网络中的计算和压缩:将计算和压缩功能卸载到网络中,特别是对于 EP 等特定工作负载,以释放网络带宽潜力。

- 以内存为中心的架构创新:解决指数模型扩展导致的内存带宽危机,探索 DRAM 堆叠和晶圆级集成等尖端技术。

本白皮书深入探讨了这些领域中的每一个,提供了具体的见解和建议,强调了硬件和软件之间需要一种整体协同设计方法,以实现大规模 AI 的持续进步和可访问性。

总之,本技术报告对 DeepSeek-V3 开发和训练过程中遇到的挑战和解决方案提供了宝贵的见解。通过仔细分析模型架构和硬件限制之间的相互作用,DeepSeek 为 AI 基础设施的未来提供了一个令人信服的愿景,强调了硬件感知协同设计在实现经济高效且可扩展的大型语言模型方面的关键作用。该论文详细探讨了 MLA、DeepSeekMoE、FP8 训练、LogFMT 和 MPFT 网络等技术,并提出了对硬件开发的前瞻性建议,为大规模 AI 研究和工程领域做出了重大贡献。

论文原件查询:DeepSeek-V3

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录