超大型智算中心(AIDC)的应用场景及关键技术

超大型智算中心(AIDC)的应用场景及关键技术

霞姐聊IT

发布于 2025-05-30 08:11:12

发布于 2025-05-30 08:11:12

超大型智算中心是拥有几千上万张、甚至十万张加速卡,总算力可达几百PFLOPS~EFLOPS级别的智算中心。

中国已有多个由超大型智算中心,比如:

²上海商汤临港人工智能计算中心可提供14 EFLOPS算力,加上其它全国各地可统一调度数据节点,共有5.4万GPU、可提供20 EFLOPS算力。

²中国移动智算中心(呼和浩特)部署约2万张AI加速卡,可提供6.7EFLOPS 算力。

²中国电信智算中心(南京)已建成算力规模2EFlops,2025年底算力规模可达5EFlops

²中国联通长三角(芜湖)智算中心总规划算力为3EFLOPS算力。

²首个国产万卡集群:科大讯飞智算平台“飞星一号”,以及正在打造的“飞星二号”

以A100 GPU卡为例,一张卡卖10万人民币,1万张卡就需要10亿人民币。再算上机房建设费用,网络、安全等硬件设施投入,每天的电力消耗、运维等人力成本等更是一笔极大的投资。

那么为什么需要这么大规模的智算中心呢?这主要是因为AIGC(生成式AI)产业的驱动(我觉得政府的牵引的动力也在于看到了AIGC对经济竞争力提升的重要性)。

2024年,AIGC已经走进营销、金融、医疗、制造等多个领域,产生了和大众息息相关的技术产品,比如数字人、智能汽车等,并且应用场景和商业机会还在增加。

AIGC是建立在大模型的基础之上的,而大模型是建立在算力等基础设施的基础之上的。

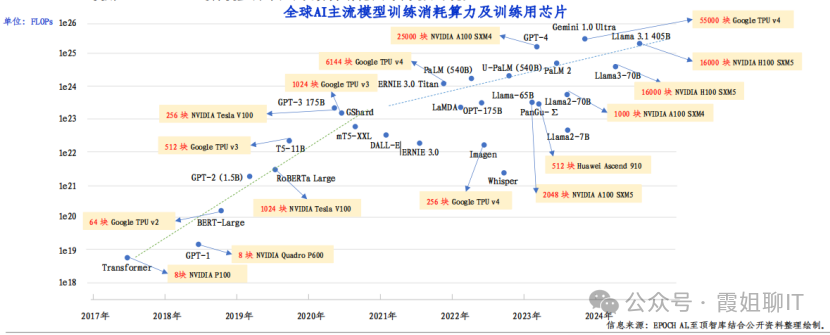

根据OpenAI在2020年提出的Scaling Law(规模法则),随着训练数据、模型大小和算力的增加,大语言模型的性能会有所提升。

因此,如果想得到性能好、质量高的模型,那么需要大量的算力投入。

尽管近年DeepSeek的出现提供了降低了AI训练成本的算法层思路,但是业界认为Scaling Law并未失效,而是从单一的暴力堆算力模式转变成为“算力-算法-场景”协同进化的模式。

这也是为什么国内国外科技巨头、运营商都在建超大型智算中心的动力所在。

超大型智算中心平时都在做什么呢?超大型的智算中心的主要用户是大型互联网、运营商、大模型公司,主要业务分成两类:1.基础大模型的预训练2. 面向海量消费者用户(ToC)的推理。

为了承载这两类业务,超大型的智算中心需要做到3点,达成极致算效和极致能效的效果:

1.提高算力集群的有效算力,提升基础模型预训练效率,缩短训练时间。

2.关注ToC推理的Latency时延、Accuracy准确率、Concurrency吞吐并发能力、Effciency算力使用效率。

3.高效率、高密度、高弹性、高可靠的能源基础设施。

评价一个超大型智算中心也正是围绕算效和能效这两个角度来评估的:

训练算效 | 算力规模(PFLOPS) | 基于FP16计算 |

|---|---|---|

算力利用率(%) | MFU:Model FLOPS Utilization模型的实际利用算力/集群理论能力 | |

故障恢复时间(min) | 训练任务由故障状态转为工作状态时的修复时间 | |

MTBF(天) | 平均故障间隔 | |

推理算效 | TTFT(ms或s) | Time To First Token (TTFT): 首 Token 延迟,即从输入到输出第一个 token 的延迟。 |

TBT(ms或s) | 生成连续输出Token之间的平均时间间隔 | |

精度(%) | 正确回答的比例 | |

吞吐(Tokens/s) | 单位时间内能够处理的请求数量或者能够生成的结果数量 | |

能效 | PUE | DC的总电量÷IT设备用电量 |

提升训练算效的关键技术有:

1、从Scale-up和Scale-out两个维度提升集群算力规模。

Scale-up:通过高速总线将数百颗AI芯片连接在一起组成超节点形态服务器。

Scale-out:是通过超高速、超大规模的组网架构来提升整体算力规模。

2、从单机和集群两个角度提升集群算力利用率

采用算子融合(FlashAttention、LayerNorm、RMSNorm等)、优化算子与硬件的适配性等软硬件协同技术优化单机效率;

采用FSPF架构亲和并行策略、高速总线、算网协同 NSLB 等技术提升集群扩展的线性度。

利用好DPU,释放CPU、GPU压力,支撑集群发挥更大性能。

3、延长MTBF、缩短MTTR、缩短CKPT备份间隔时间,提升集群可用性。

延长MTBF(平均无故障时间)的方法:冗余容错设计、训前压测检查、故障智能预测等

缩短MTTR(故障恢复时间)的方法:故障感知、任务调度、CKPT加速、计算加速、集合通信加速等

缩短CKPT(检查点CheckPoint)备份间隔时间的方法:异步CKPT保存、本地缓存加载CKPT等。

提升推理算效的关键技术有:

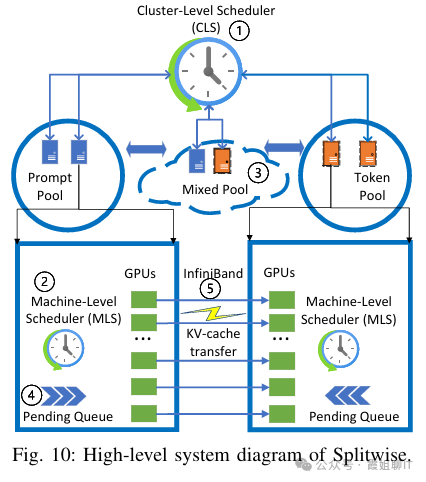

1、以 KV Cache 为中心的 P(refill)/D(ecoding) 分离式推理技术

Prefill预填充阶段:将处理用户输入的提示(Prompt)、生成初始的键值对缓存KV Cache。属于计算密集型,可采用高算力的GPU等加速设备、限制BatchSize的大小等方法优化性能。

Decoding阶段:根据Prefill阶段生成初始输出Token和KV缓存、逐步生成完整的输出文本。属于显存密集型,可采用低算力大显存的GPU等加速设备、增大BatchSize大小等方法优化性能。

将他们分离,可以减少相互之间的影响,以便对两个阶段分别进行优化,提升硬件的利用率,减少推理延迟,提升推理吞吐率。

2、KV Cache多级缓存,提升超长序列模型的推理效率

KV Cache需要的显存空间和序列长度成正比,因此当序列长度过长时,会导致GPU等AI加速设备的内存瓶颈,并延长了推理时间。

通过分级缓存,比如显存-内存(DRAM)-存储(SSD等)三级缓存,实现KV cache动态分层存储。分级缓存架构能能显著扩展模型能处理的上下文长度,加速LLM推理。

3、多机并行推理,提升超大参数和多模态大模型的推理效率

架构层面:节点间通过高性能网络RoCE或者IB连接增强整体通信效率;节点内AI加速设备需保证高速的数据交换。

实施分布式并行推理技术,并采取优化手段(自动混合并行算法、应用负载感知的 MoE动态调度、通算融合)缓解由模型参数量庞大和多模态特性所带来的计算和内存压力,从而提高推理性能。

随着AIGC产业的持续扩张,智算中心将不仅是推动经济竞争力提升的核心引擎,更是解决复杂社会问题、探索未知领域的关键工具。超大型智算中心正以其强大的算力和高效能效撑着人工智能的飞速发展,从基础大模型的预训练到海量用户的推理服务,为人类社会的智慧化转型提供源源不断的动力。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-04-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读