VideoScene:以三维感知跳跃流蒸馏策略破局,高效弥合从Sparse视图到三维场景的差距!

VideoScene:以三维感知跳跃流蒸馏策略破局,高效弥合从Sparse视图到三维场景的差距!

未来先知

发布于 2025-05-27 11:07:37

发布于 2025-05-27 11:07:37

从Sparse视图中恢复三维场景是一项具有内在病态问题的挑战性任务。传统方法已开发出专门的解决方案(例如几何正则化或前馈确定性模型)来缓解这一问题。 然而,当输入视图之间存在微小重叠且视觉信息不足时,这些方法仍会面临性能下降的问题。 幸运的是,最近涌现的视频生成模型在这一挑战上展现出潜力,因为它们能够生成具有合理三维结构视频片段。借助大型预训练视频扩散模型,一些开创性研究开始探索视频生成先验的潜力,并从Sparse视图中创建三维场景。 尽管取得了令人印象深刻的改进,但这些方法仍受限于缓慢的推理时间和缺乏三维约束,导致效率低下和与真实世界几何结构不符的重建伪影。 在本文中,作者提出了VideoScene,旨在将视频扩散模型蒸馏为一步生成三维场景,以构建一个高效且有效的工具,弥合从视频到三维的差距。具体而言,作者设计了一种三维感知跳跃流蒸馏策略,以跳过耗时冗余信息,并训练一个动态去噪策略网络,以在推理过程中自适应地确定最佳跳跃时间步长。 大量实验表明,作者的VideoScene比以往的视频扩散模型实现了更快、更优的三维场景生成结果,突显了其作为未来视频到三维应用高效工具的潜力。项目页面:https://hanyang21.github.io/VideoScene。

1. 引言

高效三维重建的需求正迅速增长,这得益于其实时游戏[83]、自主导航[1]等领域的应用[57, 97]。NeRF[59]和3DGS[35]等技术开创了高质量、密集视点重建,并在真实场景生成中展现出令人印象深刻的性能。然而,这些方法通常需要大量专业拍摄的图像,限制了其可及性[84]。为克服这一限制,研究行人开始探索从Sparse视点进行三维重建[13, 84, 95, 99],将输入要求降低至仅需两张随意拍摄的图像。

以往研究已发展出多种专门方法来应对Sparse视图重建的挑战,例如用于Sparse输入的几何正则化技术[70, 95]以及经过训练以从少量图像中生成三维场景的前馈模型[13, 17]。尽管这些方法能在相邻视点处产生合理的场景级结果,但它们难以克服Sparse视图重建的欠约束特性,即需要从有限的视觉信息中推理复杂的3D结构[22]。视图的稀缺性使得完整且连贯的3D场景难以恢复。因此,需要能够整合最少视觉信息并生成合理缺失细节以重建逼真三维几何的方法。

视频生成模型[11, 30, 94, 96]的最新进展带来了新的希望,因为这些模型能够生成具有合理三维结构的序列。利用大型预训练视频扩散模型,早期研究探索了使用视频生成先验从Sparse视图中创建三维场景。尽管取得了这些进展,当前模型仍面临重大局限性,特别是在两个方面:

(1)推理时间长,因为视频扩散模型需要多次去噪步骤才能从纯噪声输入生成高质量视频,使其效率远低于许多前馈方法;

(2)缺乏三维约束,因为这些模型在二维视频数据上训练,专注于RGB空间和时间一致性,而不是稳定的几何三维结构。结果,生成的视频往往缺乏空间稳定性和不准确的相机几何,导致重建伪影,阻碍了它们在实际三维应用中的有效性。

这促使作者构建一个高效且有效的工具,以弥合从视频到三维的差距。

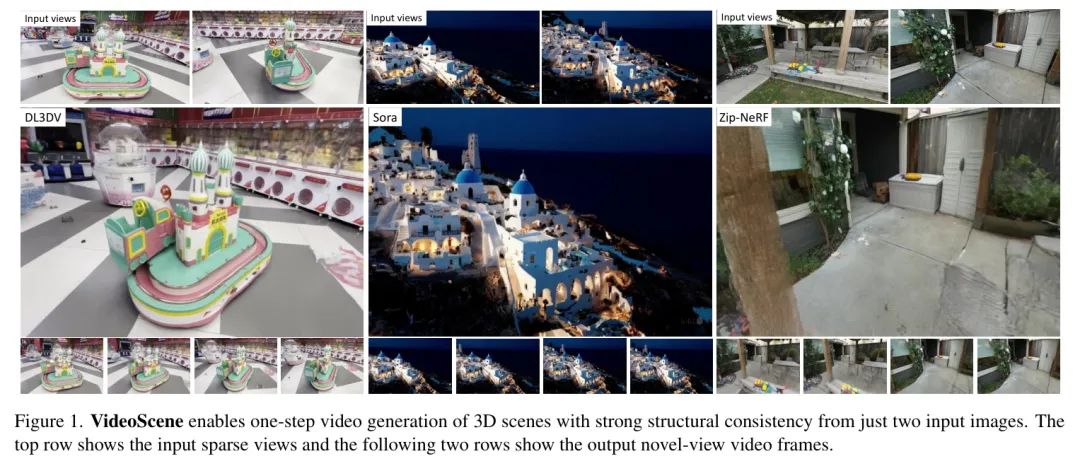

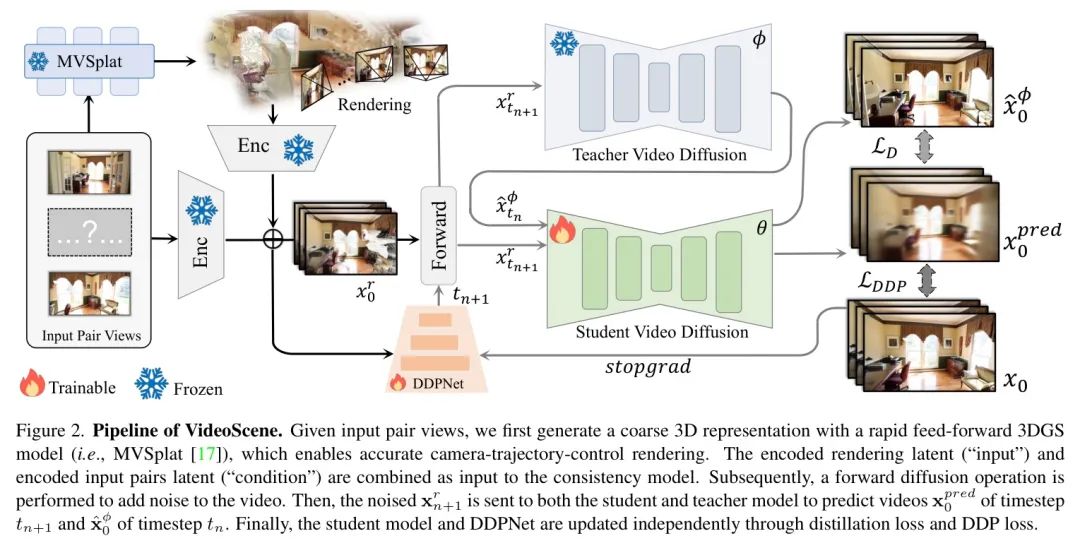

在本文中,作者介绍了VideoScene,一个用于高效、单步生成3D场景的新型视频蒸馏框架。llm-VideoScene_2504通过减少冗余信息——例如动态运动和物体交互——来优化视频扩散模型,从而解决传统扩散步骤的低效问题,提升3D一致性。作者发现主要 Bottleneck 源于传统去噪方法中纯噪声的低信息起点,这使得蒸馏过程缓慢且不稳定。为此,作者提出了一种3D感知跳跃流蒸馏策略,以跳过耗时的去噪阶段。具体而言,作者首先提供两张输入图像及其对应的相机姿态(也可以通过COLMAP [67] 或 DUSt3R [86] 进行估计)。作者关注图像对主要有两个原因。首先,单目3D重建本质上是不适定的;使用两张图像可以在不同视角的射线之间进行三角测量,从而实现更鲁棒的3D估计。其次,双视图几何是多视图几何的基本构建模块,可以扩展到完整的多视图重建。然后,作者使用一种快速、前馈的Sparse视图3DGS模型 [17] 生成一个粗糙但3D一致的场景,沿插值相机路径渲染帧。

这个初始的3D感知视频建立了一个强大的先验知识,指导后续的扩散步骤,使作者能够跳过不确定阶段,专注于一致性蒸馏中的确定性目标场景[75]。此外,作者开发了一个动态去噪策略网络(DDPNet),该网络能够在推理过程中自适应地选择最优的跳跃时间步长。该策略最大化了3D先验知识的使用,在添加噪声与保留信息之间取得平衡,从而在不牺牲质量的前提下提高了效率。大量实验表明,VideoScene在保真度和速度方面均优于现有的视频扩散方法,涵盖了多个真实世界数据集[7, 11, 45]。VideoScene作为一种通用的即插即用工具,在从视频生成模型中进行3D场景重建的未来应用中展现出巨大潜力,如图1所示。总之,作者的主要贡献包括:

作者介绍了VideoScene,一个新颖的视频蒸馏框架,该框架通过蒸馏视频扩散模型,实现一步生成3D场景。

作者提出了一种3D感知的跳跃流蒸馏策略,通过提供3D先验约束来跳过低信息步骤。

作者设计了一个动态去噪策略网络,通过将上下文 bandit 学习集成到蒸馏过程中来决定最优跳跃步长。

大量的实验表明,作者的VideoScene在多种真实世界数据集上,无论在质量还是效率方面,都优于当前方法。

2. 相关工作

视频生成。高效且高质量的视频生成已成为近期研究中的热门课题。早期方法[4, 23, 69, 81]主要依赖生成对抗网络(GANs),但往往导致生成质量低下且难以泛化到未见过的领域[9]。随着文本到图像生成中扩散模型的兴起,近期研究[8, 29, 30, 85, 88, 90, 92, 96]探索了基于扩散的文本到视频(T2V)生成的潜力,并取得了显著成果。部分方法[9, 85]专注于生成时序一致的视频,将时序模块融入二维UNet架构,并在大规模数据集上进行训练。许多研究还探索了图像条件视频合成。图像到视频(I2V)扩散模型,如DynamiCrafter[94]、SparseCtrl[26]和PixelDance[102],在视频插值和过渡等任务中展现出强大的通用性。随着数据集的持续增长,基于DiT(基于Transformer的扩散模型)的SORA类视频生成模型[11, 62]相较于早期的UNet模型[8, 15, 25]显示出明显优势。这些模型提供了增强的表达能力、改进的视觉质量和有效的多模态集成。通过这些改进,它们实现了接近生产级的性能,并展现出强大的商业应用潜力。

一致性模型。扩散模型[28, 64, 71, 74]在各种生成任务中展现了强大的性能。然而,由于需要大量推理步骤,它们面临速度 Bottleneck 。为解决这一问题,研究行人提出了多种解决方案,包括常微分方程求解器[54, 71]、自适应步长求解器[32]、神经算子[104]和模型蒸馏[37, 58, 65, 66]。在这些方法中,一致性模型[75]显示出特别的潜力。基于概率流常微分方程(PF-ODE),一致性模型被训练将生成过程中的任意一点映射回起点,或原始干净图像。这种方法支持单步图像生成,同时不损失多步迭代采样的优势,从而实现高质量输出。一致性模型可以通过两种方式推导:要么通过从预训练的扩散模型进行蒸馏(即一致性蒸馏),要么通过从头直接训练(即一致性训练)。基于这一框架,LCM[55, 56]进一步探索了在潜在空间中的一致性模型,以减少内存消耗并提升推理效率。后续方法[24, 53, 73]也对这些效率改进进行了优化,取得了令人印象深刻的结果。

在三维重建中,NeRF [59] 和 3DGS [35] 等方法通常需要数百张输入图像进行逐场景优化,这在实际应用中对普通用户来说并不实用。近期研究 专注于开发前馈模型,仅从少量输入图像直接生成三维表示。pixelSplat [13] 设计了像素对齐特征用于3DGS重建,利用极线 Transformer 更好地提取场景特征。随后,MVSplat [17] 引入多视角特征提取和代价体积构建,以捕获跨视角特征相似性用于深度估计。逐视角深度图被预测并重新投影到三维空间形成高斯中心,以更快的方式生成高质量三维高斯。尽管这些模型可以从提供的视角生成高度逼真的图像,但它们往往难以在有限视角无法看到的区域渲染高质量细节。为应对这一挑战,许多研究 [16, 47, 51, 76, 100] 采用了大规模视频扩散模型,从Sparse输入生成伪密集视角,旨在为欠约束Sparse视角重建转移泛化能力。然而,扩散模型中多步去噪的低效性会减慢这些方法的速度,且生成的视频往往缺乏三维约束,导致结构不一致和运动不真实。为解决这些局限性,作者提出了VideoScene框架,该框架使用三维感知跳跃流蒸馏来整合三维先验知识,实现一致的三维视频生成,同时通过单步扩散去噪加速快速高质量生成。

3. 方法

3.1. 预备知识

通过将引导反向扩散过程解释为求解增强概率流常微分方程(PF-ODE)[54, 74],一致性模型[75]提供了一种生成方法,该方法通过直接将噪声映射到PF-ODE轨迹的初始点(即PF-ODE的解)来支持高效的一步或多步生成。这种映射通过一致性函数实现,该函数定义为f : ,其中是一个固定的较小正数,是当前的去噪步骤,表示带噪声的输入。一致性函数应满足的一个重要自洽性属性可以表述为:

其中 表示整体去噪步骤。该性质确保函数输出在定义区间内的不同去噪步骤中保持一致。一致性函数被参数化为深度神经网络 ,其参数 通过一致性蒸馏进行学习。蒸馏目标是最小化随机相邻数据点之间的输出差异,从而确保概率意义上的自洽性。形式上,一致性损失定义如下:

其中 表示应用于PFODE的一步常微分方程求解器,模型参数 来自于 的指数移动平均(EMA),而 是用于测量两个样本之间距离的所选度量函数。在此处, 是从 对 的估计。

LCM [55] 在潜在空间中执行上述一致性优化,并在公式3中应用无分类器引导[27]来注入控制信号,例如文本 Prompt 。 通过一致性蒸馏中的教师模型和常微分方程求解器进行估计。对于训练良好的一致性模型 ,作者可以通过从初始分布 中采样,然后评估一致性模型 来生成样本。理想情况下,这仅涉及一次通过一致性模型的前向传递,因此可以在单步中生成样本。

3.2. 视频到三维的挑战

视频扩散模型已展现出令人印象深刻的结果和巨大潜力,尤其在三维重建领域。然而,在静态场景中生成视频时,往往会出现不期望的变化[101]——例如人体运动、物体交互和环境变化——这些变化会破坏可靠重建所需的三维一致性。作者的目标是在高效生成视频的同时确保三维一致性,从而打造一个有效工具来弥合视频与三维之间的差距。换言之,作者旨在输出符合三维一致数据分布的结果,同时排除破坏性的变化。解决这一问题的直接方法是针对特定的三维数据集对扩散模型进行微调,迫使模型与三维一致的数据分布对齐。该方法在各种风格迁移任务中已被证明是有效的,这些任务同样旨在在一个更大、更多样化的数据集中保留特定的数据分布。然而,这种方法存在两个主要挑战。首先,微调并不能提高扩散效率:生成高质量的视频输出仍然需要多达50步的去噪过程,这计算成本高昂且耗时。其次,生成过程缺乏可控性。尽管模型经过微调,但它遵循标准的扩散去噪流程,从随机分布开始,通过逐步去噪逐渐达到目标数据分布。这种随机过程使得即使在给定图像条件下,也难以强制执行一致相机轨迹和三维连贯性。

为应对这些挑战,作者提出了VideoScene,这是一种新颖的一步式、3D一致性视频生成蒸馏技术,旨在弥合从视频到3D的差距。具体而言,llm-VideoScene_2504在训练和推理过程中都结合了3D感知跳跃流蒸馏策略(第3.3节)和动态去噪策略网络(第3.4节),以最大化3D先验,从而提高视频生成的效率和可控性。

3.3. 基于三维感知的LeapFlow蒸馏

在一致性蒸馏训练[55]中,传统的噪声调度器从数据分布中采样初始真实值,并应用噪声通过正向扩散在随机时间步生成,具体方法如下:

高斯噪声 , 和 定义了随机插值 的信噪比(SNR)。标准SNR调度确保 保留部分来自 的低频信息,这导致与从完全噪声状态 开始的推理过程产生不匹配,从而在推理过程中造成性能下降,尤其是在去噪步骤较少时。尽管一些研究[37, 44]建议调整噪声调度或应用反向蒸馏以维持零终端SNR,但作者发现这些解决方案对于高效性能而言是不够充分的。

观察到初始去噪步骤(其中 接近 )由于先验信息有限而特别具有挑战性,作者提出了一种3D感知跳跃流蒸馏策略,该策略在中间时间步 , 对推理与训练进行对齐,其中 T^{\prime}<t

其中 表示成对输入图像, 是相应的相机姿态, 是Sparse视图重建模型, 是插值相机轨迹, 是给定3D表示并 Query 相机轨迹的渲染器, 是渲染视频。尽管视频显示出视觉伪影和模糊区域,但它包含了从3D表示渲染出的场景的3D几何结构信息。从视频中,作者将渲染视频 编码到潜在空间,并采样 ,在随机选择的时刻 添加噪声(根据公式4),训练梯度计算如下:

(6) 其中 由教师模型根据式 3 以 为输入进行估计,并输入到 EMA 学生模型中。为了便于理解,作者在图2 中将学生模型和 EMA 学生模型统称为一个“学生视频扩散”模型。在推理过程中,作者同样从 开始,并在选定的时刻 添加噪声,这一选择遵循策略网络而非随机方法。这将在第 3.4 节中讨论。

综上所述,作者的3D感知跳跃流蒸馏通过避免依赖真实信号并绕过在附近低效的早期去噪步骤,从而减少了训练与推理之间的差异。这一过程通过在推理期间有效模拟训练,加速了整体去噪,使学生模型能够利用丰富的先验知识,而不是从零开始。

3.4. 动态去噪策略网络

在推理过程中,作者从初始渲染的视频潜空间开始,并在选定的跳跃时间步逐步添加噪声。时间步的选择依赖于上下文:当输入视频质量较高时,添加少量噪声足以细化细节并保留整体结构。然而,当输入视频包含结构失真、模糊或光照不一致等伪影时,需要添加更大的噪声,因为极小的噪声步长可能引入不合适的先验信息,导致结构退化。反之,过度的噪声会淹没模型的先验信息,导致输出接近纯噪声并丢失关键的3D信息。因此,选择合适的去噪时间步对于最优推理性能至关重要。

为了更好地确定噪声水平,作者引入一种基于上下文 bandit 算法的策略网络 [10, 18, 61, 68]。该网络作为Agent,学习动态选择最佳时间步 进行去噪。作者将这个 选择建模为一个独立决策过程:给定环境状态(即输入视频潜在 ),Agent(即具有策略分布 的 DDPNet)决定一个动作(即噪声步 ),并接收一个奖励(即损失 )。在每次蒸馏训练轮次中, 的决策是随机做出的,并应用于输入潜在 。样本数据估计 可以计算为:

其中 是学生扩散模型中的噪声预测器。在去噪之后,预测的视频输出 使用均方误差损失与真实序列 进行比较:

梯度在此处停止,因为均方误差(MSE)损失仅用于更新策略网络。作者定义即时奖励 ,为策略网络提供直接的优化目标。该奖励信号鼓励选择产生最小重建误差的时间步长。作者通过策略梯度优化[61, 77]实现这一点,通过最小化 来调整 ,从而增加与较高奖励相关的时间步长选择的概率。

需要注意的是,在策略网络的训练过程中,仅使用蒸馏训练中的数据。为确保蒸馏过程的稳定性,策略网络不会将任何梯度传递给学生模型。

4. 实验

4.1. 实验设置

实现细节。为实现所提出的VideoScene,作者选择MVSplat [17]作为前馈3DGS模型,并采用预训练的CogVideoX-5B-I2V [96](分辨率为720×480)作为视频扩散 Backbone 网络。预训练的CogVideoX需要超过2分钟的默认50 DDIM [71]步骤。作者首先以900步、学习率1×10⁻⁴进行预热,微调视频模型的注意力层。然后利用参数固定的预训练3D模型进行蒸馏训练,共进行20k次迭代。作者的视频扩散在3D场景数据集RealEstate10K [105]上训练,通过以批量大小为2采样49帧。训练期间,仅更新视频模型Transformer块内的注意力层。训练在两天的8块NVIDIA A100(80G)GPU上进行,使用AdamW [52]优化器,学习率为3×10⁻⁵。动态去噪策略网络(DDPNet)遵循CNN架构,包含4层2D卷积以及相应的归一化和激活层。由于策略网络的参数数量远少于视频扩散模型,仅在最初的4,000步内参与完整训练,以防止过拟合。请注意,作者的VideoScene推理时间仅需3秒(3DGS前馈模型[17]的渲染时间约为0.5秒,使用DDIM [71]采样器单步生成的蒸馏视频时间约为2.5秒)。

数据集。作者在大规模3D场景数据集RealEstate10K [105]上评估VideoScene。RealEstate10K是一个从YouTube下载的数据集,分为67,477个训练场景和7,289个测试场景。为了更好地验证VideoScene的有效性,作者建立了一个具有较大角度差异的挑战性基准,在120个基准场景上进行了测试。该数据集还提供了每帧估计的相机内参和外参。作者首先使用首帧和末帧引导对视频插值模型进行微调。对于每个场景视频,作者以等间隔采样49个连续帧,并将首帧和末帧作为视频扩散模型的输入。为了进一步评估作者的跨数据集泛化能力,作者还评估了包含自然风景场景和相机姿态的视频数据集ACID [46]。

Baseline 与指标。多视图几何的基本单元是双视图几何,作者的目标是通过视频扩散在给定的两个输入视图之间生成新的、三维一致的视图。为了评估llm-VideoScene_2504,作者将其与几种最先进的开源视频帧插值模型进行比较:Stable Video Diffusion [8]、DynamiCrafter [94]和CogVideoX [96]。Stable Video Diffusion和DynamiCrafter采用基于UNet的扩散架构,而CogVideoX则使用扩散Transformer架构。在定量评估方面,作者通过报告Frechet视频距离(FVD)[82]来评估合成视频的质量和时间一致性。遵循之前的基准VBench [31],作者还评估了生成视频的美学评分、主体一致性和背景一致性作为作者的指标。更多详情请参见补充材料。

4.2. 与 Baseline 方法的比较

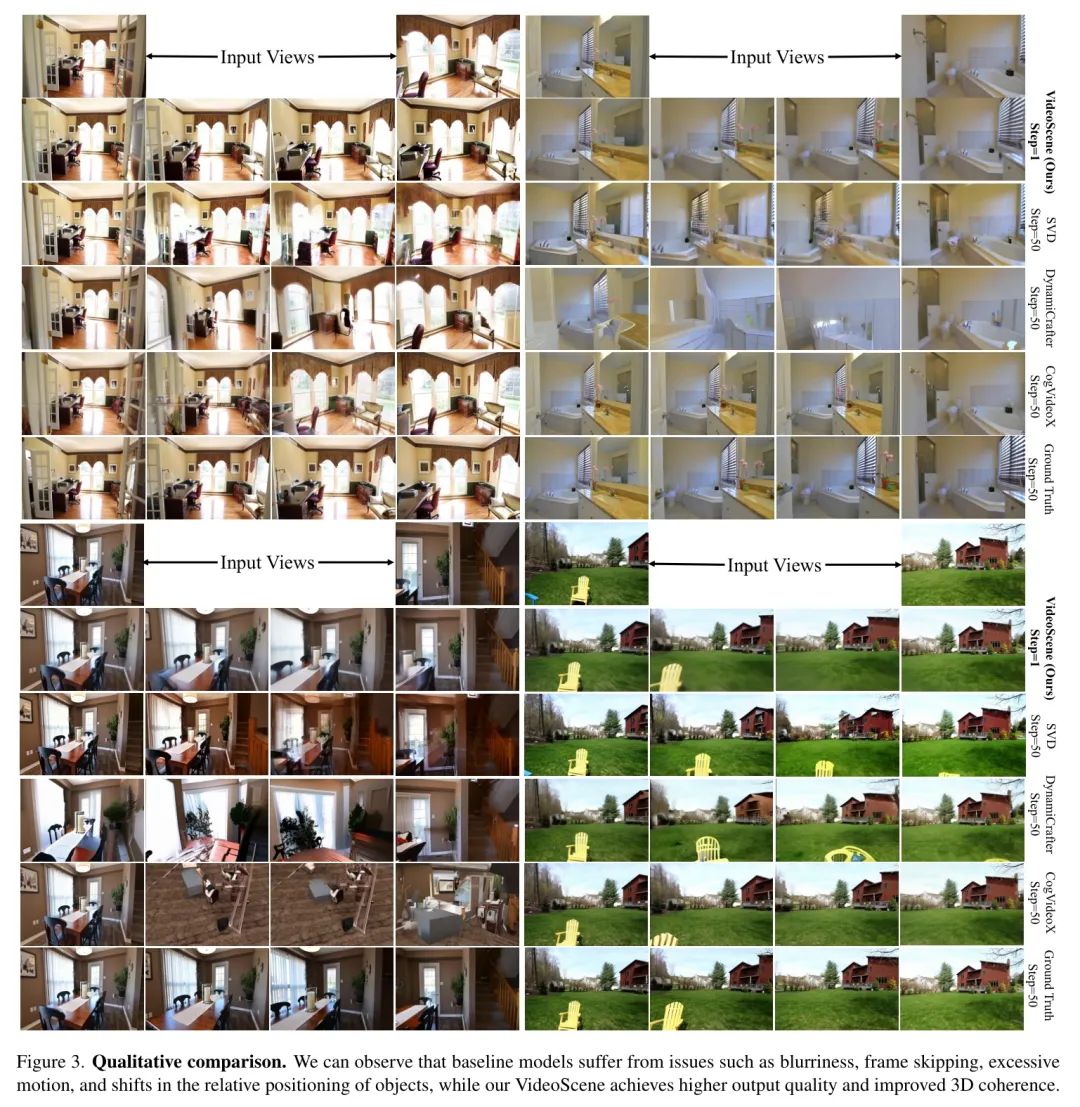

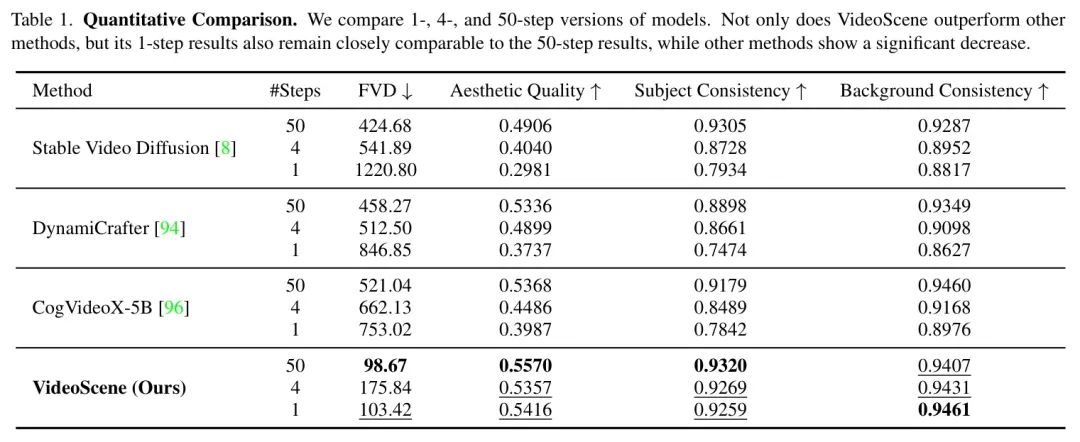

作者在表1中比较了作者的VideoScene框架与三种 Baseline 模型在不同DDIM步骤(1、4和50)上的表现。图3展示了作者的单步结果与 Baseline 模型的50步结果的视觉比较。即使仅进行单步去噪,作者的VideoScene也优于当前最先进模型,在视觉质量和与真实值的空间一致性方面均取得了更优表现。更多比较结果请参见补充材料。

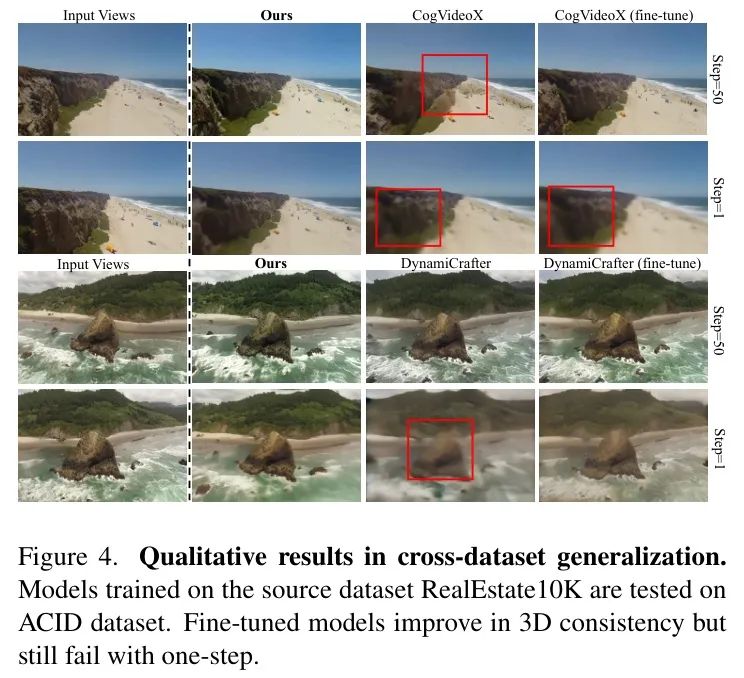

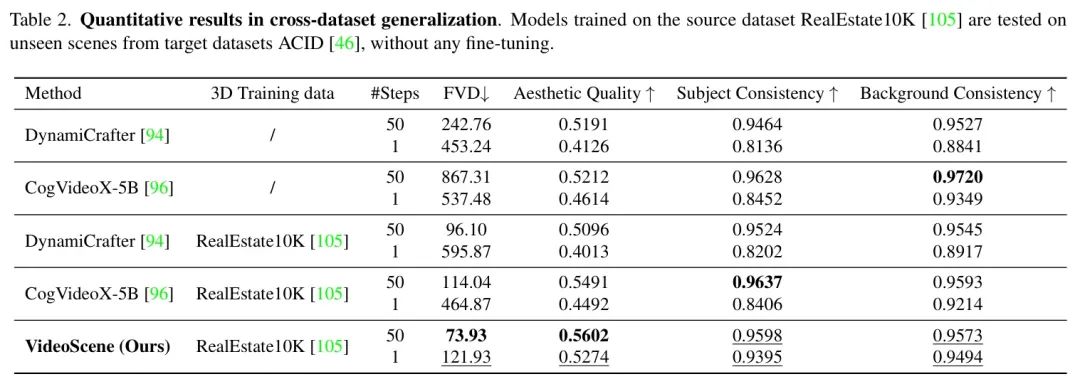

跨数据集泛化。利用具有三维结构先验的视频扩散模型的强大生成能力,VideoScene在泛化到图1中展示的新颖、分布外场景时表现出天然优势。为验证这种泛化能力,作者进行了跨数据集评估。为确保公平比较,作者在相同的3D数据集[105]上训练 Baseline 模型(包括DynamiCrafter [94]和CogVideoX [96]),并在ACID [46]数据集上直接测试它们。如表2和图4所示,虽然 Baseline 模型在3D数据上微调后通过50步推理提升了三维一致性,但它们无法通过单步推理实现清晰度。值得注意的是,llm-VideoScene_2504不仅实现了与 Baseline 模型50步推理结果相当的性能,还在单步推理中超越了它们,突显了其强大的泛化能力。

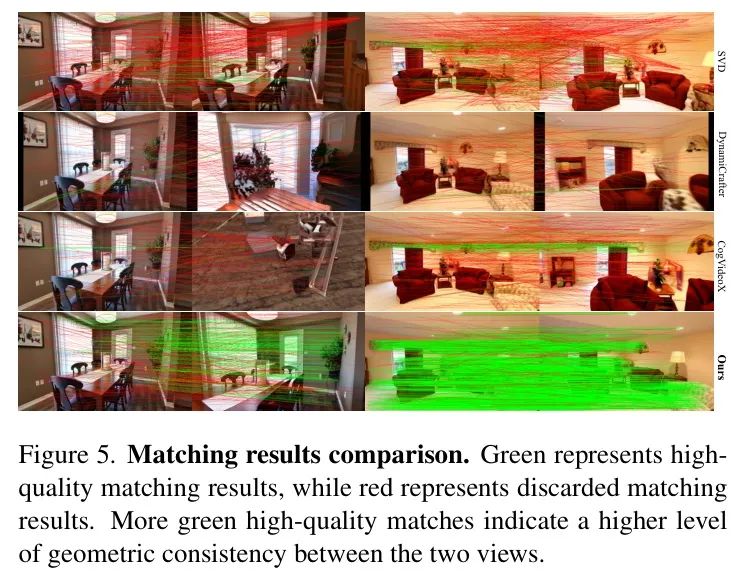

结构匹配对比。为进一步评估几何一致性,作者参照[42]的方法,评估生成视频中相邻帧之间的相机几何对齐。具体而言,作者从每段生成视频中按固定间隔提取两帧,形成双视图图像对。对于每一对图像,作者应用特征匹配算法[60]寻找对应点,并使用RANSAC[21]结合基础矩阵(对极约束)过滤错误匹配。图5显示VideoScene获得了正确匹配点数量最多,验证了其具有更优的几何一致性。

4.3. 消融实验与分析

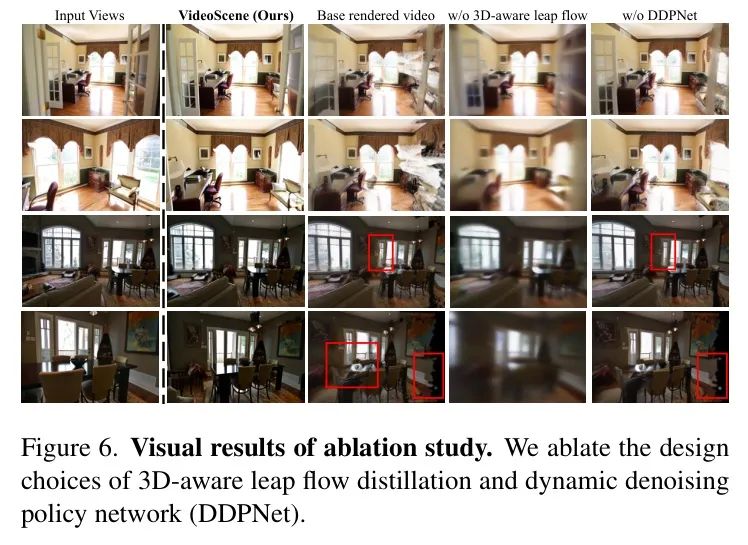

作者进行了消融研究,以分析VideoScene框架中的设计选择(参见表3和图6)。基础渲染视频表示直接从3D模型生成的视频。将3D微调视频扩散模型与标准蒸馏加速方法[87]的简单组合称为"w/o 3D-aware leap flow"。此外,作者对DDPNet进行了消融。结果表明,虽然3D模型渲染的视频质量次优,但它提供了粗粒度的信息一致性。没有3D-aware leap flow蒸馏时,生成的帧存在不一致性,导致模糊和伪影。DDPNet的加入进一步增强了细粒度细节并校正了空间失真,展示了其在最优去噪决策中的有效性。

5. 结论

本文介绍VideoScene,一个新颖的快速视频生成框架,该框架将视频扩散模型提炼为一步生成3D场景。具体而言,作者通过3D先验约束优化过程,并提出一种3D感知跳跃流蒸馏策略,以跳过耗时冗余信息。

此外,作者设计了一个动态去噪策略网络,以在推理过程中自适应地确定最佳跳跃时间步长。大量实验验证了VideoScene在效率和3D结构一致性方面的优越性,突显了其作为高效且有效工具,从视频到3D桥梁的潜力。

参考

[1]. VideoScene: Distilling Video Diffusion Model to Generate 3D Scenes in One Step

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-05-26,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录