核弹级突破!DeepEP让千亿模型训练速度狂飙200%,AI巨头集体颤抖!

核弹级突破!DeepEP让千亿模型训练速度狂飙200%,AI巨头集体颤抖!

create17

发布于 2025-03-17 13:51:17

发布于 2025-03-17 13:51:17

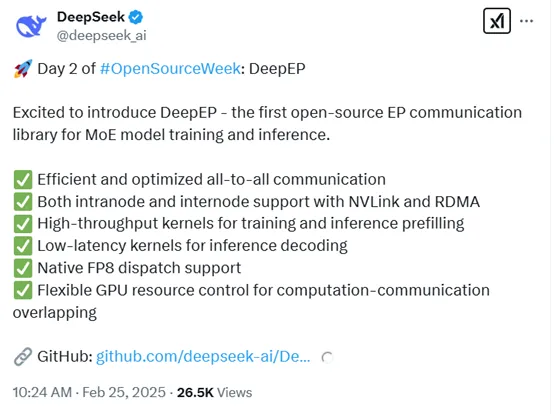

🚀【AI新基建】DeepEP横空出世!让千亿级大模型训练飞起来!🚀

DeepSeek开源周第二弹——DeepEP!这个由DeepSeek团队打造的通信库,专治大模型训练的“通信卡脖子”难题,让千亿参数的MoE模型也能跑得飞快!

图片

一、DeepEP是啥?

简单来说,DeepEP是一个“超级快递员”,专门帮AI模型的“专家团队”(也就是混合专家MoE)高效传递数据。

- MoE模型就像一个由上千个“专家”组成的团队,每个专家擅长不同任务(比如翻译、问答)。但要让这些专家协同工作,数据在团队间的传输速度至关重要!

- 专家并行(EP)把不同专家分配到多块GPU上,通过高速通信让它们协同工作。但传统方法中,数据传输常成为“卡脖子”环节,导致训练速度慢、成本高。

二、DeepEP的“超能力”

DeepEP通过三大核心技术,让MoE模型飞起来!

1、极速通信网络

- 用NVLink(单台机器内GPU直连)和RDMA(跨机器高速传输),让数据在GPU间“飞奔”。

- 比如,在400G网卡+H800 GPU上,跨机器传输速度可达46GB/s!

2、低延迟推理

- 推理时用纯RDMA技术,延迟低至163微秒(眨眼间的事儿),让ChatGPT秒回消息!

3、智能资源调度

- 支持“边算边传”:计算和通信同时进行,不让GPU闲着偷懒。

- 还能灵活控制GPU资源,让算力全开!

三、实际效果有多猛?

- 训练速度在2048块GPU上,DeepEP让MoE模型训练效率飙升,成本大幅降低!

- 模型表现配合DeepSeek-V3算法,模型性能和稳定性双优,彻底打破“大模型=高成本”的魔咒。

- 社区反响开源2小时Star量破千,网友直呼:“这才是真正的OpenAI!”

四、未来已来

DeepEP的开源,标志着AI基建进入新阶段:通过优化通信效率,让千亿级大模型触手可及。无论是企业级AI训练,还是个人开发者玩转大模型,都将迎来“飞一般”的体验!

GitHub仓库:https://github.com/deepseek-ai/DeepEP

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-02-25,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录